[PR]

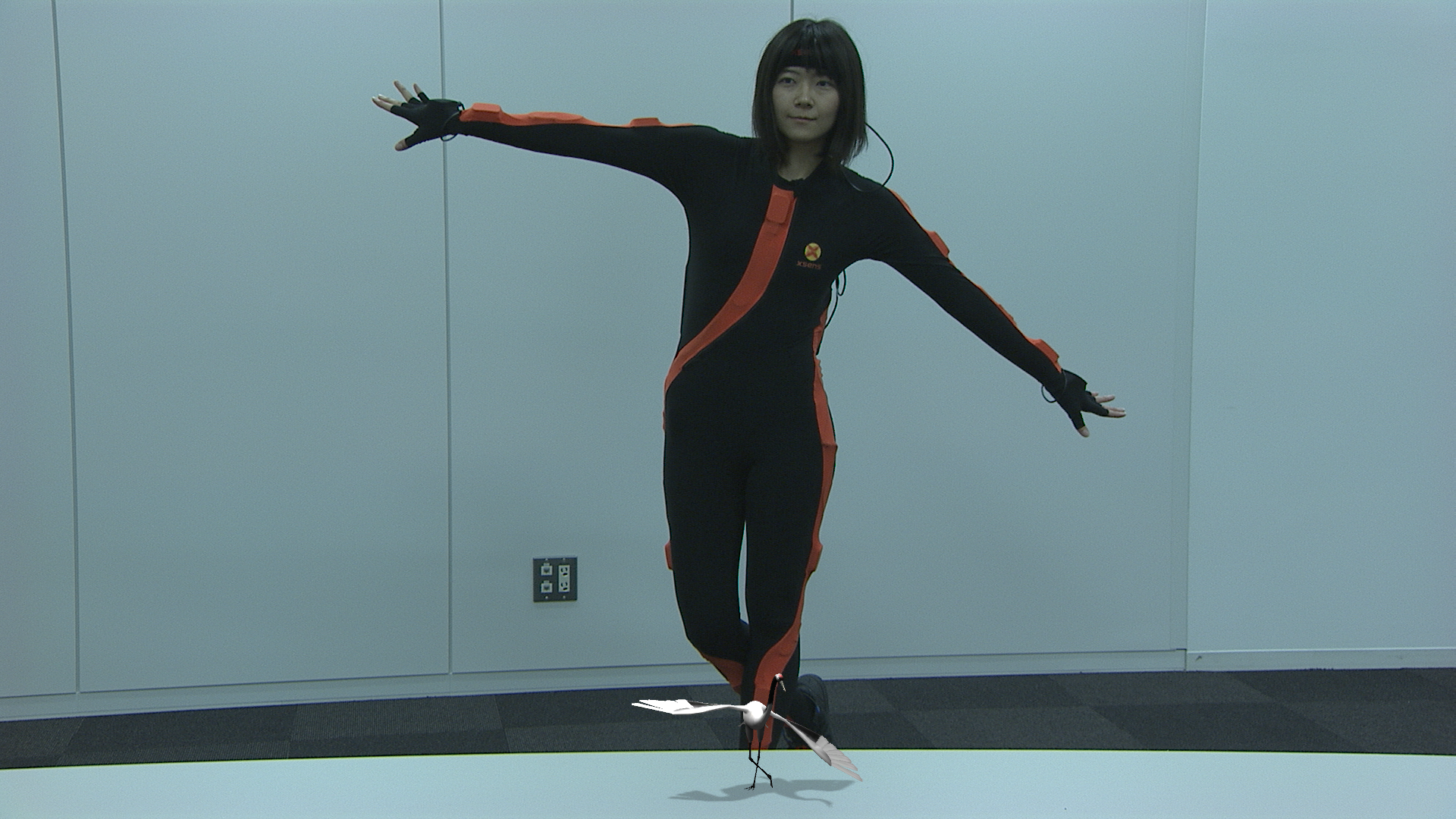

MVNは17個の慣性センサーを搭載したフルボディスーツで、既存の3DCG開発パイプラインにも簡単に統合できる柔軟性をもつ。プレミアムエージェンシーでは自社開発の3Dグラフィックスエンジン「Chidori」にモーションキャプチャデータを流しこみ、リアルタイムにキャラクターを制御。テレビ放送やイベントなどの現場で活用してきた。そんな同社スタッフに、MVNの使用事例と可能性について伺った。

人間型のキャラクターならモンスターやデフォルメキャラなど幅広くデータを活用でき、大きさも自由に変えられる。当たり判定を設定すれば、画面内で3Dキャラクターがバーチャルアイテムと高度なインタラクションをとることも可能だ。事前に用意しておいたアニメーションをキー操作で再生することもでき、目パチや口パクや特徴的な仕草ができる。複数のカメラやMVNと接続することもでき、MVN Studioを複数台連動させて、4人以上のCGキャラクターをリアルタイムに動かすことも可能となっている

▼About Company

株式会社プレミアムエージェンシー

ゲーム会社の主力スタッフを中心に2003年に起業。現在は3DグラフィックスエンジンChidoriを中心に、ゲーム・アニメ・映画・プリビズ・AR・VRなど、様々な分野で高品質な3DCGを駆使した作品を企画開発している。

http://www.premiumagency.com/

▼About Project

Chidori

2006年に誕生した、日本発の純国産3Dグラフィックスエンジン。3Dグラフィックの基本機能をひと通り備えているほか、マルチプラットフォームにも対応しており、家庭用ゲーム機やスマートフォンなど、デバイスの垣根を越えて3Dコンテンツの開発ができる。企業・教育機関向けに無料公開も行なっている。

http://www.chidoriengine.com/

徹夜でセッティングをした苦労が解消

わずか1時間で番組収録を可能に

CGWORLD(以下、C):MVNを手軽なモーションキャプチャツールとして使用する企業が多い中で、御社はMVNと3DグラフィックスエンジンChidoriと連動させて、テレビの番組放送やイベン ト演出向けに活用している点が興味深いです。

鐘井大貴氏(以下、鐘):ありがとうございます。弊社ではこれらを「LiveAR」と呼んでいて、2年前に本格スタートしました。もっとも、従来は光学式モーションキャプチャを使用していましたが、テレビ局のスタジオなどでは徹夜で準備しても精度に限界がありました。周りがゴチャゴチャしていて光学式カメラの設置場所が限られたり、しっかり固定できず映像が震えたり......。そこでMVNをテストしたところ、格段に効率がアップしたんです。今では準備に1時間もあれば大丈夫ですね。

C:MVNとLiveARを組み合わせることで、表現の幅がさらに広がりそうですね。

薬師寺賢氏(以下、薬):LiveARのViewerはいわば、バーチャルスタジオのようなものです。MVNで取得したモーションキャプチャデータを3Dキャラクターに流し込み、Viewer上でエフェクトをつけたり、キャラクターの動きに合わせて髪をなびかせたりできます。別途カメラで撮影した現実の映像と重ね合わせて、ARやVRコンテンツとして活用することもできます。

C:ズームやパンもできるのが驚きました。

和田重久氏(以下、和):番組演出には欠かせませんからね。他にこれまでテレビ番組のCGキャラクターは、事前に複数の動きを用意しておき、キー操作で切り替えるやり方でしか演技させられませんでした。それがアクターの動きに合わせてリアルタイムに演技が可能になり、喜ばれました。光学式とちがい、動きでマーカーが隠れてもデータや表示に不具合が出ることもありませんし。

C:MVNとChidoriの連携はうまくいきましたか?

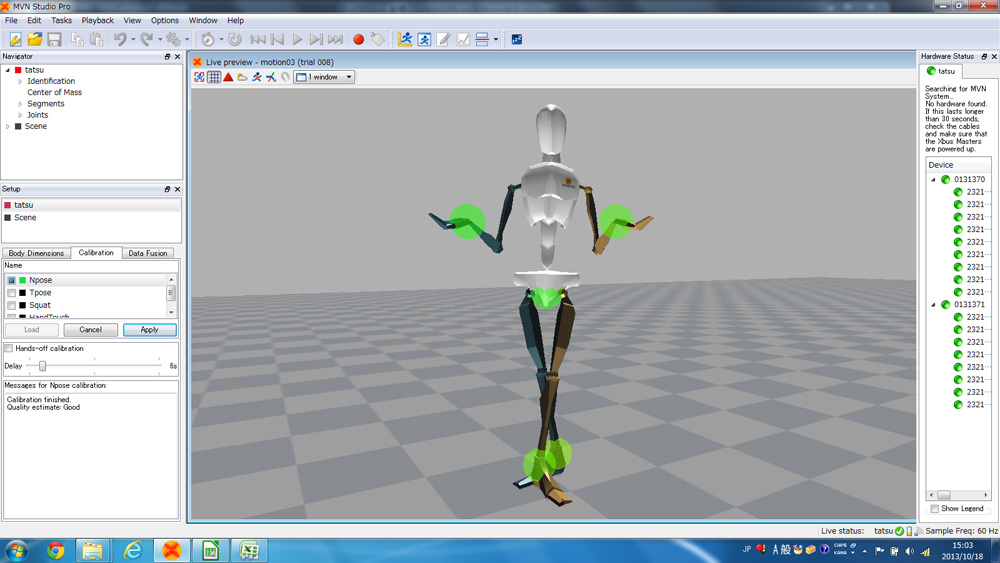

薬:光学式モーションキャプチャとの連動を以前より取り組んでおり、MVN Studioにストリーミングサーバーの機能があるため、それらを利用することでモーションキャプチャデータをChidoriに流し込むのは容易でした。専用プラグインなどを自作する必要がありましたが、昨年11月に導入して組み込みとテストで1ヶ月ずつ、約2ヶ月で実働できました。

C:運用にはどれくらいの人数が必要ですか?

和:4人もいれば十分ですね。LiveARのオペレータが1人、MVNのアクター補助に1名、撮影技術に1-2名程度です。先方に専門のカメラマンやアクターがいれば、もっと省力化できます。

C:スーツの着心地などはいかがですか?

深澤瑠美子氏(以下、深):通気性が良くて、涼しいくらいです。テレビ局のスタジオなどは照明で暑いので、アクターも楽だと思います。

光学式とMVNの併用で広がる演出

東京オリンピックも視野に入れて活動

C:生放送やイベントなどでは失敗できませんが、システムの信頼性はいかがですか?

鐘:LiveARをAR番組などで運用して2年になりますが、一度も事故が起きたことがないんですよ。MVNとの連動でも非常に安定しています。またキャプチャデータを保存し、素材として活用することもできます。つまりリハーサル時にアクターの動きを保存しておけば、最悪の場合でも本番で再生して使えるのです。

C:データのキャリブレーションは容易ですか?

和:床にきちんと設置するように、最初にViewer上でキャラクターの高さを調整するなどが必要です。ただ、ものの数分で設定は終了します。

C:今後試したい活用法などはありますか?

薬:サイバーグローブで指の動きをとったり、フェイシャルキャプチャと組み合わせたり。光学式とMVNの併用もしてみたいですね。LiveARなら全てのデータを統合して使えます。MVNは手軽な反面、取得データが相対値で、絶対値が取れません。そのため現状ではアクターの手の位置に合わせて、エフェクトを自動的に発生させるなどができないのです。そこでデータグローブにマーカーを付けておき、ダンスしながら指を鳴らして多彩なエフェクトを繰り出す、などが考えられますね。

C:東京オリンピックの開催も決まり、ARやVRを駆使した番組放送も広がりそうです。

鐘:7年後にどのような技術が誕生しているか不明ですが、LiveARを核とした番組演出を洗練させて、史上初のAR、VR番組やイベントが楽しめるオリンピックを実現させたいですね。そのためにもMVNとLiveARの組み合わせで、様々な技術・運用実績を蓄積していきたいと思います。

C:今後が楽しみですね。期待しています。

POINT 1

自社エンジンChidoriとの連携で

多彩な映像表現を可能

撮影ではMVNがインストールされたノートPCと、LiveARがインストールされたワークステーションが用意された。互いにLANで結ばれ、キャプチャーデータがLiveAR Viewer上に送られる仕組みだ。別途カメラで撮影された実写映像と合成され、出力される。

POINT 2

放送局の機材などに幅広く対応

遠隔地でのリアルタイム配信もできる

MVNとLiveARの組み合わせは、ペデスタルやクレーンなど、多彩な放送用機材に対応する。テレビ局のバーチャルスタジオにMVNとLiveARを搬入すれば、すぐに番組収録が可能になるのだ。データをインターネットで配信すれば、遠隔地でアクターのキャプチャデータを取得し、リアルタイムに活用することも可能。距離に伴う遅延さえ考慮すれば、場所を選ばずに使用できる

TEXT_小野憲史

<関連する記事>

検証! 慣性式モーションキャプチャ「MVN」第1回:セットアップから撮影まで

検証! 慣性式モーションキャプチャ「MVN」第2回:撮影から Autodesk MotionBuilder へのインポート

検証! 慣性式モーションキャプチャ「MVN」第3回:キャプチャデータの運用

慣性式モーションキャプチャMVN導入で実現した、コンパクトなモーション撮影

慣性式モーションキャプチャMVNの活用で実現する、アニメの品質向上と効率化

慣性センサー式モーションキャプチャMVNを遊技機案件で活用し迅速なリテイク対応を実現