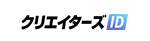

東雲めぐが「生出演」を果たした「AniCast!東雲めぐちゃんの魔法ができるまで」

©うたっておんぷっコ♪/©Gugenka® from CS-REPORTERS.INC

3日目の早朝に行われた株式会社エクシヴィによる「AniCast!東雲めぐちゃんの魔法ができるまで」では、同社の開発したOculus RiftとOculus Touchを用いた最小限の構成で自宅から1人で配信を行うことができるVRアニメキャスティングツール「AniCast」についての解説が行われた。登壇したのは代表取締役社長・近藤義仁(GOROman)氏 、ビジュアルディレクター・室橋雅人氏、Unityエキスパートエンジニア・狩野成太氏、リードオーディオプログラマー・吉高弘俊氏の4名。

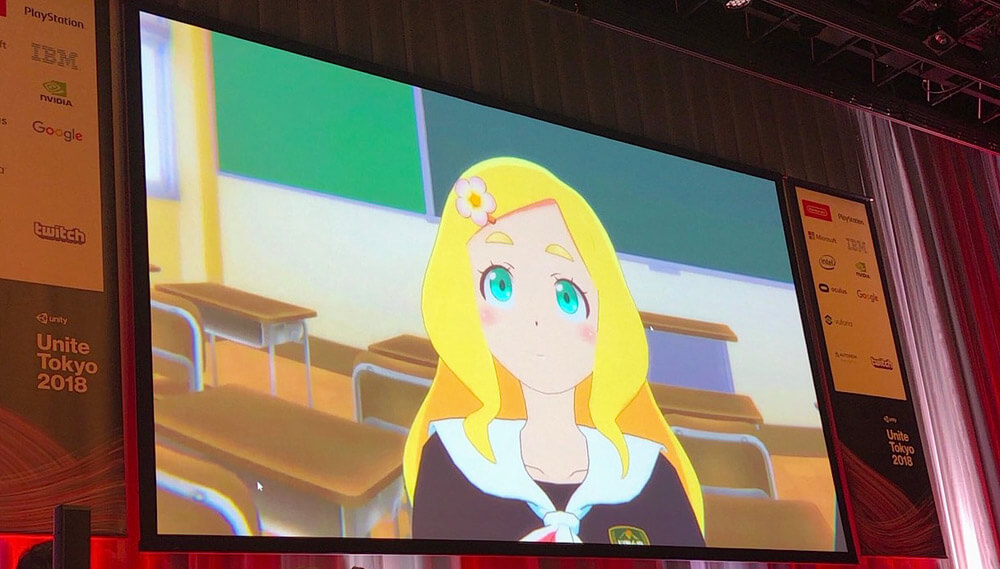

冒頭、会場から大きな反響があったのは、室橋氏が説明した「目の表情」について。実際の人間の目の動きを参考にしながら、眼球だけでなくまぶたや周辺の筋肉の動きをキャラクターに採り入れたことにより、自然な目線の動きを実現しているという。

©うたっておんぷっコ♪/©Gugenka® from CS-REPORTERS.INC

また、感情と感情の間にはながれがあり、例えば「喜び」の対になる「悲しみ」に感情が移行する際は何かしらの大きな反応が必要であると説明があった。そのため、フェイシャルの演技を変えるときも、複数の表情が入るようにしているとのこと。

©うたっておんぷっコ♪/©Gugenka® from CS-REPORTERS.INC

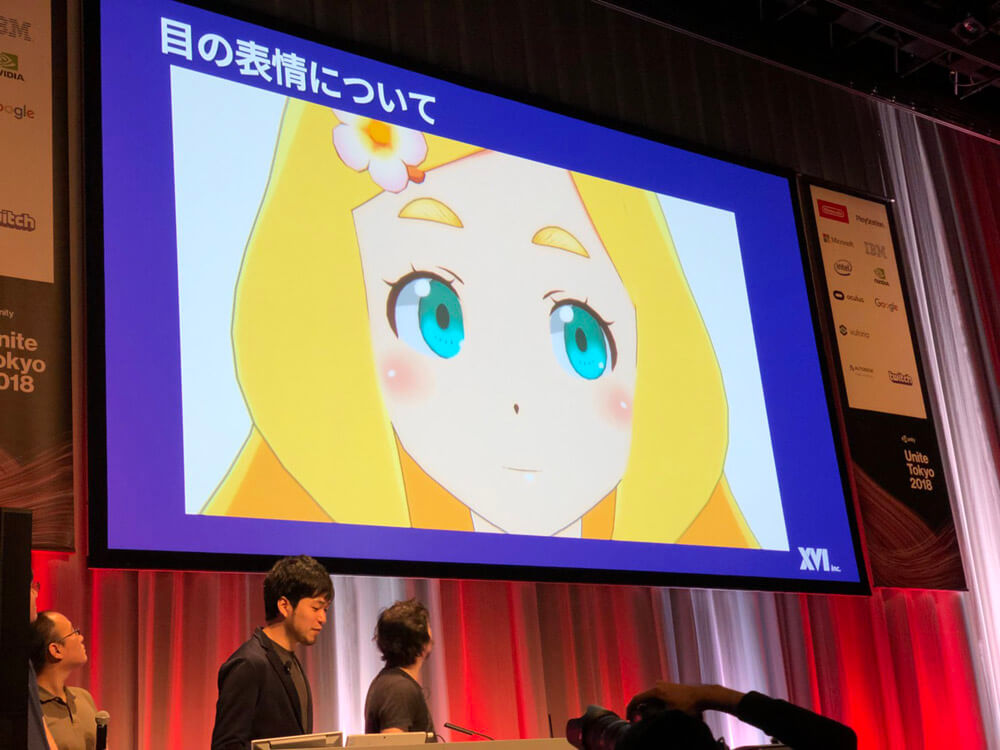

VTuberを語る上で欠かせないプレゼンスについては、「日本語でいうと実在感。プレゼンスが高まると、そこにいるかのような錯覚が起こる」(近藤氏)と説明があり、その後も狩野氏によってプレゼンスを阻害しないよう工夫した点について説明された。狩野氏によると、キャラクターの腕や胸が貫通しないことはもちろん、「人間の体はしなるので、重力や加速度を意識した動きをつくっている」とのこと。

また、興味深かったのは「一度実装したものの、不採用とした要素」についてで、講演内では「音声による感情の変化」、「右スティックによる目線移動」の2点が挙げられた。前者は声量から感情を特定できず、表情との相違が生まれることから、後者は表情を意識しながら目線を操作することの難しさから「手軽に使える」というコンセプトとの乖離が生じたためにいずれもAniCastでの採用は見送ったという。

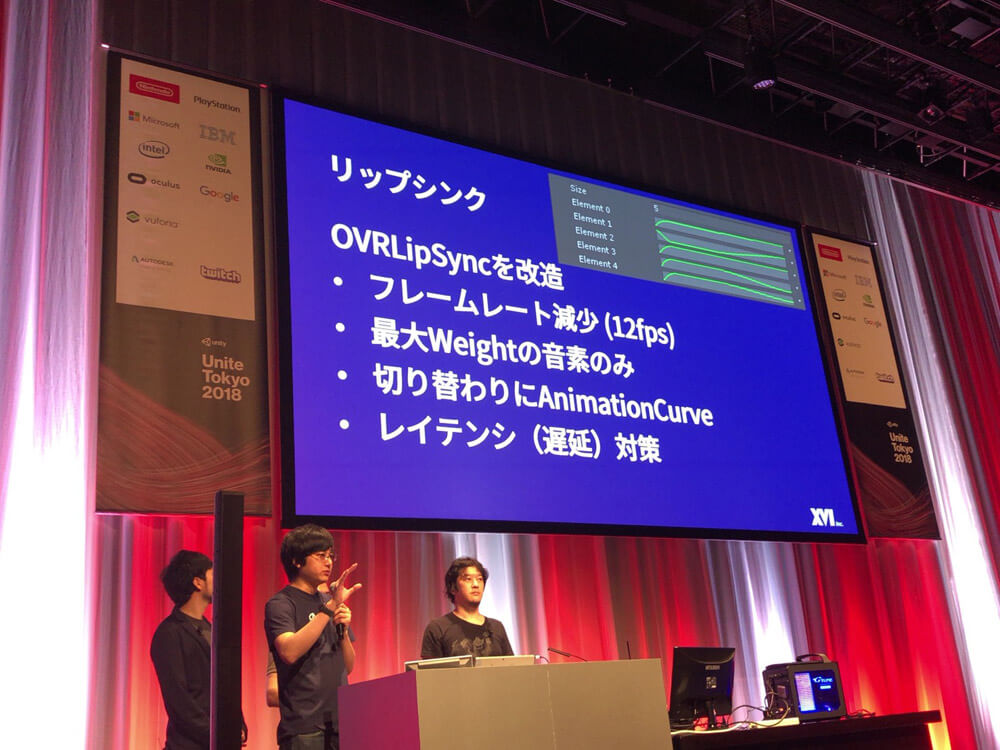

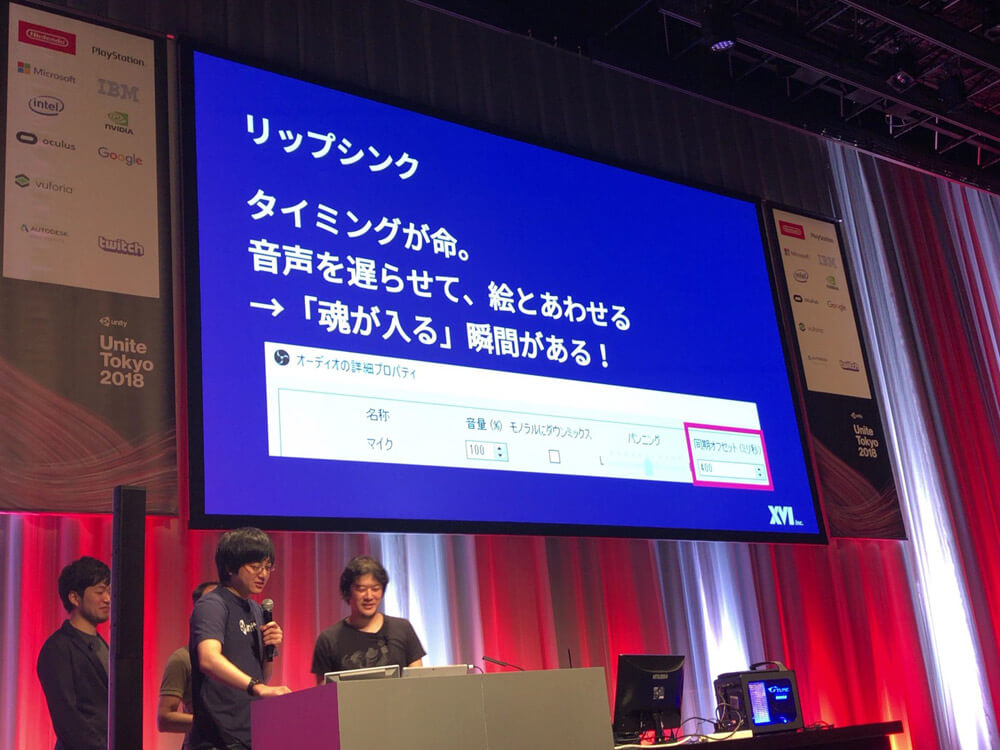

その後は吉高氏によるリップシンクについての解説があった。吉高氏は、OculusのUnity向けリップシンクライブラリOVRLipSyncをそのまま利用するだけではアニメ的な表現にならないため、動きを12fpsに固定するとともに母音の最大ウェイトの音素のみを抽出し、口の動きを作ることでアニメ的な表現を可能としたと説明する。加えて、音声が入ってから口が開くまでのバッファリングの遅延(レイテンシ対策)を配信ソフトウェアOBS Studio側で行い、「魂が入る」瞬間を探っていったという。

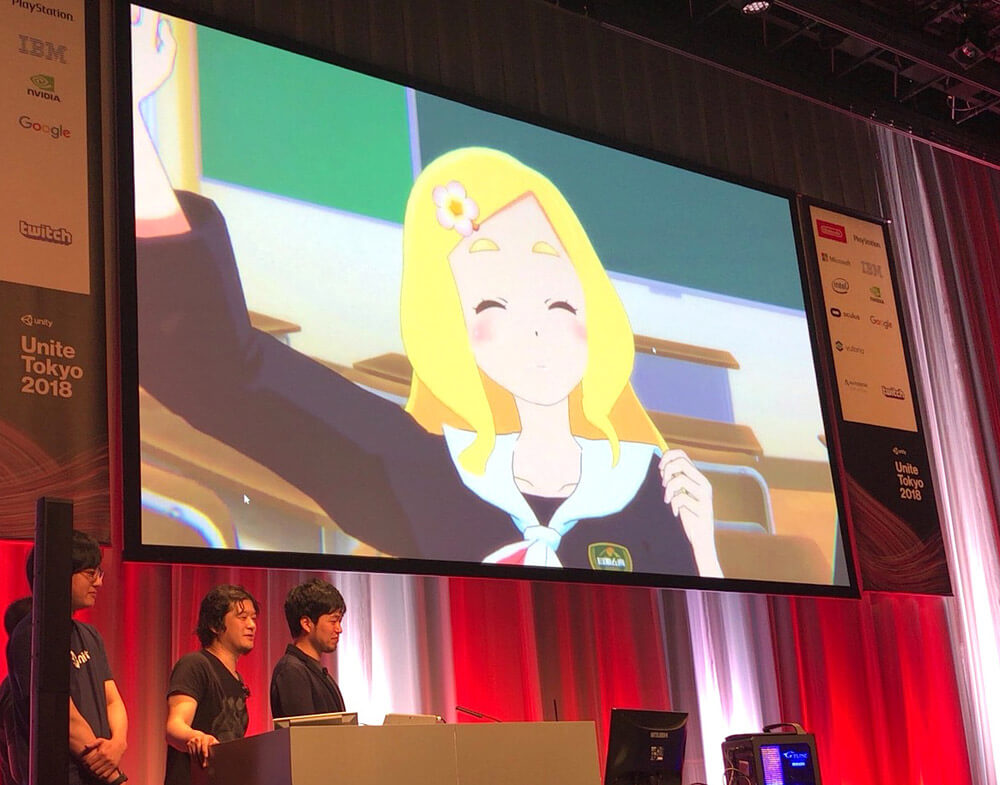

さて、ここまでは従来通りのUnite技術セッションという様相を呈していたが、GOROman氏がZoom(企業向けのビデオ会議とWeb会議サービス)とAniCastによって東雲めぐ本人を会場に呼んだことにより、状況は一変。その後の東雲めぐを交えて行われた質疑応答では、S席周辺を中心に大いに盛り上がりを見せた。質問者はGOROman氏のPCの前に立ち、東雲めぐ本人とコミュニケーションを取りながら、今後のAniCastの展望や今朝の朝ごはんの内容まで様々な質問を行なっていた。

©うたっておんぷっコ♪/©Gugenka® from CS-REPORTERS.INC

株式会社エクシヴィ/AniCast開発チーム(左から吉高氏、室橋氏、GOROman氏、狩野氏)

このように、一言で「VTuber登場」と言っても、その形態や内容は様々。可愛いアニメ調の見た目ながら骨太なアセット紹介をしてみせた電脳少女シロや、AniCastの実例として最高のタイミングでデモンストレーションを行なった東雲めぐなど、いずれの講演も非常に示唆に富んだ内容だった。いずれの講演も動画のアップロードが予定されているため、より詳しい情報を得たい方は併せて公式サイトも確認してほしい。