SIGGRAPH 2018の「Real-Time Live!」発表者

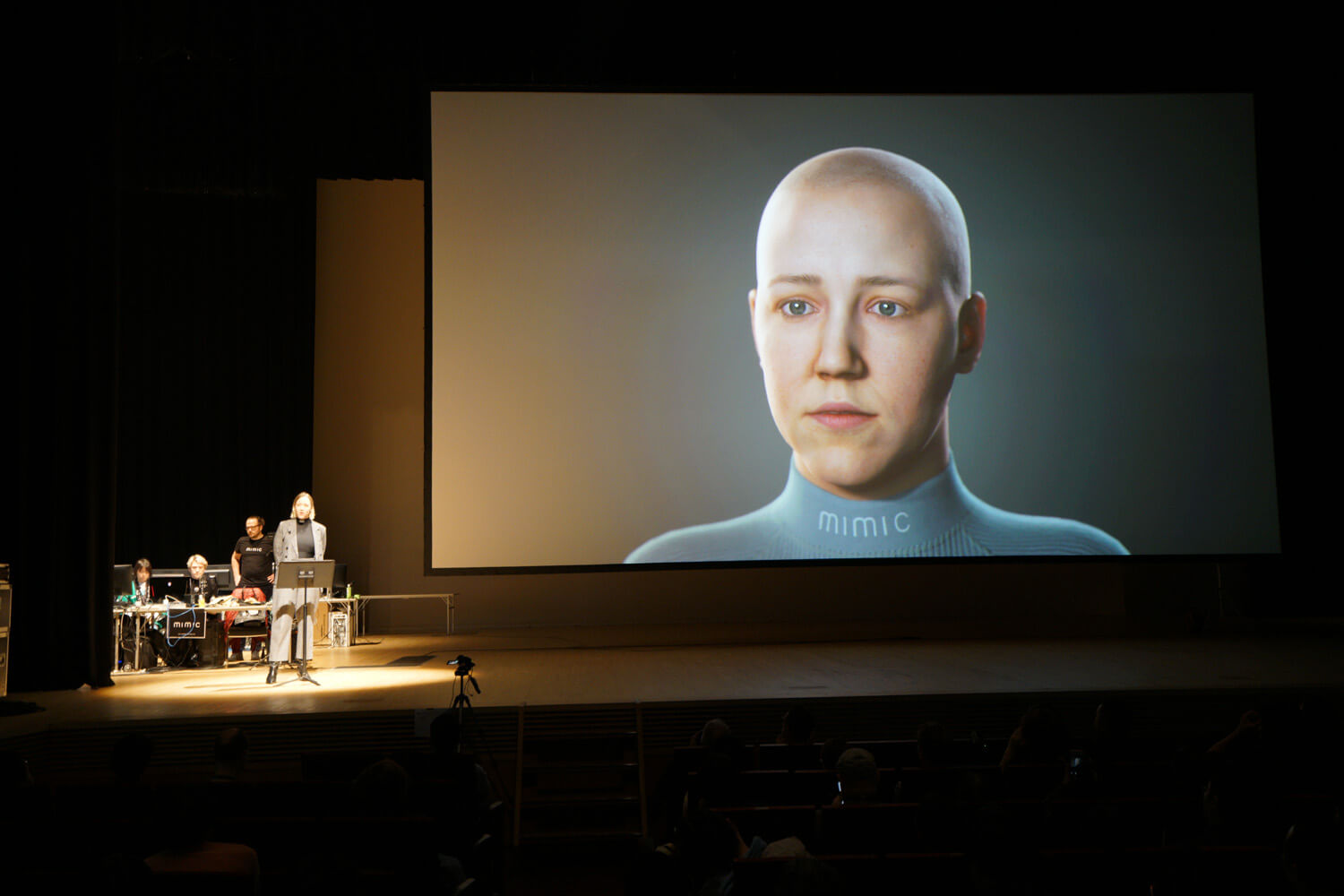

北米SIGGRAPHの場合はとても広い会場・ステージのため、発表者もステージ上の見えやすい位置でデモンストレーションを行うが、日本での「Real-Time Live!」はステージ利用の制限により、少し隠れた位置でのデモンストレーションとなってしまった。各チームのもち時間は15分。その短い時間のなかで技術的要素、エンターテインメント的要素、さらにリアルタイムならではの要素をアピールしなければいけない。また観客たちもCG/VFX業界の専門家たち、アーティストたちであり、とても難易度が高いデモンストレーション環境であったとも言える。

MR360 Live: Immersive Mixed Reality with Live 360° Video

ヴィクトリア大学(ニュージーランド) CMIC(コンピュテーショナル・メディア・イノベーション・センター)

SIGGRAPH 2018発表招待作品

MR360 LiveはDreamfluxプロジェクトによる、リアルタイム配信中の360度映像の中に違和感なく3DCG映像を重ねるMRのデモンストレーション。日照の度合いや周囲の環境に応じてCG映像に影がつき、色合いや輝きも環境の変化に応じて変わっていく様子をアピール。彼らが「augmented teleportation(拡張テレポーテーション)」と呼んでいるステージ上の2拠点間を結んだリアルタイム360度映像のビデオ会議のデモや、まだ何もないオフィスの部屋に3DCGの家具を配置してみるデモが披露された。

An Architecture for Immersive Interactions with an Emotional Character AI in VR

スクウェア・エニックス(日本)

スクウェア・エニックスによる『An Architecture for Immersive Interactions with an Emotional Character AI in VR』は、仮想環境における自然言語による会話インタラクションのデモ。3DVR空間中にいるエイリアンに自然な言葉でお願いごとをすると、その言葉や指定した色、手順を理解した上でエイリアンがちょこまかと動き、ロケットの修理作業を行うというもの。デモそのものは日本語で行われたが、英語でも認識できるよう拡張作業中とのこと。

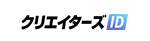

"REALITY: Be yourself you want to be" VTuber and presence technologies in live entertainment which can make interact between smartphone and virtual live characters

GREE(日本)

GREEのデモンストレーションは「全人類が『なりたい自分で、生きていく。』世界を実現する」をテーマにVTuber向けのソリューションを紹介するものだった。顔のトラッキングにはiPhone X上で動くアプリ、モーションキャプチャスーツはXsens製のものをIKINEMA LiveAction経由で利用し、手の動きにはStretchSenseスマートグローブを用いている。出演者の人数やライブ番組の設計、電波や演者のための環境などの環境に応じて、HTC Viveによる独自開発のトラッキングシステムとXsensを併用しており、今回のデモでは有線接続のXsensが利用された。

2人のアクターによるアニメキャラクターが登場するVTuber番組風のデモであり、配信中に視聴者がアイテムやプレゼントを購入することができるという仕組みになっていた。

REALITY - Real-Time Live! in SIGGRAPH Asia 2018 Tokyo - behind the scenes - 4K

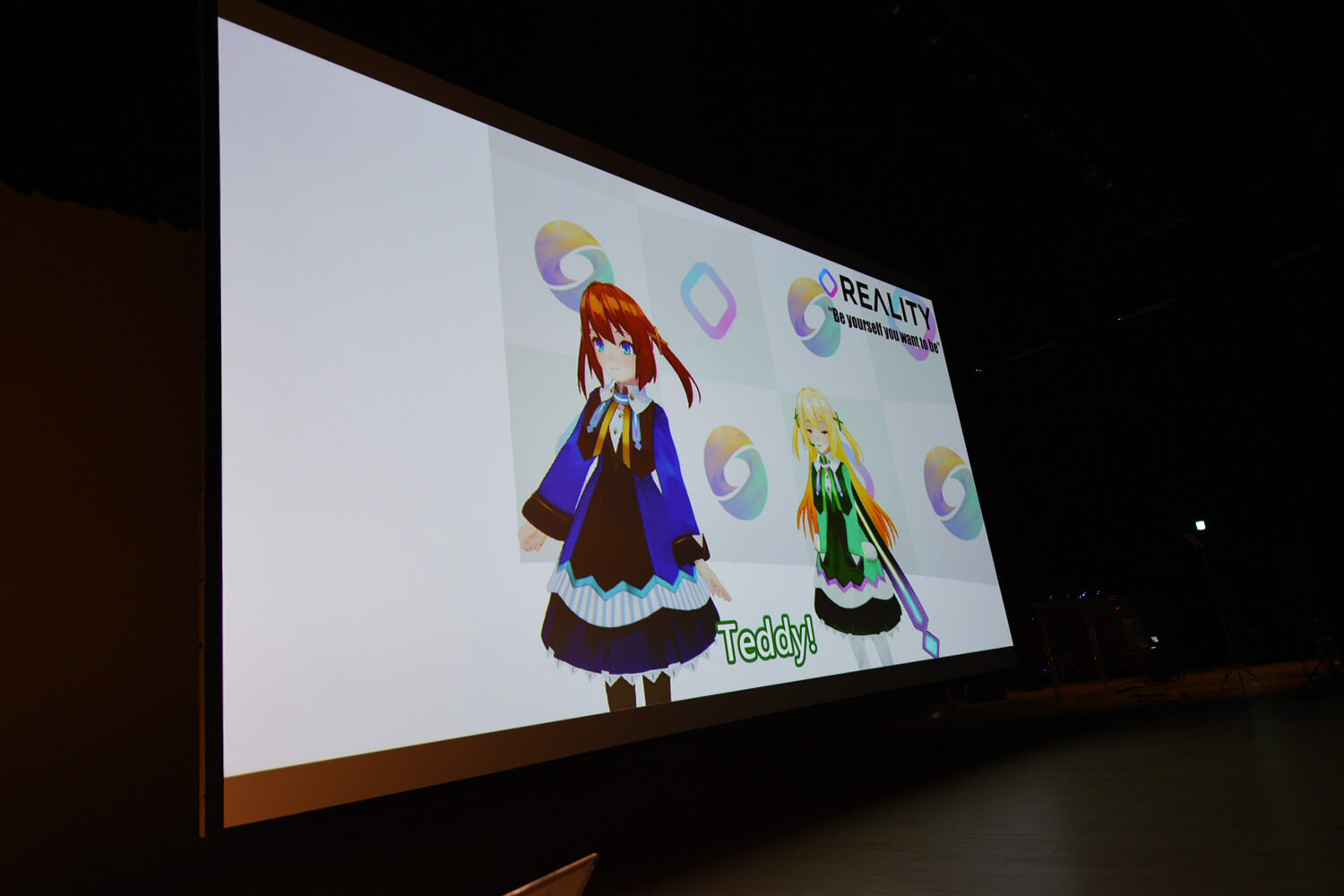

More Real, Less Time: Mimic's Quest in Real-Time Facial Animation

Mimic Productions(ドイツ)

Mimic Productionsのデモは、同社CEO Hermione Mitford氏が技術面とアート面の両側から解説しつつ行われた。フェイシャルキャプチャはデプスカメラを搭載した iPhone Xで行われ、iPhone側で取得できる51のブレンドシェイプを利用、描画はUnreal Engine 4で行われている。キャラクター表現はフォトグラメトリー技術を活用したもので、顔だけでなく首の部分もカバーしたものだそう。3Dモデルとしては髪ありのものも用意したが、いくつかの理由から今回のデモでは髪なしのものが使用された。キャプチャの途中で、キャプチャ元となる人間が入れかわっても、キャリブレーションなしですぐに追従することができていた。

Pinscreen Avatars in your Pocket: Mobile paGAN engine and Personalized Gaming

Pinscreen、USC Institute for Creative Technologies(アメリカ)

SIGGRAPH 2018発表招待作品

Pinscreenはモバイル機器を活用したアバターアプリで、スマホゲーム内で動くキャラクターをパーソナライズするためのソリューション。一枚の写真画像を元にアバターを制作できるため簡単に利用することができる。今回、デモに使用された「Pinscree」や「Pinscreen Face Tracker」がAppStoreでも無料配信されている。発表では、各国首脳をアバター化し笑いを誘っていた。

Real-time character animation of BanaCAST

バンダイナムコスタジオ(日本)

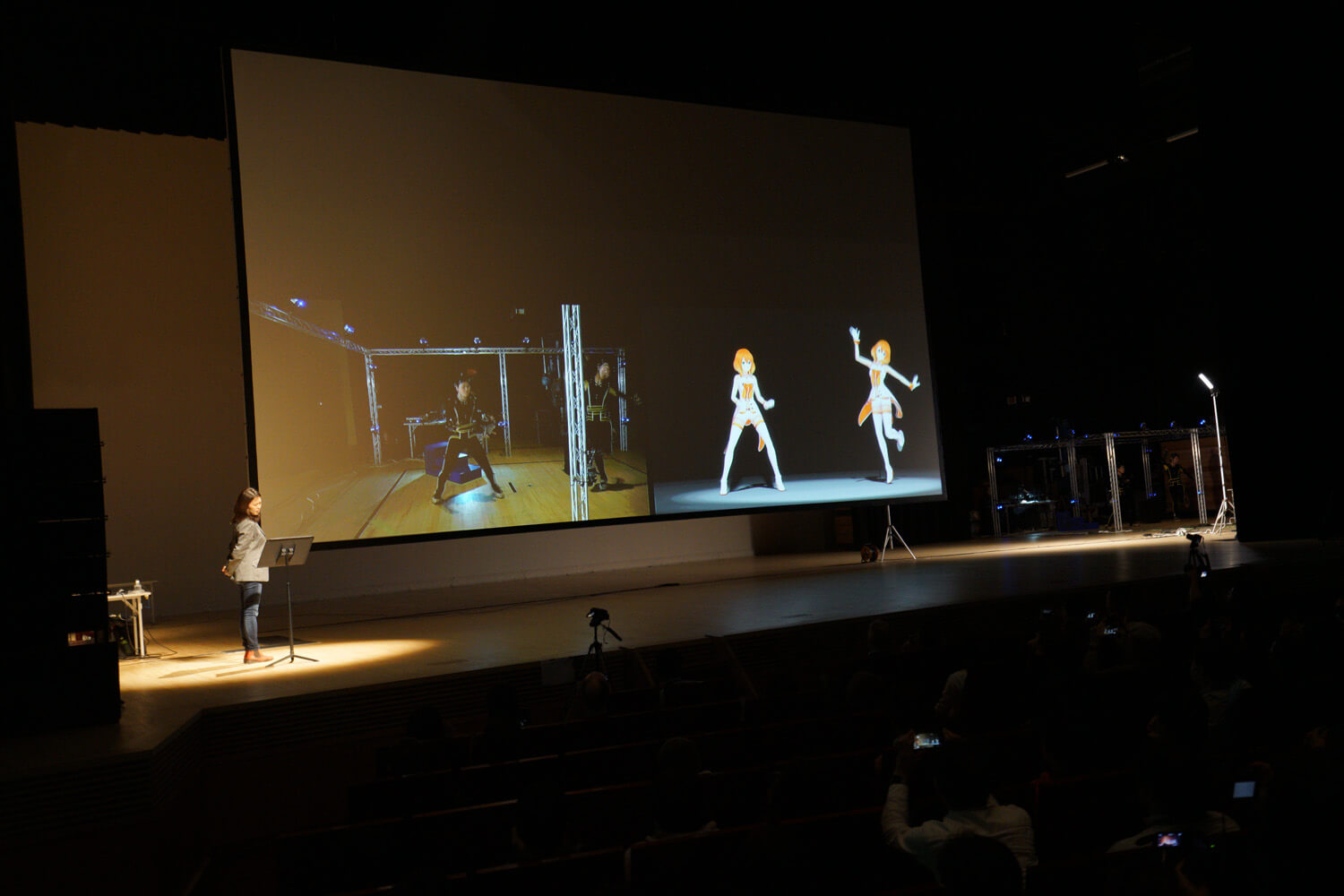

バンダイナムコスタジオによるデモは、会場の奥に設置されたライブキャプチャシステムを使った2人のアクターによるアニメキャラクタのリアルタイム配信BanaCASTの紹介。設置が数時間で行なえるため、音楽ライブの会場やイベントなどでの利用も想定されているとのこと。歌と踊りを含め、デモでは2人だったが、最大6人までのライブが可能だという。階段や椅子といった現実世界の物体を画面の中でもうまく扱えるしくみになっていた。

The Power of Real-Time Collaborative Filmmaking 2

PocketStudio(フランス)

SIGGRAPH 2018発表招待作品

PocketStudioは東京とパリを結んで、リアルタイムの映画編集のデモを行なった。3人のアーティストが同時にアニメーション作成から、オブジェクトの配置、カメラの動き、カット割りなどの作業を実施し、簡単なCG映像シーンではあったが、デモの時間内で1つの動画を完成させることができた。実際のCG映像制作で使うためにはまだまだ課題がありそうだが、場所と時間の制限を取り払うツールとして大変興味深いものだった。

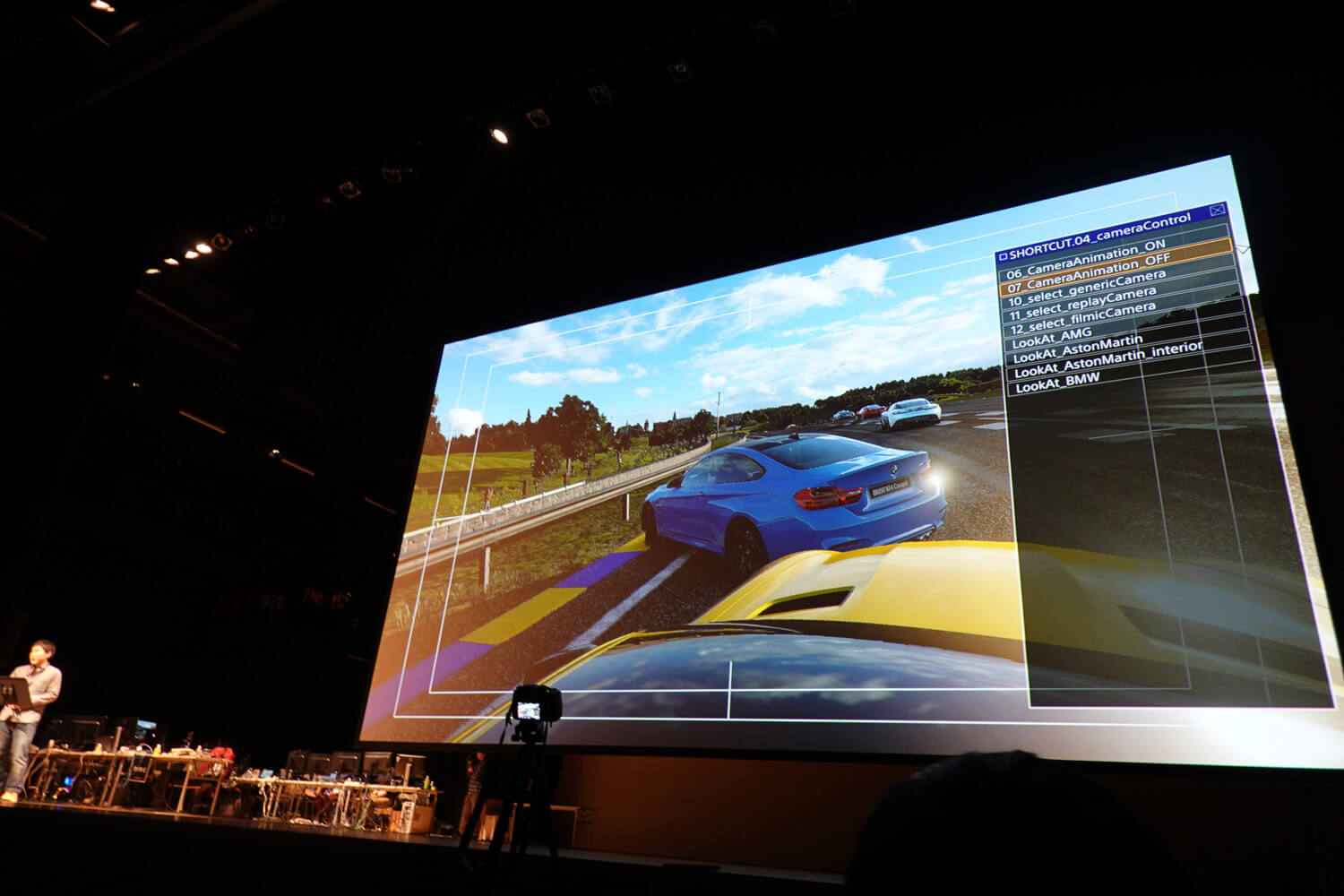

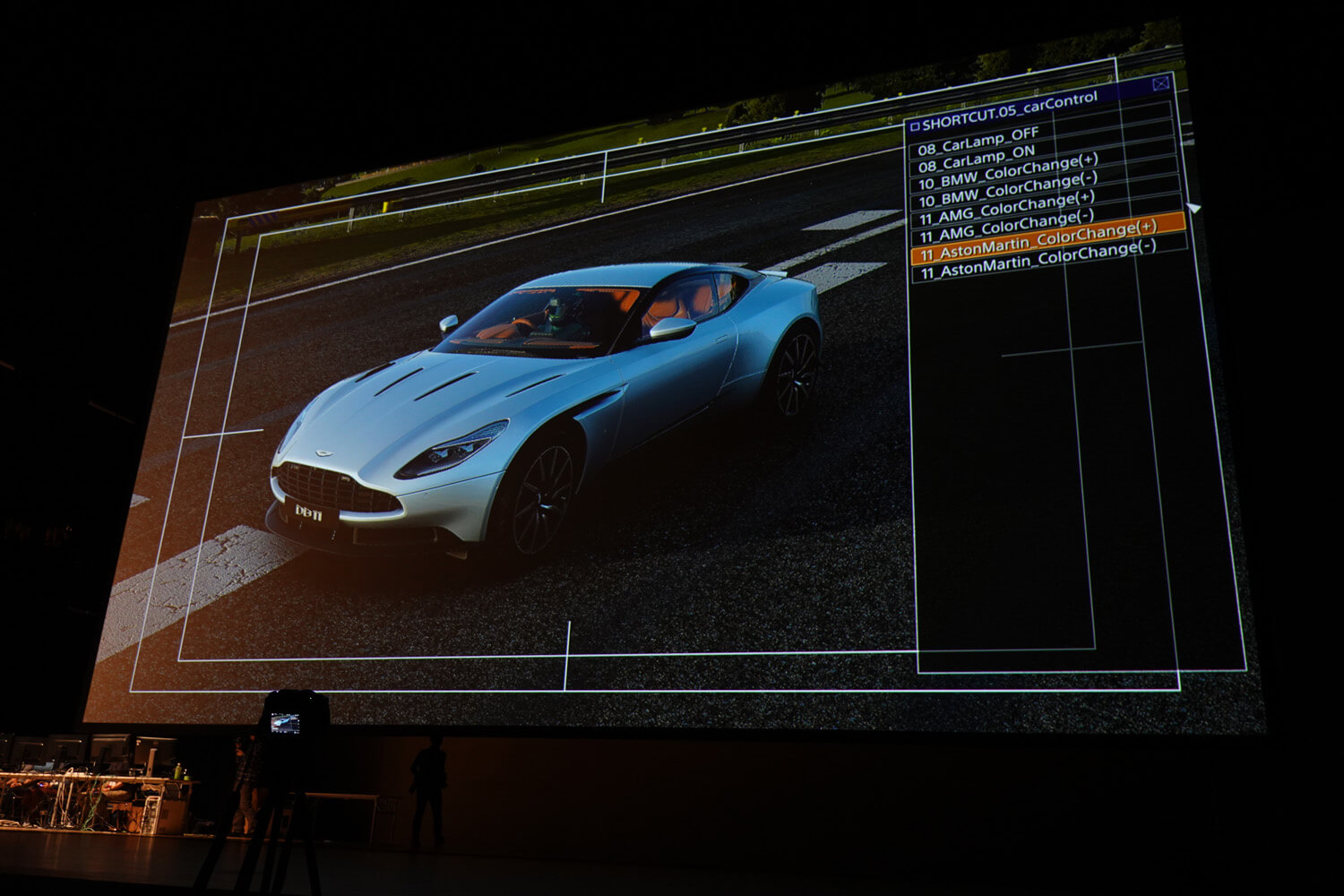

Live Replay Movie Creation of Gran Turismo

ポリフォニーデジタル(日本)

ポリフォニー・デジタルのデモは、実際のゲーム(グランツーリスモ)のゲームプレイ履歴データをもとにリプレイ動画をリアルタイムで様々なカメラアングル・カットで映画や、本物のカーレースの映像のように再現するというもの。ゲームプレイヤーがゲームの中でとった動きや衝突回避の瞬間など、手に汗握る瞬間があたかも映画のワンシーンを見ているかのようにリプレイされるのは、とても不思議な体験だった。技術的に詳しい話はSIGGRAPH Asia 2018のプレゼンテーション資料「Practical HDR and Wide Color Techniques in Gran Turismo SPORT」でも紹介されている。

<4>次回のSIGGRAPHについて

来年、2019年の本家(夏)SIGGRAPH 2019は、7月28日~8月1日に米国ロサンゼルス、2019年冬のSIGGRAPH Asia 2019は11月17日~20日にオーストラリアのブリスベンで開催されることが決まっている。

Submit Your Content to SIGGRAPH 2019

CG/VFX技術の最先端に触れることができ、様々な進化を見せてくれる次回のSIGGRAPH、SIGGRAPH Asiaにも期待したい。