ゲーム業界における日本最大のカンファレンス「CEDEC 2019」が、9月4日(水)〜6日(金)にパシフィコ横浜にて開催された。本イベントでは、ゲーム開発における先進的な技術共有が行われるとともに、ゲーム技術を他業界に転用した事例も紹介された。本稿では、自動車業界における活用事例として講演された株式会社デンソーによる「AD&ADASシステムとゲーム開発技術の融合」についてレポートする。

TEXT&PHOTO_神山大輝 / Daiki Kamiyama(NINE GATES STUDIO)

EDIT_小村仁美 / Hitomi Komura(CGWORLD)

自動運転・運転支援システムの検証に必要な3要素

講演冒頭では、デンソー AD&ADASシステム開発部 課長の服部陽介氏から「AD&ADAS」の概要が説明された。株式会社デンソーは17万人以上の社員を有する自動車業界最大の自動車部品サプライヤーで、先進的な自動車技術やシステムの提供を含めた複合的な事業をグローバルに展開している。「AD&ADAS」は正式にはAutonomous Driving&Advanced Driver Assistance Systemの略称で、自動運転やドライバーの運転支援を目的とした統括的な技術である。こうした技術は人命を預かるため、デンソーでは「安心・安全」を最大の目的とし、シミュレータによる検証や公道での実証実験を行なってきた。

服部陽介氏(株式会社デンソー AD&ADASシステム開発部 課長)

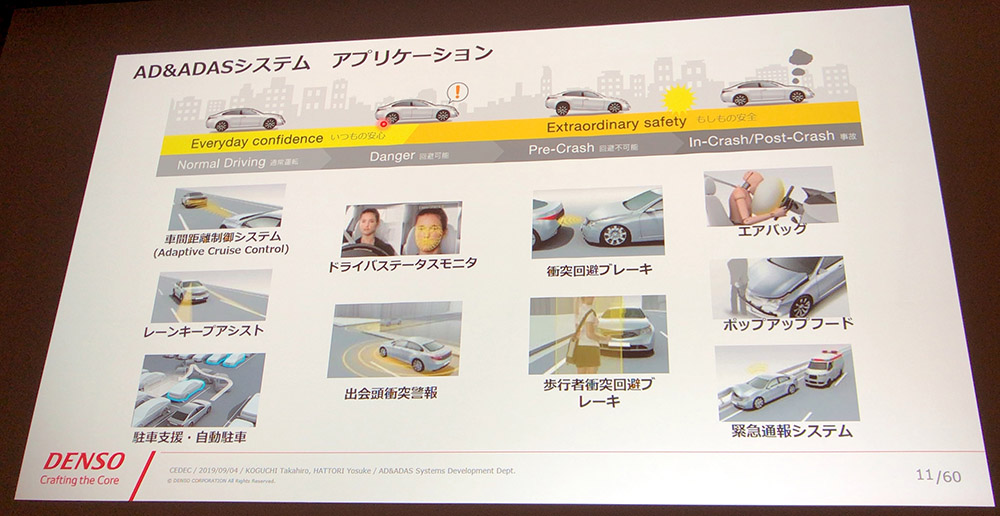

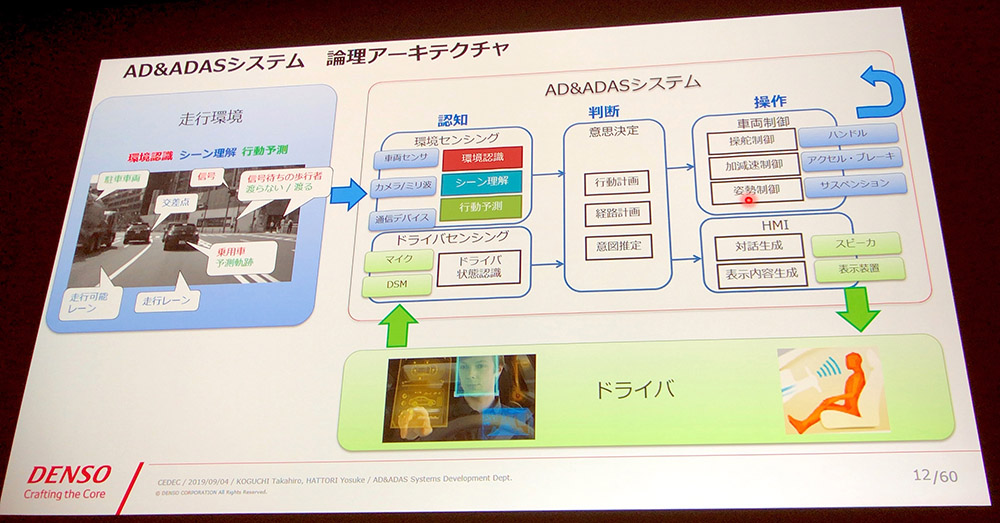

AD&ADASシステムには、走行中の車間距離調整(Adaptive Cruise Control)やレーンキープアシストといった通常運転を支援するシステムや危険を回避するしくみ、危険な状態に陥った際にも安全性を確保するシステムなど、多様なアプリケーションが用意されている。ドライバーが行う全ての認知、判断、操作を代替し、システム側が独自に走行判断をするといったかたちが、これらのシステムの概要となる。また、こうした運転支援のほかにも、ドライバーへのフィードバック(例えば走行中の居眠りから起こすようなもの)も存在しているという。

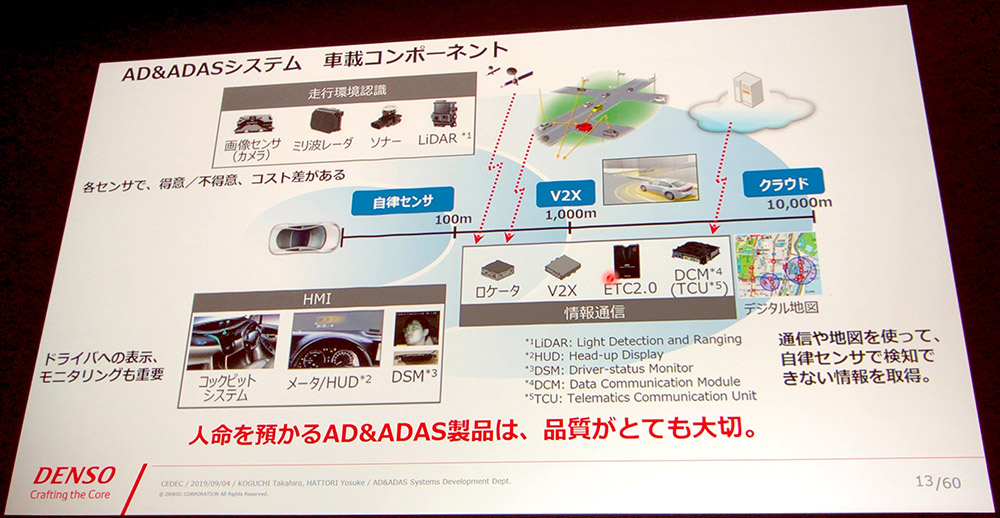

これらを支えるのは車載カメラやミリ波レーダーなど、人間の認知を代替する精密なセンサ群だ。ドライバーへのフィードバックを行うHMI(Human Machine Interface)技術の研究のほか、各センサの品質についても重点的に研究開発が行われている。

続いてはAD&ADASシステム開発部 担当係長 小口貴弘氏により、具体的なシステム検証の方法が説明された。小口氏は2年前までゲーム業界に在籍しており、現在は同社AD&ADASシステム開発部の係長を務めている。

小口貴弘氏(株式会社デンソー AD&ADASシステム開発部 担当係長)

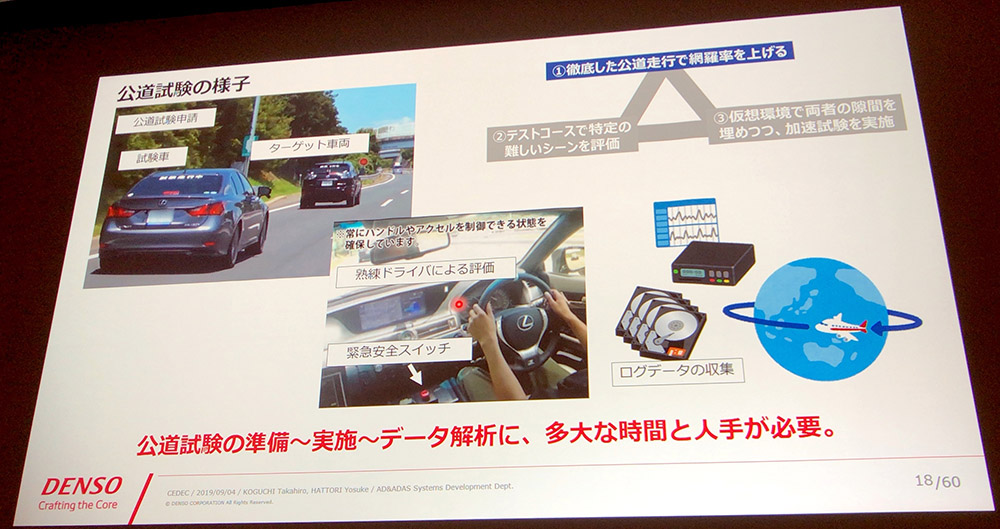

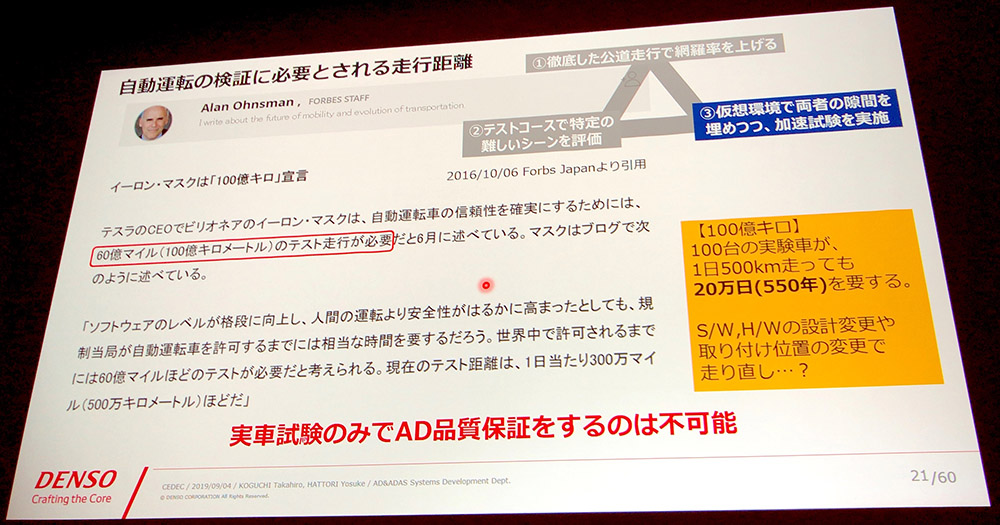

システム検証には3つの柱がある。1つは公道走行によって網羅率を上げること、1つはテストコースの難しいシーンを重点的に検証すること、もう1つは仮想環境で両者の隙間を埋めつつ、加速試験を実施することだ。公道やテストコースでの実験は、一般車にレーザースキャナやステレオカメラなどを搭載した試験車で行われており、各センサの膨大なログを取得し検証する方法が採られる。テストコースでは屋内で雨を降らせたり、夜間の環境を作ることもできるという。こういった実証実験から、例えば緊急安全ブレーキや車線逸脱防止、夜間における歩行者、車などの対象の認知度を評価するわけだが、こうした試験の準備や実施、データの解析には多大な時間と人手が必要となる。

一方、米テスラのCEOイーロン・マスク氏は、自動運転車の信頼性を確実にするためには60億マイル(100億km)のテスト走行が必要であると述べている。これは100台の実験車が1日500km走っても550年かかる計算で、さらに天候などの各種条件によって組み合わせ爆発が起きてしまうため、実車試験のみでの自動運転の品質保証は実質的に不可能ということになる。

そのため、実車以外の検証方法としてゲームエンジン等を用いた仮想環境による検証が提案されており、こうした取り組みはAD&ADASシステムを競い合う「CARLA Autonomous Driving Challenge」や、ドイツの産官学のプロジェクト「PEGASUS」など世界的に広く行われている。

UE4とtrueSKYによる仮想環境の構築

AD&ADASシステムを仮想環境で検証するために必要な要素は何か? 小口氏によると、「外界モデル(シーンデータ)作成」、「センサの模擬」、「操作(車両のアクチュエータ)」の3段階があるという。デンソーではORENDAと共同で、現実を模したフォトリアルな駐車場のシーンデータを作成し、そこで自動駐車の検証を行なっている。使用ツールはUE4とリアルタイム天候生成システムtrueSKYで、天候や時間変化が可能なほか、オブジェクトを個別に用意して汚れの度合いなども可変できる。

また、現実と見た目が似ているフォトリアルな3DCGを作成するだけでは"検証"という目的を達成できないため、SLAM(Simultaneous Localization And Mapping)を使用した比較評価(今回はカメラから得られる特徴量を基にした画像認識ベースの比較)が行われており、現実空間と仮想環境で同じような結果になるよう作られている。

比較評価の例。左が現実空間、右が3DCGによる仮想環境。緑の点が特徴点を表す

センサの模擬では、センサ自体の物量や、実際のセンサに存在する誤差やエラーをどの程度再現するのかが課題となった。デンソーでは再現性を重視し、理想値ではなく近似モデルを作成。また、現時点では誤差の計算を行うため実行速度の低下が起きているが、今後はGeForce RTXテクノロジなどによる高精度・高速な模擬センサの開発が可能になると期待されている。

また、カメラセンサにおいては、3Dスキャナを用いて実際の場所を計測し、測定データに基づいて3DCG制作を行うアプローチも行われている。現実空間の再現が目的のため、物理ベースレンダリングによって可能な限りフォトリアルに寄せた表現で作られており、現実のカメラセンサで発生する歪みなどもディストーション補正などで特徴を類似させている。

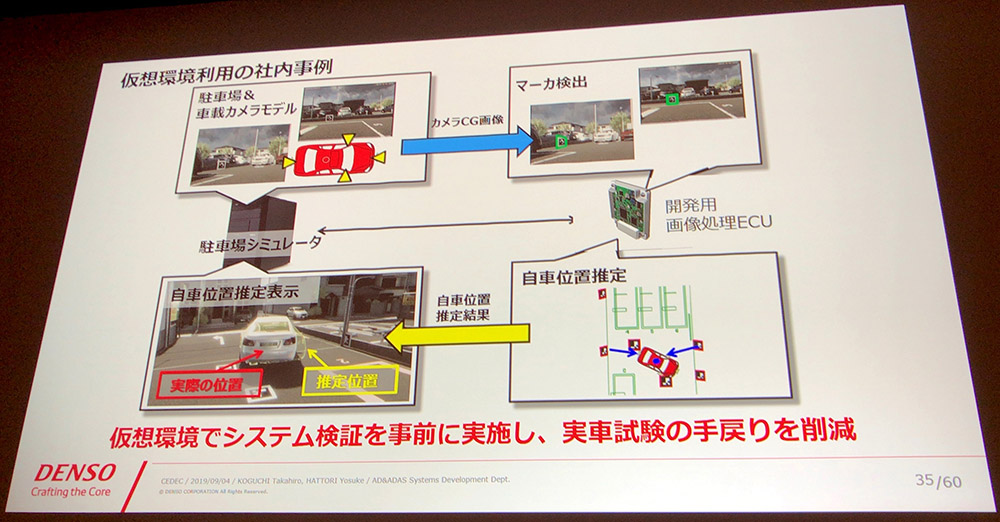

こうしたシステム検証事例として「自動バレー駐車システム」が取り上げられた。これはショッピングなどの際、店舗の入口でドライバーが降りてしまっても、その後無人で駐車場まで自走していくというしくみ。駐車場にランドマークを設定し、自己位置推定をクローズドループでくり返すことで実現可能となるが、実車試験は非常に工数がかかるため、仮想環境で検証を行うことで手戻りを防止している。

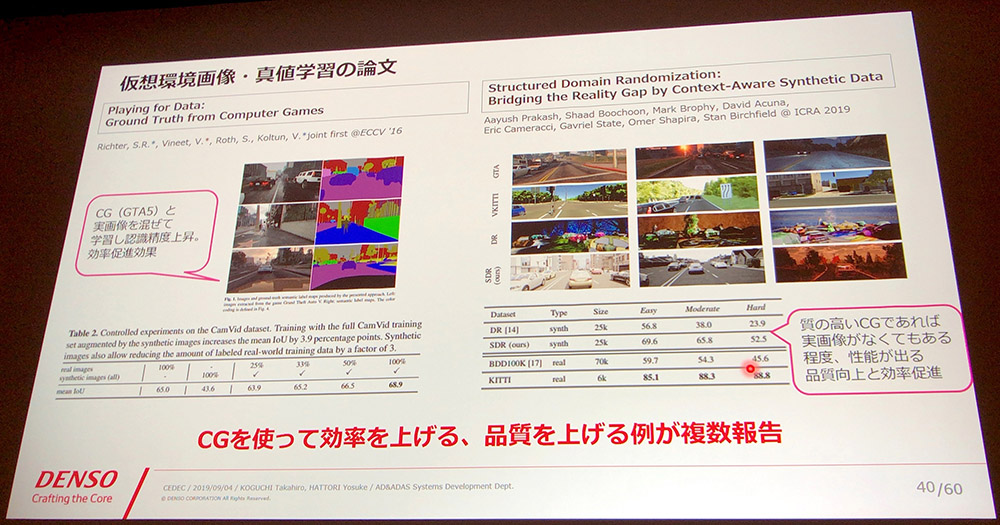

また、UE4の活用事例として特徴的だったのが、Semantic Segmentation(カメラ画像入力をピクセル単位でクラス分類する深層学習の一手法)の教師データとしてゲームエンジンから取得した中間バッファを活用するという手法だ。数千から数百万のデータに人力でタグ付けを行うのは難しく、また実写と3DCGを比較した際、推論結果の確からしさが"実写+3DCG"、もしくは"3DCGのみ"の場合でも実写に近い精度を示す研究結果も存在するため、同手法が活用されるに至っている。

仮想環境画像による学習精度に関する論文。「Playing for Data:Ground Truth from Computer Games」(Stephan R. Richter, Vibhav Vineet, Stefan Roth, Vladlen Koltun, ECCV 2016)は『グランド・セフト・オートV』のゲーム画像と実写画像を混ぜて学習させ、精度向上、効率促進効果を示した研究で、「Structured Domain Randomization : Bridging the Reality Gap by Context-Aware Synthetic Data」(Aayush Prakash, Shaad Boochoon, Mark Brophy, David Acuna, Eric Cameracci, Gavriel State, Omer Shapira, Stan Birchfield, ICRA 2019)は質の高い3DCGデータであれば、実画像がなくてもある程度の精度を出すことができることを示した研究

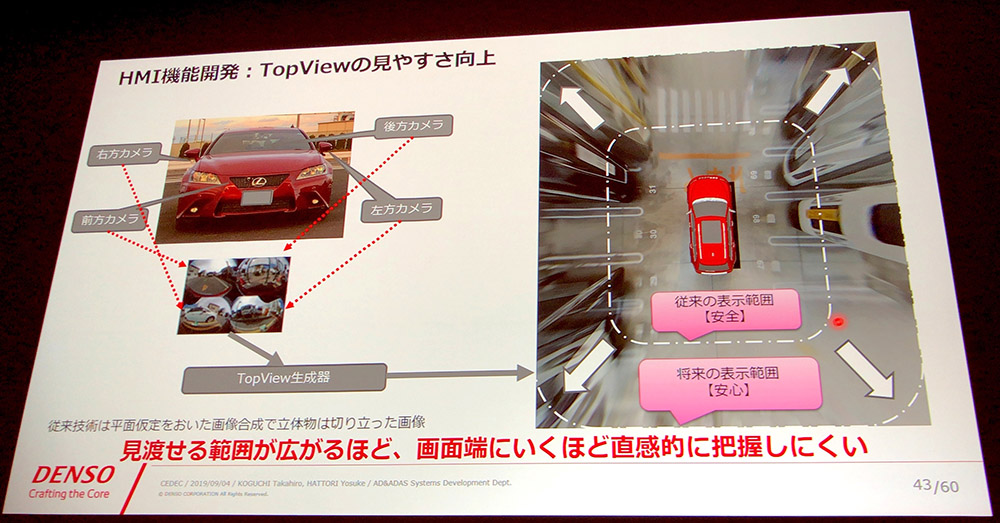

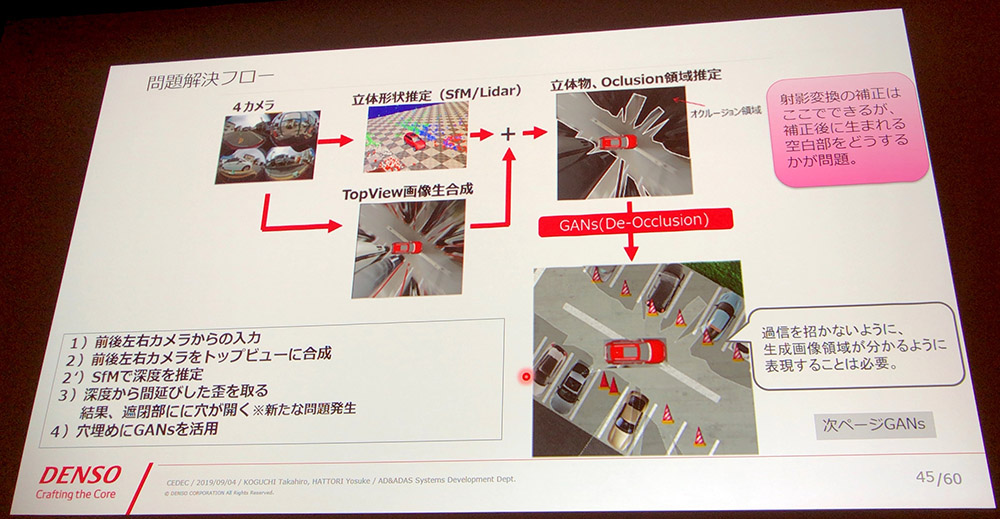

小口氏はこれを用いて駐車時のトップビューの視野角を広げる研究を行なっている。前後左右のカメラから生成されるトップビューはすでにいくつかの車種で採用されているが、理想としては「さらに広い範囲を見渡せる」ようにしたいという。そこで小口氏は立体形状を推定する手法を用いて深度を測定、オクルージョン領域を判断した上で間延びした画像を補正し、さらに空白部を深層学習で補間するという手法を提案している。

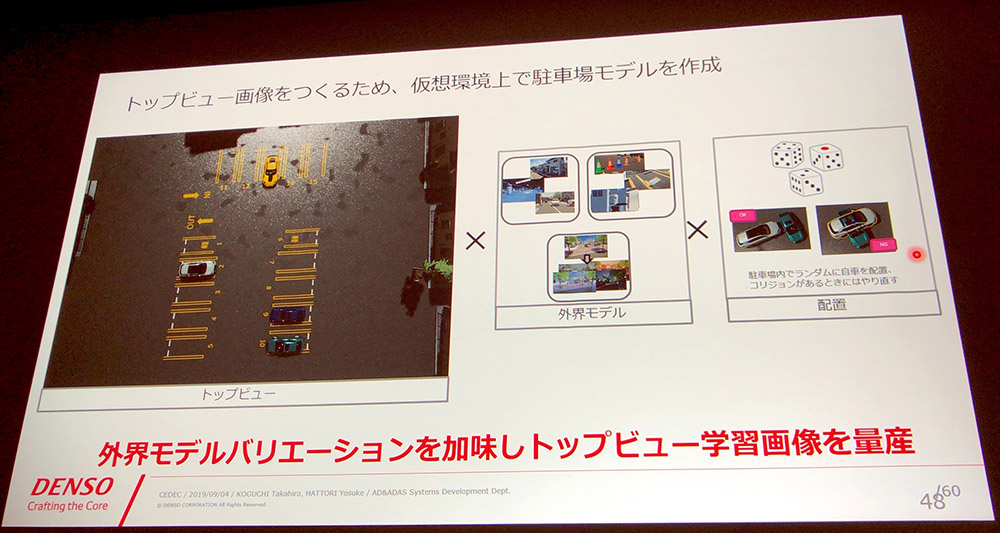

ただ、トップビューの場合は深層学習における正解となる真値データが用意できないという問題がある。「トップビューを実写で撮影しようとなると、物理的にカメラを空中に浮かせないといけないんです。ドローンでやるのも難しいので、今回はカメラを自由に配置できるUE4を活用し、10万枚の画像を用意しました」(小口氏)。

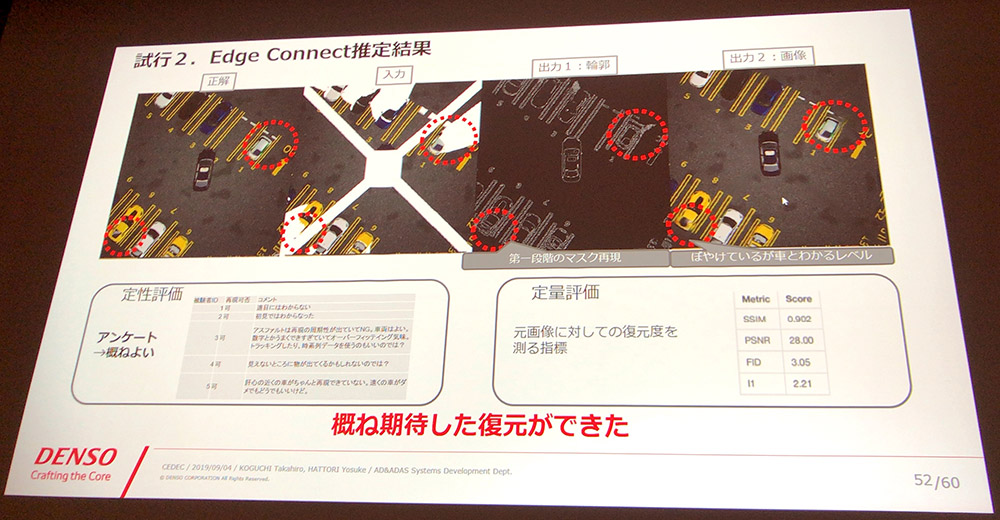

画像の補間アルゴリズムには当初IntroVAEを採用したが、遮蔽部にあるクルマが薄まってしまっていたり、1度の学習にかかる時間が2週間と長大であるため、最初に輪郭を推定するEdge Connectのアルゴリズムを採用。この結果、少しだけしか映っていない自動車もある程度のレベルで穴埋めをすることが可能となっている。

一方、課題として残ったのは推定した映像のゆらゆらしたブレや、推論結果の生成場所にゴミが出てしまうというもの。また、駐車番号の「6」が「8」のように見えてしまったり、均一に引かれているはずの駐車場のラインの長さがズレてしまったりというアルゴリズム由来のエラーもあるそうだが、今後はシーンの拡張とバリエーションを増やしていき、画質改良なども含めた研究開発を行なっていくという。ゲーム業界から自動車業界へ転身した小口氏が携わり、ゲーム技術が重要な役割を果たしている自動運転技術の今後に注目だ。