ご機嫌いかがですか? ボーンデジタル テクニカルサポートの畠山です。

今月はNukeの機械学習モデルと、ディープコンポジットについて紹介します。

2025年の7月にCattery(機械学習モデルの無料ライブラリ)にアップデートされたViTMatteとDepthProの使い方と、ピクセルごとに奥行き方向の色と深度情報をもったDeepイメージを用いたディープコンポジットの基本について解説していきます。

畠山智早

ボーンデジタルのテクニカルサポートチーム所属。ポストプロダクションでのコンポジター経験を経て、現在はFoundry製品のサポートを担当している。

※本記事は、月刊『CGWORLD + digital video』vol.329(2026年1月号)掲載の連載「TECH ROOM:このソフト、どこまでやれる?」を再編集したものです。

INFORMATION

Nuke (ヌーク)

映画・ CM等の制作現場で使われるハイエンドVFX・コンポジットソフト。

AOVやDeepイメージ、 3Dオブジェクトを標準で扱え、複雑なショットをノードベースで高精度に仕上げることができる。

より高機能なラインナップとして、 NukeX、 Nuke Studioがある。

www.borndigital.co.jp/product/nuke

Cattery① VitMatte

CatteryはNukeのCopyCat機械学習モデルを共有・ダウンロードできるプラットフォームです。 サードパーティのPyTorch学習モデルやGitHubで公開されている学習データがNukeで利用できるように.catファイルに変換されており、Gizmoのように利用できます。

ViTMatteは高品質なアルファマットを作成するのに優れており、すでに公開されているマット生成機械学習、MODNet、Semantic Segmentationと比較して、髪の毛・毛皮・モーションブラーなどの微細なディテールを抽出することができます。

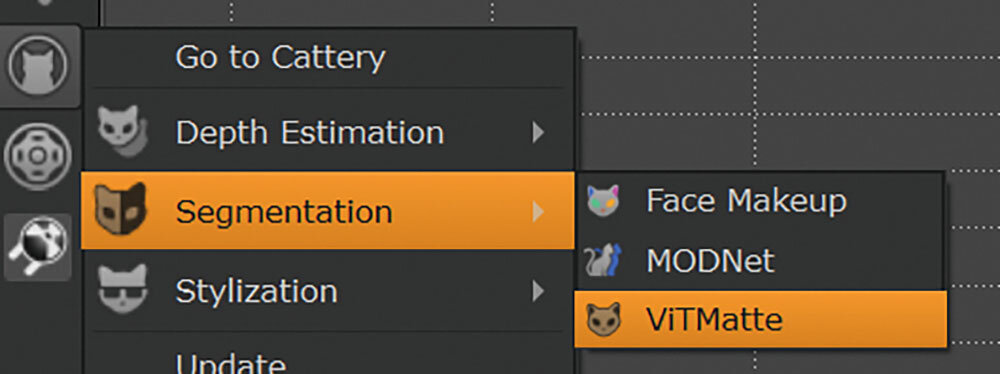

▲ViTMatteはSegmentationの中にインストールされます

-

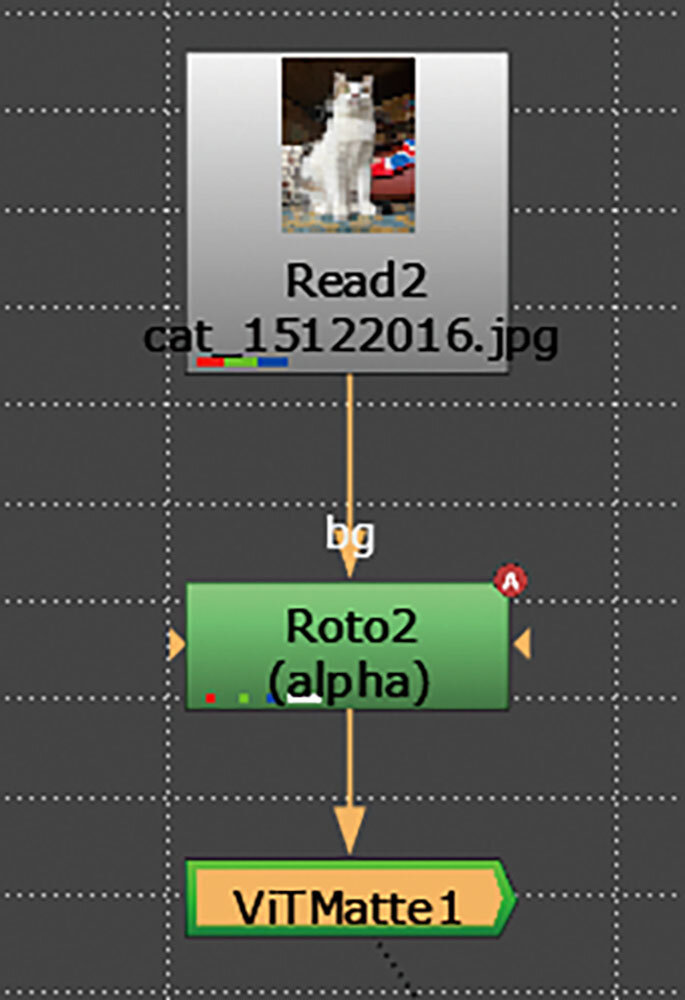

▲CatteryはNukeXの機能なのでNukeXを起動します。はじめにアルファを抽出したい部分のマスクをRotoで作成し、その下にViTMatteノードをつなげます

-

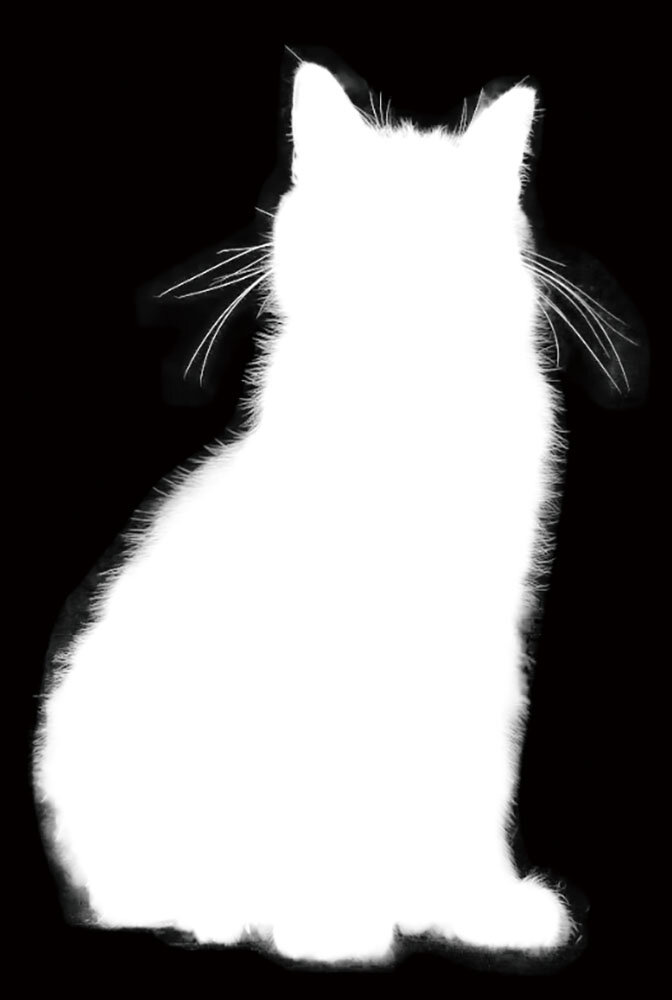

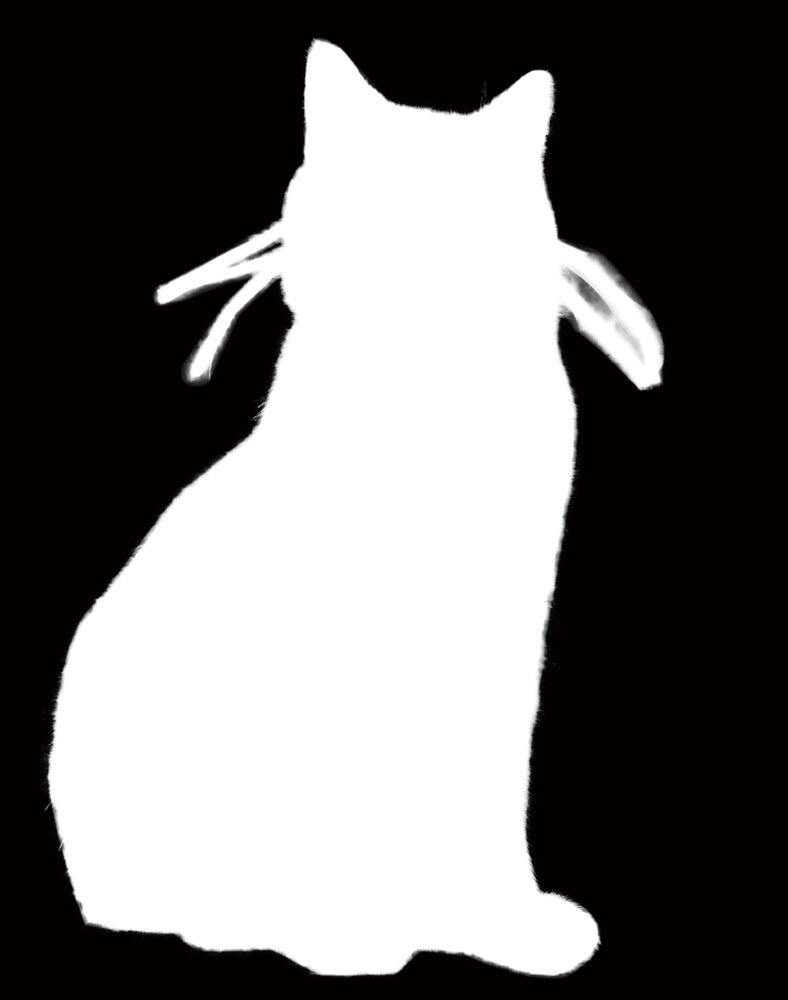

▲アルファチャンネルに切り替えてアルファマットを確認すると、まだ毛のディテールが綺麗に抽出されていません

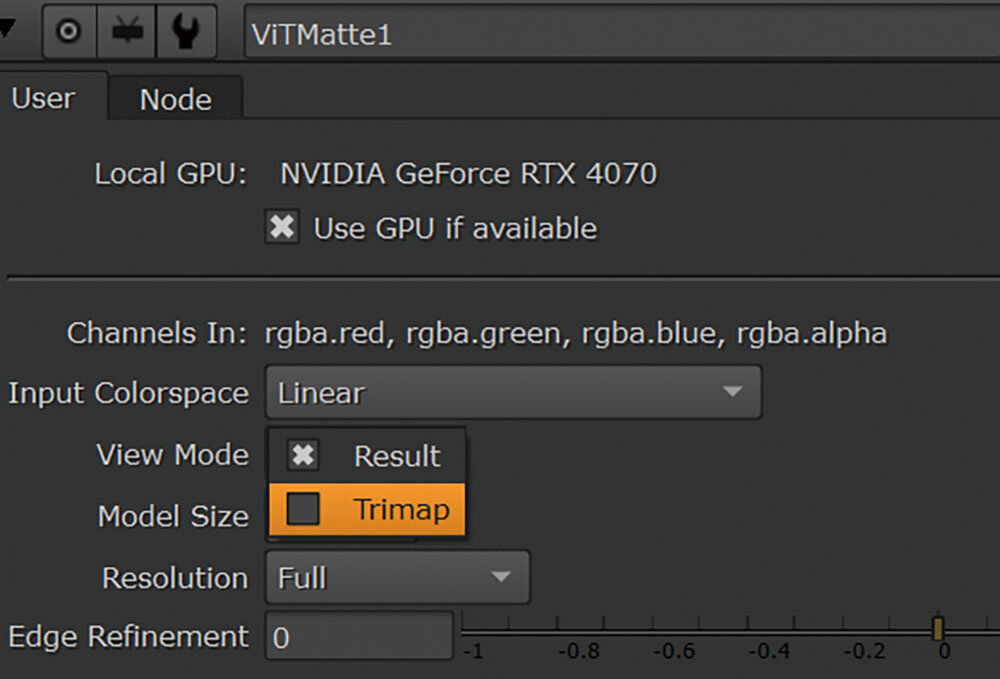

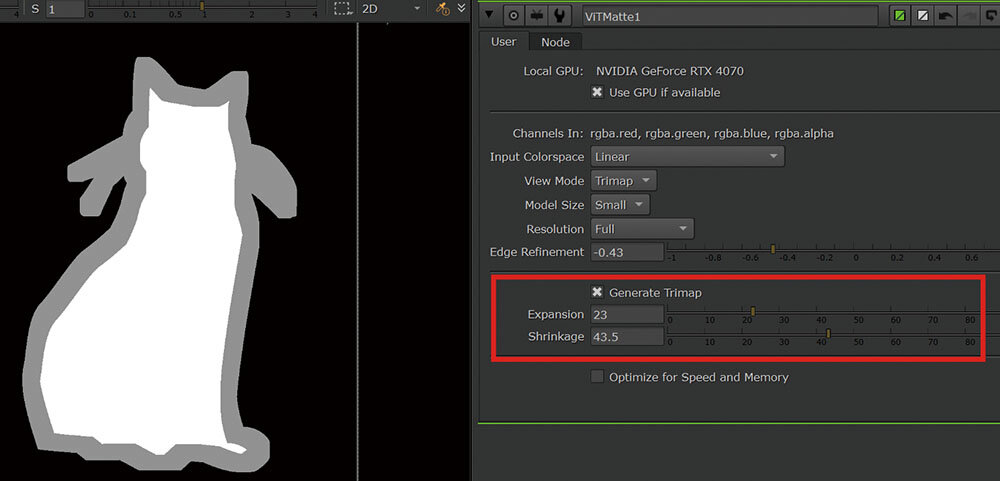

▲ViTMatteのプロパティの[View Mode]を[Trimap]に切り替えます

▲Trimapは前景と思われる領域を白、背景と思われる領域を黒、区別ができない領域を灰色として作成されるデータです

▲View Modeを[Result]に切り替えると、灰色の領域の毛のディテールが抽出されます。Resultの状態で確認しながら領域の調整を行い、毛のマットを整えます

Cattery② DepthPro

DepthProはAppleが開発した単眼深度推定モデルで、単一の2D画像から正確な3D深度を推測するように設計されています。

メートルなどの単位で現実世界の距離の高解像度深度マップを生成し、物体の境界において比類のない鮮明さとディテールを実現することが可能です。DepthProがメートル法のスケールを返す機能は、画像から直接焦点距離を推定することで実現されており、外部カメラメタデータの必要性を排除し、多様な画像に対するパフォーマンスを向上させています。

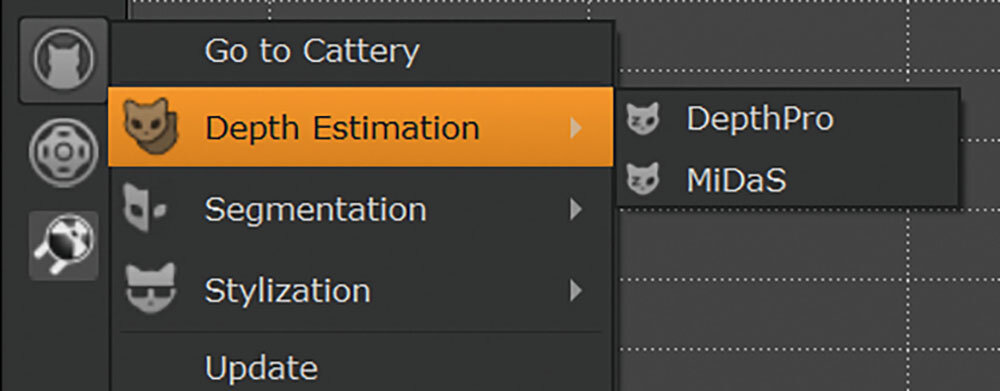

▲DepthProはDepth Estimationの中にインストールされます

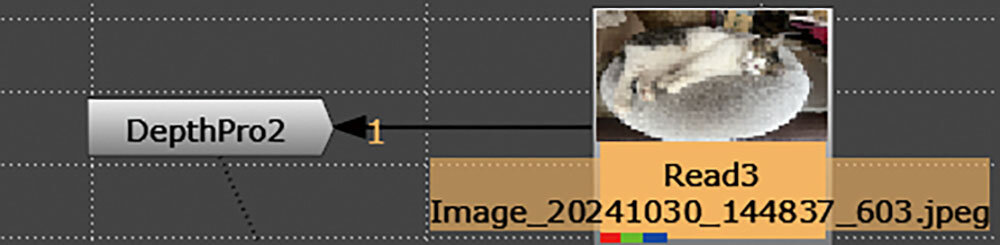

▲深度情報を追加したいイメージの下にDepthProノードを追加します

▲パラメータの設定や追加のノードなどは必要ありません。自動で3D深度を作成してくれます

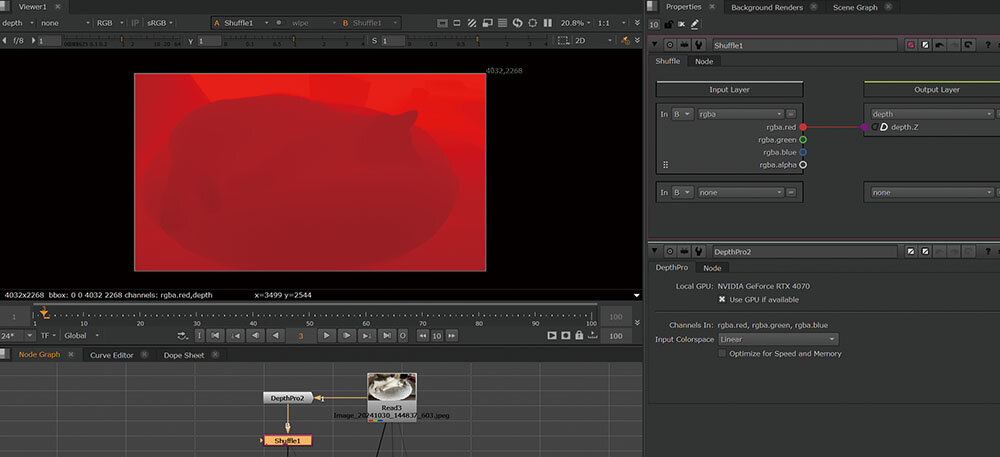

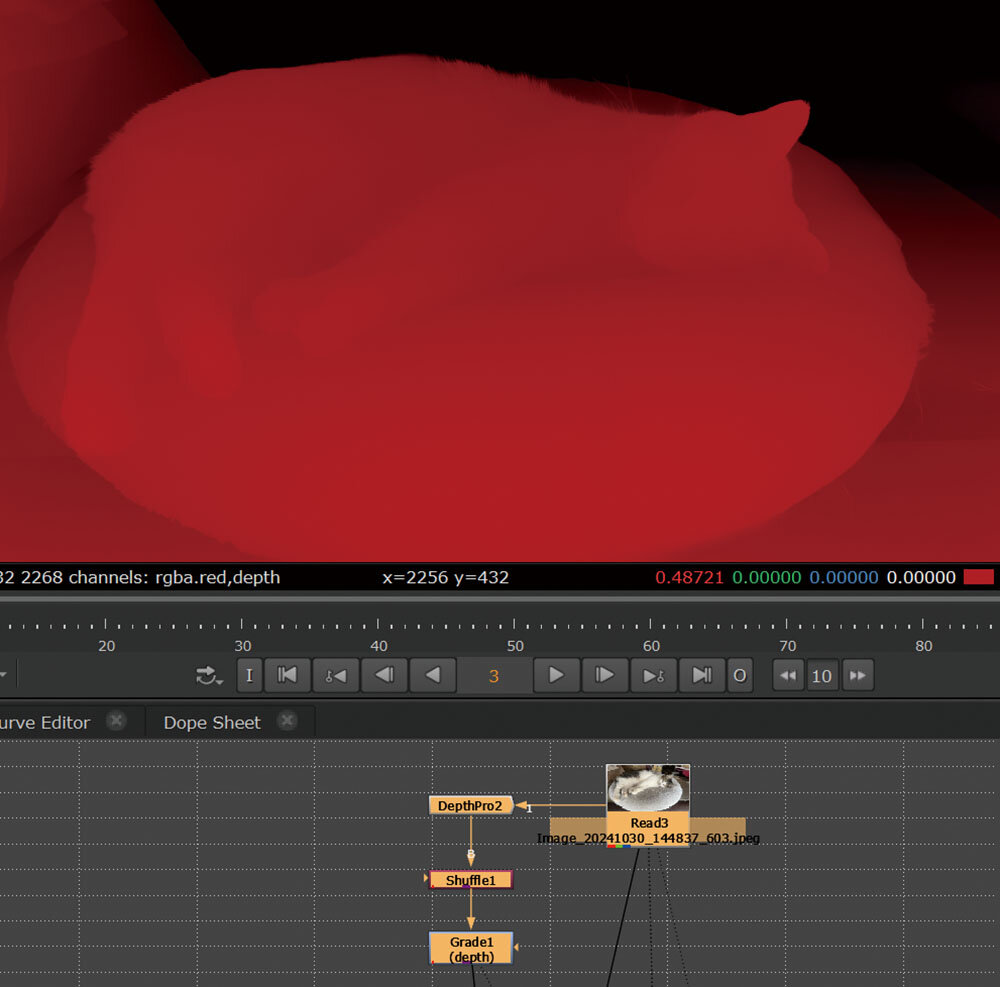

▲Redチャンネルに深度情報が追加されるので、ShuffleノードでDepthにチャンネルを移動させます

▲Gradeノードでデプスの調整をします

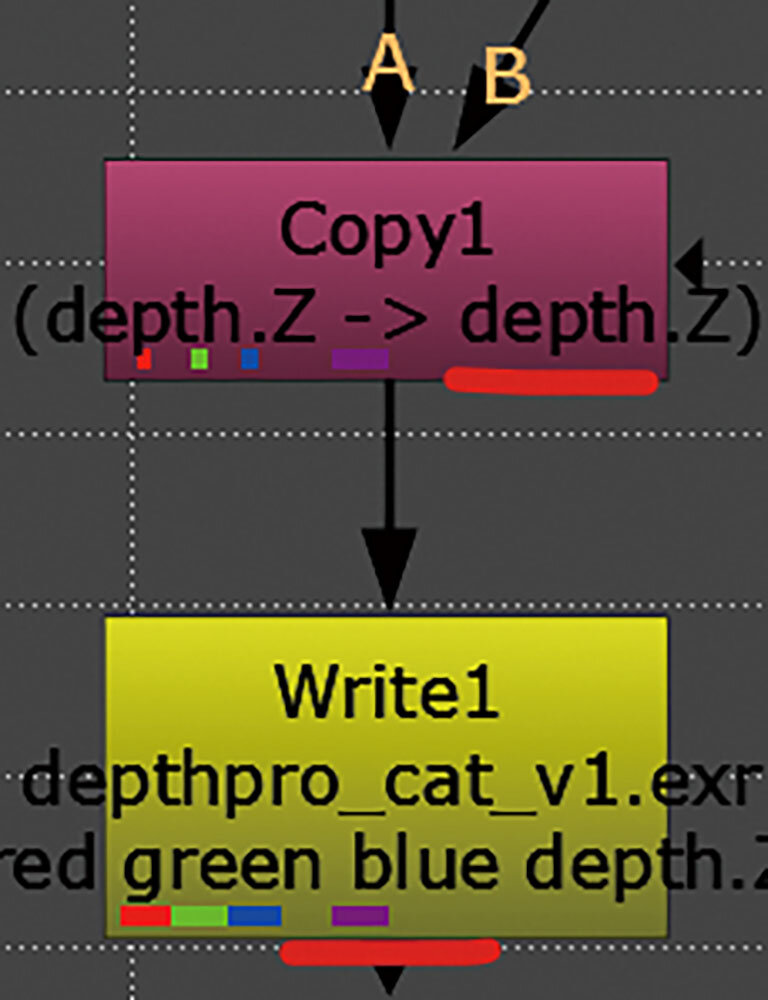

▲このまま作業を行うと動作が重いので、一度元のイメージに作成したデプス情報を追加してexrで書き出します

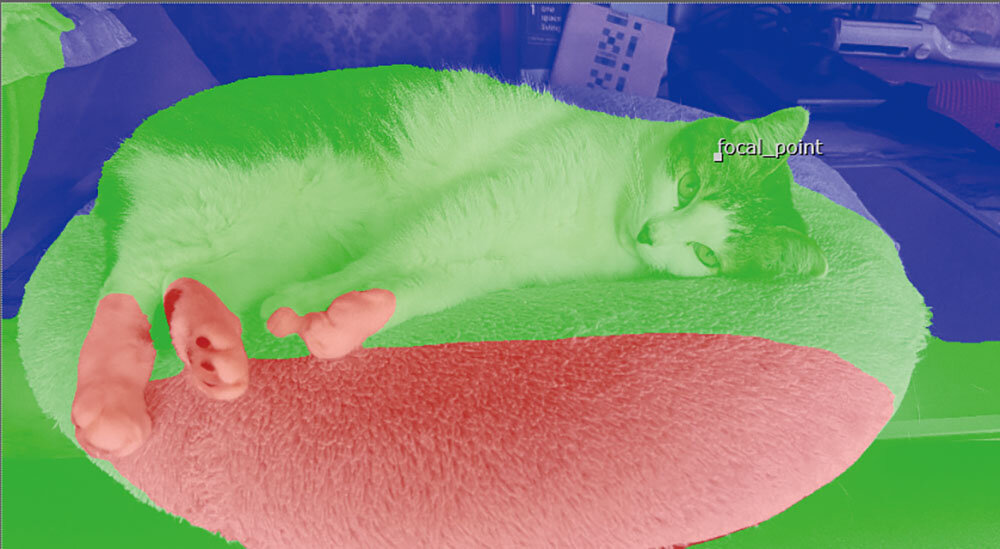

▲Depthを追加したイメージを読み込み、ZDefocusノードでデプス情報を使って猫に焦点を当てることで奥の背景をぼかすことが可能です。ZDefocusのOutputを「focal plane setup」に切り替えて焦点ポイントを調整します。青いエリアが焦点が合っている領域の後方、緑のエリアが焦点が合っている領域、赤いエリアは焦点が合っている領域の前方です

▲デプス情報を使用し、焦点エリアをコントロールすることで手前と背景をぼかすことができました

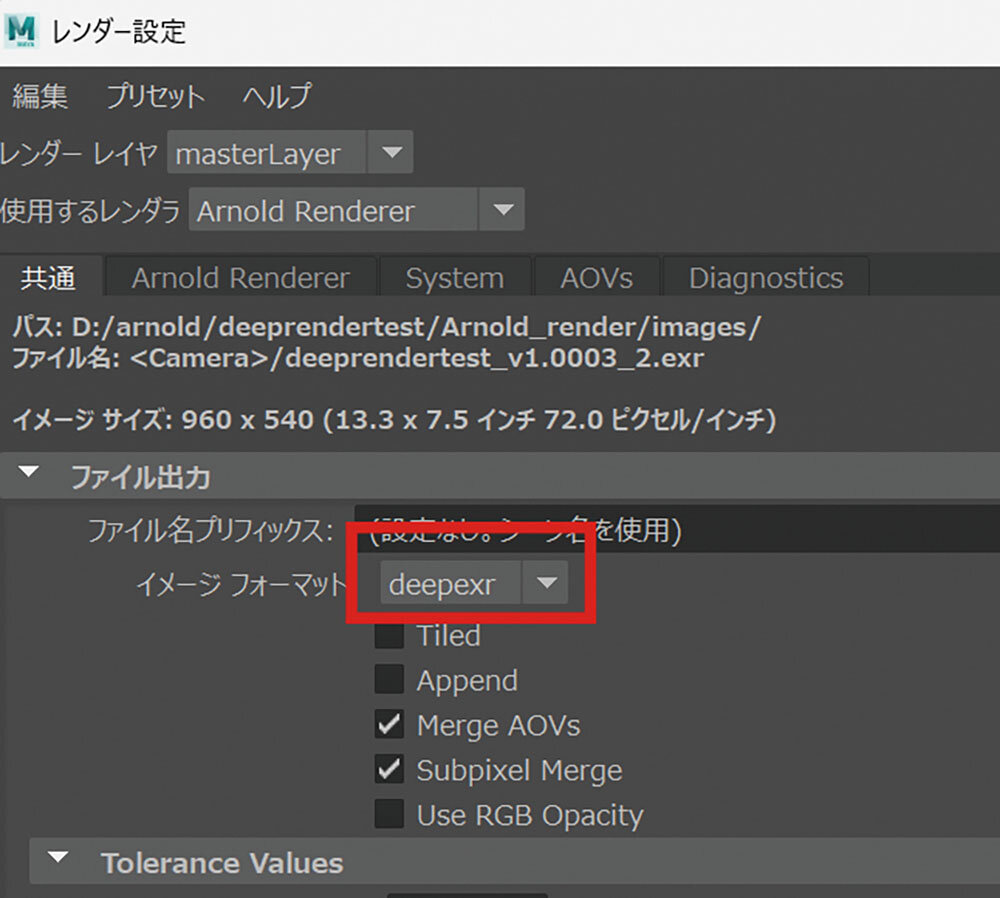

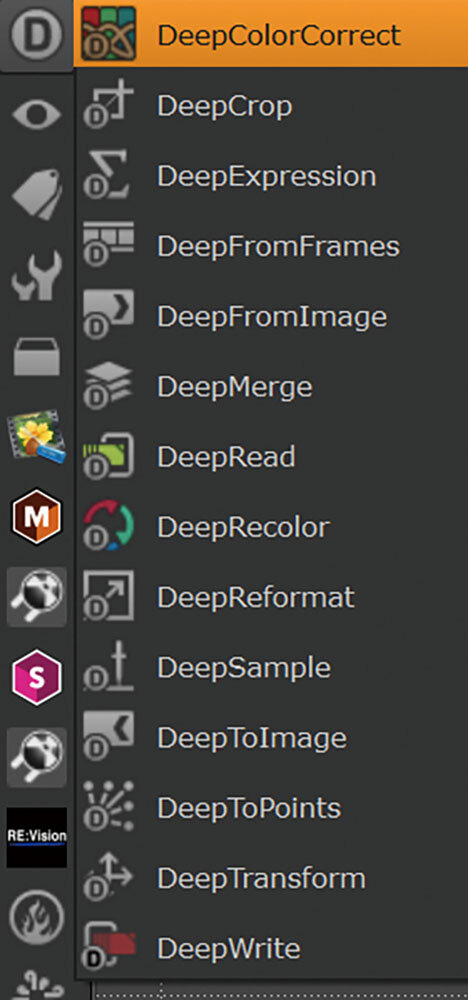

Nukeオススメ機能① ディープコンポジット

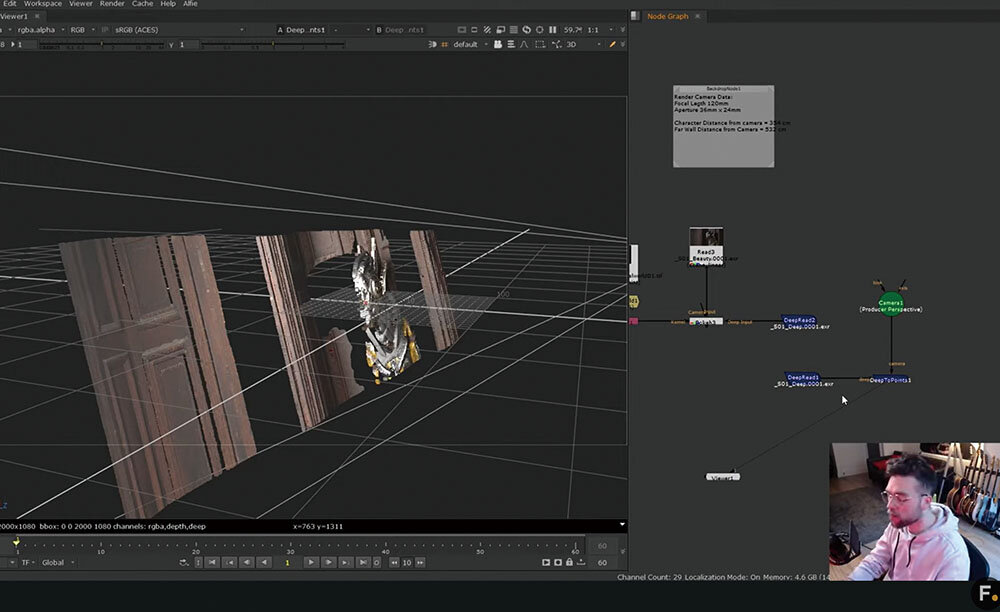

Deepイメージは、1ピクセルごとに奥行き方向の色と深度情報をもったイメージフォーマットです。Depthイメージとは異なり、Nukeで立体的な合成を行うことができます。このDeepイメージを用いた高度な合成作業をディープコンポジットと呼びます。

ディープコンポジットは、CGを合成するときに、同じピクセル内でエレメントが前後する半透明なエレメントがある素材を綺麗かつ正確に合成できたり、カメラの位置を変更しても再レンダリングの必要がないなど、たくさんのメリットがあります。

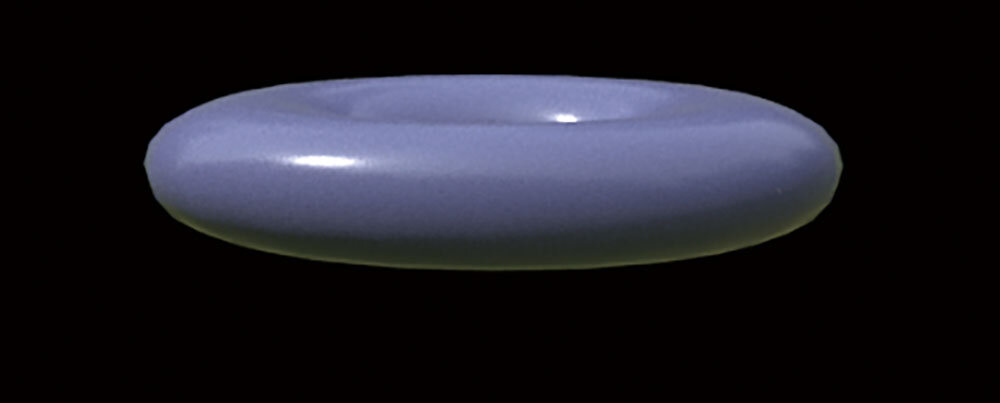

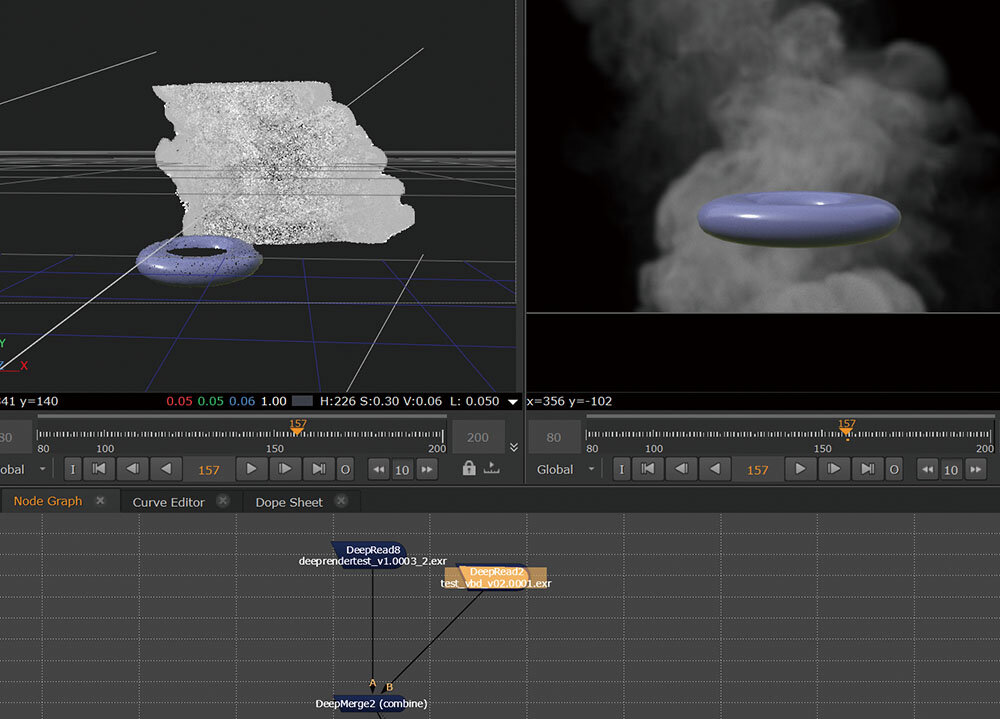

▲DeepReadから読み込んだDeepEXRの素材

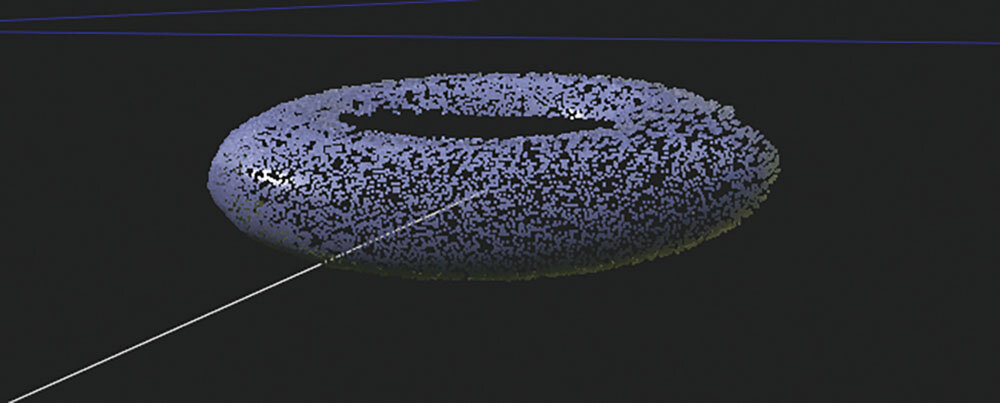

▲読み込んだ素材をDeepToPointsノードでどんなイメージか確認します。DeepToPointsノードは、ディープピクセルサンプルをポイントクラウドのようにNukeの3Dビューで表示可能な3Dポイントに変換できます。これを使って、3D上の前後関係を把握することが可能です

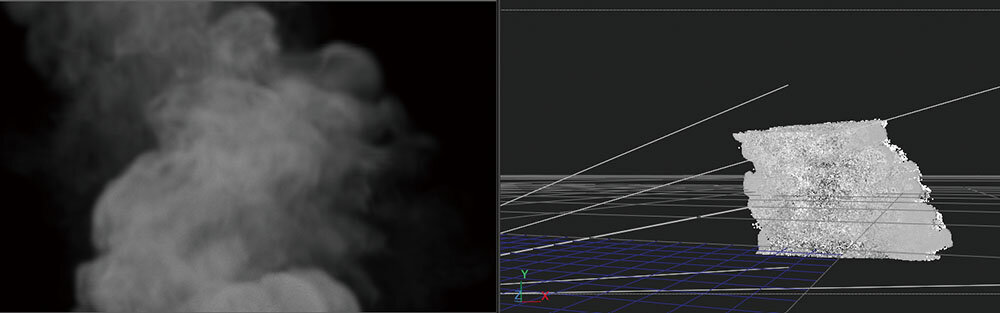

▲DeepEXRの煙のイメージを合成してみます

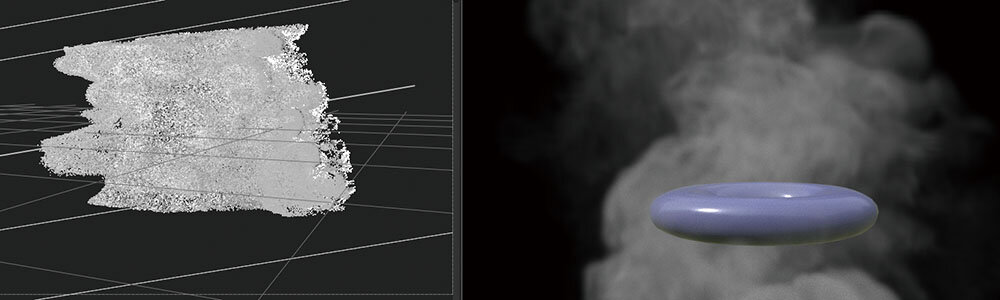

▲この2つの素材は別々のプロジェクトでレンダリングしたイメージなので、位置情報が離れています。そこで、DeepTransformノードで煙の中にリングのオブジェクトがあるようにZを移動します

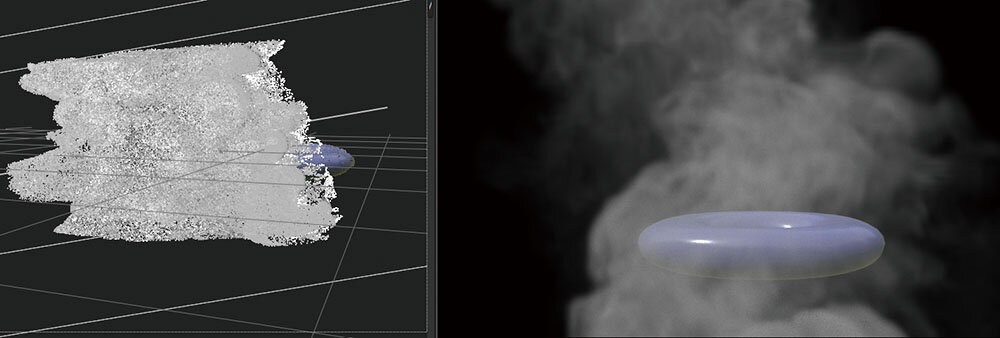

▲煙の中に移動すると、薄く煙を透過しています

▲さらに奥に移動すると煙が濃くなり、オブジェクトが煙より奥にあることがわかります

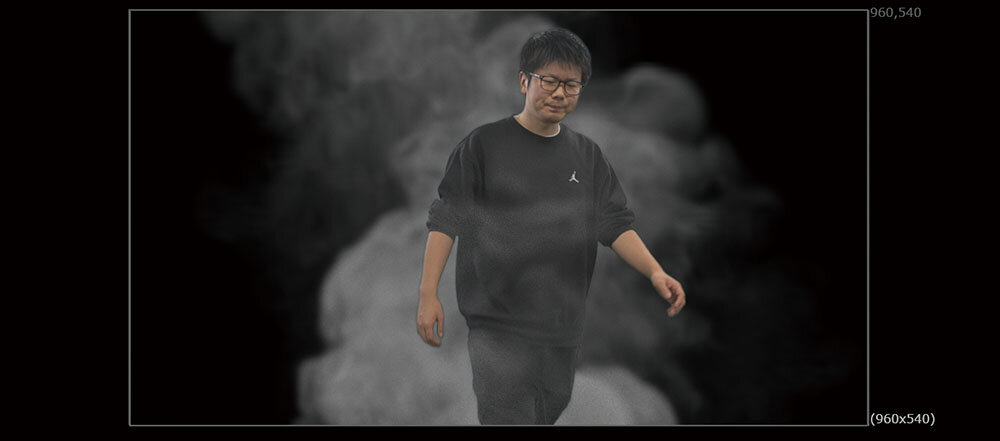

▲また、DeepFromImageで2DイメージをDeepに変換できるため、実写素材に対してDeepEXRの煙を足すことも可能です

Nukeオススメ機能② Bokehノード

Bokehはここで紹介したDeep情報を使用することで、フォトリアルなデフォーカス処理を行うことが可能です。煙や髪の毛といった半透明の要素がある場合、従来のZデプスのみの処理で発生しがちなエッジの処理を綺麗に行うことができます。

Foundryの公式チャンネルにはここで紹介しているようなチュートリアル動画が多数ありますので、ぜひご覧ください!

▲元画像にBokehをつなぎ、Deep InputにDeepイメージをつなぎます

▲デプスチャンネルに切り替えると、緑のグラデーションでデプス情報が表示されていることが確認できます。この状態で焦点を当てたい部分をサンプリングします

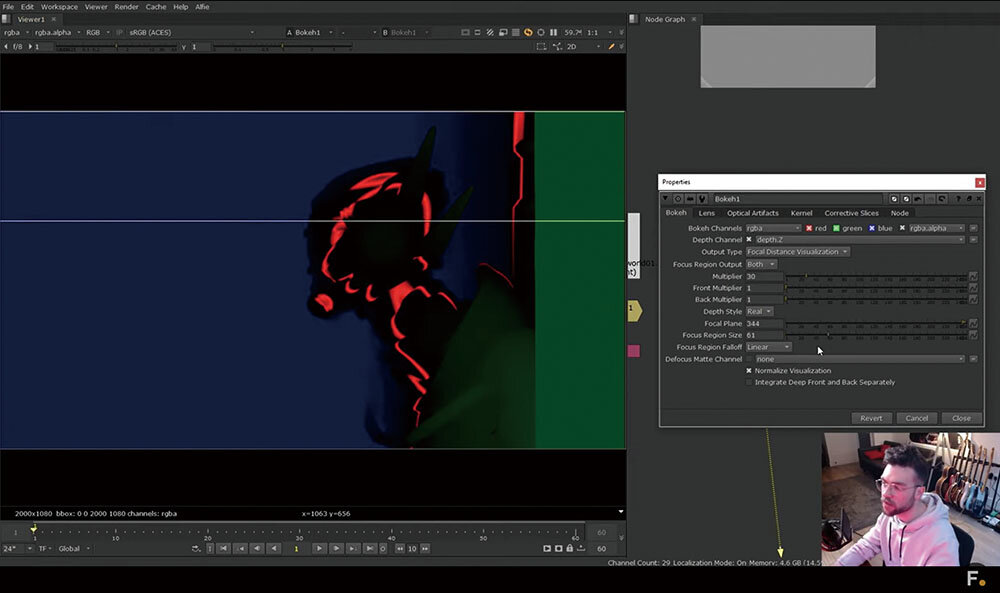

▲Bokehのプロパティでサンプリングした値を[Focal Plane](完全に焦点が合う面)に入力し、[Output Type]を[Focal Distance Visualization]に切り替えてFocus Region Output(フォーカス領域)を調整すると、焦点が合っている部分を赤く表示してくれます

▲元画像

▲Bokehで調整後の画像。背景だけでなく前後のデフォーカス量をコントロールできるので、頭の部分や肩など細部のデフォーカスを調整することが可能です

次回予告|Marvelous Designer

Marvelous Designerは衣服のシミュレーションに便利なツールですが、服飾の知識がなく、上手く活用できているか不安な方も多いはず。そこで次回は、アバター用衣服を作成するための服飾の基礎知識とTipsを組み合わせてご紹介します。

INFORMATION

月刊『CGWORLD +digitalvideo』vol.329(2026年1月号)

特集:映画『果てしなきスカーレット』

定価:1,540円(税込)

判型:A4ワイド

総ページ数:112

発売日:2025年12月10日

SUPPORT ROOM

■気になるソフトウェアがある方

製品の購入や導入におけるご質問はこちらからお寄せください。

■すでにソフトウェアを活用中の方

使用におけるお困りごとやご質問はこちらからお寄せください。

TEXT_畠山智早/Chihaya Hatakeyama、黒河 建/Takeru Kurokawa(ボーンデジタル)

EDIT_藤井紀明/Noriaki Fujii、高橋拓也/Takuya Takahashi(CGWORLD)