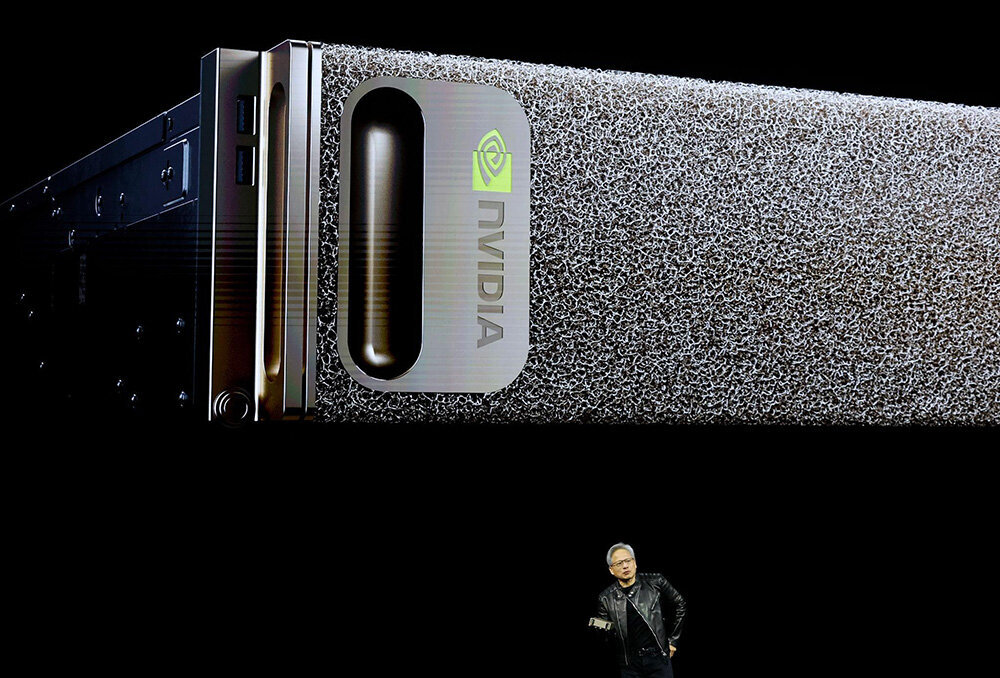

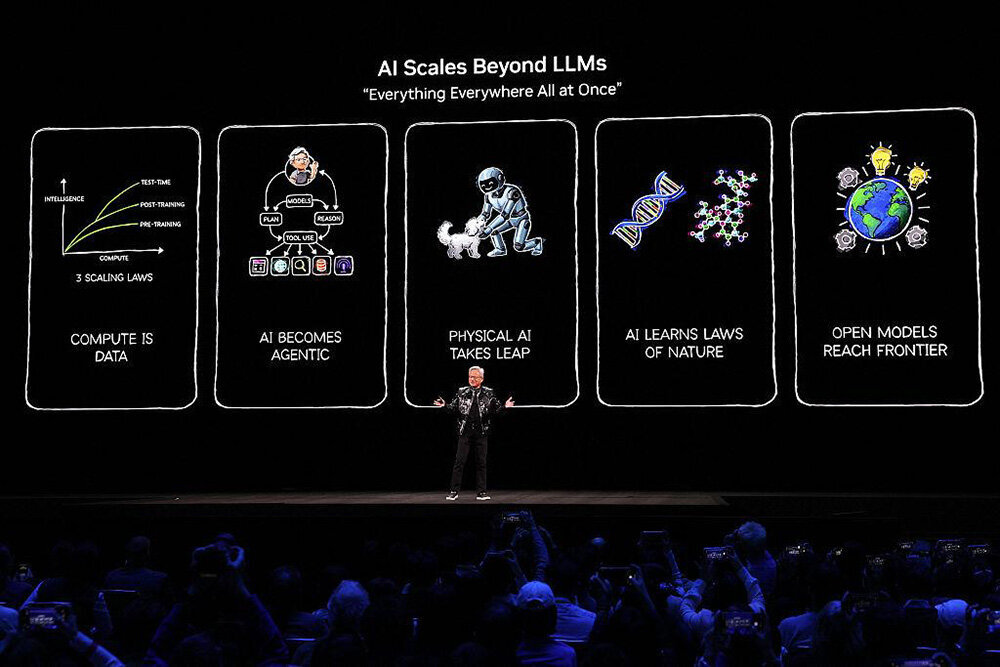

2026年初頭、米ラスベガスで開催された「CES 2026」にて、NVIDIAの創業者・CEOであるジェンスン・フアン(Jensen Huang)が基調講演を行い、最新のAI技術の方向性が世界に向けて発信された。

その中で特に注目を集めたのが、「NVIDIA DGX Spark」(以下、DGX Spark)と「Reachy Mini」を組み合わせたローカルAIロボットのデモンストレーション。

本連載は3回に渡るが、第1回ではNVIDIAが提供するDGX Sparkとは何か、Reachy Miniとは何かを整理し、両者を組み合わせることで生まれる価値と可能性を紹介する。第2回ではDGX Spark、Reachy Miniのセットアップと動作確認を、第3回では様々なサンプルを動かして、AIロボットの機能を実際に体験してもらう。

これにより、あらゆる業界に大きな影響を及ぼすAIロボットの概要と現時点で何ができるのかを具体的に知ってもらうことを目指したい。

ローカルAIロボットが拓く世界

NVIDIAのCEOであるジェンスン・フアンが行なったデモでは、"思考するAI"と"身体を持つロボット"を統合し、リアルタイムに会話・動作・センサー反応を行うパーソナルAIアシスタントロボットの可能性が示された。

これは単なる最新技術の紹介にとどまらず、ローカルAIロボット開発が、研究機関や大企業だけのものではなく、一般の開発者やクリエイターの手にも届くフェーズに入ったことを象徴する出来事だったといえる。

未来は「自分の机の上」でつくられる

これまで高度なAIやロボット知能の実現には、大規模なクラウド環境やデータセンター級の計算資源が不可欠であったが、今回の発表は、ひとつの新しい問いを私たちに投げかける。

「AIの"脳"を、あなたのデスクに置けるようになったら?」

DGX Spark × Reachy Miniの組み合わせは、この問いに対する具体的な答えとなる。開発者が自宅や研究室でAIモデルを動かし、学習・推論・対話・行動を一体化させた自分専用のAIロボットを育てていく――こうした開発スタイルが現実のものになりつつあるからだ。

ローカルAIロボットが切り開く新しい体験

本連載では、この発表内容をベースに、実際に手を動かしながらローカルAIロボットを構築していく流れを解説していく。具体的には次のステップを取り上げることで、単なる理論紹介ではなく、「実際につくれること」を重視したハンズオン形式で進めていきたい。

①DGX Spark上でAIの推論・思考処理をローカル実行する

②Reachy Miniと連携し、知能と身体動作を結びつける

③音声・視覚・ジェスチャーを統合した対話型AIロボットを実装する

DGX Sparkとは何か?

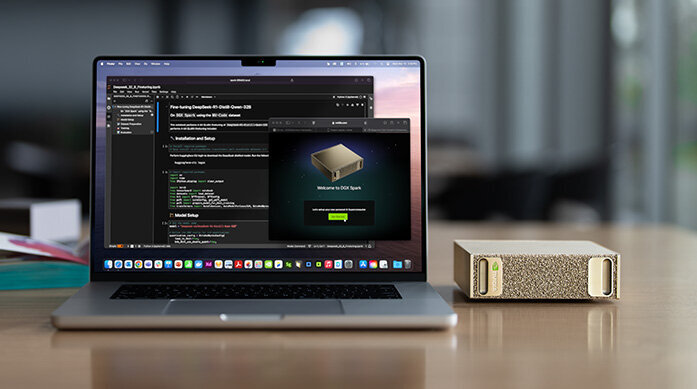

DGX Sparkは、デスクトップに収まるサイズながら、AIスーパーコンピュータ級の処理性能を目指して設計されたローカルAI開発マシンだ。従来はデータセンター級のGPUサーバやクラウド環境が必要だった大規模AIモデルの処理を、1台でローカル推論・検証ができる点が最大の特徴となる。

研究用途だけでなく、ローカルLLMの実験検証、ロボティクス連携、マルチモーダルAI開発など、開発者の手元で完結するAI開発環境を実現できるのだ。

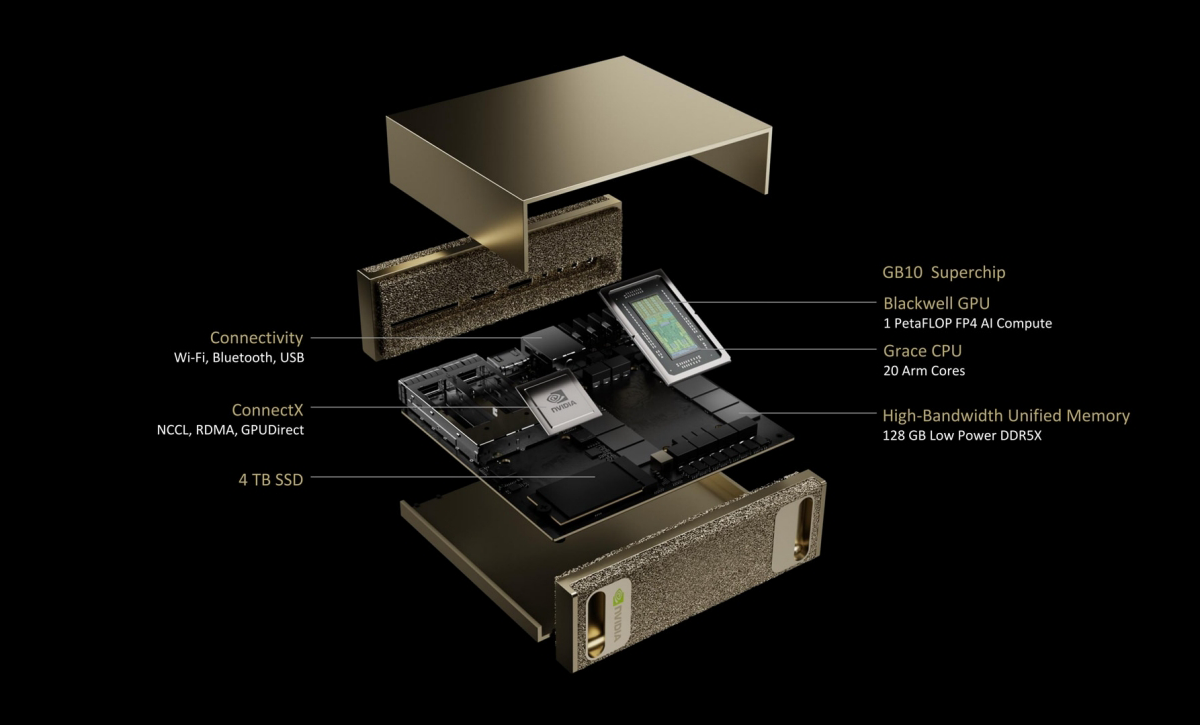

ハードウェアの特徴

ハードウェアの特徴は、次のとおりとなる。

・128GB統一システムメモリ

CPUとGPUで共有する大容量メモリ構成により、大規模モデルや長コンテキスト推論でもメモリ不足が起きにくい設計となっている。

・Grace Blackwell GB10 Superchip搭載

「ARM CPU」+「Blackwell GPU」を統合したAI特化チップで、低ビット精度(FP4など)での高速AI推論に最適化されている。

・従来はローカルでは難しかった規模の大規模モデル推論にも対応

分割実行や量子化などの最適化を前提に、これまでローカル環境では扱いにくかったサイズのモデルまで推論できる設計になっている。

これは、従来はクラウドGPU環境が不可欠だった大規模AI実験を、「自分の机の上」で完結できるようにするための大きな転換点といえる。さらに、常時対話・常時視覚認識・プライベート情報の継続的な取り扱いが前提となるロボット用途にも、特に相性のよい構成になる。

OEMモデルも多数登場している

最新のローカルAI需要の高まりを受け、NVIDIA純正版だけでなく、各社からOEM版も展開されている。これらは基本スペック部分(128GBメモリ、GB10チップ搭載)は共通で、ストレージ容量や保証・保守形態がメーカーごとに異なっており、用途に応じて選択してほしい。

なお、今回の記事では、アスクが取り扱う「MSI EdgeXpert」を使用している。アスクでは他にも「ASUS Ascent GX10」や「Dell Pro Max with GB10」といった各社版も取り扱っている。

Reachy Miniとは何か?

Reachy Miniは、AI・ロボティクス開発向けに設計されたデスクトップサイズのオープンソースロボットプラットフォームだ。AIモデルとセンサー入力、モーション制御を統合し、「身体を持つAI」を実際に動かしながら開発・検証できることを目的につくられている。

机の上に置けるサイズでありながら、視覚・音声・動作表現を備えており、対話AIやエージェントAIを現実世界で動かすための入門から実験までの環境として最適化されている。なお「Reachy Mini Lite」という簡易版もあるが、本連載ではReachy Miniを使用して解説している。

執筆者のブログでも、Reachy Miniの概要を紹介しているので、こちらも参考にしてほしい。

執筆者ブログはこちらハードウェアの特徴

ハードウェアの特徴は、次のとおりだ。

・高さ約28cm×幅約16cmのコンパクト設計(机上運用向け)

・重さ約1.5kgで扱いやすい軽量ボディ

・プログラミング前提の設計(Python標準サポート)

・キット形式で提供され、組み立てながら内部構造を理解できる

完成品ガジェットではなく、触って拡張するための開発ロボットという位置付けとなる。

開発元と背景

Reachy Miniは、Hugging FaceとPollen Roboticsの協力体制から生まれた。

Pollen Roboticsは、フランス発のロボティクス企業で、オープンソースヒューマノイド「Reachy」を開発してきた実績があり、2025年にHugging Faceが同社を買収し、AIモデルとロボットの統合プラットフォーム化を加速させることとなる。

Hugging Faceは、世界最大級のオープンAIモデル・データセット共有エコシステムを持つ企業だ。近年は、AIモデルだけでなくロボットプラットフォームもコミュニティと共有・拡張していく方針を打ち出しており、ソフトウェアにとどまらず、物理世界で動くAI基盤までオープン化する戦略の一環としてReachy Miniを展開している。

Reachy Miniで何ができるのか?

Reachy Miniは単なるデスクトップロボットではなく、AIと物理的なインタラクションを結びつける実験プラットフォームとなっている。

・センシング・対話

AIモデルと連携することで、環境認識+対話ロボットを構築可能

・広角カメラ→コンピュータビジョン入力

・マイク→音声入力・音声認識

・スピーカー→音声合成・対話応答

・表現豊かな動き

うなずき・注視・リアクションなど、人間らしい表現が可能

・6自由度のヘッド可動

・胴体360°回転

・アンテナなどの感情表現パーツ

・AIモデル連携

音声認識・音声合成・視覚モデルをそのまま接続可能

・Python SDKで全機能にアクセス

・Hugging Face Hubのモデルと直接連携

さらに、箱から出してすぐ試せる公式アプリも用意されている。

Reachy Miniの魅力

Reachy Miniは、AIを「実行する」から「身体化して体験させる」へ進めるための入口デバイスとして、AIを動かし・反応させ・存在させる開発体験を手元で実現できる基盤と言える。

「DGX Spark × Reachy Mini」-組み合わせることで生まれる価値

DGX SparkとReachy Miniの個別スペックと背景はこれまで説明したとおりとなる。ここからは、この2つを実際に組み合わせたときに、開発体験とロボット体験がどう変わるのかを中心にまとめておこう。

この構成の考え方は、以下のようにシンプルだ。

DGX Sparkが"脳"を担い、Reachy Miniが"身体"を担う。そして両者をローカルで直結することで、AIは「考えるだけ」で終わらず、「反応して伝える」ところまで一体化できる。

ロボットとの対話やインタラクションでは、知能の高さと同じくらい「反応の自然さ」が重要となる。クラウド経由のAIは、通信遅延やAPI制限の影響を受けやすく、会話のテンポや動作タイミングにズレが生じがちだ。

また、常時センシングや常時対話を前提とするロボット用途では、クラウド従量課金モデルがコスト面で不利になるケースもある。推論をローカルで完結させることで、これらの制約を避けながら低遅延で処理でき、Reachy Miniの視線・動き・発話を自然につなげることができるのだ。

体験としては、「音声アシスタントをロボットで再生している」のではなく、そこにいるAIが理解して動いている感覚に近づくことになる。

組み合わせの強み

組み合わせの強みは、次のとおりだ。

・知能レベルを妥協しなくていい

大規模LLMや音声・視覚モデルを軽量化せず、そのままロボット知能として使える。

・低レイテンシーで反応が自然

音声→理解→判断→動作までをローカルで処理でき、会話やリアクションの間が合う。

・モデルや人格を自由に差し替えられる

性格・口調・感情モデル・行動ルールを何度でも調整できる。

・試作と検証のスピードが速い

プロンプトやモデルを変えて、すぐロボットの反応で確認できる。

・キャラクターAIを物理存在にできる

設定した人格や演出が、声やしぐさ、動きとして表に出る。

「理解→判断→表現」が一本のループになる

この構成により、AI処理とロボット動作が分断されない。たとえば、Reachy Miniに話しかけると、以下のループが高速に回ることで、対話はコマンド操作ではなく、連続したやり取りへと変わることになる。

①ローカルAIが理解する

②応答内容と感情を決める

③ロボットが声と動きで表現する

④その反応を再び入力として取り込む

第1回のまとめ

研究用途でも、作品制作でも、教育用途でも、DGX Spark × Reachy Miniの構成は非常に扱いやすいのがわかっていただけただろうか。AIエージェント、キャラクター対話、音声UI、インタラクティブ展示など、これまで画面のなかで完結していたAIを、そのまま現実空間に展開できるのだ。

DGX Spark × Reachy Miniは、「高性能AIを、そのまま身体に宿らせる」ための最短構成といえるだろう。

次の連載2回目では、この構成をどう組み上げるか――実際の接続方法と開発ステップに入っていこう。

お問い合わせ

株式会社アスク

www.ask-corp.jp

TEXT_布留川英一 / Hidekazu Furukawa

EDIT_佐藤英一 / Eiichi Sato(ボーンデジタル)、池永 都 / Miyako Ikenaga