新世代のバーチャルセットソリューションZero Density社のReality。日本ではInter BEE 2018で初披露されて以来、業界内で話題を集めている。先日、そのZero Density社製品とStype社のトラッキング用機材のレンタルを扱う特殊映像社にて簡易的なグリーンバックスタジオによるデモンストレーションが行われた。その際の様子やバーチャルセットの活用術を、Zero Densityのデモビデオと共に紹介する。

※本記事は2019年2月22日の取材内容に基づきます。

TEXT_安藤幸央(エクサ)/Yukio Ando(EXA CORPORATION)

EDIT_山田桃子 / Momoko Yamada

<1>Zero Density社、Stype社とは?

Zero Density社は、もともと2007年にトルコで創業された30人ほどの企業だ。同社で開発されたリアルタイムノードベースの映像合成ソフトがRealityであり、そのベースとなったのはUnreal Engineである。平易に扱えるわりにクロマキーの精度がとても高く、2017年にはIBC 2017 Innovation Award for Content Creationや、第39回スポーツエミー賞などを受賞している業界での評価の高いソリューションだ。

また、デモに使用されたトラッキング用の機材を取り扱うStype社は2011年、クロアチアで創業された企業だ(ちなみに、社名は社長のニックネームに由来しているそう)。StypeKit、RedSpy、Fluid Headという放送局レベルのカメラトラッキングのソリューションを提供している。

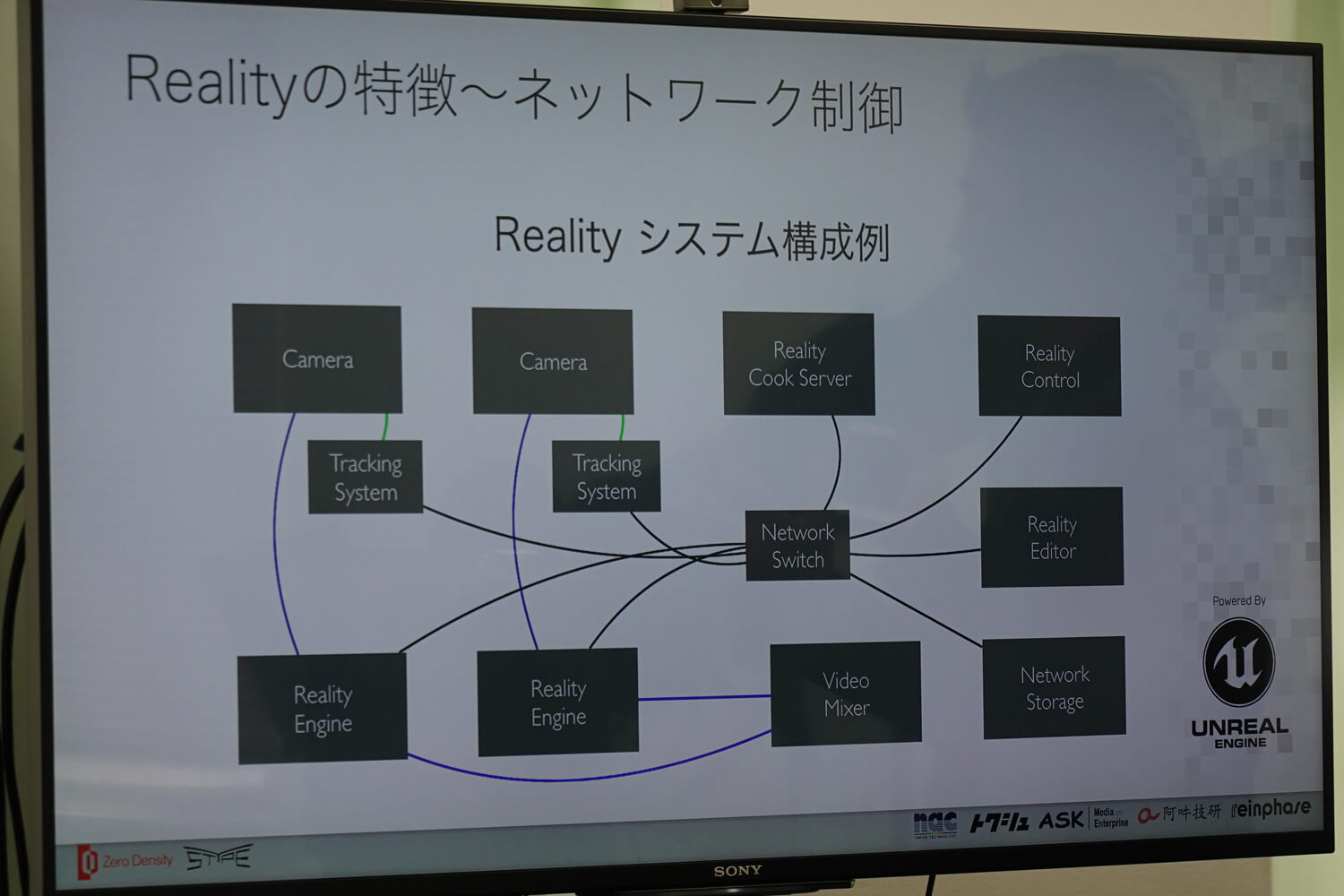

日本では、Zero DensityとStypeの製品群はアライアンス企業各社が扱っており、株式会社アスクは輸入を、株式会社リーンフェイズはテクニカルPRとマーケティングを、株式会社ナックイメージテクノロジーは販売を、有限会社 特殊映材社はレンタルを、阿吽技研株式会社はシステム構築とシステム提案を担当している。

<2>リアルタイムノードベース合成ソフトRealityの実力

機材デモが披露された仮設グリーンバックスタジオ

Realityの紹介のために特殊映像社内に設置されたグリーンバックスタジオは、テレビ局内の専用スタジオなどと比べると決してベストな環境、ベストな照明とは言えず、簡易的なものであった。しかしクロマキー合成の結果はとても精度が高く、精細かつ明瞭なものであった。

デモに使われた周辺機器は、トラッキング用にStype社の機材に加え、放送業界では定番の8bit YUV放送用カメラの代役としてSony HDW-F900、もう1台はシネマカメラの位置付けで10bit RGB出力でARRI ALEXA LFが使用された。

決してベストとは言えない照明の状況でも数方向からプロフィール用の撮影をするだけで、すぐに限りなくベストな環境に近づけることができた。

4Kにはもちろん対応し、ソフトウェア内部では16bitで対応するので、カメラからの入力は8bit、10bitのどちらでもより良い結果を出すしくみになっている。また、現在は4Kでの利用が一般的だがソフトウェア上の制限があるわけではないので、映像入力用のハードウェア、PCのスペックさえ許せば8K映像の合成を扱うことも可能だそうだ。

Realityの操作画面。Unreal Engineとほぼ共通している

RealityはWindows OS上で動作するもので、ベースとなっているのは先述したように、ゲームエンジンとして高品質な描画に評価が高いUnreal Engineである。Unreal Engineのソースコードに手を入れ、別バージョンとして分岐したアプリケーションを用いており、いわゆるUnreal Engineのクロマキー用魔改造されたソフトウェアとも言える(※当然ながら、Epic Gamesとの協力関係の下で開発されているので合法のものだ)。現行バージョンではUnreal Engine 4.20がベースとされている。

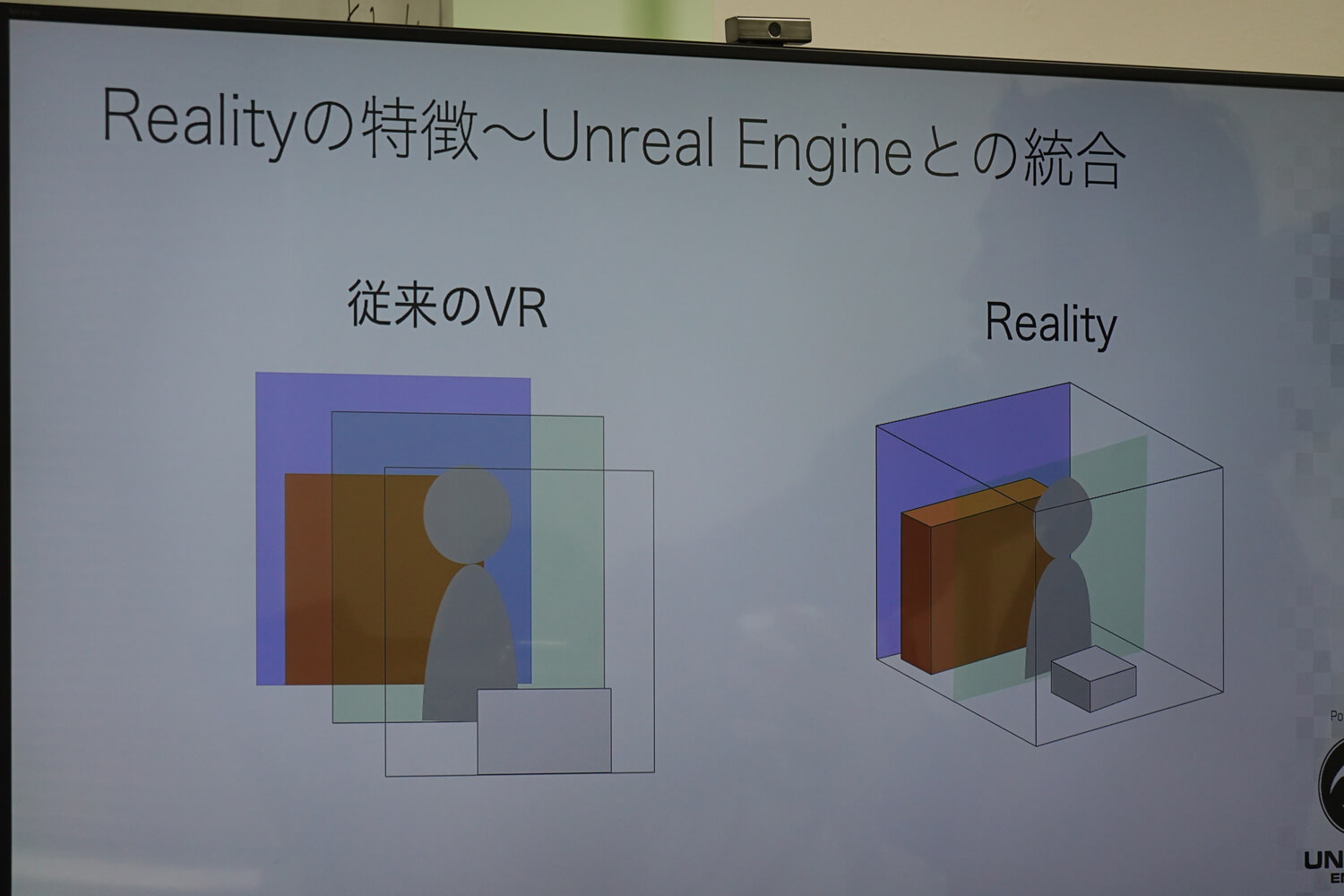

一般的なバーチャルスタジオでは背景面、人物、前方のオブジェクトなど、単なる平面のレイヤーが重なっているだけのソリューションが多い。しかしRealityはUnreal Engineがベースになっていることもあり、完全に3D空間の中に実写の映像を配置し、前後関係をもった映像を出力することができる。例えば実写映像にVFX素材を重ね合せる際、パーティクル、炎、煙などが人物を取り囲むような映像づくりが可能なのだ。

一般的なバーチャルスタジオと3D環境が扱えるRealityとのちがい

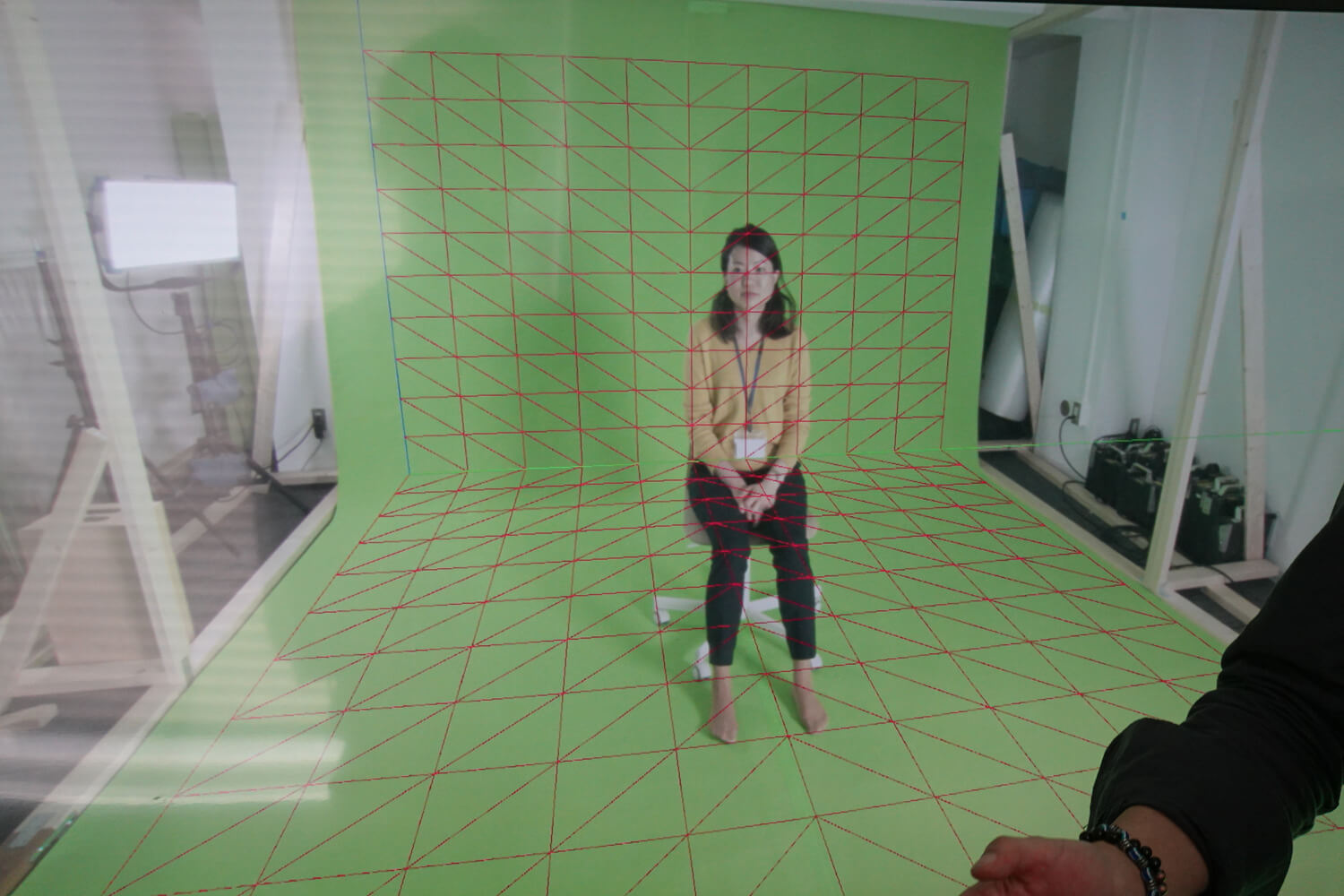

RealityのEditor機能はUnreal EngineのEditorと同様のもので、アセットを活用したり、プロビデオ用途に最適化されたプリセットなどが用意されている。スタジオのグリーンバックに合わせて3D空間内のメッシュを設定することができ、精度の高い合成が可能となっている。例えばホリゾントの位置や大きさ、ホリゾントのカーブしているR(曲面)部分の設定調整、照明にともなう暗さ、明るさなどをRealityに分析させて利用することができる。調整がうまくいった後であれば、床に落ちた水滴や透明なコップでさえもうまく合成して扱うことができ、グリーンバックの緑成分が映像に残ってしまうといった不自然なことは皆無だそうだ。

ホリゾント調整中の画面

<3>Realityの実例紹介、インパクト絶大「テレポーテーション」という合成手法も

グリーンバック撮影の人物(上)を、既存の実写カメラにリアルタイム合成(下)する様子

Realityは、さまさまな生放送番組に使われている。FOXスポーツやNASCAR(アメリカの自動車レース)のレースインタビューのほか、eスポーツ分野の大会などでゲームのキャラクターと実写を合成するなどといった用途に使われている。

生放送での合成事例

'Reality'is powering FOX Sports' new virtual studio for NASCAR season

またインパクトのある見せ方として「テレポーテーション」という手法を使ったものもある。これは、スポーツ大会の会場で仮設置したグリーンバックを背景に選手がインタビューを受けているものを、合成によって、あたかも放送局のスタジオでインタビューを受けているような映像にするといったものだ。

「テレポーテーション」の実例

Teleportation powered by Reality Engine in Finnish Ice Hockey League

こうしたリアルタイム配信に便利な機能として、Realityにはアクションビルダーという機能がある。これは、通常Unreal Engineだけでは不可能な映像描画中の3次元オブジェクトの移動を、あらかじめ動きを設定しておくことで可能にするものだ。この機能によって生放送中でも、現場で設定したボタンを押すだけでオブジェクトを切り替えたり移動したりすることができる。

また、Realityは内部的にはいくつかのアプリケーションが連携して動いているため、合成や編集をする人と、決められたオブジェクト操作をする人が平行して作業するようなこともできる。データやストレージを共有したり、ネットワークベースのソフトウェアのメリットを享受できるのだ。

Realityの機能がモジュールごとに分離して扱える様子

YouTubeのZero Density公式チャンネルでは、さまざまな合成事例がアップされているので、ぜひ参考にしてほしい。

<4>独自のトラッキング用プロトコルが使用できる、Stype社のデジタルトラッキングシステム

デモでは、Realityで利用するためのデジタルトラッキングシステムとしてStype社の製品が使用された。業界で一般的に使われているトラッキングシステム FreeD、D1などのプロトコルに対応しているのはもちろんのこと、カメラ情報も含めた情報を転送することができるStype社独自のトラッキング用のプロトコルも使え、Realityと組み合わせることでより高精度で正確な結果を得ることができる。

Stype社の独自プロトコルであるSTYPE A5/HFを利用することのメリットは、FreeD、D1プロトコルでは情報が含まれない、レンズのFOV、レンズディストーションの値 K1、K2、センターシフト情報、DoF情報などの正確なカメラ情報・レンズ情報がカメラトラッキングのデータとともに送信される点だ。さらにStype独自のプロトコルの利点としてタイムコードを入れることもできる。またそういった一連の便利な機能としてポストプロダクション用にFBXフォーマットでトラッキングデータを記録しておくこともできる。ネットワーク上にプロトコルが送信されるので、それを記録することで撮影後の合成処理、3DCG/VFXのコンテンツづくりに役立てることができるのだ。

リアルタイムでトラッキングデータが書き出せる点はほかにはない興味深いメリットで、プリビズ映像制作やポストプロダクションでの活用の可能性が広がる。例えば取得したレンズ情報をもとに、実写のボケ具合と、3DCGのボケ具合を合わせることもできるのだ。

StypeKit、10種類のプリセットがボタン一発で呼び出せる

Stype社のStypeKitは巨大な電卓のような機器で、メカニカルエンコーダである。カメラの操作、カメラブームが動いた値をトラッキングしつづける。StypeKitにはオートエイミング、オートフォーカスがあり、ある目標を設定すると、いかようにクレーンを動かしても常にそのオブジェクト(人物)をカメラフレームで捉え、フォーカスを合わせ続けるといった便利な機能が実現できる。それらの設定は10種類プリセットでき、ボタン一発で呼び出せる。

オートエイミング、オートフォーカス中の様子

StypeKitのギアとしては、定番4社の三脚・ブームに対応したものが用意されているが、要望しだいで別のクレーンでも使えるギアを用意するようにしているそうだ。メカニカルトラッキングカメラシステムなので、赤外線を使ったシステムのように遮蔽物の影響や光の影響は受けない。ペリカンケース1つで可搬できるコンパクトさも魅力だ。

また、Stype社のRedSpyは4K解像度の赤外線照射型のカメラトラッキングシステムで、壁や天井、床にランダムに貼った赤外線マーカーを捉えてカメラの動きを検知する。

カメラ上部の円筒状の機器がRedSpy

デモでは天井に数ミリ角の反射材がランダムに貼られていた。収録の際は1度に最低4個、20個以上のマーカーを捉えることができればかなり精度の高いトラッキングが可能だという。また今回のように250〜300cm程度の天井に設置する場合は8mm角程度のマーカーを利用する。

スタジオの大きさや撮影場所、室内・室外のちがいによって、マーカーの貼り付け場所や大きさ、数を調整するそうだ。また何らかの影響でマーカーが捉えられない状況になっても、ジャイロセンサーによって動きが補間されるため、いきなり座標が飛ぶようなことはなく、ある程度の追従はできるとのこと。メカ式のStypeKitは遅延量は1ミリ秒以下、RedSpyは8ミリ秒以下の遅延量と、どちらも一般的な利用では問題とならない。

天井に貼り付けられた数ミリ角の赤外線を反射するマーカー

デモを見た人からは「こんなに簡単でいいの?」というコメントが発せられたほど、手間がかからずにクオリティの高い合成が可能なReality。リアルタイムでもオフライン3DCGでも活用でき、今後はスタジオ用途だけでなく ARやVTuberへの活用といった可能性も見て取れた。

デモンストレーションを担当したZero Density社 Umut Özdemir氏(左)とStype社 LUKA PAVLINEK 氏(右)