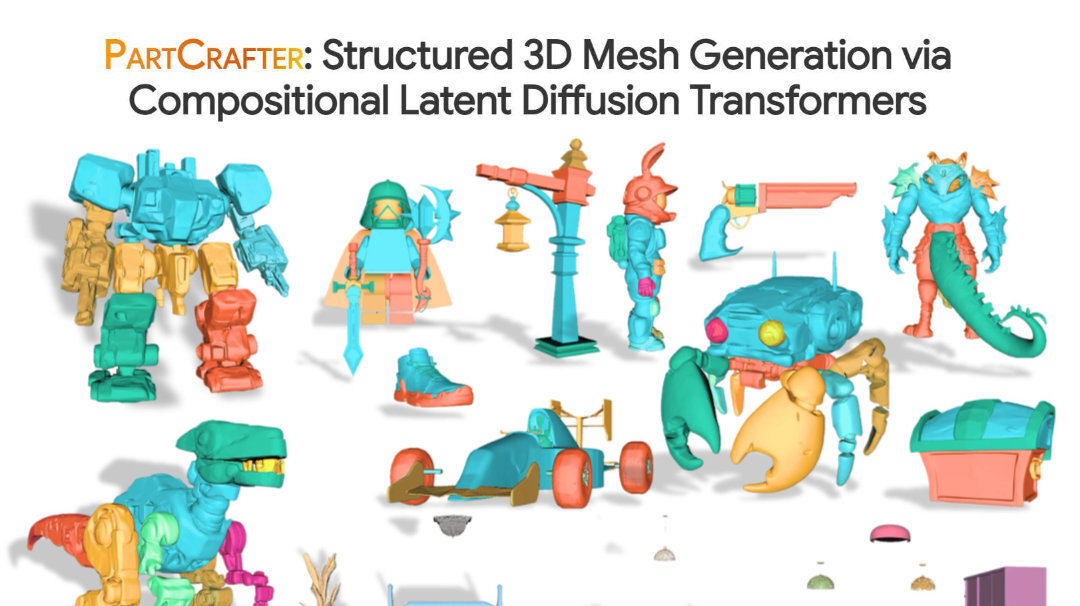

北京大学、バイトダンス、カーネギー・メロン大学からなる研究チームは6月13日(金)、パーツ単位で3Dメッシュを生成するAIモデル「PartCrafter: Structured 3D Mesh Generation via Compositional Latent Diffusion Transformers」をオープンソース(MITライセンス)で公開した(コードとチェックポイントの公開は7/15を予定)。

Introducing PartCrafter – a breakthrough in 3D generation!

— Yuchen Lin (@kevin_yuchenlin) June 9, 2025

From just one RGB image, it generates multiple structured, semantically meaningful 3D parts — all in one unified pass, no pre-segmentation needed.

Paper: https://t.co/9JFHDwOqRT

Project Page: https://t.co/VjtJjMFGZz pic.twitter.com/Zk5RGB1mB5

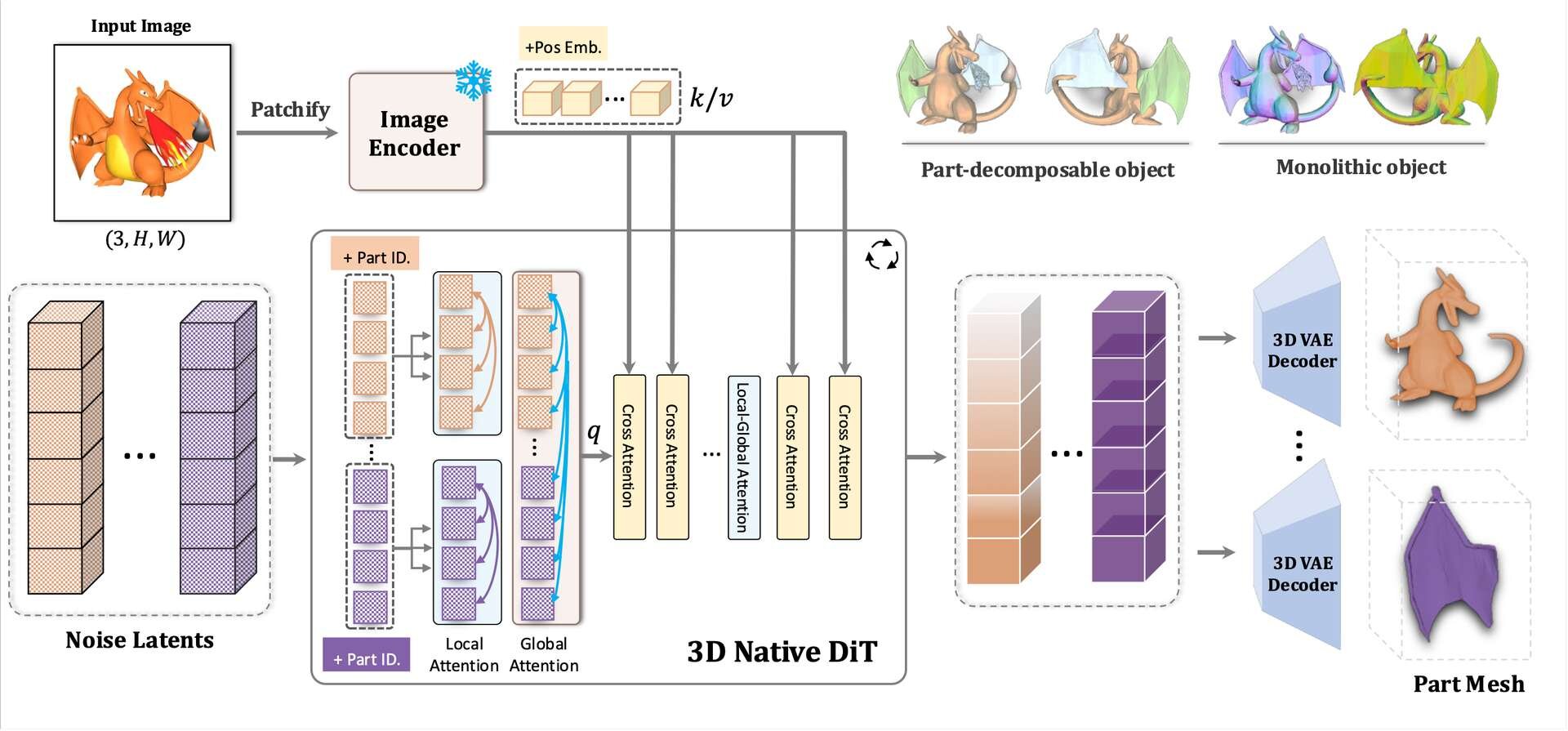

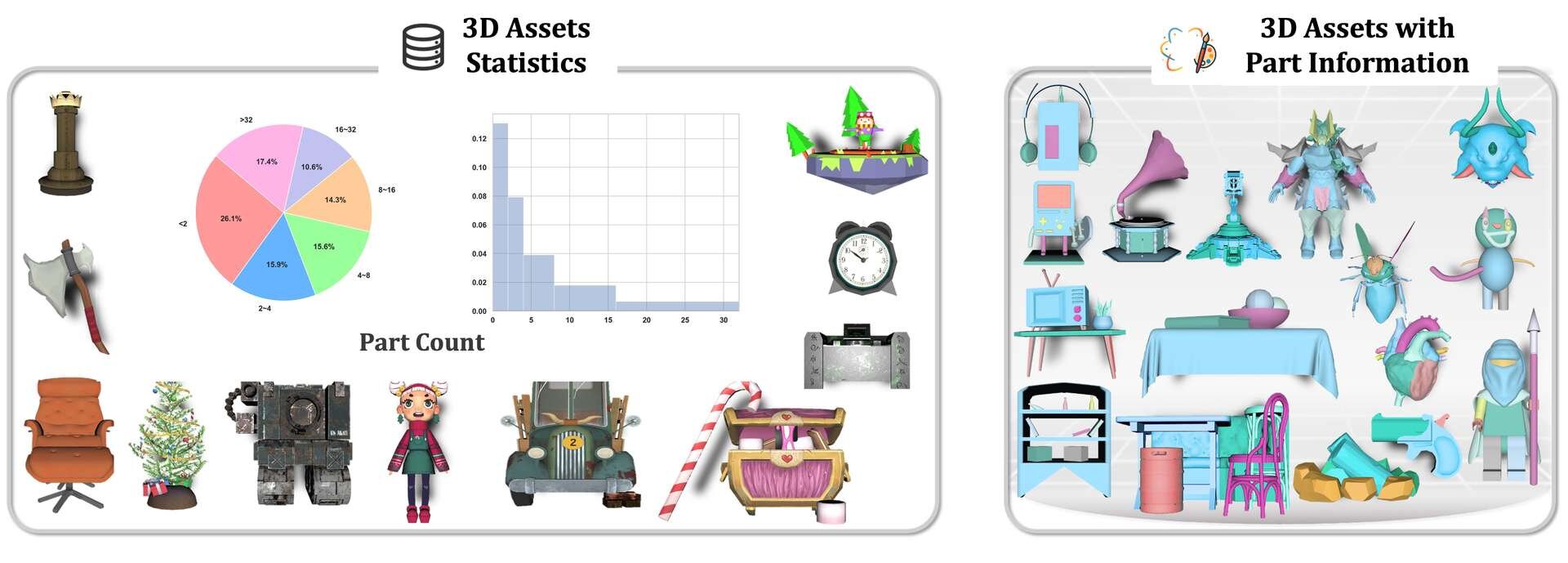

PartCrafterは、1枚のRGB画像から意味のある複数の3Dメッシュパーツを推定して生成し、ひとつの3Dオブジェクトを組み上げることが可能な3D生成モデル。

技術的特徴は、各3Dパーツが独立した「潜在トークン」として空間内で表現されることでパーツ同士が個別に扱えるようになる「構成的な潜在空間(Compositional Latent Space)」と、構造化された情報を効率的にながす仕組みである「階層的アテンション機構(Hierarchical Attention Mechanism)」という2点。これらの技術は、3Dメッシュの拡散トランスフォーマー(DiT、Diffusion Transformer)を基盤としている。

-

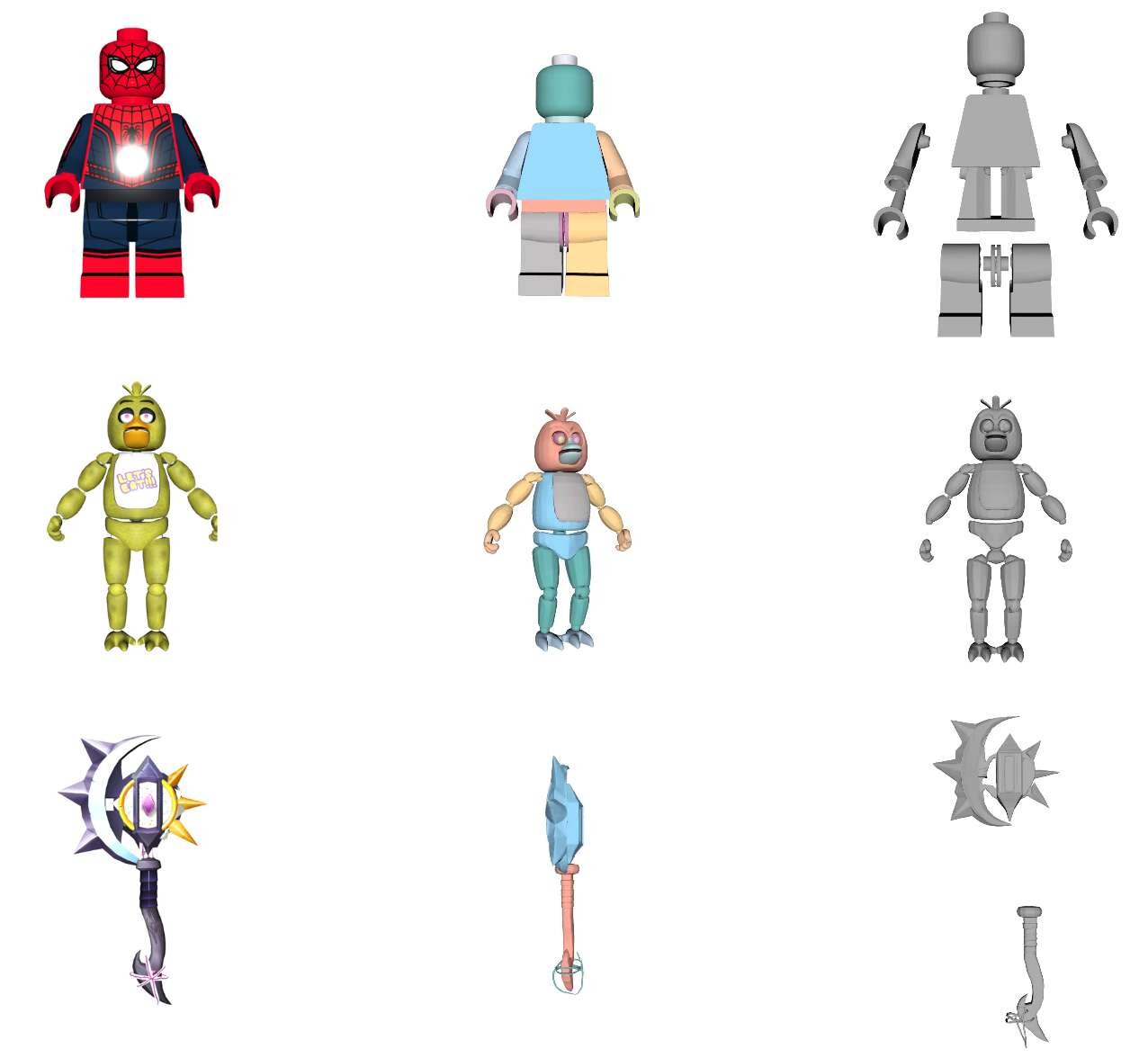

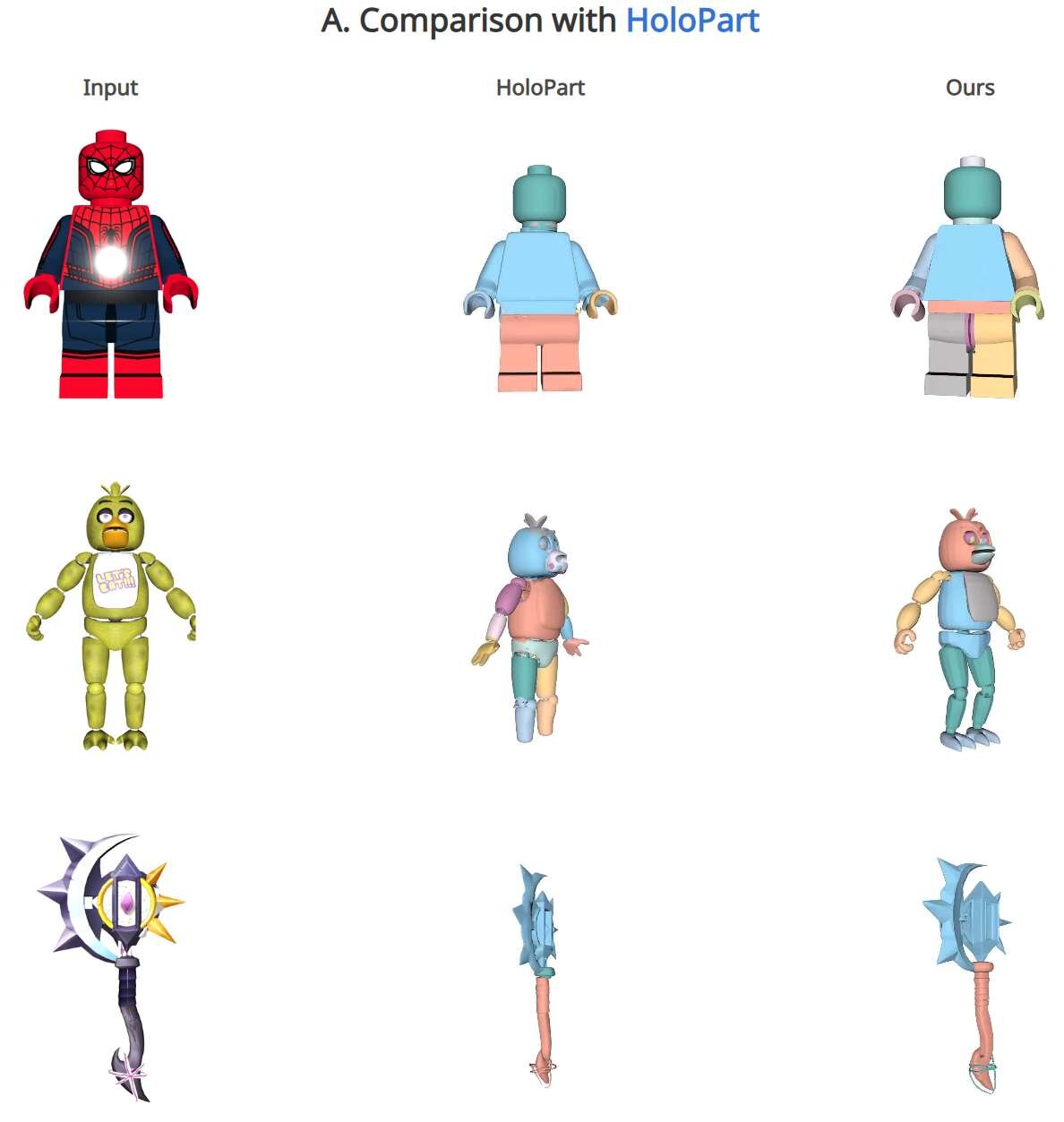

▲Vast社の「HoloPart」との生成品質比較 -

▲「MIDI: Multi-Instance Diffusion for Single Image to 3D Scene Generation」とのシーン生成品質比較

■PartCrafter: Structured 3D Mesh Generation via Compositional Latent Diffusion Transformers(プロジェクトページ、英語)

https://wgsxm.github.io/projects/partcrafter/

CGWORLD関連情報

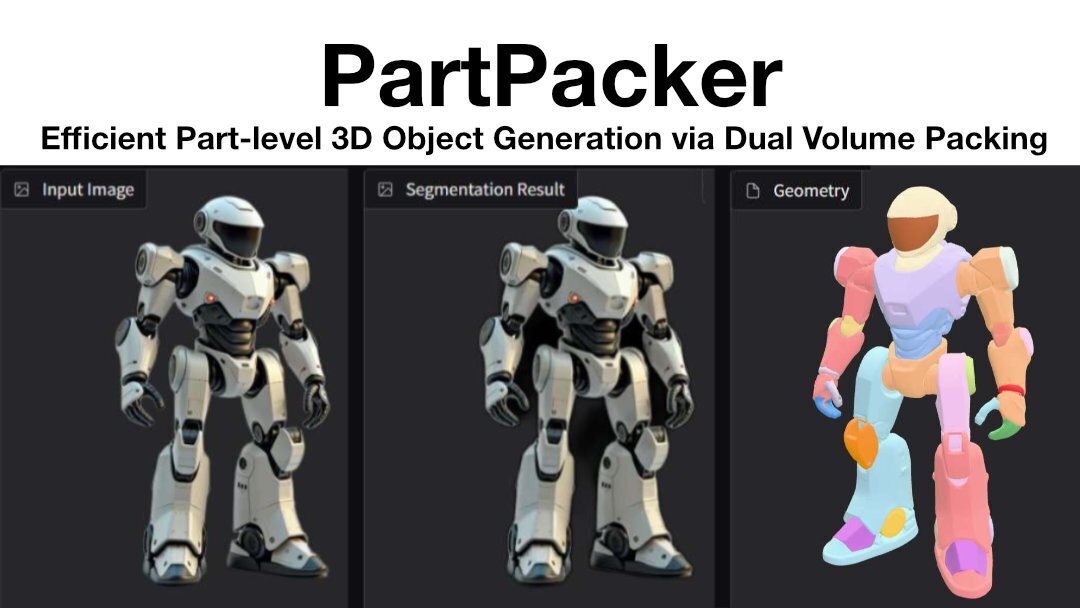

●NVIDIA、3Dモデル生成AI「PartPacker」GitHubで公開! 1枚の2D画像から意味のあるパーツ分割を施した3Dモデルを生成

NVIDIA(NVIDIA Deep Imagination Research)、北京大学、スタンフォード大学からなる研究チームが3Dモデル生成技術「PartPacker」を発表、GitHubでソースコードを公開した。ライセンスは「NVIDIA Source Code License」で、非商用目的での使用のみに制限されている。

https://cgworld.jp/flashnews/01-202506-NVIDIA-PartPacker.html

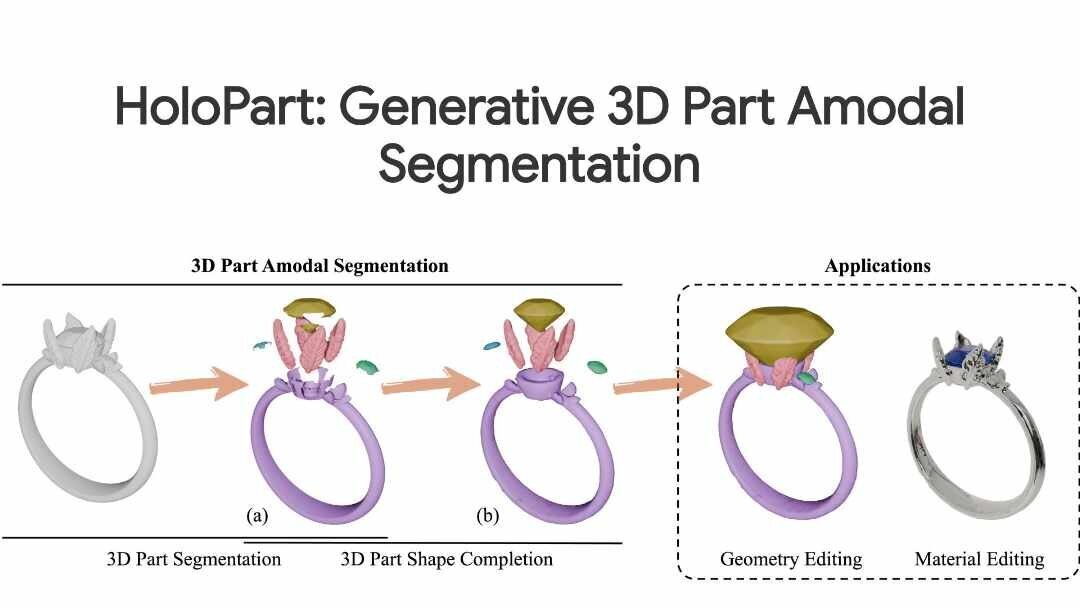

●「Tripo」のVastが3Dモデルをパーツごとに分解して生成できる3D生成AIモデル「HoloPart」をオープンソースで公開! 隠れた部分まで生成可能

Vastがオープンソースの3D生成AIモデル「HoloPart」を公開。見えない部分を含む分割(アモーダルセグメンテーション、Amodal Segmentation)のタスクを処理でき、完全な部品として3D形状を生成するのが特徴。

https://cgworld.jp/flashnews/01-202504-Vast-HoloPart.html

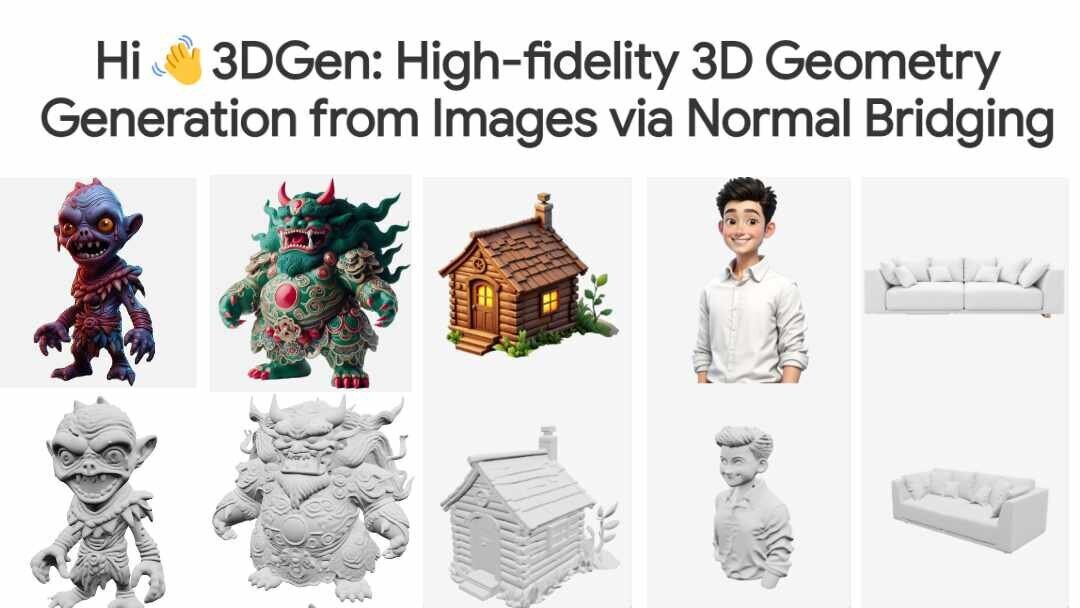

●3Dモデル生成AI「Hi3DGen v0.1」公開! 中間表現としてノーマルマップを使用することで高精細な3Dジオメトリの生成が可能に

香港中文大学(深圳)、ByteDance、清華大学の研究チームがオープンソースの3Dモデル生成AIプロジェクト「Hi3DGen: High-fidelity 3D Geometry Generation from Images via Normal Bridging」の論文を発表。Hi3DGen v0.1のモデルはHugging Faceのスペースでも公開されている。

https://cgworld.jp/flashnews/01-202504-Hi3DGen.html