中国テンセント(Tencent)社のHunyuanチームは9月2日(火)、世界モデル「HunyuanWorld-Voyager」をオープンソース(研究や個人利用に加え、一定の条件下で商用利用も許可する独自ライセンス)で公開した。1枚の画像とユーザーが定義したカメラの軌道から、3D的に一貫性のある動画を生成できる。

HunyuanWorld-Voyager is here and fully open-source! The world’s first ultra-long-range world model with native 3D reconstruction, redefining AI-driven spatial intelligence for VR, gaming, and simulations.

— Hunyuan (@TencentHunyuan) September 2, 2025

Direct 3D Output: Exports point cloud videos to 3D formats without tools… pic.twitter.com/fegYqHlPYR

HunyuanWorld-Voyager、ついに公開!完全オープンソースです!

これは、ネイティブな3D再構築機能を備えた世界初の超長距離ワールドモデルであり、VR、ゲーム、シミュレーションにおけるAIドリブンな空間知能を再定義します。

- ダイレクト3D出力:COLMAPのような外部ツールを必要とせず、点群動画を直接3Dフォーマットに出力。これにより、3Dアプリケーションですぐに利用できます。

- 革新的な3Dメモリ:スケーラブルな「ワールドキャッシュ機構」を導入し、どのようなカメラの軌道でもジオメトリの一貫性を保証します。

- トップクラスの性能:スタンフォード大学のベンチマーク「WorldScore」で第1位を獲得。動画生成と3D再構築の両方で卓越した性能を誇ります。

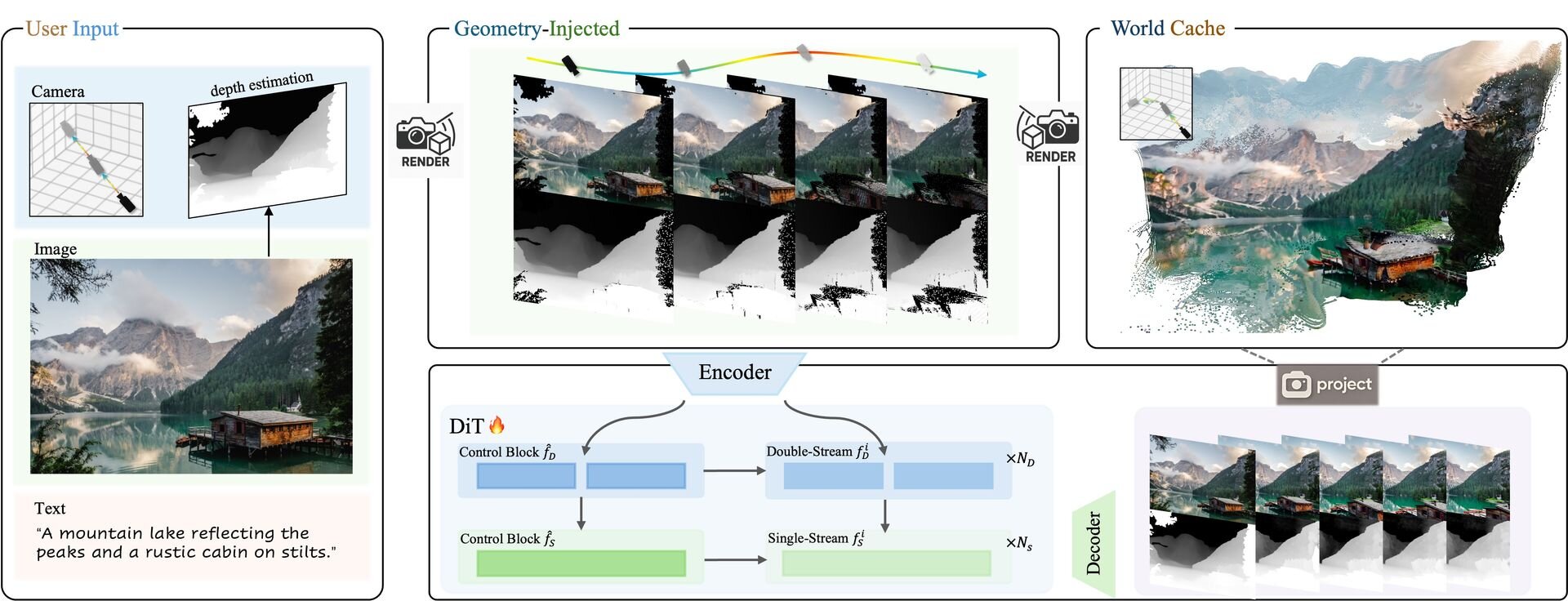

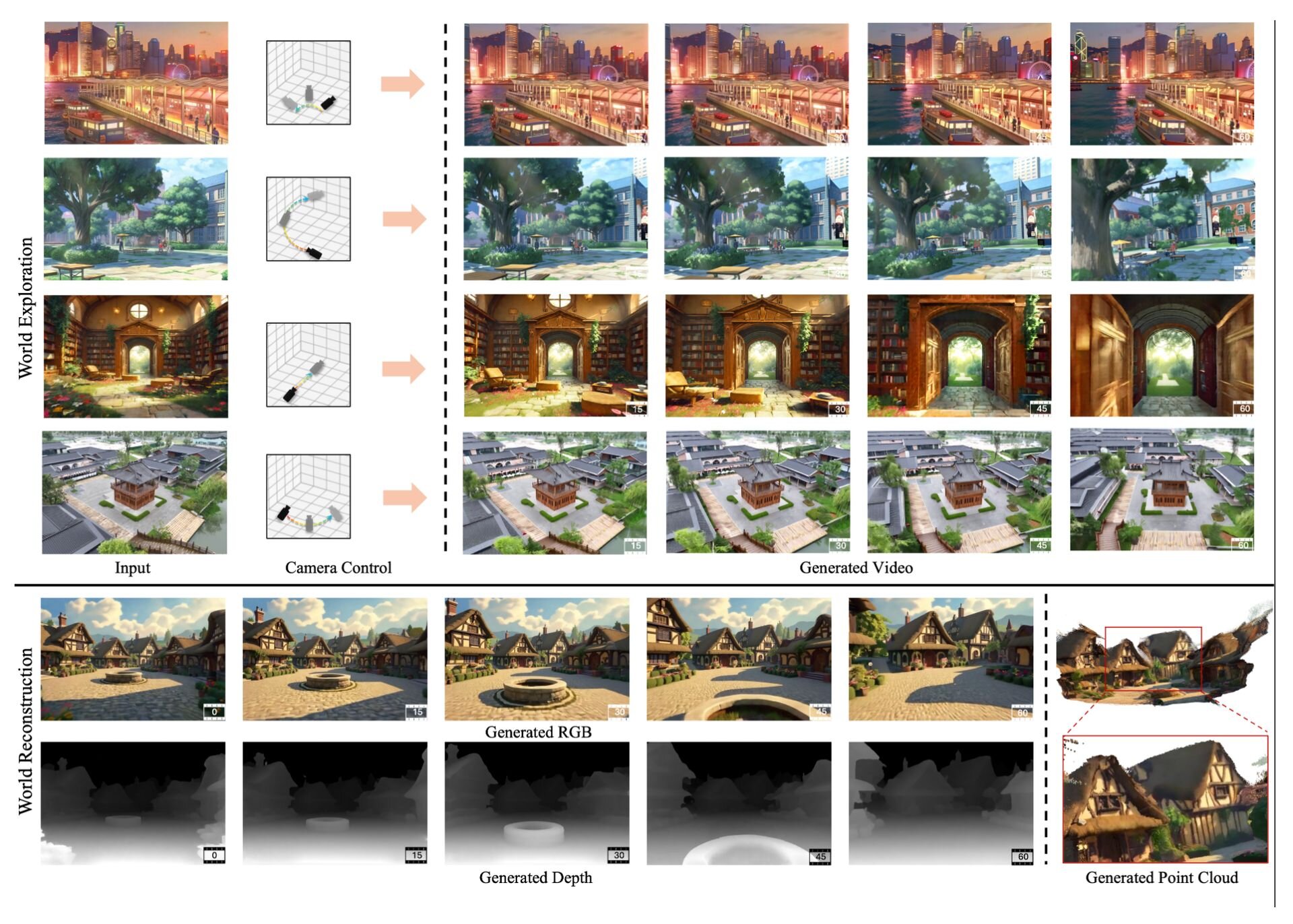

HunyuanWorld 1.0を基盤とするVoyagerは、動画生成と3Dモデリングを融合させ、カメラで制御可能な高忠実度のRGB-D(カラー+深度)シーケンスを提供します。

キーボードやジョイスティックでシーンを操作し、比類なき3D一貫性を体験してください。

HunyuanWorld-Voyagerは、「世界観と一貫性のある動画拡散モデル(World-Consistent Video Diffusion)」と「長距離のワールド探索(Long-Range World Exploration)」という2つの主要素により構成される。前者は既存のワールドの観測データ(生成済みの部分)を条件として、全体的な一貫性を保証する統合アーキテクチャで、整合性の取れたRGB映像と深度映像のシーケンスを同時に生成する。

後者は点群の間引き(point culling)を行う効率的な「ワールドキャッシュ」と、滑らかな動画サンプリングを伴う「自己回帰的推論(auto-regressive inference)」を組み合わせたもの。これにより、映像の文脈を認識しながら一貫性を保ち、シーンを反復的に拡張していくことが可能になる。

Voyagerの学習のために開発された「データエンジン」は、あらゆる動画からカメラの姿勢推定と正確な深度予測を自動化する「動画再構築パイプライン」となっている。この仕組みにより、手動での3Dアノテーションを必要とせず、大規模かつ多様な学習データを収集。このパイプラインを用いて、現実の撮影映像と、Unreal Engineによる合成レンダリング映像を組み合わせ、10万本以上の動画クリップからなるデータセットを構築した。

■Hunyuan World Model-Voyager(プロジェクトページ)

https://3d-models.hunyuan.tencent.com/world/

■HunyuanWorld-Voyager(GitHub)

https://github.com/Tencent-Hunyuan/HunyuanWorld-Voyager

ライセンスについて

HunyuanWorld-Voyagerは「TENCENT HUNYUANWORLD-VOYAGER COMMUNITY LICENSE」に基づき、オープンソースで提供される。本ライセンスでは、月間アクティブユーザー数が100万人を超えない限り、商用利用ができる。ただし、EUとイギリス、韓国では適用されず、これらの地域からアクセスして利用することはできない。

■TENCENT HUNYUANWORLD-VOYAGER COMMUNITY LICENSE AGREEMENT(GitHub)

https://github.com/Tencent-Hunyuan/HunyuanWorld-Voyager?tab=License-1-ov-file#readme

CGWORLD関連情報

●世界モデル「Mirage 2」公開! 画像とプロンプトからリアルタイムでインタラクティブな空間を生成し、リンク共有でオンラインプレイが可能

Dynamics LabがAIシステム「Mirage 2」を公開。画像やテキストプロンプトから、ユーザーが操作・探検できるインタラクティブな3D世界をリアルタイムに生成する技術で、ユーザーが創作した世界(ゲーム)はオンラインで共有できる。Mirage 2は現在、ユーザーを問わずオンラインでプレイ可能となっている。

https://cgworld.jp/flashnews/01-202509-Mirage2.html

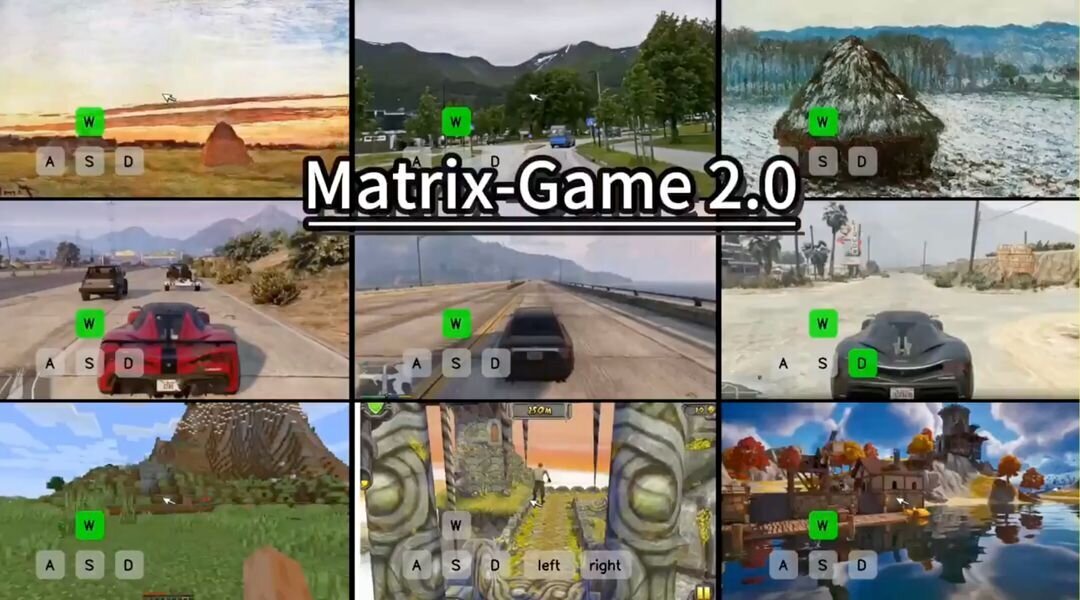

●オープンソースの世界モデル「Matrix-Game 2.0」リリース! マウスやキーボード操作に反応しながら25fpsの長尺動画をその場で生成

Skywork AIがオープンソース(MITライセンス)の世界モデル「Matrix-Game 2.0」をリリース。マウスやキーボード操作に反応しながら、25fpsの長尺動画をその場で生成する。コードとウエイトがGitHubとHugging Faceで公開されている。

https://cgworld.jp/flashnews/01-202508-Matrix-Game2.html

●Googleの世界モデル「Genee 3」発表! テキストプロンプトからインタラクティブでプレイ可能な3D環境を生成、720p・24フレーム/秒

Google DeepMindが新しい世界モデル「Genie 3」を発表。テキストプロンプトからリアルタイムで操作可能な多様なインタラクティブ環境を生成できる汎用モデルで、720p・24フレーム/秒、数分間にわたる一貫性を維持できる。現在は一部の研究者やクリエイターを対象とした限定的な研究プレビューとして提供されている。

https://cgworld.jp/flashnews/01-202508-Google-Genee3.html