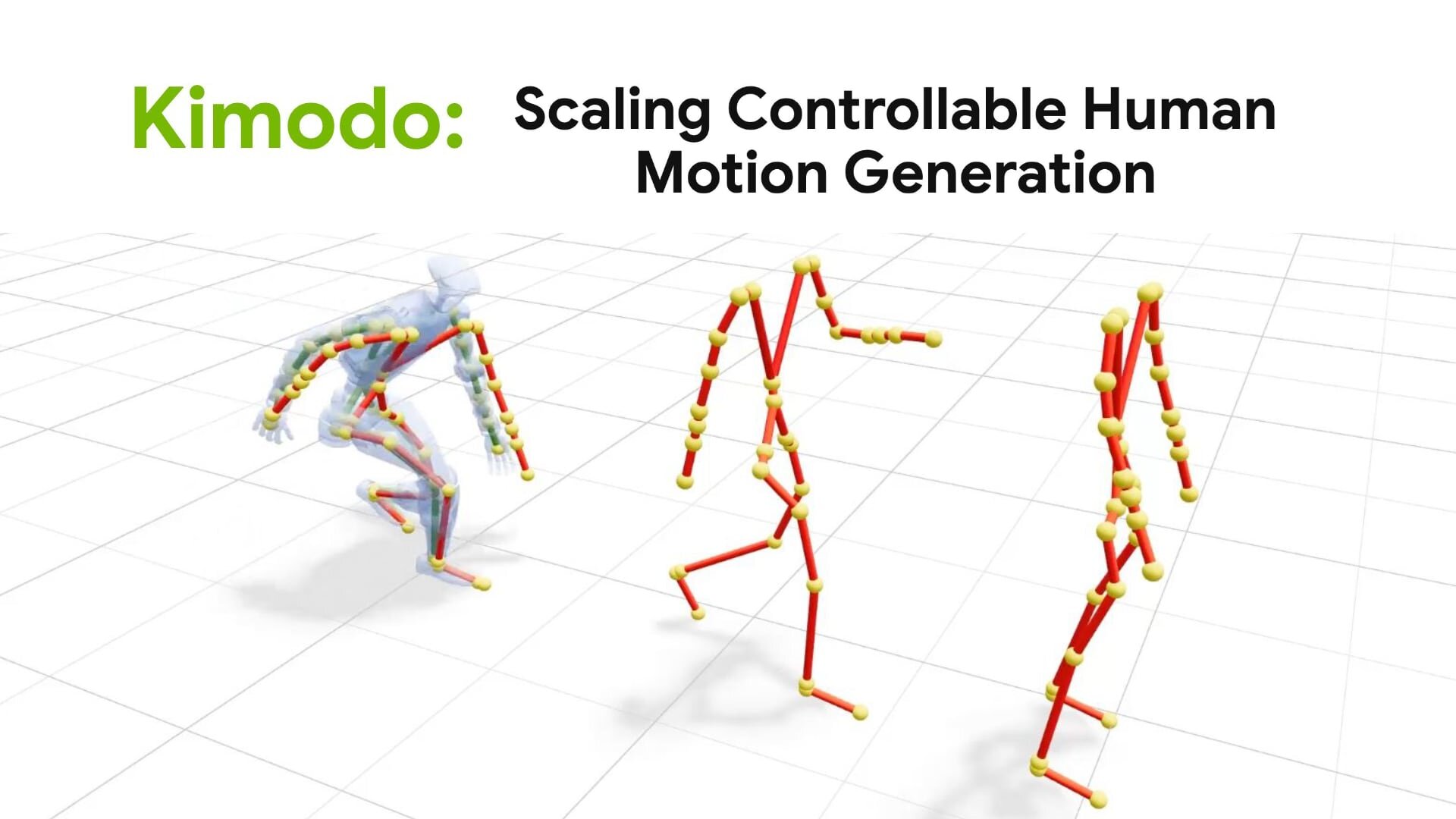

NVIDIAのSpatial Intelligence Labは3月16日(月)、人間の動作を高精度に生成する新たなAIモデル「Kimodo」を発表した。本プロジェクトは、700時間分にも及ぶ大規模な光学式モーションキャプチャデータから学習した「Kinematic Motion Diffusion Model(運動学的モーション拡散モデル)」。テキストによる指示や、空間内での骨格の位置指定といったコンストレイントの入力により、高品質な3Dモーション生成を行える。モデルとウェイトはオープンソースで公開され、ライセンスは、条件を満たせば商用利用や派生モデルの作成、配布を許可する「NVIDIA Open Model License」が適用されている。

Need high-quality motion for humanoid robots or digital humans?

— Davis Rempe (@davrempe) March 17, 2026

Meet Kimodo: our new diffusion model trained on 700 hours of optical mocap data for easy, controllable, and high-fidelity motion generation. @NVIDIAAI https://t.co/aVbQB0WQLA pic.twitter.com/H4j9lCnCtX

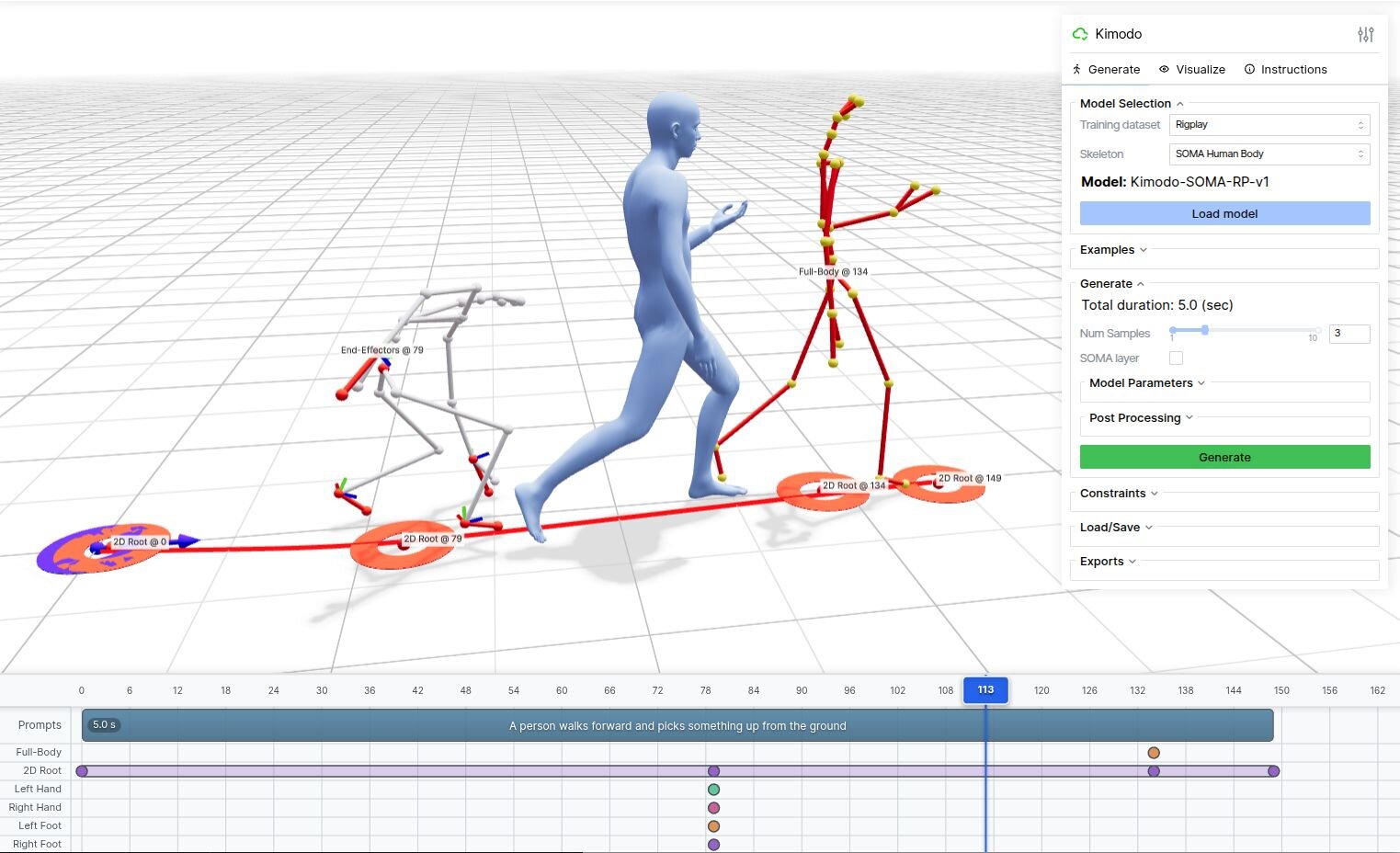

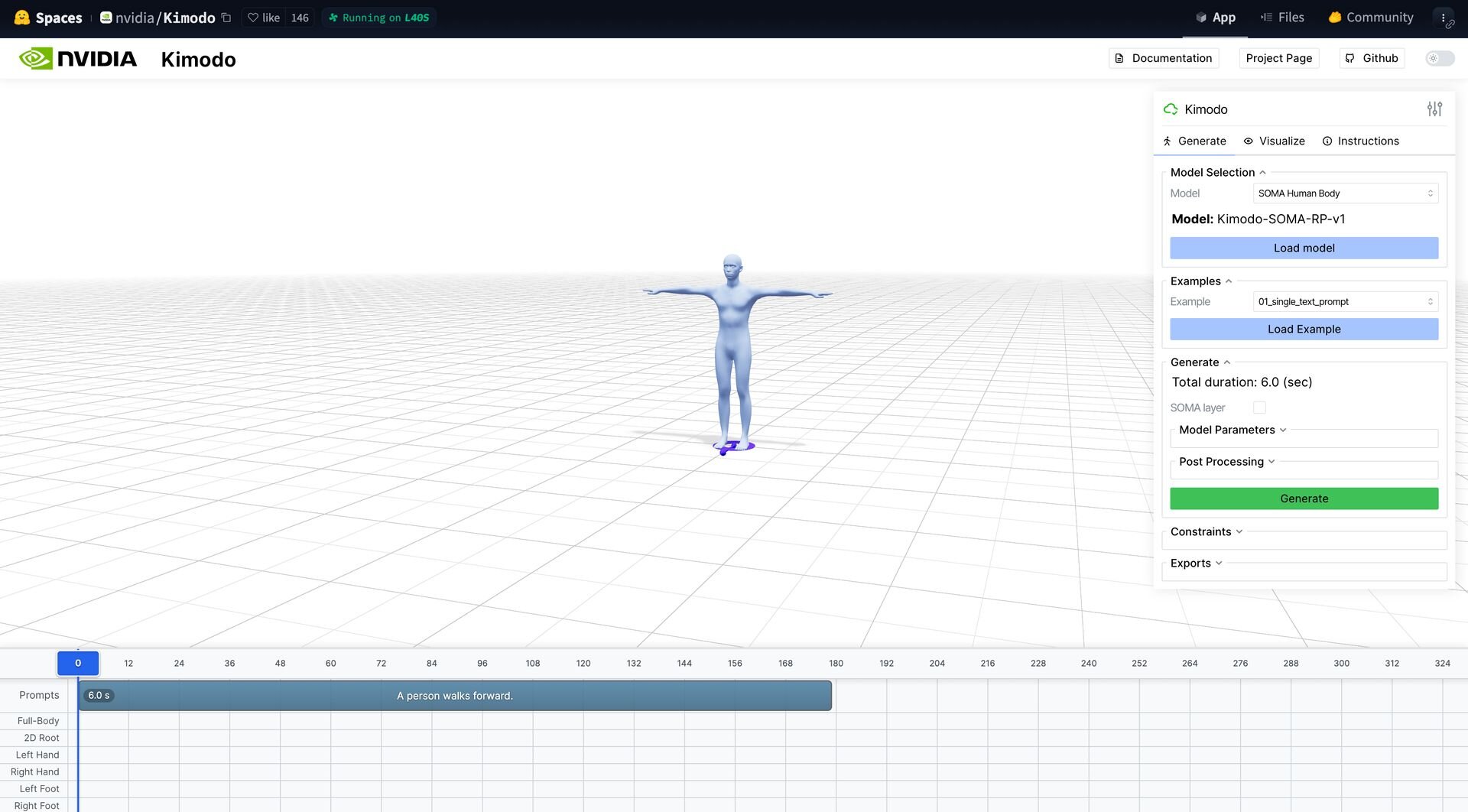

「Kimodo」では、テキストプロンプトによる直感的な動作指定と、キネマティック(運動学的)なコンストレイント(制約)を用いた細やかな制御を両立するモーション生成モデル。「歩きながら手を振る」「ダンスをする」といったテキストでの大まかな指示をベースに、特定のタイミングで手足の位置を固定するスパースなコンストレイントや、空間内の移動経路を描画して指定する2Dウェイポイントなどを追加で組み合わせることができる。

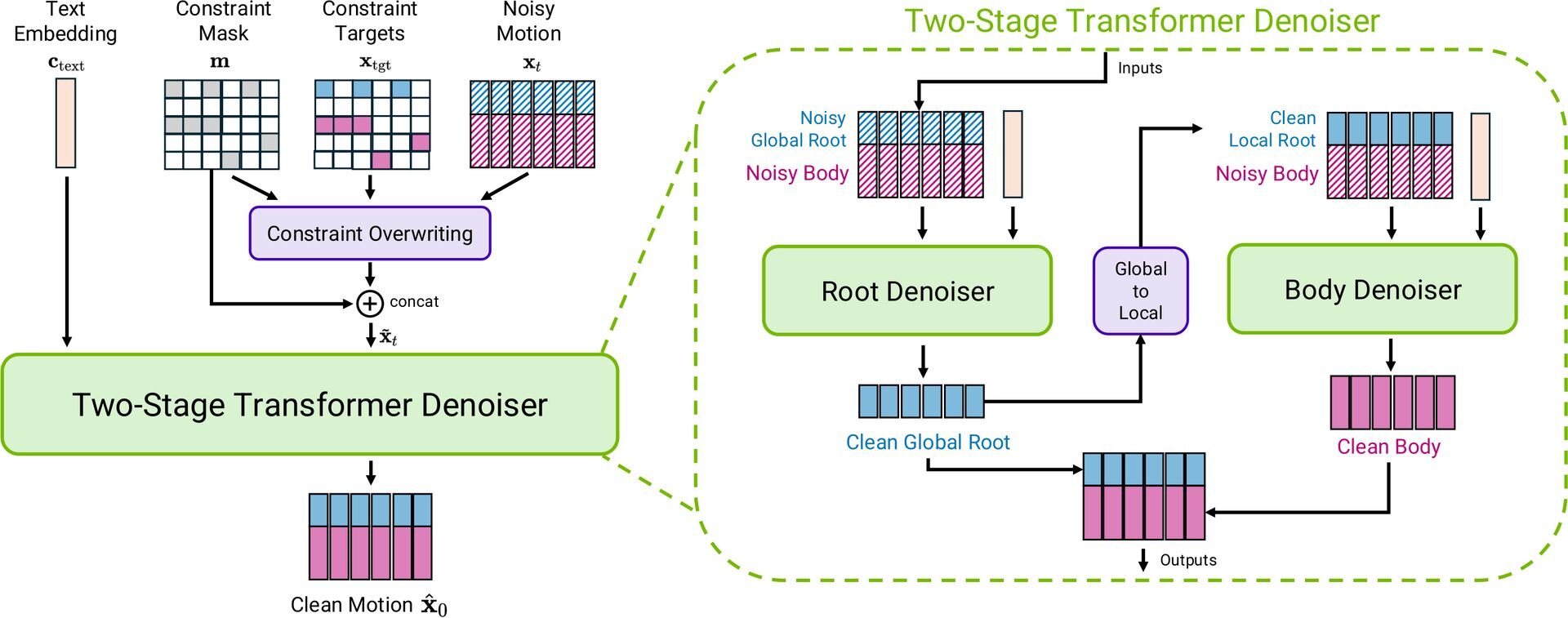

この複雑な制御には、動きのノイズを段階的に除去する2段階デノイザーアーキテクチャ(Two-stage Denoiser Architecture)が採用されている。従来のAIによるモーション生成では、キャラクターの移動と手足の動きを同時に計算していたため、足が地面を滑る「フットスケート」と呼ばれる現象や、不自然なブレが生じやすかった。

Kimodoでは、これを「空間全体における身体の移動(Root)」と「手足など身体各部の細かな動き(Body)」の予測に分離して処理。これにより、指定した経路を正確になぞりながらも、物理法則に反しない極めて自然な動作を生成することに成功したという。

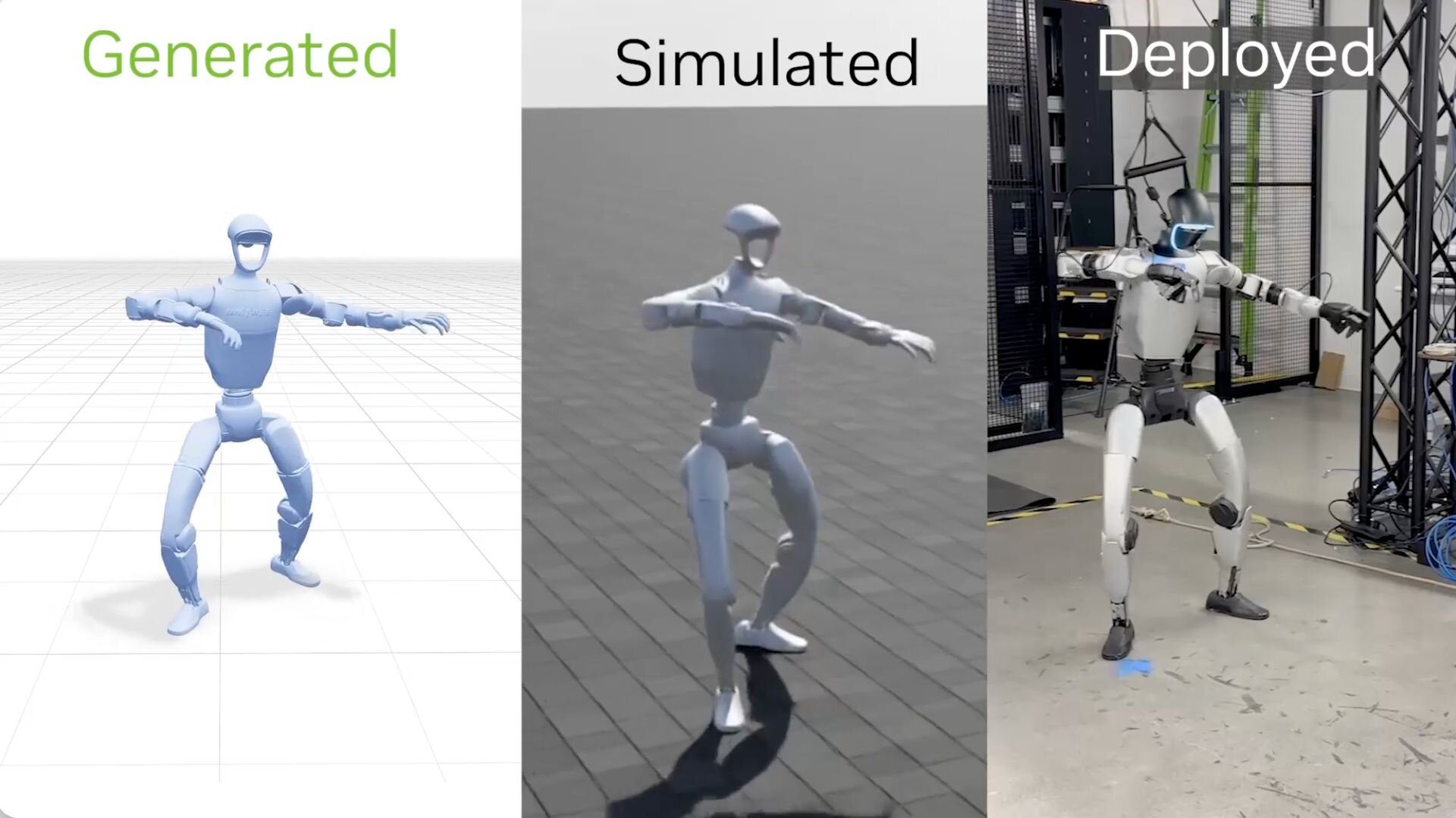

生成したモーションデータはロボティクス分野での活用も想定されており、NVIDIAのデジタルヒューマン向け身体モデル「SOMA」や、小型ヒューマノイドロボット「Unitree G1」の骨格構造に合わせたモーションを直接出力できる。また、物理シミュレーション環境「ProtoMotions」や「MuJoCo」に対応した形式での書き出しにも対応する。

■Kimodo: Scaling Controllable Human Motion Generation(プロジェクトページ)

https://research.nvidia.com/labs/sil/projects/kimodo/

ライセンスについて

Kimodoはオープンソースのプロジェクトとして公開されており、Hugging FaceやGitHubからモデルの重みデータやソースコードを誰でも無償で取得できる。ライセンスについては、条件を満たせば商用利用や派生モデルの作成、配布をも許可する「NVIDIA Open Model License」が適用されている。

■NVIDIA Open Model License

https://www.nvidia.com/en-us/agreements/enterprise-software/nvidia-open-model-license/

■Kimodo: Scaling Controllable Human Motion Generation(GitHub)

https://github.com/nv-tlabs/kimodo

■Kimodo-v1(Hugging Face)

https://huggingface.co/collections/nvidia/kimodo-v1

■Kimodo Demo(Hugging Face)

https://huggingface.co/spaces/nvidia/Kimodo

CGWORLD関連情報

●テンセント、オープンソースのモーション生成モデル「HY-Motion 1.0」リリース! テキストプロンプトから3Dキャラクターのモーションを生成

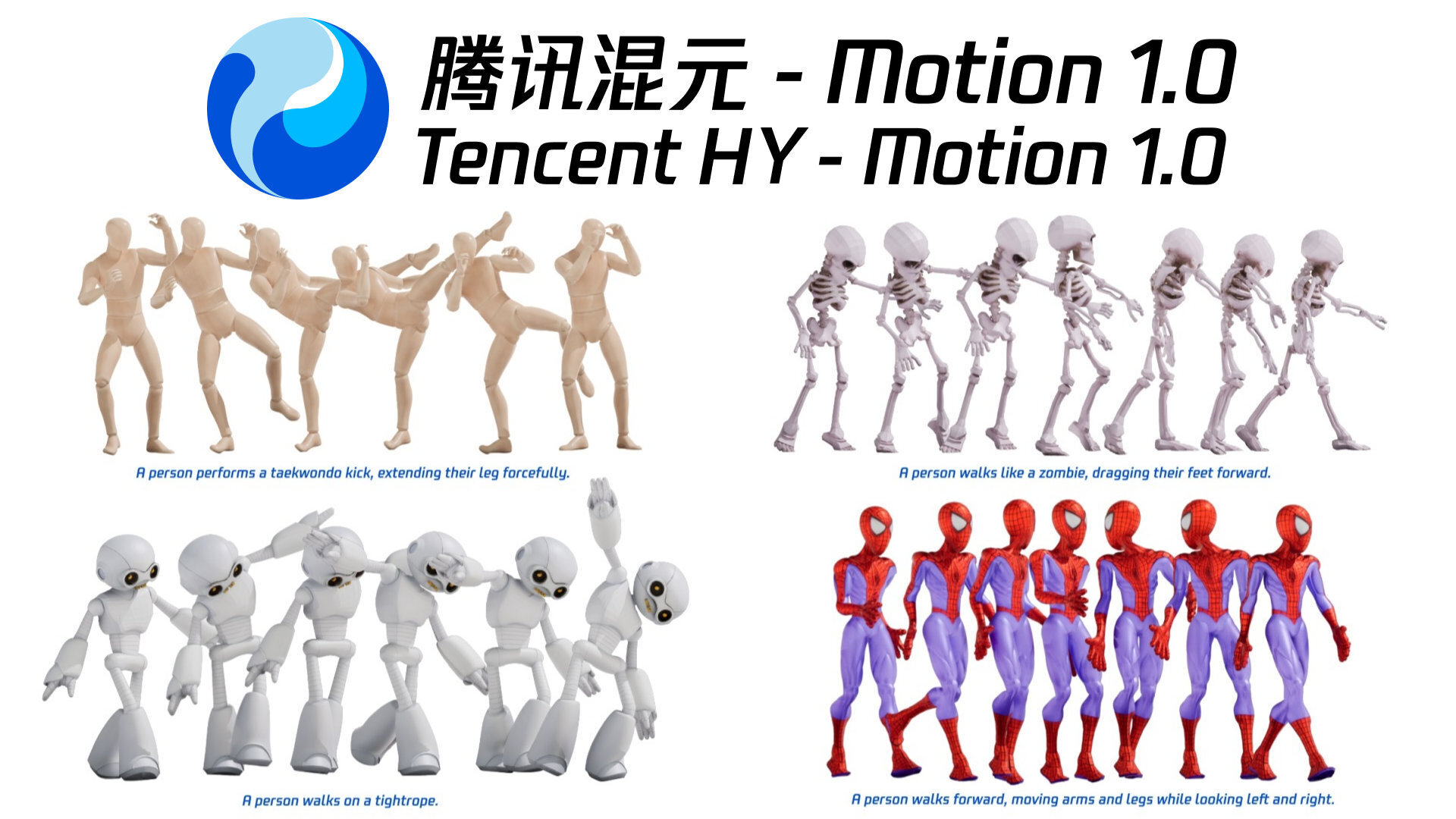

テンセントのHunyuanチームが、テキストプロンプトに基づいて3Dキャラクターモデルの動作を生成する、オープンソースのAIモデル「HY-Motion 1.0」を公開。ソースと学習済みモデルのウェイトがGitHubとHugging Faceで配布されている。ライセンスは独自の「TENCENT HY-MOTION 1.0 COMMUNITY LICENSE」が適用されており、MAU1億人超の大規模プラットフォーマーを除く一般企業や個人は無償で商用利用、複製、改変、再配布が可能。

https://cgworld.jp/flashnews/01-202601-HY-Motion.html

●NVIDIAら、少数の画像から高速・高精度の3Dシーンを復元する「InstantSplat++」をオープンソースで公開! 2024年発表「InstantSplat」の拡張版

テキサス大学オースティン校、NVIDIA、厦門大学、テキサスA&M大学、ジョージア工科大学、スタンフォード大学、南カリフォルニア大学からなる共同研究チームが、数点の画像から数秒でフォトリアルな3Dシーンを構築できる技術「InstantSplat」の拡張版「InstantSplat++」をオープンソース(Apache-2.0ライセンス)でリリース。基盤となるInstantSplatの設計を維持しつつ、ごくわずかな視点の画像から大規模な空間を再構成できるように改良されている。

https://cgworld.jp/flashnews/01-202603-InstantSplat.html

●NVIDIA、新しい3DGSセグメンテーション技術「ArtisanGS」発表! AIと手動を組み合わせることにより高精度なオブジェクト抽出を実現

NVIDIAとトロント大学の研究チームが、3D Gaussian Splatting(3DGS)を用いたシーンから、任意のオブジェクトを対話的に抽出・編集できるツール群「ArtisanGS」の論文を公開。AIを活用した高速なオブジェクトや領域のセグメンテーションと、手動での柔軟な微調整を組み合わせることにより、ノイズの多い現実世界のキャプチャデータからでも目的の立体物を正確に切り出すことが可能となる。

https://cgworld.jp/flashnews/01-202603-ArtisanGS.html