グリーンバック方式のバーチャルプロダクションを用いることで、『牙狼〈GARO〉』の独創的な世界観と特撮アクションの醍醐味を最大限に引き出した本作。メインVFXベンダーを務めるスタジオ・バックホーンの取り組みを追った。

garo-project.jp/HIGASHINOKAIROU/

監督:鈴村正樹、木村好克、田口清隆

脚本:鴨 義信、江良 至

原作:雨宮慶太

製作・制作:東北新社

特別協力:サンセイアールアンドディ

エグゼクティヴ・プロデューサー:二宮清隆

プロデューサー:井野十兵、安養寺紗季

©2026「東ノ界楼」雨宮慶太/東北新社

今まで見たことがなかった世界観を描く

現在放送中の特撮テレビドラマ『牙狼〈GARO〉 東ノ界楼』。20年以上にわたり愛され続けている『牙狼〈GARO〉』シリーズの最新作だが、全編をグリーンバック(以下、GB)方式のバーチャルプロダクション(以下、VP)で撮影するという新たな試みが実践された。

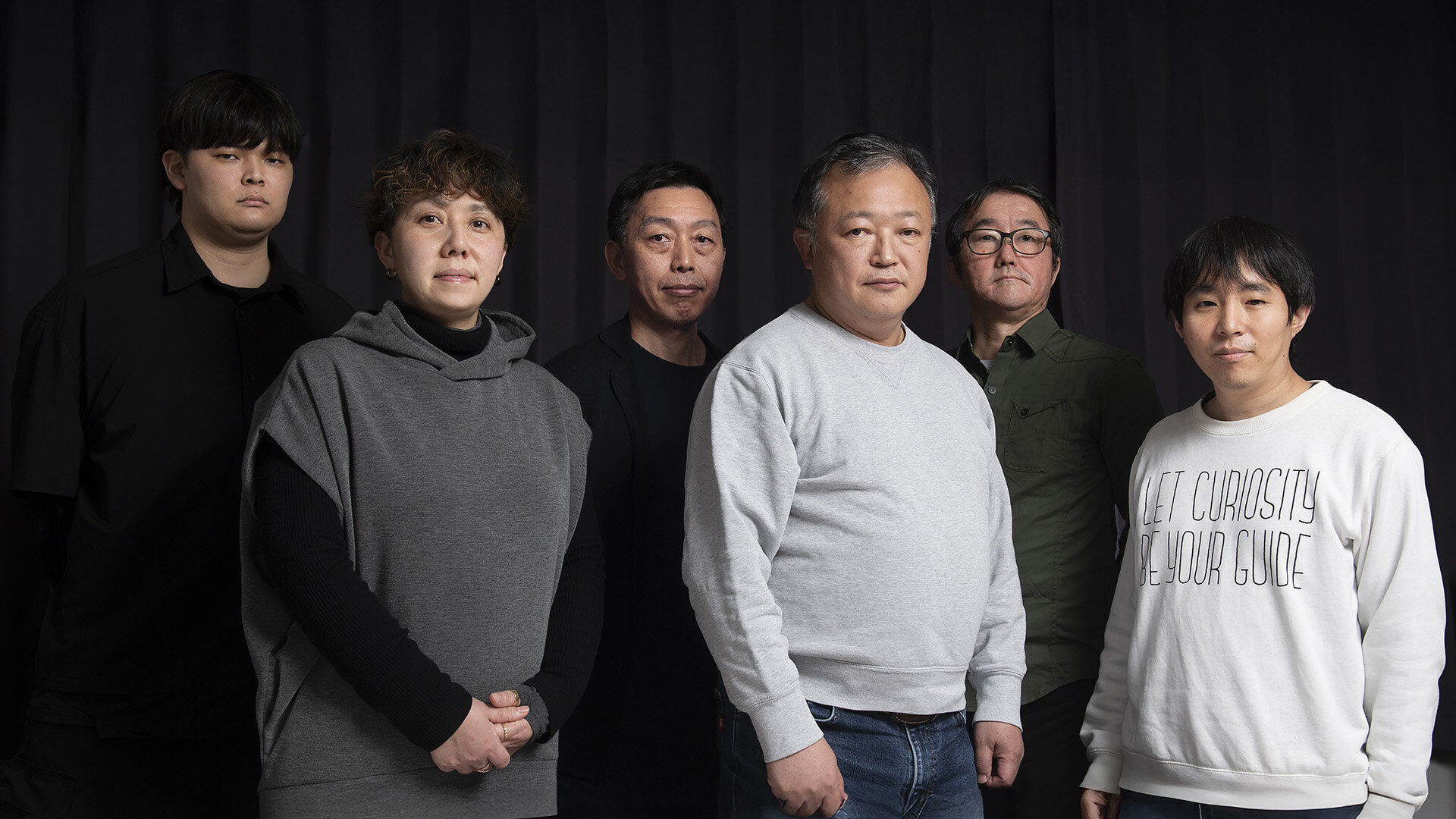

「最初にご相談をいただいたのは2025年4月頃でした。そのときから全編グリーンバック撮影で、AIなど新しいテクノロジーを積極的に採り入れつつ今までに見たことがなかった世界観を描きたいというオーダーをいただいていました」と、本作のVFXヘッドスタジオを務めるスタジオ・バックホーン(以下、StB)の鹿角 剛VFXスーパーバイザーはふり返る。

そこで鹿角氏は、GB方式のVPを提案した。VPはスクリーンプロセスかインカメラVFXかを問わずLEDウォールを用いるのが一般的だが、特撮アクションの醍醐味を最大限に引き出せるのはGB方式だと鹿角氏は考えた。

「LED方式では、LEDにピントを合わせると撮り方によってはモアレが発生する恐れがあります。さらに特撮アクションでは自由なカメラワークが理想なので、自ずとLEDウォールの範囲以上の画角が発生します。加えてリアルカメラの挙動とバーチャル背景とのレイテンシーがたとえわずかでも発生することも避けるにはGB方式が望ましいと考えました」(鹿角氏)。

GB方式であれば、スタジオ全面をGBで覆え、360度回転するような激しいカメラワークも可能。さらに「(牙狼の)黄金に輝く鎧」というビジュアルも、この選択を後押しした。語弊を承知で実写とCGの馴染み以上に、どんなシチュエーションでも金色が魅力的に見えることが求められるため、GB撮影でも演出的なライティングと相応のVFXによって意図したビジュアルに仕上げられるわけだ。

「VPを選択したことでバーチャル背景を撮影前までに完成形に近い状態までつくり込むなど、新たな苦労も多くありました。ですが、監督陣、撮影スタッフ、そしてわれわれVFXチームが有機的に連携することで『牙狼』独自の世界観とアクション表現が高次元で融合した新しい映像を創り出せたと思います」(鹿角氏)。

<1>効率性とハイクオリティの両立〜撮影システム〜

撮影スタジオとUnreal Engineの3D空間を正確に同期させる

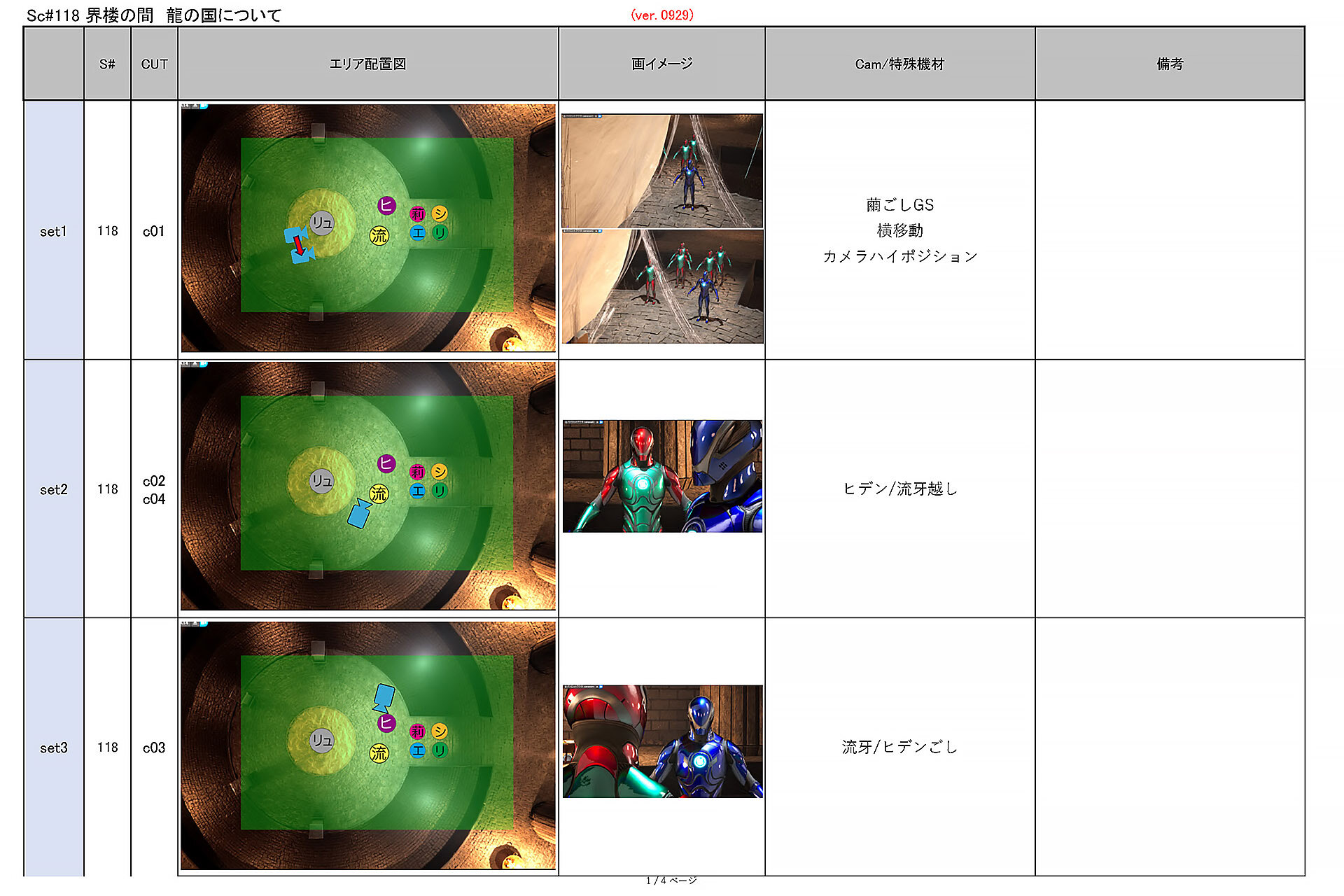

本作のVPシステムは、バーチャル・ライン・スタジオ(以下、VLS)が提供するZero Density「Reality」を中核に構築されている。RealityはUnreal Engine(以下、UE)を基盤とするリアルタイム合成システムであり、高精度のキーイングと生放送などリアルタイムの運用などに定評がある。カメラトラッキングには、stYpe「RedSpy」を使い、撮影はメインのAカメラにRED「 V-RAPTOR 8K VV」、機動性を重視するBカメラにはRED「KOMODO -X」が用いられた。

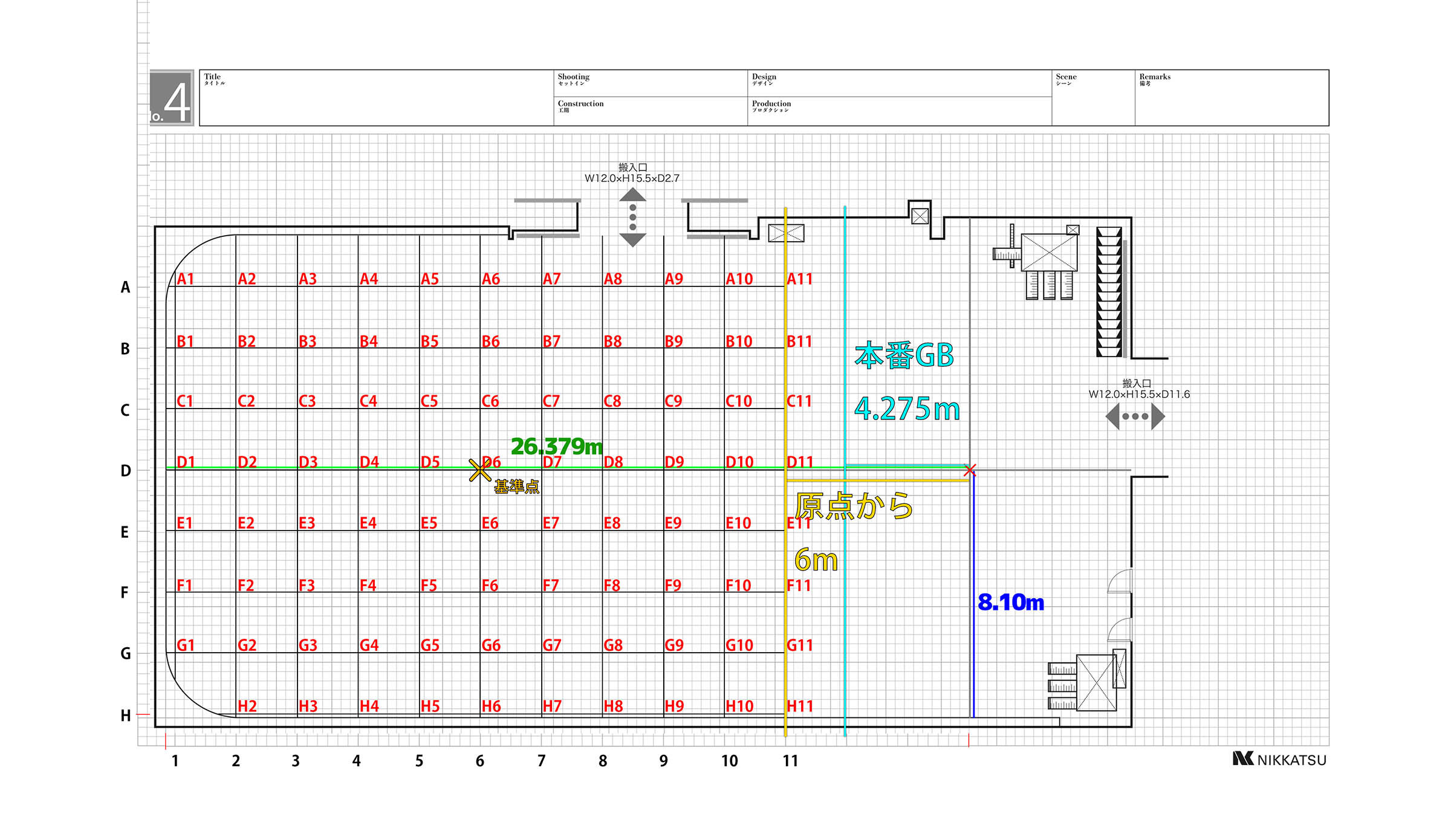

撮影は約3ヶ月にわたって行われ、最初の2ヶ月は東京都調布市の「日活調布撮影所」で、残りの1ヶ月は群馬県太田市の「CSS」で行われた。最初に課題となったのが、撮影スタジオとUEシーンの3D座標を正確に合わせることだった。

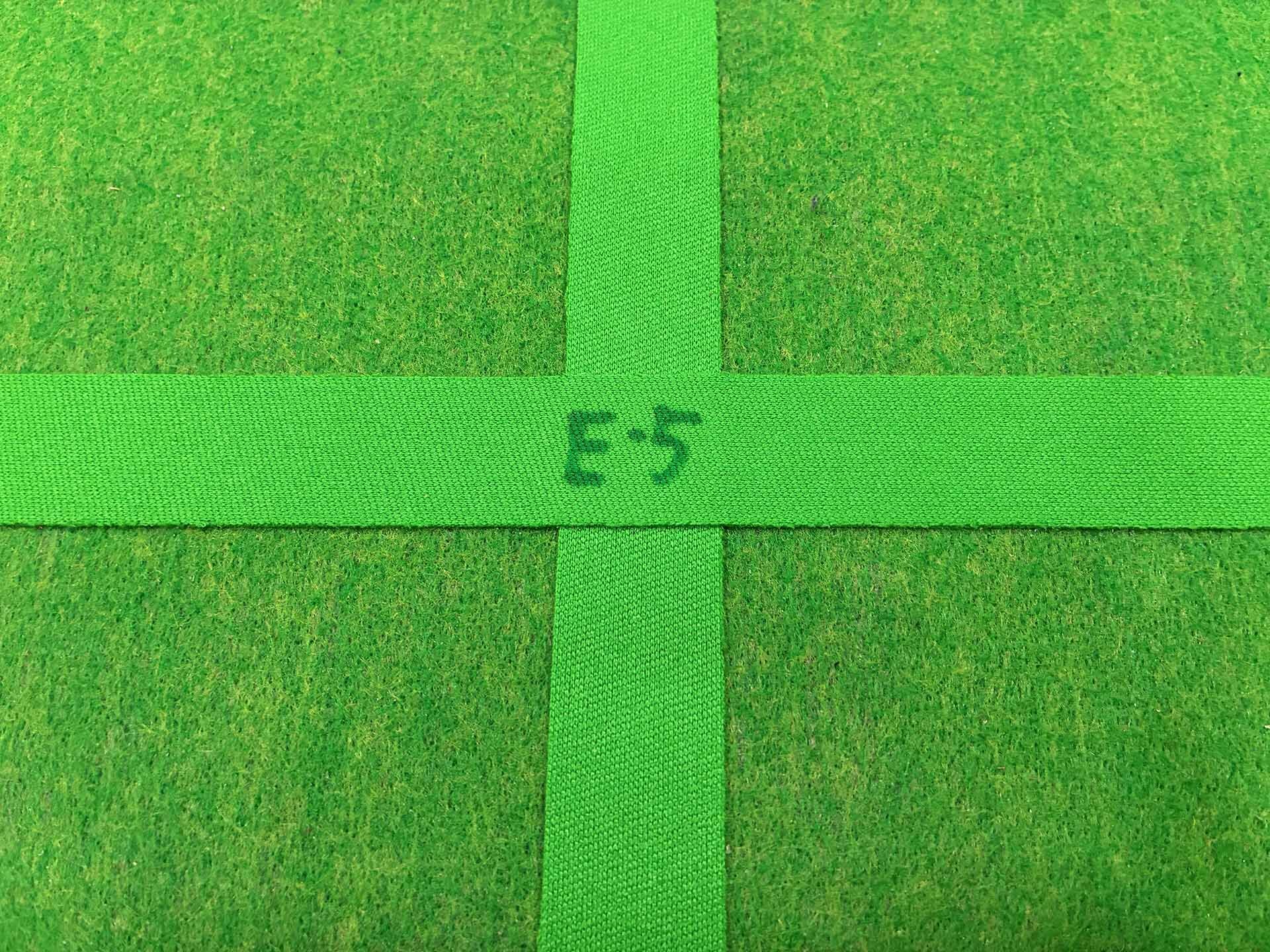

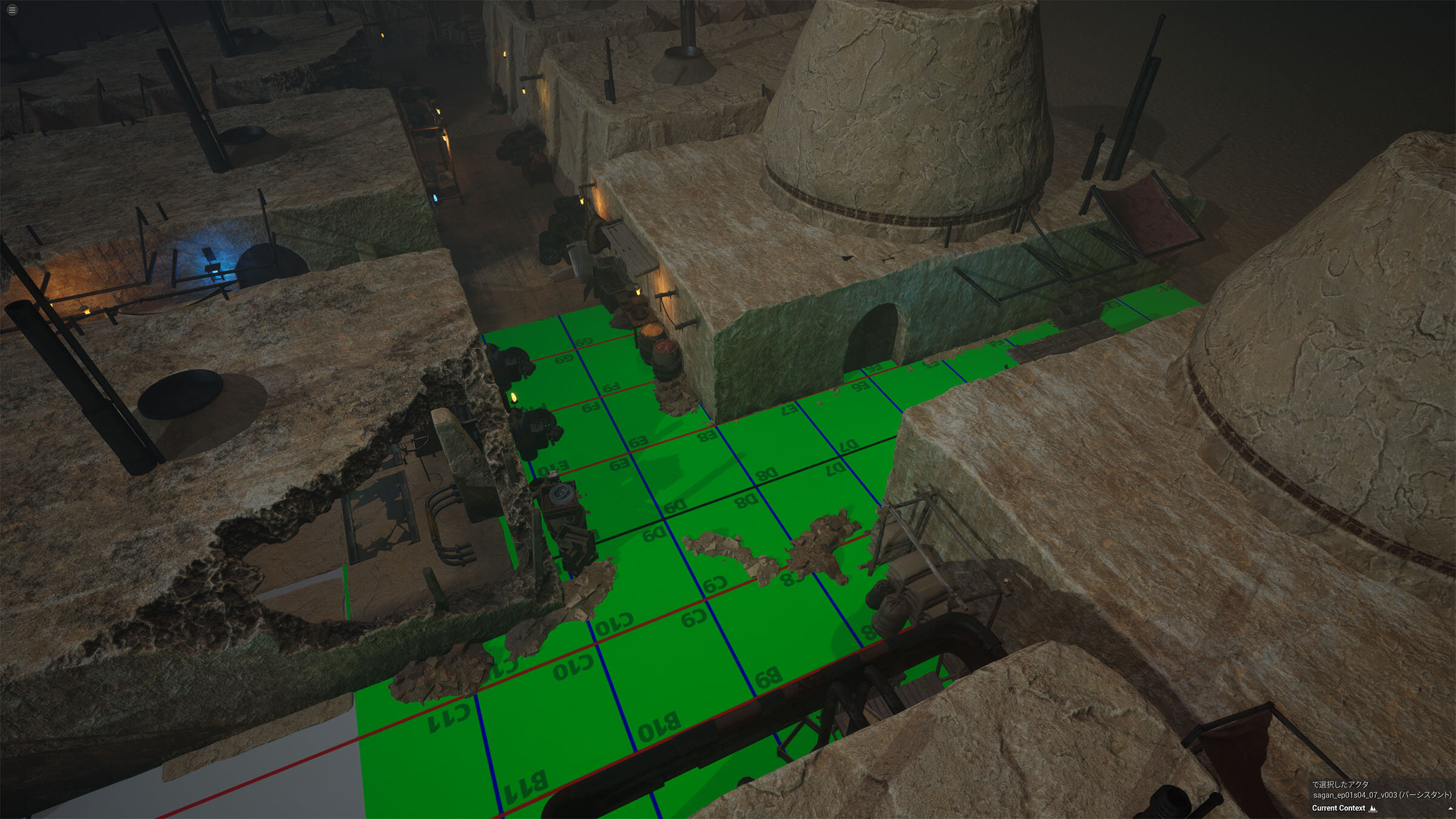

「バーチャル背景と実写カメラ、そして演者の相関を正しく把握する必要がありました。そこで『グリッドシステム』を考案しました」(鹿角氏)。

これはスタジオ床面に配置されたグリッドを基準に、UE側の座標系を正確にキャリブレーションするというもの。これにより、カメラの位置と向きがリアルタイムに3D空間へ反映され、背景映像とのほぼ完全な同期が実現できたという。

GB方式のため、現場での簡易合成や収録データの取り扱いのしやすさにも配慮。収録システムには、AJA「Ki Pro Ultra 12G」を採用。HD解像度であれば最大4チャンネル同時収録が可能な特性を活かして、現場でのリアルタイム合成映像、グリーンバックのみ(フォアグラウンド)、背景のみ(バックグラウンド)という3つのソースが同時収録された(※オリジナル5Kの撮影データは別途保管)。

「テストの時はマスク素材も収録していたが、処理落ちの問題と、ライティングが偏ったシーンでのリアルタイムキーイング調整に時間がかかることがわかったため、本番ではマスク出力を省きました。これにより、撮影を効率良く行えるようになりました」(鹿角氏)。なお撮影後のキーイングについては、StBを中心とするVFXとは別に専門チームが編成された。

アクションシーンでは、60コマや120コマのハイスピード撮影も不可欠だが、背景の品質とPCの能力的にハイスピード収録は難しいため、現場では24Pで収録&リアルタイム合成をしつつ、カメラ本体ではハイスピード収録を行い、撮影後に技術チームがハイスピード素材を書き出し、編集段階で24P素材をストレッチした箇所にハイスピード素材を差し替えるという運用が採られた(※オフライン用の素材はDITチームが収録)。

グリッドシステムを用いたVP撮影

演出要件への対応

<2>制作支援ツール&能動的なワークフロー

直感的な独自ツールが部署間の連携を加速

VPの成否の鍵を握るのは、全スタッフが部署間の垣根を越えて連携することである。本作では、監督陣と撮影現場スタッフ、VFXチームなどが有機的に連携するために新たなツール群とワークフローを導入。特に活躍したのが、StBがシーズクラフトの協力を得て開発したバーチャルロケハンシステムとバーチャルカメラである。

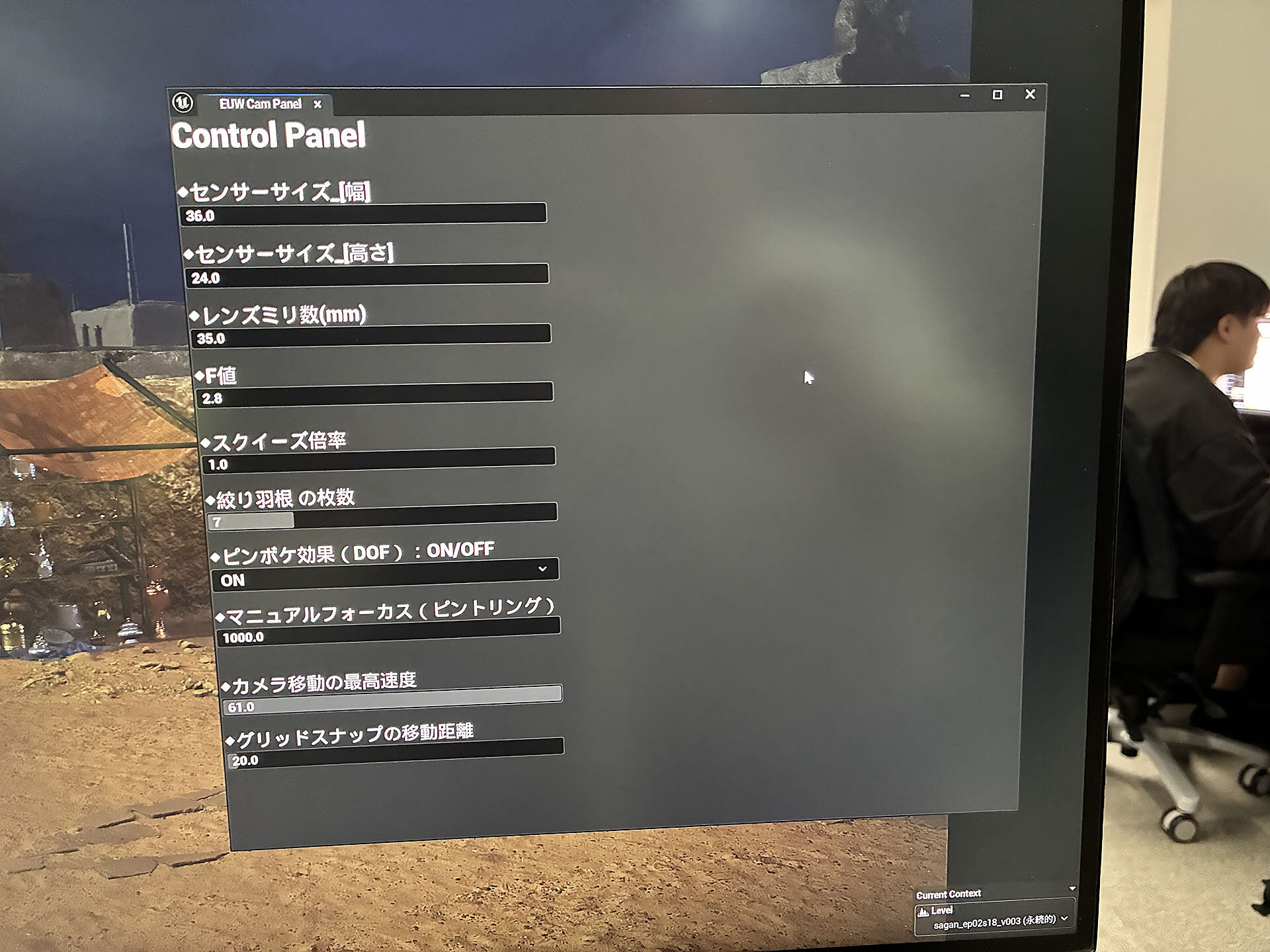

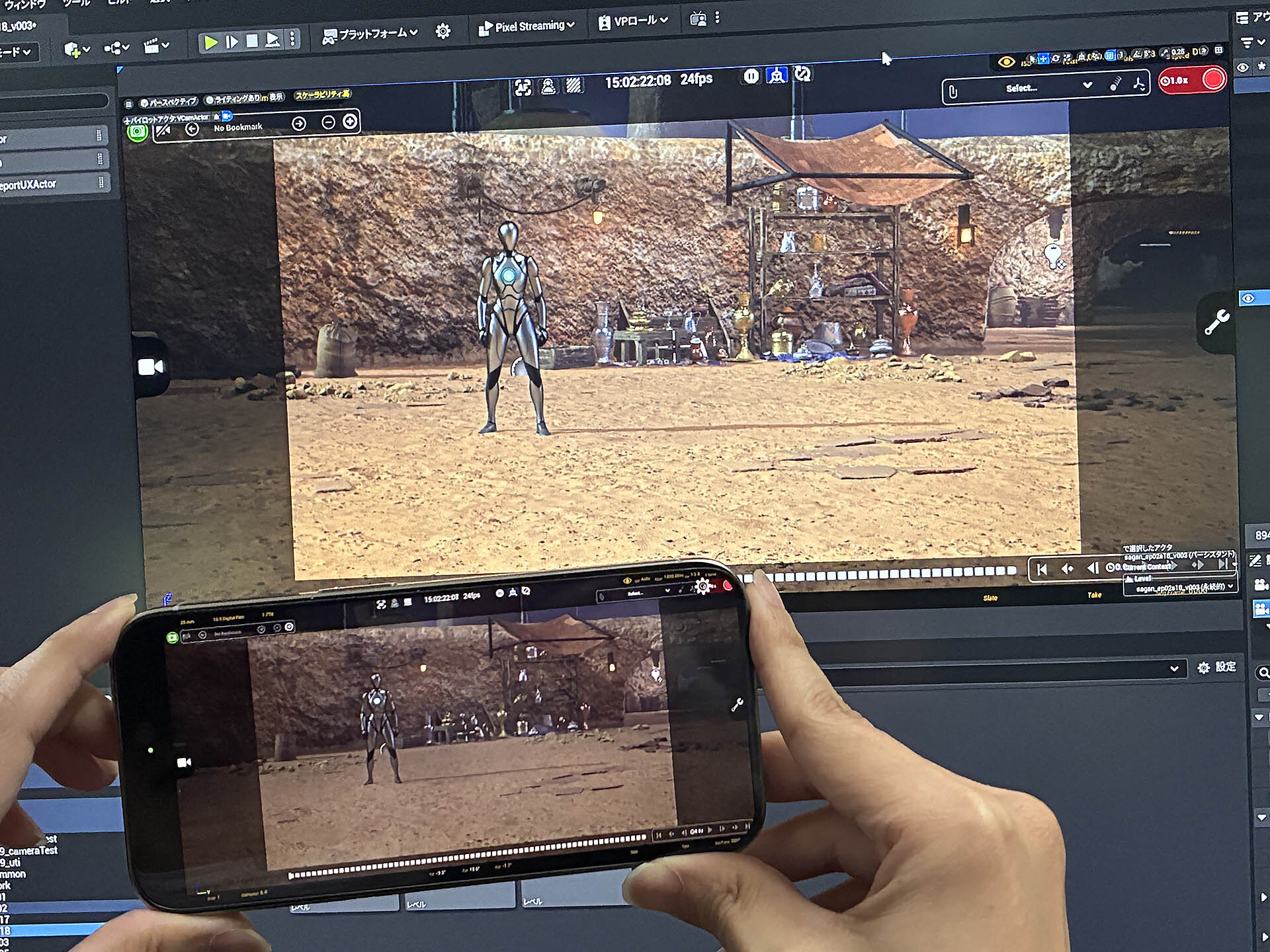

「バーチャルロケハンシステムでは、ゲームパッドでUEシーンを操作できるようにすることで監督をはじめ、UEの操作に不慣れな人でも直感的にアングルハントが行えるようにしました」(鹿角氏)。

「このシステムを導入したことで打ち合わせの際、会議室にノートPCを持ち込んでテレビにUEシーンを映しながら、その場でレイアウトを調整するといったことも積極的に行いました。従来のワークフローでは、いったん持ち帰って修正したシーンをQTなどで再チェックしてもらっていたので工数が増えがちでしたが、簡単な修正であれば打ち合わせ中に行えるようになったことで制作効率を上げることができました。UEのリアルタイム処理の恩恵ですね」と、水石 徹CGディレクター。

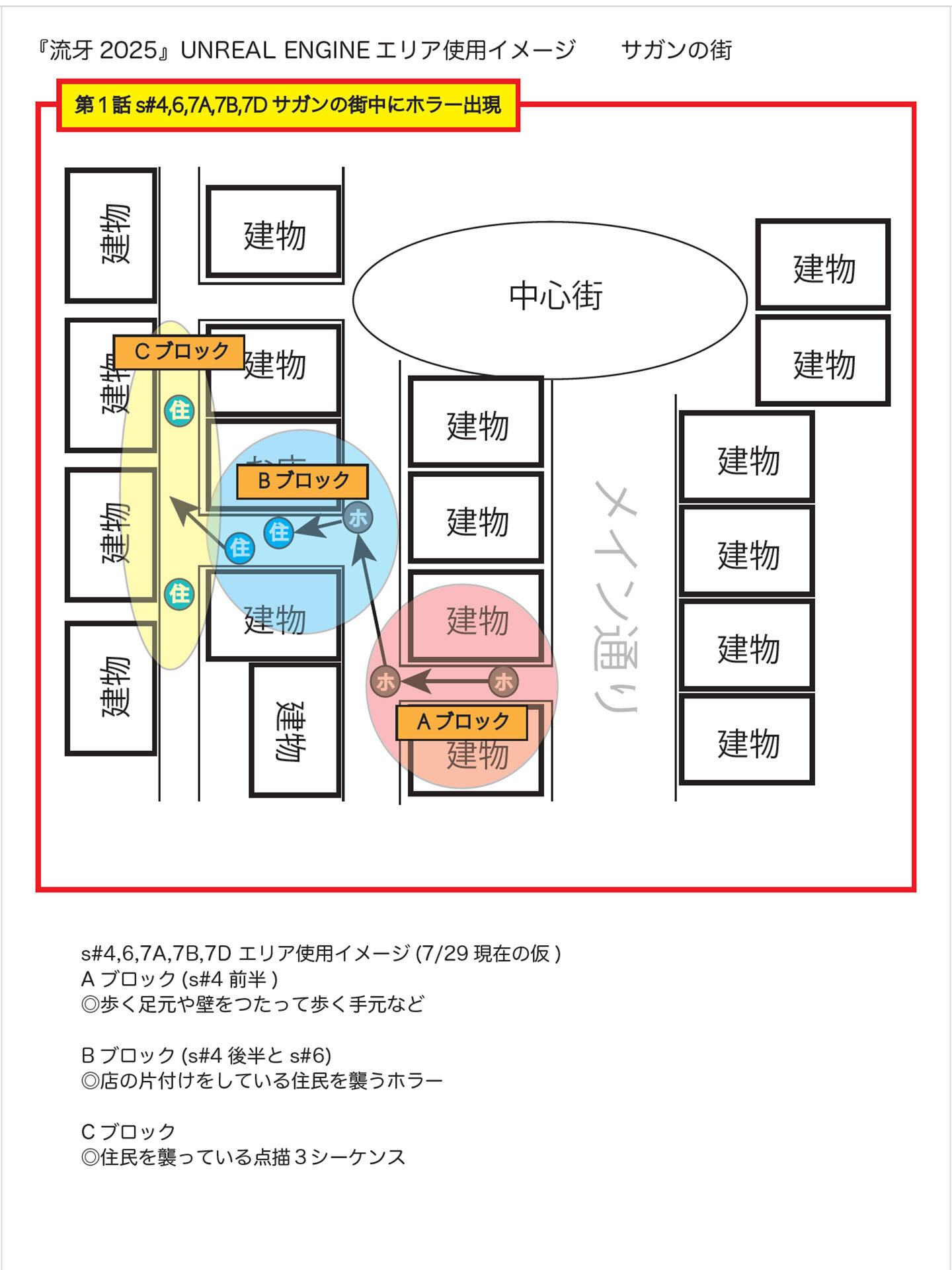

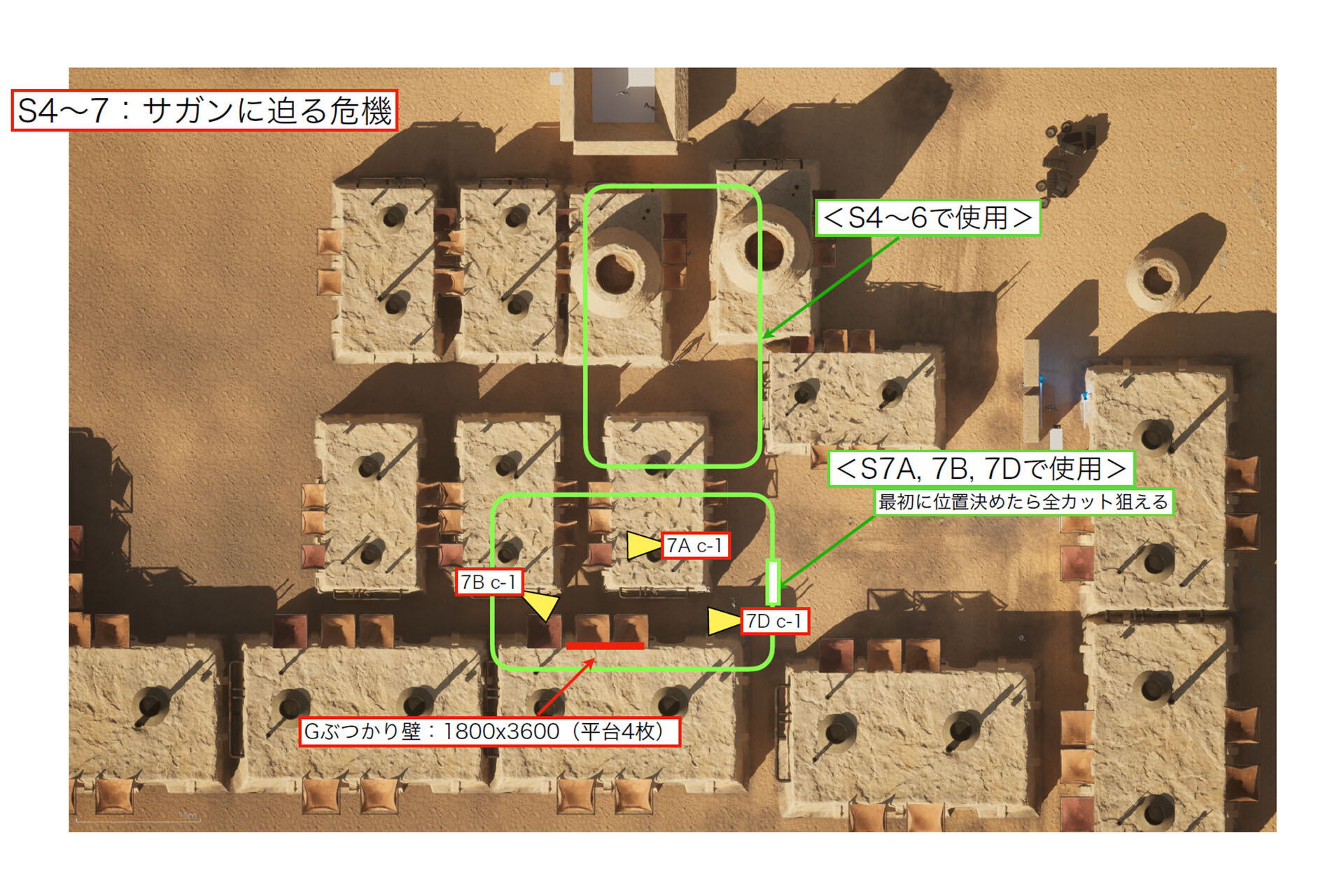

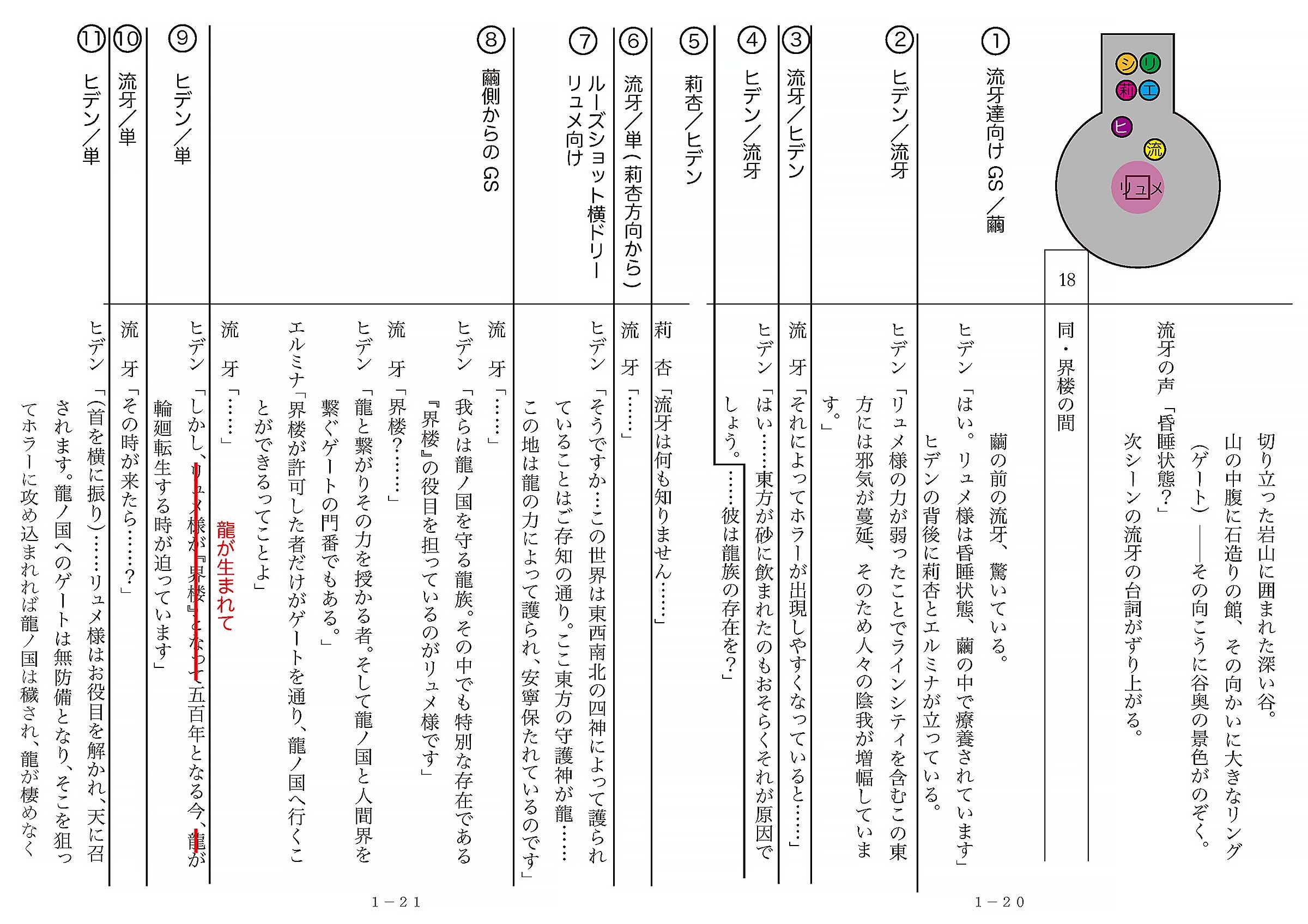

さらにこれらのツールを活用することで、監督陣が割本(※シナリオに具体的なカット割りを加筆したもの)に加えて、各シーンの撮影時のカメラとキャストの配置とアングルイメージなどをまとめた資料を自作して撮影に臨むようになり、全スタッフが具体的なイメージを共有しながら撮影を進めることができるようになったという。

「そしてアクション部が自分たちのVコンテに、バーチャルロケハンシステムを使って作成した簡易的なテックビズのようなものを合成したムービーを用意してくれるようにもなりました。これらの資料のおかげでカメラワークと演技が複雑に絡むアクションシーンでも必要な情報を正確に把握できるようになるなど、効率性とクリエイティブをさらに高めることができました」(鹿角氏)。

撮影現場では、笹倉秀信VFXスーパーバイザー補が鹿角氏と共に常駐し、技術的なトラブルシューティングや、急な演出変更への対応を担った。

「最初に行なった撮影テストでは、様々な問題が発生して本当にVPで撮りきることができるのか不安もありましたが、撮影を重ねていくと確実に撮影ペースが上がり、スタッフ間のコミュニケーションが円滑になっていきました。特に第1話のラストに登場する道外流牙(栗山 航)が岩山からサガンの街を見下ろすカット(※本記事冒頭のカット)は、撮影時の照明とUEシーンのライティングが絶妙にマッチしていてVP本来の強みを引き出せたと思います」(笹倉氏)。

独自開発のバーチャルロケハンシステム&バーチャルカメラ

-

▲ StBが開発したバーチャルロケハンシステム(実装はシーズクラフトが担当)。ゲームパッドで直感的に操作できる -

▲ カメラ設定のUI。センサーサイズ、レンズミリ数、F値など本番撮影に使われたREDなどのリアルカメラのスペックを設定できる

撮影&芝居の段取りをビジュアルで共有

KiProによる、データ受け渡しの効率化

-

▲ Ki Proプレビュー。右上から反時計回りで、フォアグラウンド、リアルタイム合成、バックグラウンド -

▲ Ki Proから3ソースがProRes 422 HQで出力することで現場でのチェックや編集など後工程へのデータ受け渡しが効率化された

ブレイクダウン|episode 1ラストカット

-

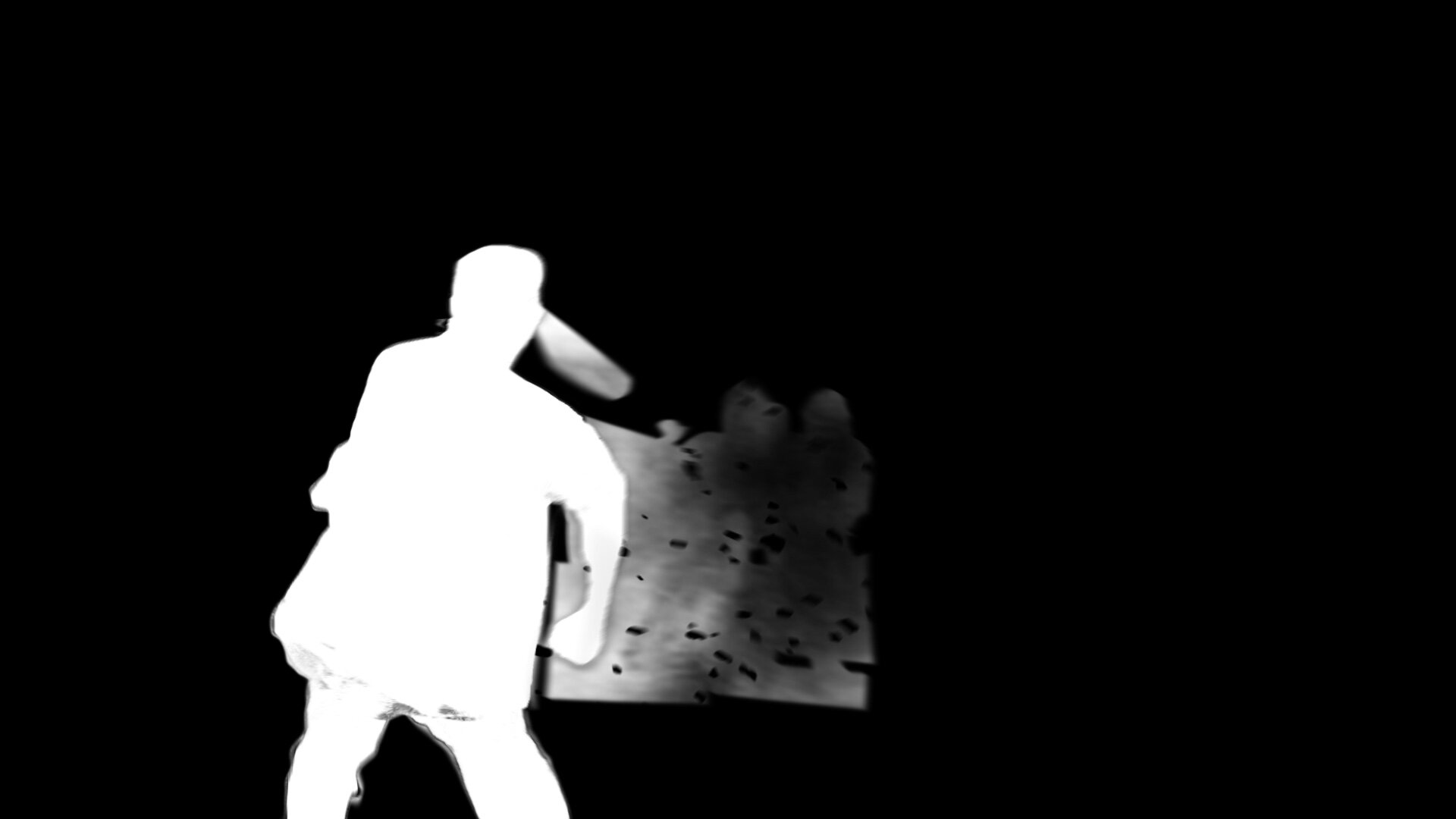

▲ キーイング専門チームが作成したマスク素材 -

▲ コンポジットとしての完成形。撮影後に「もっと広い画にしたい」という監督リクエストを受けて、トラッキングデータをそのまま利用してUEカメラをオーバースキャンで再レンダリングすることでスケール感が高められた

<3>Unreal Engineのリアルタイム性を活かす〜VFXワーク〜

リアルタイムCGとAIの活用が、次世代のVFXを切り拓く

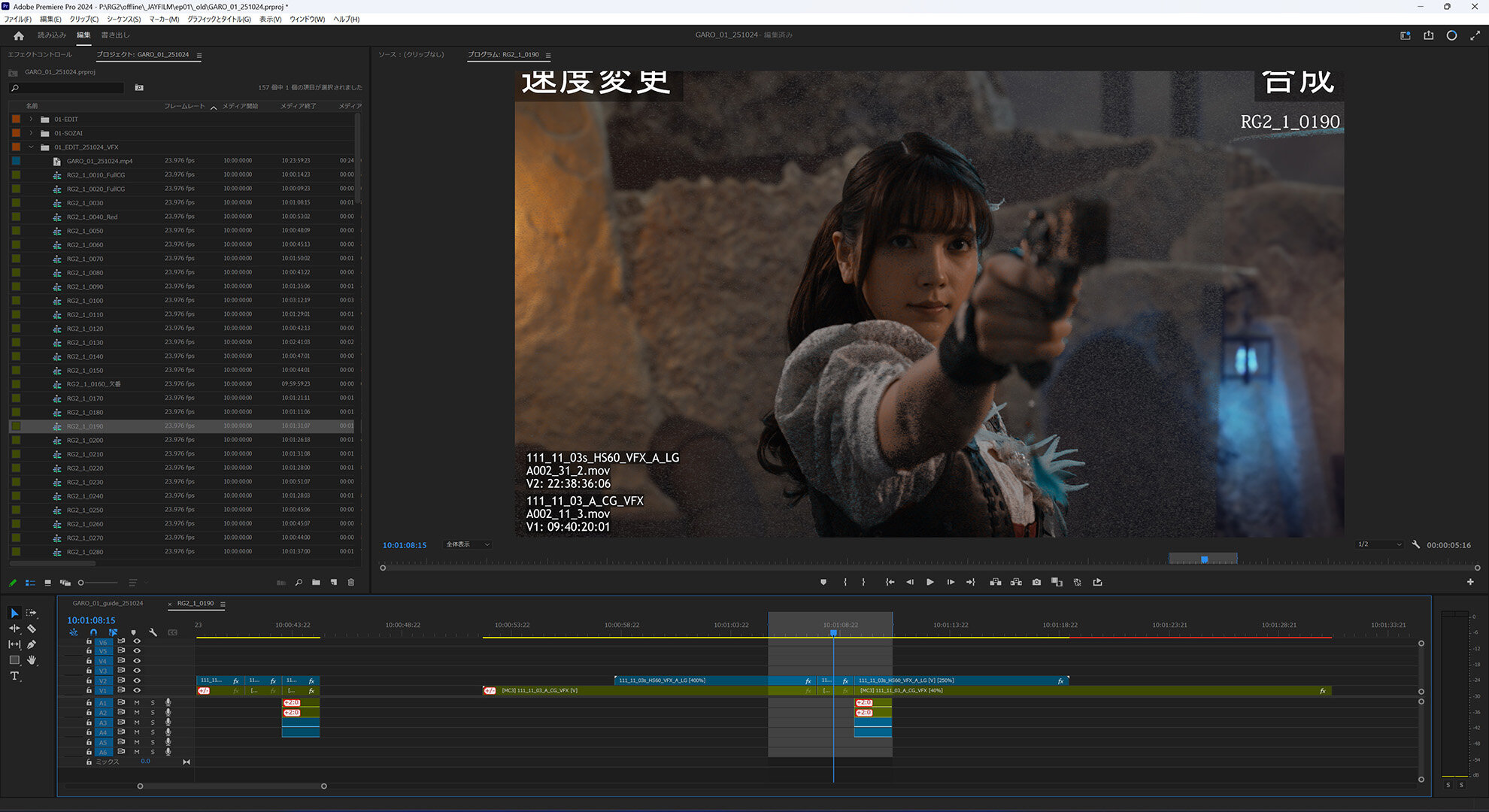

ポストプロダクション工程でも費用対効果の高いワークフローが採られた。

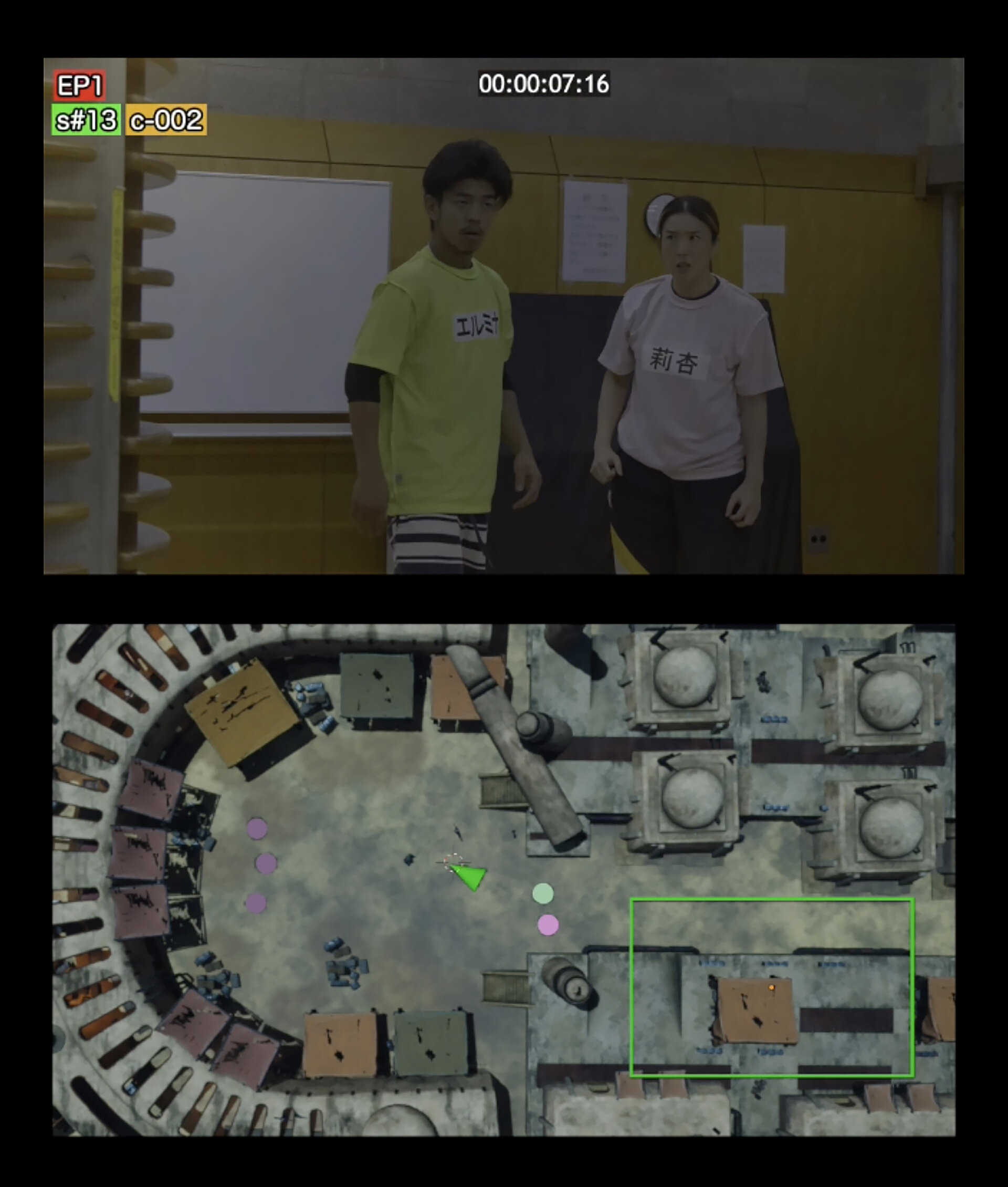

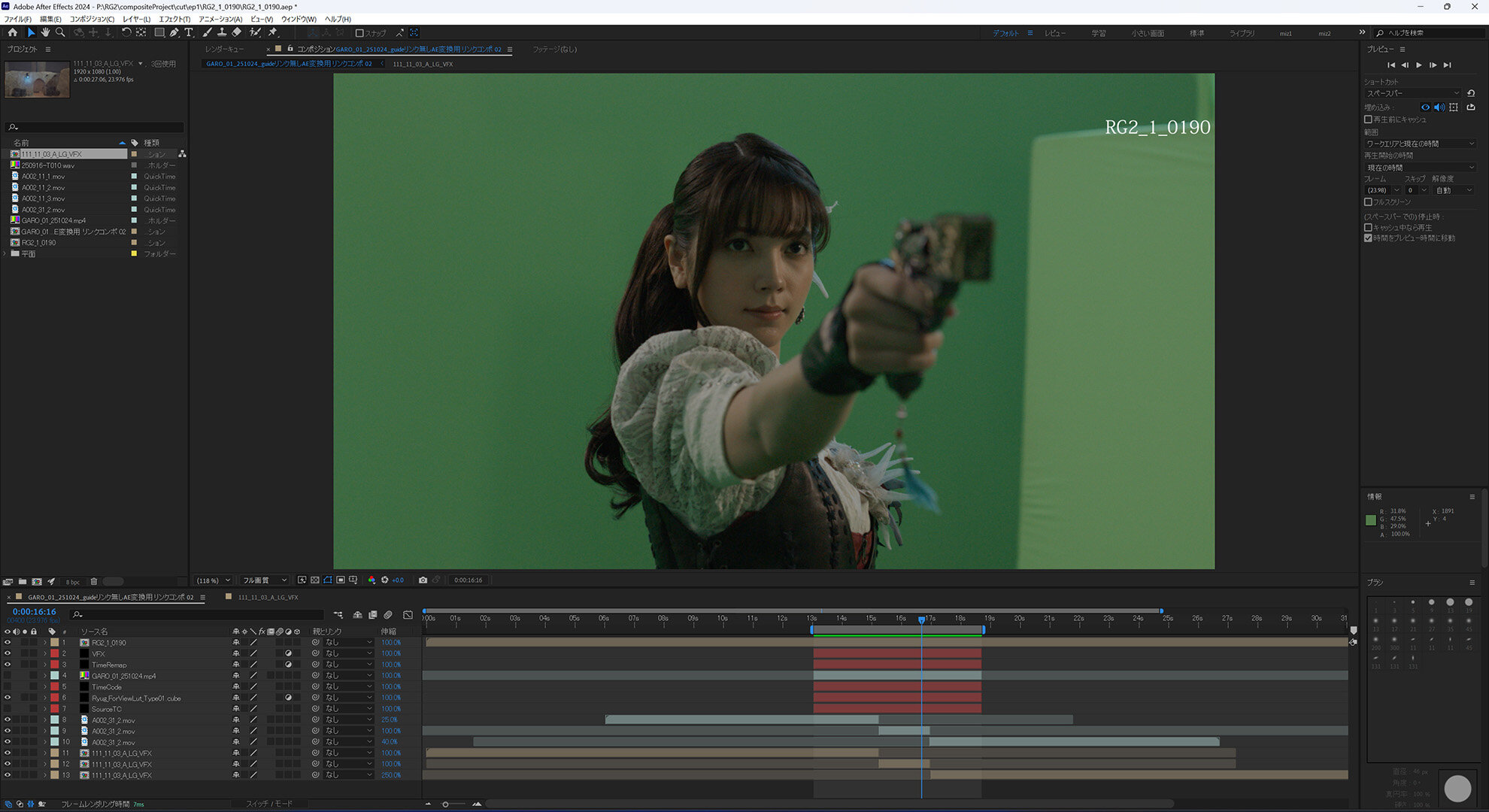

「編集を担当されているジェイ・フィルムさんがPremiere Proのマルチトラック編集機能を使って、Ki Proで収録したリアルタイム合成、フォアグラウンド(GB素材)、バッググラウンド(CG素材)を一元管理されていたので、こちらではDynamic Linkを使ってPremiereのシークエンス情報をAfter Effectsに持ち込むことで読み込み/書き出しの手間を減らしつつ、編集作業とVFX作業をシームレスに連携させることができました」(鹿角氏)。

VPの利点を活かす上では、UEによる画づくりも積極的に行われた。

「バーチャル背景となるUEシーンの作成にはUNITさんにご協力いただきました。当初は市販アセットをできるだけ活かすことで効率的につくろうとしていたのですが、監督たちの本作独自ルックへの強いこだわりから多岐にわたって作り替えを行うことになりました(苦笑)。ですが、そうしたなかでもMegascansのフォトリアルなアセットや、LumenなどUEの様々な機能を活用することにより、限られたリソースの中で最大限クオリティを上げることができたと思います」(中屋健司デジタルアーティスト)。

例えばサガンの街は、かろうじて砂漠化を逃れたという設定のため、建物と地面の砂が一体化しているような見た目が求められたが、UEのRVT(Runtime Virtual Texture)を利用することで建物と地面各々のテクスチャを自然な見た目にブレンドさせることができたそうだ。

「サガンの街は灼熱の太陽が降り注ぐ昼閒から夜の闇まで、ライティング的にも大きなコントラストがありました。そこでLumenを利用することで同じシーンでも様々なルックで描くことができました」(水石氏)。

近年の『牙狼〈GARO〉』プロジェクトではAIテクノロジーを積極的に活用している。

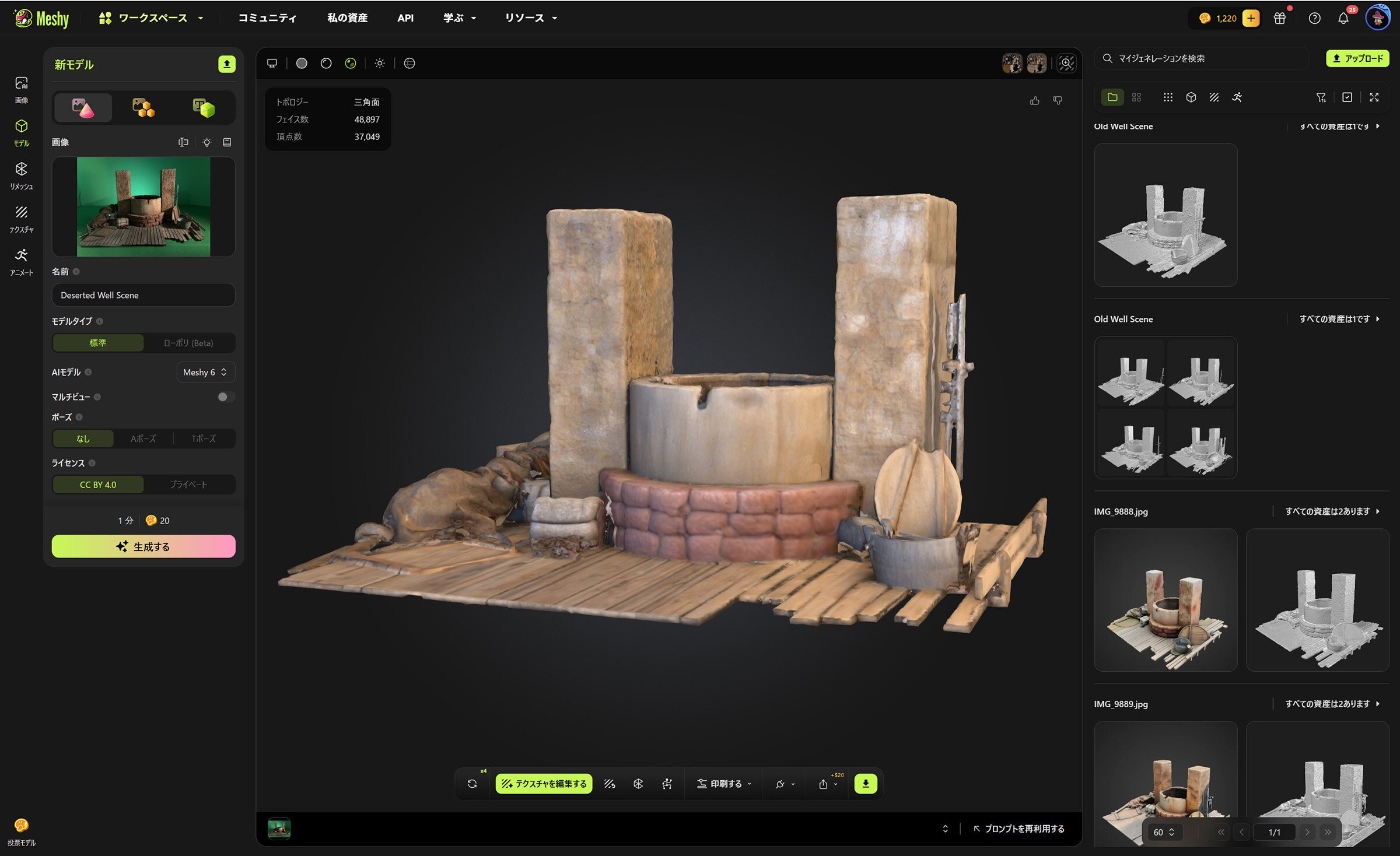

「今回もデジタルモブや撮影用の美術の3Dモデル化にMeshyを利用することで効率良く画づくりを行なっています。そのほかにもスローモーションのカットではフレーム補間に、特別なアクションカットの背景の超解像処理などにTopazを利用しています。イチからAIでカットをつくるのはまだ難しいと思いますが、正攻法ではコストがかかりすぎるVFXなどにAIを利用することで今までの特撮アクションでは難しかった表現にも積極的にチャレンジできるようになるはずです」(鹿角氏)。

Unreal Engineシーン〜サガンの街〜

▲ UEシーン「サガンの街」ブラッシュアップ例。図は、市販アセットをベースにした初期デザイン

▲ 完成シーン。演出要件に応じたプロップの追加やディテールアップが随所に施されている

▲ 撮影部と照明部からのリクエストを受けて、UEシーン内に配置されたランプの光源にステンドグラス状のテクスチャを組み合わせることで、リッチな照明効果を実現させた。(左図)市販素材を加工したテクスチャ素材/(右図)完成したランプ照明。本編でもぜひ注目してほしい

▲ RVTの使用例。砂漠化が進んだ建物の印象が高められた。(左図)適用前/(右図)適用後

▲ 街が火災に襲われるシーンでは、Flipbookテクスチャを利用することで迫力ある火災描写を生み出した。「VPに必要なfpsを確保する必要があるので、常にシーンへの負荷を考慮しながら画づくりを行なっています。この火災シーンでは、炎アニメーションの連番素材をFlipbookテクスチャに割り当てたものを多数配置していますが、UEではfpsをしっかりキープしてくれたのでそのリアルタイム性能に改めて感心しました」(中屋氏)

Adobe CCのDynamic Linkによるシームレスな同期

Meshy AIの活用

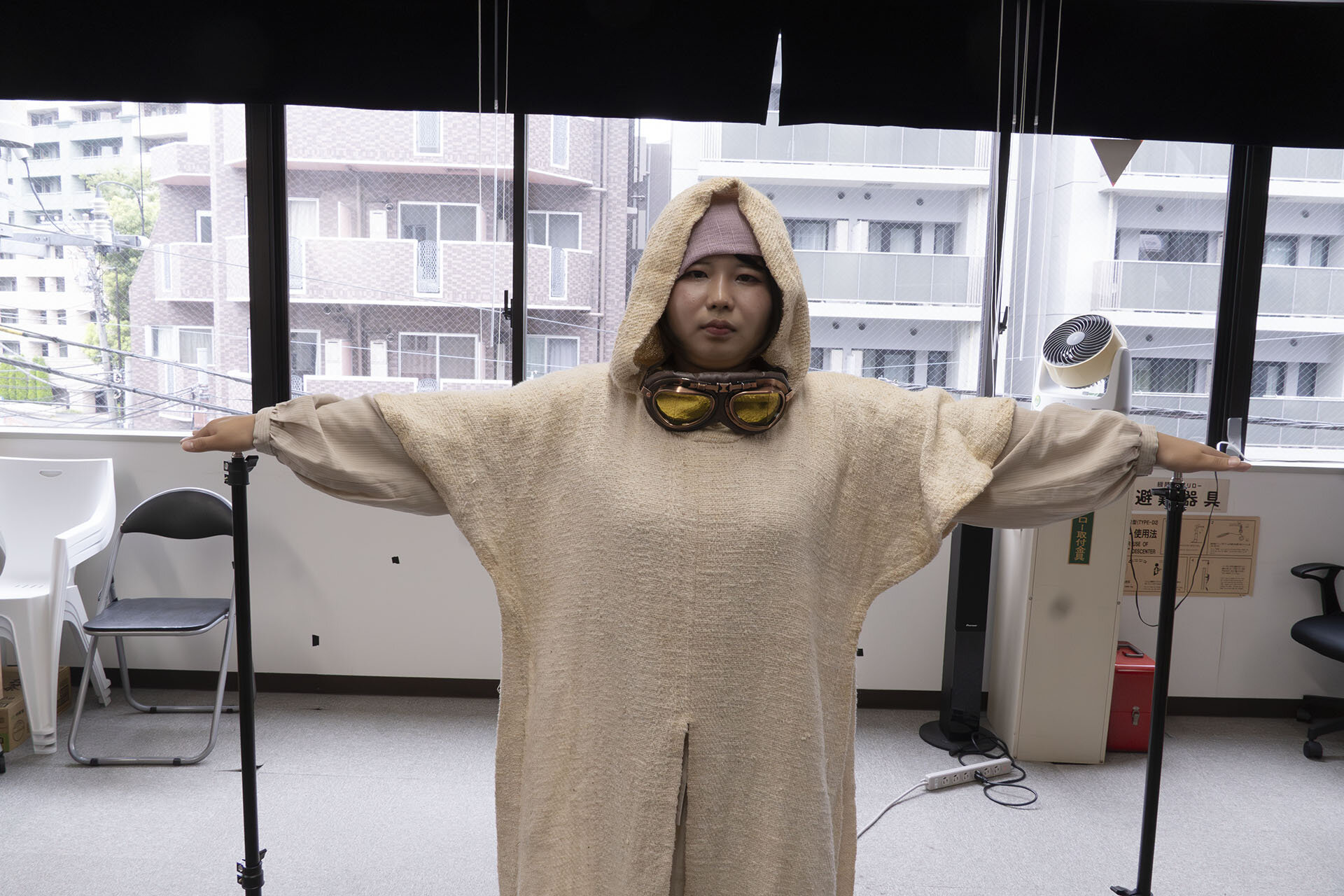

▲ デジタルモブ用のフォトグラメトリー例

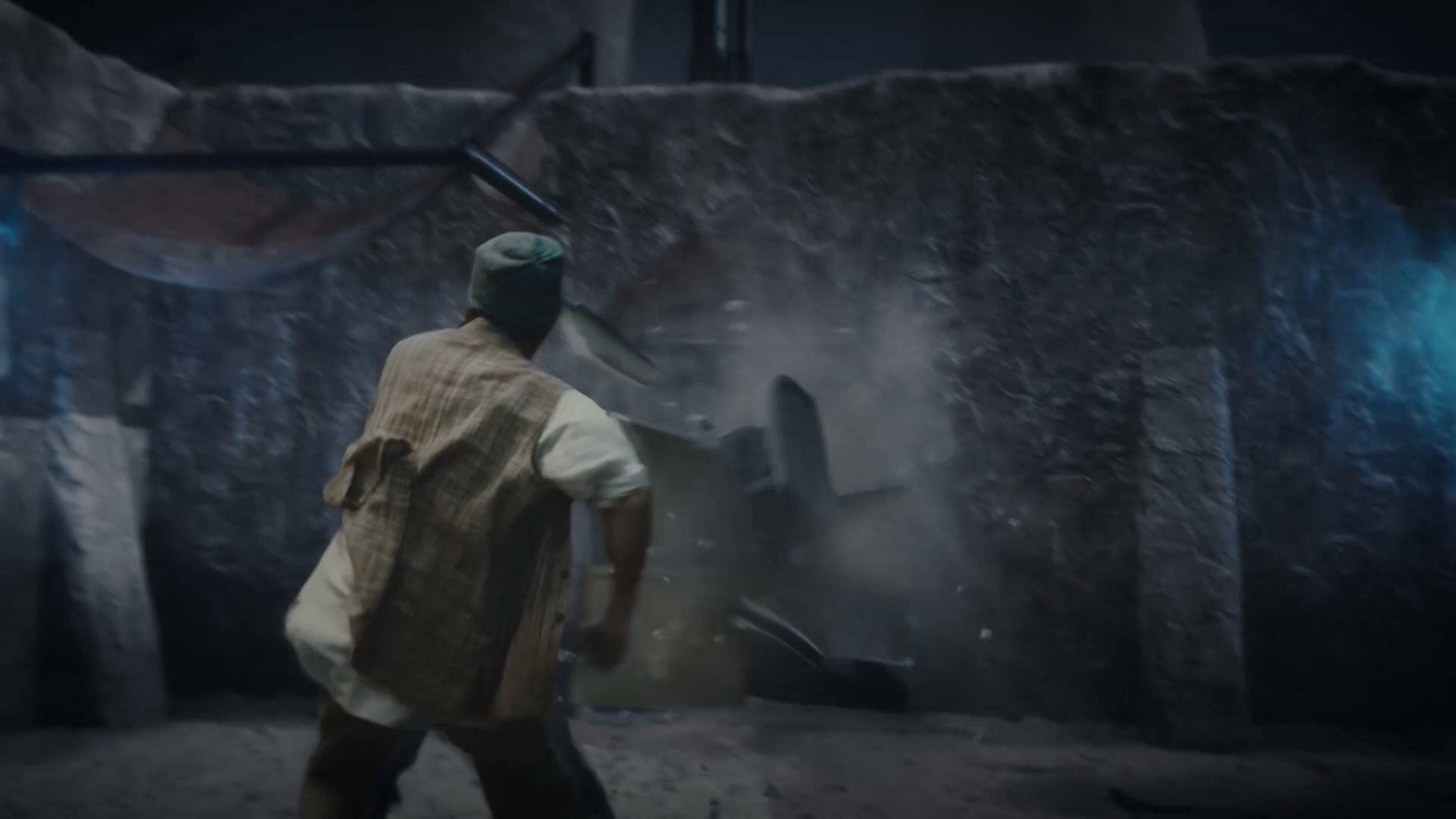

ブレイクダウン|ホラーの襲撃

-

▲ まりむが担当したショットのブレイクダウン。扉が破壊された奧からホラーが倒れ込むという演出のため、実写とCGの複雑な合成が求められた。図は、フォアグラウンド(実写プレート) -

▲ バックグラウンド(UEから出力したCG背景)

INTERVIEW & EDIT_NUMAKURA Arihito