3DCGによる作品制作において、複数キャラクターのアニメーションは非常に労力のかかる工程だ。Blenderでショートアニメーション作品を個人制作するtaka v3氏は、まさにこの課題に直面するクリエイターのひとり。氏は最新作『The Stone Upstream』において、新しい表現の模索と作業効率化に同時に向き合うため、手軽に扱えるモバイルモーションキャプチャー「mocopi®」をソニーマーケティング株式会社から貸し出してもらい、試験的に導入した。

本稿は、個人制作におけるモーションキャプチャー導入のメリットや手付けアニメーションとの使い分け、そして実作業を通じて見えたmocopiの真価に迫る。taka v3氏が切り拓いたアニメーションワークフローのノウハウを堪能してほしい。

taka v3氏

アニメーター。武蔵野美術大学映像学科出身。大学卒業後、海外のVFXスタジオに就職し、約8年間にわたりアニメーターとして映画やドラマなどに参加。スタジオ業務の傍ら、Blenderを用いた個人制作も行なっている。

x.com/TakaV113119

carefreehm.wixsite.com/takanabu

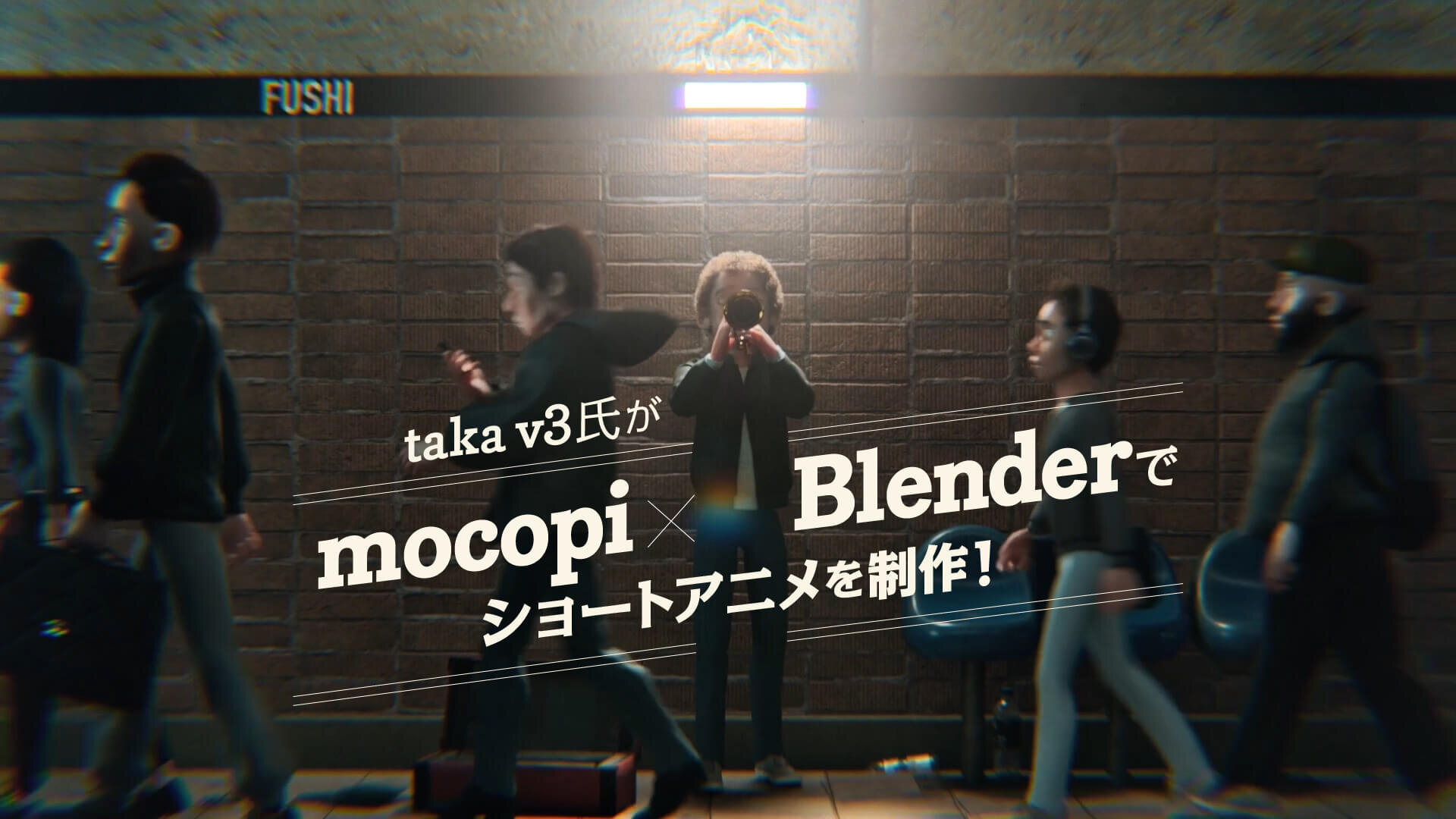

taka v3氏がmocopiとBlenderで制作したショートアニメーション

日常のワンシーンを切り取るモブアニメーションへの挑戦

カナダのVFXスタジオに所属するtaka v3氏。業務では徹底的にリアルな動物などの動きを追求する一方で、個人制作ではBlenderを使用し、丸みを帯びた可愛らしいキャラクターの映像作品を制作している。

そんなtaka v3氏が「BlenderFes 2026 SS」のセッションに向けて制作したのが、約15秒のショートアニメーション『The Stone Upstream』。画面中央でトランペットを吹くストリートミュージシャンと、その背後を行き交う大勢の通行人たち。駅のホームのような空間で、音楽に耳を傾ける者もいれば、足早に通り過ぎていく者もいる。この作品は、taka v3氏の体験から生まれたものだ。

「昨年、旅行で行ったニューヨークで、素晴らしいアーティストたちが街中いたるところで活動しているのを目にして。素人目にも非常にレベルが高いのに、プロになれないのかというプレイヤーがたくさんいました。しかし、自分も含めて、多くの人は数秒耳を傾けただけで、またながれるように歩き始めていました。そんな行き交う人々の中に、彼らの人生を動かすような出会いがあるのではないか。そんな希望を込めて制作したのがこの作品です」(taka v3氏)。

このコンセプトを実現する上で最大の障壁となったのが、モブ(群衆)キャラクターのアニメーション。作品にはメインのトランペット奏者に加え、背景を歩くモブキャラクターが7〜8名ほど登場する。プロのアニメーターであるtaka v3氏は、これら全てを手付けでアニメーションさせるとかなり非現実的な工数になることが予想できた。

「キャラクターが多すぎるなと頭を抱えていたところでした。そこで、モーションキャプチャーもアリだなと考えるようになったんです」(taka v3氏)。

なぜmocopiなのか? 慣性センサー式の圧倒的なメリット

モーションキャプチャー技術には現在、大きく分けて3つの方式が存在する。体にマーカーを取り付け、複数の専用カメラで追跡する高精度かつ高額な「光学式」。カメラ映像からAIが動きを抽出する手軽な「AIカメラ式」。そして、体に装着したセンサーの傾きや加速度から動きを読み取る「慣性センサー式」だ。

今回taka v3氏が選んだのは、ソニーのモバイルモーションキャプチャー、mocopi。500円玉ほどの小型軽量なセンサーを体に装着し、スマホアプリと連携してモーションを取得する、慣性センサー式のデバイスだ。mocopiにはいくつか構成例があるが、taka v3氏は、mocopiを2セット、計12点のセンサーを用いる「mocopiプロフェッショナルモード」を選択。より細かな動きを取得できるmocopiのハイエンド構成だが、使用してみてその精度の高さに驚かされたという。

「モーションキャプチャー体験自体が初めてだったのですが、思った以上にしっかりと動きを読み込んでくれました。12個のセンサーひとつひとつが繊細に位置を読み取ってくれて、想定よりもずっと正確なデータが取れました」(taka v3氏)。

モブアニメーション制作にmocopiの方式がマッチしていたのには明確な理由がある。それは、カメラの画角を気にせずに、広範囲を動き回れるという点だ。AIカメラ式では、カメラからフレームアウトしてしまったり、遠くに離れすぎたりすると動きを抽出できない。しかし慣性センサー式であれば、センサーが通信できる範囲内なら自由に動き回ることができる。

「カメラに自分が映っているかどうかを気にせず、自分が動きたいように演じられたのが良かったですね。駅のホームを横切って歩くキャラクターをつくる際、僕の住んでいる部屋がちょうど横長で、端から端まで歩けばぴったりの距離でした。往復して歩き回るような広範囲の動きでも、PCのモニタを遠目で確認しながらしっかりとキャプチャーできていました。高額な機材を用意しなくても、自宅のスペースでこれだけ自由なモーションデータが取れるなら十分です」(taka v3氏)。

わずか1日の収録でモブが完成。2ヶ月間のハイブリッド制作フロー

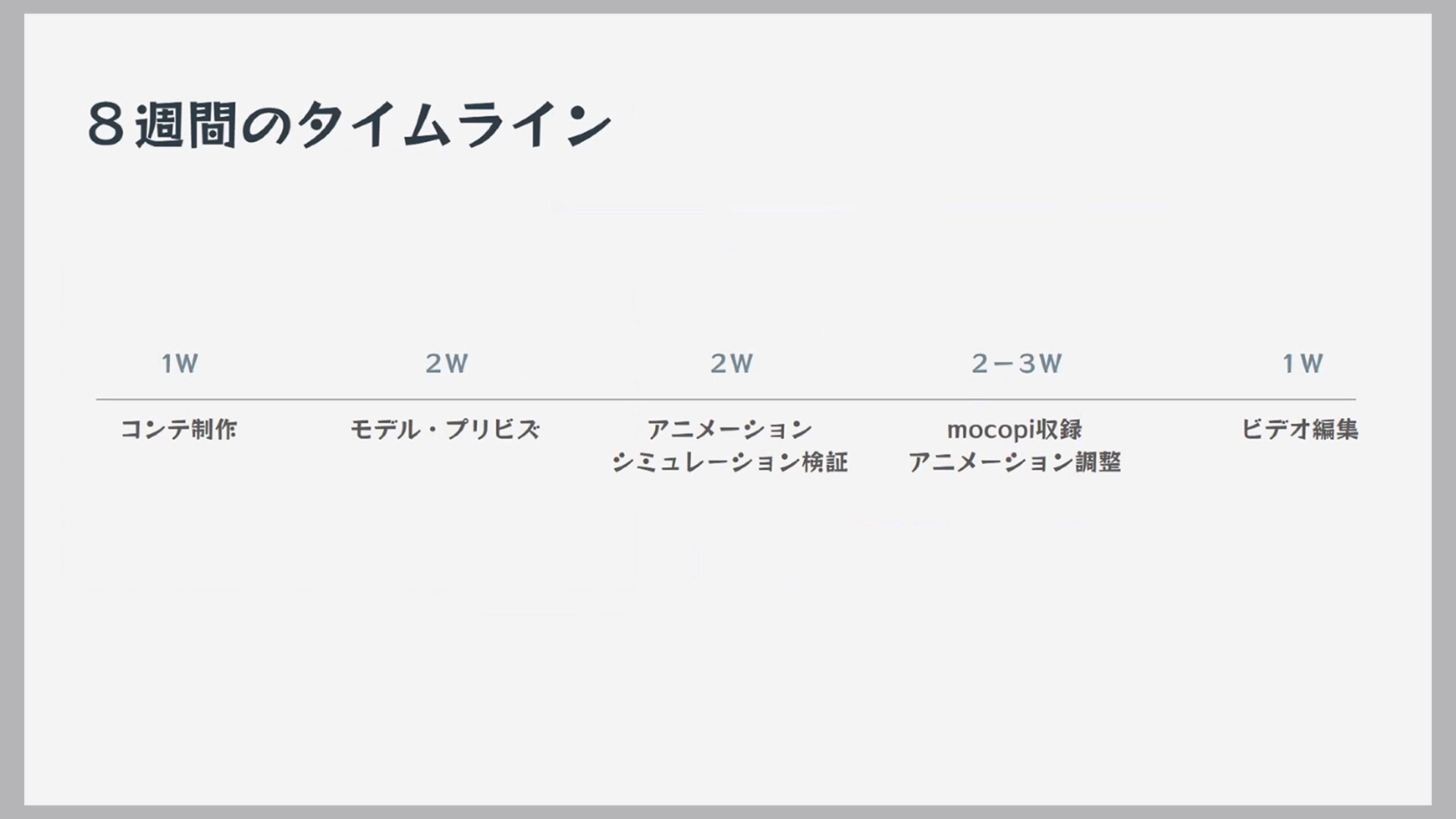

『The Stone Upstream』の制作にかかった期間は約2ヶ月。限られたスケジュールの中でクオリティを最大化するため、taka v3氏は手付けとモーションキャプチャーを組み合わせたハイブリッドな制作フローを構築した。

最初の1週間でアイデアを固めてコンテを作成し、次の期間でキャラクターのモデリングを実施。次の2週間で、アニメーションとクロスシミュレーションの検証を行った。トランペットを吹くという複雑な動作は、口、手、楽器の親子関係をどう構築するかが難しく、この検証フェーズで入念なテストが繰り返された。

そして次がmocopiによるモーション収録のフェーズ。驚くべきことに、この収録はたった1日で完了したという。

「あっけないくらい、1日で全てのパターンを撮り終えました。最初は壁に寄りかかっている人など、様々なバリエーションを試して収録していたのですが、画面構成や視聴者の目線をどこに集中させるかを考えた結果、最終的には“歩き”の動きをベースに採用しました」(taka v3氏)。

ネット上にはフリーの歩行モーションデータなども存在するが、それらは“決まった”動き。今回の作品のように「キャラクターの体型や骨格のちがい」「トランペットのケースに少し足が当たる演技」など、演出意図に合わせた微調整を施すことは難しい。自分で装着して演技ができるmocopiだからこそ、映像のニーズに合わせたニュアンスを即座につくり出すことができたのだ。

「仮にモブキャラクターをひとりずつ最初から手付けでつくるとしたら、まず基本のウォークサイクルをつくり、そこから各キャラに応じた調整を入れることになります。それを考えると、mocopiを使った今回は手付けの1.5倍近く早く作業が進んだ体感があります。歩きのモーションを自分で演じてキャラクターにながし込み、画面に配置する。その時点でタイミングやレイアウトの構成を素早く決めることができたので、制作のスピードアップにも繋がりました」(taka v3氏)。

収録後、残りの期間を使ってメインキャラクターの手付けアニメーション(トランペットを吹く動作、イヤホンを外す動作)を行い、細かなシミュレーションや動画編集を経て作品を完成させた。

■実作業で見えたmocopiの"注意点"とBlenderでのリカバリー術

mocopiの導入によって劇的な効率化を実現したtaka v3氏だったが、実際にBlenderのワークフローに組み込んでいく中では、いくつかの不具合やデバイス固有の弱点にも直面した。しかし、プロのアニメーターならではの視点で、それらをBlender側の機能でカバーしたという。

最初のつまずきは、キャラクターの初期ポーズに起因するものだった。通常、モーションキャプチャーのデータは腕を水平に広げた「Tポーズ」を基準に生成されることが多い。しかしtaka v3氏は、腕を斜めに下げた「Aポーズ」でキャラクターをモデリングしてしまっていたのだ。

「完全に僕のミスですが、Aポーズのキャラクターにモーションデータを読み込んだら、腕の角度に余分な数値が入ってしまい、本来とはちがう不自然な腕の振り方になってしまいました。ただ、モーションデータ自体は正常だったので、全てつくり直すのではなく、Blender上でボーンの動きを同期させて修正するという自分なりの方法でリカバリーしました。これからmocopiを使う方は、キャラクターをTポーズでつくっておけば問題なく機能するはずです」(taka v3氏)。

また、モーションキャプチャーの原理上、物理的な接触を伴う細かな動きには限界があることも実感したという。

「腕が思った位置でピタッと止まらないということはありました。例えば、最後にイヤホンを外すキャラクターがいるのですが、自分で耳に手を当てる演技をしても、画面上では指が顔にめり込んでしまうことがありました。腕を組む動作も、実際の体でぴったり組んでしまうと上手く計算されないことがありましたね。なので、収録時は少しすき間を空けてやんわり組むように演じるのがコツです。そうすると、取り込み時には綺麗に腕を組んでくれます」(taka v3氏)。

これらは、実際の自分の体とアバターの骨格(腕の長さや関節の位置など)が少しずつ違うために起こるもので、同じ動きを再現していても、体のサイズや構造が異なることで、手の位置にズレが生じてしまう。こうした現象はmocopi固有の不具合ではなく、モーションを別のアバターに適用する際によく起こることで、必要に応じて、アバターの調整やBlender上での補正を行うことで、より自然な動きに近づけることができる。

さらに、mocopi単体では顔の表情や指先のトラッキングができない点にも注意が必要だ。

「指や表情の動きまで全てキャプチャーしたい場合は、グローブ型のハンドトラッキングデバイスやフェイシャルトラッキングのアプリと組み合わせて使う必要があります。ただ今回の僕の作品の場合、モブは基本的に横を向いて歩いているだけで、指で何かをつかむわけでもありません。体の大きな動きはmocopiで取り、手や表情の細かいニュアンスが必要な部分は自分で手付けすれば十分だという判断で進めました」(taka v3氏)。

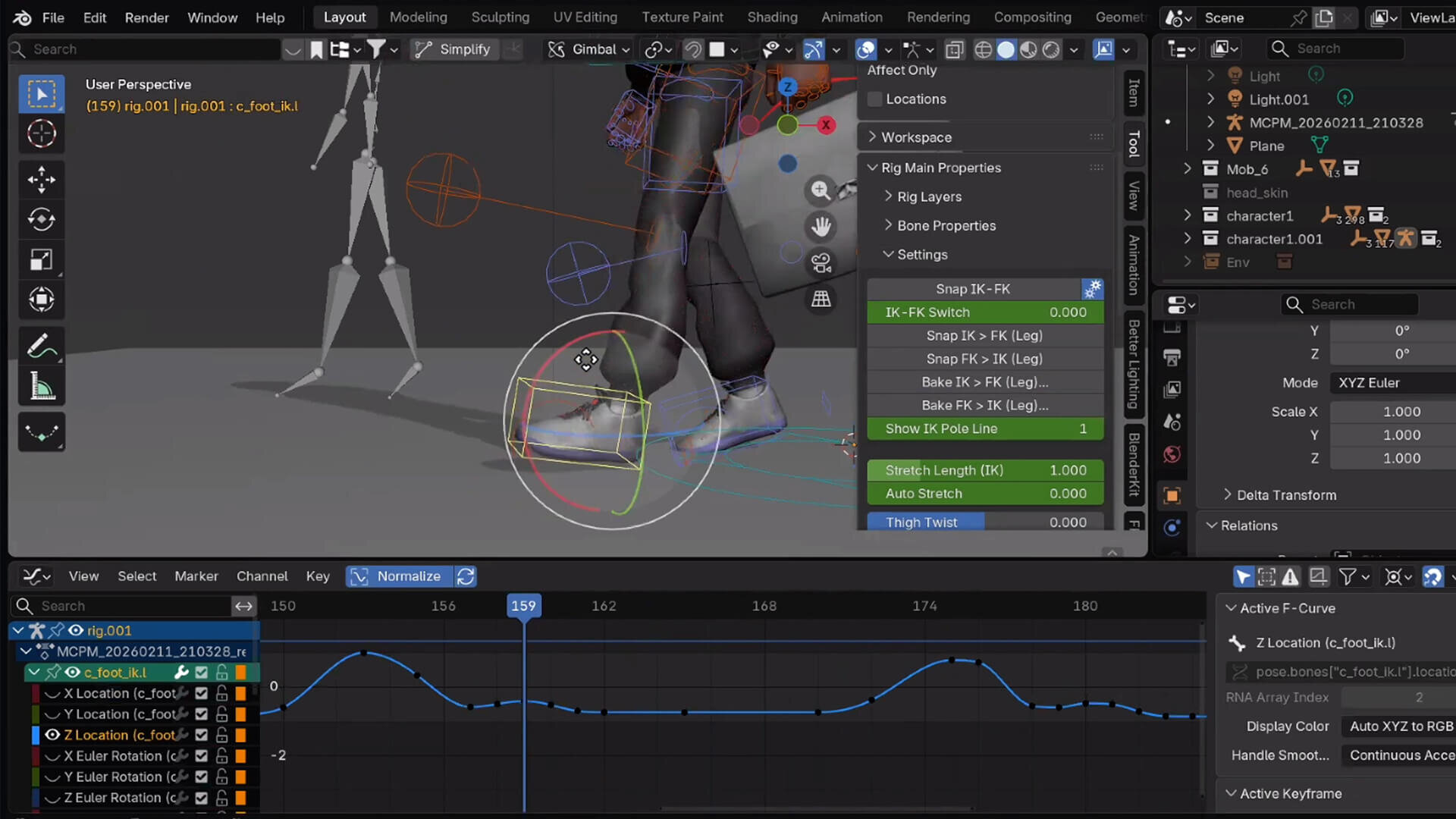

キャプチャーデータのBlenderへの取り込みでは、標準機能の「Rigify」で手動で骨のリターゲティングを行うのではなく、有料アドオン「Auto-Rig Pro」を活用。これにより、モーションデータの移植を一括で素早く行い、さらに「足の滑り」を修正するためにFKからIKへの一括変換も実行し、接地感のあるリアルな歩行アニメーションを制作した。

「手抜き」ではなくクオリティを上げるための選択

mocopiを自身のワークフローに組み込んだことで、taka v3氏の制作アプローチは大きく変化した。削れる工数を徹底的に削ることで、本来注力すべきクリエイティブな表現に時間を投資できるようになったのだ。

「手付けでイチからつくる場合はゼロからのスタートですが、モーションキャプチャーを使えば、取り込んだ時点ですでに60〜70%が完成している状態。残りの作業は、自分で調整を加えてそのクオリティを80%、90%へと引き上げ、時間がある限り100%に近づけていく工程です。イチからつくるのと、ある程度できているものを修正していくのとでは大ちがいで、アニメーションのブラッシュアップに使える時間が劇的に増えました」(taka v3氏)。

個人制作においては、いかにリソースを分配するかが作品の最終的な完成度を左右する。『The Stone Upstream』において、もっとも感情や生命力を宿すべきは、画面中央でトランペットを吹き鳴らすキャラクターだ。

「トランペット奏者の演技にしっかりと時間をかけたいのに、背景のモブキャラクターの手付けに膨大な時間を奪われてしまうのは本意ではありませんでした。効率化することは、作品全体のクオリティを上げるために『自分ができるベストは何か』を考えることです。ここはモーションキャプチャーを使って自分で素早く修正し、ここは手付けで全力で命を吹き込む。そうした優先順位をつけた判断をしていくことが、制作では非常に重要です」(taka v3氏)。

mocopiの登場により、高精度なモーションデータが自宅の省スペースで、しかも個人で手が届く価格帯で取得できるようになった。そしてmocopiを用いたBlenderによる3DCGアニメーション制作のワークフローは、個人クリエイターが抱える工数の壁を低くしたことも明らかになった。mocopiを手にしたtaka v3氏の今後の創作活動から目が離せない。

提供

ソニーマーケティング株式会社

mocopi

www.sony.jp/mocopi

TEXT_kagaya(ハリんち)

EDIT_阿部勝孝 / Masataka Abe(CGWORLD)