複数のアングルから撮影した動画から、AIの力を借りて自由視点の3Dシーンを生成する手法「NeRF」(ナーフ)。2023年1月には米マクドナルドのTVCMでも活用され、CG界隈の話題に上った。

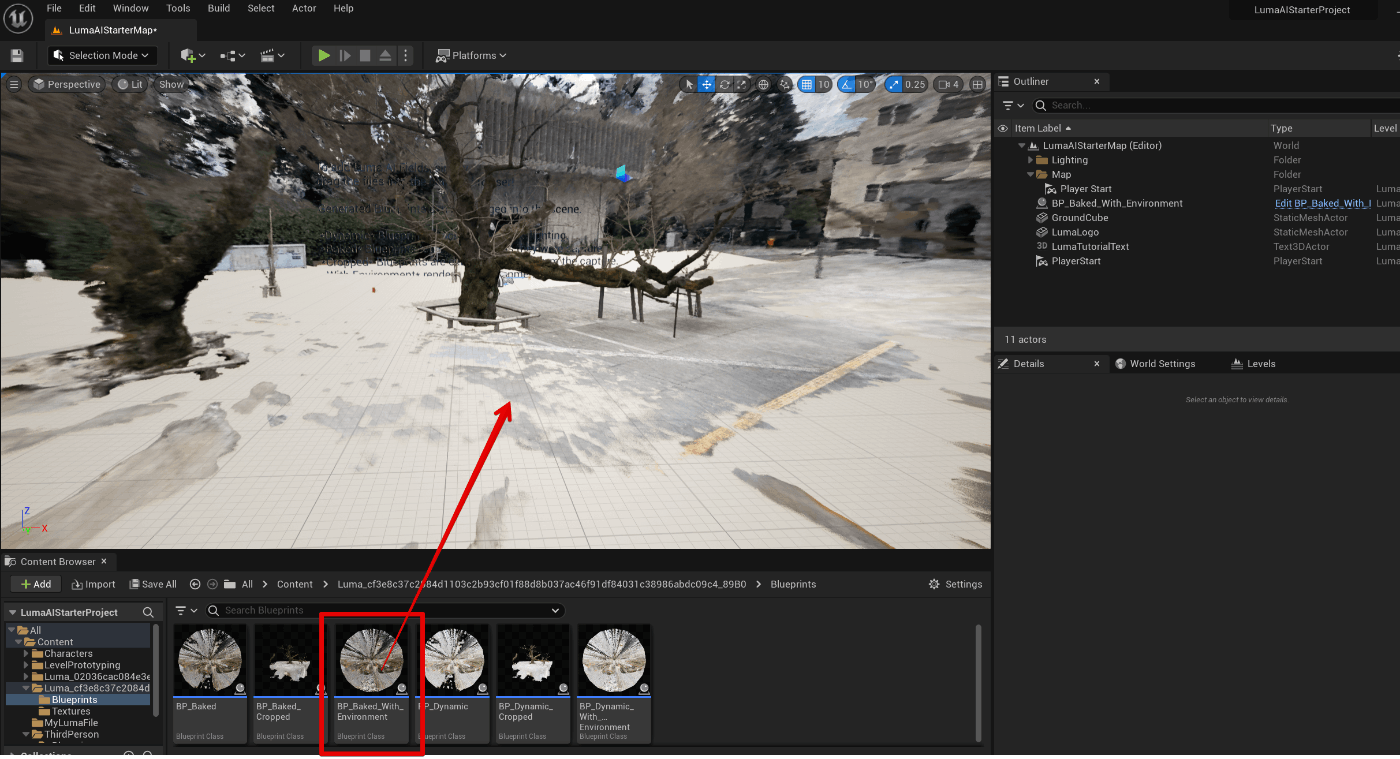

2023年4月3日(月)、このNeRF関連の最新事情として米Luma AI社はプラグイン「Luma Unreal Engine Plugin」のアルファ版をリリースした。これはWebアプリ・iPhone用アプリの「Luma AI」でキャプチャしたNeRFデータをUnreal Engine 5に読み込み、フィールドとしてリアルタイム表示できるものだ。

イワケン氏がプラグインの利用方法をQiitaで解説

そしてわずか2日後の4月5日(水)、サイバーエージェントのXRエンジニア、イワケン(岩﨑謙汰、iwaken71)氏が早速そのプラグインをテスト。プラグインの導入方法からLumaデータの読み込みや調整方法までをQiitaで公開した。

記事を投稿しました! Luma AIで撮影したNeRFデータをUnreal Engineで表示する! [UnrealEngine] on #Qiita https://t.co/QPmGsczAPw

— イワケン@XRコミュニティのキーマン/Microsoft MVP (@iwaken71) April 4, 2023

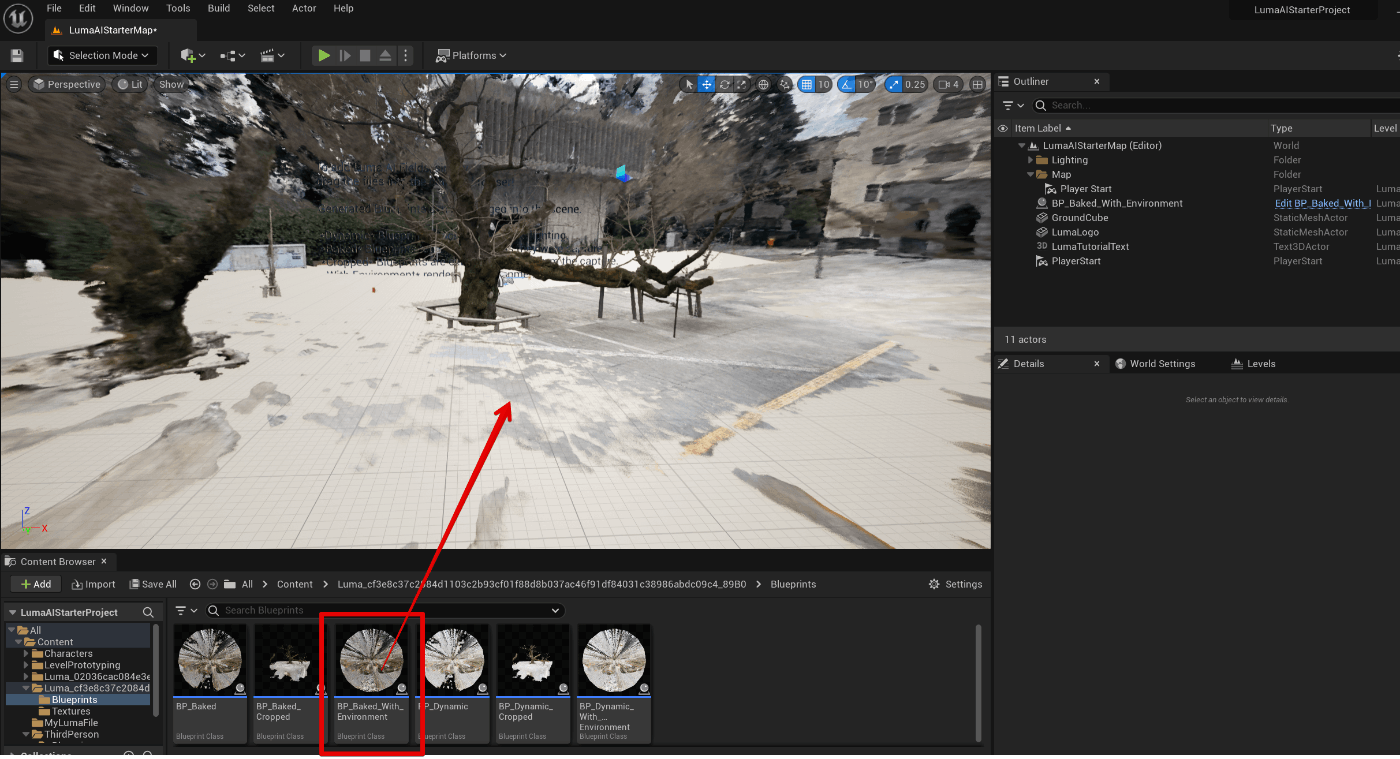

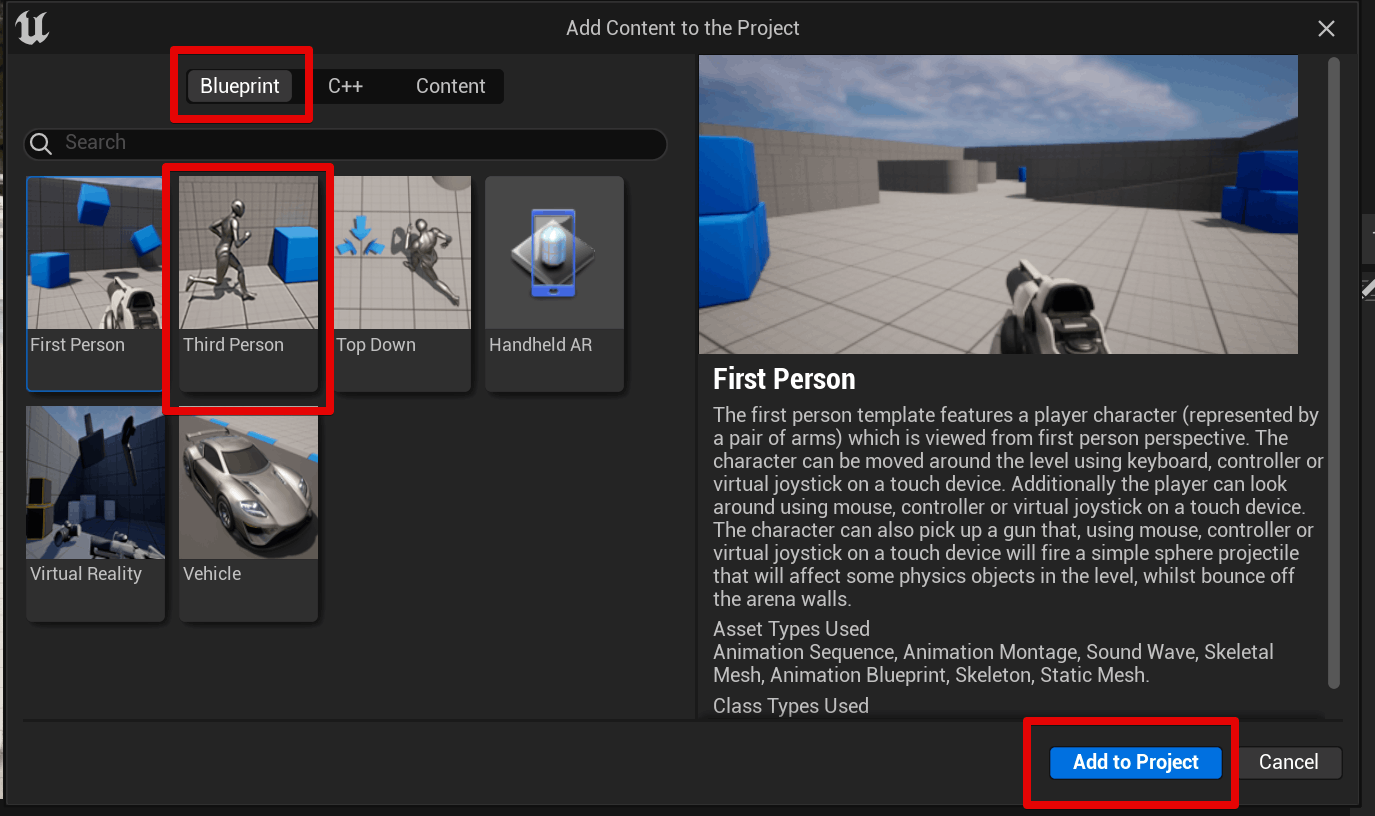

上記記事でイワケン氏は、東京・目黒にある大岡山公園で撮影したLumaデータをUE5に読み込んで、サードパーソンを追加して走り回るまでの手順を解説。NeRFキャプチャ用のブループリントの解説や、サードパーソンの追加手順にも触れている。

最後はこの通り。念願のLumaデータを使ったシーンでのランニングが実現した。

ぬおおおおおおおお

— イワケン@XRコミュニティのキーマン/Microsoft MVP (@iwaken71) April 4, 2023

Unreal Engineで大岡山公園を歩くことができた!!!!!!!!!!感激!!!!!!!!

最後落ちたwwwww怖いぜ#NeRF #LumaAI #UnrealEngine #UnrealEngine5 @LumaLabsAI pic.twitter.com/F1QAE0BwaZ

CGWORLD関連情報

●「NeRF(ナーフ)」を活用した世界初のTVCMが放映! NeRFとはなにか、既存の3DCG制作ワークフローとの親和性や実用性とともに紹介

マクドナルドのTVCMでの活用で話題を呼んだNeRFとはどんな技術なのか、CGWORLDアドバイザーのコメントとともに紹介した記事。

https://cgworld.jp/flashnews/lumaai-202301.html