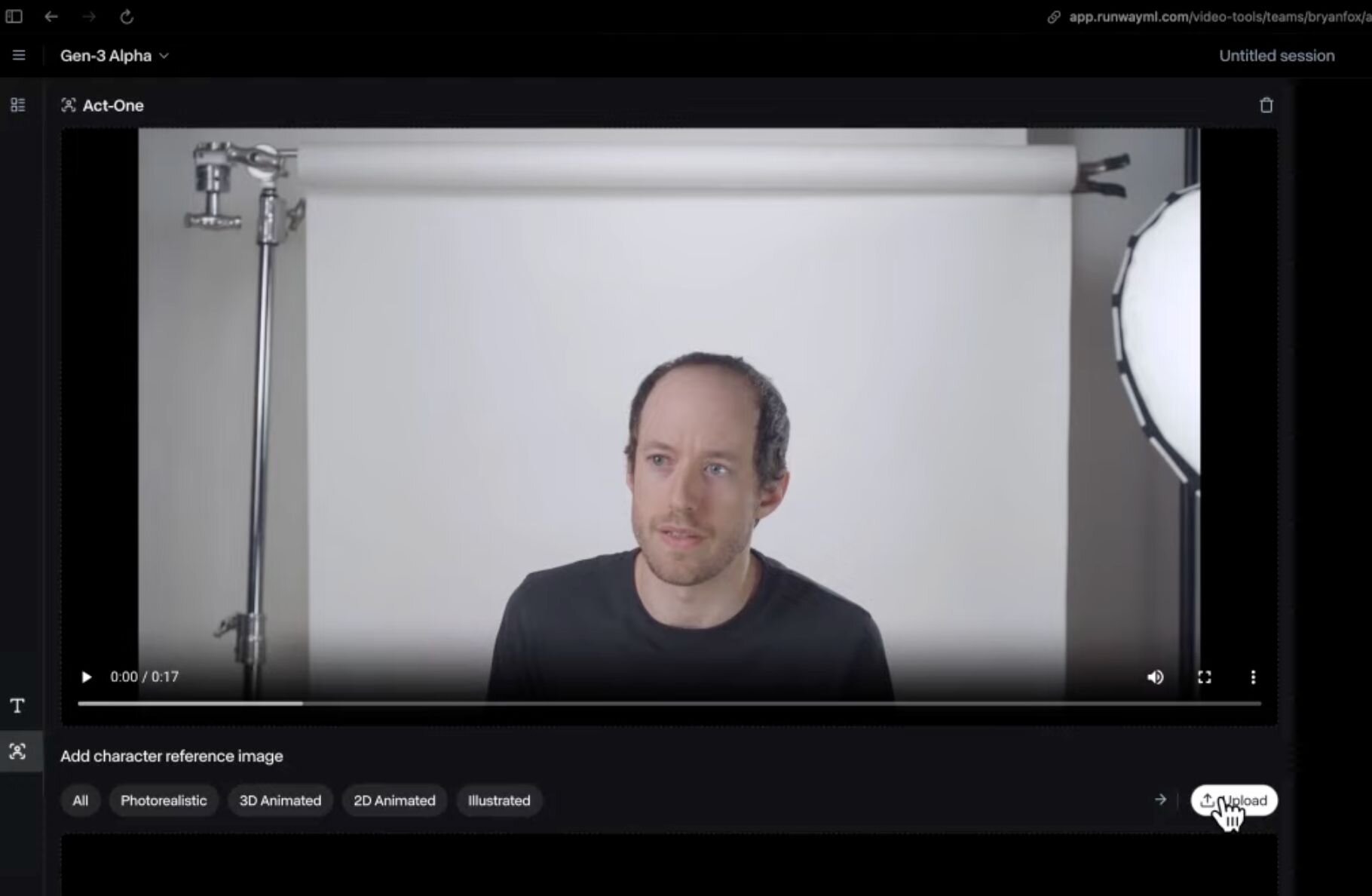

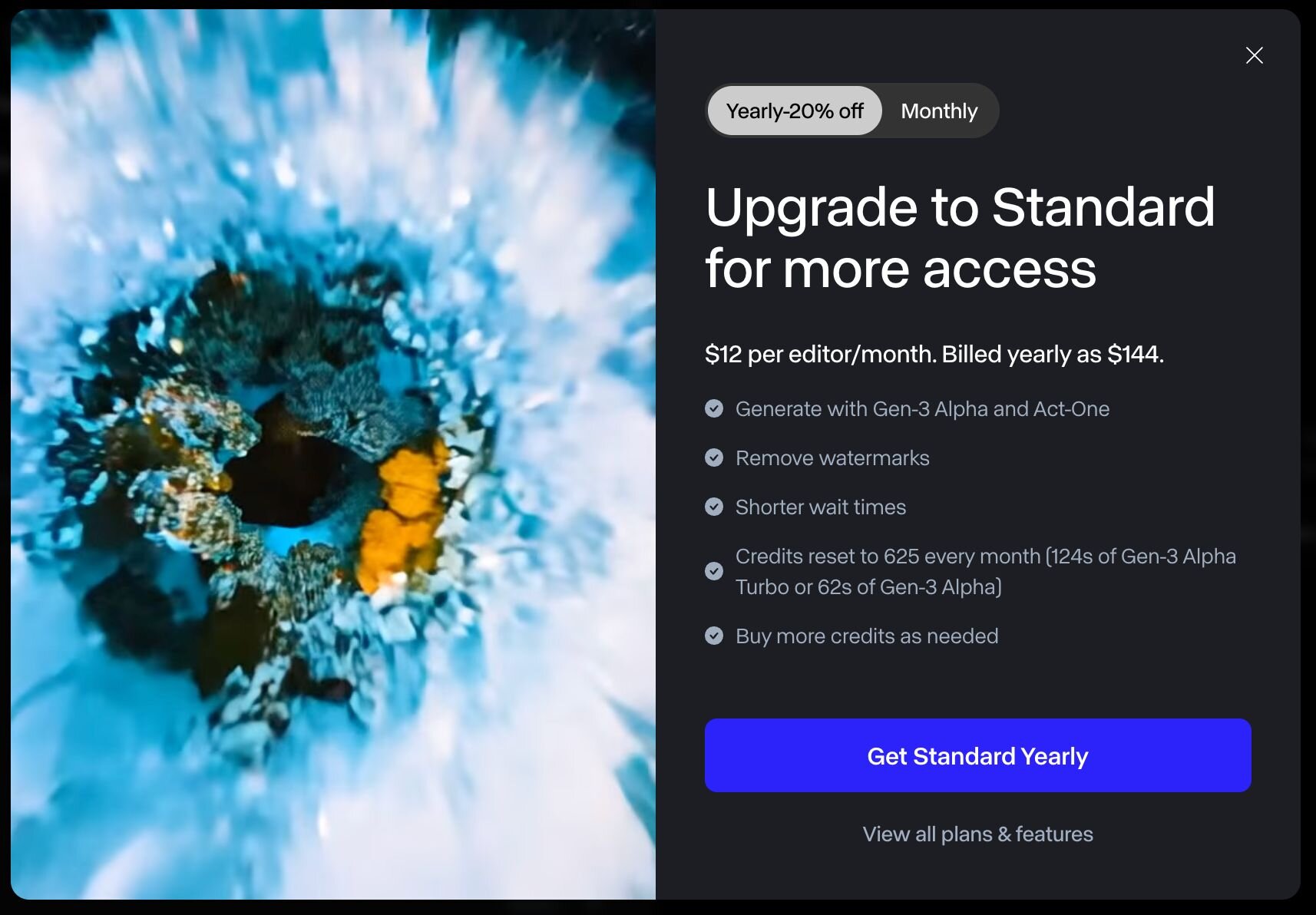

アメリカのテック企業Runway AI社は10月22日(火)、動画生成AI「Gen-3 Alpha」内の機能として、フェイシャルモーションのリファレンス動画からキャラクター画像を動かす、マーカーレスフェイシャルモーションキャプチャ機能「Act-One」をリリースした。利用対象者は有料プラン(月額または年額課金のStandard以上)のユーザー。

Act-One allows you to faithfully capture the essence of an actor's performance and transpose it to your generation. Where traditional pipelines for facial animation involve complex, multi-step workflows, Act-One works with a single driving video that can be shot on something as simple as a cell phone.

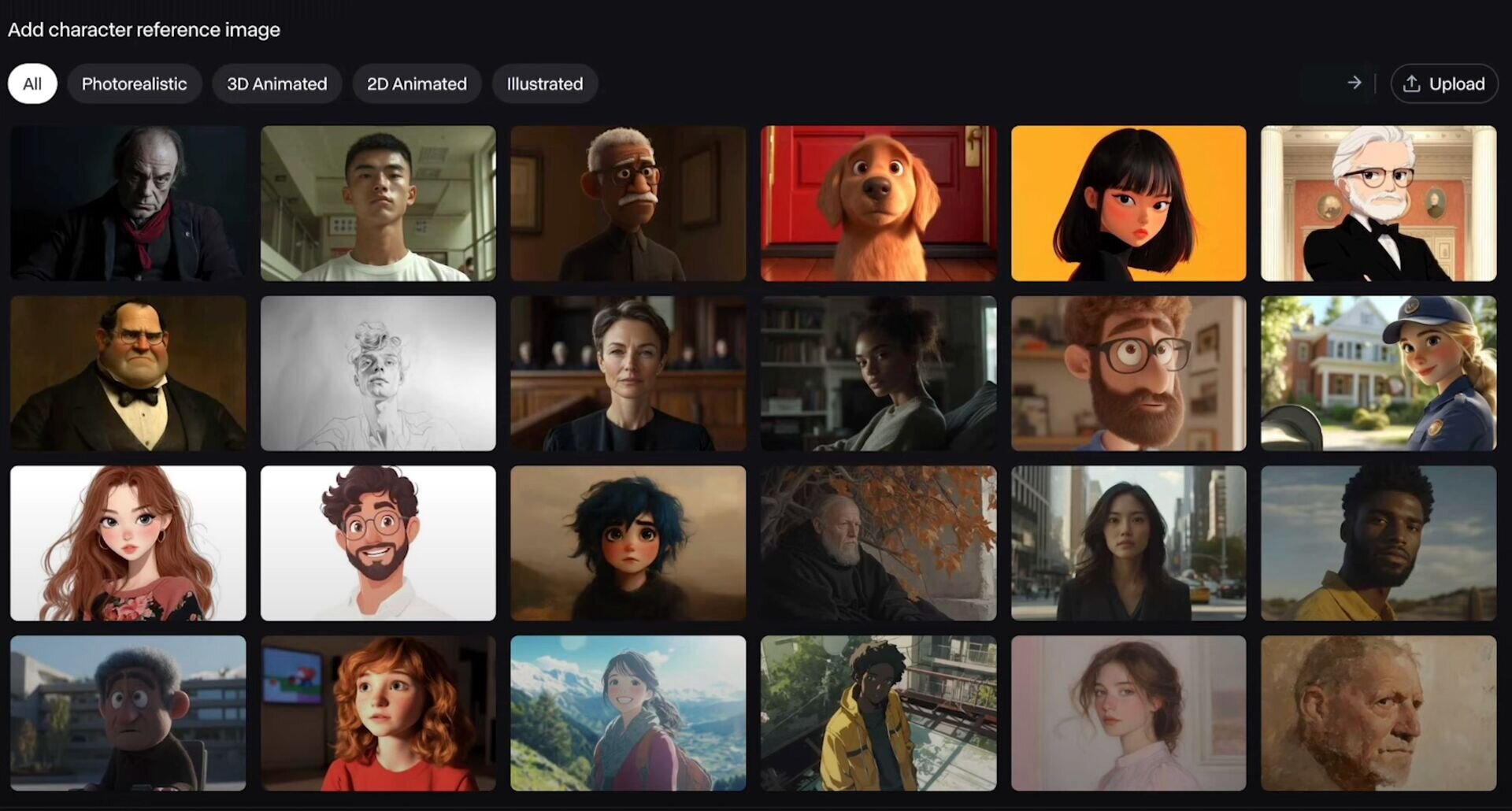

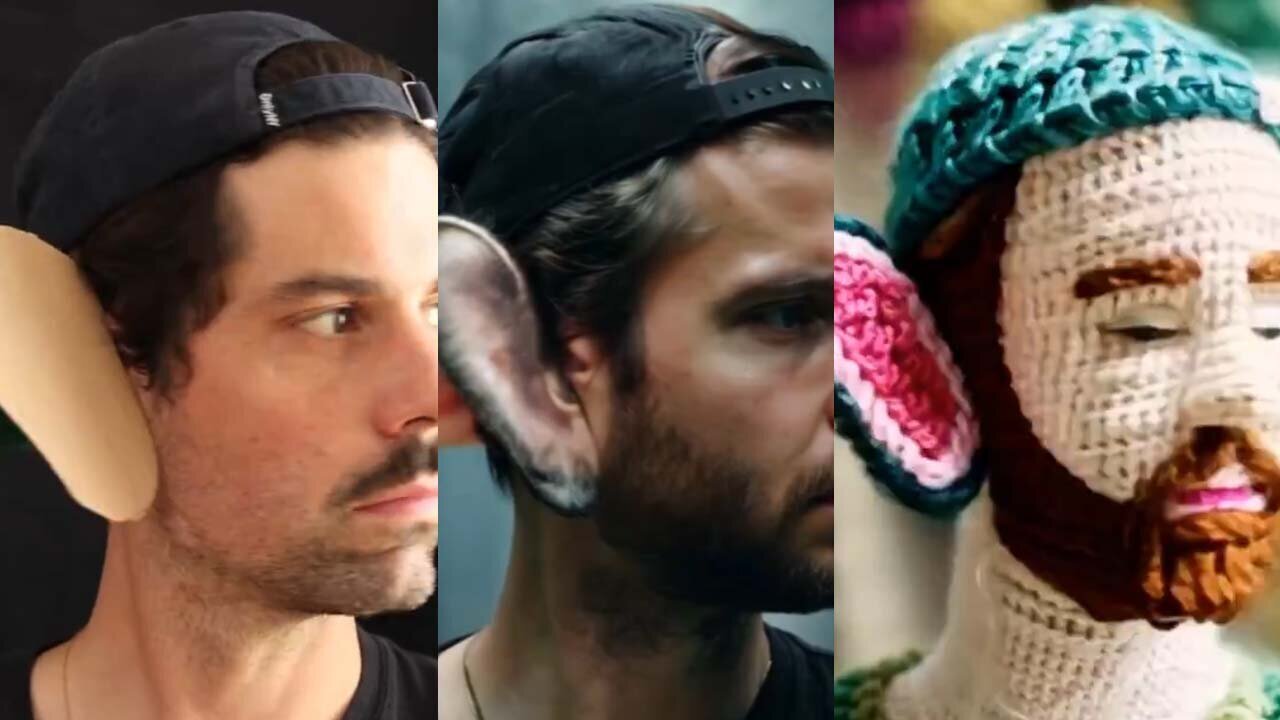

Without the need for motion-capture or character rigging, Act-One is able to translate the performance from a single input video across countless different character designs and in many different styles.

Act-Oneは演者によるパフォーマンスのエッセンスを忠実にキャプチャし、それを動画生成AIに置き換えることができます。従来のフェイシャルアニメーションのパイプラインには複雑なワークフローが必要でしたが、Act-Oneならスマートフォンのようなシンプルなカメラで撮影できる1本の動画があれば作業ができます。

モーションキャプチャやリギングが必要ないAct-Oneは、1本の入力映像から、数え切れないほどの異なるキャラクターデザインや様々なスタイルのパフォーマンスを生成できます。

One of the models strengths is producing cinematic and realistic outputs across a robust number of camera angles and focal lengths. Allowing you generate emotional performances with previously impossible character depth opening new avenues for creative expression.

With Act-One, eye-lines, micro expressions, pacing and delivery are all faithfully represented in the final generated output.

このモデルの強みのひとつは、数多くのカメラアングルと焦点距離で映画のようなリアルな映像を生成出力することです。従来の動画生成AIでは不可能だった、キャラクターの深みを持った感情的な演技を生み出すことができ、クリエイティブな表現の新たな道を開きます。

Act-Oneでは目線や微かな表情の変化、間の取り方、話し方などの全てを忠実に生成動画に表現します。

利用手順は、撮影したフェイシャルパフォーマンス動画をアップロードし、リファレンスとなるキャラクター画像をプリセットから選択、またはアップロードして指定して「Generate」を実行するだけ。

Gen-3 Alpha内でAct-Oneを使用するには10クレジット/秒が必要となる。生成できる動画は最大30秒、1,280×768・24fpsとなる。利用にあたっては、パフォーマンス動画を正面から撮影する、パフォーマンスを反映するキャラクターの画像に横顔や全身は不向きなど、必要条件や推奨条件がある。それらの条件や注意事項は下記に掲載されている。

■Creating with Act-One on Gen-3 Alpha

https://help.runwayml.com/hc/en-us/articles/33927968552339-Creating-with-Act-One-on-Gen-3-Alpha

Standardプランは年払いで144ドル(約22,000円)。「Generate with Gen-3 Alpha and Act-One」の記載がある。

CGWORLD関連情報

●Runway、動画生成AI「Gen-3 alpha」でVideo to Videoが利用可能に! 最大10秒、入出力動画の一貫性制御にも対応

Runway AIは動画生成AI「Gen-3 Alpha」のVideo to Video機能を一般公開。利用対象者は有料プラン(月額または年額課金のStandard以上)のユーザー。

https://cgworld.jp/flashnews/202409-Gen3AlphaVideo.html

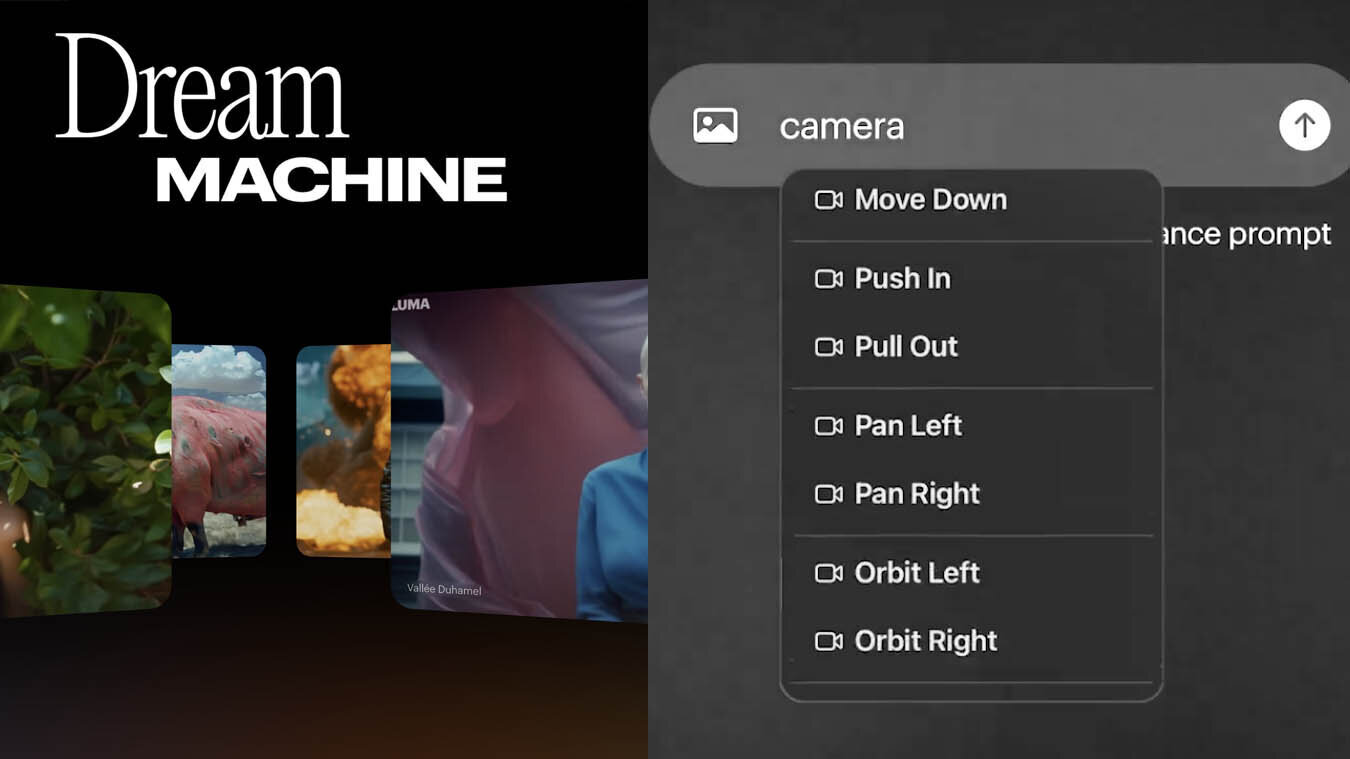

●Luma AIの動画生成AI「Dream Machine 1.6」リリース! カメラモーションのコントロールに対応、v1.5ではカスタムテキストのレンダリングにも対応

Luma AI社は動画生成AI「Dream Machine」の最新バージョン1.6を一般公開。Text-to-VideoとImage-to-Videoのどちらでも、テキスト入力のサジェストからカメラモーションの指示が行えるようになった。

https://cgworld.jp/flashnews/202409-DreamMachine.html

●Adobeが動画生成AIモデル「Firefly Video Model」ベータを今年後半にリリース! Premiere Proへの機能組み込みを予定、商用利用でも安全な設計である点を強調

Adobe社は同社ブログにて動画生成AIモデル「Firefly Video Model」のベータバージョンを2024年後半にリリースすることを発表、同モデルによる生成サンプルなどを公開した。

https://cgworld.jp/flashnews/202409-FireflyVideo.html