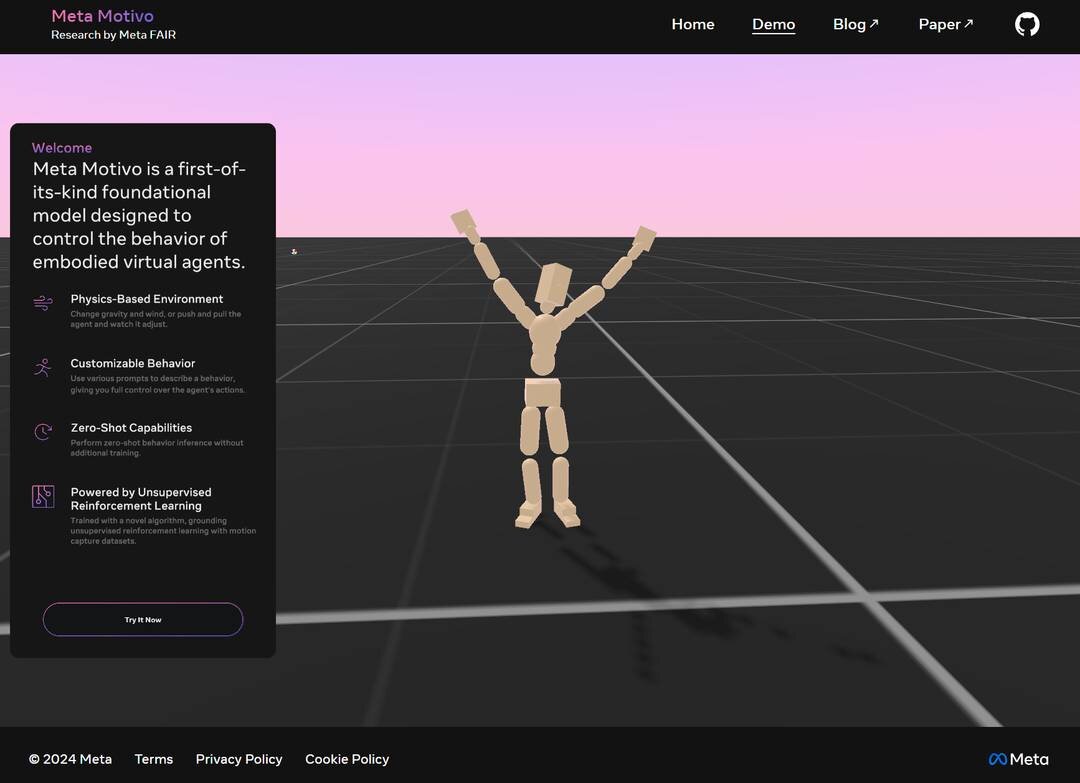

Meta社の基礎AI研究チーム(Meta FAIR)は12月13日(金)、動作基盤モデル「Meta Motivo」の研究結果を公開した。Meta Motivoは同社の新アルゴリズムに基づく教師なし強化学習を基礎とするAIアバターの動作基盤モデル。バーチャル環境において、より人間らしい動きができるNPCキャラクターを生み出すためのエンボディドAI(Embodied AI、人型ロボットのような身体性のあるロボットのAIシステム)のひとつとなる。

Wrapping up the year and coinciding with #NeurIPS2024, today at Meta FAIR we’re releasing a collection of nine new open source AI research artifacts across our work in developing agents, robustness & safety and new architectures. More in the video from @jpineau1.

— AI at Meta (@AIatMeta) December 13, 2024

All of this… pic.twitter.com/rNvZ5dmdYp

Meta Motivoは、教師なし強化学習の代表的な制限である「事前のトレーニング」や「データセットの必要性」から解放され、ラベルレスの動作データセットを活用した強化学習を基礎とする新しいアルゴリズムによって「ゼロショット学習」(トレーニングデータに存在しないタスクや概念を認識し分類するようAIモデルをトレーニングすること)を実現する動作基盤モデル。

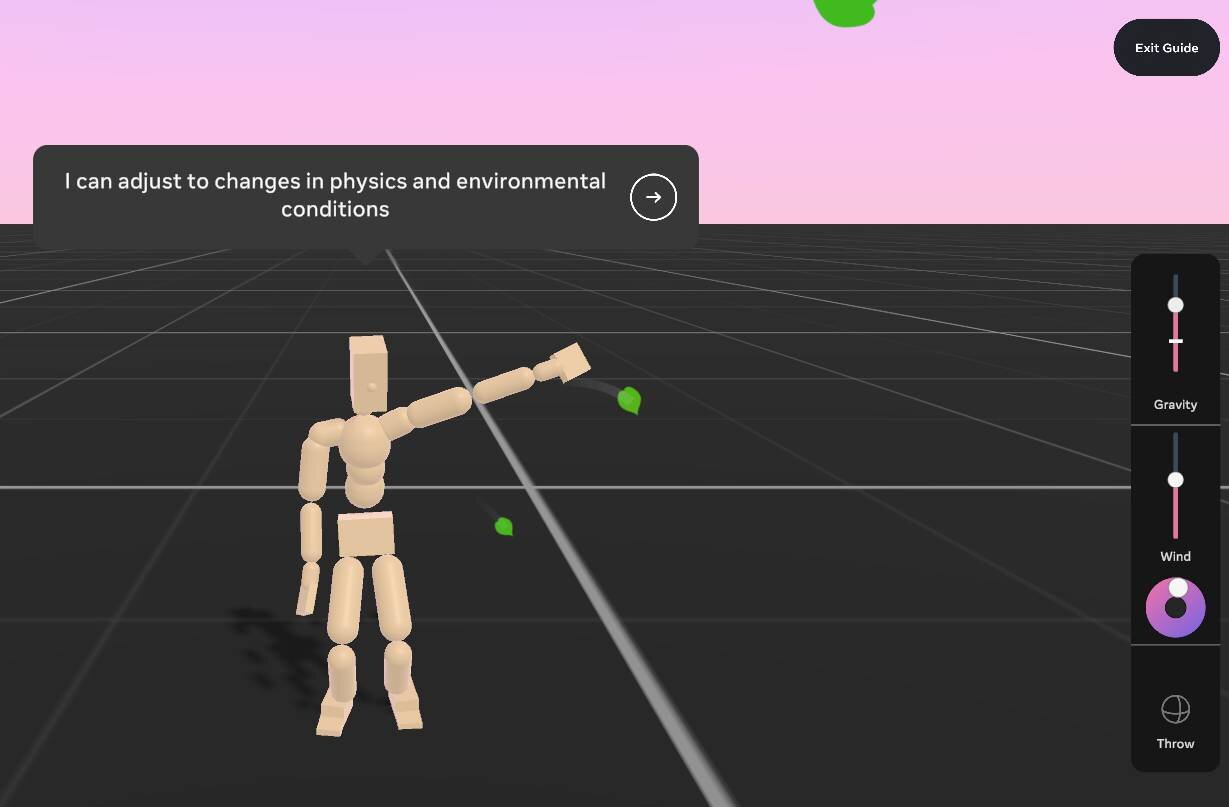

状態やモーション、報酬が同じ潜在空間に埋め込まれているため、モーショントラッキングやゴールとなるポーズへの到達、報酬の最適化などといった幅広い全身制御タスクを追加トレーニングなしで実行できる。

また、トレーニングされていないにもかかわらず、重力や風、小さな変化に対する高いロバストネス(強靱性)を示すという。

Meta Motivoは、同社が展開するAIアシスタント「Meta AI」の機能拡充のひとつとして発表されたもの(現在、日本ではMeta AIは利用できない)。今後は、同社ヘッドセットのMeta Questシリーズにも対応する予定とのことだ。

また、Meta FAIRは今回、Meta Motivoだけでなく、動画に対する電子透かし技術「Meta Video Seal」を含むいくつかの研究結果を発表している。詳しくは下記ブログを参照してほしい。

■Sharing new research, models, and datasets from Meta FAIR(公式ブログ、英語)

https://ai.meta.com/blog/meta-fair-updates-agents-robustness-safety-architecture/

■Zero-Shot Whole-Body Humanoid Control via Behavioral Foundation Models(論文、英語)

https://ai.meta.com/research/publications/zero-shot-whole-body-humanoid-control-via-behavioral-foundation-models/

■Meta Motivo(デモサイト)

https://metamotivo.metademolab.com/

■Meta Motivo(GitHub)

https://github.com/facebookresearch/metamotivo

CGWORLD関連情報

●現実の43万倍の速度で物理シミュレーションを実行できるプラットフォーム「Genesis」登場! ロボット工学の研究開発加速、CGキャラクターへの応用にも期待

カーネギーメロン大学の研究チームがオープンソースの物理シミュレーションプラットフォーム「Genesis」を発表。Genesisは、現実の43万倍のスピードで物理シミュレーションを実行できる、Pythonベースの軽量な設計の汎用物理エンジン。ロボット工学、エンボディドAI、フィジカルAの分野における、高速なロボットトレーニングでの活用が期待されている。

https://cgworld.jp/flashnews/202412-Genesis.html

●VRMコンソーシアム、3Dアバター向けファイル形式「VRM」の国際標準化に向け「glTF」開発のKhronos Groupとの連携を発表

一般社団法人VRMコンソーシアムは)、同法人が開発・提唱する3Dアバター向けファイル形式「VRM」の国際標準化に向けて、その基盤技術である「Khronos glTF 2.0」を開発したThe Khronos Group社と協力し、共同でVRMとglTFフォーマットの開発を進めていく、と発表。

https://cgworld.jp/flashnews/202410-Vrm-glTF.html

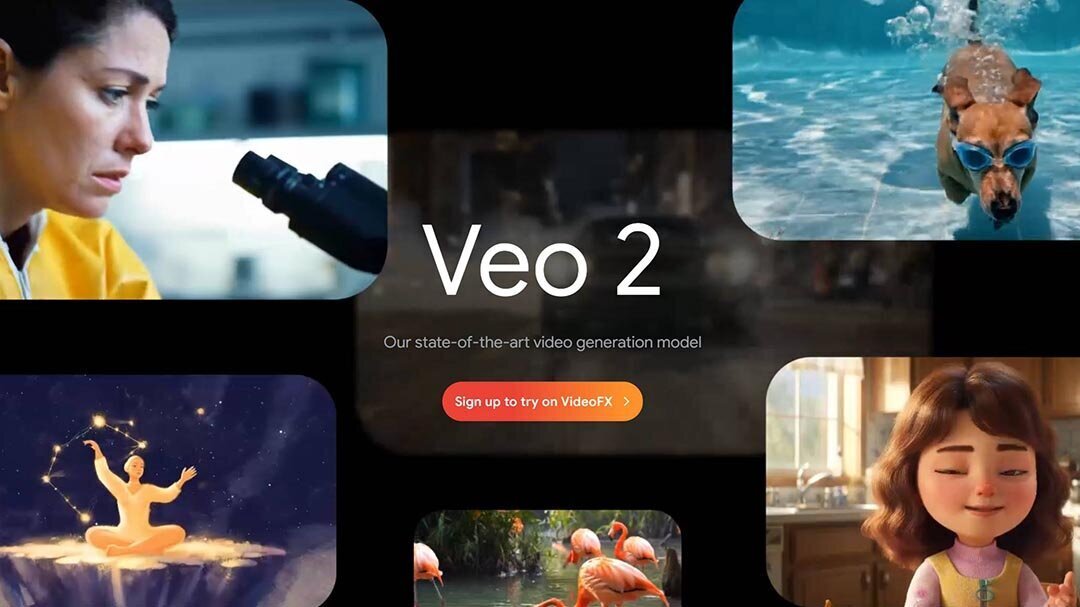

●Google、動画生成AI「Veo 2」を一般公開! 最大4K、物理学・人間の動き・表情のニュアンスを理解

Googleが動画生成AI「Veo 2」を一般公開。現実世界の物理学や人間の動き、表情のニュアンスを理解・表現でき、最大4K解像度、長さ数分まで対応する。Google Labs内「VideoFX」で利用できるが、現在は順番待ちリスト(Early Access Waitlist)への登録が必要となる。

https://cgworld.jp/flashnews/202412-Google-Veo2.html