2017年にAdobeに買収されたVR専用ツール開発会社Mettleの共同創業者で、現在Adobeのイマーシブ担当ディレクターを務めるChris Bobotis/クリス・ボボティス氏による、先日行われた記者発表会の様子をレポート。VRソリューションのAdobe Creative Cloudへの統合の状況と、VRコンテンツ制作におけるこれまでと現在、今後について、ツールメーカーならではのお話を伺った。

TEXT&PHOTO_安藤幸央(エクサ)/ Yukio Ando(EXA CORPORATION)

EDIT_小村仁美 / Hitomi Komura(CGWORLD)

<1>Adobeイマーシブ製品について

Chris Bobotis/クリス・ボボティス氏(Mattle共同創業者、現・Adobeイマーシブ担当ディレクター)

「イマーシブ(immersive)」という聞き慣れない単語は、直訳すると「没入感」。ドーム映像や360度映像など、映像に没入することができるコンテンツを包括して「イマーシブ」と呼ぶことが多い。ボボティス氏は、2017年までAdobe製品向けのVRプラグインを開発していたMattleの共同創業者を務めていた。MattleのVRへの取り組みは2015年頃からはじまったという。「最初のプロジェクトは広告代理店から依頼のあった360度VRコンテンツのストーリー企画でした。なぜそのプロジェクトに興味をもったかというと、VRが映像のストーリーテリングを考え直すきっかけになったからです」(ボボティス氏)。

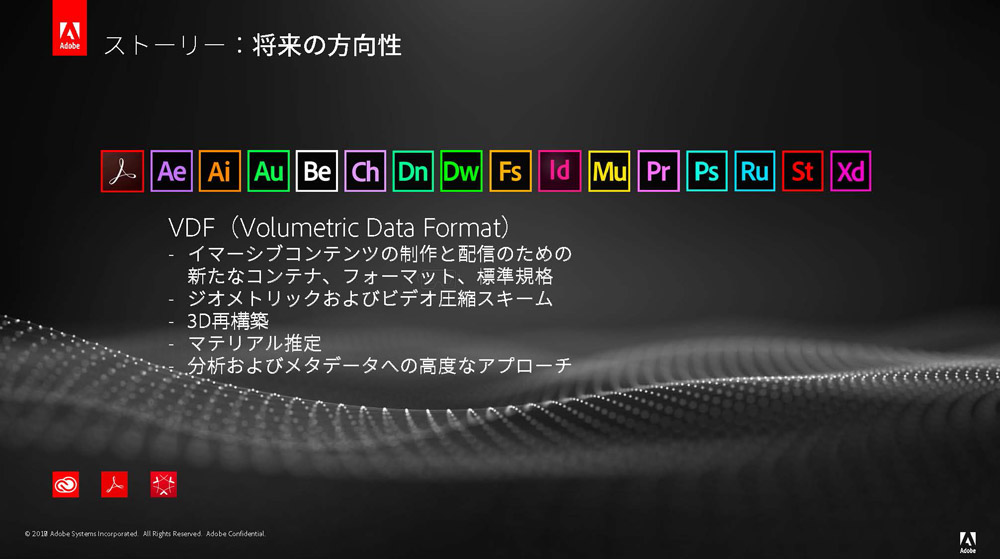

Adobeの様々な製品群が連携しあう様子を解説した資料

映画の映像や、スマートフォンで観る映像は画面の「枠」があるが、360度VRは映像の「枠」がない世界で、ストーリーを語らなければならないと語るボボティス氏。枠が消えるということは、視聴者が映像空間に存在するということになる。そうすると通常の映像とは異なるため、ストーリーをどう語るのかをゼロから考えなければならない。ドラマのように視聴者を感動させる映像、広告映像のように製品の良さを知らせる映像も、360度VRの場合、従来のメディアとは扱いがまったく異なるのだという。

従来のメディアであれば、ストーリーテリングとは映像制作者が映像の「枠」を決める話だったが、360度VR映像では、ユーザーの視線をどう誘導するのかが大きな課題となる。ユーザーはいったいどこを見ているのか?その視線をどうやって導くのか?それらはVR制作ツールの機能ややり方によっても大きく変わってくる。

<2>これまでの道のり

まず、「これまでの道のり」と題して、イマーシブ映像制作の歴史について簡単に語られた。「360度実写VR映像制作の初期は、市販のアクションカメラGoProを数台組み合わせた手づくりのリグを使用していました。体験的にはこれでも最高のコンテンツがつくり出せて、それは今でも変わりありません」。

GoPro数台を組み合わせただけの簡素なパノラマカメラアレイ

現在では、各社から360度撮影専用のカメラがリリースされており、完璧なソリューションが数多く提供されているが、「最初の頃の制作はAdobe After Effectsで、決まったやり方もなく試行錯誤で、今からするとわけもわからない巨大で複雑怪奇なプロジェクトをつくって制作していました」と、往時をふり返った。

現在市販されている360度撮影専用カメラの例

試行錯誤中のAEプロジェクト

そこで編集した映像は、Oculus Rift DK2で利用したり360度映像に対応したばかりのYouTubeなどにアップロードすることになるのだがその手法は大変複雑で、一般的な制作者にはとても難しいものだったという。「そこで、Mattleでは、何かわかりやすい方法を提供しないと大変もったいないと考えました。そう思った大きな理由のひとつはFacebookがOculusを買収したこと、Facebook1社であればそれほど大きな影響はなかったかもしれませんが、YouTubeも360度映像に対応するのであれば、ごくごく一般のユーザーも360度映像制作に注目するのではないかと考えました」。また、もうひとつ大事だったのは、特殊で高価なVRヘッドセットだけでなく、スマートフォンを活用した安価なコンテンツ視聴の方法も広がりつつあり、そうすれば視聴者も多い、魅力的なメディアになると考えたとのこと。

そうして、試行錯誤して利用していたAEのプロジェクトが7つのプラグイン製品となった。「これらのプラグインは、VRコンテンツを仕事としている会社であれば大体が使っているプラグインです。これらの製品のいくつかをAdobeが買収し、今後はAEとPremiere Proに統合される予定です」。また、SkyBox製品はイマーシブVRという製品名に変更。さらにPhotoshopが一部対応、Dimensionも3Dコンテンツの制作の部分でかなり関わってきているという。

Where are the SkyBox 360 Tools in After Effects and Premiere Pro CC 2018?

「VRコンテンツの制作当初は360度カメラを買って、ジェットコースターに乗りながら撮影したり、ライブイベントを撮影したり、そこそこ面白いコンテンツができれば十分だと考えていました」と語るボボティス氏。しかし現在は、テクニックから言っても作品的に言っても100年間歴史のある映画と同じレベルのコンテンツが生み出せるようになったとし、一例としてクリストファー・ノーラン監督のIMAX映画『ダンケルク』(2017)の劇場公開時に提供された360度トレーラー『ダンケルクVR』のメイキング映像が紹介された。

SAVE EVERY BREATH: THE DUNKIRK VR EXPERIENCE

この映像制作にはIntel、Microsoft、DELLが協力しており、ハードウェアメーカーであるIntelなどが真剣に取り組んでいること、そしてハードウェアの提供だけでなくコンテンツの制作にも協力していることを強調。さらに、「もうひとつご理解いただきたいのは、今のVR体験は、GoProやREDといった高解像度カメラ、つまり、かなり品質が良く、解像度の高い、かつ映画を制作している人が扱い慣れているカメラで撮影されています。それらの高解像度の映像があれば、必ずしも360度全周撮影したものでなくとも、ツールの助けによって360度映像を制作、編集することができるのです」と氏は続けた。

「『ダンケルク』のクリストファー・ノーラン監督は、かなり厳しく細かい監督で、映像フレームの1つ1つ、1ピクセルでも気にくわないとダメ出しする方でした。それほど映像にこだわる監督でさえ今の新しいVRメディアに納得できるのであれば、このVRというメディアには未来があるのではないかと私たちは考えたのです」。

<3>現在の取り組み

続いてAdobeとして現在行なっている取り組みについて、まずはイマーシブ映像における音の重要性に言及。「360度VR映像にとって、ビデオ素材はとても大事ですが、それと同じくらいにオーディオ素材も大切な要素です。イマーシブ映像の場合は、後ろにあるものが、目の前に見えていなくとも音として聞こえていないとイマーシブな体験にはなりません。人間にとってビデオよりもオーディオが大事な場合もあるのです」。

そうして、昨年のAdobe MAX 2017にて発表した開発中のイマーシブオーディオの新機能「SonicScape」について、将来のリリース版に含まれるかどうかは未定としつつ、その背景と機能を紹介した。「イマーシブな音の収録に関してはいわゆるアンビソニック方式と呼ばれる4つ程度のマイクが様々な角度で設置されているマイクアレイを用いますが、事前に完璧に調整することは難しく、4つのオーディオチャンネルの方向によって微妙に変わります。そして編集の際、オーディオの方向とカメラの方向がずれている場合が多く、これまではそれを実際に耳で聴きながら調整するしかありませんでした」。

SonicScapeはオーディオが聞こえて来るときに、その方向を映像に重ねてレンダリング表示するという機能だ。音が発生しているのが視覚的にわかるため、音の発生場所の映像と、音の方向をぴったりと一致させることができる。この機能を用いれば、一箇所で動かずに収録したものだけでなく、音楽フェスティバルなどで移動しながら撮影・収録したコンテンツについても、収録時にはあまり気にせず収録後に的確に編集・調整するといった現実的な作業が可能になる。

SonicScape機能により、映像の着目点と、立体的な音の発生源の場所を調整して合わせている様子

「従来のAEにはこういった空間音響に対応するしくみはないため、VST(Virtual Studio Technology:バーチャル音楽スタジオ技術)で知られるSteinbergと協力の下、現在手を入れて改造中です。将来的にはこういった空間音響の対応を進めていくのが大事だと思っています」。

もうひとつ対応を進めているものとして、MettleがFacebookとともに開発した新技術「Sidewinder」を紹介。「現在、360度ビデオの再生についての大きな課題は3方向の自由度で撮影されていることです。頭を回転して見る、頭を傾けて上を見る、下を見るといった場合には、ビデオ映像が追従することで違和感のないイマーシブな体験が得られます。ただし、ビデオを撮影した地点は1点のみのため、しゃがんだり、ジャンプしたり、そういう動きをした場合ビデオ映像はその動きに追従できません。そういった場合違和感が出てきてしまいます」。

「Sidewinder」では、ステレオ撮影したRGBのデータから奥行きの情報を推定することができる。その奥行きのデータを加えると、6DoFの自由度、立体感のある再生環境を手に入れるきっかけになり、ある程度、壁の向こう側にも回り込んで見える雰囲気を提供することが可能になるという。

また、VR映像の制作上の課題として、制作現場では扱うデータ量の増加が大きな負荷になってきていると指摘。時間や予算、クリエイターのモチベーションに余裕があれば問題ないが、大抵の場合、データ管理の作業が増えれば増えるほどクリエイティブ作業の余裕が減っていくのが現実だ。

扱うデータはますます巨大化。4K、8K、8K立体視と、倍々に扱うデータ量が増加していく

現在主流のVRの元データは4Kサイズで、それでも相当のデータ量となる。より解像度を求めると8Kサイズを扱うケースもあるが、理想を求めると16Kかつステレオフォーマットでなければ、どうしても粗さが目立ってしまう。4Kから8K、8Kから8Kステレオデータ、さらに8Kデプスデータが加わると、データ量は倍々に増えていく。最近ではそれに加え、メッシュ、ポイントクラウドデータが加わる場合もある。

「肥大化するデータ量の負担を減らす、処理時間を減らすためにある程度妥協が必要だと考えました。例えば8Kステレオ両面のデプスデータを全て扱わなくとも、片面のデプスデータだけでも総データ量はかなり小さくなり、多くの場合はこれで十分だと考えています」。一番重要なのは、目的や必要に応じて最大限重いフォーマットも、利用状況に応じてより軽いフォーマットも使える柔軟性だとボボティス氏は語った。

そういった状況で、現在Adobeが対応を進めているのがVDF(Volumetric Depth Format)というフォーマットだ。VDFはイマーシブコンテンツのための標準規格であり、Adobeだけでなく様々なパートナー企業を巻き込みつつ、提案を行なっているとのこと。

Adobeが対応を進めている新フォーマット・VDF(Volumetric Depth Format)

また、今後の予定として、Googleが提供する前方180度のVRフォーマット「VR180」のサポートを挙げた。VR180は180度しかカバーしないため、360度VRよりも没入感は少ないが、制作や編集の手間が減ることで、同じ予算でより長くより複雑なコンテンツが制作できると期待されており、Adobeも力を入れているのだという。

<4>将来の方向性

最後に、Adobeのイマーシブ映像制作に対するこの先の方針について、「現在手に入るVRヘッドセット製品、今後リリースされていくVRヘッドセット製品への対応はこれからも続けていきます。Microsoft HoloLensや、各社のVRヘッドセットに対応していくことで自由度も上がっていくと考えています。また、AdobeはARもとても大切だと思っており、できるだけ早く対応する予定です」とボボティス氏は話した。ARに関して、公開できる現時点の情報としてはこちらで確認できるとのこと。

「Adobeとして、ビデオ編集ツールに限らず、できるだけ多くのツールをイマーシブに対応させることを目標としています。イマーシブなコンテンツをつくるときに、新しいことを勉強せずともすぐに利用できるようなツールとして改善を続けています。また、Creative Cloudのイマーシブ対応も考えています。VRのこれからは、Adobeのような大きな会社が導くだけでなく、コンテンツクリエイターとも協力してツールをつくっていくのが主流になると考えています」。

ちなみに、ボボティス氏にとってオススメのVRコンテンツはあまりにもたくさんありすぎて特定の何かを紹介することはできないが、気になる人はMettleのブログで紹介されているものをチェックしてほしいとのこと。

中でも注目しているのは、ロサンゼルスにある『Alien Zoo』というイマーシブコンテンツと、同じくロサンゼルスにあるVRインスタレーション『CARNE y ARENA』。どちらも大変噂になっており、なかなか体験の機会を得ることが難しいほどの人気なのだという。

Dreamscape Immersive presents Alien Zoo

ボボティス氏によると、今までと比べて技術だけでなくVRコンテンツ側がどんどん面白くなっているし、マネタイズの方法も進化し、それによって技術も進化していることが実感されているそうだ。