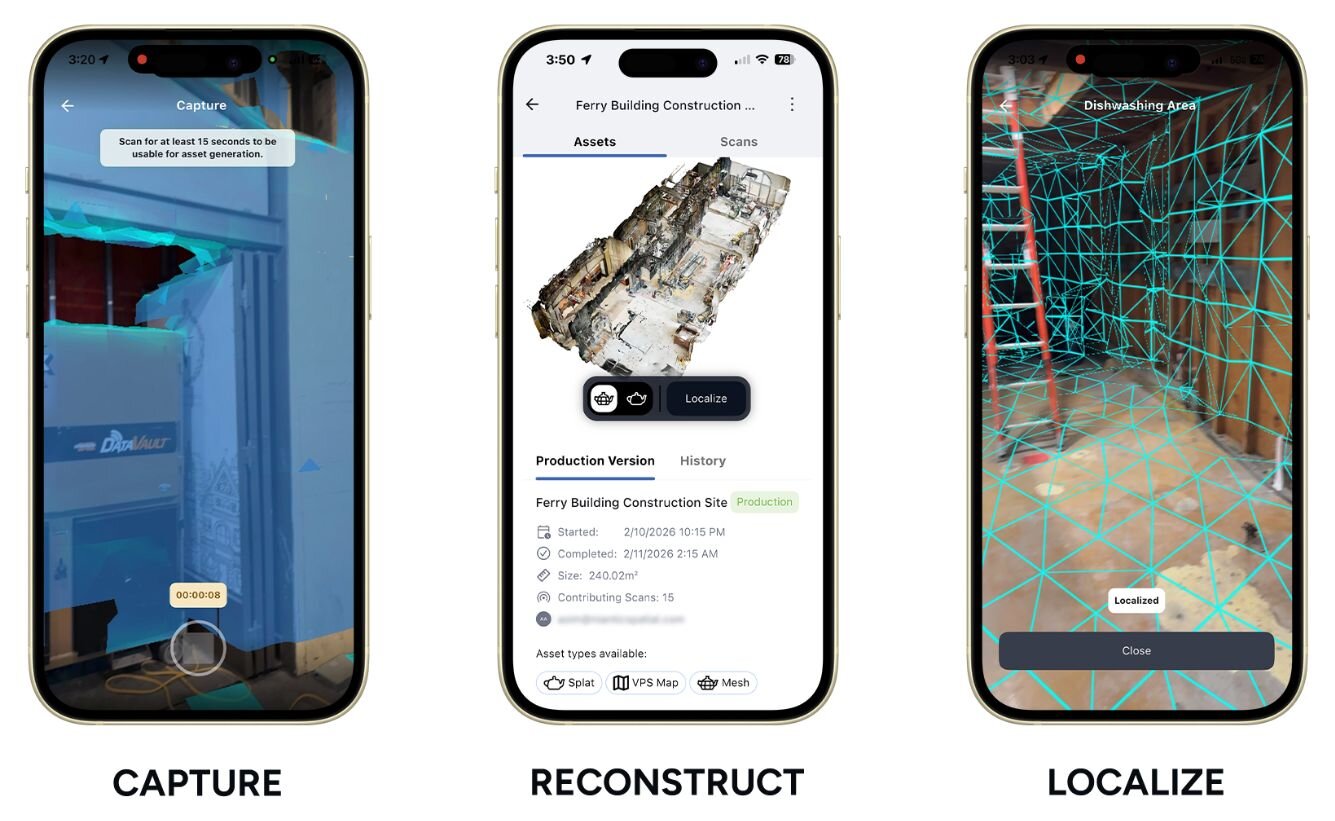

Niantic Spatial社は4月8日(水)、従来から提供してきた「Scaniverse」を刷新し、ビジネス向け空間インテリジェンスサービスの入口となるプラットフォームとして新たに提供を開始した。併せて、事前の空間スキャンなしで機能するグローバル規模の視覚測位システム「VPS 2.0」と、各種プラットフォームに対応する開発キット「NSDK 4.0」もリリースした。

空間キャプチャプラットフォーム「Scaniverse」

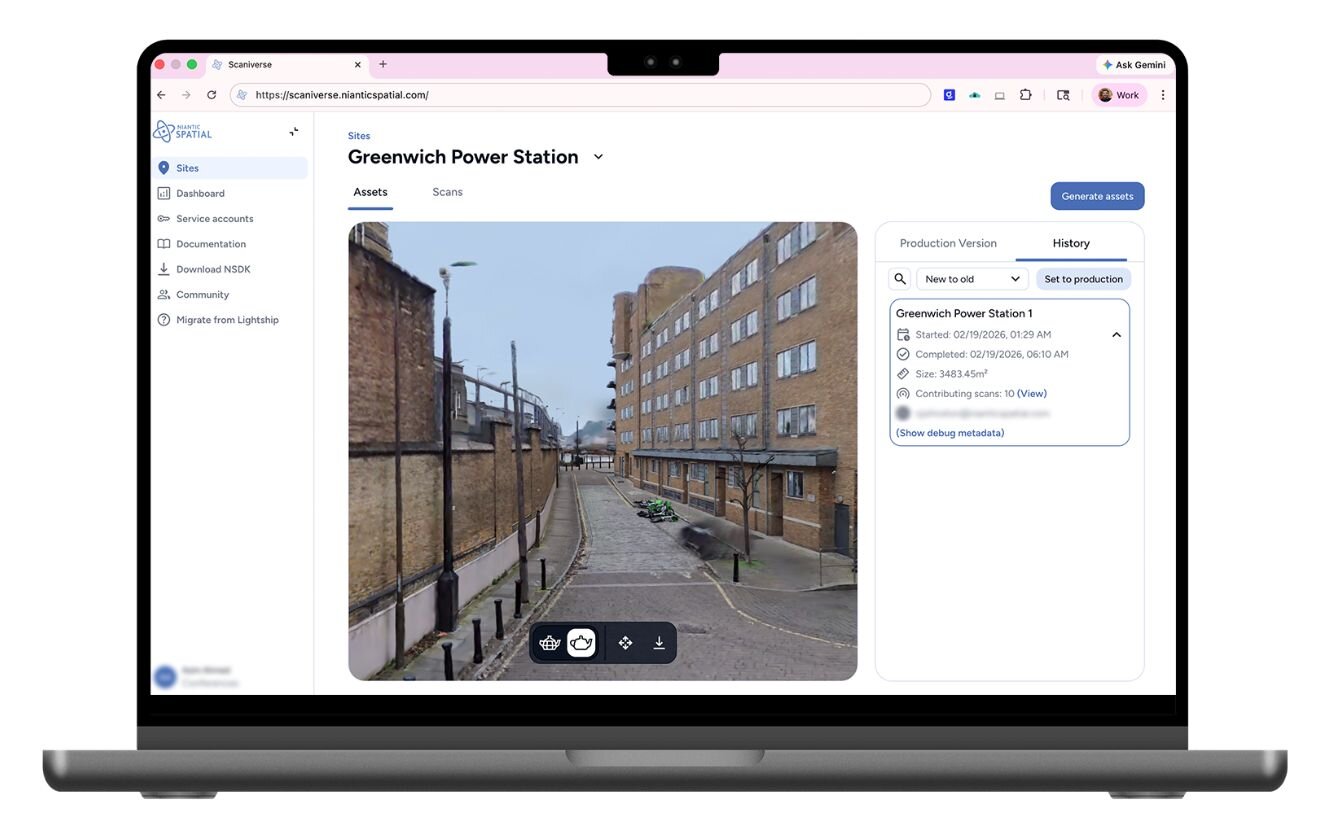

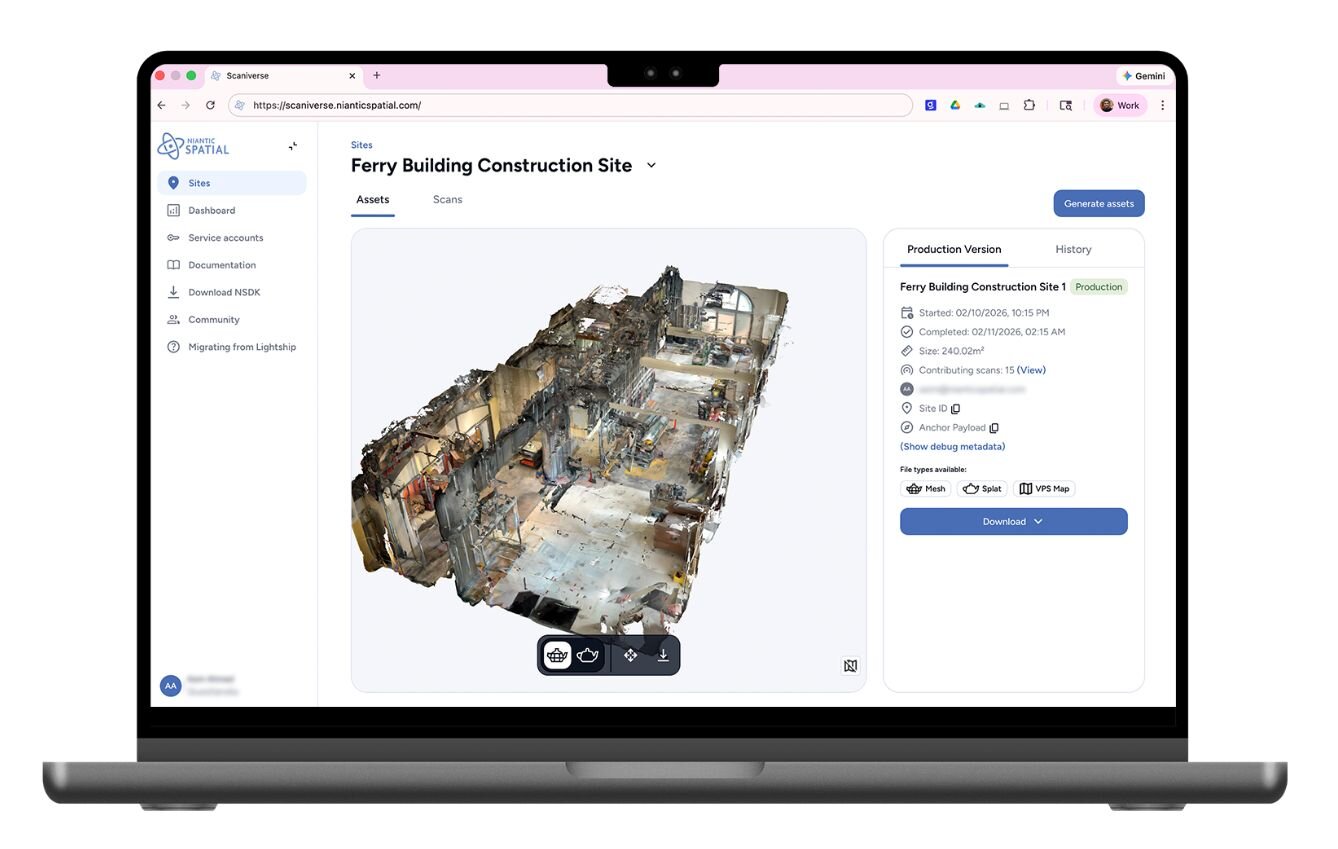

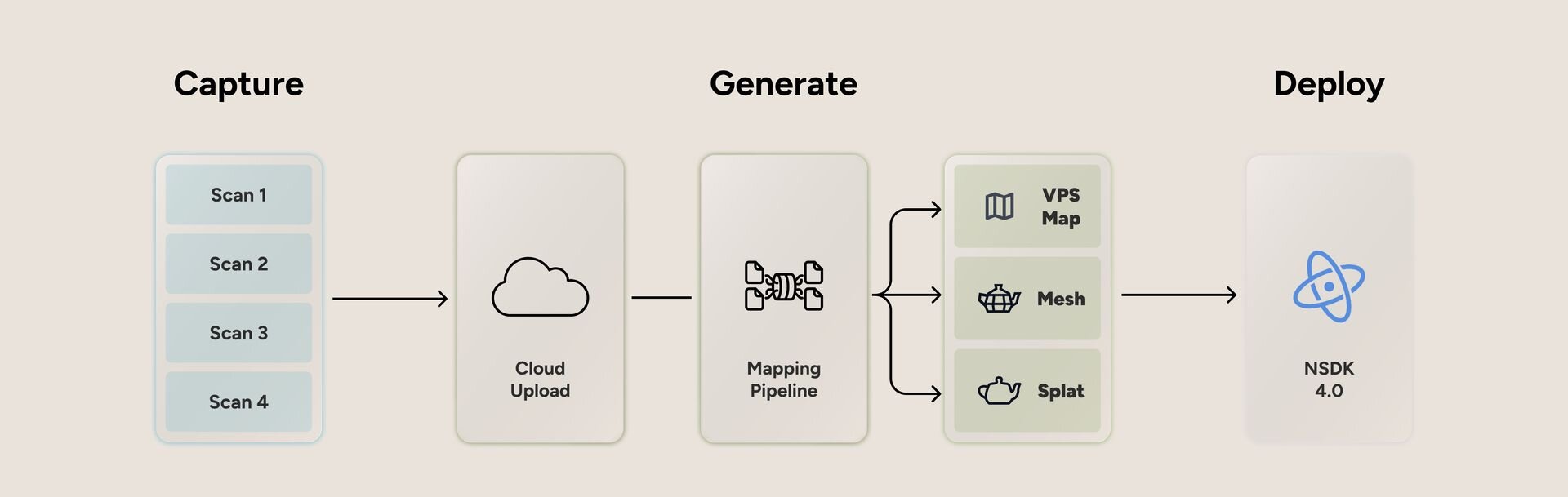

Scaniverseはスマートフォンや市販の360°カメラを用いて3D空間をキャプチャするモバイルおよびWebプラットフォーム。一部屋の空間から数千平方メートルの大規模なエリアまで対応し、高精度のメッシュや3DGS(3D Gaussian Splatting)を生成できる。クラウドを通じた共同編集機能により、複数ユーザーが別々のデバイスからスキャンデータを追加し、単一の統合モデルを構築可能。生成されたアセットは標準的な3DフォーマットのFBXやPLY、およびNianticがオープンソース(MITライセンス)で推進する3DGS用フォーマットSPZ形式でエクスポートでき、ロボティクスシミュレータへの組み込みも想定されている。

■Capture(Niantic Spatial)

https://www.nianticspatial.com/products/capture

■Scaniverse - 3D Scanner(App Store iPhone)

https://apps.apple.com/jp/app/scaniverse-3d-scanner/id1541433223

■Webブラウザ版Scaniverse

https://scaniverse.nianticspatial.com/

事前スキャン不要のグローバル測位「VPS 2.0」

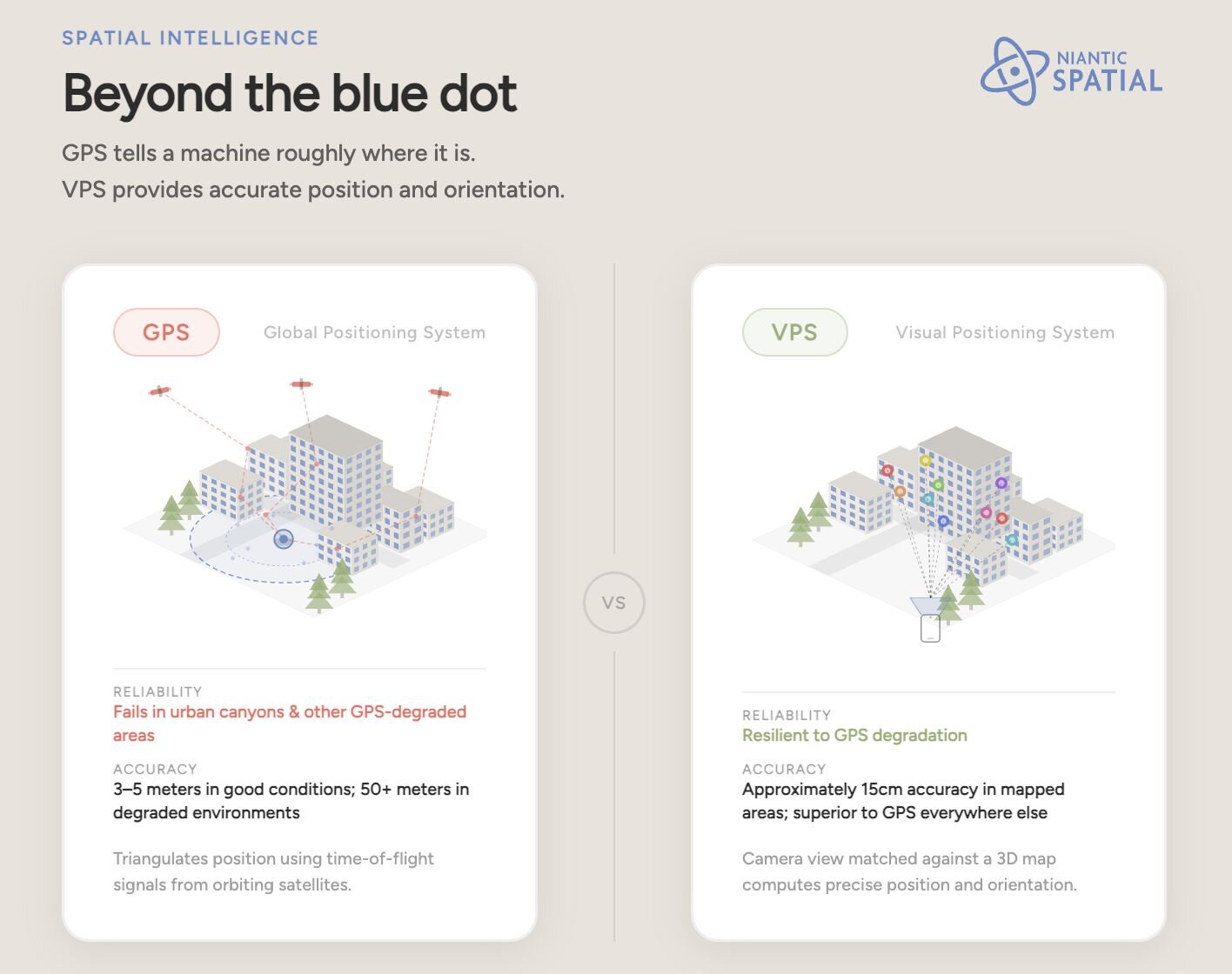

「VPS 2.0」は、カメラの視覚情報と高度なコンピュータビジョンを用いてリアルタイムに正確な位置と向きを割り出すVPS(Visual Positioning System:視覚測位システム)の最新版。従来は事前にロケーションをスキャンしておく必要があったが、本バージョンからその制限が撤廃された。Scaniverseでマッピング済みの場所ではセンチメートル精度の6DoF(6 Degrees of Freedom、位置と姿勢を含む6自由度)ローカリゼーションを提供し、未スキャンの場所でも視覚的な文脈と複数のデータソースを活用してGPSのズレや信号消失を補正し、3DoFによる安定した測位と方位の提供を行う。

■Localize(Niantic Spatial)

https://www.nianticspatial.com/products/localize

複数環境をサポートする開発キット「NSDK 4.0」

開発者がScaniverseやVPS 2.0と統合された空間アプリケーションを構築するための開発キット「NSDK(Niantic Spatial Development Kit) 4.0」も一般提供開始。本アップデートでは、Unity、Swift、ネイティブAndroidのサポートが拡張される。さらに、ロボットソフトウェア開発の世界的な標準フレームワークであるROS 2(Robot Operating System 2)の早期サポートもリクエストベースで開始される。これにより、モバイルアプリ開発者からロボット工学のエンジニアまで、単一のプログラミング環境に縛られることなく既存のワークフローを活用できる。

■Niantic Spatial SDK(Niantic Spatial)

https://www.nianticspatial.com/docs

■Mapping the World For Machines with Scaniverse(公式ブログ)

https://www.nianticspatial.com/blog/scaniverse

CGWORLD関連情報

●「OpenUSD v26.03」リリース 3DGSのネイティブサポート、テスト用レンダラ同梱によりusdview内で表示確認可能

AOUSD(Alliance for OpenUSD)が3Dシーン記述フレームワークOpenUSDの最新バージョン「OpenUSD v26.03」をリリース。本アップデートでは3D Gaussian Splats(3DGS)のネイティブサポートや、Webブラウザでの実行を可能にするWebAssemblyへの対応が追加。また、データ処理エンジンの改良や描画性能の向上などの機能強化も施されている。

https://cgworld.jp/flashnews/01-202604-OpenUSDv26.03.html

●3Dシーン補完生成技術「Seen2Scene」発表! 不完全な実世界の3Dスキャンデータから現実的な3Dシーンを補完・生成

ミュンヘン工科大学とバージニア大学の研究チームが不完全な実世界の3Dスキャンデータから現実的な3Dシーンを補完・生成する技術「Seen2Scene」を発表。現実の観測データから直接学習する新しいアプローチを採用し、複雑で雑然とした環境でも高精度なシーンの再構築を実現する。

https://cgworld.jp/flashnews/01-202604-Seen2Scene.html

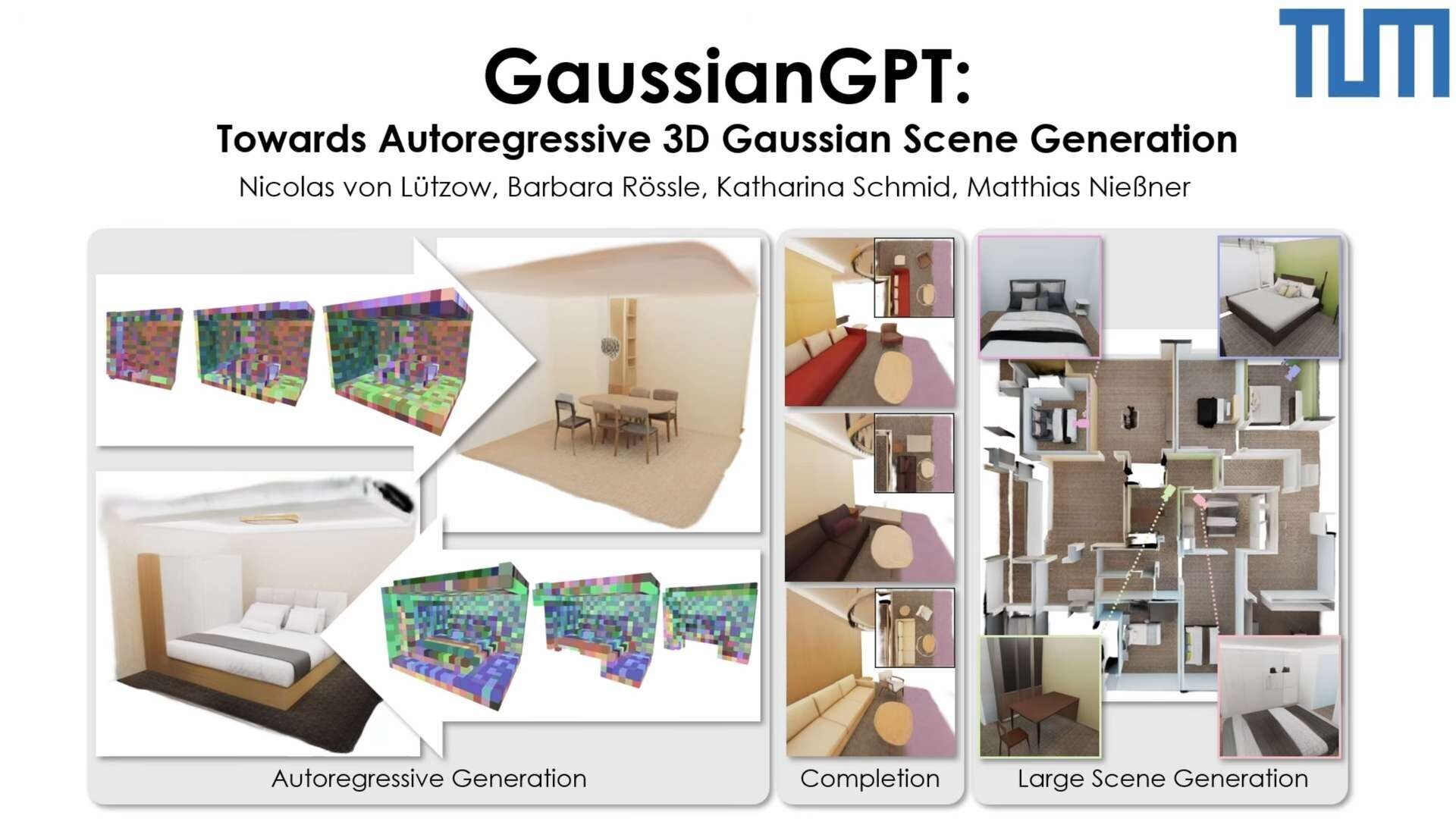

●自己回帰的3DGSシーン生成技術「GaussianGPT」発表! GPT形式のトランスフォーマーを用いて3D空間の構造と外観を段階的に生成

ミュンヘン工科大学の研究チームが、次トークン予測を用いた自己回帰型の3DGS(3D Gaussian Splatting)生成モデル「GaussianGPT」を発表。LLM(大規模言語モデル)と同様の学習手法を3D空間の構築に応用することで、シーンの欠損補完や自由度の高い拡張を可能にする。現在は学術的な研究段階となっており、ソースコードは近日公開予定。

https://cgworld.jp/flashnews/01-202604-GaussianGPT.html