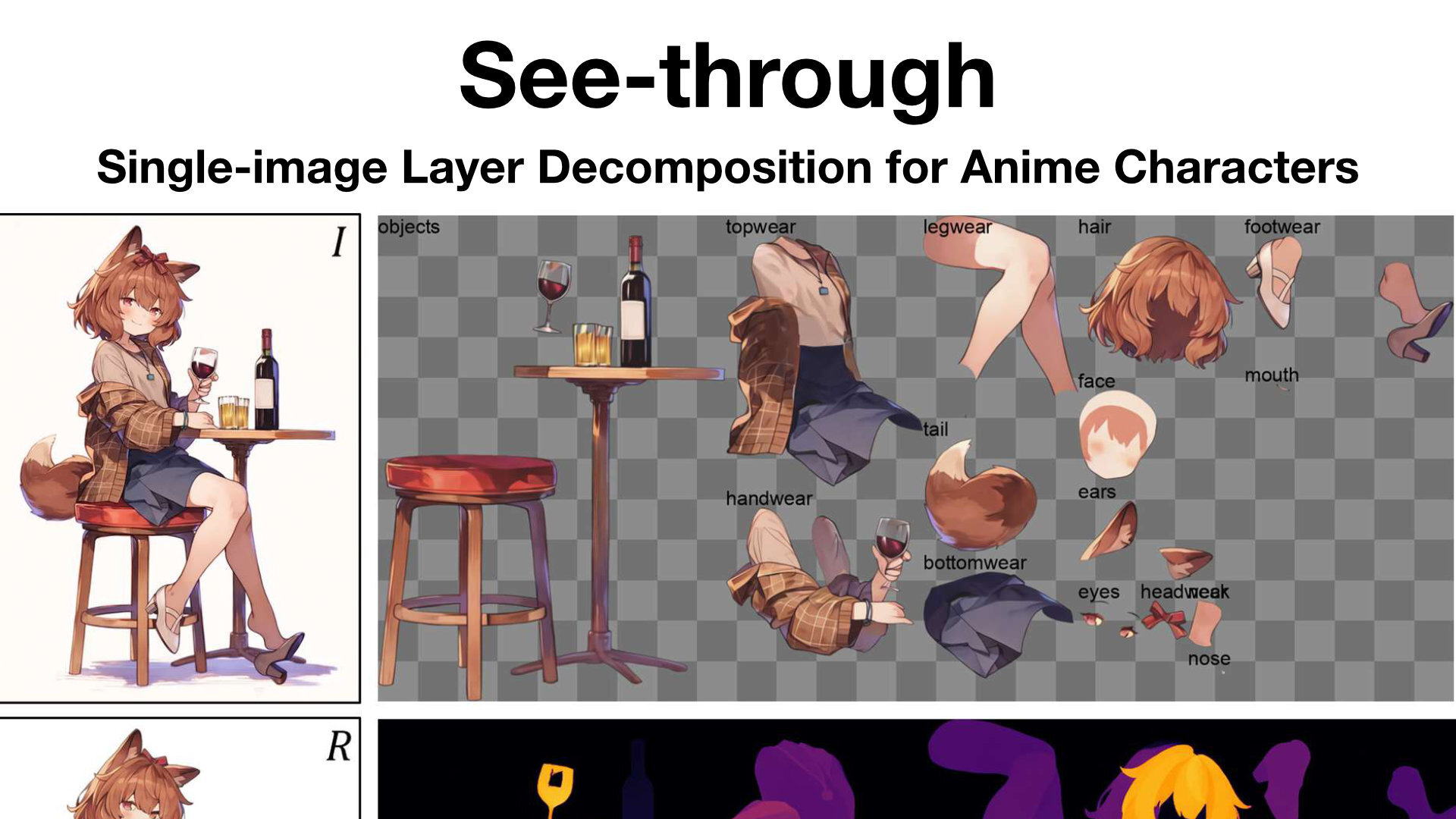

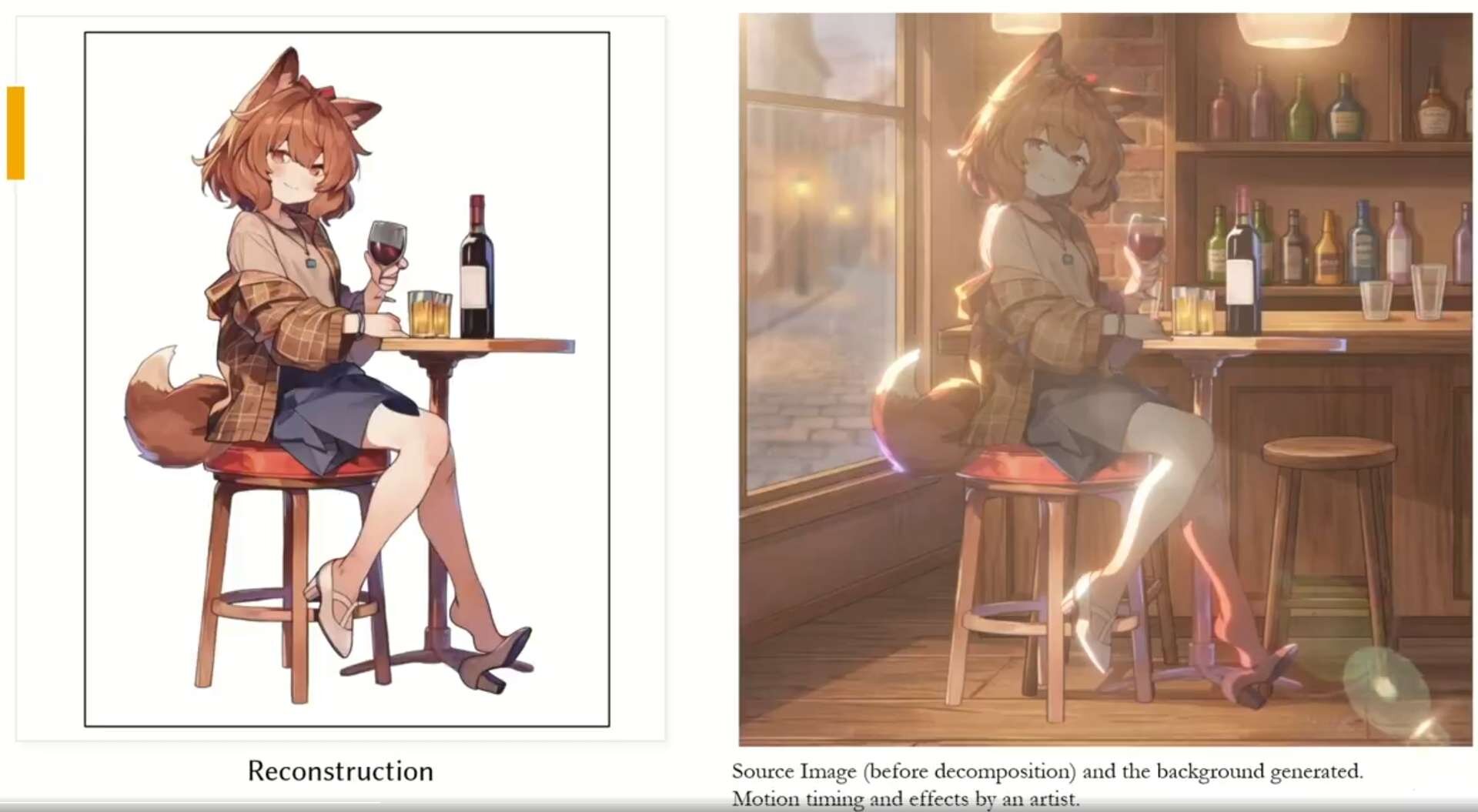

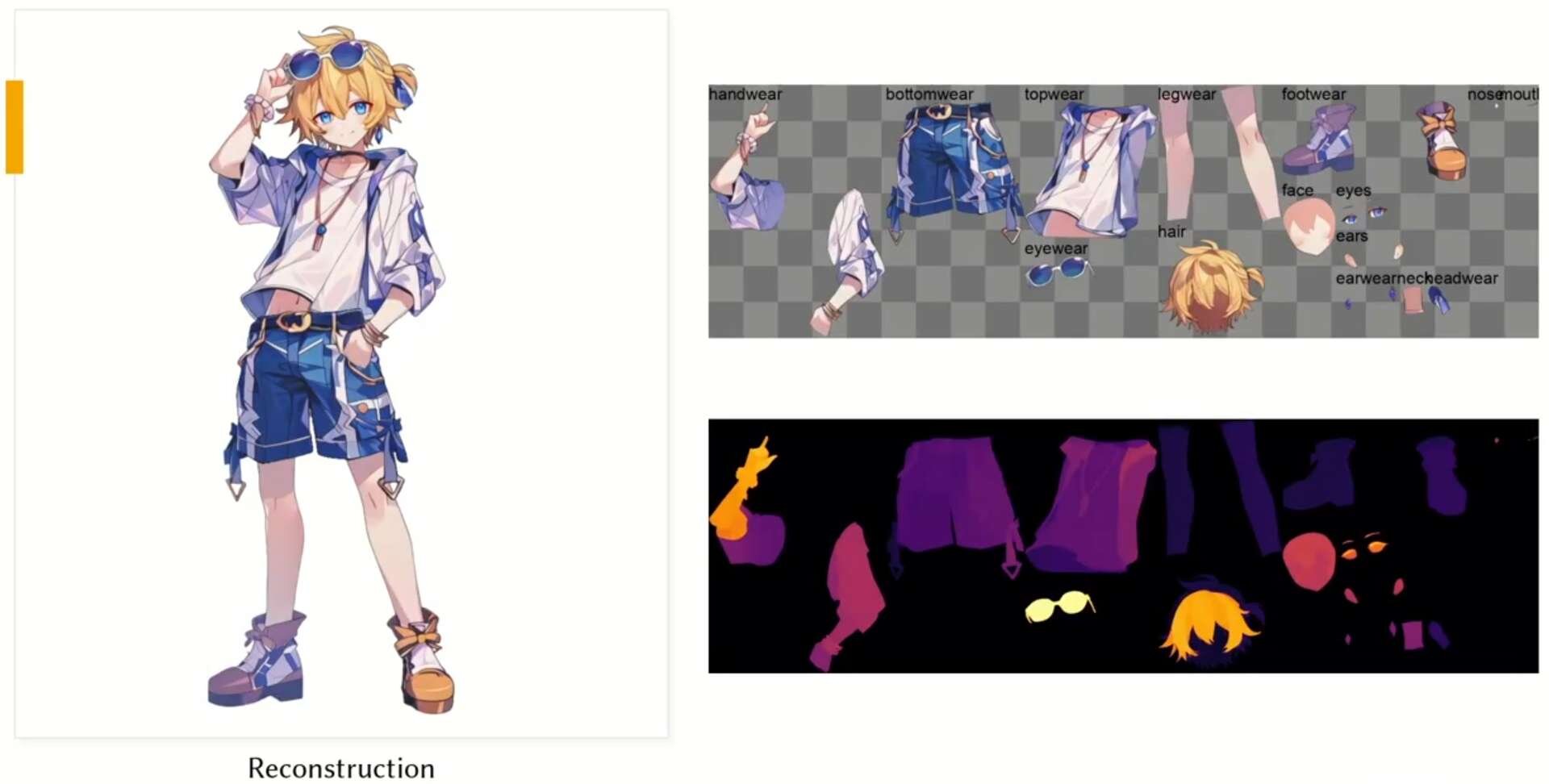

セント・フランシス大学、ペンシルベニア大学の研究チームとSpellbrushは3月31日(火)、1枚のアニメイラストからキャラクターを自動でパーツごとに分割し、重なり合う部分を補完してレイヤー構造を持つPSD形式の画像ファイルを出力する技術「See-through」をオープンソース化(Apache-2.0ライセンス)した。隠れた部分のピクセルを推測して描き足す機能や、奥行きの順序を自動で整理する機能が実装されている。

We're reintroducing and open-sourcing project "See-through". Given a single anime illustration, it automatically decomposes the character into fully-inpainted semantic layers with depth ordering. One image in, layered PSD out. (1/n)

— 李萌萌 (@ljsabc) March 31, 2026

Repo:https://t.co/w5oB45ljcI pic.twitter.com/pSO3jdze14

We're reintroducing and open-sourcing project "See-through". Given a single anime illustration, it automatically decomposes the character into fully-inpainted semantic layers with depth ordering. One image in, layered PSD out.

Under the hood: a diffusion-based body part consistency module (built on SDXL), paired with pixel-level pseudo-depth fine-tuned on Marigold.

It automatically resolves interleaving structures like overlapping hair strands, accessories behind hair, clothing layers, etc.

Is this Image-to-Live2D? Not really. Live2D needs artistic decomposition choices + rigging.

We only automate segmentation and occlusion inpainting. But it's a solid starting point that may save plenty of manual work.

Looking for community contributions — ComfyUI nodes, Colab notebooks, workflow integrations. PRs welcome, we'll feature your work. Enjoy!

Finally, props to Lvmin Zhang. He is a legend. Honestly, without his work I might have lost all motivation to pursue this direction.プロジェクト「See-through」を改めて紹介し、オープンソース化します。1枚のアニメイラストから、キャラクターを自動的に分解し、深度を保持したまま、裏側まで完全に補完されたレイヤーを生成します。1枚の画像を入力するだけで、レイヤー分けされたPSDが出力されます。

内部の仕組みとしては、SDXLをベースにした拡散モデルによる「身体パーツ一貫性モジュール」に、Marigoldで微調整を行った「ピクセルレベルの疑似深度モデル」を組み合わせています。

これにより、重なり合う髪の毛の束や、髪の後ろにあるアクセサリー、衣服の重なりなど、複雑に交差する構造を自動的に解決します。これが「画像からLive2Dへの完全自動変換」かというと、そうではありません。Live2Dには、アーティストの意図を反映したパーツ分割と、リギングが必要だからです。

私たちが自動化したのは、あくまでセグメンテーションとオクルージョン・インペインティング(隠れた部分の描き足し補完)のみです。それでも、膨大な手作業を省くための、確かな第一歩になるはずです。コミュニティからのコントリビューションもお待ちしています。ComfyUIノード、Colabノートブック、既存ワークフローへの統合など、プルリクエストは大歓迎です。皆さんの素晴らしい成果はこちらでも紹介させていただきます。ぜひ活用してみてください!

最後に、Lvmin Zhang氏に最大限の敬意を。彼はレジェンドです。正直なところ、彼の功績がなければ、このアプローチを追求するモチベーションを完全に失っていたかもしれません。

「See-through」は、1枚のアニメ風イラストを入力するだけで、キャラクターを構成する各パーツを自動的に認識して分割する。単に画像を切り抜くだけではなく、前髪に隠れた瞳や衣服の重なりなど、元の画像では見えない部分のピクセルを推測して描き足す隠蔽部分の補完(Occlusion Inpainting)を自動で行う。処理された画像は、深度情報に基づいて奥から手前へと順序立てられ、完全に補完されたセマンティック(意味的)なレイヤー構造を持つPSDファイルとして出力される。

内部的には、画像生成AI「Stable DiffusionXL(SDXL)」を基盤として開発された、各部位の形状や特徴を保つ身体パーツ一貫性モジュール(Body Part Consistency Module)を採用。これに加えて、ピクセル単位で画像の奥行きを精密に推定する技術「Marigold」を微調整した疑似深度(Pseudo-depth)モデルを組み合わせている。これにより、交差する髪の毛束や、髪の裏側にある装飾品、衣服の多重レイヤーといった複雑な交差構造を正確に分離・解決する。

■See-through: Single-image Layer Decomposition for Anime Characters(GitHub)

https://github.com/shitagaki-lab/see-through

■See-through: Single-image Layer Decomposition for Anime Characters(Hugging Face)

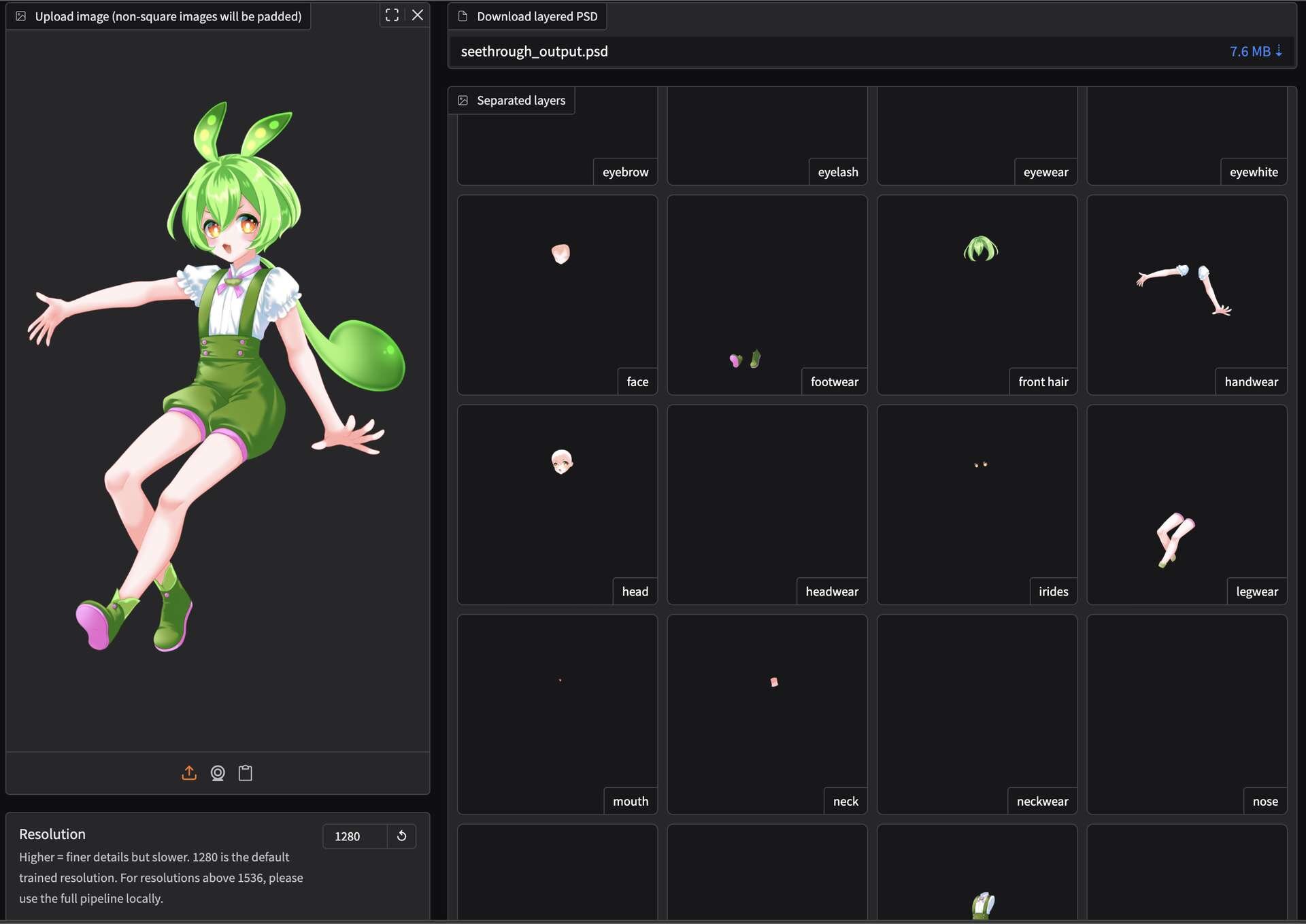

https://huggingface.co/spaces/24yearsold/see-through-demo

有志による活用例も公開

「See-through」の公開を受け、コミュニティの有志による派生ツールの開発も活発化している。

ビームマンP(BeamManP)氏は4月5日(日)、複雑な環境構築を必要とせず、ブラウザ上で直感的に本技術を試すことができる「See-through WebUI」を公開した。動作にはGeForce RTX 2060以上が必須となる。同ツールはオープンソース(Apache-2.0ライセンス)で公開されている。

今話題の、イラスト1枚を各パーツに分解してpsd出力してくれる「See-through」を比較的手軽に試せるWebUIを作りました。色々めんどくさそうな環境構築もたぶんきっと簡単…なハズ(動作はRTXの2060以上必須)https://t.co/INSr5SVT7i pic.twitter.com/TQMNTCFtLl

— ビームマンP ver40 (@BeamManP) April 5, 2026

また、カズヤ弟(kazuya-bros)氏は4月8日(水)、「See-through」から出力されたPSDファイルと元の画像を組み合わせ、同氏開発のノベルゲーム向け会話ツール「SpriTalk」用の立ち絵素材を自動生成するアプリ「PachiPakuGen」を公開した。オープンソース(MITライセンス)で公開されている。

「PachiPakuGen」は、任意の物体を高い精度で切り抜くことができるMeta社のセグメンテーションAI「SAM3」を用いて、「See-through」で不便だった首回りの処理や、過剰に描き足されてしまう口部分の形状を自動で削り取り、適正な形に修正する機能を搭載している。さらに、動画のコマとコマの間を推測して滑らかにするフレーム補間技術「RIFE(Real-Time Intermediate Flow Estimation for Video Frame Interpolation)」を活用することで、口パクや瞬きを自然なアニメーションとして出力できる。

See-Throughから出力したPSDファイルと元画像を渡すと、SpriTalk用の素材画像が出力できる「PachiPakuGen」公開しました。

— カズヤ弟 (@dodo_ria) April 7, 2026

地味にSee-Throughで不便だった首部分と、アウトペイントされすぎな口部分をSAM3を使って削っているのと、… https://t.co/cEA67A03C0

■PachiPakuGen(GitHub)

https://github.com/kazuya-bros/PachiPakuGen

CGWORLD関連情報

●オープンソースのAviutl2プラグイン「SAM3 BB/GB Generator」リリース! SAM 3を活用し、クリックするだけで動画から簡単にオブジェクトを切り抜き

クリーニング氏が動画編集ツール「AviUtl2」向けのオブジェクト切り抜きプラグイン「SAM3 BB/GB Generator(1クリック動画切り抜き)」v0.0.8をGitHubで公開。Metaが開発したセグメンテーションモデル「SAM 3(Segment Anything Model 3)」を用いて、マウスクリックなどの直感的な操作のみで、動画内の特定の部分を簡単に切り抜くことができる。本ツールはオープンソース(MITライセンス)で提供されている。

https://cgworld.jp/flashnews/01-202604-SAM3BBGBGen.html

●Metaの3D生成AI技術「SAM 3D」発表! 単一の2D画像から精密な3Dオブジェクトや人物を再構築、GitHubとHugging Faceでコード&データ公開

Metaが画像セグメンテーションAIの最新モデル「Segment Anything Model 3(SAM 3)」と、単一画像から3Dモデルを再構築する「SAM 3D」を発表。ソースコードはGitHubで公開されているが、独自ライセンスによって「SAM 3」基盤モデル、「SAM 3D Body」、「SAM 3D Objects」が明確に区分されている。データセットはHugging Faceで公開されているほか、同社AI技術のプレイグラウンド「Meta AI Demos」ではブラウザ上でSAM 3Dをテストできる。

https://cgworld.jp/flashnews/01-202511-Meta-SAM3D.html

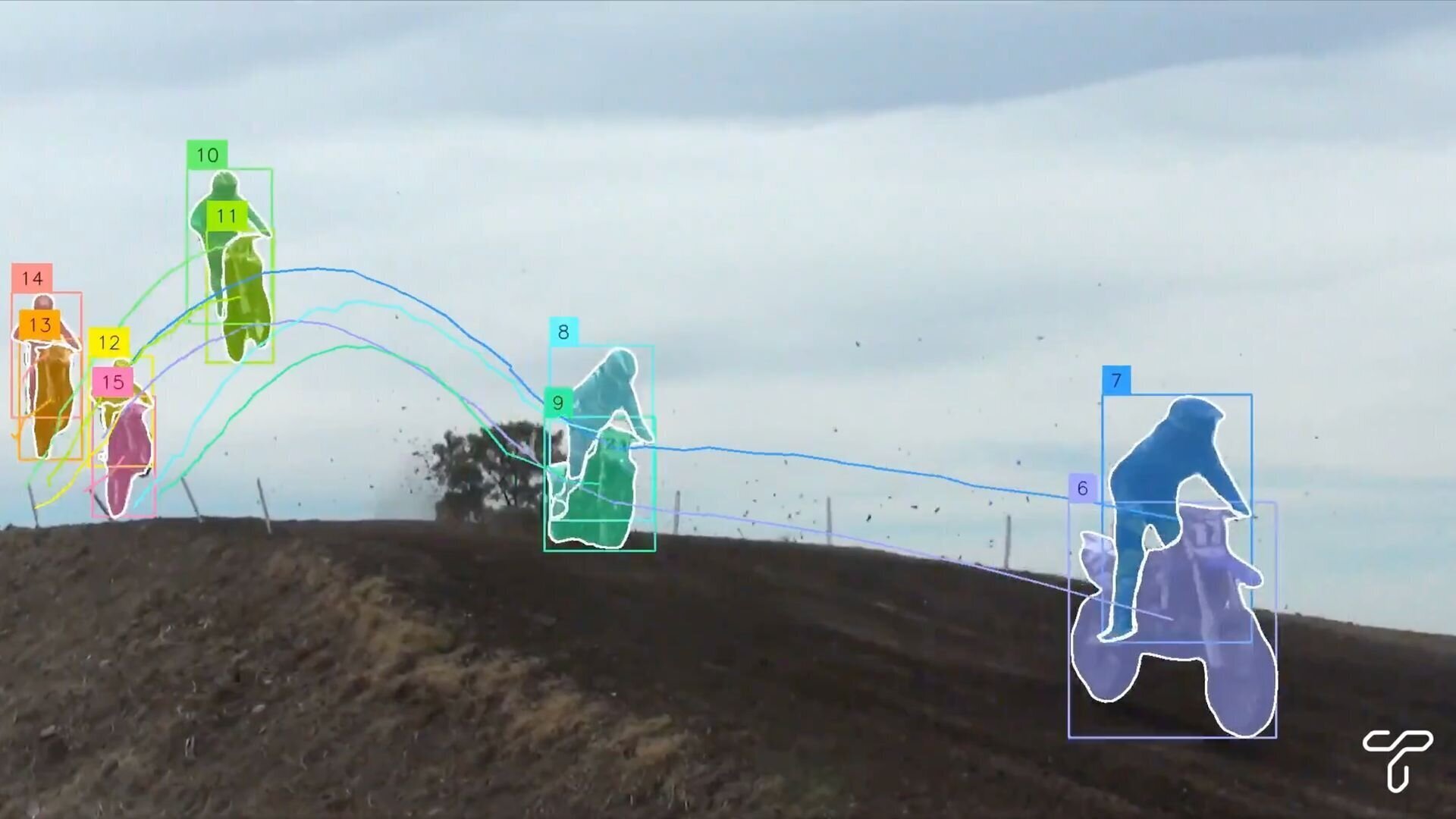

●オープンソースのモーショントラッキングツール「trackers v2.1.0」リリース! ByteTrackサポート、セグメンテーションモデルRF-DETRとの連携

Roboflowがオープンソース(Apache-2.0ライセンス)のモーショントラッキングツール「trackers v2.1.0」をリリース。本アップデートでは、高速かつ遮蔽に強い追跡アルゴリズム「ByteTrack」のサポートが追加された。また、Roboflow社のセグメンテーションモデル「RF-DETR」ともシームレスに連携が可能。

https://cgworld.jp/flashnews/01-202602-trackers.html