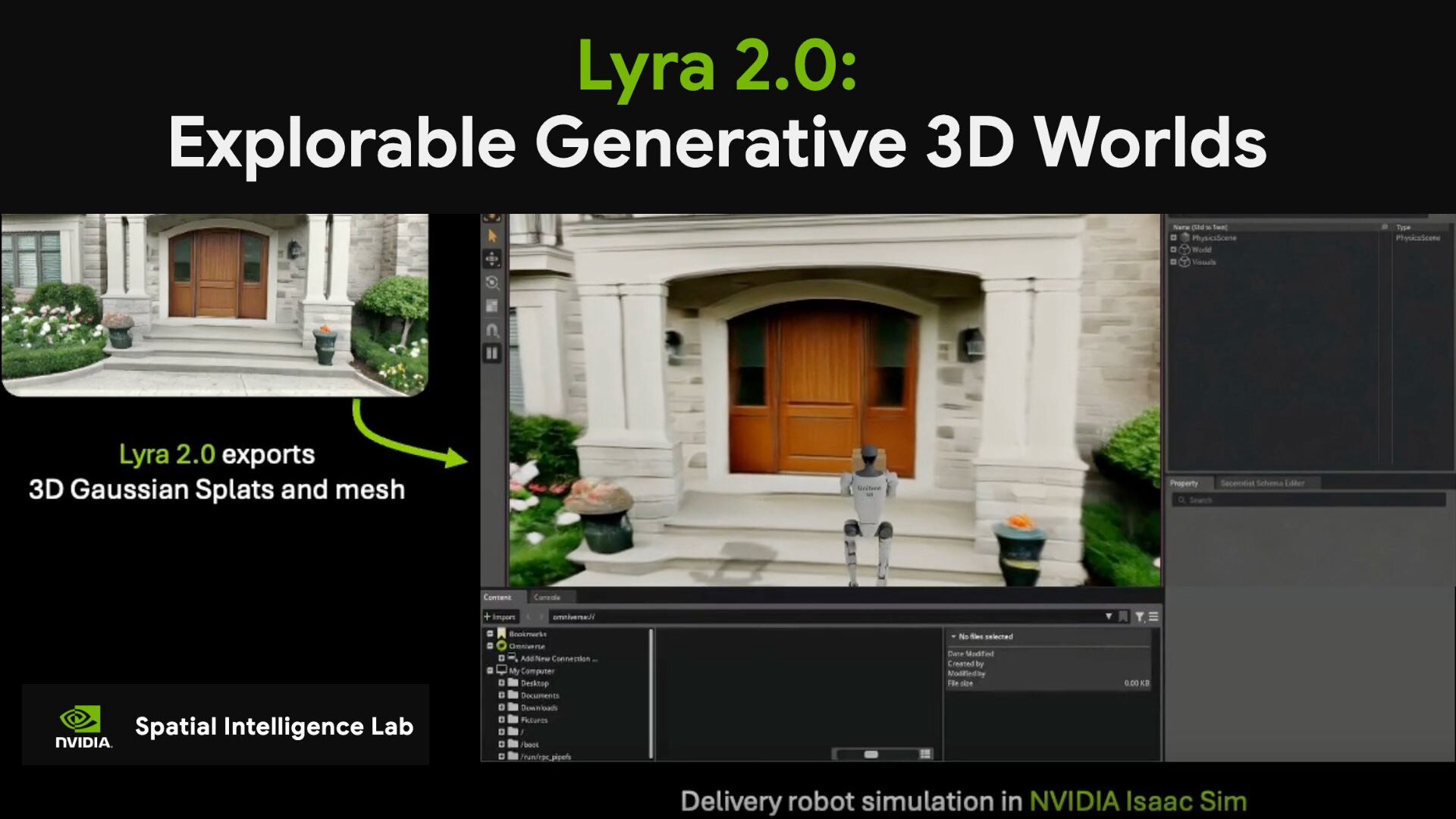

NVIDIAのSpatial Intelligence Lab(SIL)は4月16日(木)、探索可能な生成3D世界を構築する新たなAIフレームワーク「Lyra 2.0」を発表した。カメラ操作の可能なウォークスルー動画を生成し、フィードフォワード再構成技術によって3D空間を生成することで、大規模で複雑な3D環境の構築を実現する。ソースコードはApache-2.0ライセンスでGitHubにて、モデルはNVIDIA Internal Scientific Research and Development Model License(非商用の研究開発用途限定)でHugging Faceで公開されている。

Today, we released Lyra 2.0, a framework for generating persistent, explorable 3D worlds at scale, from NVIDIA Research.

— NVIDIA AI Developer (@NVIDIAAIDev) April 15, 2026

Generating large-scale, complex environments is difficult for AI models. Current models often “forget” what spaces look like and lose track of movement over… pic.twitter.com/l6oTNMl5mV

「空間的忘却」と「時間的ドリフト」を克服するLyra 2.0の仕組み

3Dシーン生成技術においては、大規模で複雑な環境を構築する際の「空間的忘却(Spatial forgetting)」と「時間的ドリフト(Temporal drifting)」による品質劣化が課題となっている。

空間的忘却とは、カメラが仮想空間内を長時間移動・探索するうちに、AIモデルのコンテキスト(一度に処理・記憶できる情報量)の上限を超え、過去に描画した領域の情報が抜け落ちてしまう現象。そのため、空間の辻褄を合わせることができず、以前とは全く異なる構造物や風景をその場で捏造(ハルシネーション)して生成してしまう。

時間的ドリフトとは、動画のフレームを連続して生成していく過程において、各フレームの生成時に生じるごく微小な誤差が、時間の経過とともに雪だるま式に蓄積していく現象。動画生成モデルの多くは、過去の出力結果を基にして次のフレームを予測する自己回帰(Autoregressive)モデルを採用しているため、一度生じた小さなノイズや歪みが次のフレームに引き継がれ、さらに増幅されてしまう。

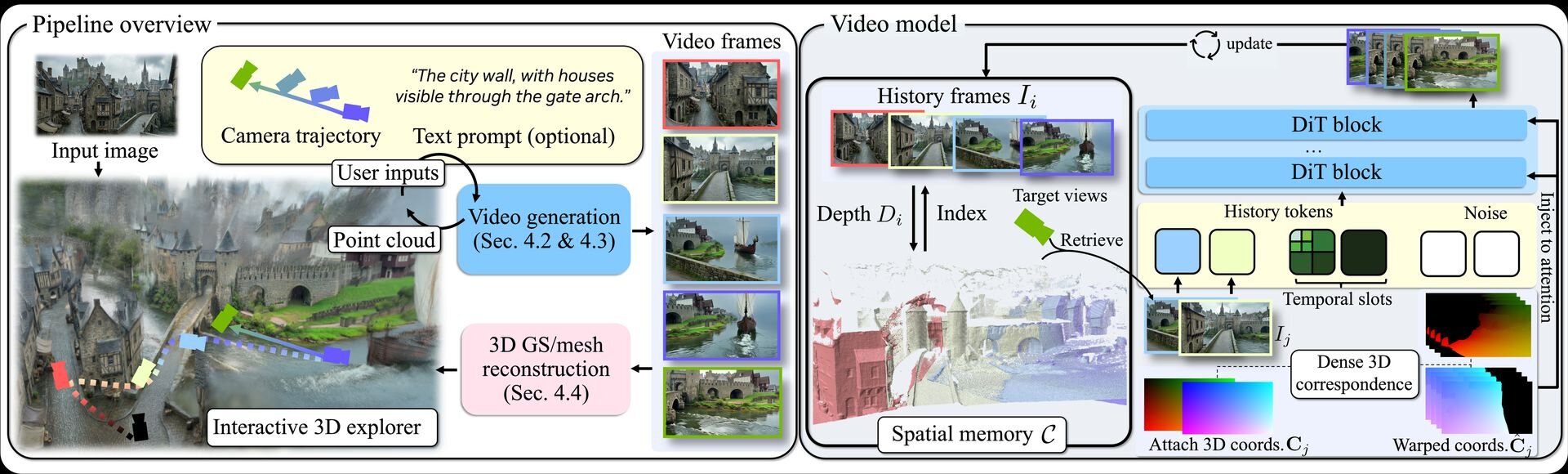

「Lyra 2.0」は、大規模で持続的な3D世界を生成するためのフレームワークとして、これらの劣化現象に対処している。空間的忘却を防ぐため、各フレームのジオメトリを維持し、それを過去の関連フレームの検索と視点との高密度な対応付けを行う「Information routing(情報ルーティング)」としてのみ活用し、見た目の合成には生成AIの事前知識(Generative prior)を利用する。

そして、時間的ドリフトに対しては、モデル自身が生成した劣化した出力をあえて学習履歴に含める「Self-augmented training(自己拡張学習)」を導入。これにより、モデルは誤差をそのまま伝播させるのではなく、自らドリフトを修正するように学習し、長時間のカメラ軌跡でも3Dとして一貫性のある動画生成を可能にする。

物理シミュレーション対応とEmbodied AIへの拡張性

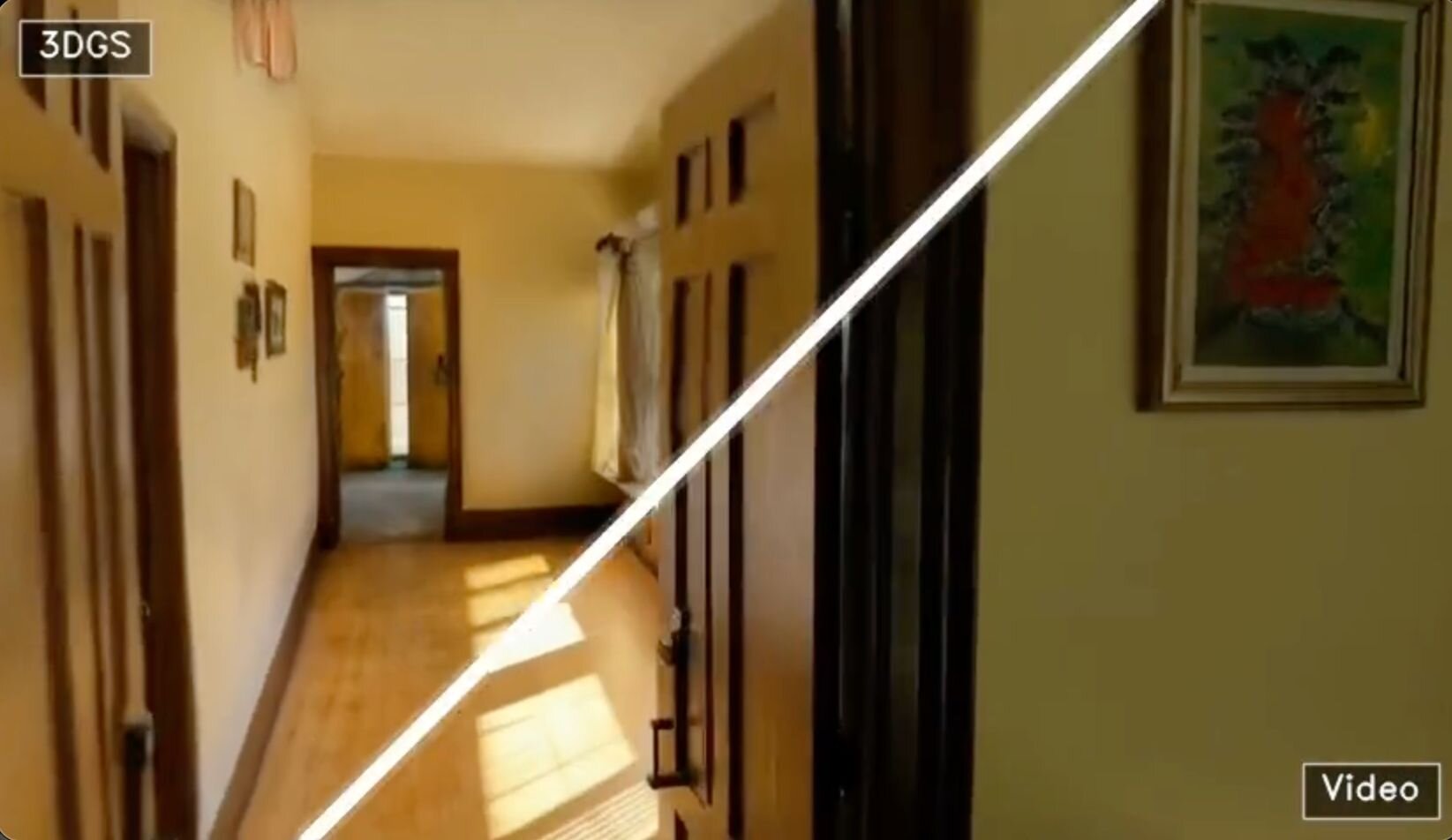

Lyra 2.0で生成された動画は、フィードフォワード再構成(Feed-forward reconstruction、追加の最適化なしに一度の処理で3Dデータを構築する手法)モデルの微調整に活用され、最終的に3DGS(3D Gaussian Splatting)や3Dメッシュとして高品質なシーンを出力する。

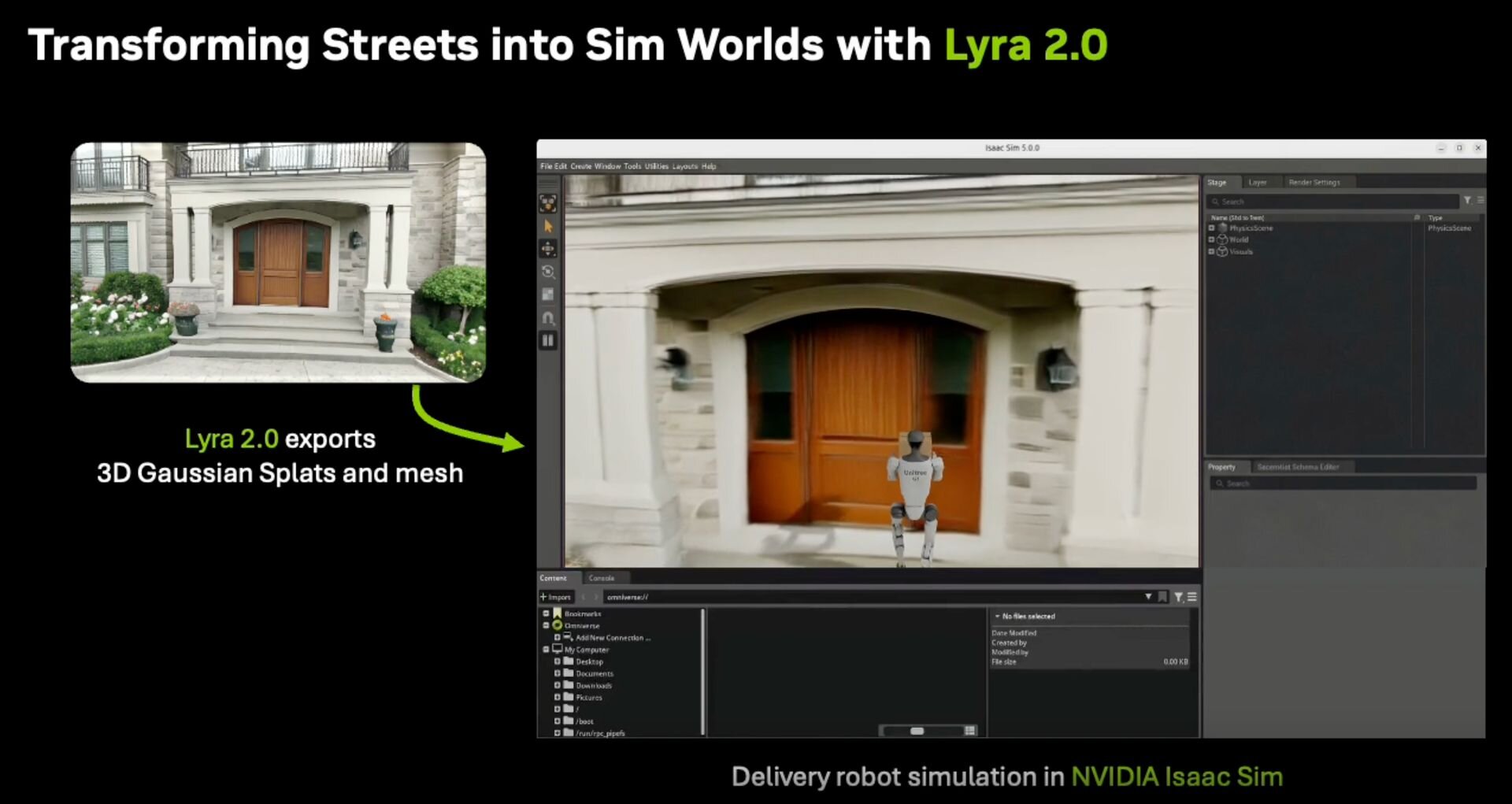

提供されるインタラクティブなGUIを用いることで、ユーザーは蓄積された点群(ポイントクラウド)を視覚化し、カメラの軌跡を計画して未知の領域を探索したり、過去の領域を再訪できる。また、生成された3Dシーンは物理エンジンへ直接エクスポート可能。公式デモでは、スケーラブルなEmbodied(身体性)AIシミュレーションへの適用例として「NVIDIA Isaac Sim」に取り込み、物理的根拠に基づいたロボットのナビゲーションやインタラクションを行う様子が公開されている。

■Lyra 2.0: Explorable Generative 3D Worlds(プロジェクトページ)

https://research.nvidia.com/labs/sil/projects/lyra2/

■Lyra 2.0: Explorable Generative 3D Worlds(arXiv)

https://arxiv.org/abs/2604.13036

■Project Lyra: Open Generative 3D World Models(GitHub)

https://github.com/nv-tlabs/lyra

■Lyra 2.0: Explorable Generative 3D Worlds(Hugging Face)

https://huggingface.co/nvidia/Lyra-2.0

CGWORLD関連情報

●World Labs、Web向け3DGSストリーミングLoDシステム「Spark 2.0」リリース Three.jsを基盤に構築、オープンソース

World LabsがWebブラウザ上で動作する動的な3DGS(3D Gaussian Splatting)レンダラ「Spark 2.0」をリリース。新たにLoD(Level-of-Detail)システムとストリーミング機能が導入され、巨大な3Dワールドを最適化し、あらゆるデバイスへ高品質にストリーミングするための高度なシステム設計を備える。GitHubでオープンソース(MITライセンス)として提供されている。

https://cgworld.jp/flashnews/01-202605-Spark20.html

●Niantic Spatial、空間知能プラットフォームの新「Scaniverse」リリース iOS&PC対応、一度のキャプチャでVPSマップとメッシュと3DGSを同時生成

Niantic Spatialが従来から提供してきた「Scaniverse」を刷新し、ビジネス向け空間インテリジェンスサービスの入口となるプラットフォームとして新たに提供を開始。併せて、事前の空間スキャンなしで機能するグローバル規模の視覚測位システム「VPS 2.0」と、各種プラットフォームに対応する開発キット「NSDK 4.0」もリリースした。

https://cgworld.jp/flashnews/01-202604-Scaniverse.html

●「OpenUSD v26.03」リリース 3DGSのネイティブサポート、テスト用レンダラ同梱によりusdview内で表示確認可能

AOUSD(Alliance for OpenUSD)が3Dシーン記述フレームワークOpenUSDの最新バージョン「OpenUSD v26.03」をリリース。本アップデートでは3D Gaussian Splats(3DGS)のネイティブサポートや、Webブラウザでの実行を可能にするWebAssemblyへの対応が追加。また、データ処理エンジンの改良や描画性能の向上などの機能強化も施されている。

https://cgworld.jp/flashnews/01-202604-OpenUSDv26.03.html