2022年3月21日(月・祝)から24日(木)、NVIDIAによる開発者会議「GTC 2022」が開催された。同会議では最新AI技術に関する様々なプレゼンが実施。この記事では、そうしたプレゼンのなかからエンタメとアートに関わるものを紹介する。

AIが生成するキャラクターの感情表現

スクウェア・エニックス所属のEdgar Handy/エドガー・ハンディ氏は、「スタイル転移とニューラル音楽作曲によるAIキャラクターの感情表現」と題したプレゼンを行なった。RPG等に登場するNPCは、シーンに合わせて感情を伴ったリアクションを行うのが一般的だ。こうしたリアクションは事前に出現するルールが定義されており、そのルールはビヘイビアツリーを用いて記述される。AI技術が進化した近年では、AIがリアクションを生成することで、より柔軟な感情表現を実現することが試みられている。

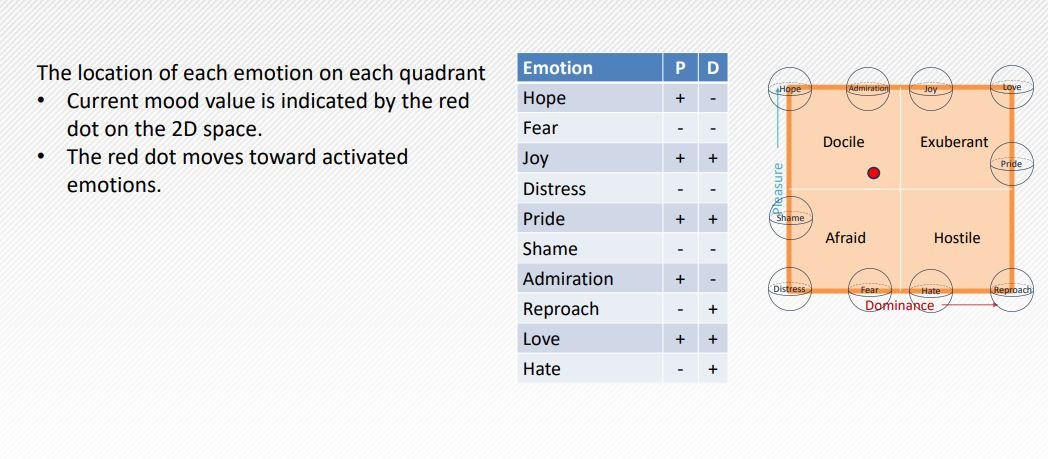

AIによる感情表現に取り組んでいるハンディ氏は、まず感情を定義することから始めた。感情を定義するにあたり、縦軸の上方ほど肯定的な感情を表し、横軸の左側ほど受動的な感情で右側ほど能動的なそれとなる座標軸を作成。この感情の座標軸に主要な感情をプロットして、感情相互の関係を明確化した。

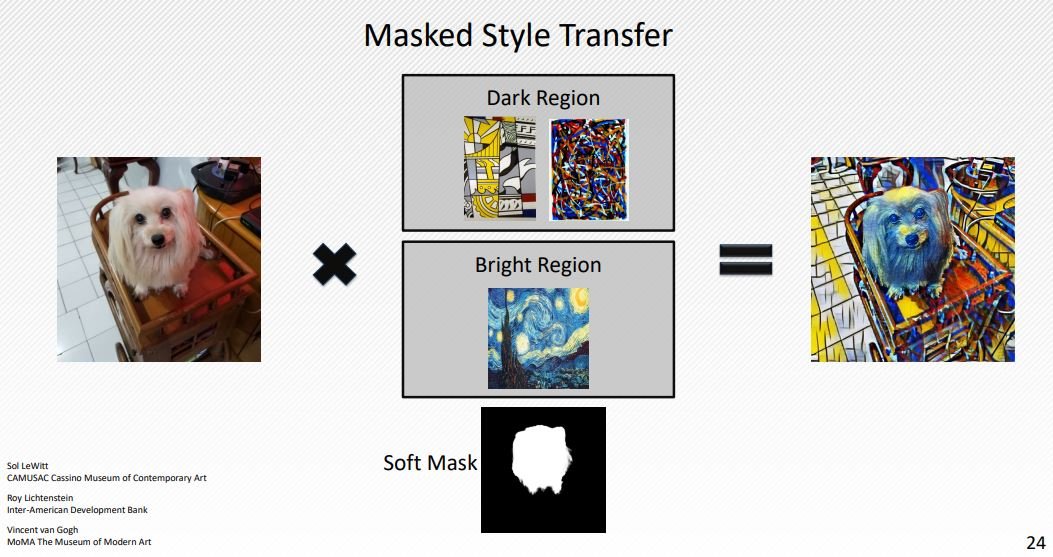

次いで任意の感情に合わせて、NPCのグラフィックを変える方法が解説された。感情に合わせたグラフィック生成に活用されるのが、Neural Style Transferだ。これは、任意の画像を入力として与えると、特定の特徴をもった画像と合成して新たな画像を出力するAIである。このAIを使うと、例えばNPCの画像と悲しいトーンの画像を合成して、NPCの悲しい感情表現を生成できる。ハンディ氏が実際に活用したのは、明るい領域と暗いそれに別個の画像を合成できるMasked Style Transferだった。

任意の感情に合わせた曲調の楽曲を生成するAIについても解説された。そうしたAIのしくみは、以下の図のように音符などの任意の音楽情報を入力すると、特定の感情に合うように音符を生成し続けるというもの。この楽曲生成AIは、27,000曲のクラシック音楽とフォークミュージックから音楽による感情表現を学習した。

以上のようなAIによる感情表現は、従来のルールベースのそれに比べて柔軟かつニュアンスに富んだ表現が可能となる。こうした技術は、豊かな感情表現が求められるRPG等に実装されていくことだろう。

既存の画像をAIが新たなビジュアルに変換

メディアアーティストのRefik Anadol/レフィーク・アナドール氏は、「機械の心のなかの芸術」と題したプレゼンでAIを活用した自作のアート作品を紹介。8歳の時に映画『ブレードランナー』を鑑賞してきらびやかな街並みに魅了された同氏は、建物に投影するプロジェクションマッピングの制作からアーティスト活動を始めた。ディープラーニング系AIが普及しつつあった2016年、同氏はAIの演算能力に可能性を感じてAIアーティストとしてのキャリアをスタートさせたという。

アナドール氏が制作するAIアート作品は、SNS画像のようなオープンにアクセス可能なデータに対して、データ間の類似性や自然現象といったエッセンスを加味してAIが処理した結果を可視化したもの。プレゼンでは多数の作品が紹介されたが、以下では代表的なものを取り上げる。

アメリカ・ニューヨークで2019年9月から2020年2月まで展示された『Machine Hallucination(機械の幻覚)』は、同市で撮影された1億枚以上のSNS画像から1025の特徴をAIによって抽出したうえで、その特徴に基づいてマッピングしたものだ。16K画質の30分間の映像となった同作品は、同市の集合意識とでも呼べるものを未来的なビジュアルで表現している。

ドイツ・ベルリンで2021年11月から12月まで展示された『Machine Hallucinations — Nature Dreams(機械の幻覚 ― 自然の夢)』は、アナドール氏が率いる制作チームが収集した3億枚以上の自然に関する画像を学習データとして、GAN(敵対的生成ネットワーク)が生成するビジュアルを可視化したものだ。GANを使うと任意の画像に特定の特徴を加味できるのですが、この作品では流体力学や量子コンピューティングのシミュレーションが視覚的に取り入れられている。

2021年9月から10月まで香港で展示された『Machine Hallucinations — Space : Metaverse NFT Collection(機械の幻覚 ― 空間:メタバースNFTコレクション)』は、国際宇宙ステーション、ハッブル望遠鏡、火星探査機が撮影・記録した200万枚以上の画像を学習データとして、GANが生成した画像をアート作品として可視化した作品。なお、タイトルのメタバースは今日使われる仮想空間の名称というより、「Universe(宇宙)」を超えたもの、という意味で解釈するのが適切だろう。

既存の画像をAIによってまったく新しいビジュアルに変換するアナドール氏のアート作品には、大きな発展の余地がある。また、同氏に影響された新たなAIアーティストが誕生する可能性も大いにあることだろう。

実用性から解放された画像生成

アメリカ・ノースイースタン大学でデータビジュアライゼーションについて研究しているJane Adams/ジェーン・アダムス氏は、「アーティスティックなワークフローにおける機械学習の活用」と題したプレゼンでクリエイティブな画像生成に関するテクニックについて解説した。

プログラマーではなくアーティストを自認するアダムス氏によると、プログラマーとアーティストのちがいは、前者が実用性を重視するのに対して、後者は実用性だけではなく美的感覚や好奇心に重きを置くことにあるという。アーティストたる同氏は、一般的なAIによる画像生成プロセスにあえて変更を加えたりすることで、予想もつかなかった画像を得るテクニックを発明してきた。以下では、同氏が解説したテクニックの一部を紹介する。

画像生成AIが画像を生成する際には、大量の画像を学習する。そして、学習から得られた画像の特徴が反映しているような画像が生成される。こうした画像生成プロセスで問題となるのが、望んでいる特徴をもった大量の画像をなかなか収集できないことだ。例えば、アダムス氏は鉢植えに生えた植物の画像を生成しようとしたとき、植物の画像と鉢植えのそれはあるものの、その両方が写っている画像があまりないことに気づいた。そこで同氏は、植物の画像と鉢植えのそれを素材として、鉢植えに生えた植物の画像を自作。学習データを自作すれば、求めている特徴をAIが学習できるようになる。

画像生成AIが学習するデータには、複数の特徴が認められるのが一般的だ。それらの特徴のうち注目する特徴が異なると、異なる画像生成AIが完成する。アダムス氏は、注目する特徴を意図的に変えることで、様々な画像生成AIを開発することに成功した。例えば、植物の葉に関する学習画像データセットに対して、葉の模様に注目するようにして学習を進めると、キャンディや布のレースに関する画像を生成するAIが完成する。葉についている水滴に注目すると、窓についた水滴に関する画像を生成するAIになる。このように学習プロセスに介入することで、異なる画像を生成するAIとなるのだという。

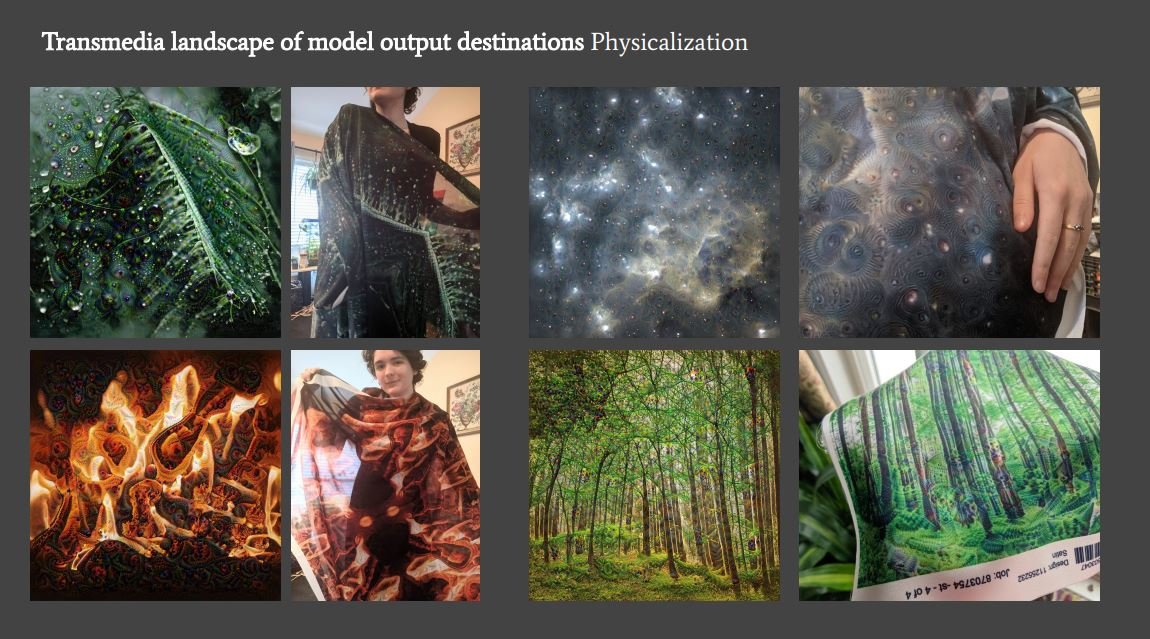

AIが生成した画像は、ディスプレイに出力されることがほとんどだ。こうしたなか、アダムス氏は出力先を様々に変える試みを行なった。例えば、布地に画像を印刷した場合、以下の画像のように非常に神秘的な柄の衣服が完成した。そのほかにも、同氏の顔や教会の壁面に画像を映写したりした。

以上のようにAI技術は、エンタメとアートの分野においてその可能性が様々に探求されている。そして、エンタメ・アート系AI生成コンテンツは日本においても目にする機会が増えることだろう。

TEXT_吉本幸記 / Kouki Yoshimoto

EDIT_小村仁美 / Hitomi Komura(CGWORLD)