ユニティ・テクノロジーズ・ジャパンによるオンラインカンファレンス「SYNC 2022」が、10月25日(火)と26日(水)の2日間行われた。Unityの開発事例や最新技術情報などをテーマにした全67セッションを配信し、その分野はゲーム、映像・アニメ、自動車・輸送、建築・建設、ロボティクスなど多岐に渡った。

本記事では株式会社LATEGRAによるセッション「ライブのノウハウを活用したバーチャルキャラクターライブのカメラと照明の紹介」の模様を一部レポートする。

関連記事

『Enemies』メイキング&スマホゲーム『プリコネ!』におけるURP導入事例~SYNC 2022(1)

プリレンダを得意としてきたCompositionによるバーチャルスタジオ開発&実写ノウハウを活かすStory EffectのUnityアニメ制作事例~SYNC 2022(2)

stuが取り組むライブエンタメ向け技術開発~SYNC 2022(3)

イベント概要

SYNC 2022

開催日時:2022年10月25日(火)~26日(水)10:00~22:00(予定)

開催形式:オンライン(事前登録制)

events.unity3d.jp/sync

ライブのノウハウをバーチャル空間で再現

セッション「ライブのノウハウを活用したバーチャルキャラクターライブのカメラと照明の紹介」には株式会社LATEGRAのテクニカルアーティスト 中村直樹氏が登壇。現実のライブで使われているスタッフや機材を活かして、説得力のある映像を効率的につくる方法を解き明かした。

イベント企画会社のLATEGRAは2022年7月にbilibiliで配信された、中国のボーカロイド・洛天依の生誕10周年記念ライブを制作。企画から演出、システム開発まで全面的に関わった。2時間を超えるライブをHDRPで制作するのは初めての経験だったが、中村氏は「最終的には今までよりひと回り高いクオリティのコンテンツがつくれたのではないか」と手応えを語る。

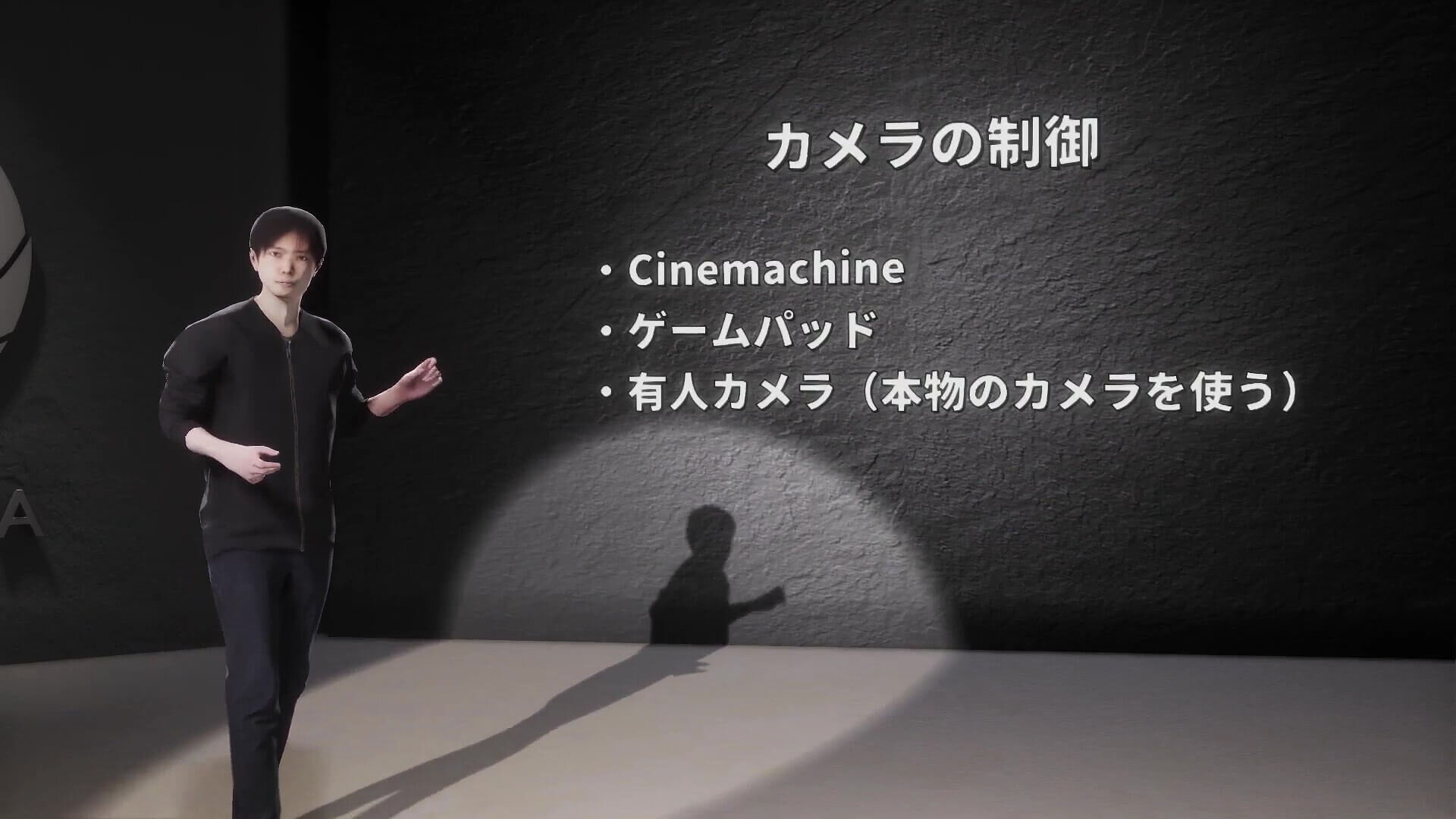

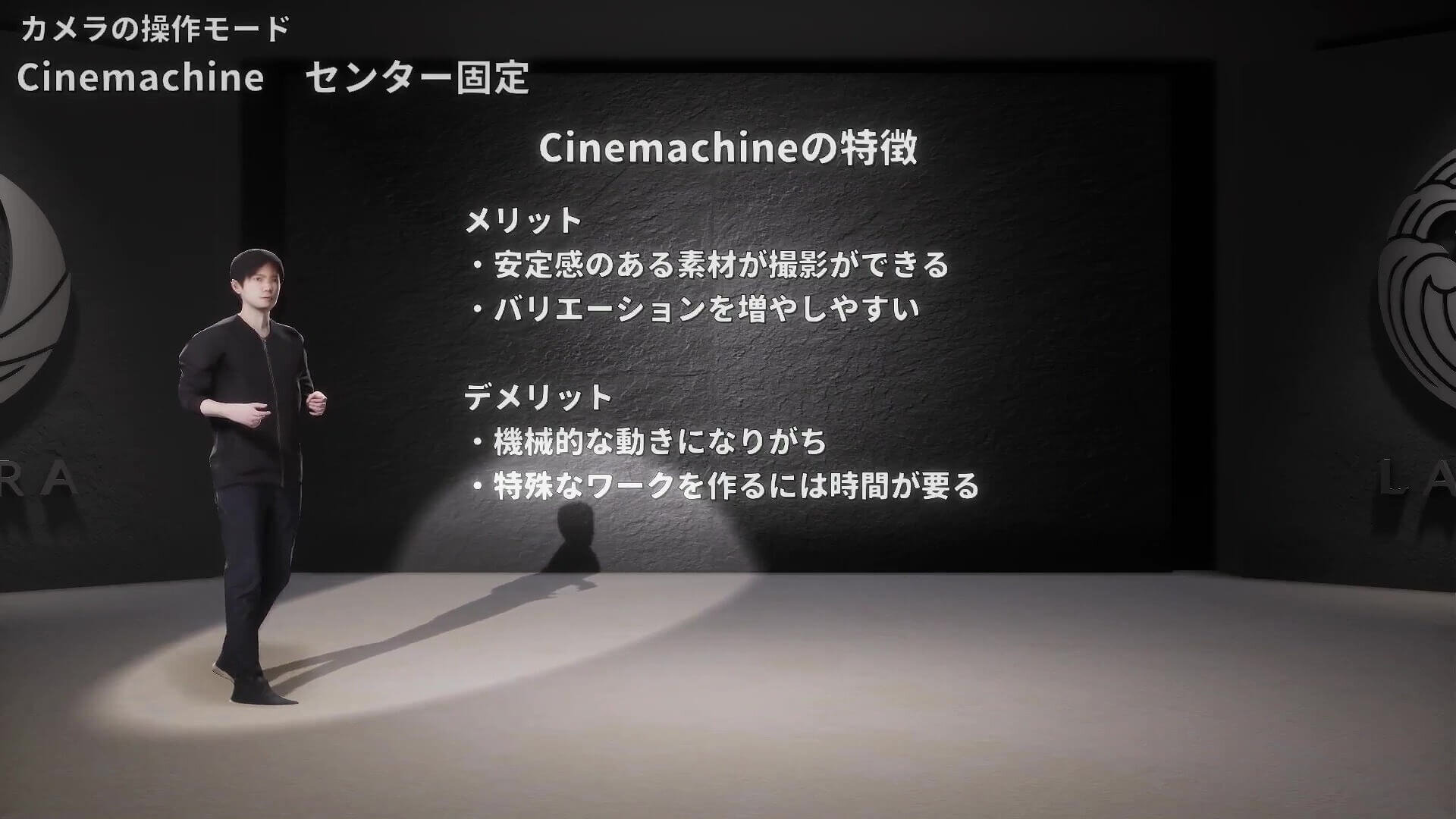

最初はカメラの制御について、UnityのモジュールであるCinemachineを使った効果的なパターンを紹介。例えばステージのセンター後方からカメラを固定したシンプルな構図であっても、FOVの値を2つの間で行ったり来たりする簡単なスクリプトを組めば、ズームアウトとインを繰り返す映像になる。少し動きが生じるだけで印象が良くなるため、ひと工夫するのはオススメだという。

キャラクターを自動で追従するカメラワークの場合は、Damping(遅延)の値を少し大きめに設定するのがポイントだと言う。値を小さくするとタイトに追従して、機械的な動きだという印象を与えてしまうからだ。

カメラはキャラクターのヘッドに追従するため、自然とキャラクターの顔が正面で映っている構図になる。キャラクターライブでユーザーが求めるのは顔が大きく映っている映像なので、そのような素材を確保できる点でも重宝するとコメントした。

続いて、ゲームパッドを使った撮影を実演。この手法のメリットは自由度の高さで、慣れればドローンやクレーンカメラのような動きの大きい撮影も可能だ。しかし操作が難しく、キャラクターのモーションや演出の展開、バーチャル会場の空間を熟知していないと狙った画が撮りにくい。

繊細な動きは苦手なので、魅力的な構図を保ちながらキャラクターを追いかけるといったカメラワークも難易度が高い。どこにでもカメラを動かせるという自由度の高さゆえに、失敗するとカメラが壁や地面にめり込むというミスも起きてしまう。

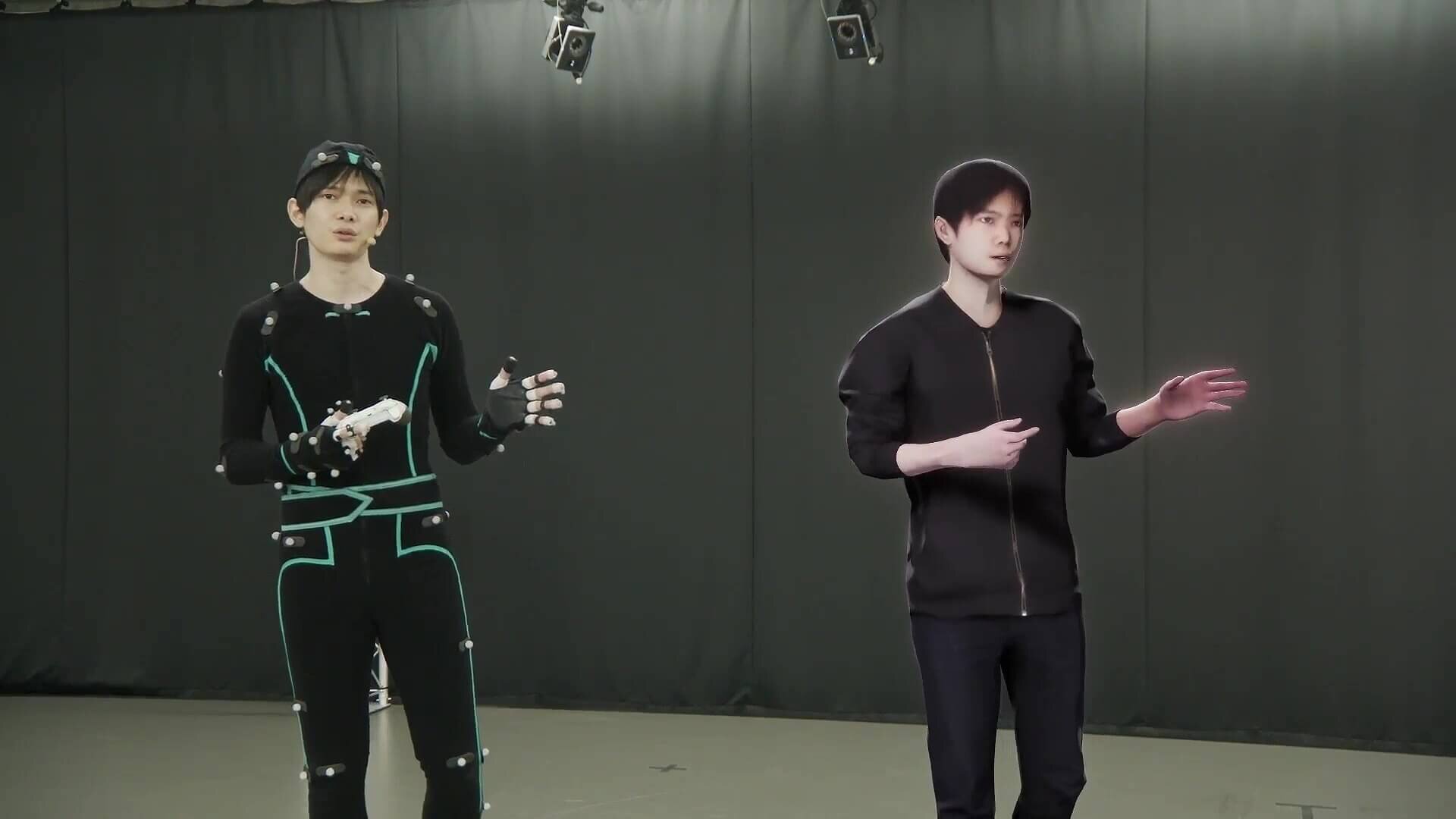

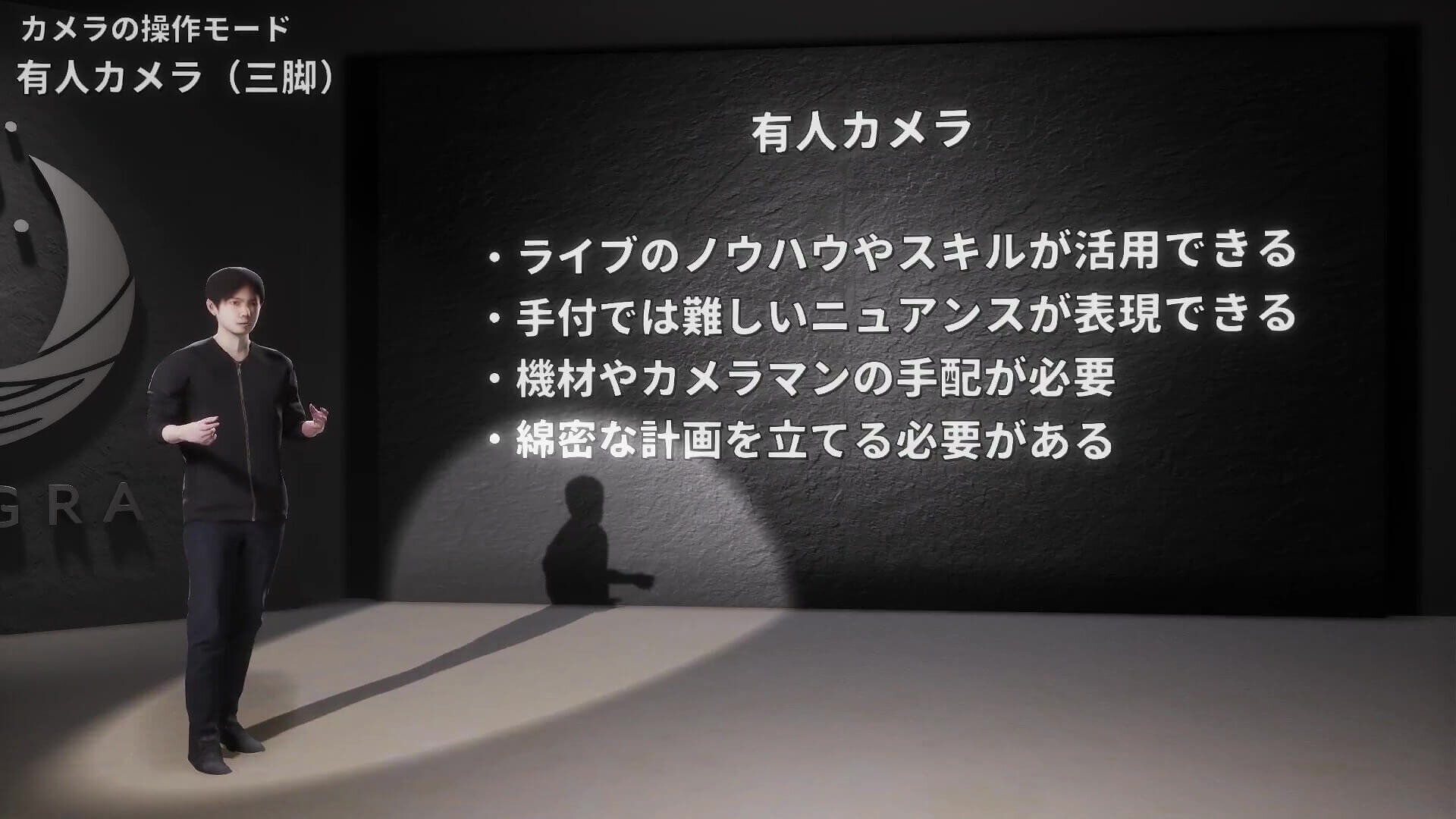

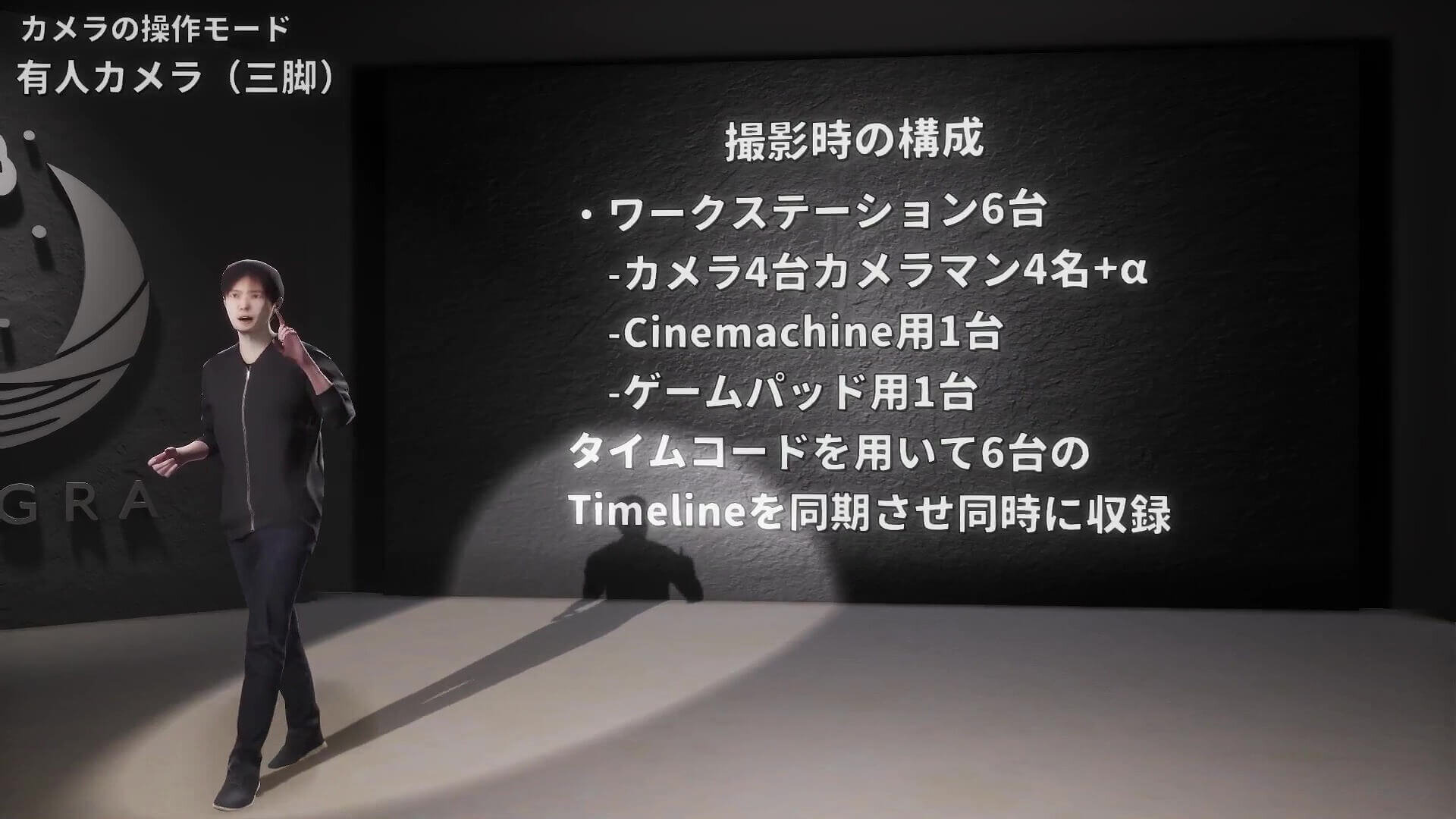

続いてはLATEGRAが「有人カメラ」と呼んでいる本物のカメラを使った操作だ。カメラにエンコーダを取り付けており、カメラの首の回転やズーム、フォーカスといった操作を数値化できる。そのデータをパソコンに送り、LATEGRAのプラグインを通じてUnityに転送することによって、Unityのカメラと現実のカメラが同じように稼動する。

有人カメラの一番のメリットは、人間的な判断や感性がUnity上で活かせることだ。現実のライブで見られるエモーショナルなカメラワークをバーチャルキャラクターライブで再現するには、本物のカメラとカメラマンに委ねるのがベストである。ただし収録にあたって機材とスタッフの手配が必要になり、綿密な計画を立てて練習をした上で撮影に臨まなければいけないなどの苦労も多い。有人カメラを導入したからといって、簡単に良い画が大量につくれるようになるわけではない点は注意したい。

さらにCinemachine、ゲームパッド、有人カメラを組み合わせることで、より魅力的なカメラワークを生み出すこともできる。

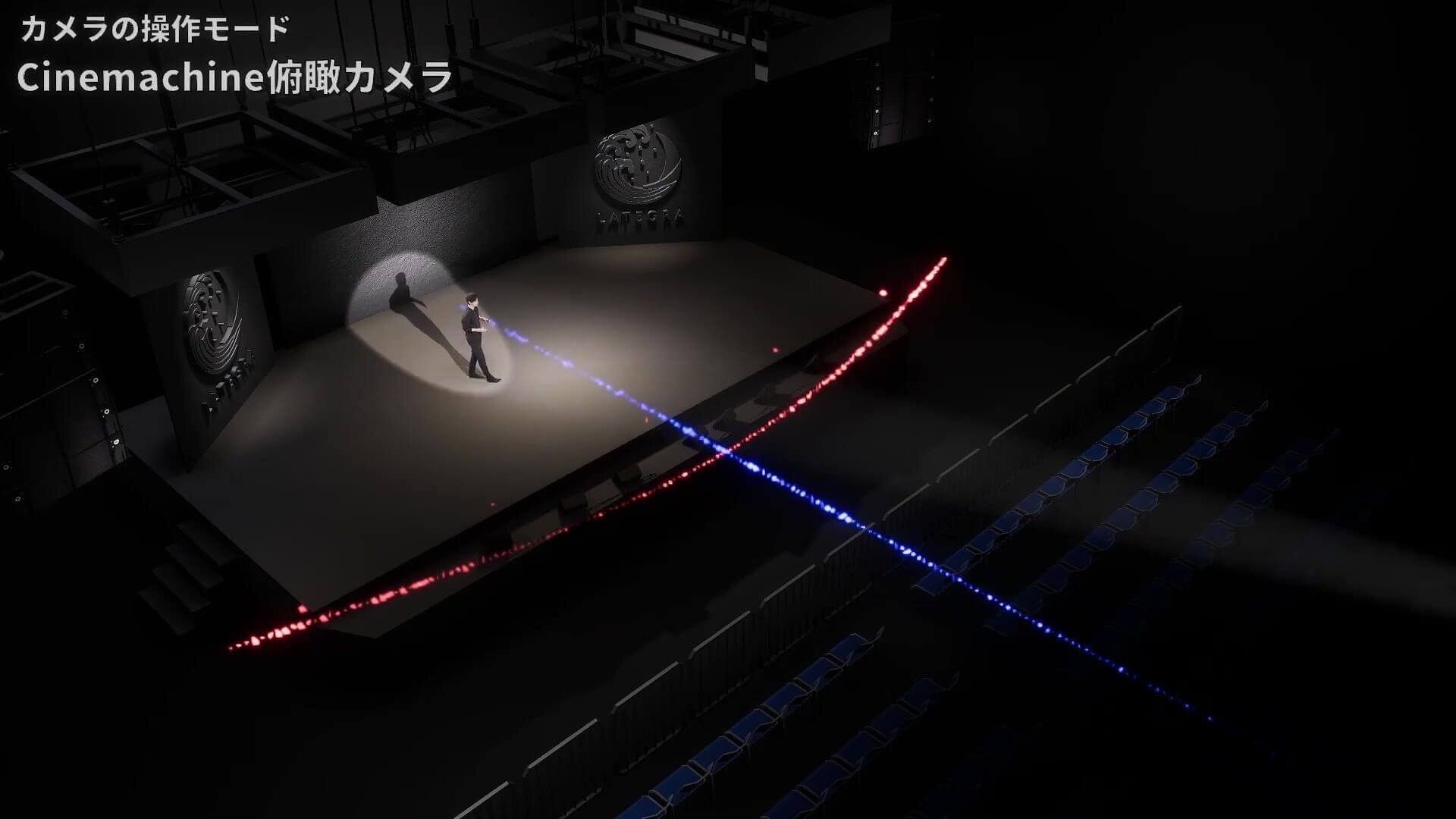

カメラはレール上しか動けないため、ゲームパッド単体より自由度は低いものの、むしろ実際のライブに近い構図になって説得力のある画がつくれる。カメラがめり込むというミスもなくなるため、安心して大胆に動かせるのもメリットだ。

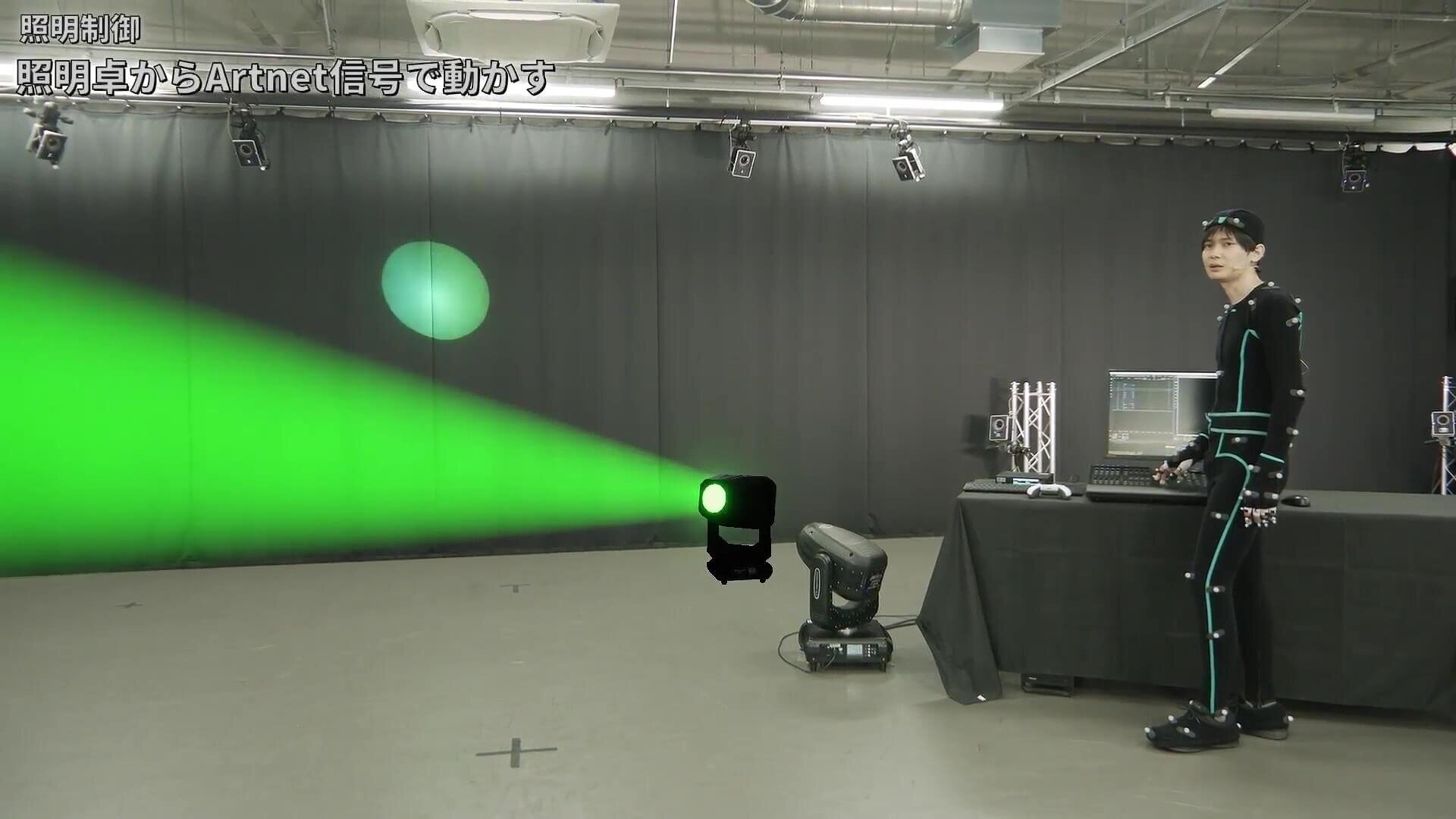

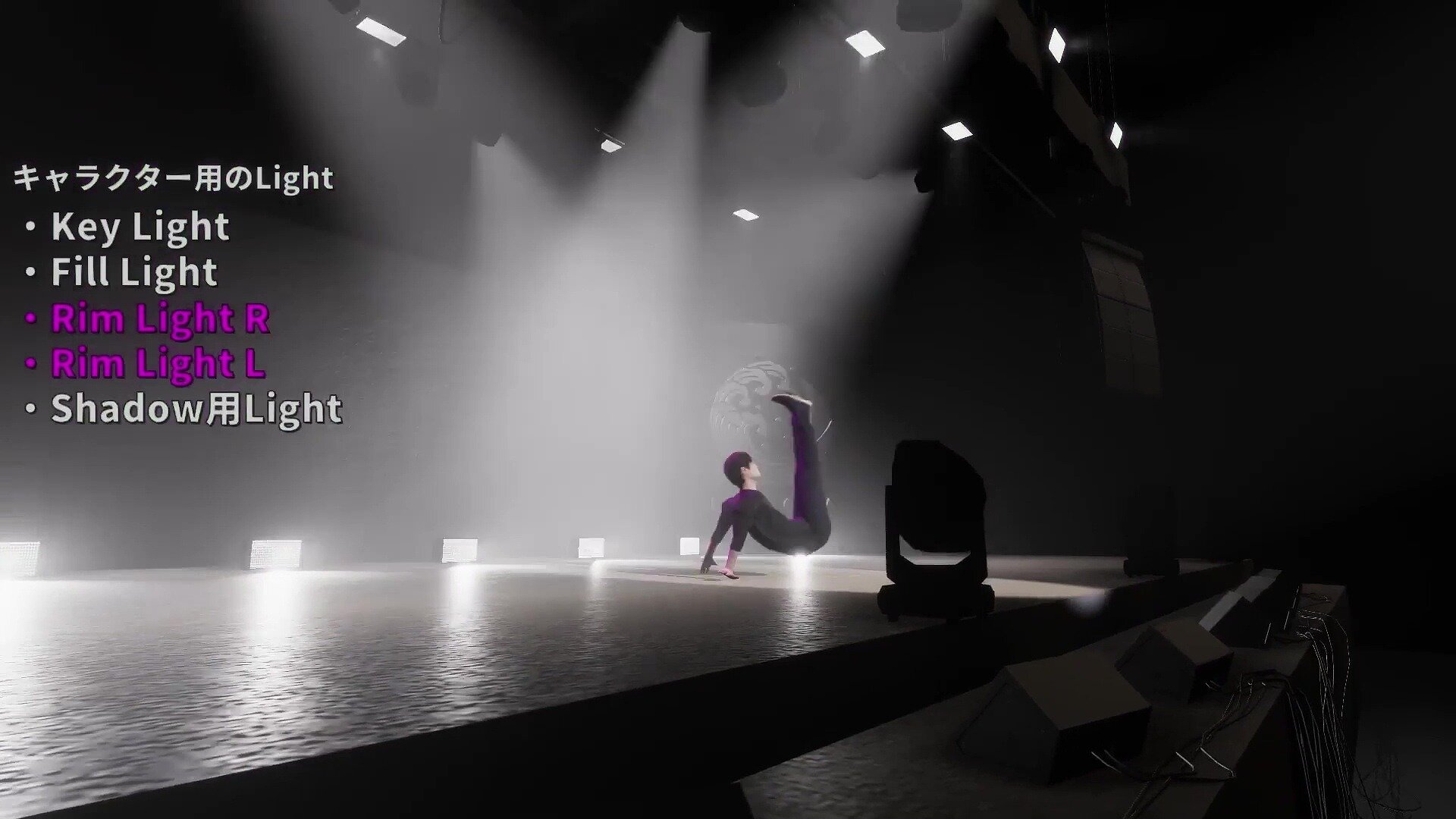

後半は照明についての解説に移った。照明もカメラと同じように現実のライブで使われているハードウェアで制御しており、照明スタッフがつくった信号をUnity上で再現した。

バーチャル空間に照明をどう配置するのかも照明スタッフが考えている。最初にステージのモデルが完成した時点でデータを照明スタッフに渡し、どこに置けば効果的なのかを考慮した上で、本物のライブと同じようにレイアウトを作成。そのデータをLATEGRAが開発したプラグインを通してUnityにインポートすることで、現実のライブと同じような照明が再現される。

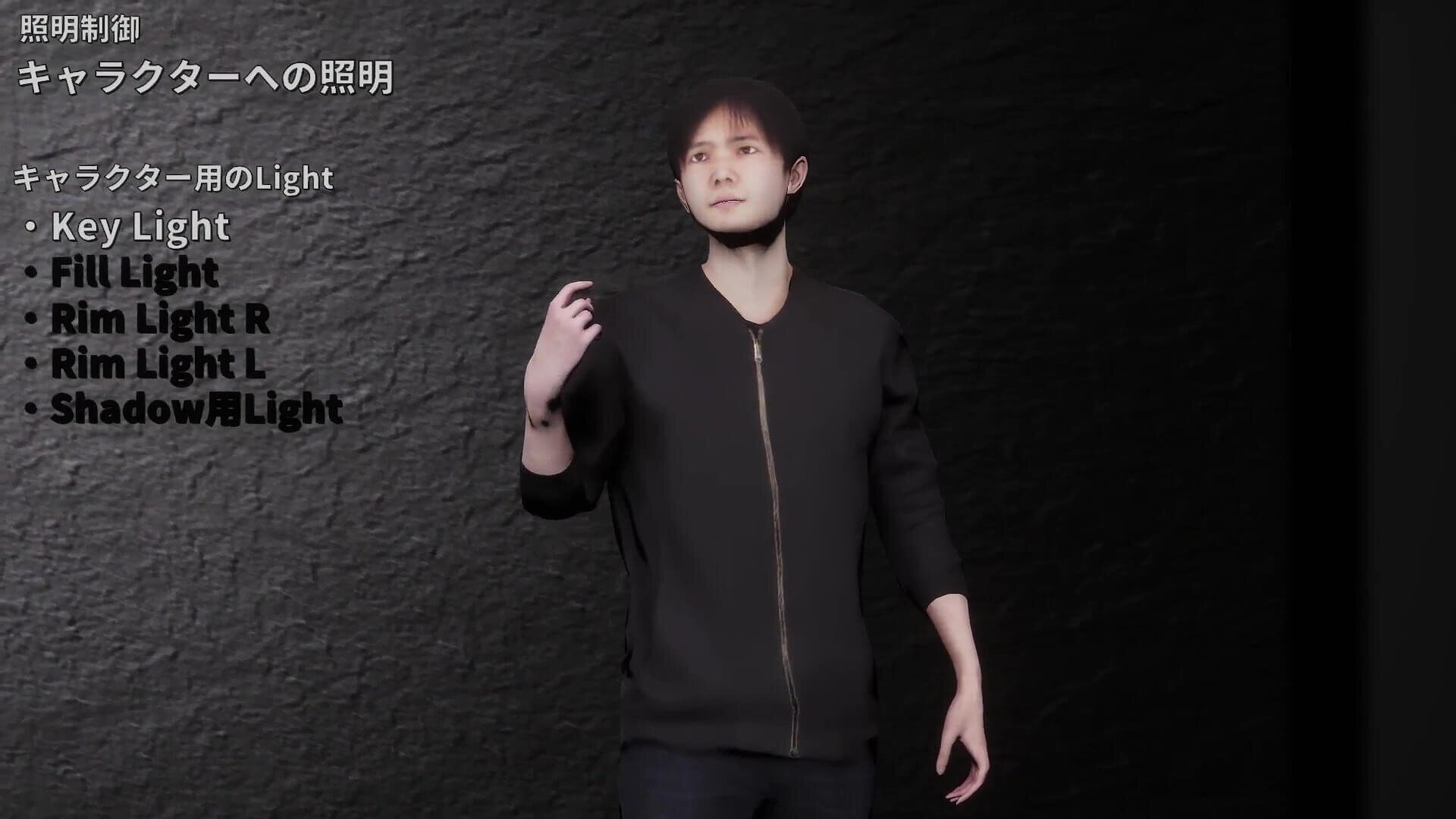

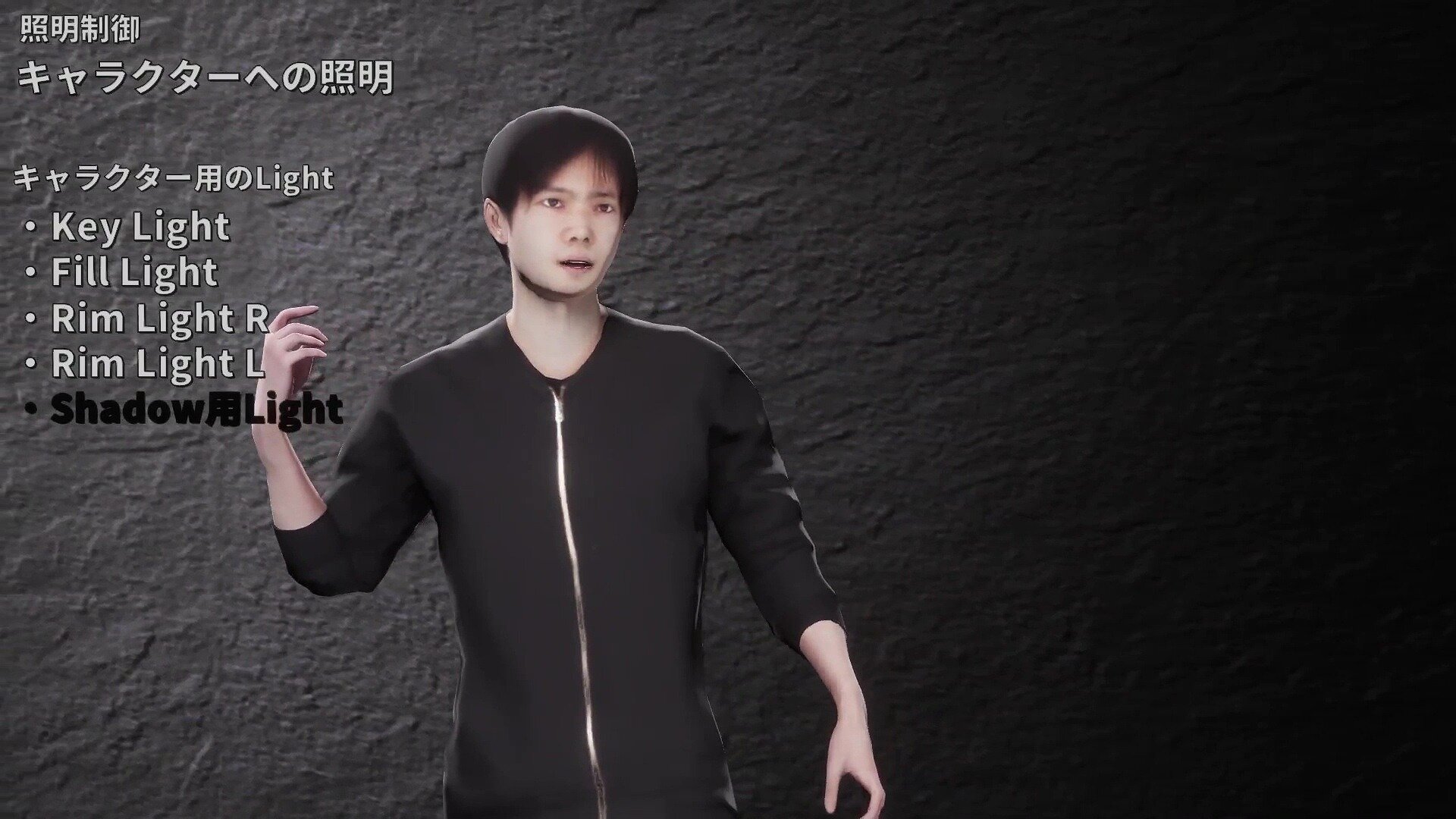

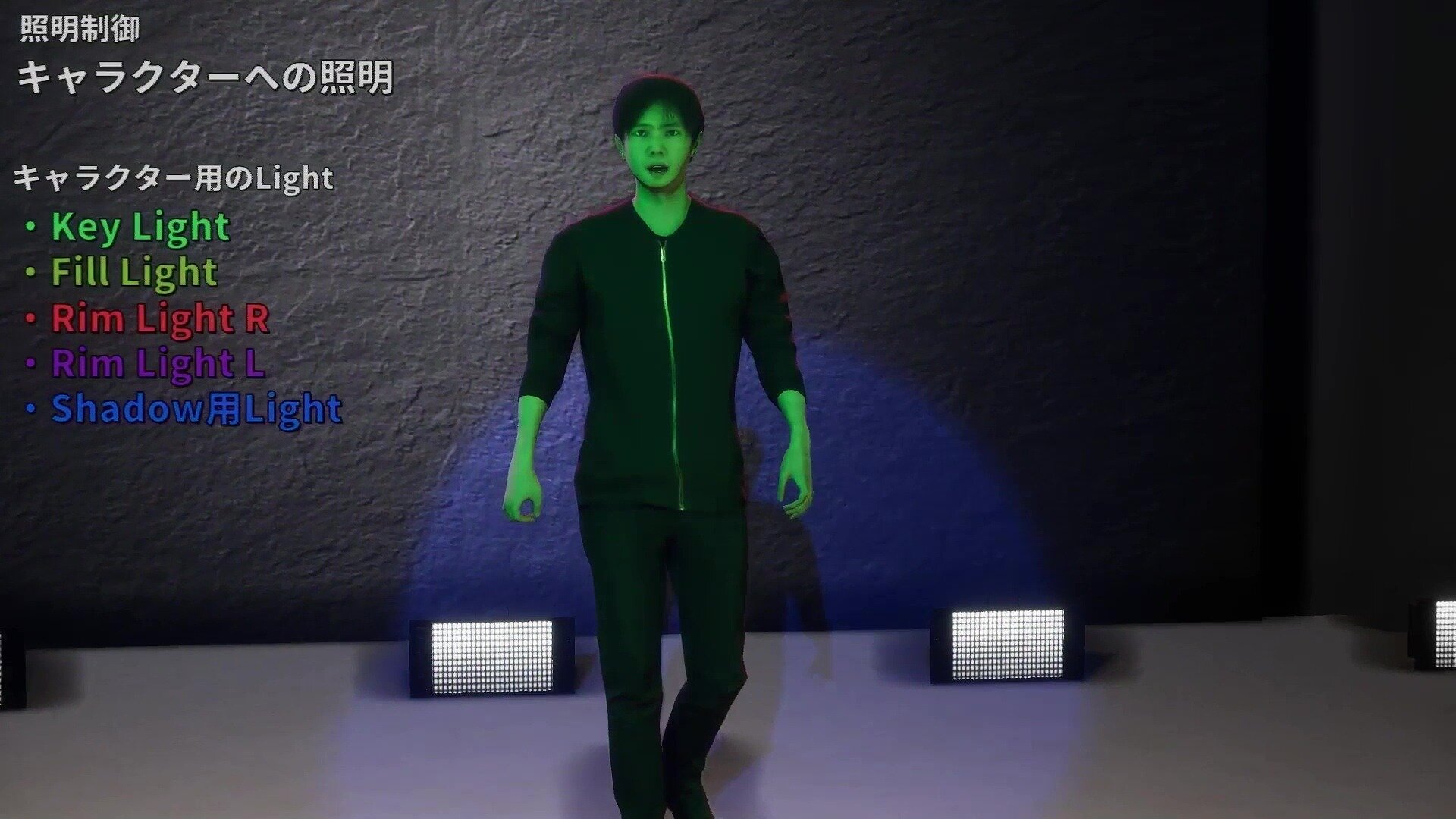

LATEGRAではステージとキャラクターの照明を完全に切り分けて設計し、キャラクターの見映えを追求している。キャラクター用のライトは「Key Light」、「Fill Light」、「Rim Light R」、「Rim Light L」、「Shadow用Light」の5種類。それぞれを付けたり消したりしながら効果のちがいを説明した。

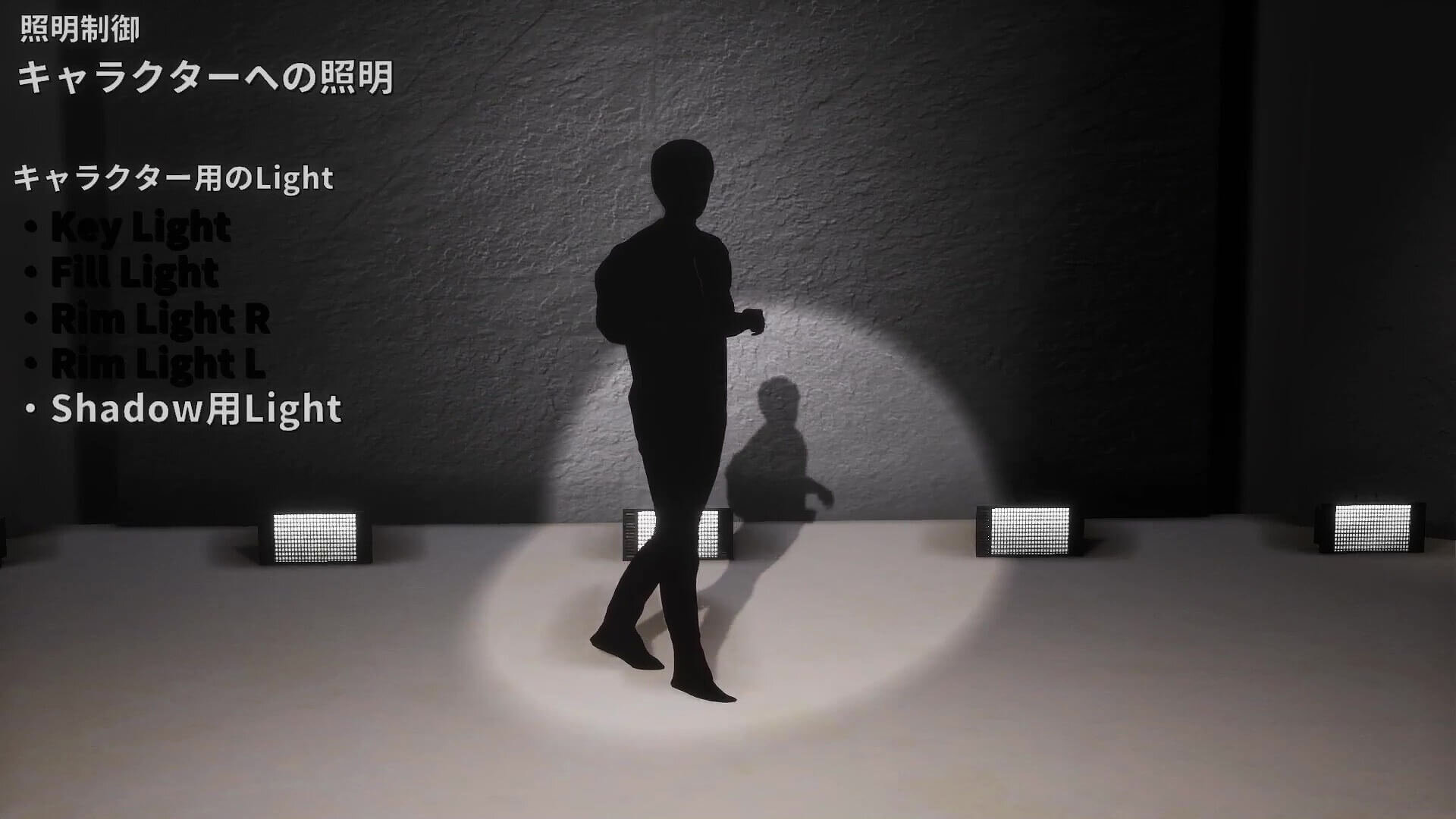

Shadow用Lightはキャラクターに当たるスポットライトと、それによって生じるシルエットを表現するためのもので、キャラクターそのものには何の影響も与えない。そのためShadow用LightだけをONにしてもキャラクターは真っ黒のままだ。

現実のライブでは照明を当てればシルエットは自然に発生するが、バーチャルキャラクターライブでは正しい位置に出なかったり、美しく見えなかったりする場合も多い。そのためKey、Fill、Rimのライトでキャラが綺麗に見えるように構成してから、Shadow用単独でシルエットを付け加えている。

ライティングの切り分けはHDRPのライトレイヤーを使用。それによってオブジェクトとしてのレイヤーを分けずに、どのオブジェクトにライトが当たるか、影を落とすのかを簡単に制御できる。中村氏は「HDRPを使った中で非常に便利な機能の1つでした」と制作をふり返った。

セッションのまとめとして中村氏は、本セッションではライブのプロセスをUnity上で再現するという試みを紹介したが、「今後はただ再現するのではなく、バーチャル空間の制限のなさを活かした演出をつくっていきたい」と意気込みを語る。

例えばカメラや照明卓の信号を使ってVFXの制御もできるし、キャラクターのモーションをカメラや照明に反映させるという逆のアプローチも可能かもしれない。今後どのような方法で映像をつくり上げていくのかに期待が膨らむセッションとなった。

TEXT_高橋克則 / Katsunori Takahashi

EDIT_山田桃子 / Momoko Yamada