アーティストのライブにおいてバーチャルプロダクション活用の先鞭をつけたのが2022年9月に行われたオンラインライブ「SiM XR LiVE」だ。映像演出を手がけたのは、技術力に裏打ちされたビジュアル表現を得意とするflapper3。楽曲と一体となってライブを盛り上げた映像制作の一端をご紹介しよう。

※本記事は月刊「CGWORLD + digital video」vol. 294(2023年2月号)からの転載となります。

Information

公演日時(日本):2022年9月30日(金)20:00配信

料金(日本):フルサイズ視聴:3,300円(税込)単曲視聴:880円(税込)

販売/配信プラットフォーム:PIA LIVE STREAM、Veeps

2022simxr.com

© SiM XR LiVE All rights reserved.

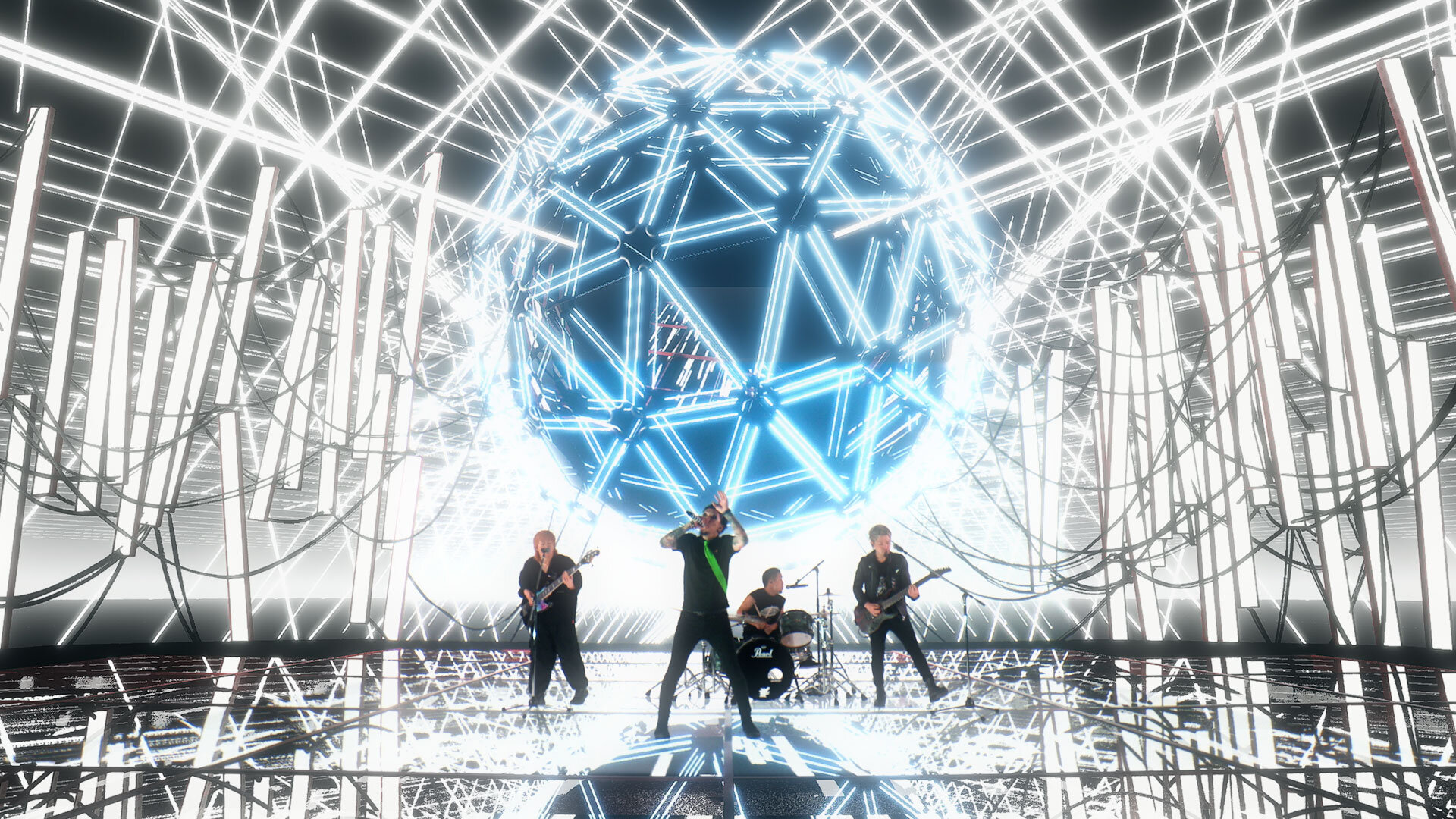

アーティストのライブでバーチャルプロダクション初採用

2022年9月30日にレゲエパンクバンドSiMによるオンライン限定ライブ「SiM XR LiVE」が開催された。SiMが歌う『進撃の巨人 The Final Season Part2』のオープニング曲「The Rumbling」のMVはボリューメトリックキャプチャを大胆に使ったVFXが大きな話題を呼んだが、本作ではそれをさらに発展させ、現実と仮想世界を融合するXRの技術を用いたオンラインライブとして実現。コロナ禍でリアルライブを実施することが困難な状況において、最先端の技術を利用したオンラインライブでバンドの魅力や楽曲の素晴らしさを届けるという、意欲的かつ実験的な取り組みとなった。

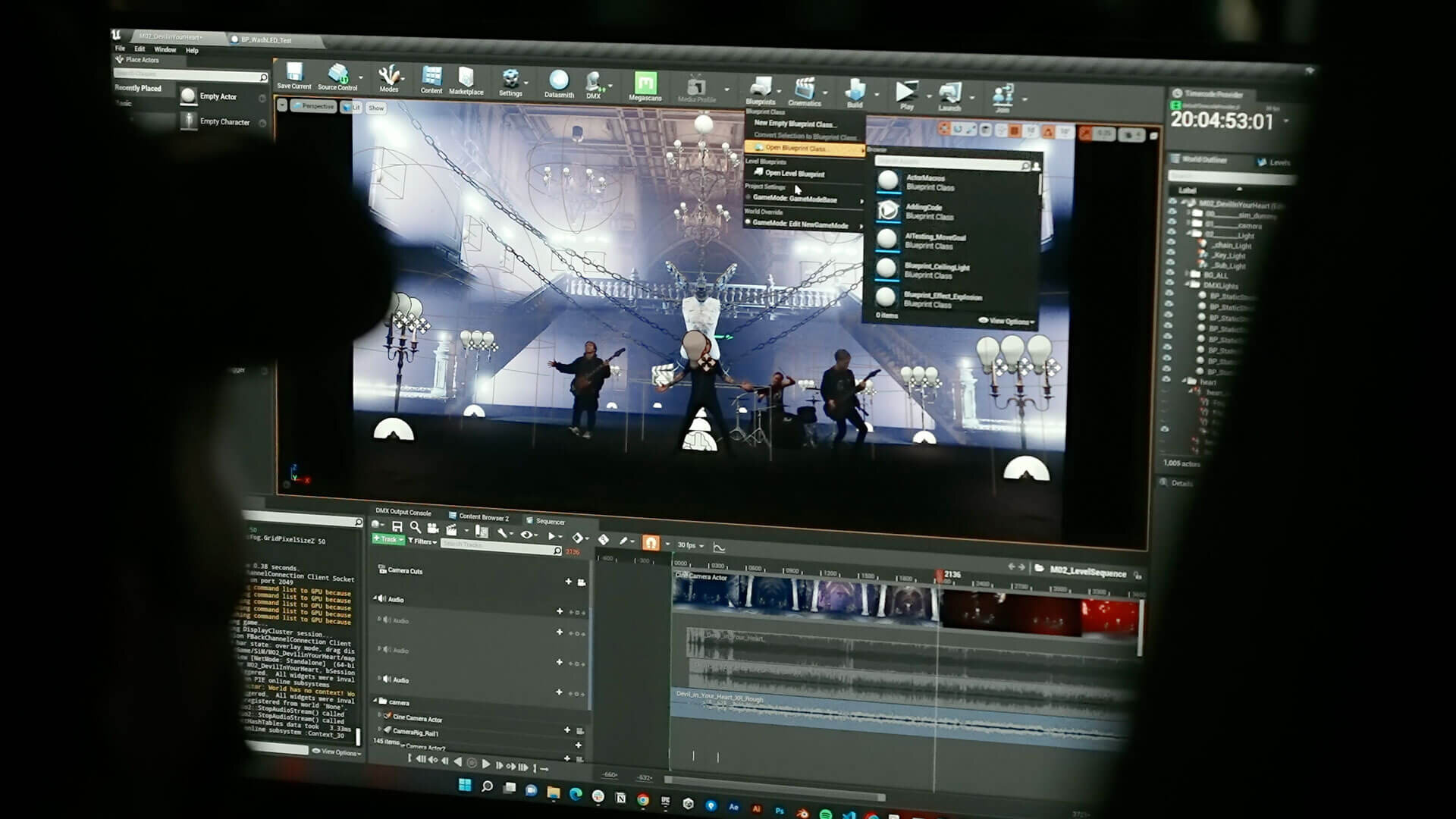

MVから続き、ライブ映像はflapper3が担当。MVの制作終盤に、巨人が歩いている中でXRのライブをしてみたいという話が出たことから企画がスタートしたという。グリーンバックで合成するという案もあったが照明が浮いてしまう問題などもあり、バーチャルプロダクション(以下、VP)を使ってライブすることに決定した。もともと同社は現実のバンドマンにARの初音ミクを合成したARライブを制作しており、バーチャルの映像と現実の照明を合わせるなどのXRの表現には実績があったが、今回はさらに一歩進めてVPにトライすることになった。今まではXRにUnityを使っていたが、Unreal Engine(以下、UE)で制作するというのもチャレンジだった。

「意識したのは、ほかでやっていないことをやってみるということ。VPはMVや映画などでは使われていますが、ライブでは使われていません。VPを使って、現実のアーティストをバーチャルの空間に置いてリアルタイムのライブを行うのは初の試みです」とアートディレクターの山本太陽氏は語ってくれた。ディレクターの矢向直大氏は「VPには作業を進めていく中で見えてきた演出のおもしろさがあり、通常のライブにはない新しい世界を提示できたと思います」とライブの手応えをつかんだという。

<1>バーチャルプロダクションによる撮影

ゼロからつくり上げたバーチャルプロダクション

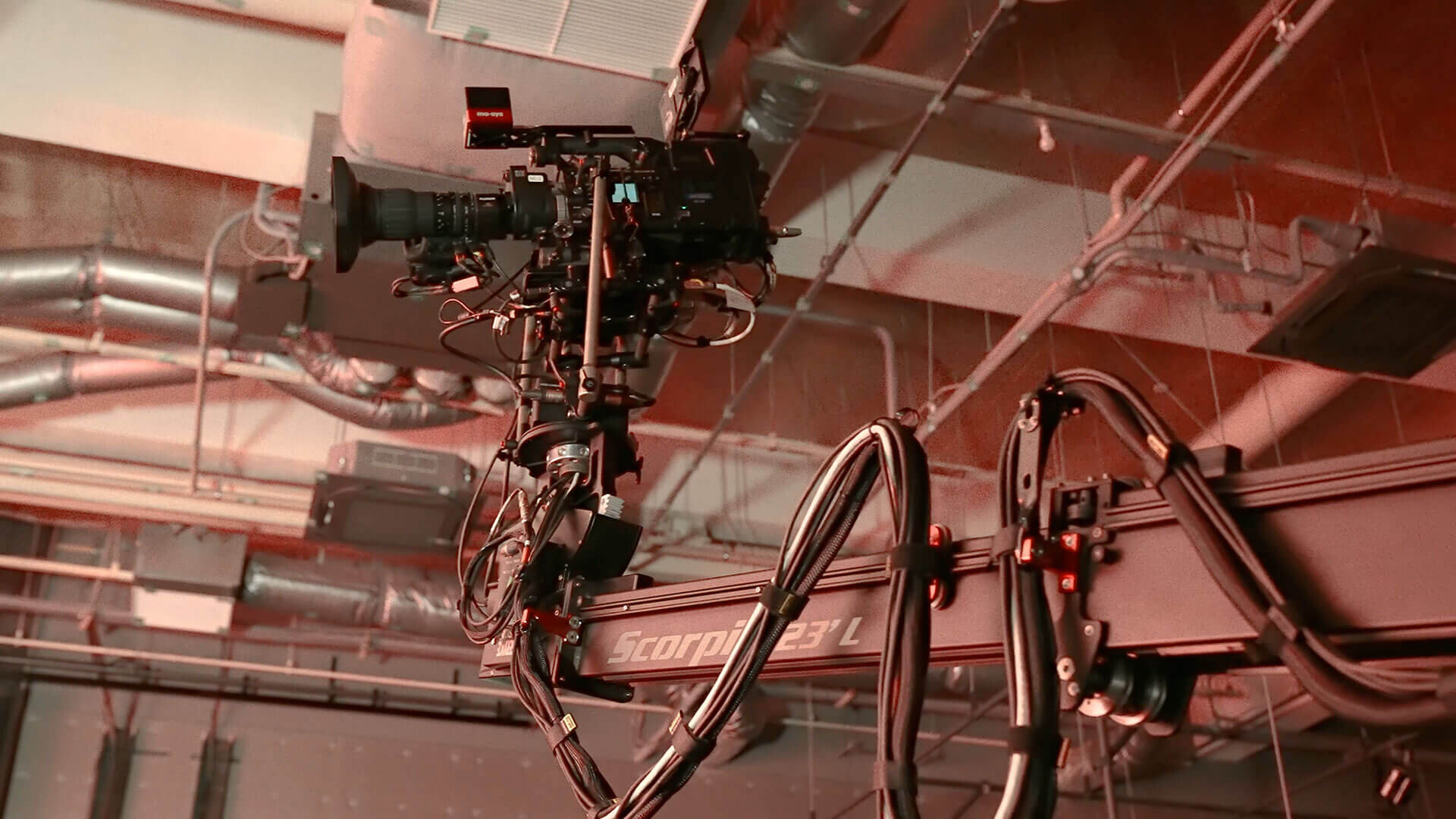

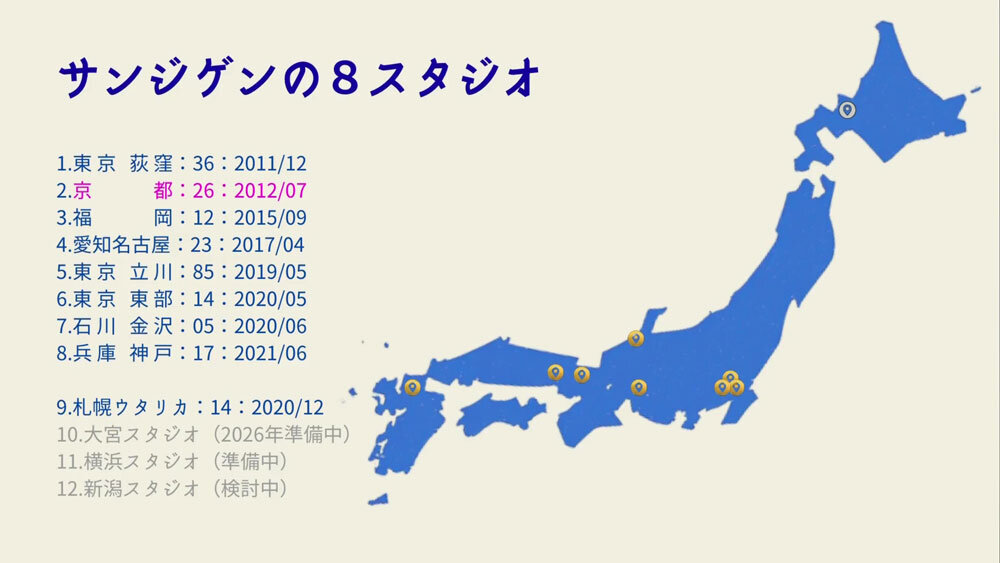

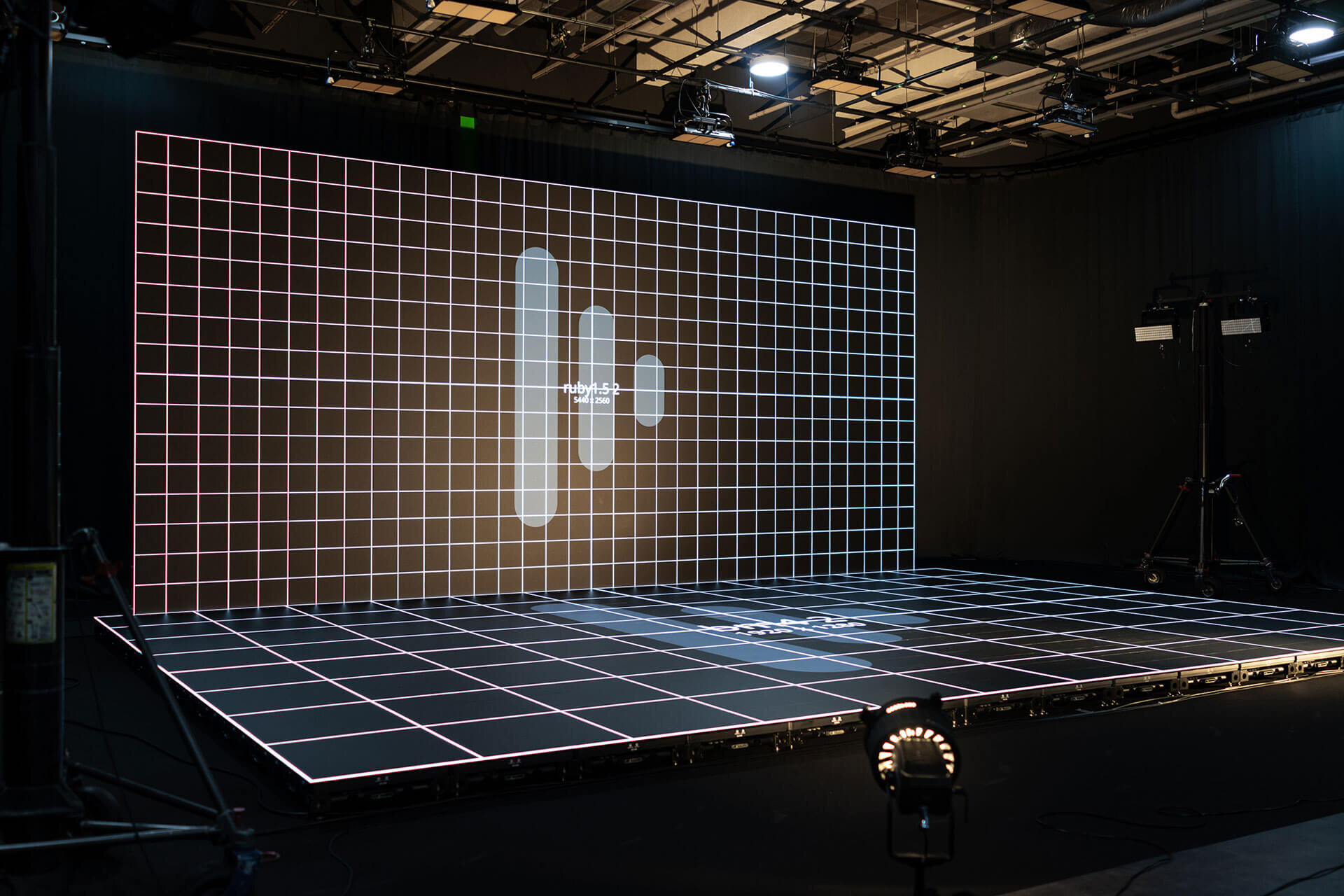

VPを使うことを決定し、思った通りの撮影ができるスタジオを探し出すところから制作はスタート。国内の多くのプロダクションを見て回ったが希望に合うところはなく、最終的に羽田のモーションキャプチャ用のスタジオにLEDパネルを運び込み、背面は高さ4メートル、幅9メートル、床は奥行き6メートル、幅9.5メートルのオリジナルステージが組み立てられた。スタジオが決まった後は、XRに強いタケナカに技術協力を依頼し、現場でdisguiseをオペレーションするチームにはヌーベルバーグが参加した。組み立てたVPは常設ではないため、組み上げてから本番までの短い時間にセッティングをしなければならない。設営には1日、セッティングとゲネプロに1日、撮影に1日という短期間だったが、特に本番環境でUEを動かすのは初めてのため調整が難航したという。

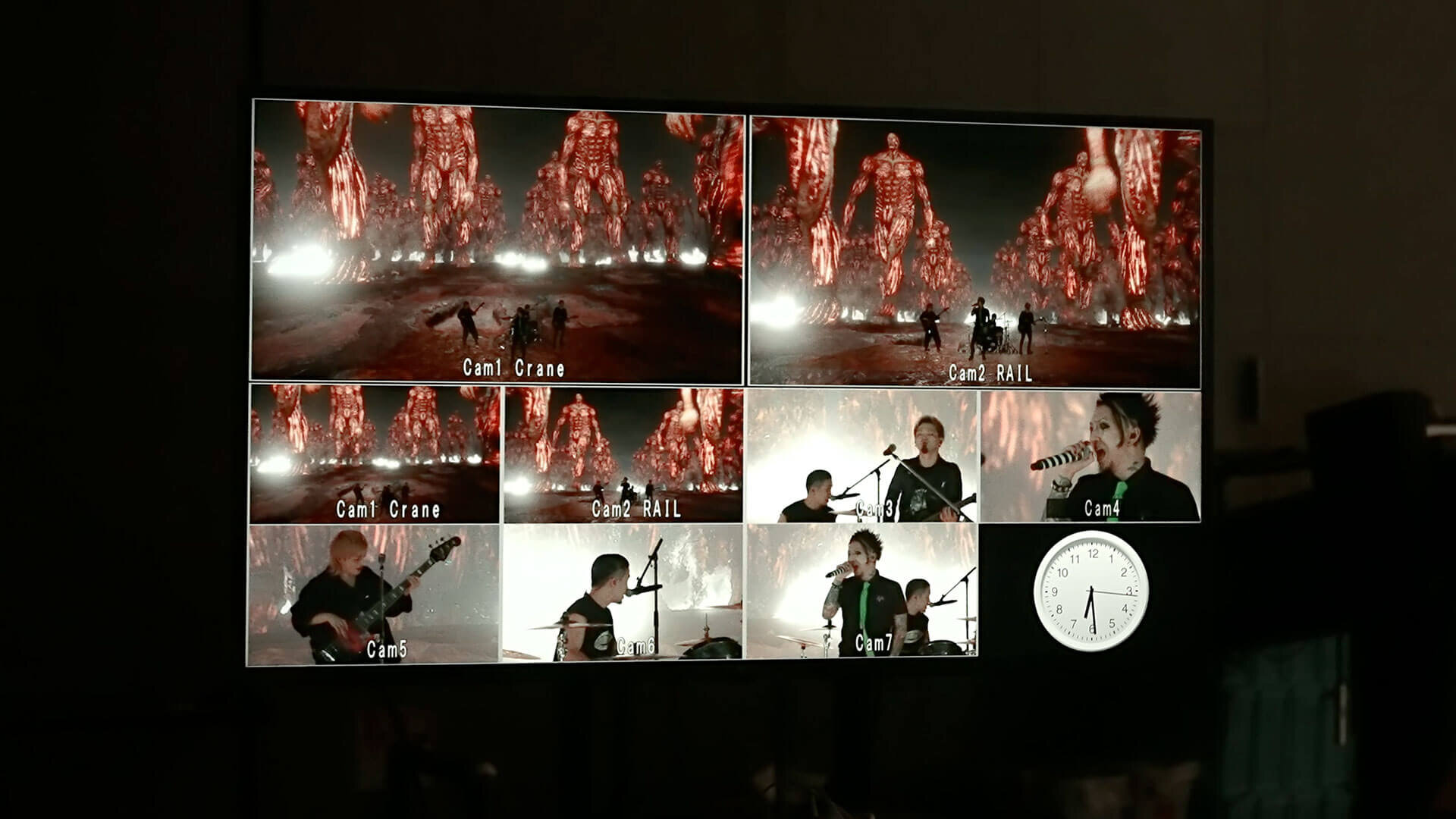

本作の撮影の大きな特徴は同録2カメでのライブという点だ。通常のライブなら2カメはそれほど大きな負担にならないが、カメラの動きに合わせて背景と床に表示するCGの画角が変わるVPでは2台のカメラ用に別々のCGを流し、1フレームごとに画面を切り変えて撮影している。60fpsでCGを流し、30fpsのカメラ2台で1フレームずらして撮影している(そのため現場のLEDを肉眼で見ると1フレームごとにパカついているように見える)。この特殊な撮影にはグローバルシャッターでシネライクなビデオカメラが必要だったため、要件を満たすSonyの往年の名機PMW-F55が都内から7台ほどかき集められた。また、照明のライトはLEDウォールからだけではなく、CG映像に合わせてリアルタイムに変化する照明を当てている。前作のMVでは楽器の反射を修正する工数が大きかったが、今回は上手く馴染んだ。これらは現場でカメラや照明、disguiseなどの機器をタイムコードで同期することで実現している。

CG制作のツールは3ds Maxに加え、テクスチャ制作にSubstance 3D Painterを使用。V-Rayで試しにレンダリングしたもので映像を検証して、UEへはモデリングやアニメーションのデータをFBXやDatasmithでインポートした。画づくりはUEでシェーダや最終的なルックを調整してフィニッシュ。CG制作においてもdisguiseを使った本番環境が当日まで試せないため、本番前のすり合わせで苦労したそうだ。

バーチャルプロダクションスタジオ

複数台カメラを用いた撮影

<2>「KiLLiNG ME」&「Devil in Your Heart」

インパクトのある1曲目とゴリ押し3DCGの2曲目

ライブのセットリストは全4曲。通常のライブでは全体を通してイメージを共通化することが多いが、今回はVPの特性を活かすこともあり、各曲で別々の世界観をもつワールドを展開している。そのため制作側としてはボリュームが大きくなったが、それもひとつのトライだったという。

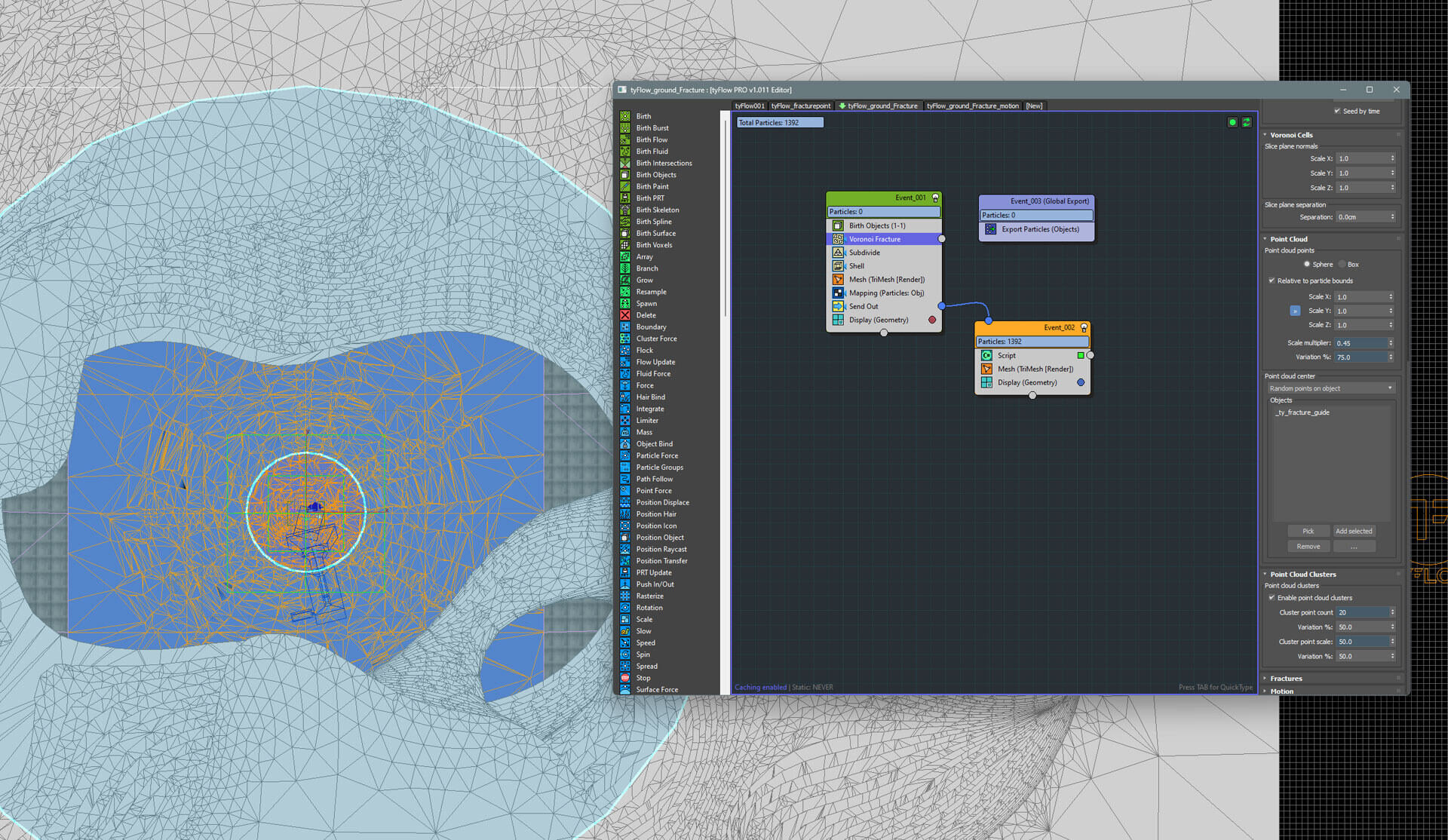

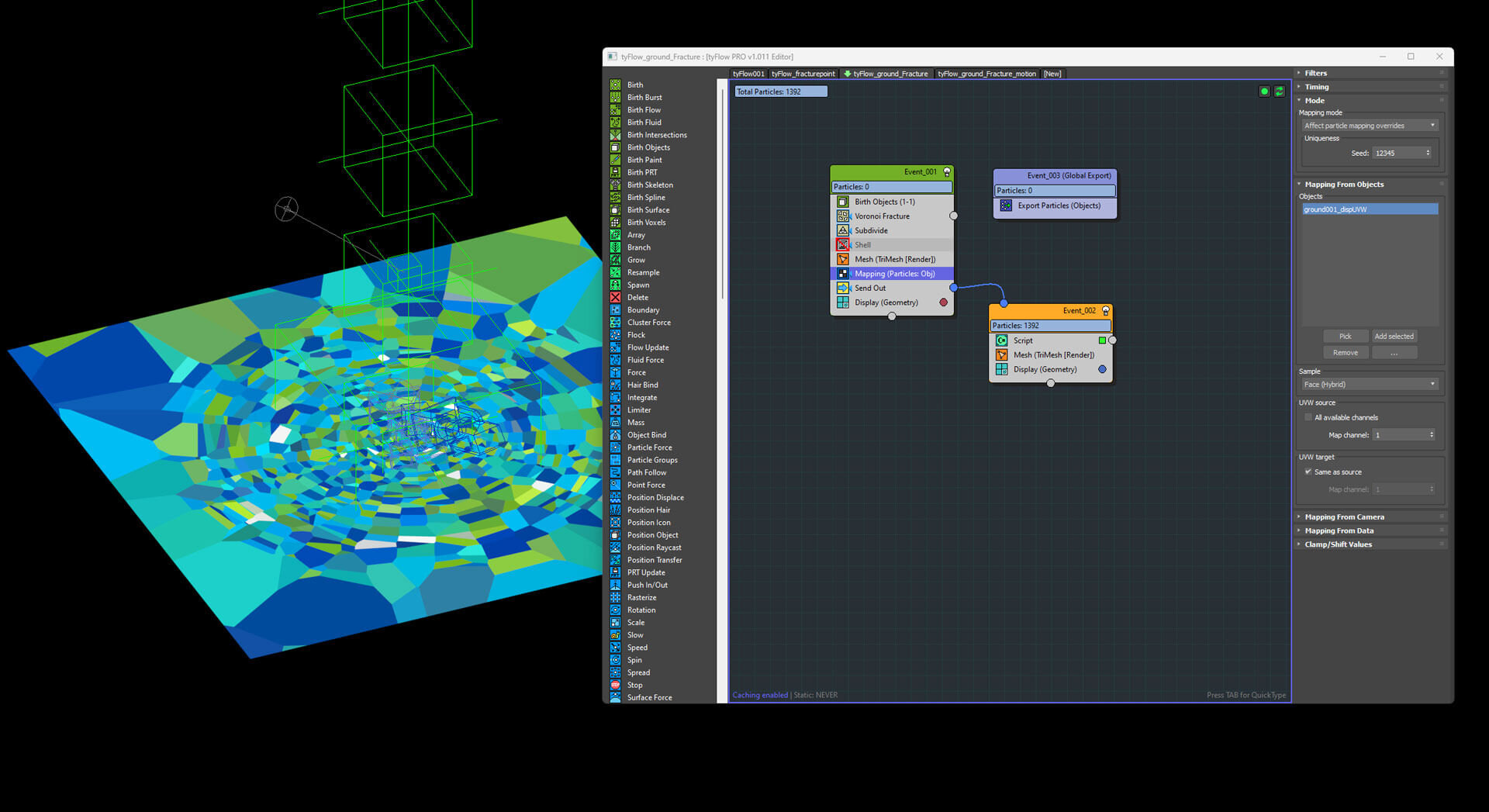

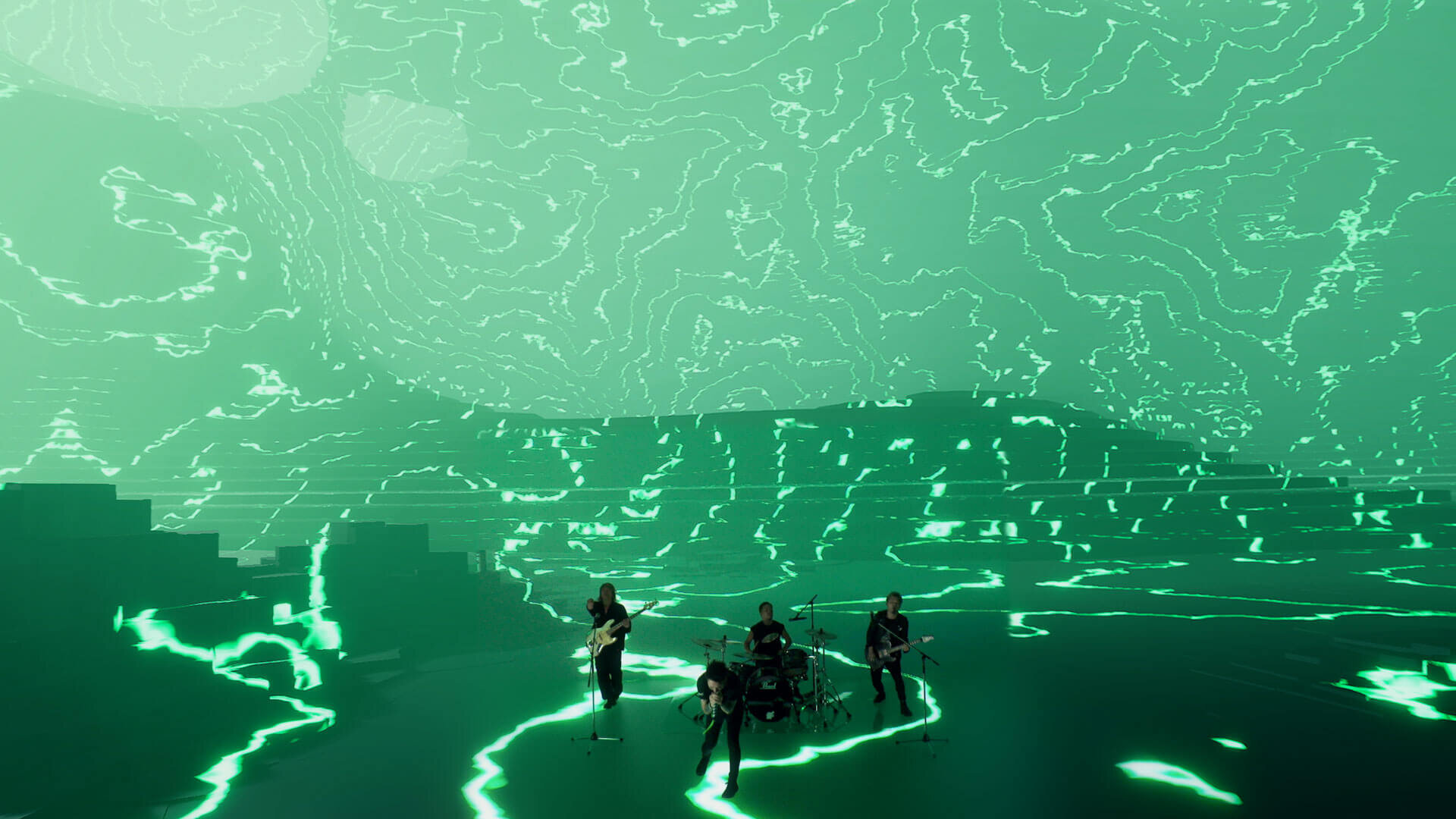

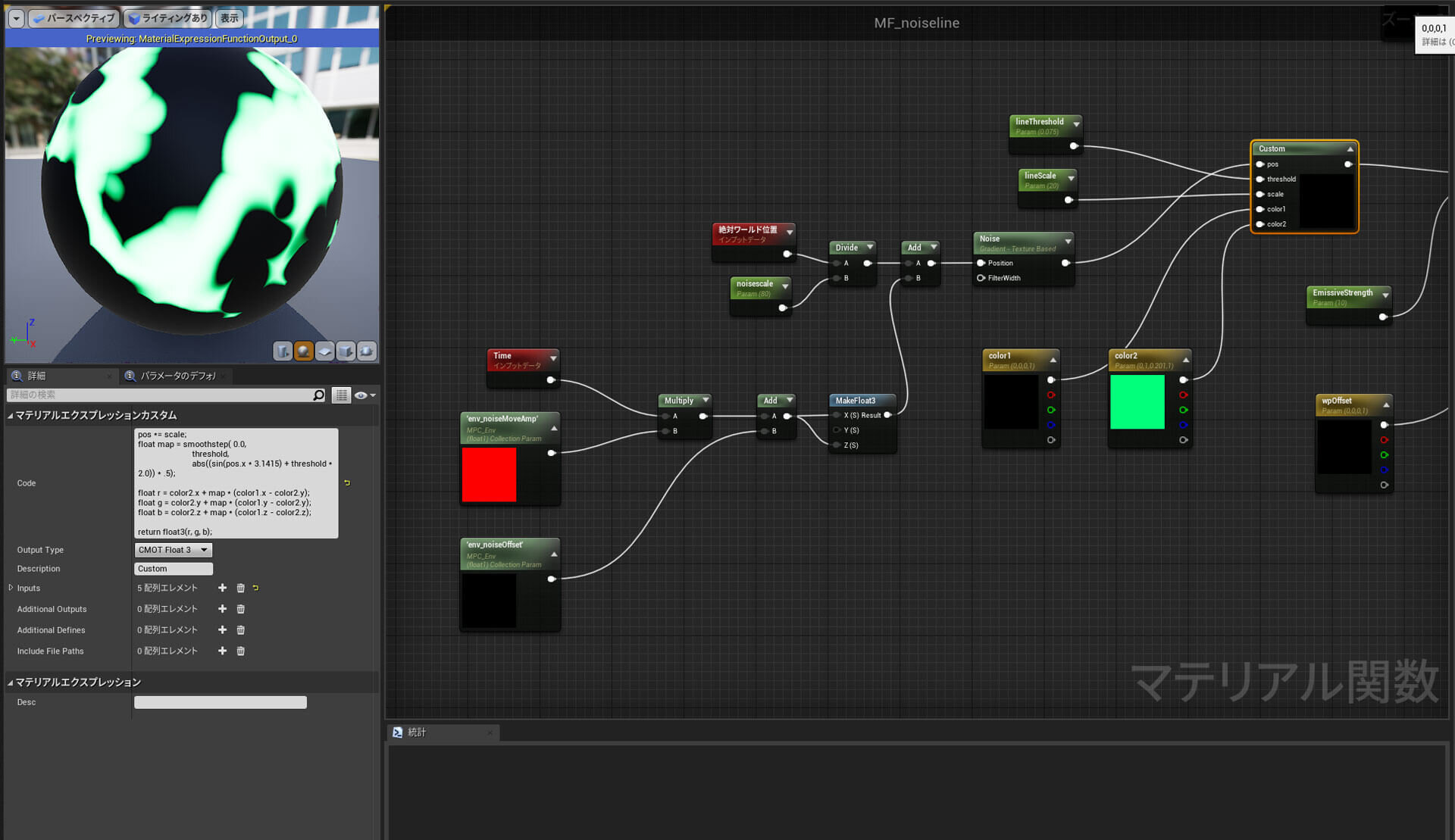

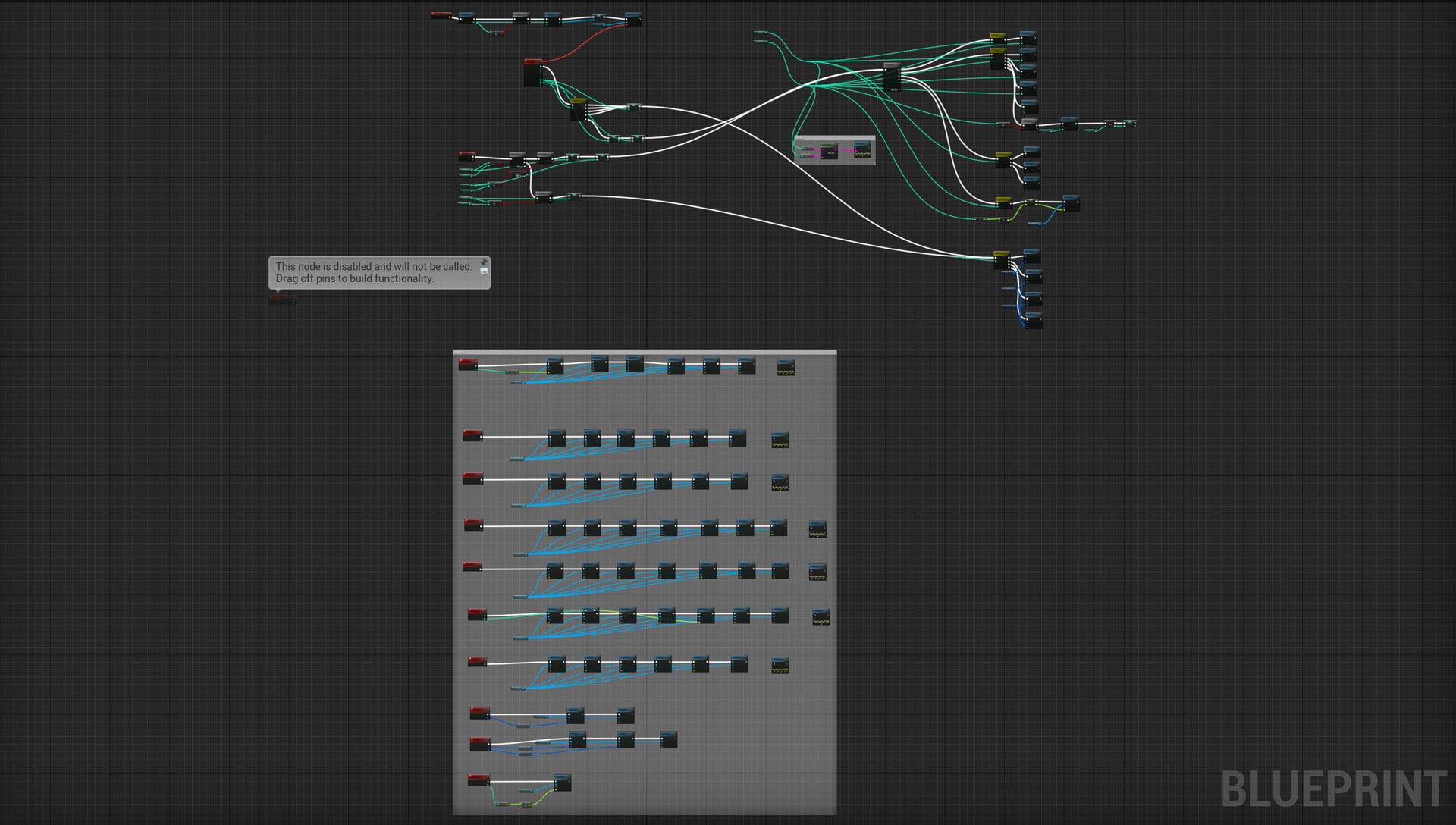

1曲目の「KiLLiNG ME」は、曲の始まりと共にLEDの白い画面にノイズが走り、地面がせり出してくるオープニングにふさわしいインパクトのある演出だ。UE上でキーを打って床のせり出しを制御していくとデータ量が増大していくため、動画をテクスチャにしてUEのWorld Position Offsetを使って押し出している。ただし動画テクスチャのコーデックやビット数などの品質が大事で、今回はProResをそのまま流すことで最良の結果を出している。このコーデックの精査などもプロダクションが設営された本番環境でのテスト中に行われた。「動画テクスチャもUEの中で再生するのではなく、NDIで繋がれた他のPCで再生された動画を受け取るシステムになっています。手元で再生しないので軽くできるんです」とテクニカルディレクターの佐藤 豪氏は解説する。アニメーションはプロシージャルと手付けのハイブリッドだ。音と映像の同期、いわゆる“音ハメ”をするなら手付けの方が圧倒的に品質を高くできるため、そこに効率的なプロシージャルの良さを組み合わせた「いいとこ取り」をねらったとのことだ。グリーンのシェーダはパーリンノイズをサイン波で加工。ノードからパラメータを外に出して音ハメがしやすいように組まれている。

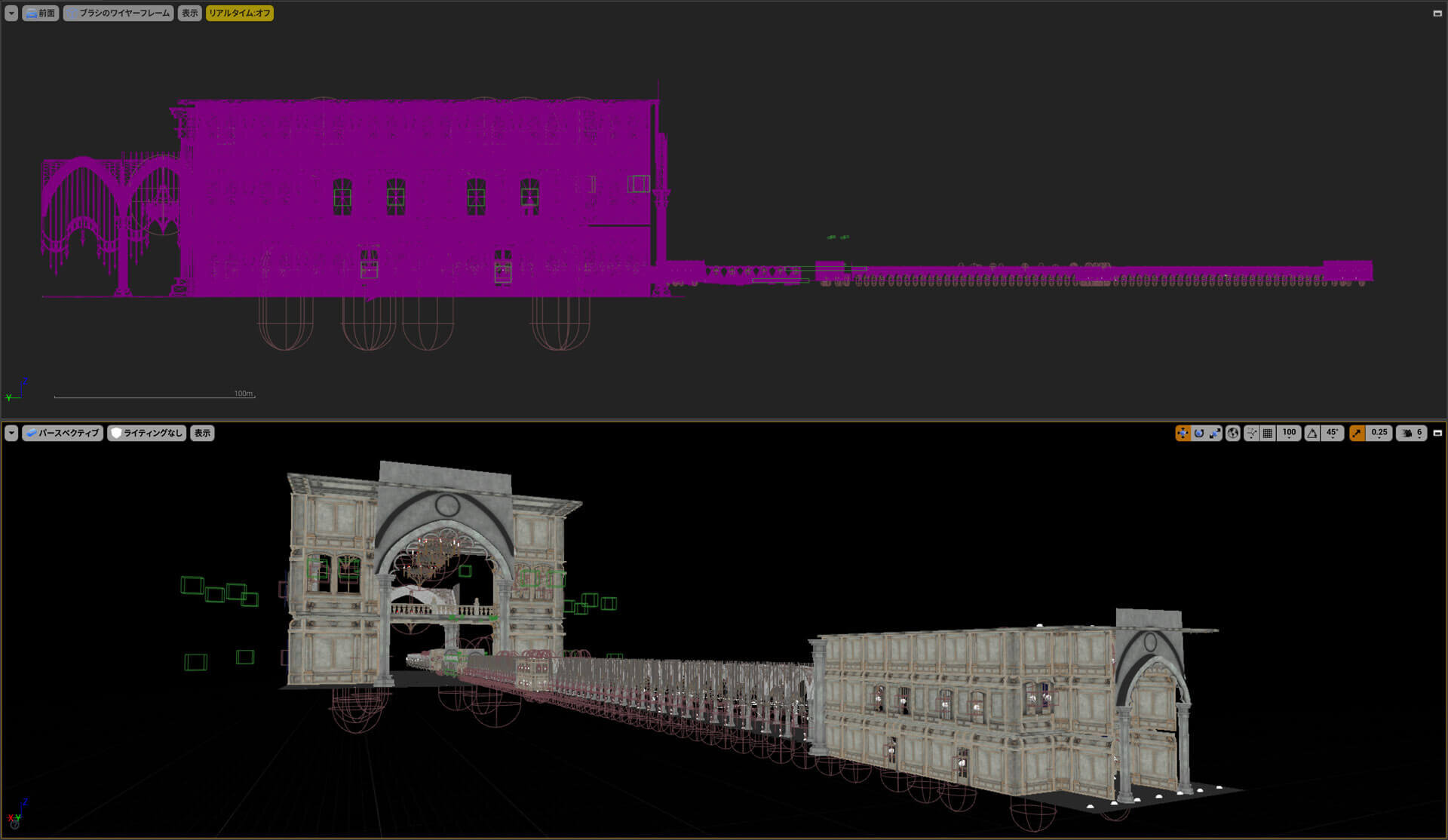

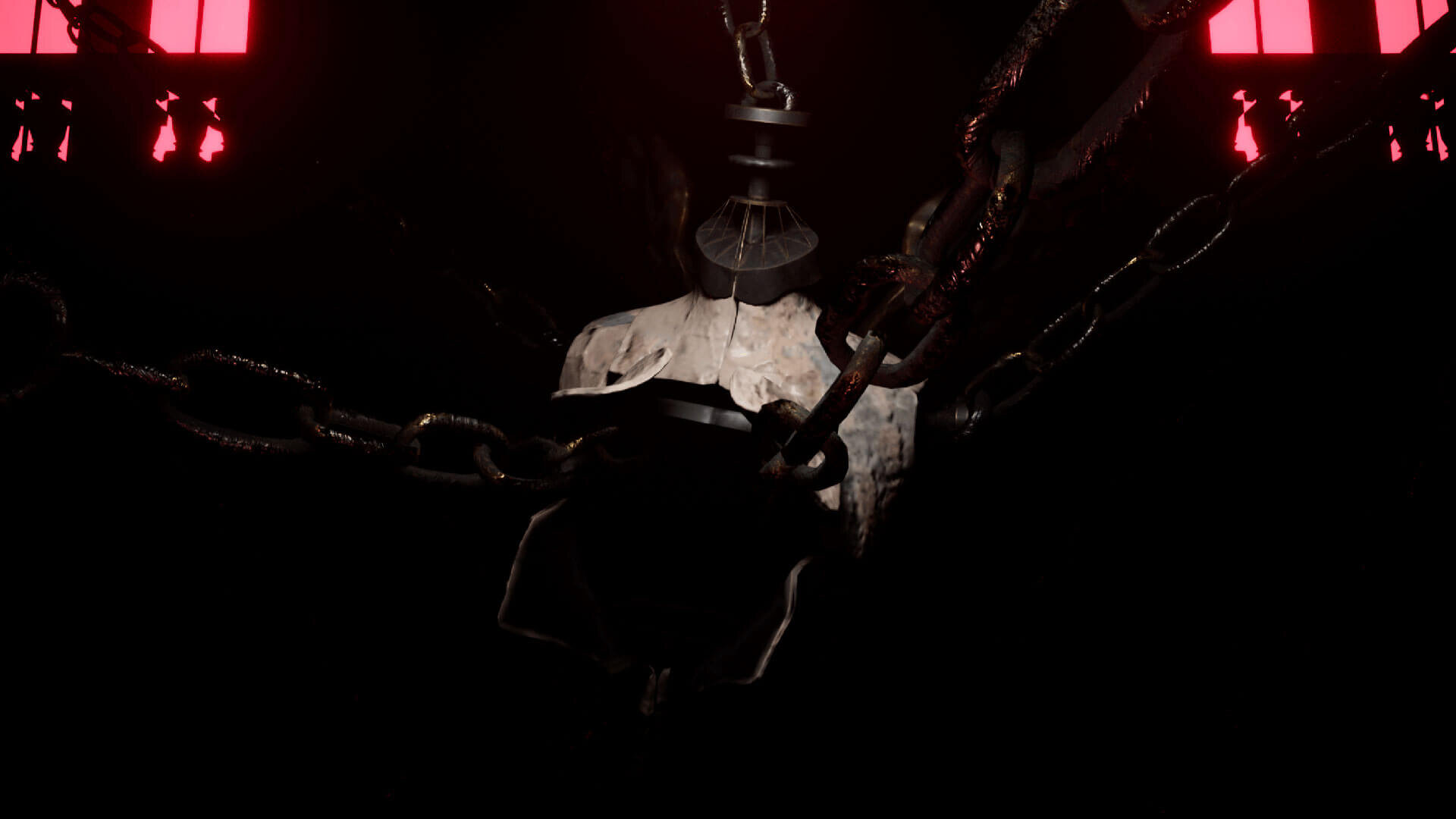

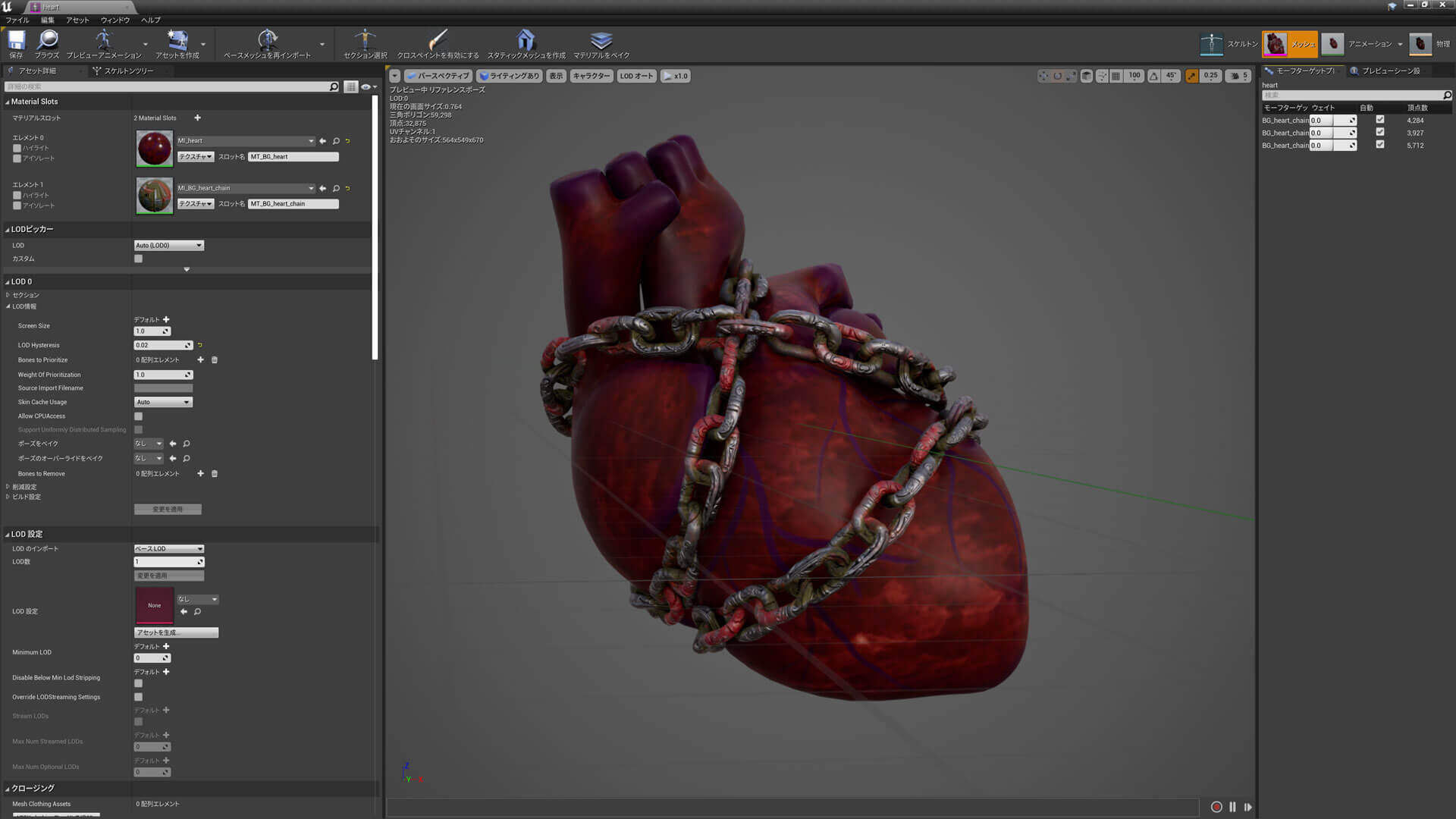

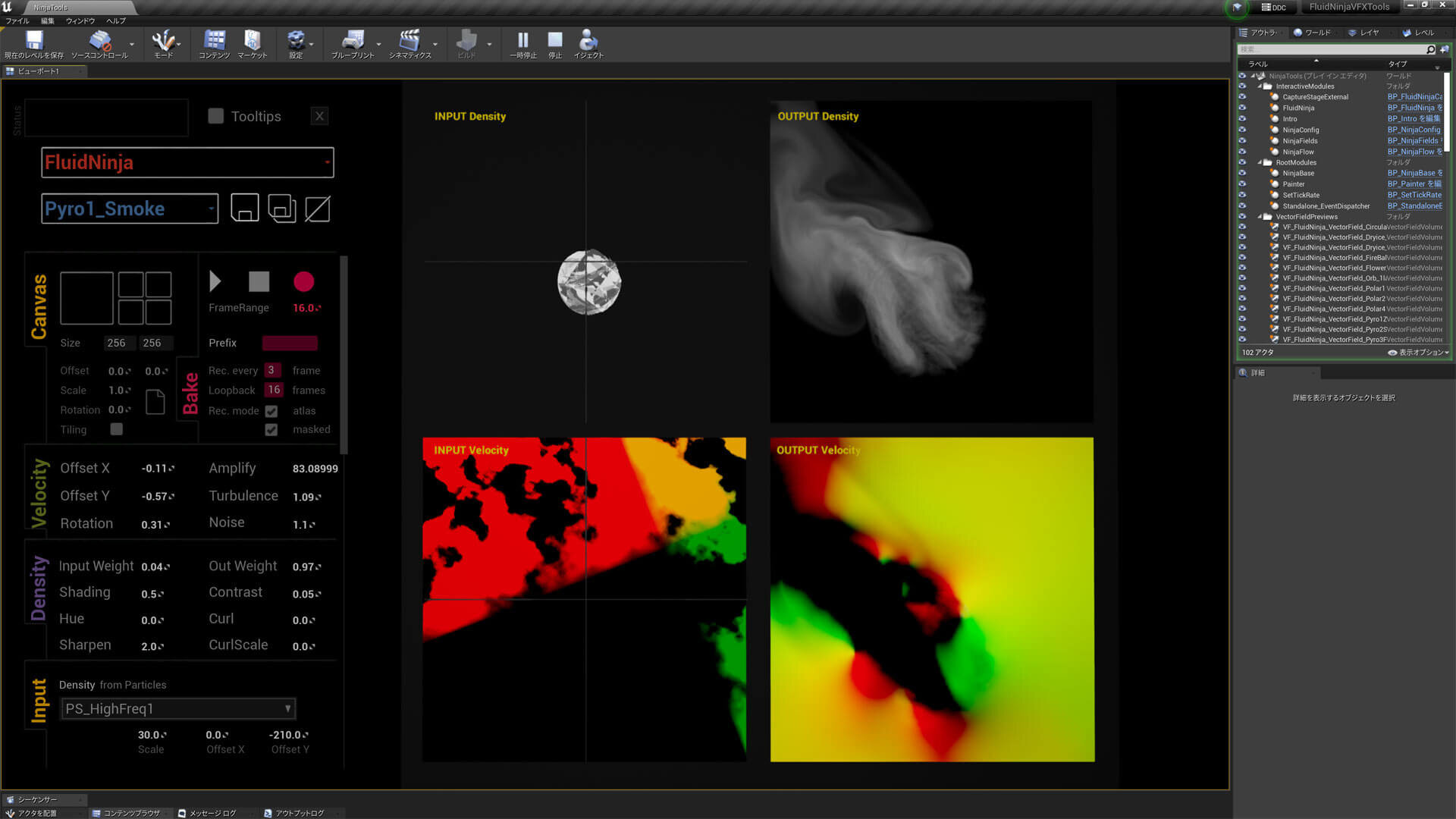

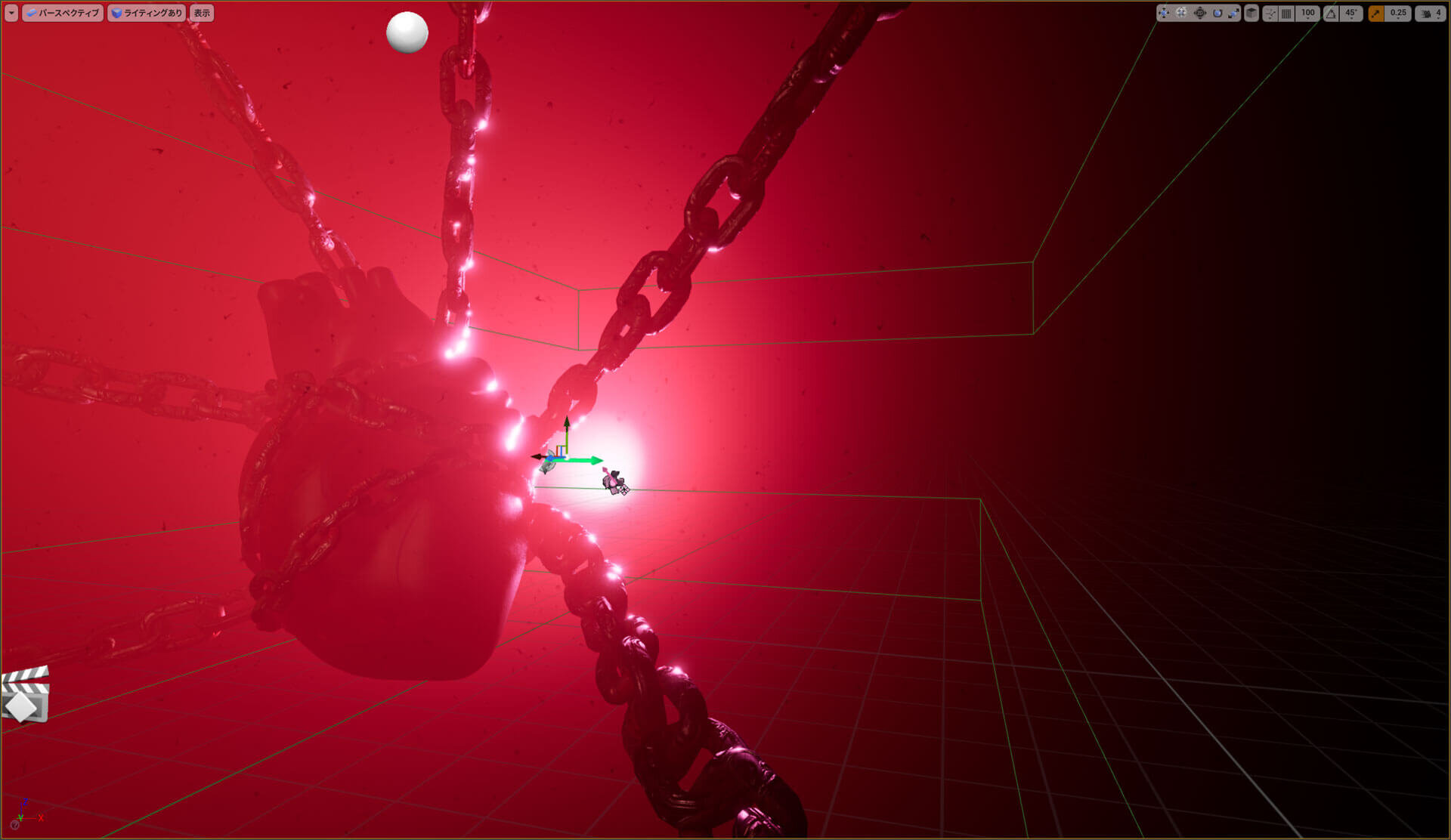

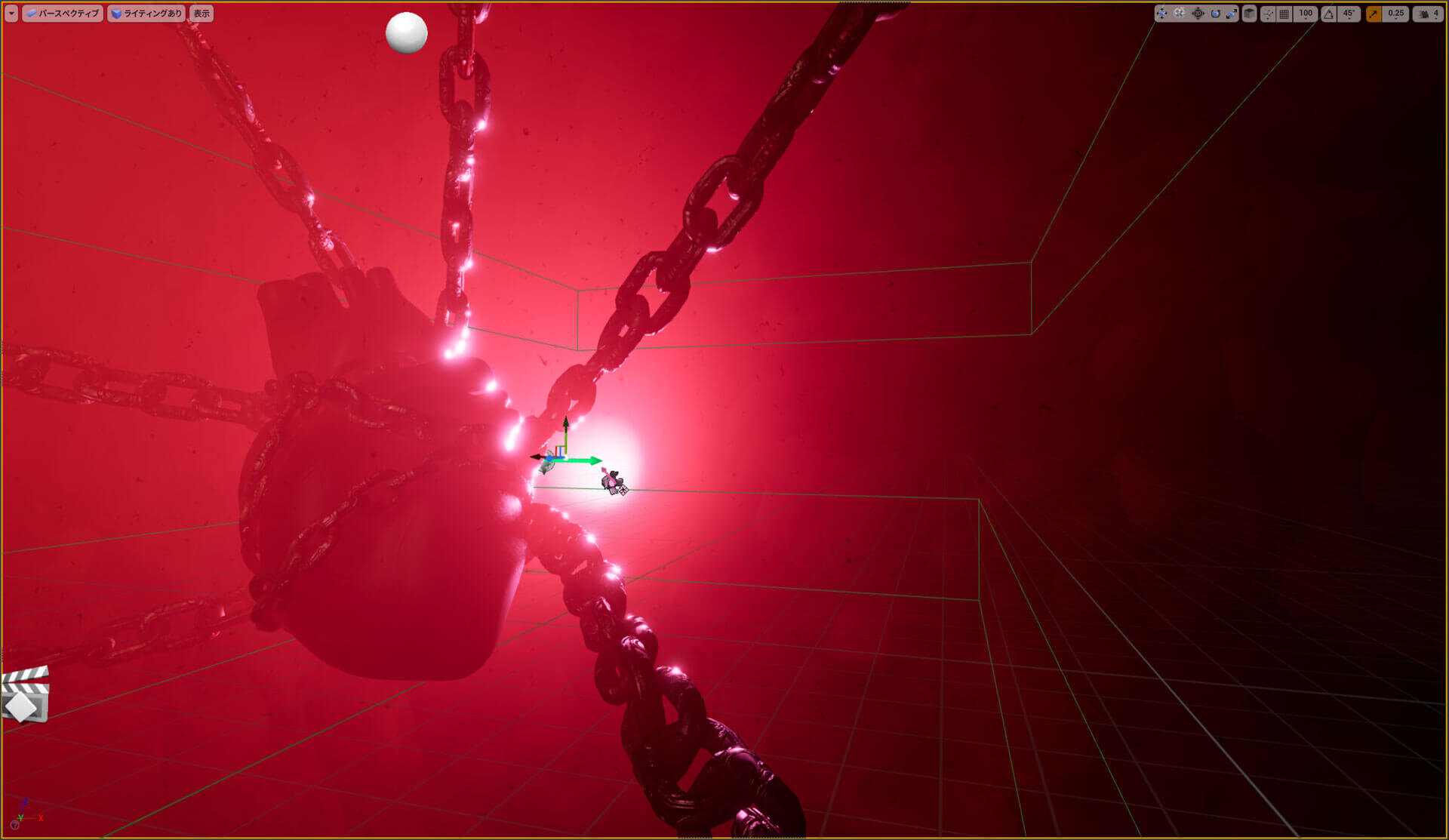

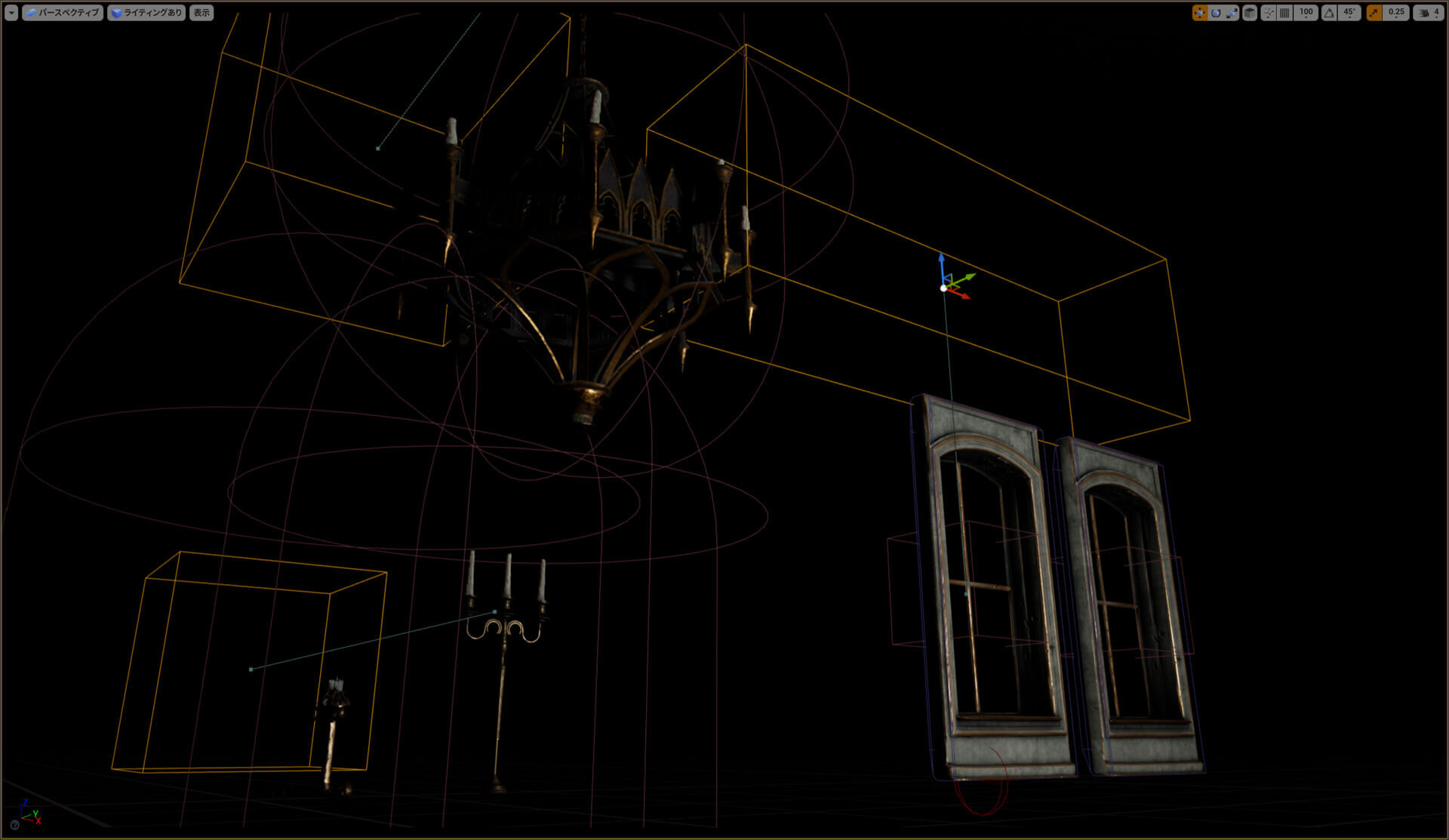

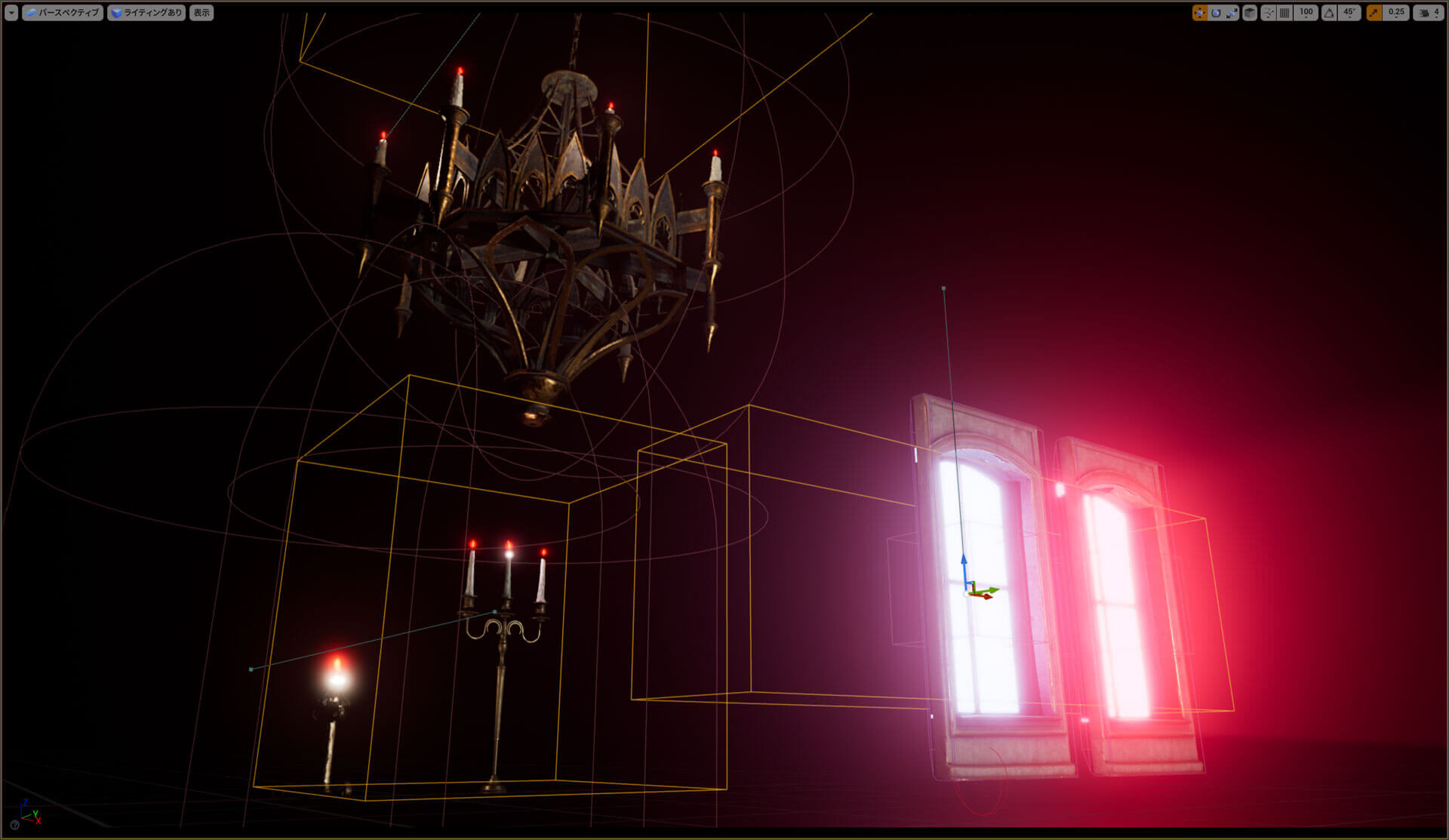

2曲目の「Devil in Your Heart」は、洋館の中を移動しながら演奏していくという演出だ。部屋の壁のベースモデルはMegascansを使い、テクスチャはSubstance 3D Painterでオリジナルなものにしている。その壁や床を、手作業ではなくブループリントでパラメータを使って配列し、ステージを構成している。心臓や鎖のアニメーションは3ds Maxのキーフレームで付けたものをUEにインポートしている。フォグはUEの疑似FluidのツールであるFluidNinja VFX Toolsを使い、ボリュームは標準のものだ。照明の調整などの最終的な画づくりはUE内で行なっている。長い廊下を移動するシーンは実際に長い廊下をつくって素早く動かすことで、相対的にプレイヤーが移動しているように見せている。また、disguiseの仕様上でタイムラインを複数保持してカットを切り替えることができなかったため、1つのシーケンサーの中で複数カットをむりやり入れ込んでいる。「カットを割れないのでゴリ押しでつくっていったのがおもしろかったです。UEは長いシーンをつくっても割と動くので助かりました」とCGディレクターの小田島義行氏はふり返った。

細分化した地面と隆起アニメーション

-

最終的にY方向へのみ押し出すため隣接するオブジェクトに干渉しない棒状になるように、いったんPlaneを割ってからShellで厚みを付ける -

Displacement用UVの設定。Vertexが個別に動かないようにパーティクルごとに単一のUVを割り当てる。各パーティクルのPivot位置でガイドオブジェクトのUVを参照している

シェーダによるノイズ表現

1シーンで構成した曲中舞台

UE4での質感&VFX表現

コリジョンを用いた照明制御

<3>「Light it up」&「The Rumbling featuring 進撃の巨人」

flapper3らしい3曲目と『進撃の巨人』の4曲目

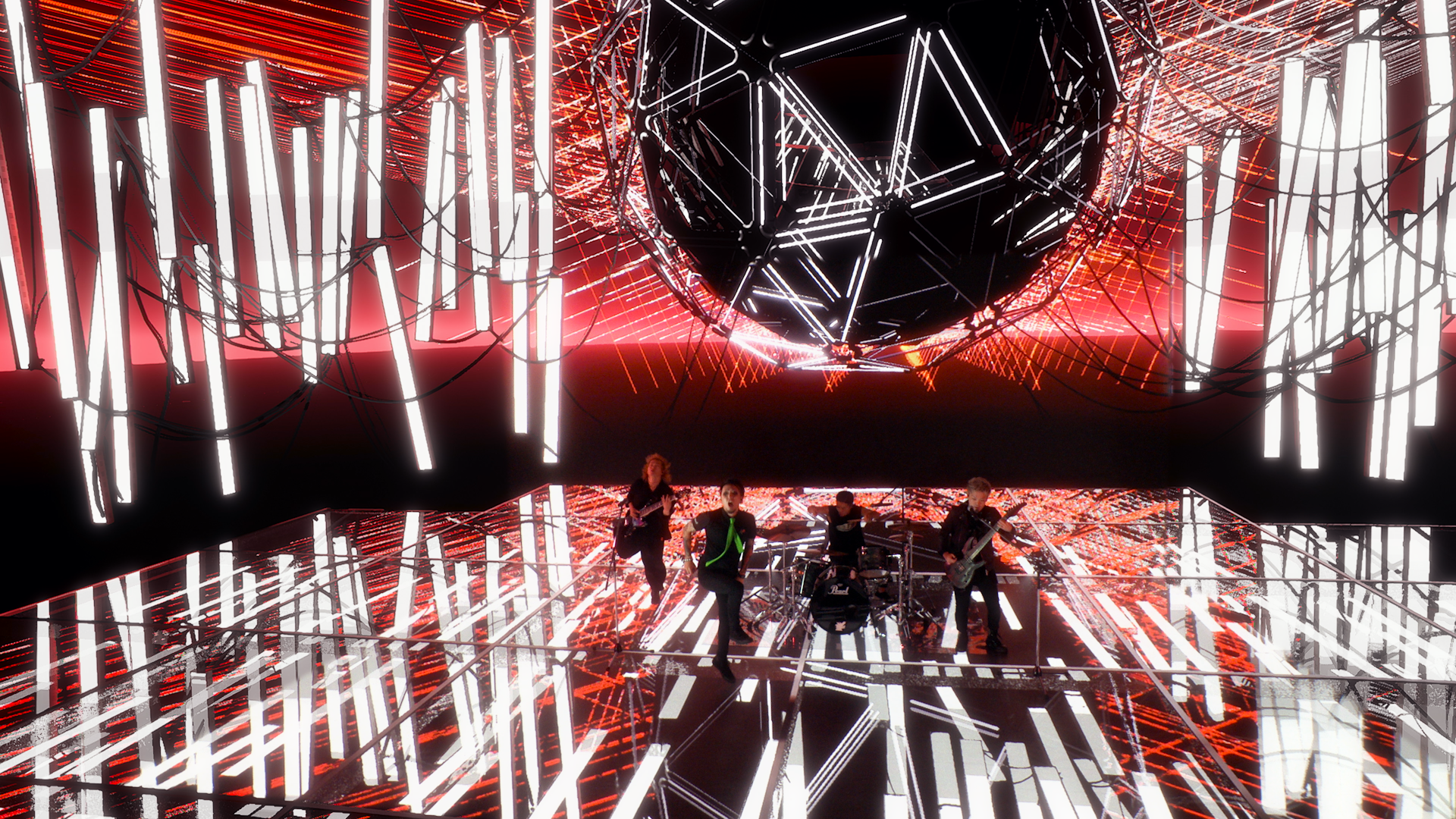

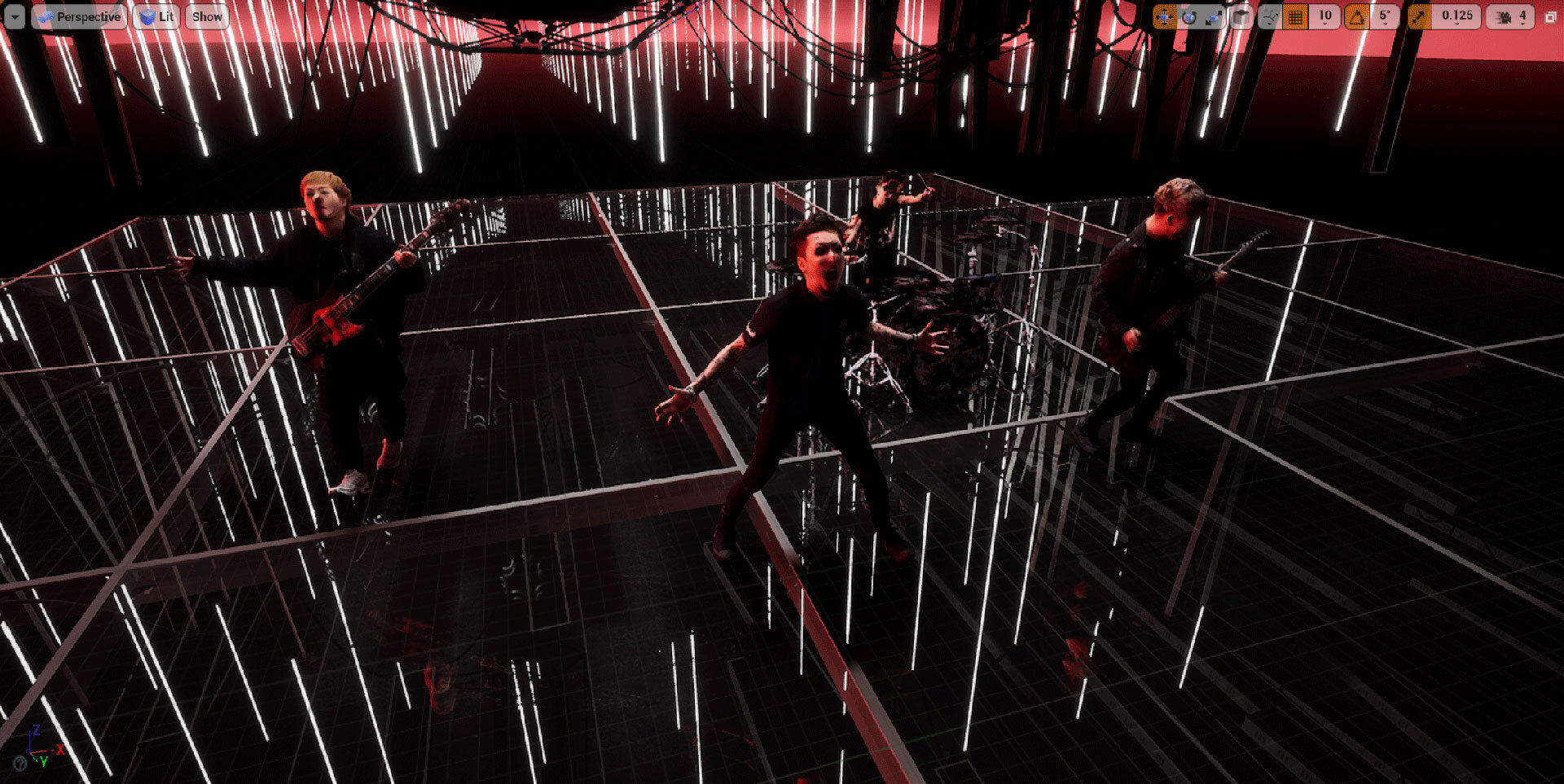

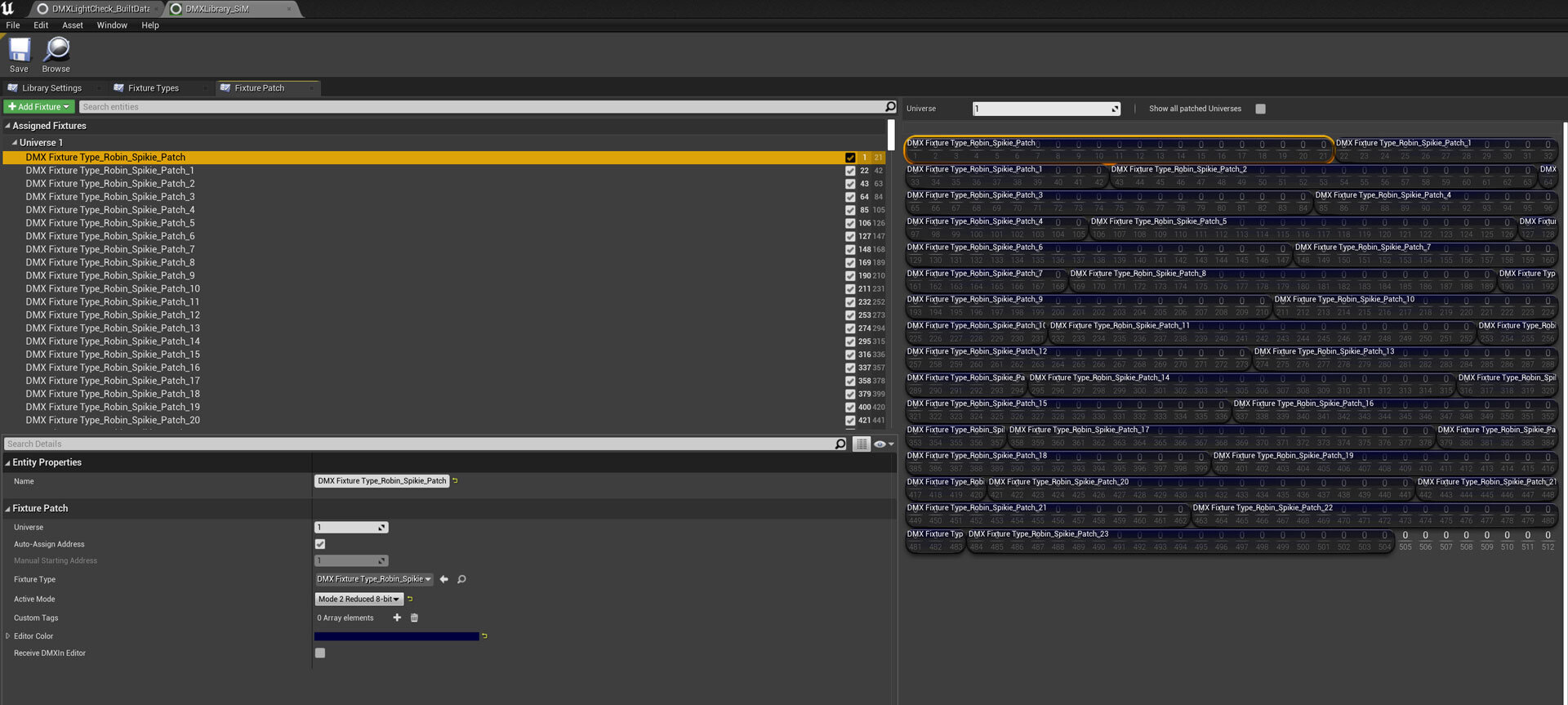

3曲目の「Light it up」は、もっともflapper3らしいという評判のノリのいい演出だ。負荷の高いレイトレースの処理を、UEのハイブリッドレイトレースを使って効率良く効果的に表現している。暗い中で光が飛び交う演出はLEDウォールと相性が良く、カメラ検証のときに一番見映えが良かったという。懸念していた床への影も、実際の床への反射もあり気にならなかった。背景のビーム照明は初め800本ほど使っていたが、再生負荷的に厳しく、最終的には600本に削減した。このビーム照明は、実際の照明オペレーターが照明用のソフトで組んだものをUEにインポートして配置している。制御も同様に、照明用ソフトでプログラムを組んだものをDMXで送信してUEで受信している。同社はARライブの仕事も多く、照明への造詣が深い。実照明とバーチャルの照明の角度を合わせたり、LEDにNDIのソースを流し込んだりするのは以前の経験からのノウハウだ。どうしてもUEやUnityの中だと、実際の照明とは異なる挙動になってしまうため、専門の照明シミュレータを使ってUEで信号だけ受け取ってUE内でRECしている。「この曲が一番心配でしたが、検証のときに一番見映えが良かった。ライブ感やVJノリが出ていて、もっとも当社らしいステージでした」と矢向氏。ノリが良く進んで、制作時間は4曲中で最も短かったという。

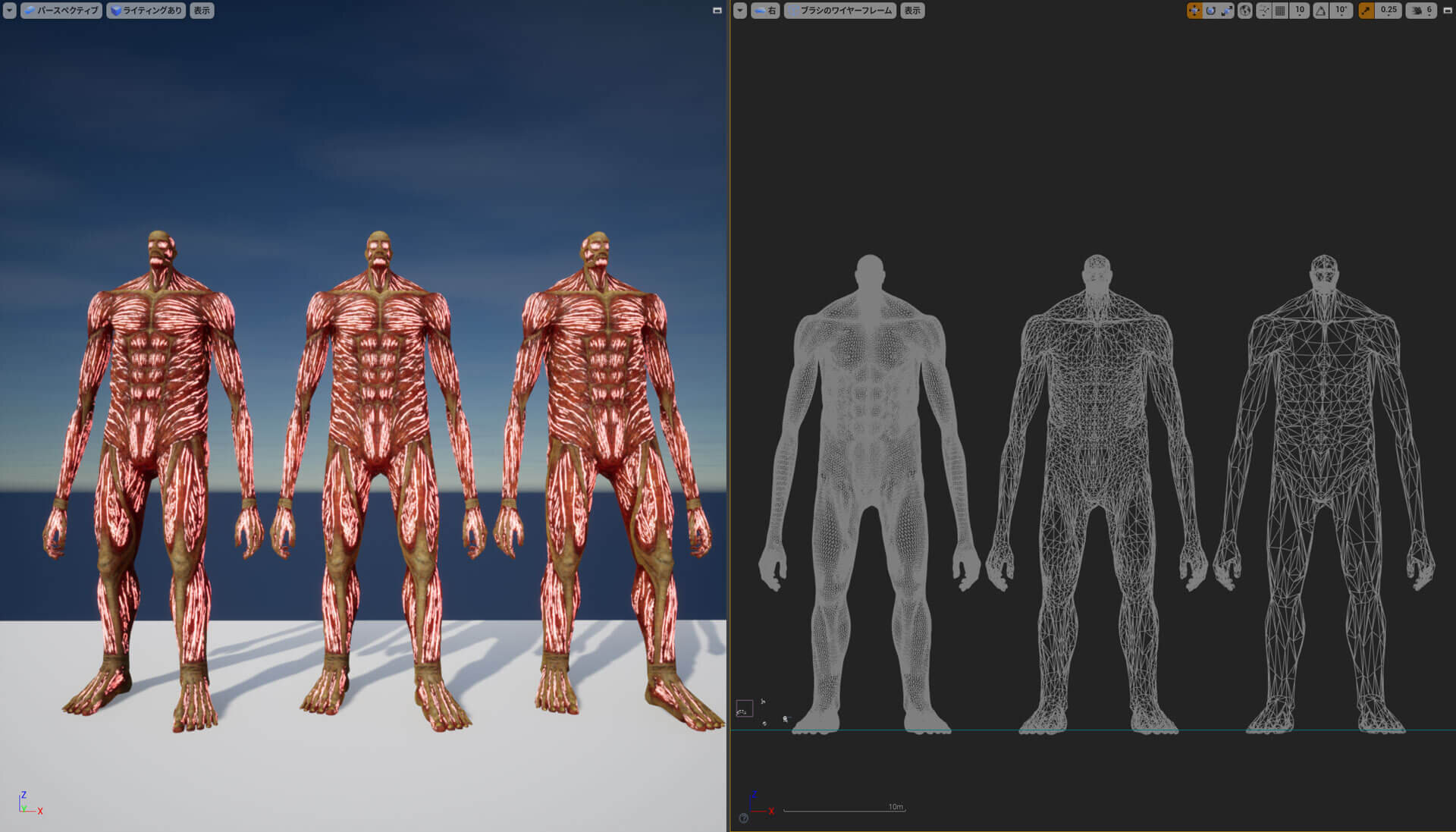

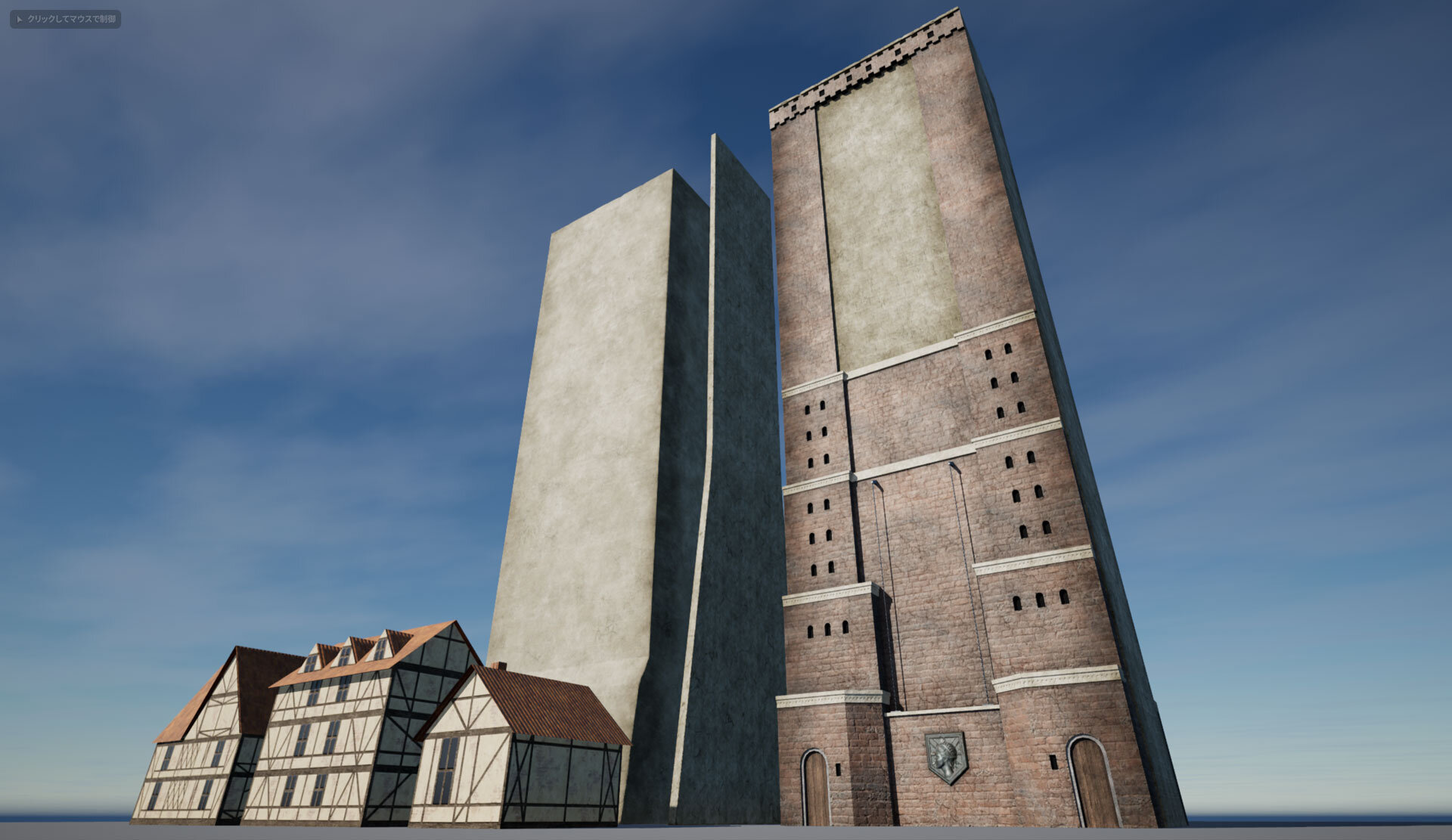

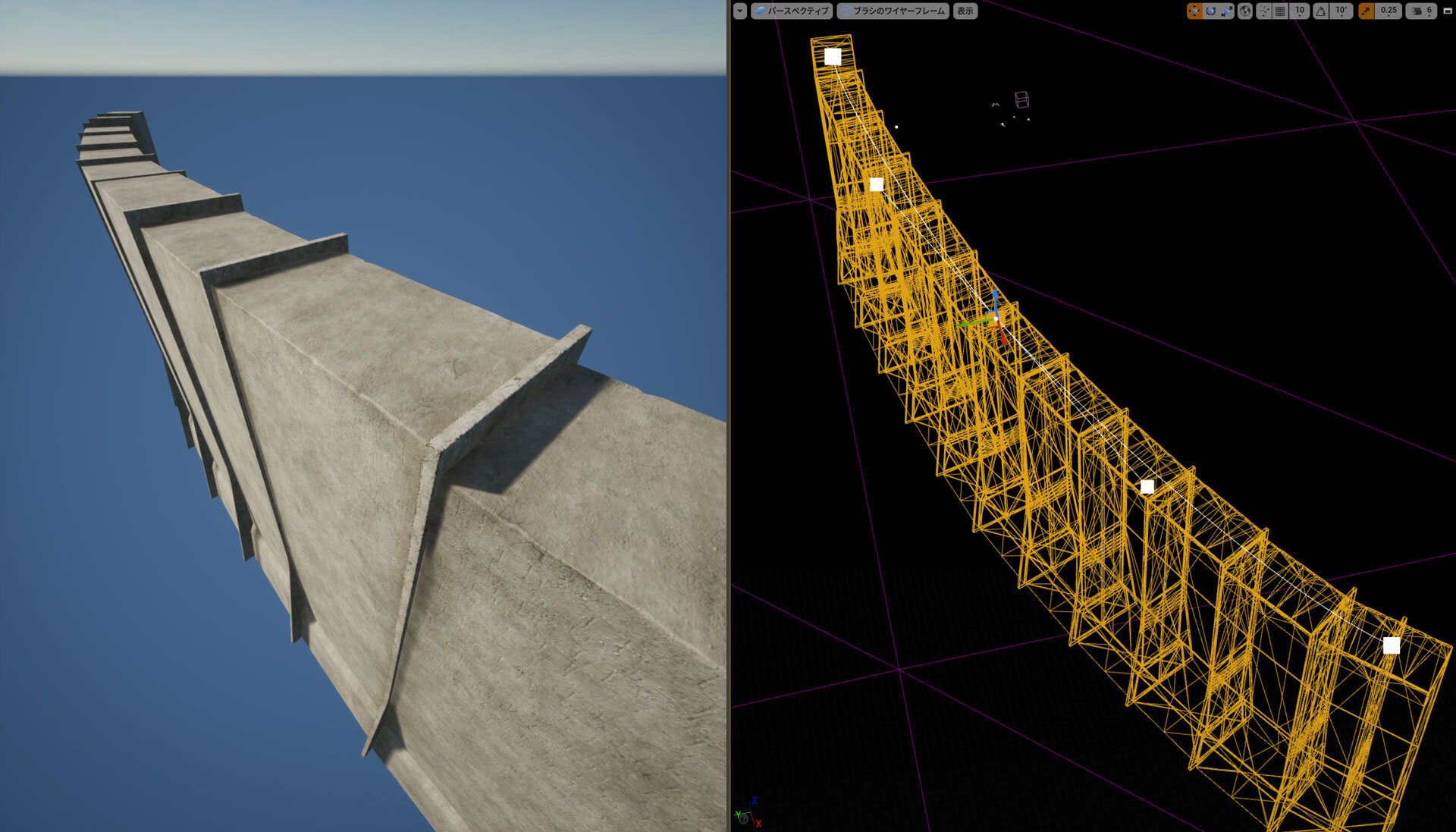

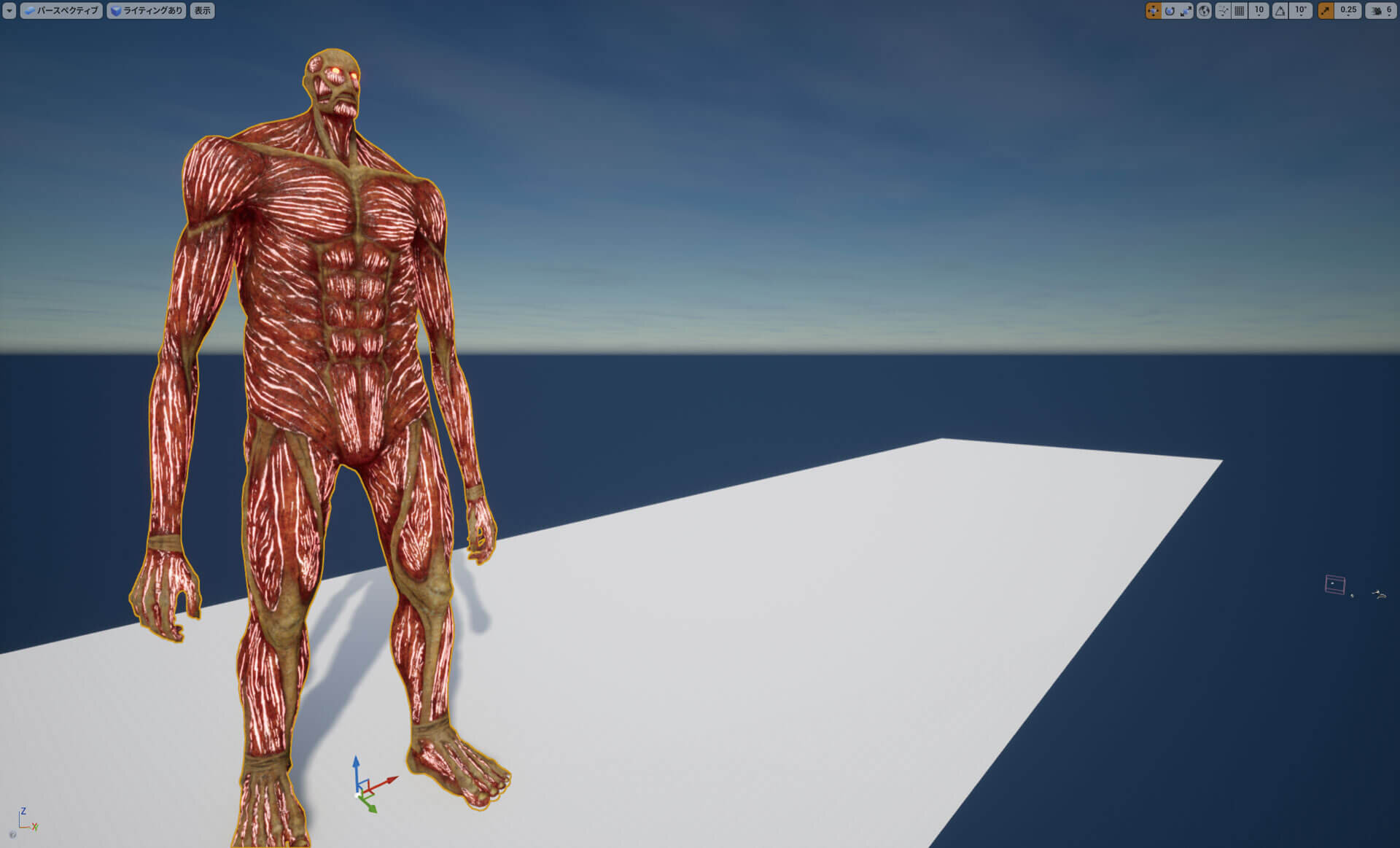

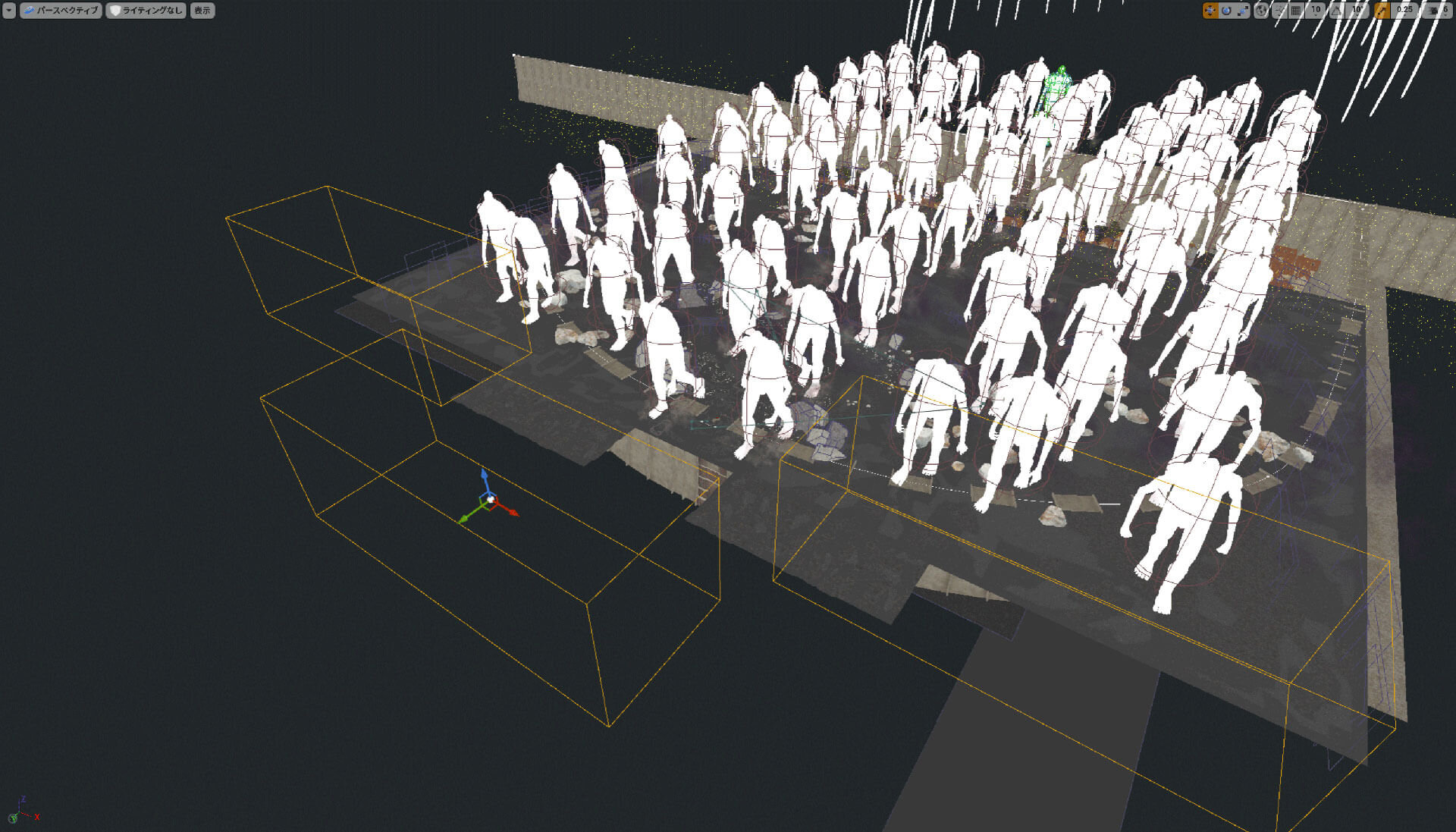

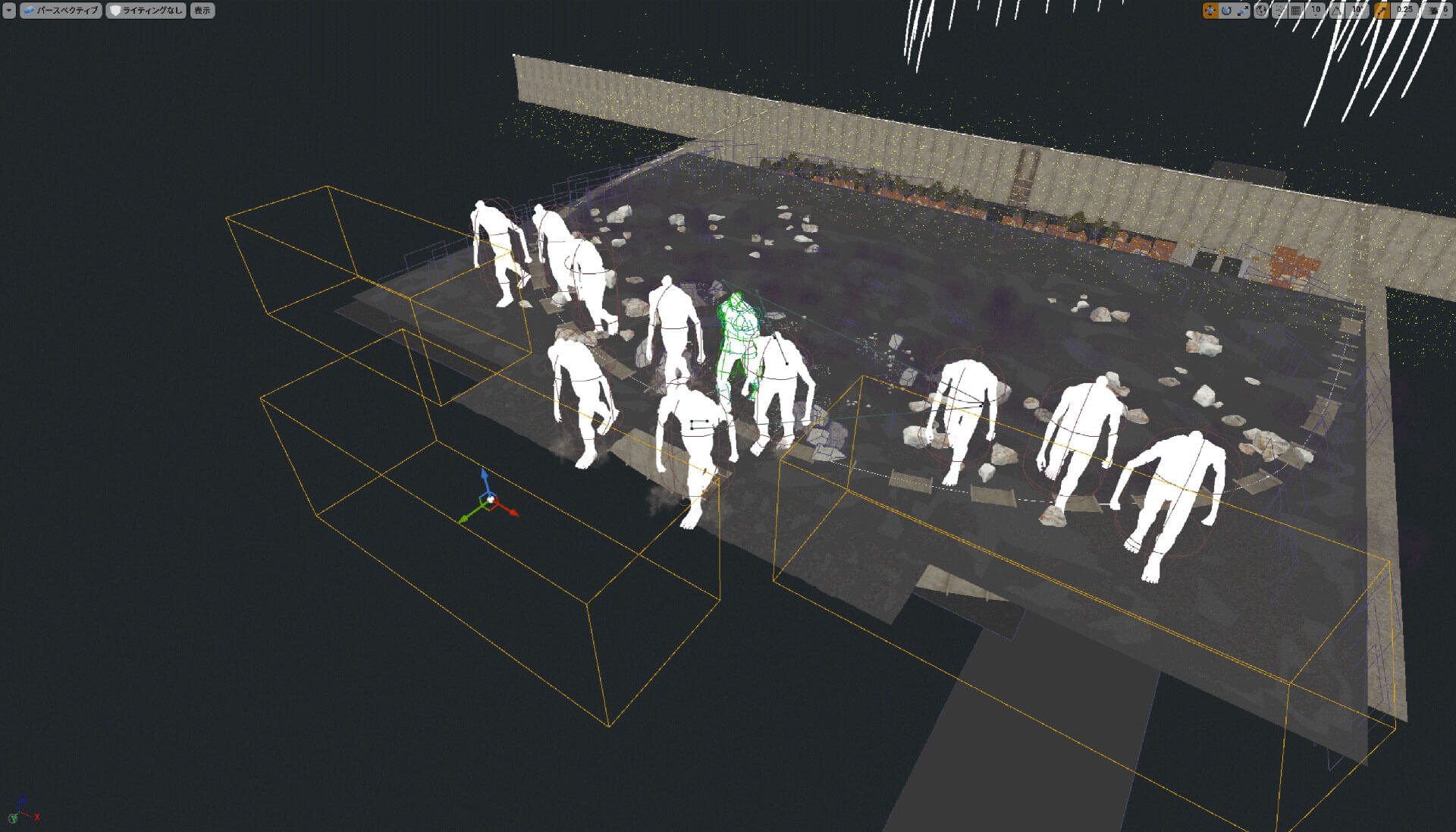

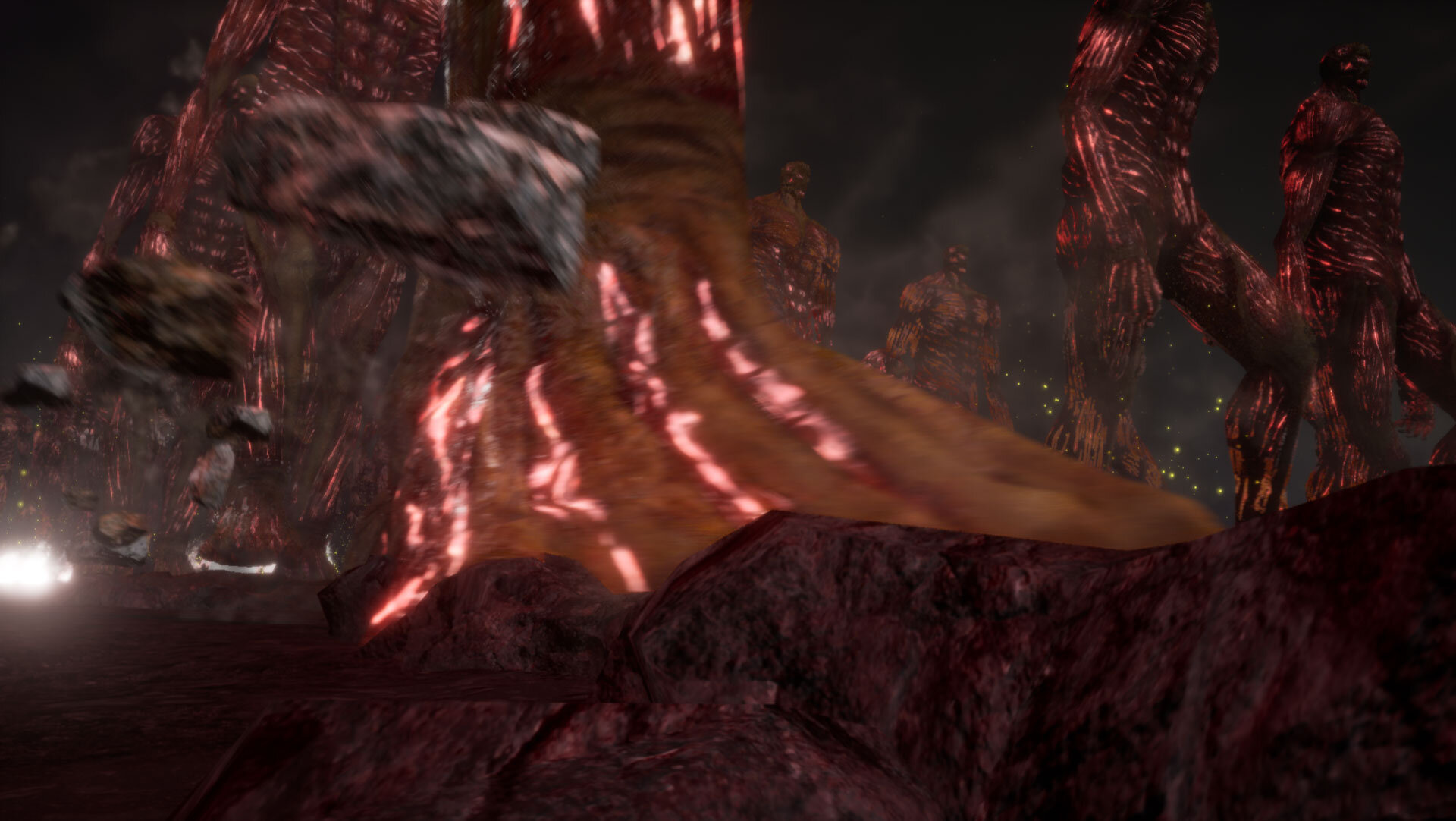

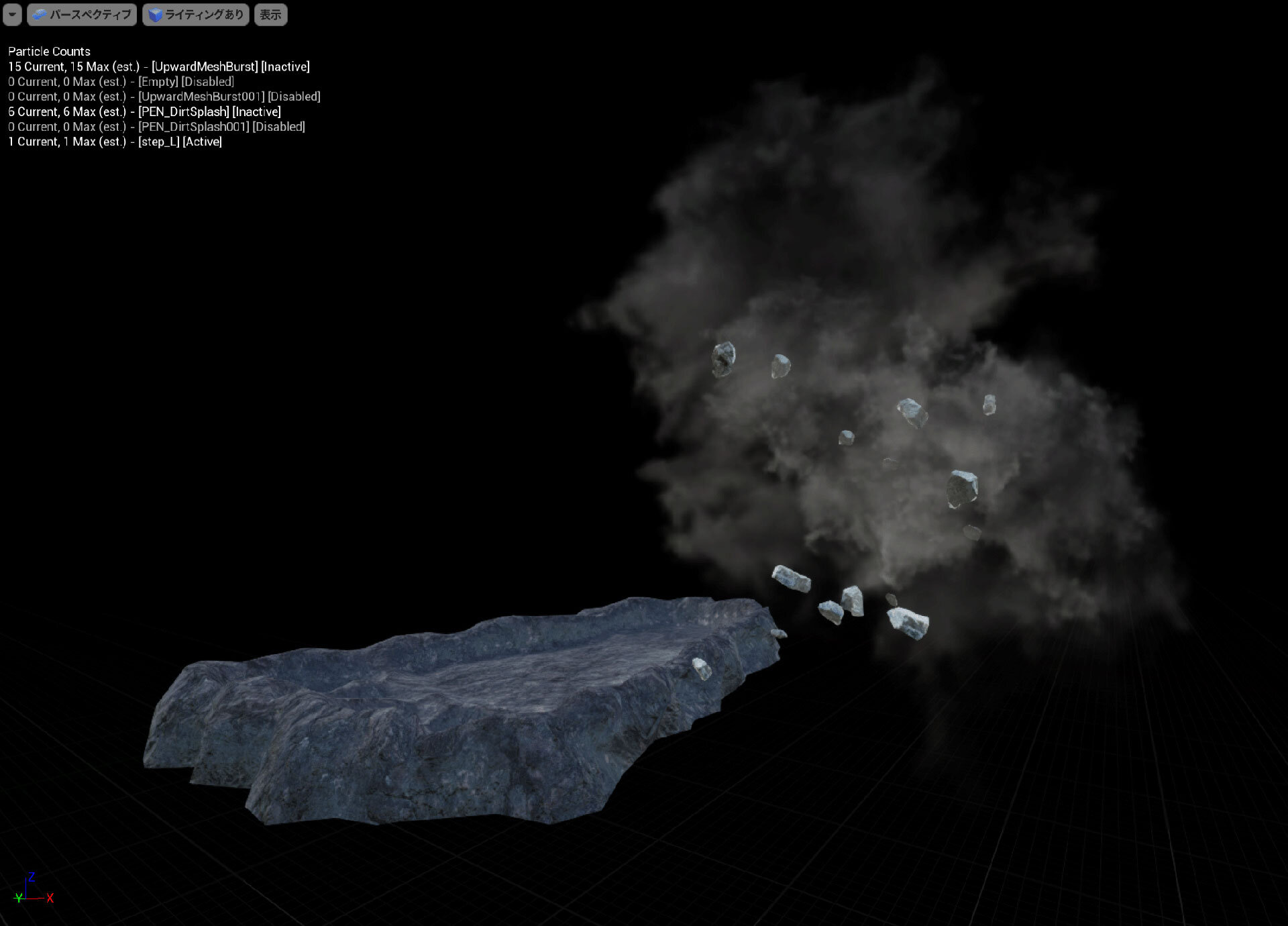

最後の『The Rumbling featuring 進撃の巨人』は原作ありきで、その世界観を現実に拡張するというような趣旨だ。壁の上で歌うところからスタートし、クライマックスでは巨人の行進が始まる。ここでもシーケンサーの仕様でカットの切り替えができないため、反転などを使って音に合わせて切り替えている。現場のdisguiseチームが一番苦戦したのがこの曲だったという。理由は重さよりもカラーグレーディングで、シンプルな赤いシーンのためごまかしが効かず、難易度が高かったようだ。また、アセットの負荷も大きかった。巨人が画面から外れたら消したり、遠くはLODを落としたり、負荷を落とす工夫を重ねている。宙に舞うパーティクルの負荷も高く、現場で動きのカクツキを見ながら量を調整していった。同様に巨人の質感はSSSが入っていたが、負荷が高いので現場でOFFにした。足跡や瓦礫、煙なども残しておくと負荷が高くなるので、目立たないようにそっと消している。ちなみに、これらの設定は全て撮影前日に行われた。

大量の灯体制御

-

後方にあるビーム状のライト -

UE標準のDMXプラグイン(DMX Fixturesなど)を使うことで、実際のリアルライブで使用される照明卓で使われている制御信号「DMX」をUE 内で扱うことができる。照明制御用ソフト上で組んだ配置データをGDTF形式で出力し、CSVに変換したデータをインポートした

床面のリフレクション

ガラスの質感や反射が必須となるので、UEの設定からReflectionsとTranslucencyのRay Tracingを有効にしている

壁の上のブレイクダウン

-

壁と街のアセットモデル。制作はMORIE Inc.が担当 -

壁の配置はスプラインに沿って自動配置するようにブループリントで制作。ワールドポジションで汚れや高低差がランダムに決まる

巨人カットのブレイクダウ

画面を彩るVFX表現

月刊CGWORLD + digital video vol.294(2023年2月号)

特集:映画『すずめの戸締まり』

定価:1,540円(税込)

判型:A4ワイド

総ページ数:112

発売日:2023年1月10日

TEXT_石井勇夫(ねぎデ)

EDIT_藤井紀明(CGWORLD)/ Noriaki Fujii、山田桃子 / Momoko Yamada