[PR]

ここ数年で国内でのフェイシャルキャプチャの活用事例も多く見られるようになってきた。ゲーム『FINAL FANTASY XV(ファイナルファンタジーXV)』、映画『GANTZ:O』、映画『デスノート Light up the NEW world』、Virtual Human Projects『Saya』など、CGWORLDでもおなじみの作品での活用事例も増えている。

一方で"フェイシャルキャプチャ"と聞くと、とかく複雑な工程を想像し、敬遠してきた方もいるだろう。確かにこれまで主流だった光学式カメラによる収録においては、撮影エリアの関係から演者の動作に制限がかかってしまったり、大量のマーカーを正確に顔につけた上、その大量のマーカーから取得したデータを解析し、フェイシャルリグに落とし込む"職人技"のようなノウハウが必要だったため、その利用は数少ないプロダクションに限られていた。

だが、こうした問題点を解消して生まれたビデオベースによるフェイシャルキャプチャの登場により、高クオリティのフェイシャルキャプチャはより一層手軽になってきた。その代表格ともいえるDynamixyzのPerformer2

は精度の高さや簡便性から、上述の作品の他、国内外の様々な作品において利用されている。主にフルCG映画など、キャラクターの感情を精緻に表現する作品において使用される同製品だが、正確なリップシンクが可能なので短納期のプロジェクトやリアルタイムストリーミングのコンテンツにも使われているという。本稿ではプロダクション利用に目的を限り、Dynamixyzを用いたフェイシャルキャプチャの基本的な利用の流れとメリットを紹介していきたい。

TEXT・画像提供

渡邊英樹(motion studio Crank)

月刊誌CGWORLDにて編集長を勤め、2015年にmotion studio Crankを設立し、フィシャルキャプチャ、モーションキャプチャのサービスや、アプリ開発を行なう。映画『寄生獣 完結編』、NHK『ひよっこ』OP、VRプロジェクト『KIBADANCE』、三代目 J Soul Brothers from EXILE TRIBE 『J.S.B. DREAM』などでモーションキャプチャを担当、フランクミューラー ipadwall、フォルクスワーゲン 「東京モーターショー2015」ショーコンテンツなどの企画・制作も行なう

http://studio-crank.jp/

▲Dynamixyz使用事例をまとめたデモムービー。国内外の様々なハイエンドのゲームタイトル・映画作品やMVやアニメーションに用いられている

▲AnimatrikによるDynamixyzを活用したライブモーションキャプチャ

■1:ビデオ撮影

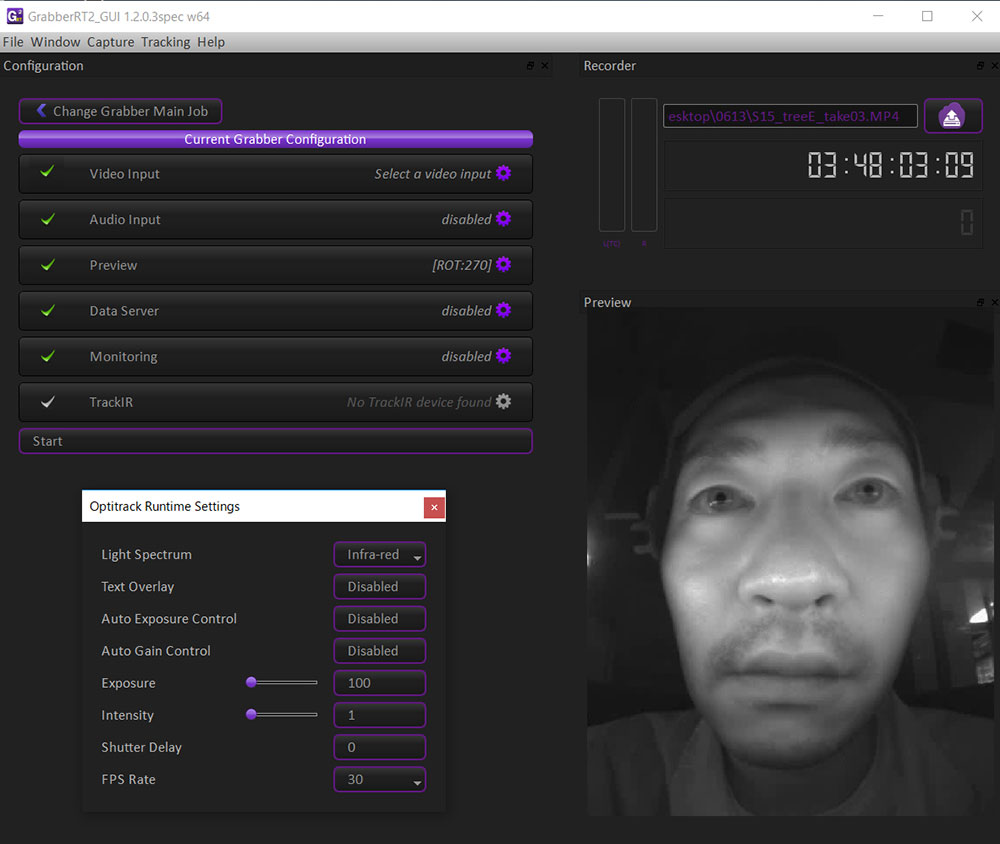

Dynamixyzが提供するビデオベース フェイシャルキャプチャソリューションは、ビデオ撮影用のソフトGrabberと、動画解析からリターゲティングまでを行なうPeformer 2という2つのソフトによって構成されている。

この2つのソフトを用いて、

■1:ビデオ撮影 → ■2:アナライズ(動画解析) → ■3:リターゲティングという流れで作業が行なわれる。下記では■1:ビデオ撮影について解説したい。

まずは機材について。ヘッドマウントカメラに関してはDynamixyz社から純正品も出ているが、他社製品であっても問題はないし、ヘッドマウントカメラがない場合には固定カメラでの撮影でも問題はない。(ただし、固定カメラを用いる際には基本的にカメラに顔を正対させるという動きの制限はあることに気を付けておこう)

▼Dynamixyzのヘッドマウントカメラの標準モデル

次にビデオを撮影する際の注意点についてだが、顔全体を正面から、なるべく中心から捉えるようにするのが好ましい。カメラ位置を下にし過ぎると、顔の上部の動きの変化を認識しずらくなっていまう。また、ビデオベースで表情を解析(アナライズ)するため、極端なライティングの変化が起こらないように配慮する必要がある。

なお、アクターが演技するカットをそのまま撮影してもアナライズ・リターゲティングを行なうこともできるが、基本となる表情のパターンを撮影したROMビデオを撮ることで、後のアニメーション制作効率を大きく向上させることが可能になる。アクターの表情ごとにプロファイルを蓄積しておくことで、例えば、別日に撮影したカットのビデオであっても素早くフェイシャルアニメーションを生成することができるのだ。このROMビデオを用いたアナライズ・リターゲティングがDynamixyzの大きな利点の1つだと言えよう。

▲Grabberの画面。こちらはDynamixyzのカメラを使った例であるが、カメラセッティングオプションにて、ライト種類(可視光、赤外光)やインテンシティなどの設定を行なえる

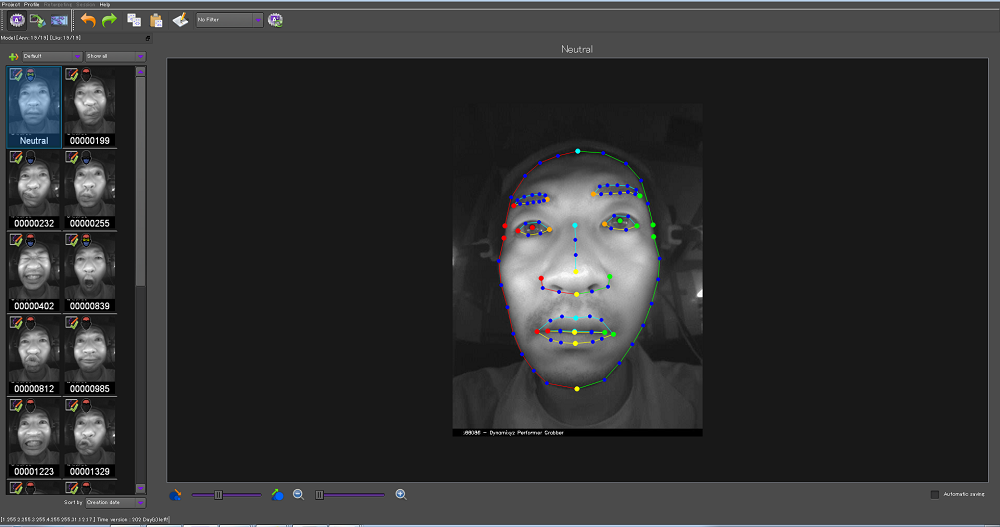

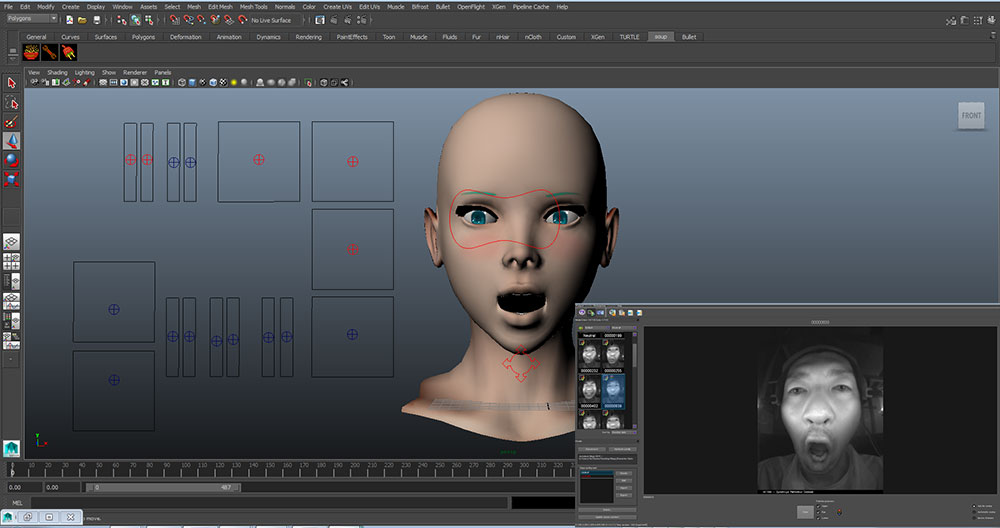

■2:アナライズ(動画解析)

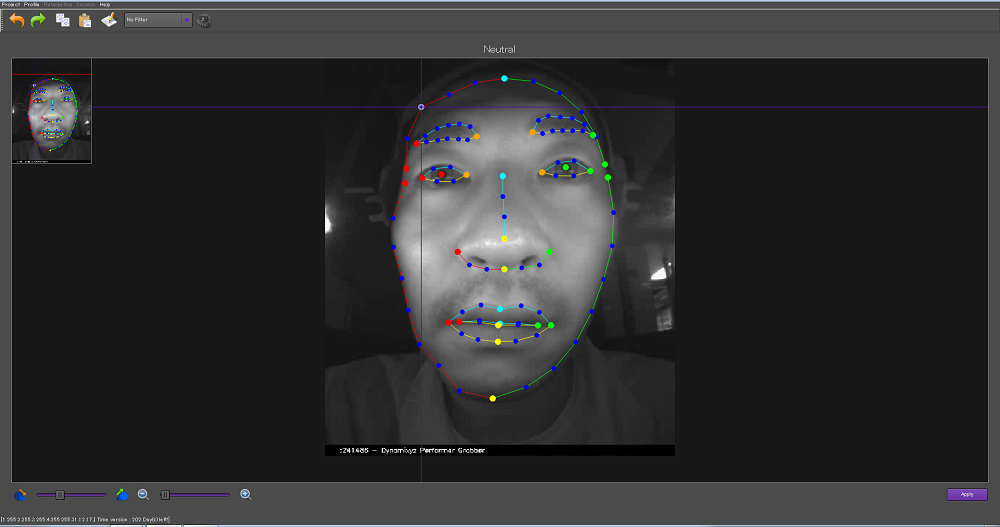

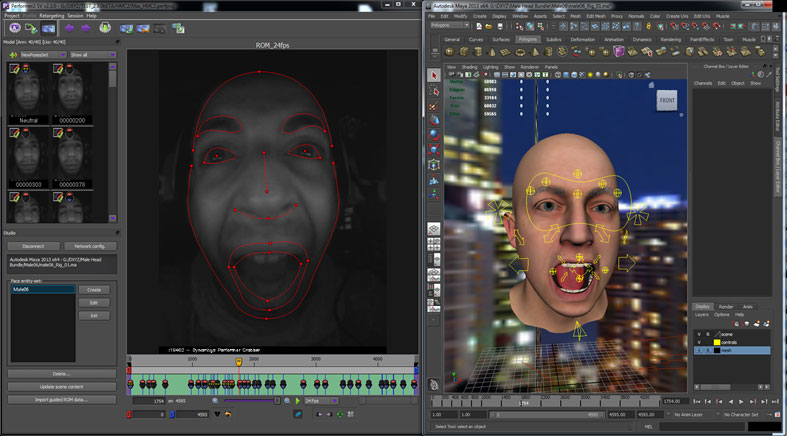

ビデオ撮影が完了したら、次はアナライズ(動画解析)作業となる。ここからPerformer 2での作業となるが、まずはインターフェイス画像を見ていただきたい。Performer2は、トラッキングモード(1)、リターゲティングモード(2)、セッションモード(3)に分かれている。各モードでの作業内容は以下一連の作業解説の中で紹介していく。

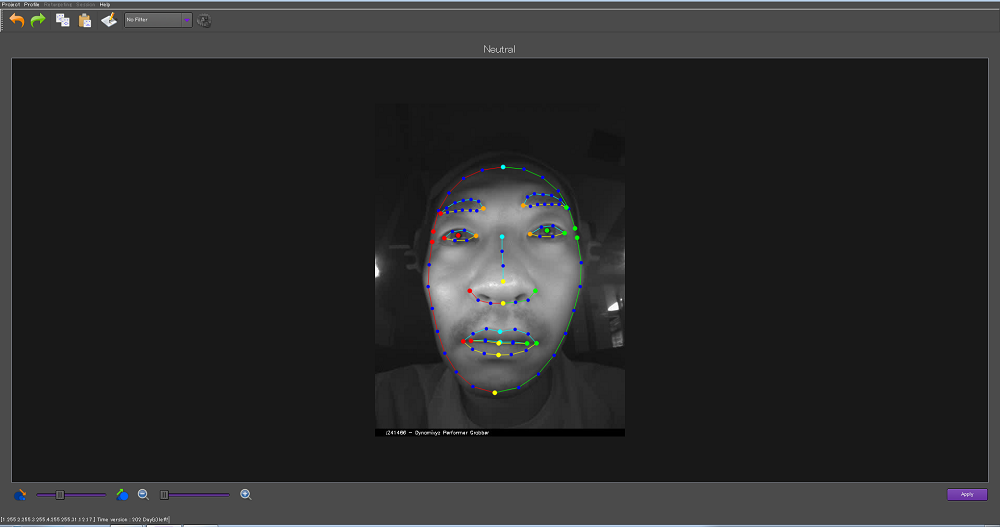

▲(1)トラッキングモード。トラッキングプロファイルに登録した表情のトラッキング

▲(1)トラッキングモード。トラッキングプロファイルに登録した表情のトラッキング

▲(2)リターゲティングモード。リターゲティングに関わるCGリンクを行なうモード

▲(3)セッションモード。読み込んだビデオの管理やアニメーションの流し込みを行なうモード

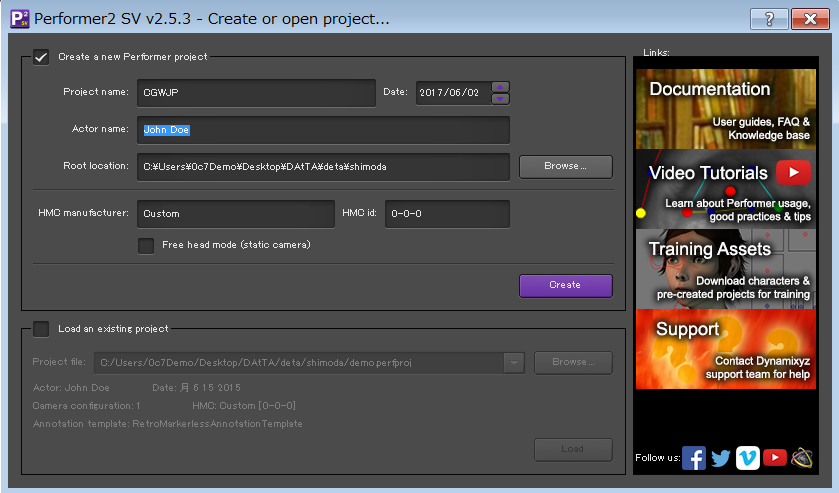

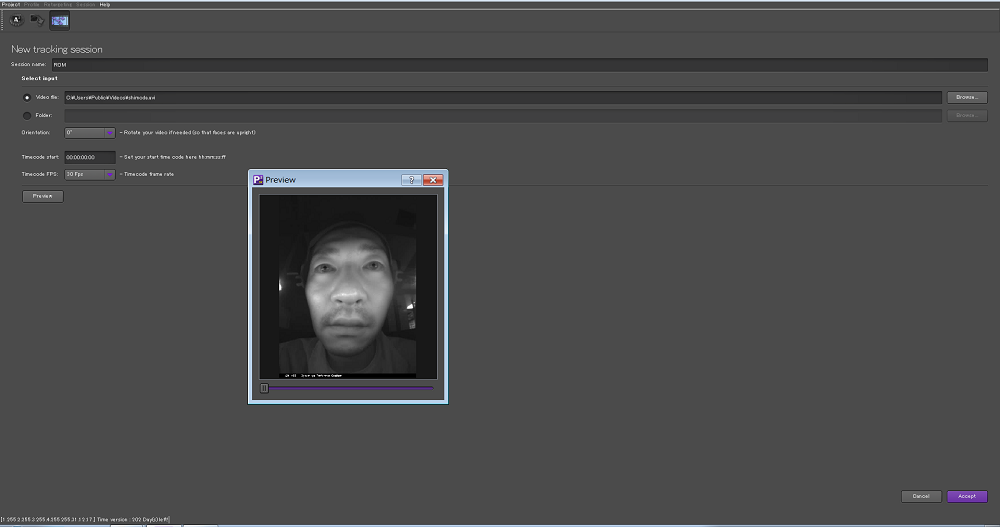

Performer 2を立ち上げ、まずはプロジェクト名などの必要項目を入力(4)。次にビデオを読む込む(5)。ビデオの読み込みが完了するとスライダーで動画を確認できるようになる(6)。

▲(4)アクター情報なども入力して管理することができる

▲(5)プレビューにて動画を確認可能。カメラによってはアングルを調整する必要がある

▲(6)ビデオの読み込みが完了。下部のスライダーを動かしてニュートラルの表情を指定

ここで最初に行なうのが、ニュートラルな表情の指定だ。ニュートラルな表情は、正面を向いた無表情のものがベストであるが、作業上の基本となる表情であれば問題はない。スライダーを動かしニュートラルを指定すると境界線・マーカーが配置される(下左)。ただしこれはソフトウェアが自動認識で仮配置しているだけであるため、ビデオの状態によっては大きく外れることもある。このズレをまず手で調整し直す必要がある(下右)。ポイントの調整は、左クリックでマーカーポイントを単体で、右クリックでグループ選択できるほか、Shiftキーで複数選択して動かすこともでき、簡単に行なえる。

▲【左】ソフトウェアが自動的に感知してマーカーポイントを仮配置してくれる

【右】目や口、輪郭などのマーカーポイントのずれを調整する

この調整が完了すると、ビデオを解析するための「トラッキングプロファイル」が生成され、トラッキングモードとセッションモードでの作業が行なえるようになる。最初に生成されたトラッキングプロファイルはニュートラルの表情のみの情報となるため、以降はセッションモードでビデオから必要なフレームを抜き出し様々な表情を追加して、トラッキングモードでマーカーポイントの位置を調整し、トラッキングプロファイルを充実させていく流れとなる。トラッキングプロファイル内の参照される情報が充実されればされる程、トラッキング精度が上がっていくというものだ。

▲完成したトラッキングプロファイル。ビデオの尺や表情のバリエーションによって、必要となるフレーム数は異なる

では、トラッキングプロファイルに、どれだけの表情を登録しておく必要があるかだが、ビデオの尺や表情のバリエーションによって必要となるフレーム数は異なるが、15秒くらいの尺のビデオであれば10フレーム分いれておけば問題なくビデオ全体をトラッキングできる。なお、ROMビデオを使用する場合は、60種程度の表情を入れておくのが一般的である。

■3:リターゲティング(アニメーションの流し込み)

トラッキングプロファイルの完成後は、いよいよリターゲティングの作業となる。Bridgeというプラグインを用いて、CGソフトとPerformer2を行き来して作業を行う流れとなるが、リターゲティングの原理を簡単に言うと、先に作成したトラッキングプロファイルに登録されている表情毎に、CGキャラクターの表情を作り保存して、リンク(CGリンク)するというものだ。では、実際にそのCGリンクを行ない、アニメーションを流し込む作業を下記で紹介していく。

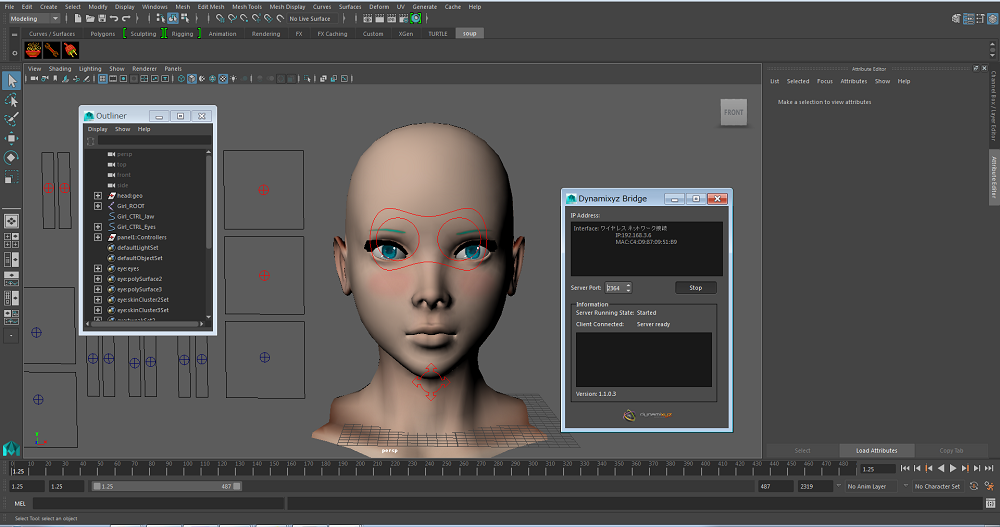

CGソフト側(ここではMaya)でBridgeプラグインを立ち上げクリック(下)。 それに合わせてPerformer2からもコネクトする。コネクトされた後、まず最初に行なうのが、エンティティセットの作成だ。これは流し込み先の登録で、流し込みに必要な骨を選ぶこととなる。この流し込み先の登録と聞くと複雑に感じられる方も多いと思うが、この登録が非常に簡単であることにみなさん驚くことだろう。CGソフト側のビューポート上で動かしたい部位のコントローラーを選択した状態で、Perfomer2側のボタンをクリックするだけでいいのだ。最上位あるコントローラーさえ登録すれば、下位に従属するリグなどを個別に選ぶ必要はないというのだ。

▲Bridgeの起動。Mayaの場合はMELコマンドに「dxyzBridge」と入力すれば立ち上がる。ポート等は自動で検知してくれる

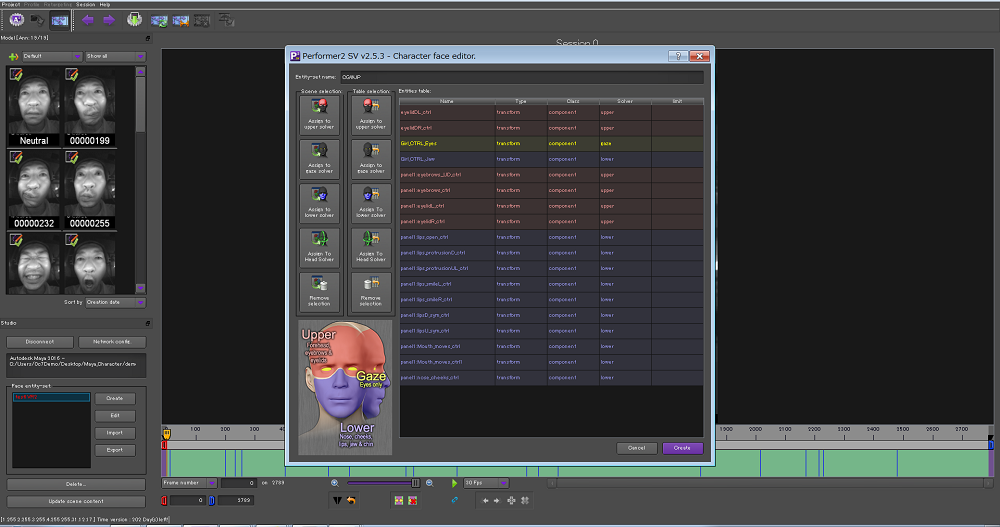

ものの5分もあれば、このエンティティセットは完成してしまう。ただし、登録する際には1点だけルールがあり、UPPER(眉、額、瞼)、LOWER(鼻、頬、口)、GAZE(目)と分ける必要がある(下)。とは言え、これも登録ボタンが分かれているので、非常に簡単に区分けすることができる。

▲UPPER(眉、額、瞼)、LOWER(鼻、頬、口)、GAZE(目)と区分けして登録

エンティティセットの登録が完了すれば、CGリンクの作業に移る。Performer2でトラッキングプロファイルに登録された表情に対して、Maya上でCGキャラクターの表情を作っていく。このCGリンクまでを行なったものをリターゲティングプロファイルといい、このプロファイルを作成する流れを以下に紹介していく。

ソフトをコネクトし、エンティティセットが作成されると、リターゲティングモードが使用可能となり、以降の作業はここで行なう。Performer2のリターゲティングに並ぶフレーム画像を選択した状態で、Maya上で表情を作成し、Performer2で保存する。

▲CGリンクを行なっている様子。Mayaにて表情を作り、Perfomer 2で保存していく

この作業をリターゲティングプロファイルに含まれる表情分繰り返す。こう聞くと煩わしく手間のかかる作業と思われるかもしれないが、15秒尺のビデオであれば10枚程度の表情登録だけでトラッキングが可能と前述した通り、10個の表情のキーを打つだけで一連のアニメーションが生成できるとなると、非常に効率的だということがご理解いただけるだろう。また、このCGリンクの作業で、アニメーターが直接表情を作れるということは、アニメーターが意図する表情をしっかりと反映させることができるということである。この当たりがDynamixyz社が考える大きなコンセプトであり、機械的にCGキャラクターを動かすのではなく、意図した表情を盛り込みエモーショナルにキャラクターを動かすというものだ。

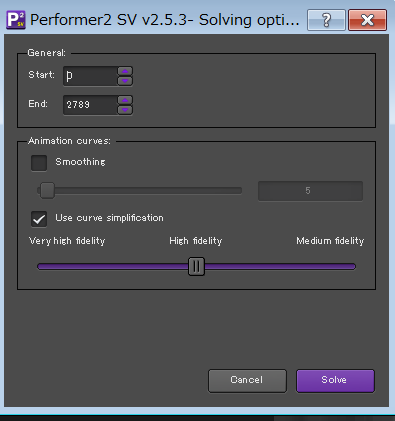

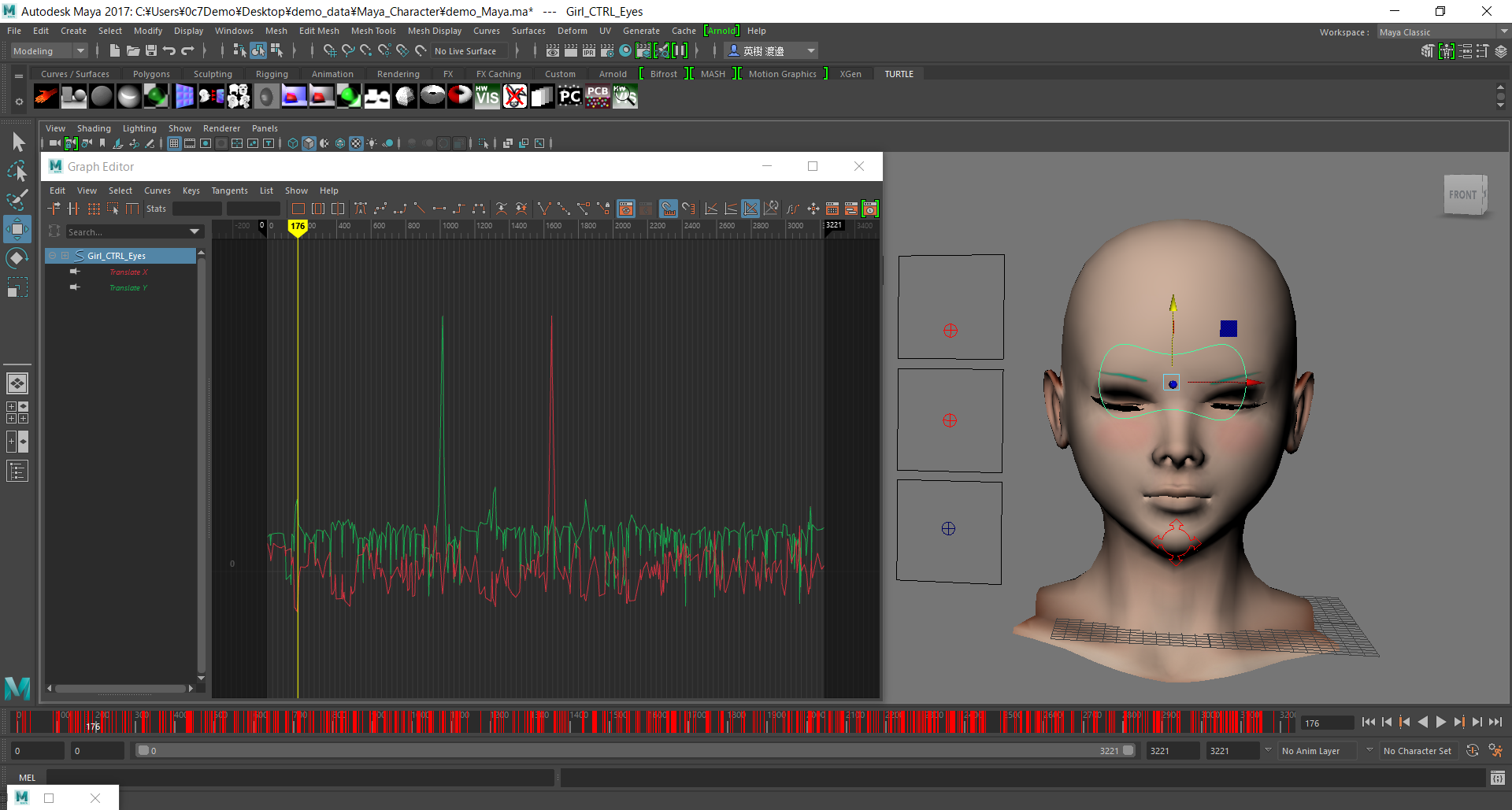

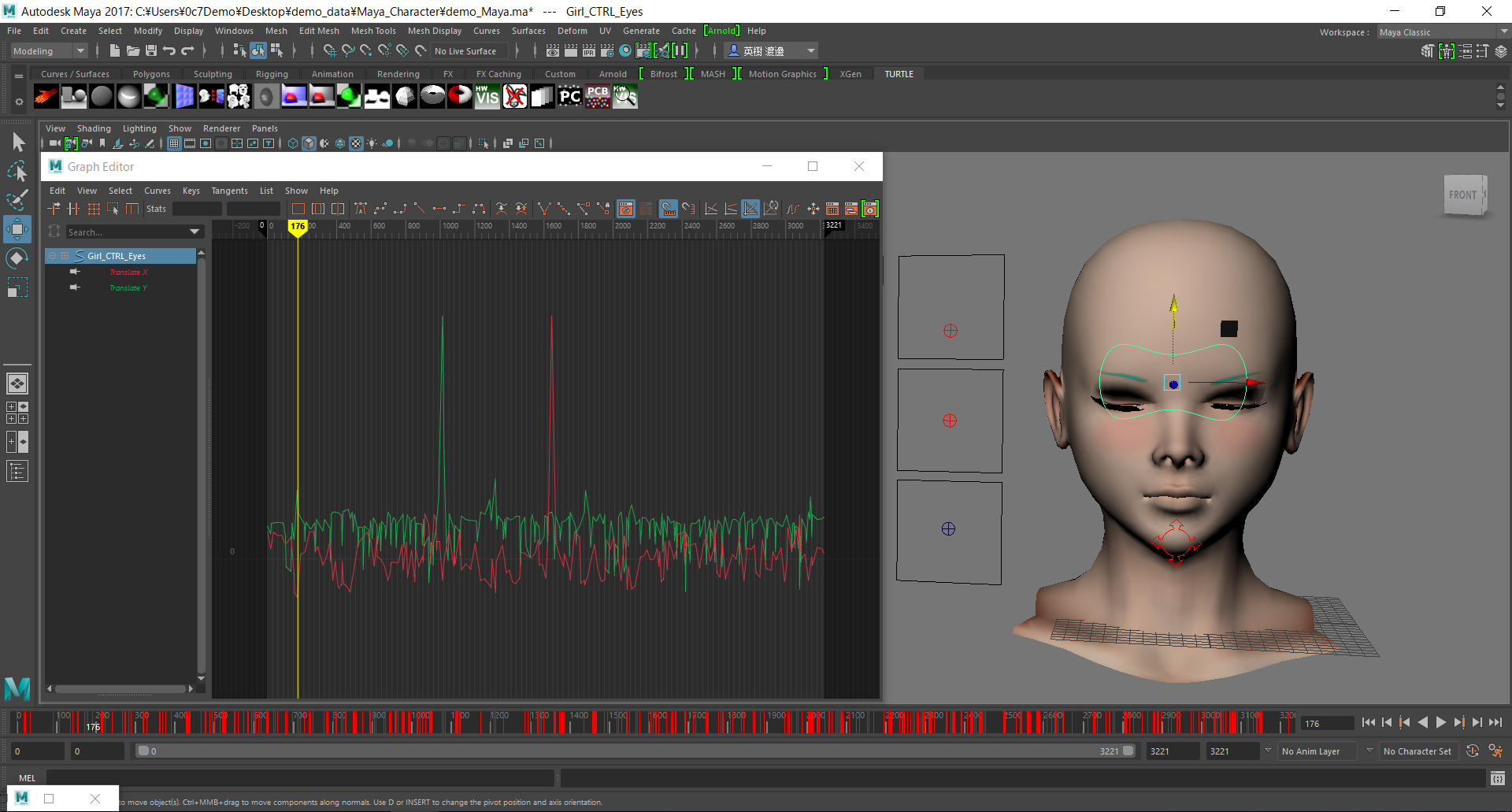

こうしてリターゲティングプロファイルの完成後は、アニメーションの流し込みだから、セッションモードからSolveボタンだけで完了する。

▲Solveを行なう設定。キーの数やノイズフィルターの強弱などの設定

▲上がハイクオリティ、下がミドルクオリティで流しこんだ結果(カーブは目のコントローラのもの)。タイムライン上のキーの数が減っているが、カーブ自体は大きく変化していないことが確認できる。フルキーのデータでない上に、キーの数を調整できるため、編集が行ないやすい

効率的なアニメーション制作を実現するために

作業の流れを一連で紹介してきたが、概ねの流れは理解いただけただろうか。他のフェイシャルキャプチャソフトを使用中の方は、思ったより手がかかると感じられた部分もあることだろう。

しかし、Performer2は、前述した通り、アニメーターの手が入りやすく意図した表情を盛り込んだキャプチャデータとして運用できることが大きなメリットとなっている。さらに、冒頭のワークフローの項で説明した通り、ROMビデオを作成すれば、同じアクターであれば異なるビデオも解析し、アニメーションを生成することが可能なため、初期セットアップにコストがかかるがビデオが多ければ多い程、後の量産性が高くなるという利点もある。大規模プロジェクトで使用される理由が、ここにあると言う訳だ。

現在ゼロシーセブンでは、 リターゲティング無料体験キャンペーンを行なっているとのこと。ゼロシーセブンが準備しているビデオと解析ファイルで、手持ちのCGキャラクターモデルにアニメーションの流し込みを無料で行なってくれるというものだ。ただし、異なるビデオで試したいというのであれば、トライアルライセンスの貸し出し、もしくは有償での作業にも対応可とのこと。ぜひこの機会に一度試してみてはいかがだろうか。

フェイシャルキャプチャというとリアル系のCGで使われるものという印象も多分にあるが、ここ数年デフォルメの効いたキャラクターでの活用も増えて来ている。さらに国内での事例も増えていくことになるだろう。

製品情報、問い合わせ先

-

-

Dynamixyz Performer 2

OS:Windows 7以降

プラグイン対応アプリケーション:Maya 2015~、3ds Max 2015~、Motion Builder 2015~

価格:1,600,000円(税抜)~

【問い合わせ先】

ゼロシーセブン株式会社

システムソリューション事業本部 コンテンツ部

〒107-0052

東京都港区赤坂5-4-7 The Hexagon 7F

TEL:03-3560-7747 / FAX : 03-3560-7748

E-MAIL:info@0c7.co.jp

http://www.0c7.co.jp/