画像生成AIのMidjourneyとアメリカ・Spellbrush(Sizigi社)は1月10日(土)、アニメ特化型画像生成AI「Niji 7(にじジャーニー バージョン7)」をリリースした。画像全体の一貫性の向上、プロンプト追従性能の改善が実装された。公式YouTubeではリリースを記念して、Niji 7とNiji Videoを用いて制作したMVが公開されている。

ディテール描写と一貫性向上

「Niji 7(にじジャーニー バージョン7)」では、画像全体の一貫性が向上。従来モデルでは、複雑な構成において細部のディテールが崩れる傾向があったが、Niji 7ではキャラクターの瞳の輝きから、背景に舞う花びらの1枚1枚に至るまで、高精細なアップグレードが施されているという。

プロンプト追従性能の改善

-

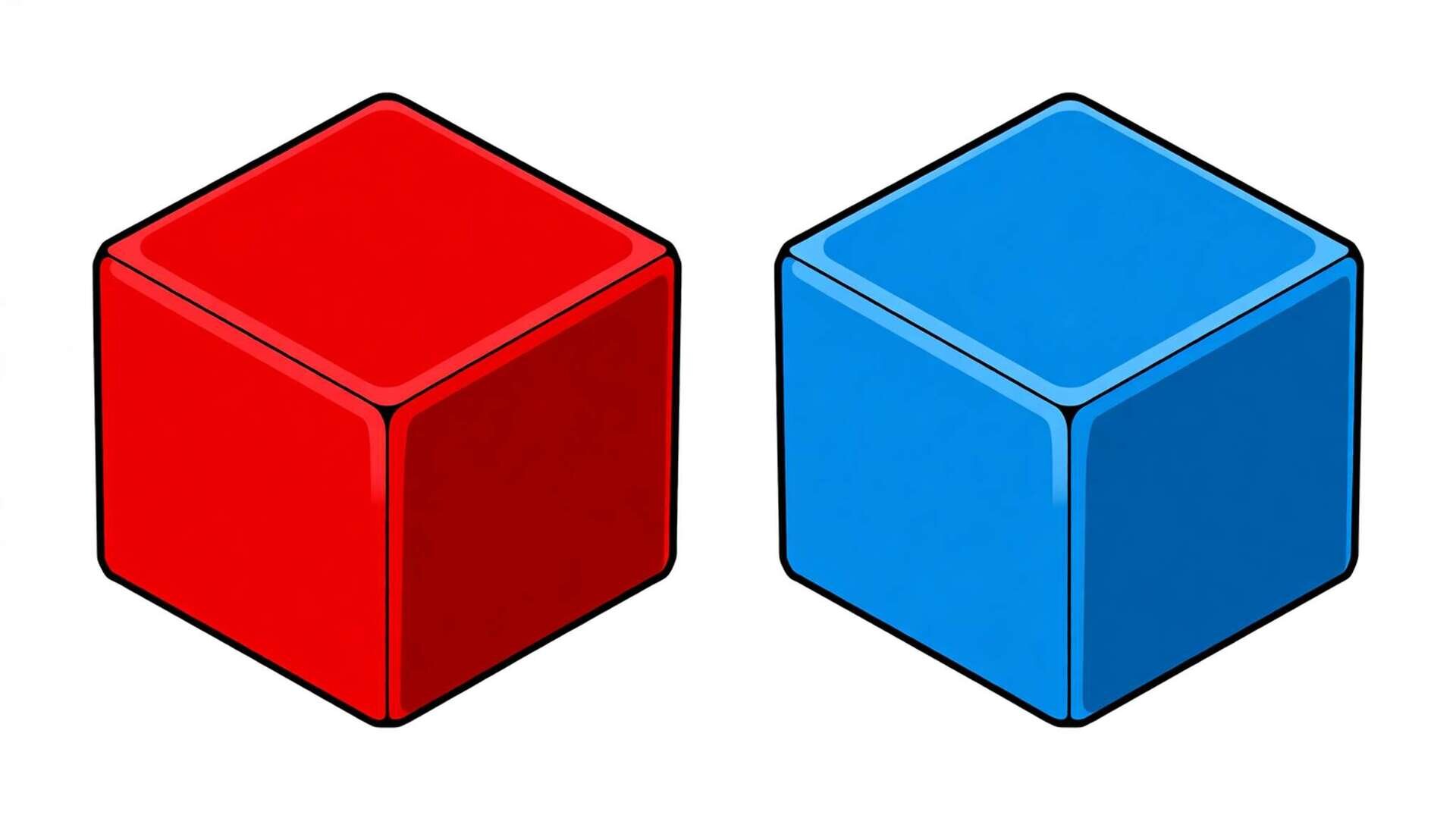

▲プロンプト「二つのキューブ、赤いキューブは左側、青いキューブは右側にある」 -

▲プロンプト「ライム色のショートヘア、ひとつのお団子の髪型、青い瞳、八重歯、腕が四本ある少女、それぞれアイスクリームを持っている」

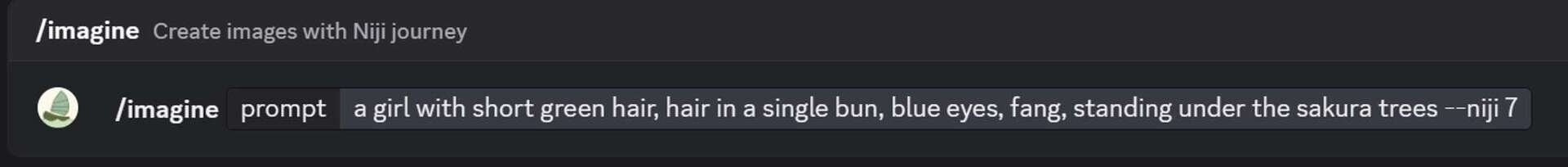

プロンプト追従性能が改善され、複数のオブジェクトの配置指定や、一般常識を超えた特殊な構造の要求に対しても、正確に応答する能力を備える。

ぜひsref(スタイル参照)を試してみて!

— niji・journey (@nijijourney) January 10, 2026

今回のリリースでは、多くの機能に後方互換性を追加しています。

(なんと、あの妙に指定されがちな--sv 4 フラグにもちゃんと対応しています!)

移植された数ある機能の中でも、今回一番のお気に入りは間違いなくsref です。… pic.twitter.com/Cvj4XeS0zI

今回のモデルは、形になるまで特に長く、そしてとても困難な道でしたが、待つだけの価値は十分にあったと感じています。

— niji・journey (@nijijourney) January 10, 2026

皆様も、気に入ってくれると嬉しいです。

いつもこの旅を支えてくれて、本当にありがとうございます!

もっと詳しい情報についてはブログをチェックしてください (8/8)…

■Niji V7へようこそ!(公式ブログ)

https://nijijourney.com/ja/blog/niji-7

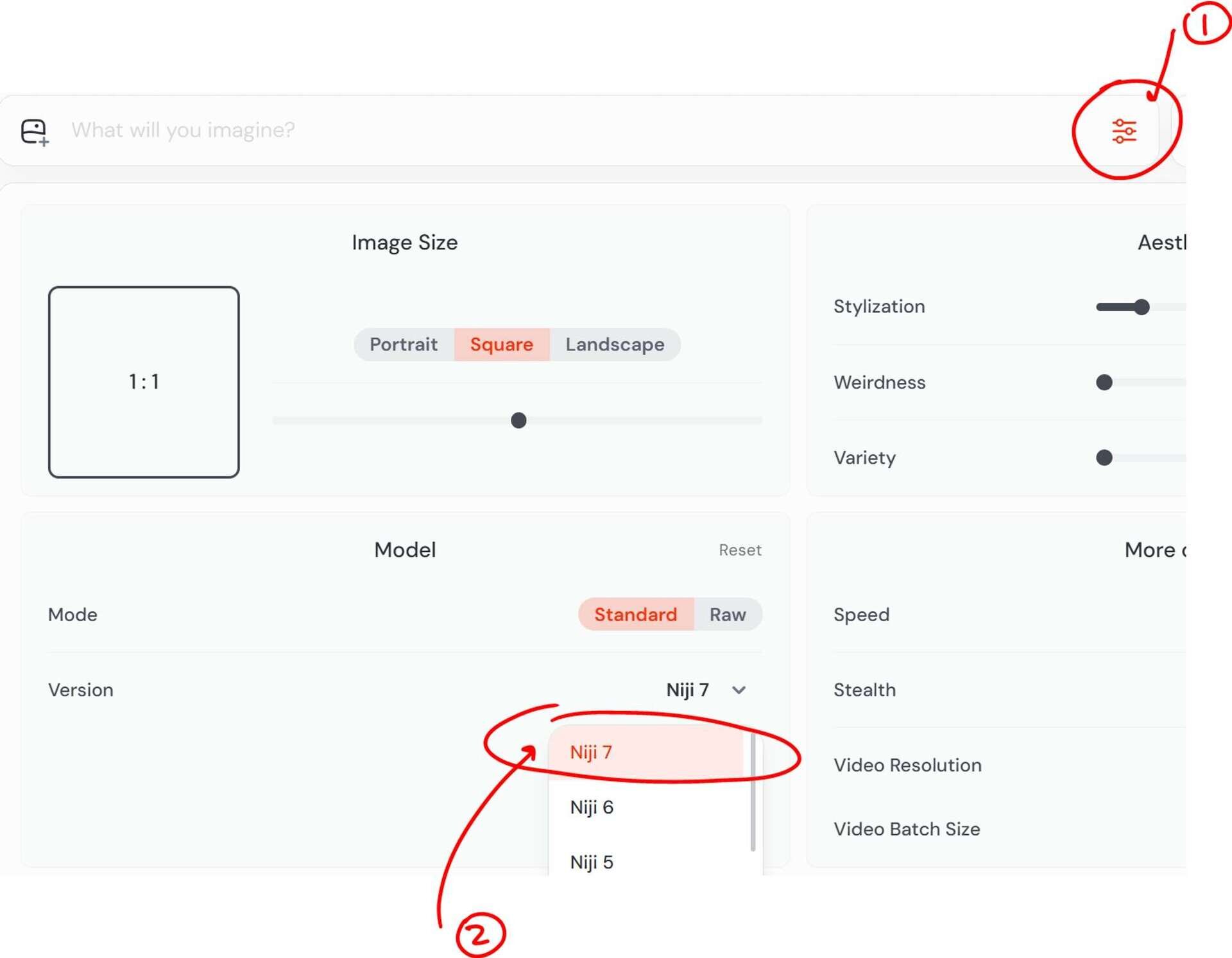

■にじジャーニー(niji・journey)Web版

https://nijijourney.com/explore?tab=video_top

■にじジャーニー(niji・journey)Discord

https://discord.com/invite/nijijourney

プランと価格

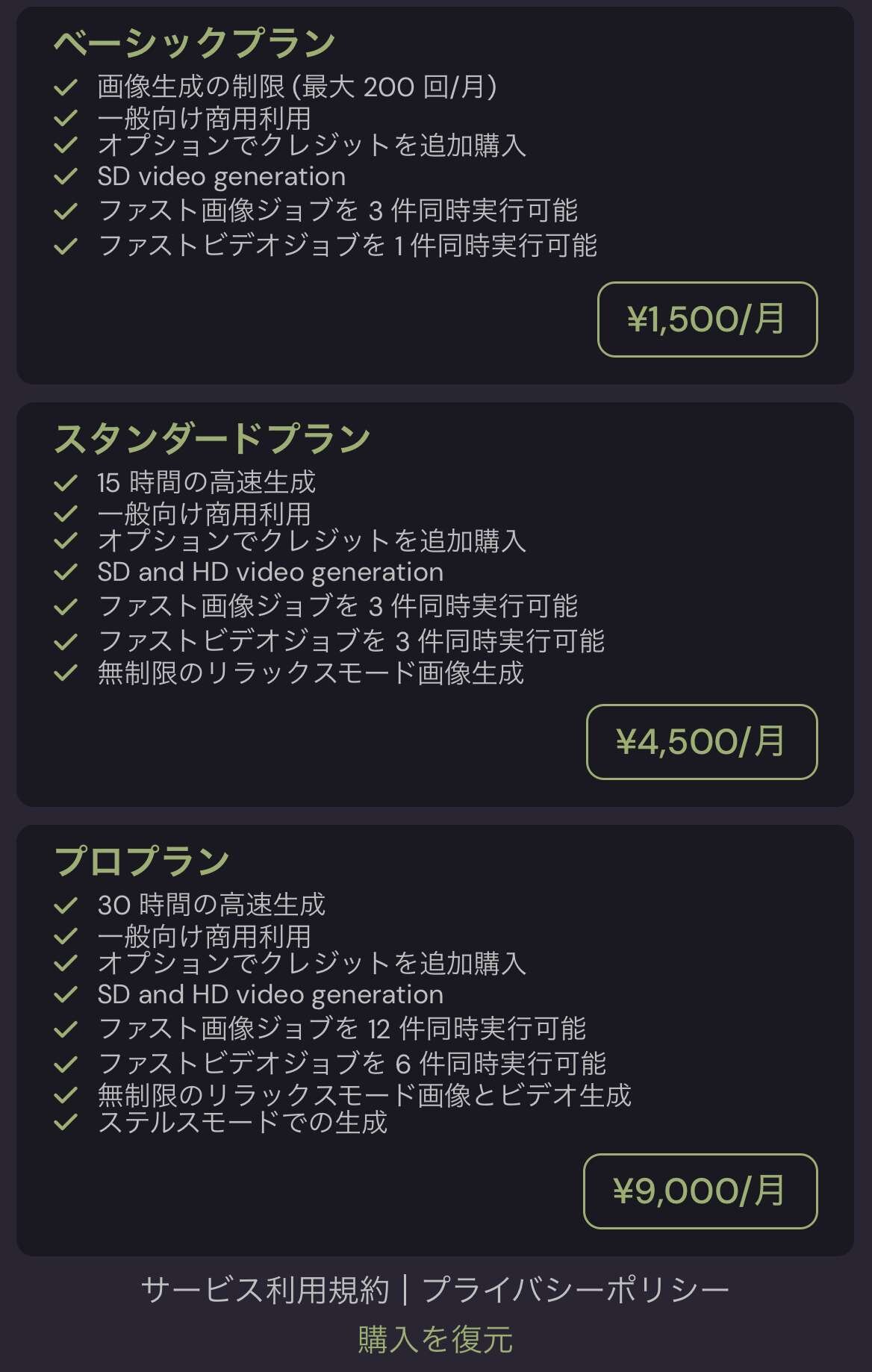

Web版「にじジャーニー」のサブスクリプションは4つのプランが用意されている。ベーシックプランは年払いで月額8ドル(約1,225円)。月間の生成回数は最大200枚、SD画質の動画生成、生成した画像をエディタで編集する機能が含まれる。画像生成の同時実行(ジョブ)は3件まで、動画生成は1件まで可能で、生成物に対する一般向けの商用利用権も付与される。

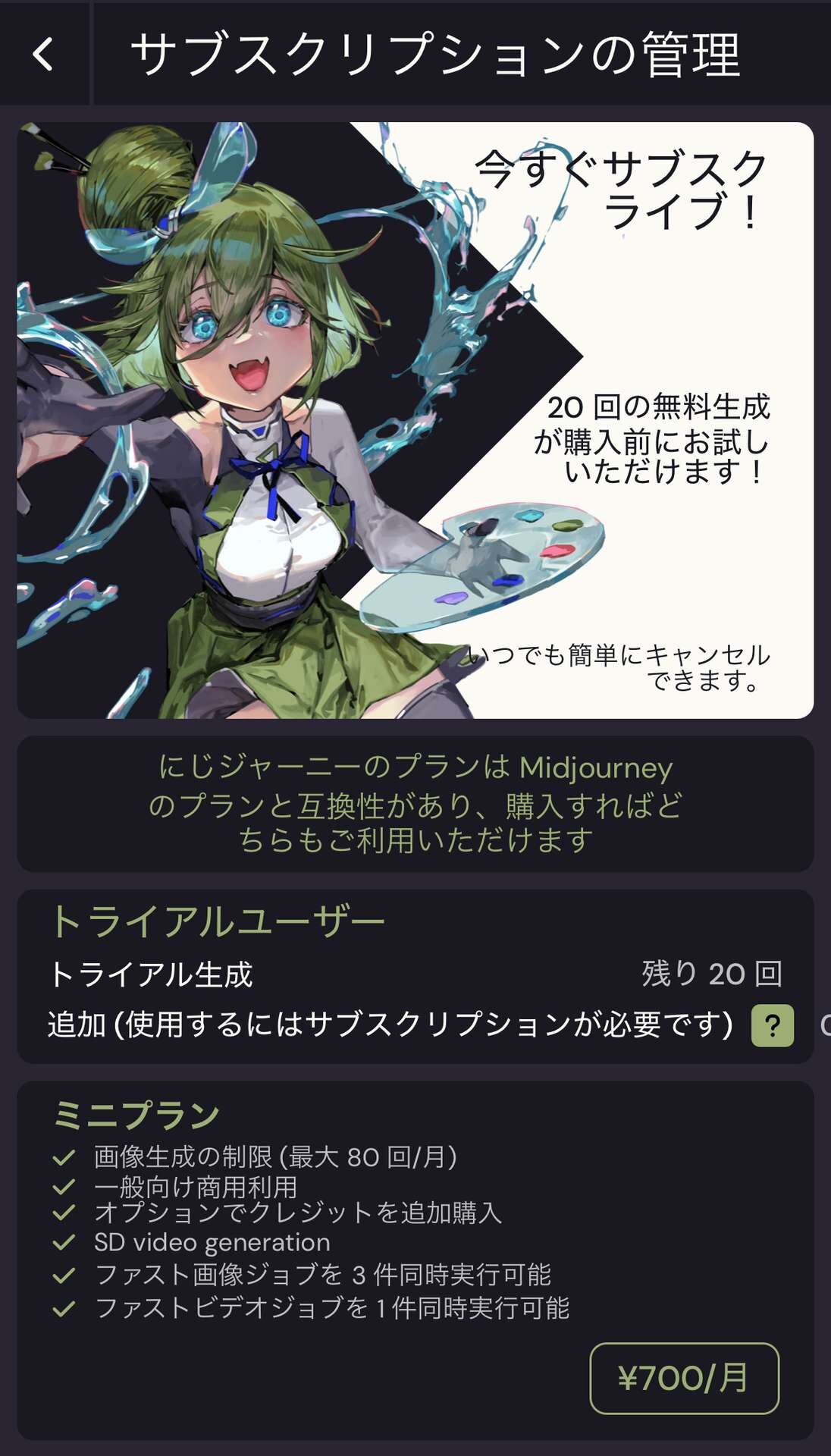

にじジャーニーはモバイルアプリとしても提供されている。20回のトライアル生成後は有料サブスクリプションへの加入が必要。エントリープランのミニプランは月700円。

▲iPhone版のサブスクリプション管理画面

■にじジャーニー - AI アニメアート(App Store iPhone向け)

https://apps.apple.com/jp/app/%E3%81%AB%E3%81%98%E3%82%B8%E3%83%A3%E3%83%BC%E3%83%8B%E3%83%BC-ai-%E3%82%A2%E3%83%8B%E3%83%A1%E3%82%A2%E3%83%BC%E3%83%88/id6446376937

■にじジャーニー - AI アニメアート(Google Play)

https://play.google.com/store/apps/details?id=com.spellbrush.nijijourney

CGWORLD関連情報

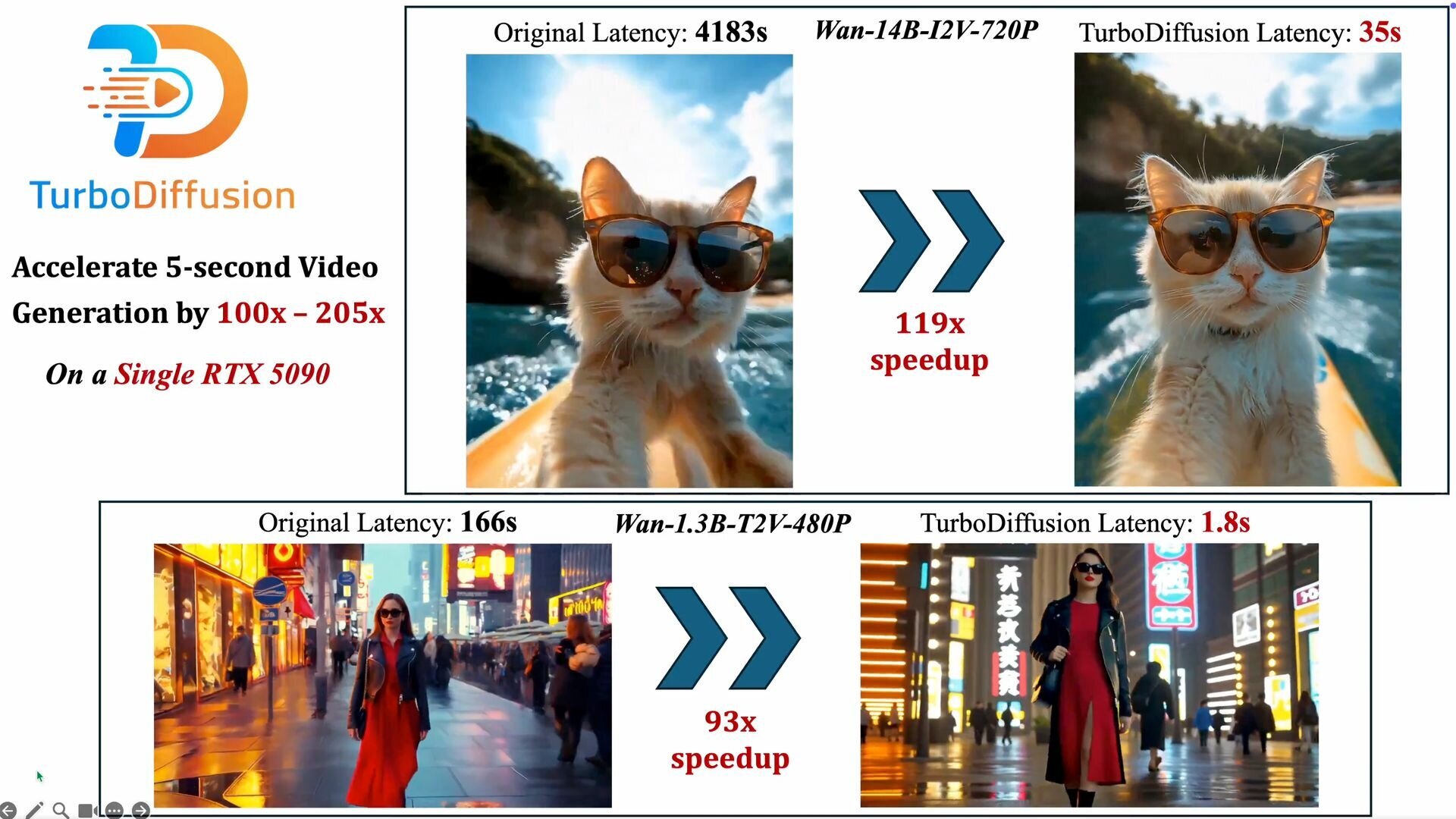

●オープンソースの高速な動画生成AIモデル「TurboDiffusion」公開! 単一のRTX 5090で従来技術比100~205倍高速

清華大学、生数科技、カリフォルニア大学バークレー校からなる研究チームが、動画生成AIの推論速度を向上させる新技術「TurboDiffusion」を公開。単一のNVIDIA GeForce RTX 5090を用いて数秒で動画生成が行えるという。ソースコードはGitHubで、学習済みモデルのチェックポイントはHugging Faceで公開されている。ライセンスはApache-2.0。

https://cgworld.jp/flashnews/01-202601-TurboDiffusion.html

●マルチモーダル生成AIモデル「Wan2.6」リリース! 1080p15秒、リファレンスキャラクターのインポート、マルチショット生成によるストーリーの自動構築など

Tongyi Labがテキスト・画像・音声入力を統合し、リアルな画像と動画を生成するマルチモーダル生成AIモデル「Wan2.6」をリリース。特定のリファレンスキャラクターを異なるシーンへ一貫性を保ったまま配役する「Starring」機能、単純な指示から複数のカットで構成される物語を自動構築する「マルチショット・ナラティブ」機能、ネイティブレベルでのA/V同期による自然な対話シーン、1080p、緻密なライティング制御などの特徴を備える。Wan2.6は公式プラットフォームやサードパーティ製プラットフォーム、APIから利用可能。

https://cgworld.jp/flashnews/01-202512-Wan2.6.html

●マルチモーダル動画生成AIモデル「Kling O1」リリース! テキスト・画像・動画・特定の被写体を組み合わた入力に対応、動画生成から編集・スタイル変換まで1モデルに統合

快手がマルチモーダル動画生成AIモデル「Kling O1 動画モデル」をリリース。テキストと参照画像、既存の動画、特定の被写体(エレメント)を混在させて指示を出し、3秒から10秒までの動画を生成できる。チャットによる複雑な動画編集やスタイル変換の機能も統合。公式Webアプリでは無料・有料プラン共に利用できるほか、各種サードパーティ製プラットフォームで提供されている。

https://cgworld.jp/flashnews/01-202512-KlingO1.html