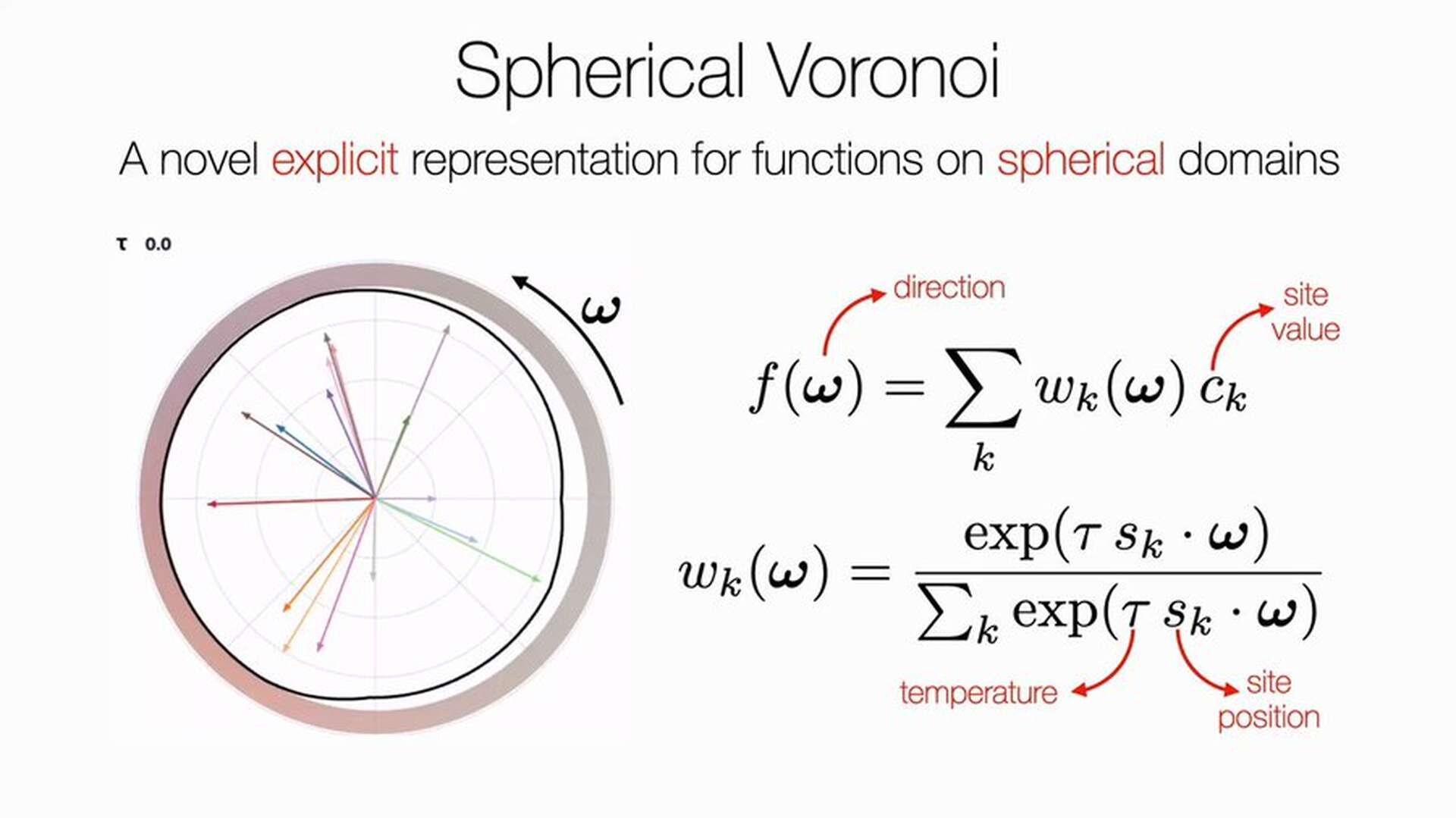

トリノ大学、サイモン・フレーザー大学のフランチェスコ・ディ・サリオ(Francesco di Sario)氏らが率いる研究チームは12月18日(木)、3D空間の再構成やレンダリングにかかる光の反射・質感表現の新技術「Spherical Voronoi(球面ボロノイ)」を発表した。Spherical Voronoiは、3D Gaussian Splatting(3DGS)の枠組みに統合され、従来技術(Spherical HarmonicsやSpherical Gaussiansなど)と比較してビジュアル表現能力が向上している。コードはGitHubリポジトリにて公開予定。

: directional appearance as a differentiable partition of the sphere

— Andrea Tagliasacchi (@taiyasaki) December 17, 2025

– Project: https://t.co/mUPYvL887s

– Paper: https://t.co/v1SZrVfVoA

– Colab: https://t.co/WLJDMpv7Yu

Project led by (graduating!) pic.twitter.com/iU8AauU8P0

Spherical Voronoiは、空間内の光の分布を記述する場であるラディアンスフィールド(Radiance Field、放射輝度場)などのワークロードにおいて、視点依存効果(View-dependent effects、見る角度によって変化する光沢や色味)を効率的かつ高精度にモデル化する手法。

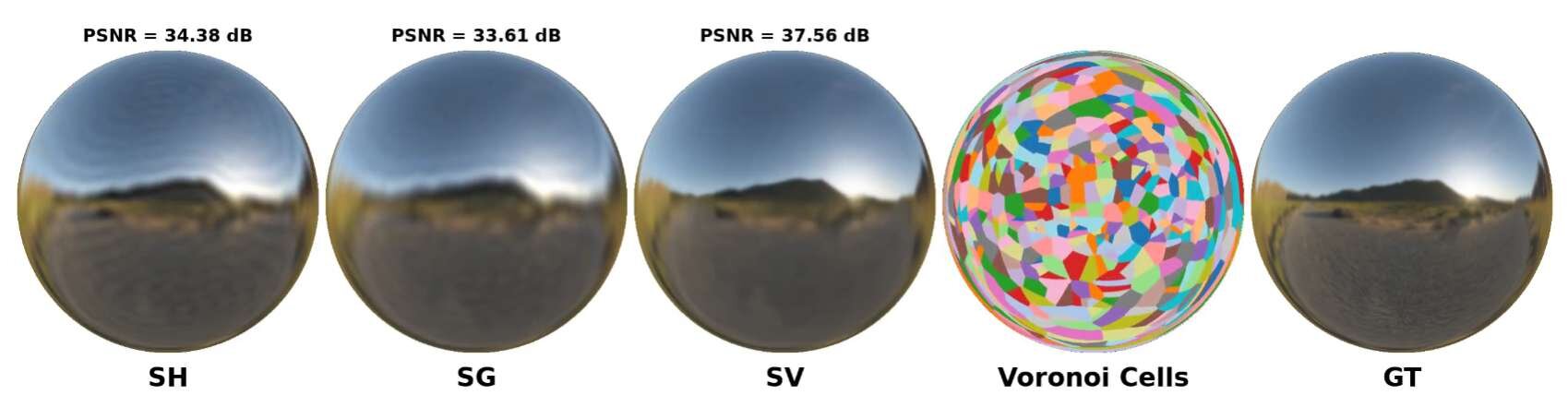

従来、この分野では球面調和関数(Spherical Harmonics)が標準的に用いられてきたが、鋭い反射などの高周波信号(High-frequency signals)の表現を苦手としており、不自然な振動(リンギング)が生じる課題があった。また、球面ガウス分布(Spherical Gaussians)などの代替手法は最適化が難しいという欠点があった。Spherical Voronoiは、球面上を学習可能な領域に適応的に分割(Partition)することでこれらの問題を解決し、滑らかな境界と明確に定義された勾配(Gradients)を持つことから、最適化が容易だという。

Spherical Voronoi optimizes functions as an on the sphere (good for high frequency), with everywhere (easy to optimize) pic.twitter.com/a4W5lyoc8U

— Andrea Tagliasacchi (@taiyasaki) December 17, 2025

Spherical Voronoiは、高速レンダリング手法3D Gaussian Splatting(3DGS)の枠組みに統合され、そのビジュアル表現能力を大きく向上させた。これにより、ベンチマークではZip-NeRFなどの強力な多層パーセプトロン(Multi-Layer Perceptron、MLP)ベースのニューラルネットワーク手法を、非ニューラルフィールドのアプローチとして上回ったという。また、鏡面反射のような鋭いピークを持つ信号を正確に捉えることができるため、反射光線や法線ベクトルを考慮するRef-NeRFのような高度な反射モデルにおいても、最高性能を達成したとのこと。

We use it for representing view-dependent effects in radiance field workloads (e.g. NeRF and 3DGS). For the, this that, since ZipNerf appeared, dominated the benchmarks. pic.twitter.com/5Vbxw8QS5f

— Andrea Tagliasacchi (@taiyasaki) December 17, 2025

And we did not stop here... we also show that this gives you in like workloads, where you (with normals), and consider material properties. pic.twitter.com/VHvNjG3WlH

— Andrea Tagliasacchi (@taiyasaki) December 17, 2025

■Spherical Voronoi: Directional Appearance as a Differentiable Partition of the Sphere(プロジェクトページ、英語)

https://sphericalvoronoi.github.io/

■Spherical Voronoi(GitHub)

https://github.com/sphericalvoronoi/sphericalvoronoi

CGWORLD関連情報

●Apple、単一画像から高品質な3DGSを生成する技術「SHARP」公開! 一般的GPU環境で高速3Dシーン構築可能

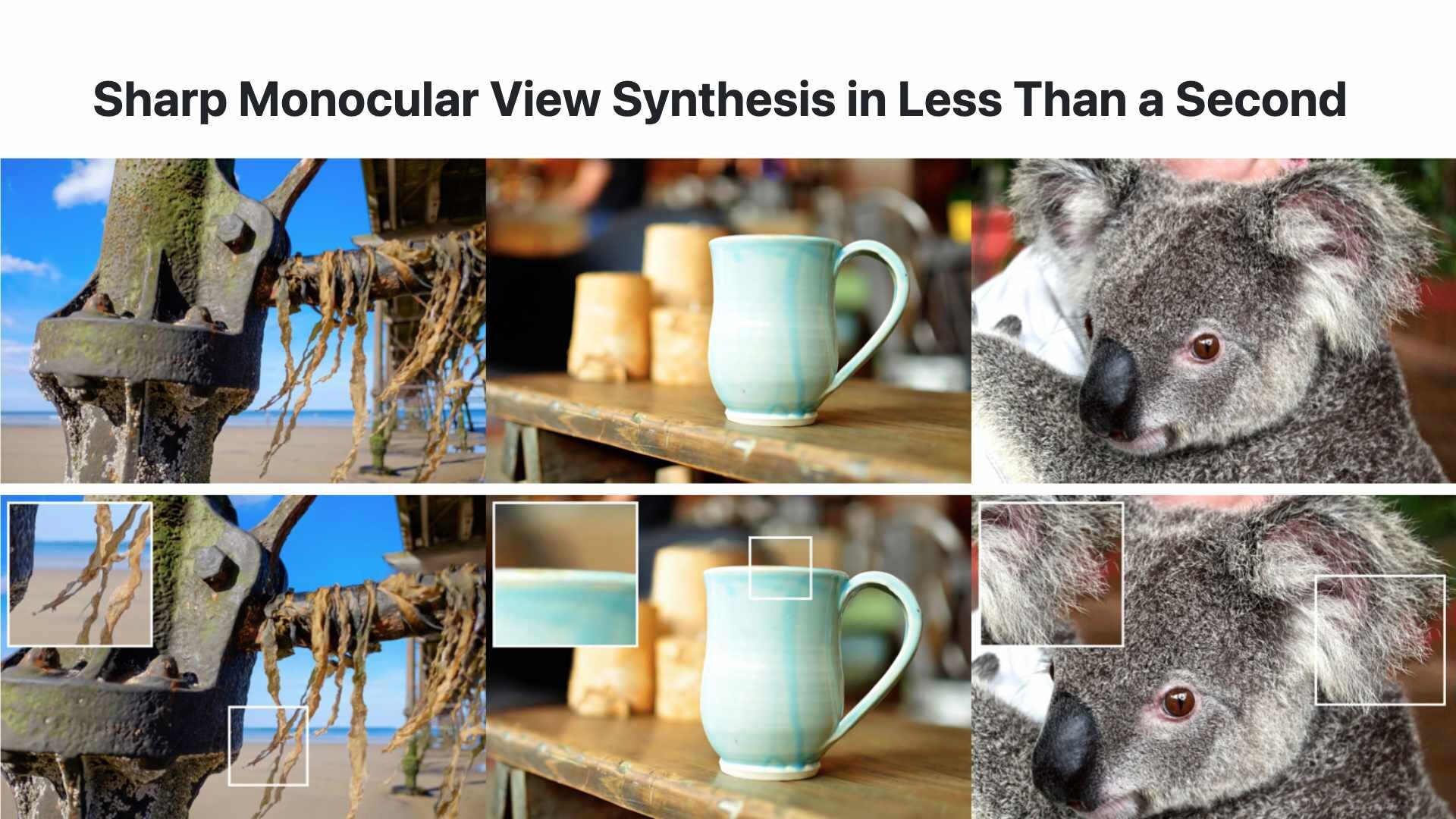

Appleが1枚の静止画から高品質な3D表現を瞬時に生成する新たな技術「SHARP(Sharp Monocular View Synthesis in Less Than a Second)」を公開。コードとモデルウェイトはGitHubとHugging Faceで公開されており、それぞれApple独自ライセンスの下で提供される。

https://cgworld.jp/flashnews/01-202601-SHARP.html

●3Dワールド生成モデル「Echo」発表! 独自の空間基盤モデルを用いて、メートル法ベースのジオメトリに裏付けされた物理空間の描画・編集を実現、クローズドβ中

SpAItialがテキストや1枚の画像から一貫性のある3D世界を生成する新モデル「Echo」を発表。Webデモでは3DGS(3D Gaussian Splatting)を採用し、低スペックな機材でもリアルタイムでジオメトリに裏付けされた空間の描画・編集、Webブラウザ上での自由な移動や探索を実現している。現在はクローズドベータ版の登録を受付中。

https://cgworld.jp/flashnews/01-202512-Echo.html

●テンセント、オープンソースの世界モデル「HunyuanWorld-Mirror」公開! 動画や画像から最適化なしで3DGS・深度・カメラパラメータをまとめて高速出力

テンセントがオープンソースの世界モデル「Hunyuan World Models」シリーズの新モデルとして、高速・汎用3D復元モデル「HunyuanWorld-Mirror(Hunyuan World 1.1)」を公開。動画や画像から3Dシーンを数秒で生成し、3DGS(3D Gaussian Splatting)やデプス(深度)マップ、サーフェスノーマル(法線)、カメラパラメータといった3Dデータを一度にまとめて出力できる。GitHubとHugging Faceでコードとウェイトが公開されており、基本的に商用利用が許可されるが、地理的制限などのある独自ライセンスとなっている。

https://cgworld.jp/flashnews/01-202511-HunyuanWorld-Mirror.html