自分そっくりのロボットと働く......20年後には現実になっているかもしれない、クリエイターの新しい働き方を示すコンセプトムービーが公開された。制作したのはCyberHuman Productionsをはじめとした、サイバーエージェントグループの面々だ。2020年4月1日(水)の「April Dream」プロジェクトに合わせて制作された、本ムービーのメイキングについて聞いた。

TEXT_小野憲史 / Kenji Ono

EDIT_小村仁美 / Hitomi Komura(CGWORLD)、山田桃子 / Momoko Yamada

クリエイターの新しい働き方を提案

政府が進める「働き方改革」も未だ進まず、プレミアムフライデーも名ばかりになった印象のある昨今。加えてコロナ禍の影響で、慣れないテレワークを続けているCGクリエイターも多いだろう。「自分と同じロボットが、自分の代わりに仕事をしてくれたら嬉しいのに......」と夢想したことも、一度や二度ではないのではないだろうか。

こうした誰もが抱く妄想を形にした映像が、4月1日(水)に「April Dream」企画の一環としてYouTubeで公開された。制作したのは高精細スキャンや3DCGなどを活用した映像制作で知られるCyberHuman Productions(以下、CHP)だ。映像はCHP取締役の桐島ローランド氏と瓜ふたつのロボット「桐島ローランド2号」が実務を行い、本人はディレクションを中心に、ゆとりある生活を楽しむという内容。「April Dream」とは、4月1日に、単に笑えるネタではなく、実際に企業や団体、個人が叶えたい「夢」を発信しようというPR TIMESによるプロジェクトで、200社以上が参加した。

本コンテンツは同社が掲げる「最先端技術を用いてクリエイターの『夢のワークスタイル』実現を目指す」ドリーム宣言に基づいて制作されたものだ。自分そっくりのロボットとの協業は、今は無理でも20年後には実現しているかもしれない......そんなふうに、夢のある内容になっている。

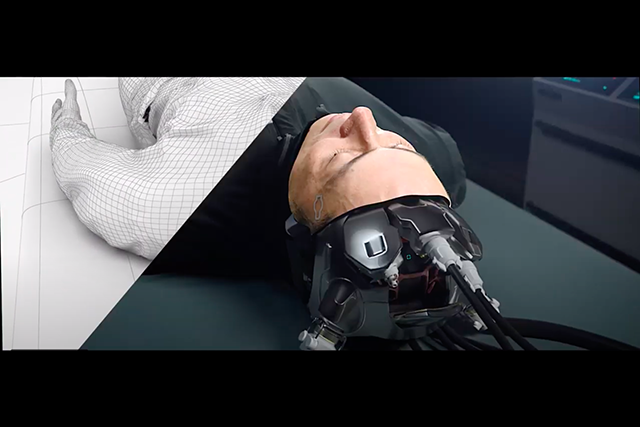

1人2役の映像自体は目新しいものではない。しかし、4/28(火)に公開されたメイキングムービーを見ると、二重の意味で驚かされるだろう。第一に「桐島ローランド2号」の頭部がCGで制作されていること。そして第二に、CGで作られたセットの中でバーチャル撮影が行われていたことだ。

そこには同社の技術力の高さもさることながら、サイバーエージェントグループの横の繋がりが活かされていた。約1ヵ月でつくられたという本映像の舞台裏について、制作陣に聞いた。

新サービスの紹介半分、遊び心半分

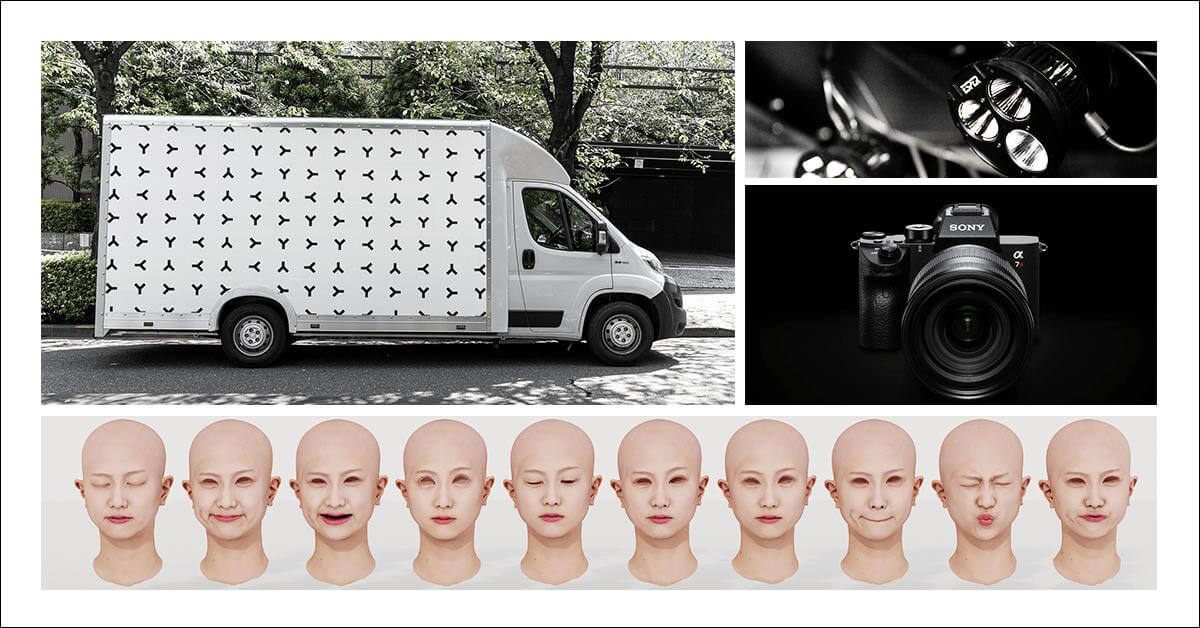

本企画のベースとなったのが、2019年にCHPが始めた出張型3DCGスキャンカー「THE AVATAR TRUCK」だ。自動車に3DCGスキャンのシステム一式を搭載して先方に赴きその場で撮影を済ませてしまうソリューションで、1名あたり数分でスキャン撮影が完了する。

「僕たちはタレントやアスリートといった有名人のスキャンを目標に掲げてきました。ただ、これまでそうした方々にスタジオまで来てもらうのが大変でした。皆さんとても忙しくて、最近はスチルとムービーの撮影を半日で済ませる、といった案件も増えてきています。そのため、3Dスキャンのために専用スタジオまで来てもらうことが、非常に難しいんです」と語るのは、本映像で主演を務めた取締役の桐島ローランド氏。

-

-

桐島ローランド/Rowland Kirishima

CyberHuman Productions取締役

主演

www.cyberhuman-productions.co.jp

スタジオへの来訪が難しければ、こちらからスキャンシステム一式と共に、出張撮影すれば良い......。こうした逆転の発想で生まれたシステムが「THE AVATAR TRUCK」だ。一度の撮影でキャプチャする表情は約40種類にもおよぶ。研究開発の結果、スペキュラやラフネス情報の16Kでの抽出やデータ生成の自動化など、精度も速度も格段に進化しているという。

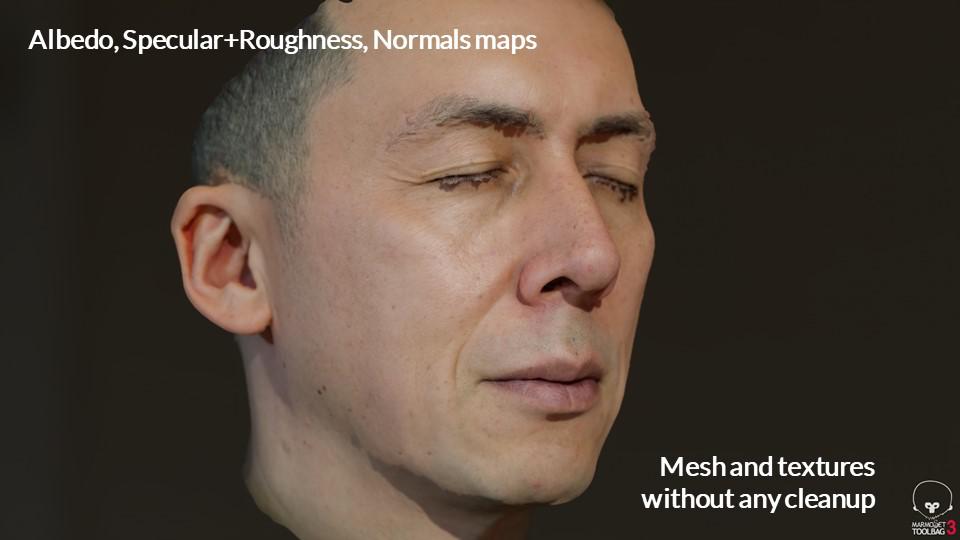

THE AVATAR TRUCKとキャプチャされたデータ群。コロナ禍の渦中で、スタジオでの収録が不安視されている中、本システムを使えば「三密状態」になりにくいメリットもあるという

もっとも、これまでにないサービスであるため、プロモーションにおいても従来にないやり方が求められる......本動画の企画とプロデュースを務めた芦田直毅氏は、こうした問題意識を抱えていた。

「スキャンデータを使ってどれくらいの精度のアウトプットができるのか、理屈で説明するよりも直接映像で示した方がわかりやすいのではないかと考えていました。また、弊社には多彩なデータアーカイブがあるため、これを活用して従来の「To ALL」ではなく、「For You」なコンテンツをユーザーに届けたい。 ......そうしたビジョンもありました。そこで、これらを体現できるような映像コンテンツ制作について、年明けから社内で議論を開始しました」(芦田氏)。

芦田氏を筆頭に、CG制作とクリエイティブディレクションを務めた田森 敦氏と児玉秀行氏をはじめ、数人で始まった企画会議。面白くて、世の中に関心をもってもらえる映像をスキャンシステムでつくりたい、それってなんだ......? 企画が二転三転する中、芦田氏から「4月1日のエイプリルフール企画向けに映像コンテンツをつくる」というアイデアが飛び出した。そうなると、おのずと制作期間が決まってくる。決め手になったのが児玉氏のひとことだ。

「何回目かの打ち合わせのとき、児玉さんが申し訳なさそうに、『すごく面白いことを思いついちゃった』と現れたんですよ。聞けば『CGでローランド2号をつくれば良いんじゃないか』って言うんです。それを聞いたみんなが賛同して、具体的な企画が動き出しました」(田森氏)。

もともとCyberHuman Productionsという社名から、ロボットをつくっていてもおかしくない印象があること。ローランド氏がファッションモデル出身で、有名人でも遜色のないリアルなCG映像がつくれる技術であることが、わかりやすく示せること。そして何より「2号」というアイデアが面白いこと......このように、様々なピースがピッタリとハマったと、芦田氏はふり返る。

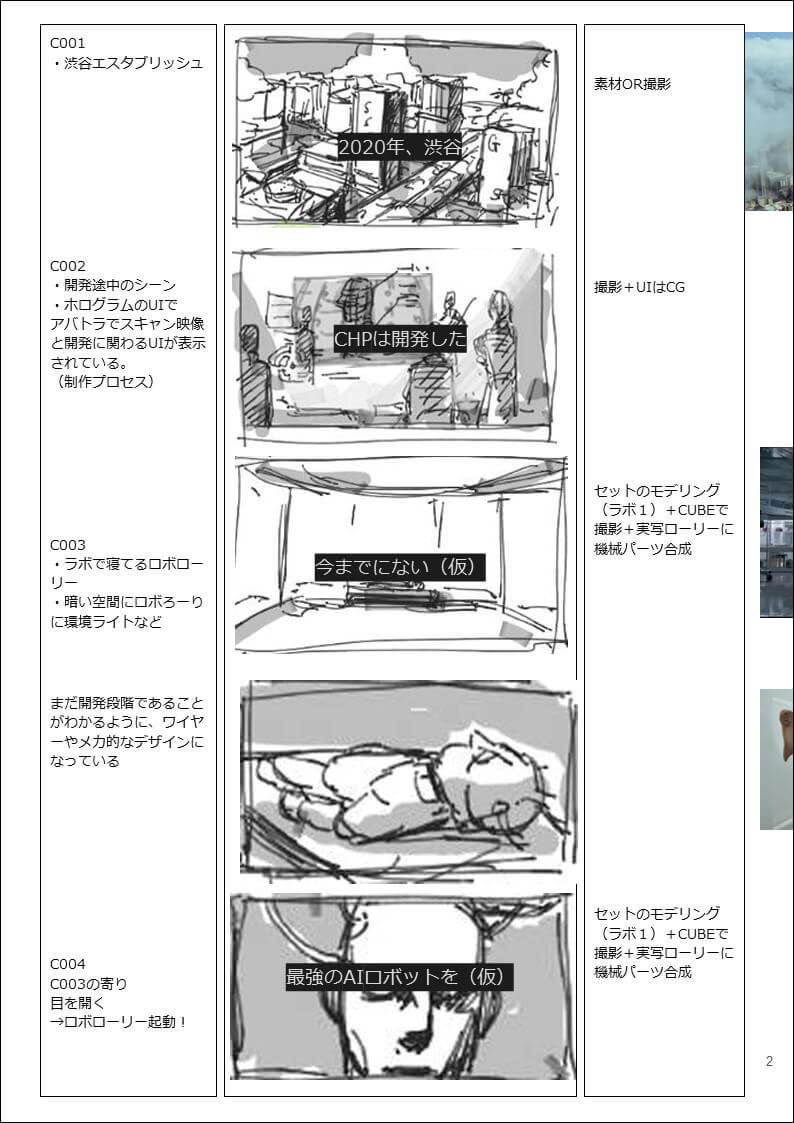

「2号」のアイデアが飛び出したのが1月後半。具体的な内容と共に、制作体制を固めつつ、ストーリーボードや絵コンテが完成したのが2月後半。その間、企画/プロデュースを進行面から支えた岡村圭太朗氏をはじめ、スタッフが徐々に増えていった。ローランド氏に企画が提案されたのは、3月頭のことだ。通常より時間がかかっているように見えるのは、本企画が本業ではない「課外活動」だったため。スタッフは本業と並行して準備を進める必要があった。

ちなみにインタビューで田森氏は「最初にローランドさんに話をしたときは、ドキドキしました」と明かした。それを聞いたローランド氏は「僕がNOと言うわけないじゃん」と即答。同社の自由な社風が垣間見えた一幕だった。

サイバーエージェントグループの横の繋がりを活かす

このようにCHP社内の課外活動として始まった本企画。もっとも、全てを社内で完結させるには、1ヵ月という制作期間は短すぎた。そのためムービーモンスター、6秒企画、サイバーエージェント音進化局のメンバーが制作チームに加わっている。いずれもサイバーエージェントのグループ会社で、結果的に横の繋がりを活かしたプロジェクトになった。

「最初はそんなつもりはありませんでしたが、いざロボットの映像をつくるとなったとき、全てをCGにすると時間的に間に合いませんでした。また、グループの連携を活かしたプロジェクトを進めたいという思いを昔から温めていたことも、背景にありました」(芦田氏)。

インターネット広告の代理店として急成長したサイバーエージェント。しかし、代理店業務に徹して協力会社に実制作を発注するだけでは、制作の深い工程が理解できず、イノベーションも生まれにくくなる。そのため社内に制作部隊をつくったり、子会社をつくったりというながれが生まれた。

インターネット広告向けに動画制作を手がけるムービーモンスター、短尺の動画広告に特化したクリエイティブ集団の6秒企画、そしてCHPも、こうした文脈で生まれたグループ会社だ。

ムービーモンスター【左】と6秒企画【右】は、共にサイバーエージェントグループのスタジオだ

もっとも、通常のクライアントワークだけでは、各々の強みを活かしたフレキシブルな連携が難しかった。クライアントの課題を解決することが主目的にならざるを得ないからだ。そのため、どこかのタイミングでグループ内連携を主目的に据えたプロジェクトをやってみたいと思っていた。

「そんなとき、このプロジェクトが最適だと気がついたんです。2月中旬にロボットが出てくるムービーをつくろうということになり、撮影でムービーモンスターさん、映像編集・コピーライティングで6秒企画さん、サウンドでサイバーエージェント音進化局といった具合に、お声がけしていきました」(芦田氏)。どの会社も、とてもフランクに賛同してくれたという。

企画段階で強力な援護射撃を行なったのが、6秒企画でコピーライターを務める大塚マリエ氏だ。田森氏や児玉氏ら中核メンバーにインタビューをくり返し、「この映像のコンセプトは何か」、「どのようなメッセージを視聴者に伝えたいのか」、「視聴者にわかりやすく理解してもらうには、どうしたらいいか」などと、企画意図を言語化しつつ、深掘りしていったのだ。

-

-

大塚マリエ/Marie Otsuka

6秒企画

コピー

www.cyberagent.co.jp/corporate/overview/id=23271

企画兼プロデューサーとして途中参加した岡村氏は「当初は映像しかありませんでした。絵コンテの初期バージョンが出来上がった時点で、言葉がないとストーリーがわからないよね、ということになりました。別の案件を一緒にやっているときに、どさくさにまぎれて大塚さんに相談しました」とふり返った。

これに対して大塚氏は「ローランドさん『2号』という時点で面白そうだと思った」と快諾。通常業務とは異なる「課外活動」的なノリのプロジェクトに、積極的にかかわっていった。

「CGやAIで人間の仕事が奪われるみたいな考え方ではなくて、先端技術を上手く活用することで、人間自身の能力が拡張されるみたいなイメージを提示したい......そんな議論を皆さんとくり返しました」(大塚氏)。

[[SplitPage]]緊急事態宣言下でギリギリまで調整

3月に入ると実制作が急ピッチで始まった。もっとも、絵コンテに基づいて作業を洗い出し、スケジュールを切り直したところ、実写パートの撮影が終わらなければ本格的なCG作業が難しいことがわかった。その一方で「課外活動」プロジェクトだったこともあり、会社間の協力体制の確立や撮影スケジュールの決定などが遅れた。その結果、CG制作に費やせる期間は半月しかなかった。

初期段階で描かれた絵コンテ。映像中心でコピー(テロップ)が入っていないことがわかる

撮影素材がないと、がっつりと進められるパートが少ない。じゃあ、撮影をどうしよう。ムービーモンスターにお願いしよう。スケジュールはどうしよう。こことここが空いている。一方で自分たちの仕事もある......こんなふうに、バタバタと決まっていったと、田森氏は語る。

「それぞれのスタッフで手が空いているところにタスクをはめていったので、およそ綺麗なやり方ではなかったですね。撮影の前に児玉さんが仕込んでくれたり、その合間に大塚さんにコピーをつくってもらったり、企画自体を練り上げたり。みんなで準備を進めました。まとまった時間がとれなくて、ちょっと、ちょっと......と細切れに撮影をして、全部で5日間ほどで撮り切りました」(田森氏)。

「ローランドさんが寝そべっている椅子は、自分がレンタルを手配しました。ローランドさんが2号をツンツンしているシーンでは、目の前に別の人がいないとやりにくいということで、仮のモデルにもなりました。そんなふうに、普段の仕事ではやらないことを、いっぱいやらせてもらいました」(児玉氏)。

「撮影素材が来てからはドタバタが加速して。マッチムーブを手が空いている人に頼もうとか。その間に合成のテストをしようとか。児玉さんは実写合成が得意で、僕はフルCG系の仕事が多かったので、お互いに自然と作業分担が生まれて。他のCHPメンバーにも可能な限り手伝ってもらいました」(田森氏)。

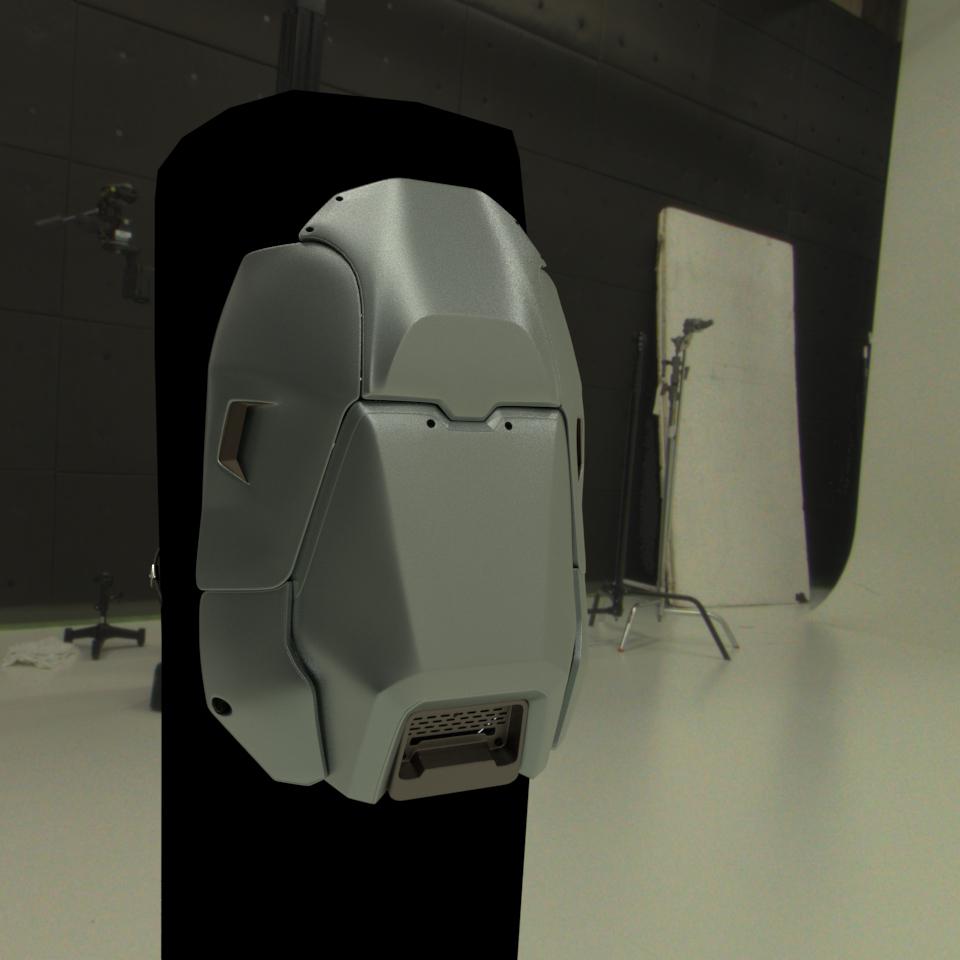

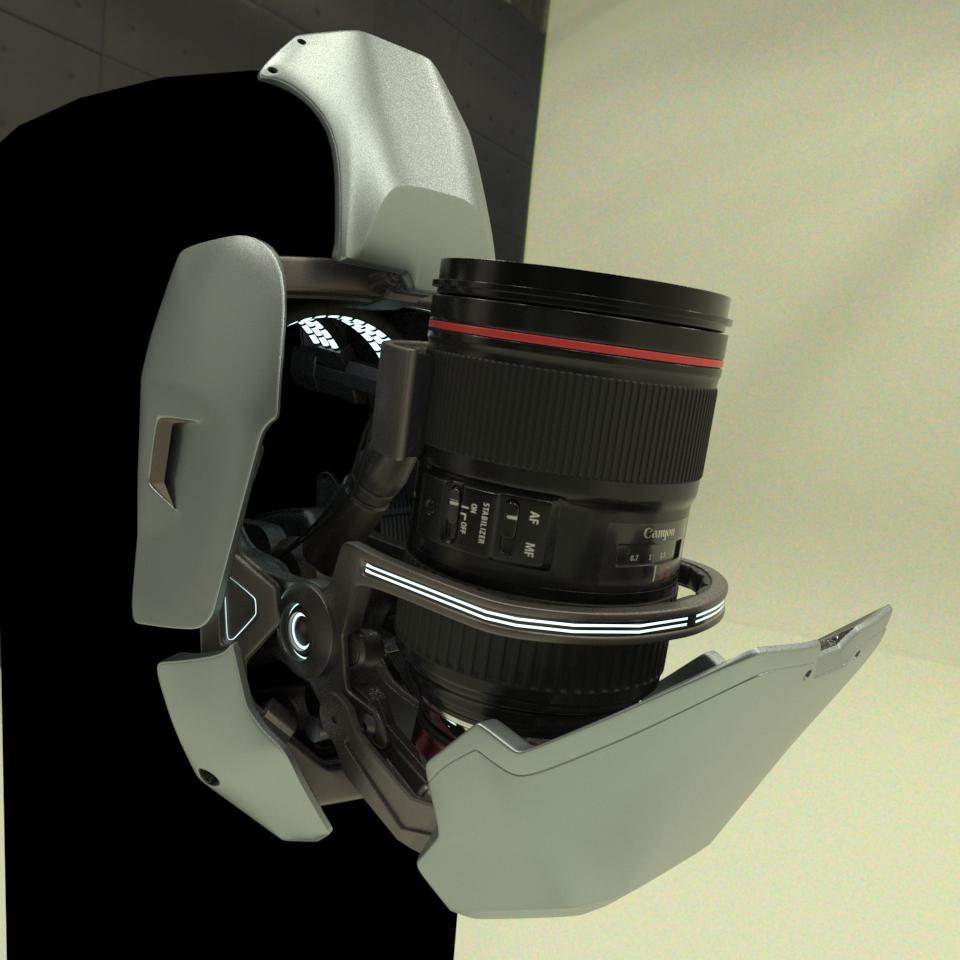

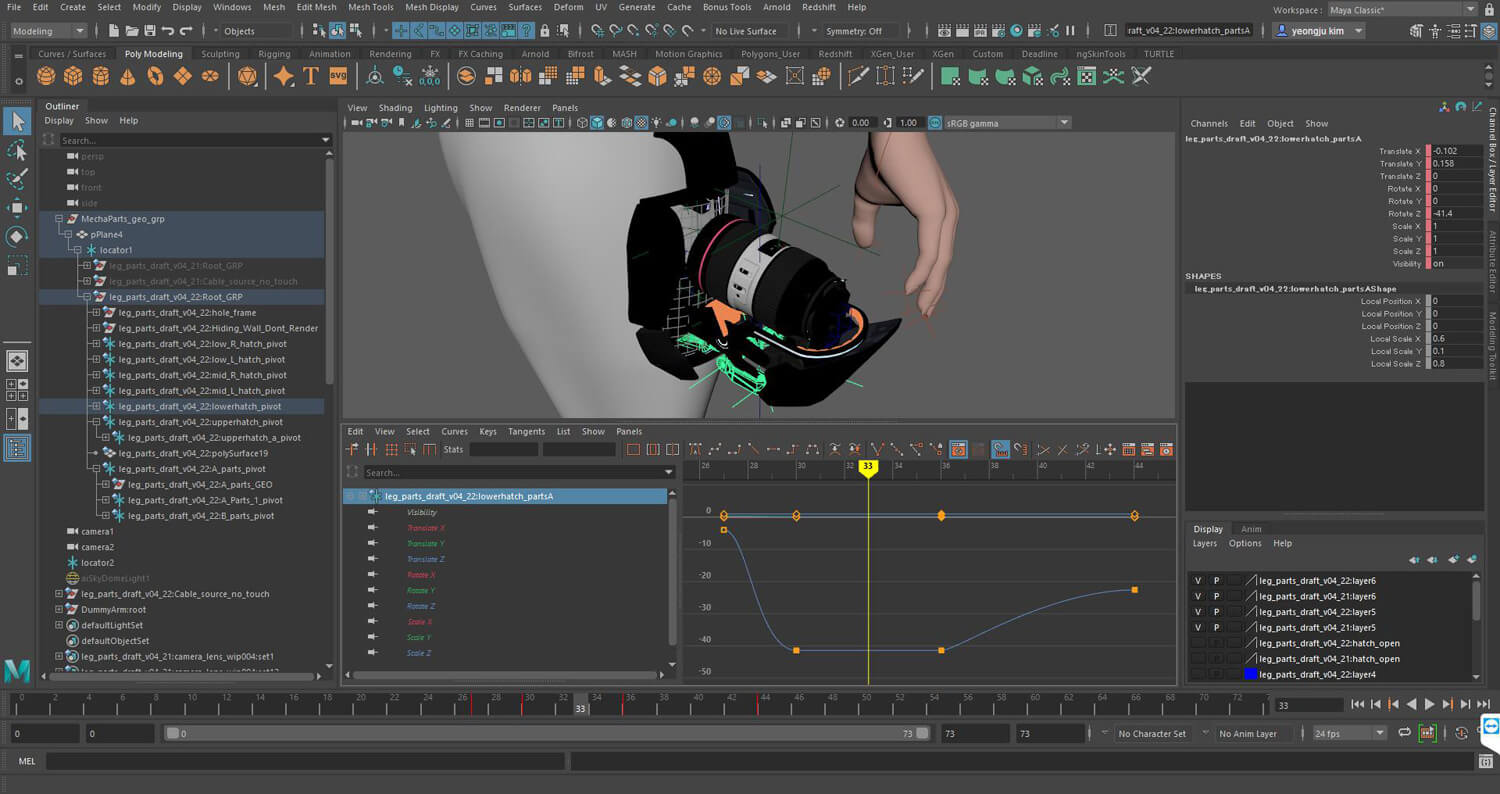

通常のCG制作と異なり、ギリギリまで思いつくアイデアを入れたり、修正をくり返したりした......田森氏はこのように振り返る。ローランド2号の頭部デザインで、開口部が後頭部から頭頂部に変更されたり、画が寂しいからと画面上にUIを入れたり、効果音やコピーを修正したり、などは好例だ。ローランド2号が腰のケースからレンズを取り出すときのアニメーションも、担当者のこだわりの産物だ。

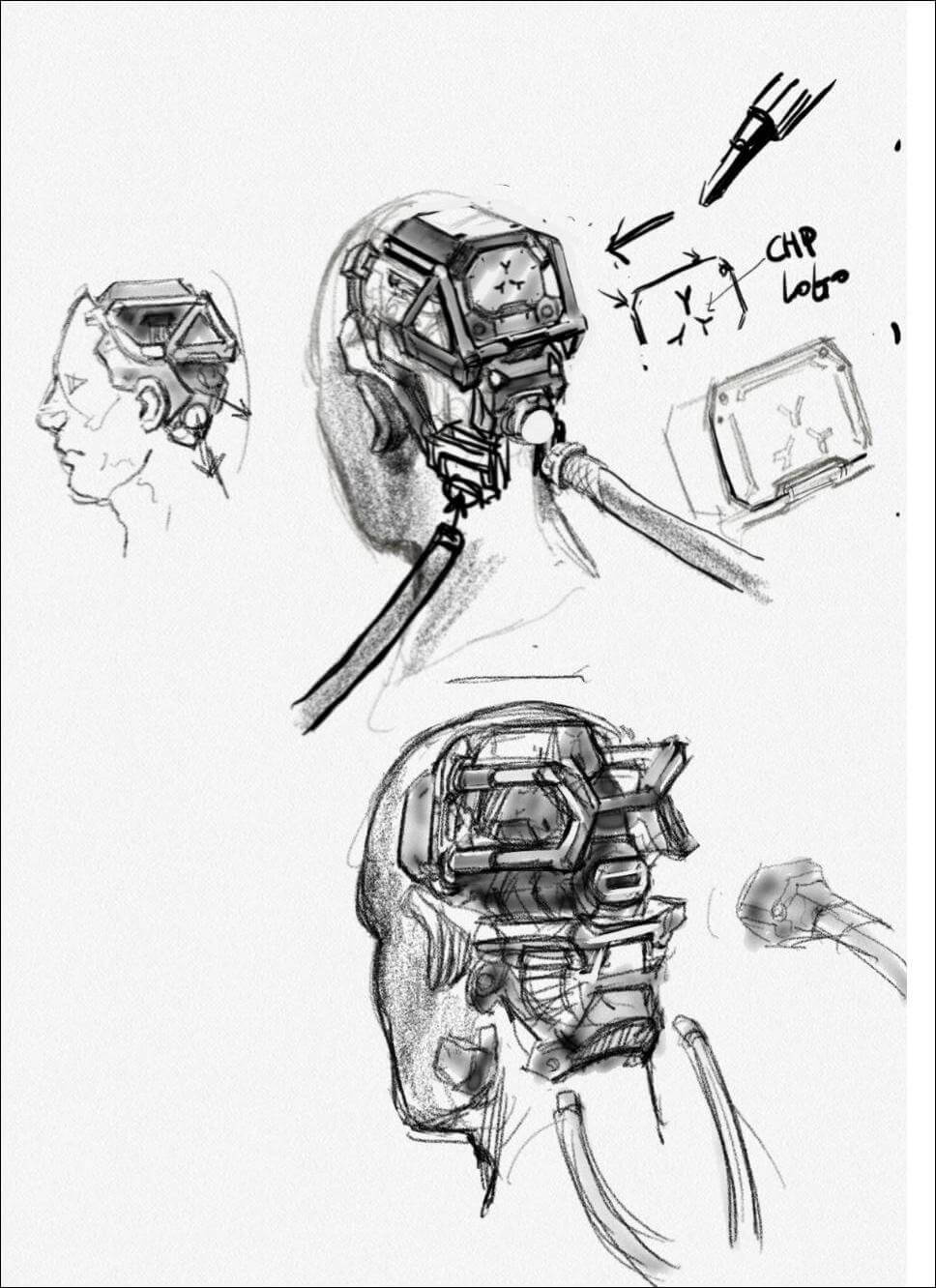

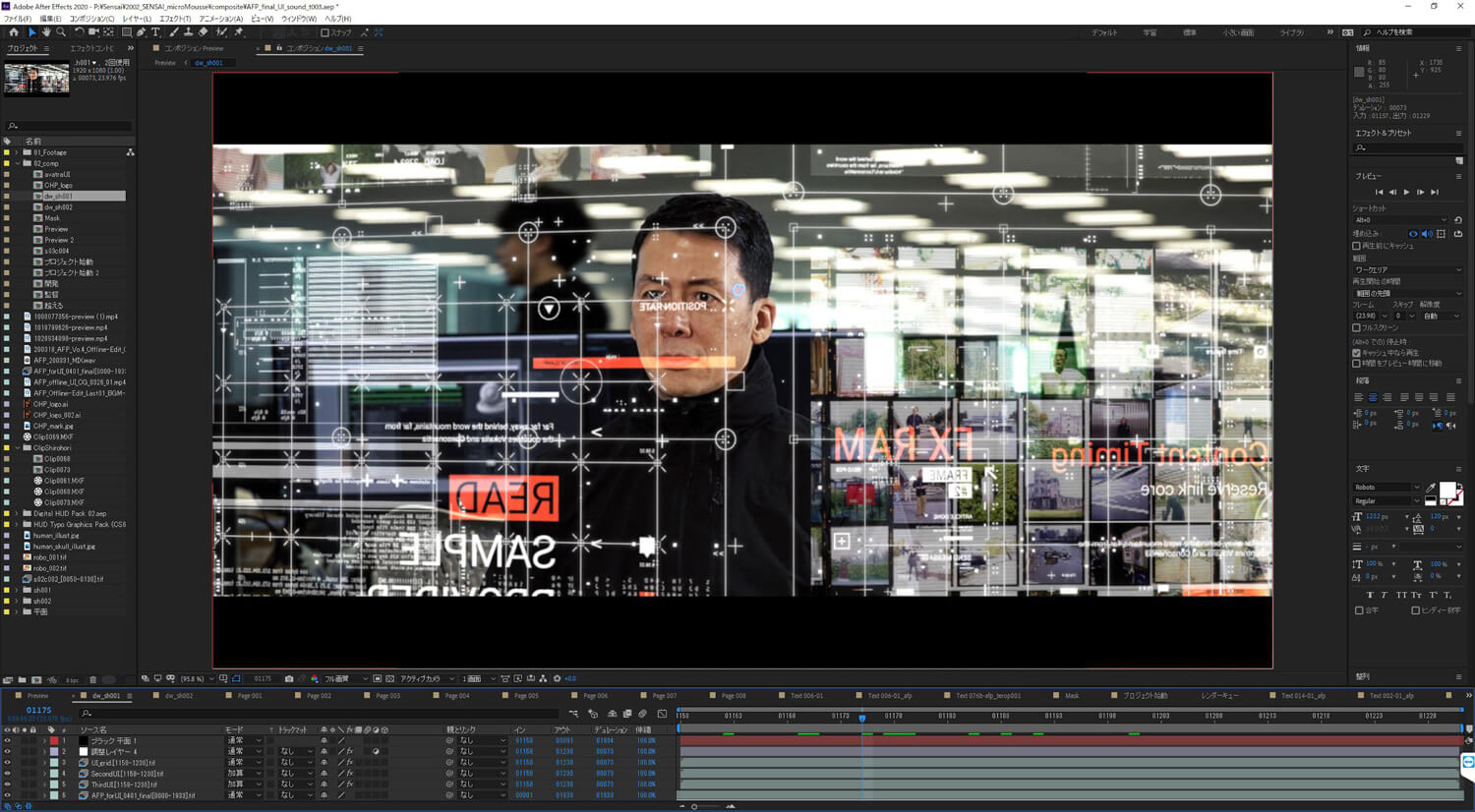

ローランド2号の後頭部のデザイン【上】とコンポジット画面【下】。デザイン画では後頭部が開き、コード類が差し込まれる予定だったが、台の上に寝るとカメラに映らないため、CG制作時に頭頂部からコードが差し込まれるデザインに変更された

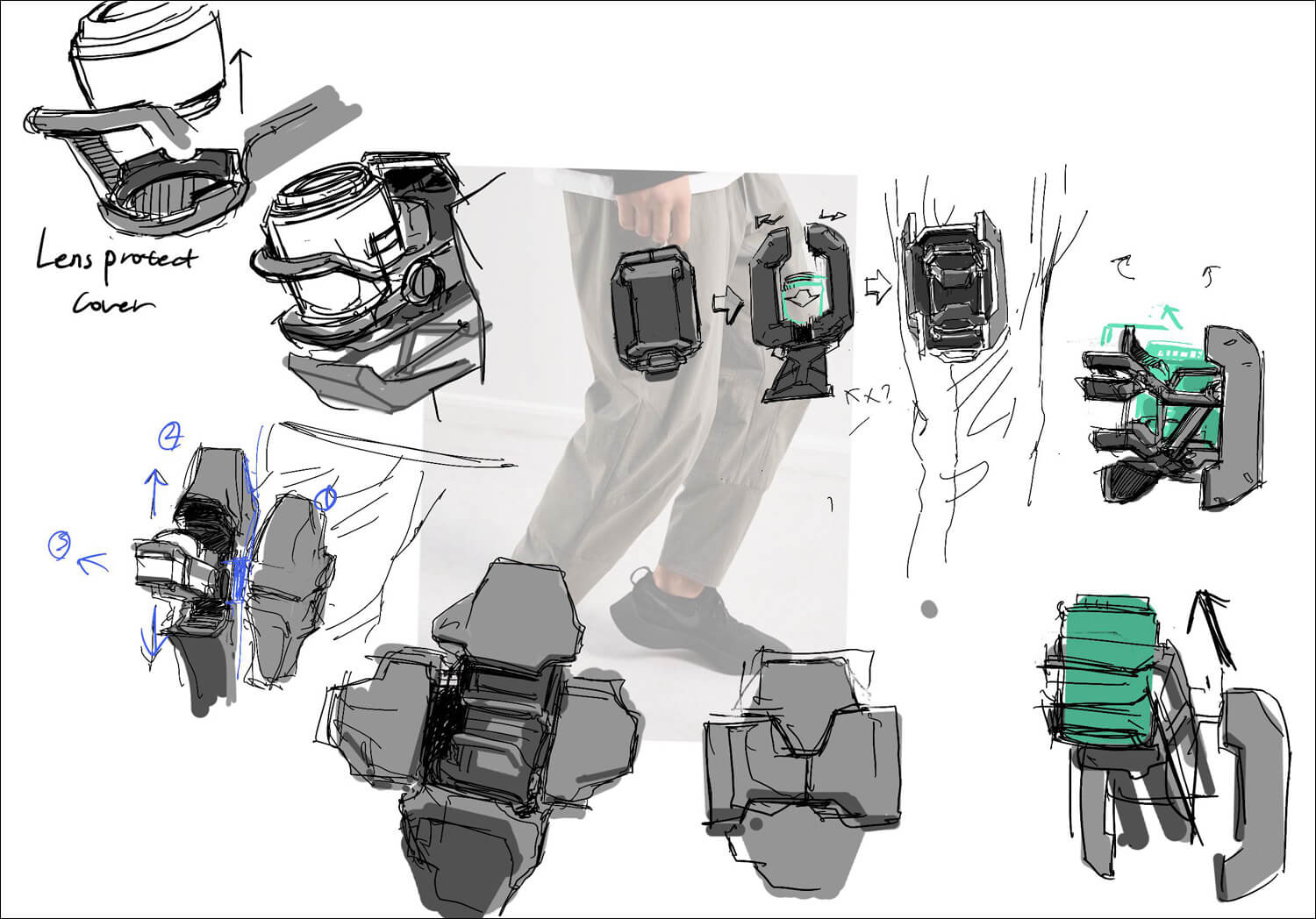

交換レンズ用アタッチメントパーツのデザイン画【上】とコンポジット画面【下】

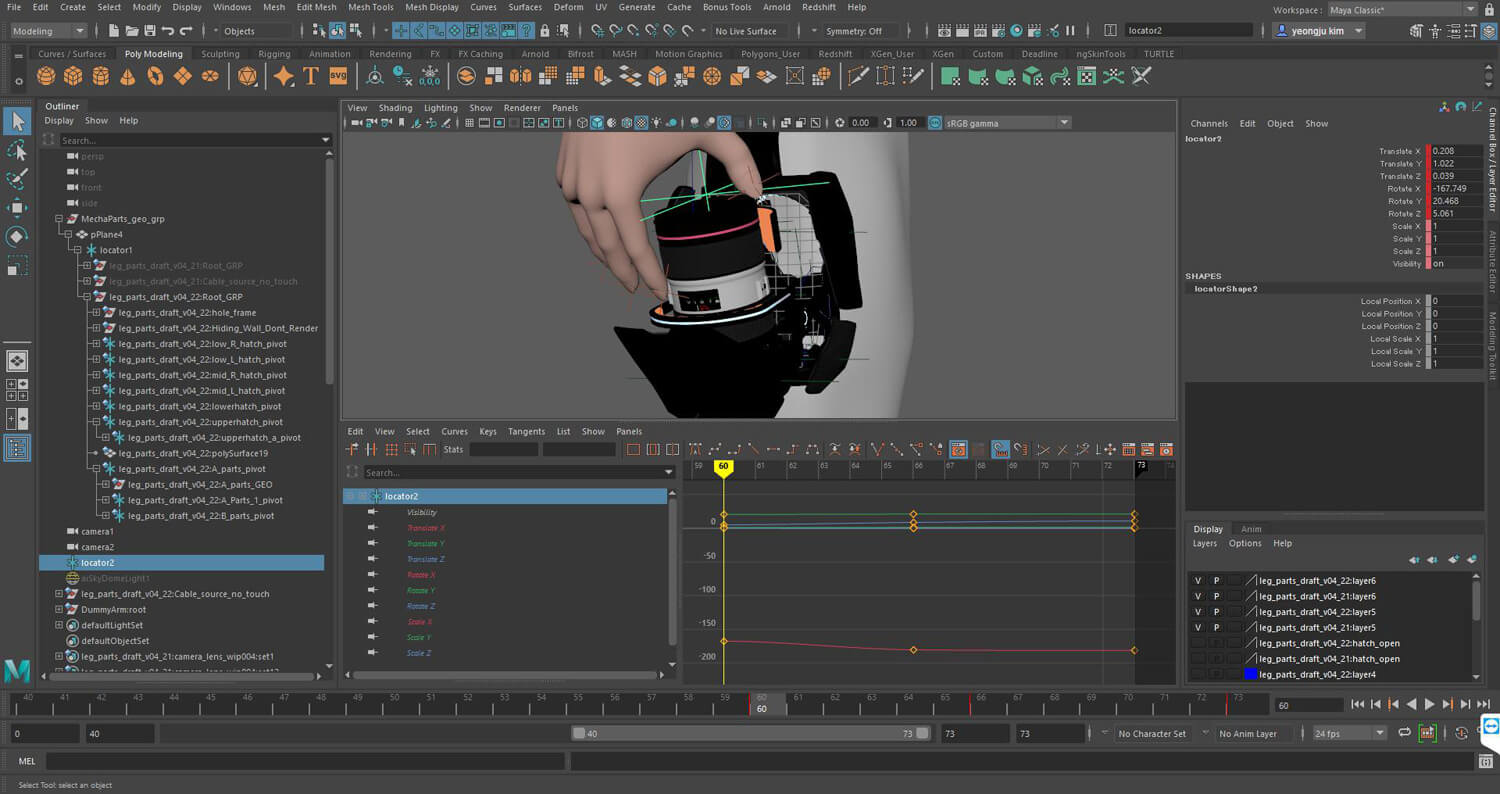

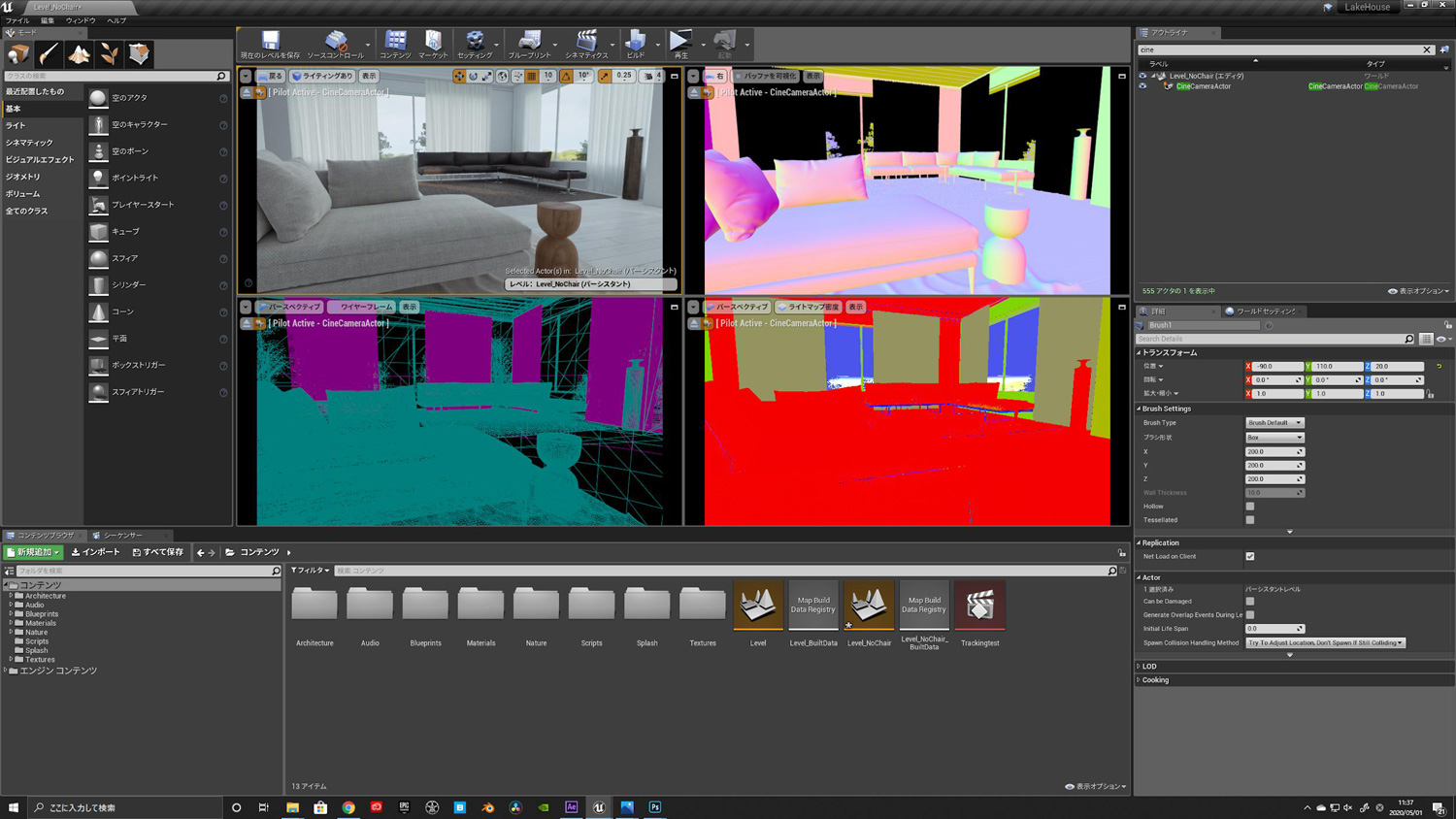

アニメーションのテスト中の画面【上】とUE4上の画面【下】。わずか1秒程度の動きにもかかわらず、担当者のこだわりが見え隠れする表現になっている

このように田森氏は「みんながよってたかってアイデアを出し合い、時間の許す限り、良いものにしていった。そのため、自分が何をしたか正確に言うことが難しい」とふり返った。準備と段取りをしっかり決めて進める、いわゆるウォーターフォール型で進むことが多い映像制作では、珍しいやり方だ。

芦田氏も「そういったスピード感は広告っぽいですね。普段つくっているのがインターネットのコンテンツや広告だったりするので、ライブ感がある映像制作に、みんな慣れていました。その上で今回は普段のCM制作より、もっとフレキシブルに動いている感じでした」とふり返った。

もっとも予想外の事態も発生した。新型コロナウイルスの感染拡大だ。これに伴い、土壇場でプロジェクトがテレワークに移行。芦田氏は連日のようにテレビで放映される小池都知事の記者会見をチェックしながら、田森氏と児玉氏にPCとモニタを自宅にもち帰るように連絡した。田森氏は「ここに来て、これかよ」と天を仰いだという。

「リリース直前の3月30日(月)と31日(火)は、なかなか熱かったですね。1回寝落ちして、朝方に目が覚めたら、未読のメッセージが90件くらいありました。何があったんだって」(田森氏)。

「緊急で芦田さんに電話をしましたよね。あのときは、つながって本当に良かったです」(児玉氏)。

「たぶん全然データが上がってこないから、不安だったんでしょうね(笑)」(芦田氏)。

ともあれ、こうした関係者の尽力もあり、映像は無事に完成。4月1日(水)に配信された。チーム全員がほっと胸をなで下ろした瞬間だった。

もっとも、「どこからどこまでが実写で、どこからがCGなのか、わからない人も多かったんじゃないかな」......ローランド氏はそのようにふり返った。

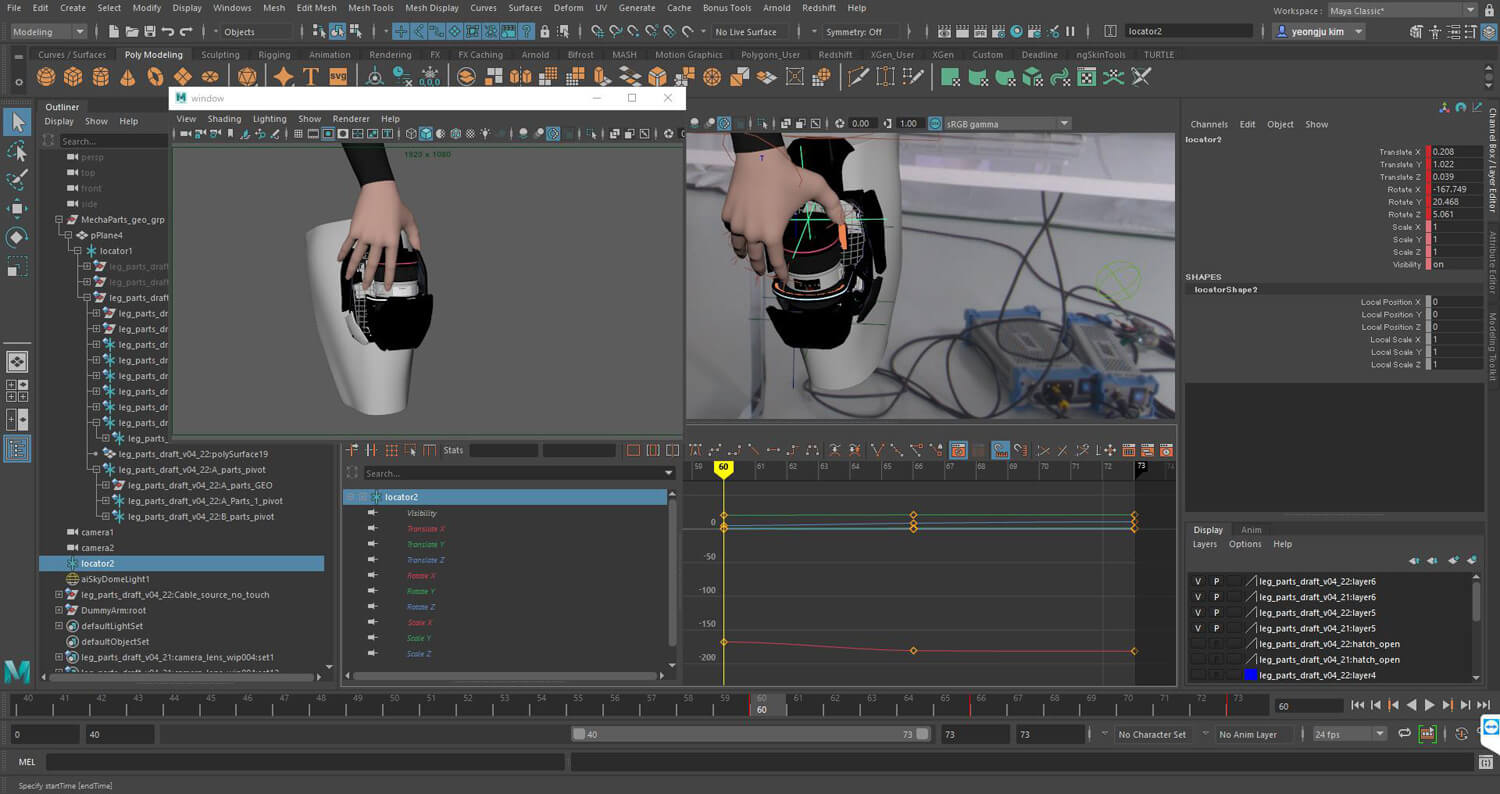

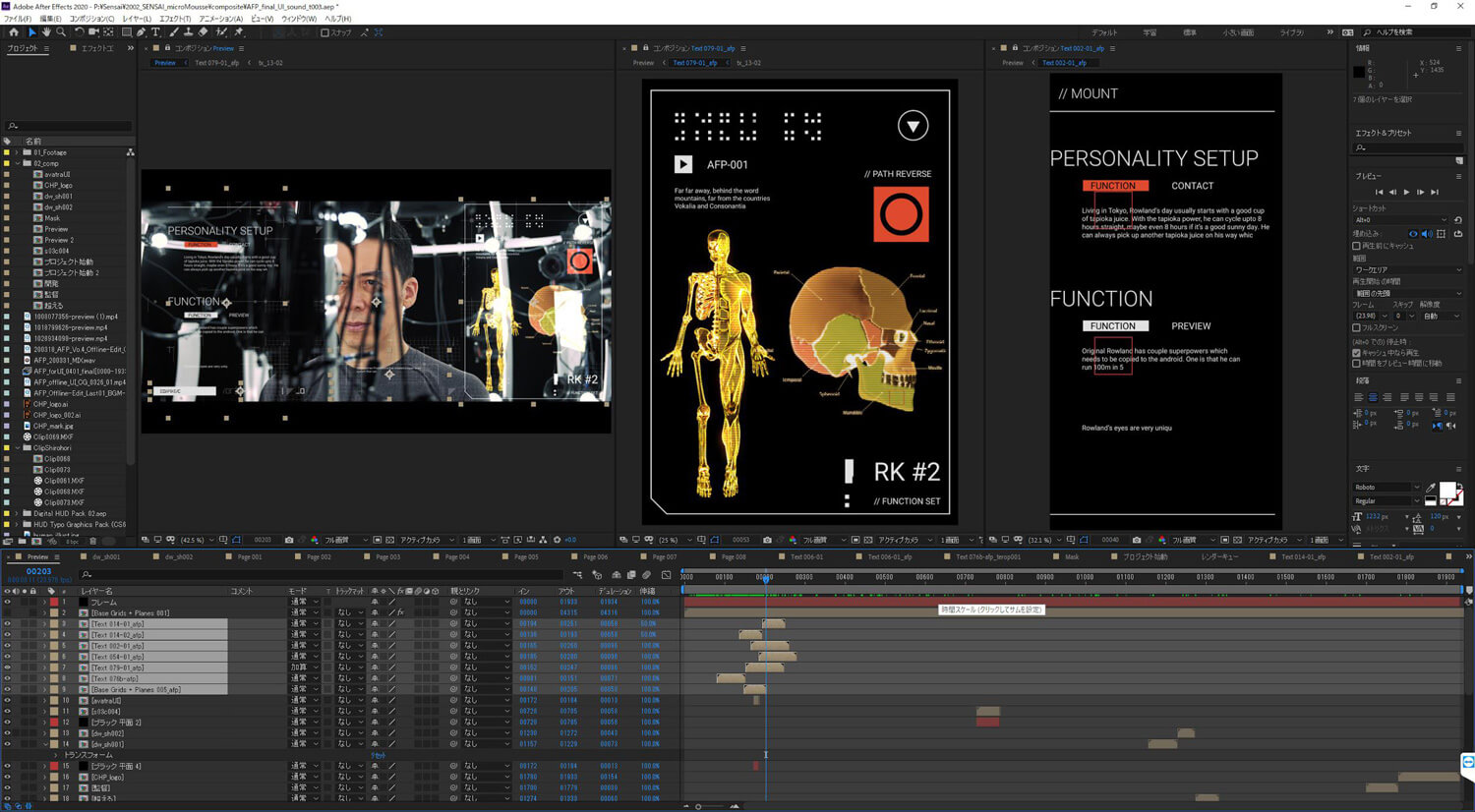

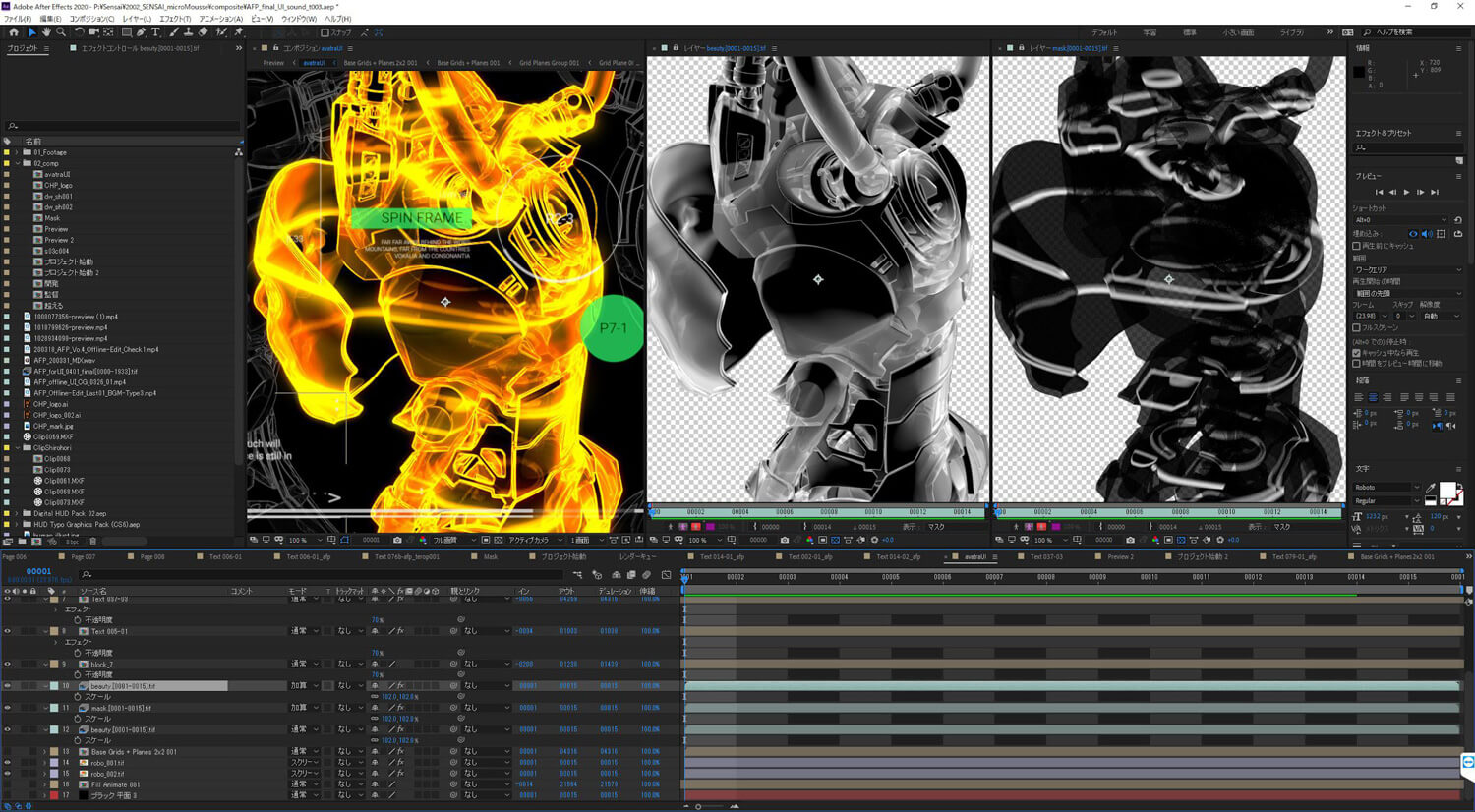

冒頭のスキャン時に表示されるUI表現におけるAfter Effectsの作業画面

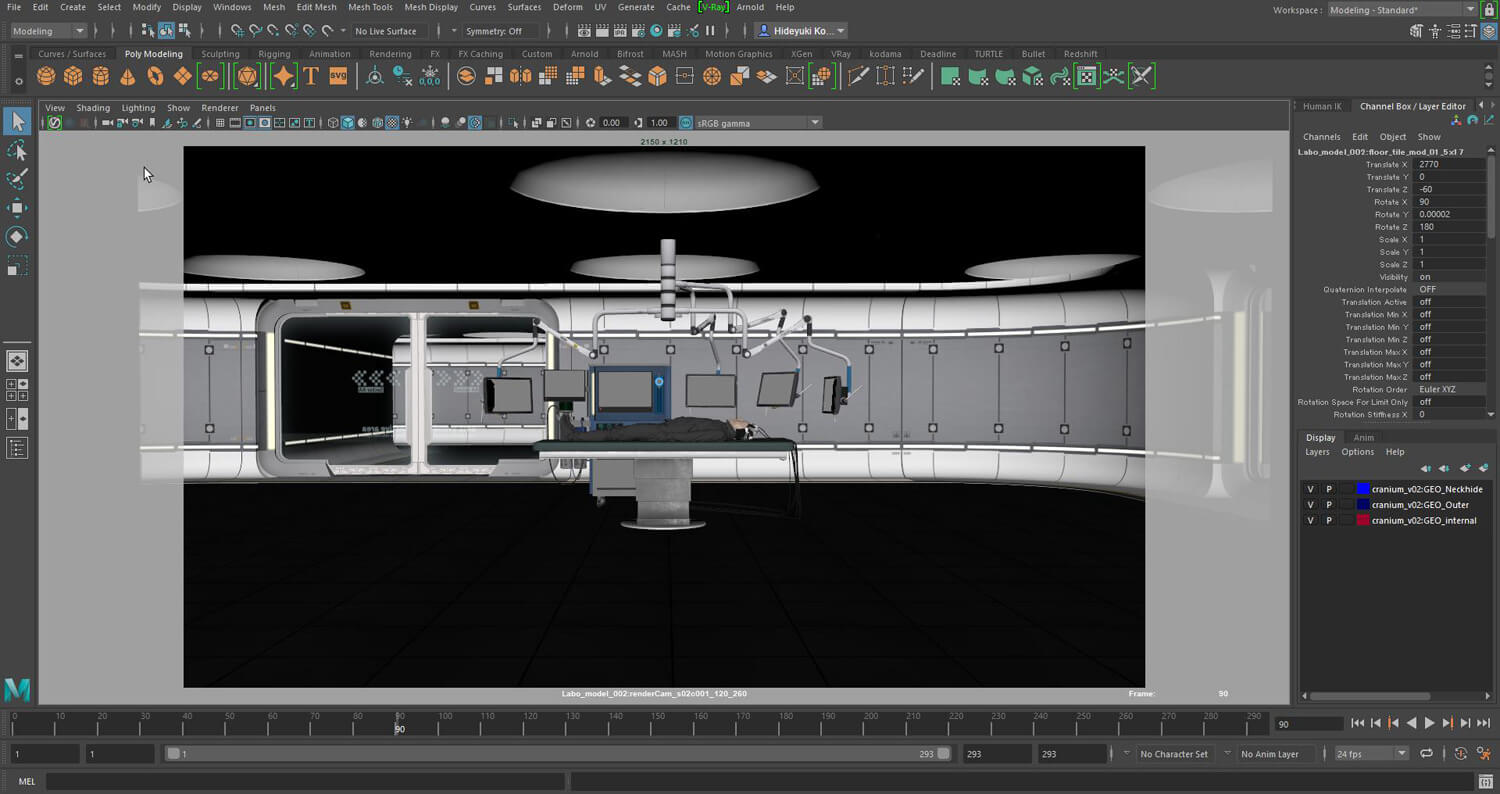

Realityでキャプチャした映像をMaya上で修正し【左】、さらにAfter EffectsでUI表現を合成して【右】完成系に仕上げた

次ページ:

フォトグラメトリとゲームエンジンで変わる映像制作

フォトグラメトリとゲームエンジンで変わる映像制作

それでは、この映像はどのようにつくられたのだろうか。メイキング動画を基に、具体的な制作工程についてふり返っていこう。

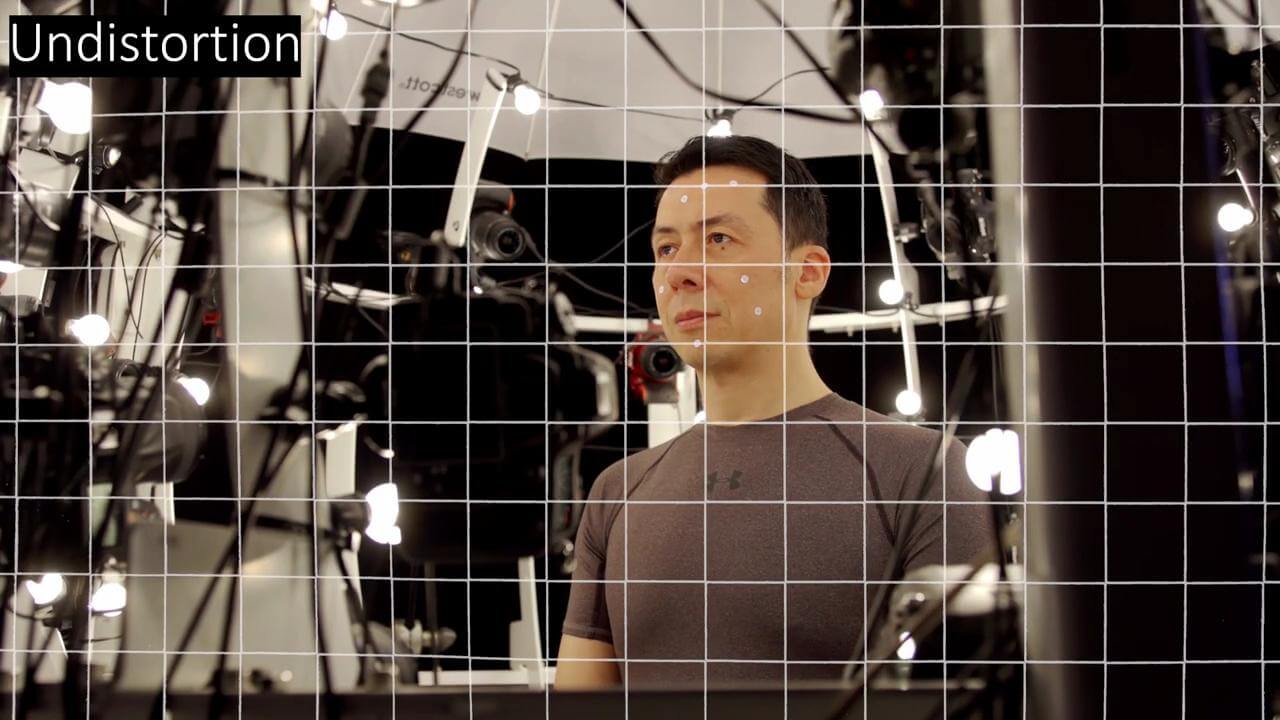

映像のキモはローランド氏そっくりの「2号」が「CG」で登場することだ。もっとも制作期間の都合上、CG部分は頭部や表情など、一部に限定されている。こちらは撮影に先行して、「THE AVATAR TRUCK」と同等のシステムで撮影。データのクリーンアップが行われた。

ラボで横たわったり、スタジオでモデルを撮影したりしている「2号」の頭部や顔のデータも、このスキャンデータを基に制作されたものだ。実際に演技しているローランド氏を実写で撮影し、頭部や表情だけがマッチムーブで合成されているのだ。

余談だが、このとき本人と似た体型のモデルを使用すれば、一度本人の頭部データをスキャンするだけで、タレントなどを映像内に「出演」させられることは、言うまでもない。もっとも制作時間の関係上、今回は胴体もローランド氏のものになっている。

【5】完成した顔の3DCGデータを実写撮影された人体とマッチムーブして合成

ローランド氏は「国内では随一、世界的に見ても3本の指に入るシステムができた。しかも、このシステムをどこにでも『出張』させられるメリットが大きい」と胸を張る。

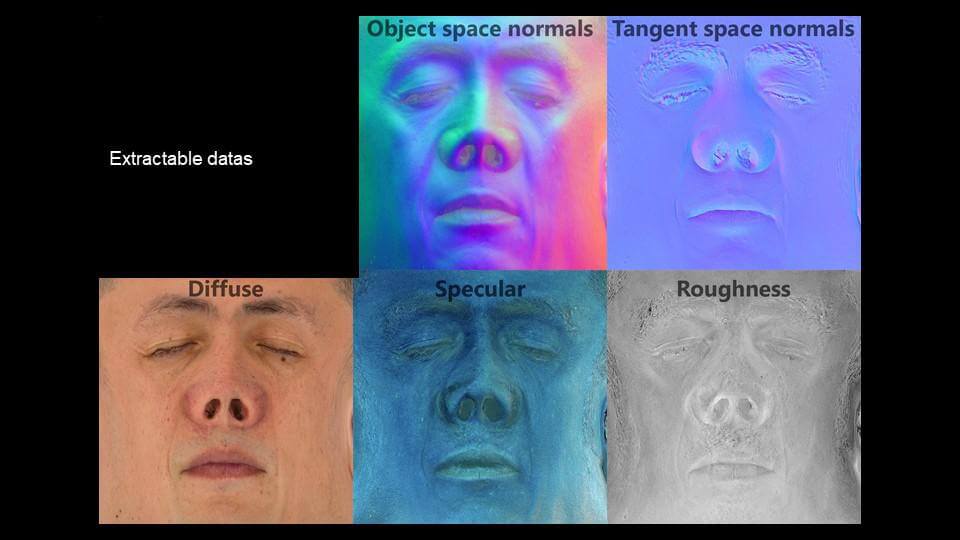

ポイントはライトシステムが刷新され、デジタルカメラで連写しながらPL(偏光)フィルタの有無を切り替えられるようになったことだ。これにより両者の差分からスペキュラマップとラフネスマップを自動生成できる。これにより一気に作業時間が短縮できたという。

もっとも課題も残っている。髪の毛の表現、レンダリング、そしてフェイシャルアニメーションだ。

ショートカットなら容易な髪の毛も、ロングヘアだと手作業に負う部分が増加し、格段に日数がかかる。レンダリング時間の短縮では、同社の主力レンダラであるArnoldのアップデートが鍵を握っている。フェイシャルアニメーションについても、表情とまとめてスキャンできるシステムを研究開発中だという。

「それでも以前に比べれば、ずいぶん時間が短縮できるようになりました。我々の目標はCMの話が来てから、90日以内で完成データをクライアントに納品すること。これまでは半年後納品でも難しかったのですが、今ではかなり現実的になっています」(ローランド氏)。

THE AVATAR TRUCKで撮影されたノーマルマップ・スペキュラマップ・ディフューズマップ

もうひとつのポイントは、主要な背景が全てCGで制作され、ゲームエンジン上で実写の撮影素材とリアルタイムで合成されている点だ。ラボとプライベートルーム風の背景がそれで、それぞれゲームエンジンのUnreal Engine(UE4)向けのアセットをカスタマイズしたものを、事前に用意して使用している。リアルタイムキャプチャにはZero DensityのReality Engine、カメラトラッキングにはRedSpyを使用。これにより合成の様子をリアルタイムに確認しながら撮影ができる。

「がっちりと事前に準備しておくのではなくて、ここから、こうやって撮ろうとか。その都度現場で思いついたアイデアをリアルタイムで確認しながら撮れたのが、クオリティが上がった要因のひとつかなと思います」(児玉氏)。

「従来のグリーンバックだと、どういう空間内で演じているのか、出演者からもわかりにくいと言われていたんですよ。それがモニタ上でリアルタイムに確認できるので、今こんな風に自分が映っているんだとわかるようになりました。これから、すごく役に立つんじゃないかな」(桐島氏)。

このようにして撮影された映像素材をNUKEに書き出し、ポストエフェクトなどが行われた。ラボのシーンではUE4からMayaにデータを書き出し、細かい修正も追加されている。こうして作成された映像素材に、サウンドやコピー(テロップ)などを追加して、最終映像が完成した。

【5】完成した顔の3DCGデータを実写撮影された人体とマッチムーブして合成

撮影を担当したムービーモンスターの跡地淳太朗氏は「前職では撮影パートと合成パートが完全に分かれていて、自分が撮影した素材がどんなふうに合成されるのか、実際に見ることはありませんでした。しかし、今回のワークフローではその場で合成された画が見られるようになり、仕事の幅が広がりました」と語る。

またロケ地、天候、スケジュールなど、現実世界に紐付く制約がなくなるため、プロダクションのスケジュール感覚が大きく変わるとも感じたという。「マジックアワーなどの再現が難しい時間帯や、ゲームやアニメのように現実では不可能な世界でも、現場でテストしながら撮影できます」。これらはゲームエンジンを中核に据えたワークフローならではだろう。

-

-

跡地淳太朗/Juntaro Atochi

ムービーモンスター

撮影

www.movie-monster.jp

もっともローランド氏は、地味ながら大きな役割を果たした要素に、照明があったと指摘する。CGのバーチャルセットと同じ光源や色空間で出演者をライティングしなければ、画に違和感が発生するからだ。そのため今回の撮影でも、プロの照明技師が参加してクオリティを引き上げている。

「CGではなく、実写のスチル写真やムービーを背景に活用することもできます」(ローランド氏)。同社には世界中の風景をHDR情報つきで撮影した、膨大なストックがある。これを活用しながらゲームエンジン上で背景とモデルを合成し、撮影できるというわけだ。コロナ禍で海外ロケが困難な中、このメリットは大きい。

また、現在のワークフローも完全ではない。跡地氏は「リアルタイムの合成はかなり癖があるので。はじめは万能だと思っていたんですが、相性というか、特性も見えてきました。逆にそのことで、これが得意なんだとか、ここを掘っていくといいとか、撮影部から提案ができるなと思いました」と指摘する。

田森氏もReality Engineによるキャプチャについて、「リアルタイムなぶん、こういうアングルになると苦手だねとか、レンズボケが入ると、うまくヌケにくいだとか、若干の制約があります。もっとも、だから格好良い画が撮れないかというと、そういうわけでもない。むしろ、現場でリアルタイムに判断できる点が大きいですね」とコメントした。

このように本ワークフローには様々な可能性があり、今後も研究開発を進めていくという。また同社では、今回の撮影ワークフローをベースに、次世代CG制作ソリューション「バーチャルプロダクション」パッケージの提供も、4月28日(火)から開始している。コロナ禍のおり、「合成された画像を観ながら、リアルタイムで人物、背景とのバランス(カメラワークの詳細)などをリモートでディレクションできる」メリットも挙げられた。

ラボのワイヤーフレーム【上】、完成映像とバーチャルスタジオ【中】、ワイヤーフレームと完成映像【下】

今回のプロジェクトが映像制作の未来にもたらす可能性

このようにクライアントワークではなく、「April Dream」企画としてつくられたことで、研究開発プロジェクトとしての性格ももつことになった本案件。それをアシストしたのが、サイバーエージェントグループの横の繋がりだ。田森氏は「このシステムをノリで使えるのが大きい」と指摘する。

芦田氏も「エイプリルフールでもハロウィーンでも良いんですが、みんなが自由に挑戦できる機会を活かして、こうしたプロジェクトができれば、それが次のクライアントワークでも活かせると思います」とコメントした。

実際、世界の映像制作はフォトグラメトリとバーチャル撮影を活用する方向に急速にシフトしている。映画『スター・ウォーズ』シリーズの外伝として、ルーカスフィルムが制作するインターネットテレビシリーズ『マンダロリアン』は、その最右翼だ。

『マンダロリアン』ではスタジオの壁面を巨大なスクリーンに活用し、UE4で表示したCGアセットを背景とした撮影が行われている。ライティングもリアルタイムに調節されるなど、究極のバーチャル撮影だ。ローランド氏は「いずれCHPでも、ああいった撮影システムを構築したい」と抱負を語る。

もっとも、こうした機材はツールに過ぎない。そのために必要なことは、企画・撮影・CG制作のチームが密接に連携して制作を進める体制を整えることだ。これは従来のウォーターフォール型で確立した映像製作のワークフローを根底から揺さぶることになる。近年、ソフトウェア開発で用いられるようになった、アジャイル型のしくみを採り入れていく必要もあるだろう。

芦田氏はこうした体制を整えやすいのが、サイバーエージェントグループの強みだとも指摘する。

「ハリウッドでは撮影プロダクションとCGプロダクションが密接に連携していますよね。それができると、照明パートなども連携できるようになる。我々もグループ会社をどんどん作っているので、予算感や規模感は格段に違うとしても、アビリティとしてはハリウッドに近しいことができると思います。特にリアルタイム合成はそうした成果が出やすい部分ですので、今後も挑戦を進めていきたいですね」。

CyberHuman Productionsでは、今回のような企画や、新しい表現に一緒に挑戦できる3DCGアーティストを探しているという。興味のある方はぜひ公式サイトをチェックしてみてほしい。