アメリカLuma AI社は3月11日(火)、生成AI向けの新しい事前学習(Pre-training)アルゴリズム「Inductive Moment Matching(IMM)」を発表した。IMMは、従来の手法である自動回帰モデル(Autoregressive model)や拡散モデル(Diffusion model)、一貫性モデル(Consistency model)などと比較して、学習済みの大規模モデルの性能をより引き出せるアルゴリズムだという。オープンソースで公開されている。

Today, we release Inductive Moment Matching (IMM): a new pre-training paradigm breaking the algorithmic ceiling of diffusion models. Higher sample quality. 10x more efficient. Single-stage, single network, stable training. Read more: https://t.co/pewpFNtJAX pic.twitter.com/PvxI6rzSsx

— Luma AI (@LumaLabsAI) March 11, 2025

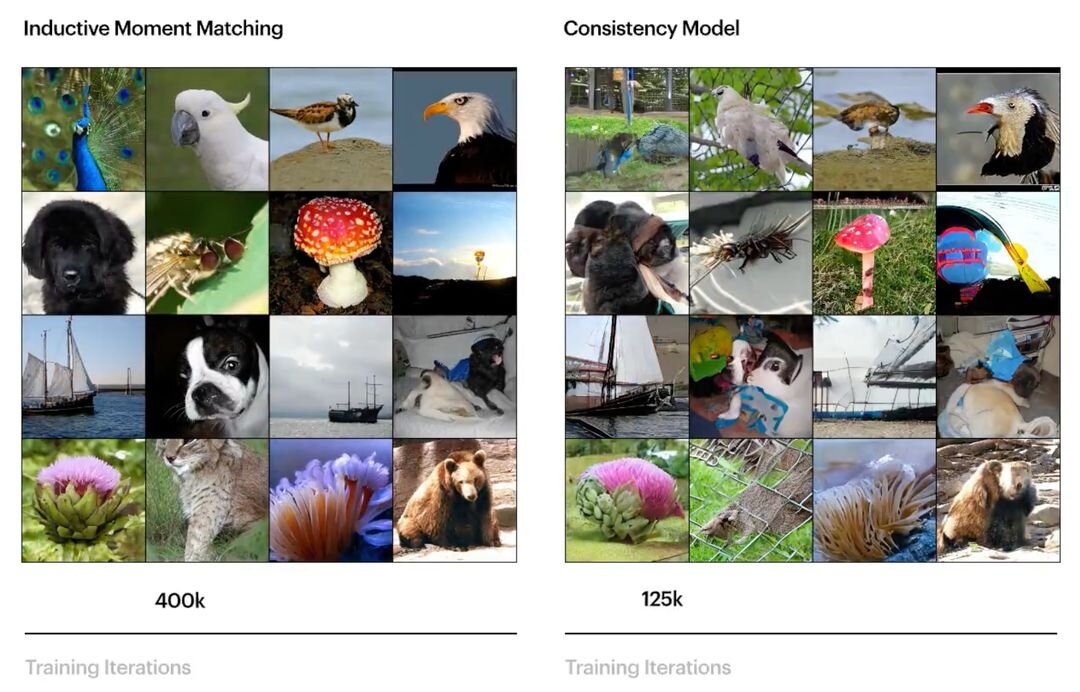

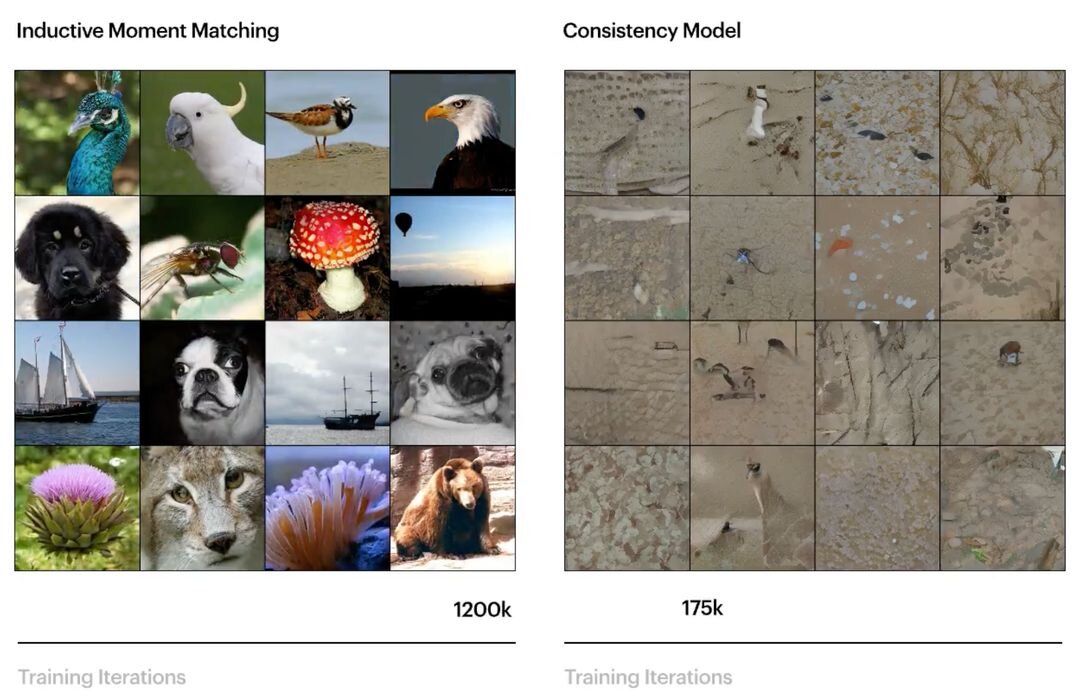

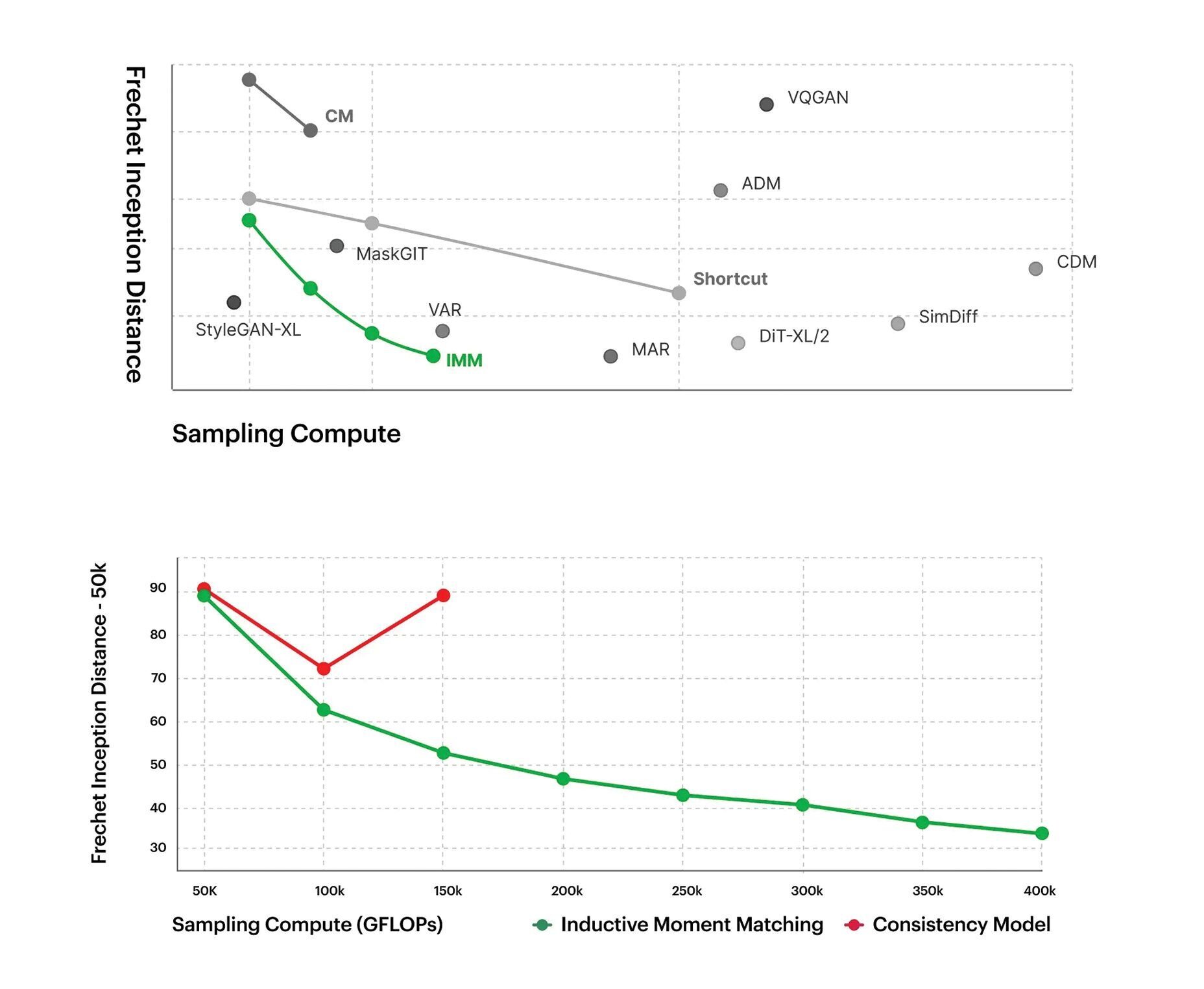

IMMは従来のモデルと比較して「サンプル品質の向上」、「サンプリング効率向上による高速生成」、「安定した学習」という3つの特徴をもつ。生成品質では、ImageNet-256×256・8ステップで1.99のFIDスコア、CIFAR-10・2ステップで1.98のFIDスコアを出したという。生成までの反復処理は拡散モデルの10分の1で済むことからサンプリング効率が向上し、高速生成を実現する。そして学習の安定性については、IMMは単一の目的関数を用いることから、一貫性モデルのように不安定にはならない。

▲IMMと一貫性モデルによる学習の安定性比較。イテレーションを上げていくごとに一貫性モデルは不安定になる

技術的側面からは、従来のモデルではインファレンス(Inference、学習済みモデルにより新しい画像を生成するプロセス)のステップが多く、計算コストが高くなってしまっていたところ、IMMでは現在のタイムステップに加えて生成後のターゲットタイムステップも同時に処理することにより、生成ステップの柔軟性と効率を大幅に向上させている。また、拡散モデルのような線形補間ではなく、MMD(Maximum Mean Discrepancy、最大平均差)を用いたモーメントマッチングを利用することにより、分布の特性を確実に捉えている。

実験の結果、IMMではモデルのサイズや計算リソースの増大に伴って生成品質が大きく向上し、学習時における調整項目(hyperparameter)の影響も少ないため、安定性も向上しているという。プロジェクトページでLumaは下記のように結んでいる。

We believe that this is just the beginning of a paradigm shift towards multi-modal foundation models that transcends current boundaries and fully unlock creative intelligence.

IMMは現在の限界を超越して創造的知性を完全に解き放つ、マルチモーダルな基礎モデルへのパラダイムシフトの始まりに過ぎないと信じている。

■Breaking the Algorithmic Ceiling in Pre-Training with Inductive Moment Matching(プロジェクトページ、英語)

https://lumalabs.ai/news/inductive-moment-matching

■Inductive Moment Matching(arXiv)

https://arxiv.org/abs/2503.07565

■Inductive Moment Matching(GitHub)

https://github.com/lumalabs/imm

CGWORLD関連情報

●Lumaの動画生成AI「Dream Machine」の「Ray2」アップデート! キーフレーム、動画の拡張、ループ動画作成に対応、低コスト版の「Ray2 Flash」もリリース

Luma AIが動画生成AI「Dream Machine」で利用可能な動画生成モデル「Ray2」のアップデートを発表し、Dream Machine内で利用可能にした。新しいRay2はキーフレーム、動画の拡張、ループ動画作成に対応する。また、Ray2よりも低コストかつ高速生成が可能な廉価モデル「Ray2 Flash」もリリースし、同じく利用可能にした。

https://cgworld.jp/flashnews/202503-Luma-Ray2-update.html

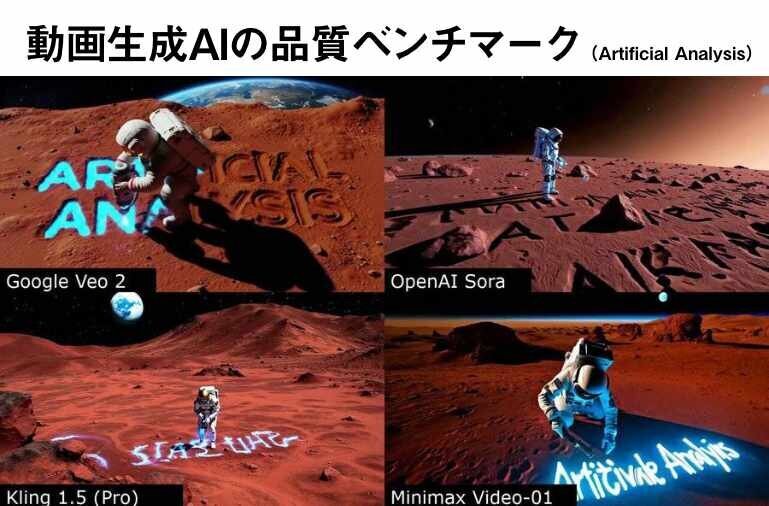

●Artificial AnalysisがGoogle Veo 2、Sora、Kling 1.5 Proなどの生成品質をベンチマーク! 結果はVeo 2に軍配

Artificial Analysisが主要動画生成AIの生成品質のベンチマーク結果(Arena Elo)をSNSで公開。5種類のプロンプトを用いて生成された動画の品質比較において、「Google Veo 2」が最も高いレーティングを獲得し、快手「Kling 1.5 Pro」(クリング)とOpenAI「Sora」がそれに続く結果となった。

https://cgworld.jp/flashnews/202503-ArtificialAnalysis.html

●動画生成AI「CineMaster」発表! 3D空間内のオブジェクトとカメラを柔軟に制御可能なText-to-Videoフレームワーク

大連理工大学、香港中文大学、快手の研究チームが動画生成AIフレームワーク「CineMaster: A 3D-Aware and Controllable Framework for Cinematic Text-to-Video Generation」の査読前論文(プレプリント)を公開。Text-to-Videoの動画生成において、ユーザーが3D空間内のオブジェクトとカメラを操作して、高品質なシネマティック動画を生成できる技術となる。

https://cgworld.jp/flashnews/202502-CineMaster.html