Meta社は2月28日(金)、同社ARグラス開発プロジェクト「Project Aria」の次世代開発機「Aria Gen 2」を発表した。最新センサー群を搭載し、前モデルよりも処理能力や使用可能時間が向上したほか、人間の視点から世界認識を行うAIシステムの研究用に特化した新機能を備える。

最先端のセンサー群を搭載

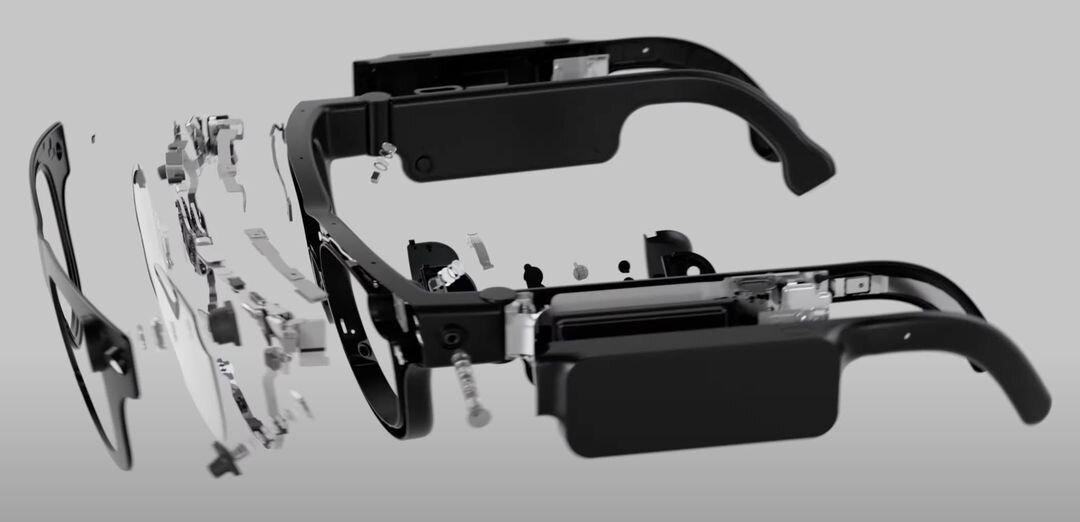

Aria Gen 2には、アップグレードされたRGBカメラ、SLAMカメラ、視線追跡カメラ、空間マイク、IMU、気圧計、磁力計、GNSSが搭載されているほか、ノーズパッドには心拍数測定用のPPGセンサーと接触型マイクを新たに搭載。接触型マイクは、装着者の声とそれ以外の声を識別するために利用される。

また、SLAMやアイトラッキング、ハンドトラッキング、音声認識には全てMetaのカスタムシリコンが使用され、Aria Gen 2のデバイス内で処理される。

重さは約75グラム、連続6〜8時間の使用が可能で、一般的な眼鏡と同様にアームの折りたたみが可能。さらに、オープンイヤー式の高音質スピーカーによる音声フィードバックを得られることから、ユーザー参加型システムのプロトタイピングの利用が可能となる。

Ariaを活用したアクセシビリティのための新技術開発

MetaはAria Gen 2の活用事例として、Envision社による視覚障害者向け支援の様子も紹介。Aria Gen 2のオンデバイスSLAM機能とオンボードスピーカーを介した空間オーディオ機能により、屋内環境のシームレスなナビゲートを調査研究している。

■Introducing Aria Gen 2: Unlocking New Research in Machine Perception, Contextual AI, Robotics, and More(Metaブログ、英語)

https://www.meta.com/ja-jp/blog/project-aria-gen-2-next-generation-egocentric-research-glasses-reality-labs-ai-robotics/

Project Ariaについて

「Project Aria」はMeta社が2020年から進めているリサーチプログラム。最先端の研究用ハードウェアとオープンソースのデータセット、モデル、ツールへのアクセスを通じて、機械知覚とAIの最先端技術の進歩を目的に、世界中の研究を推進している。リサーチパートナーとして承認を得た団体には、Aria AIグラスとSDKを含む「Aria Research Kit」が提供されている。

■Project Ariaホームページ

https://www.projectaria.com/

CGWORLD関連情報

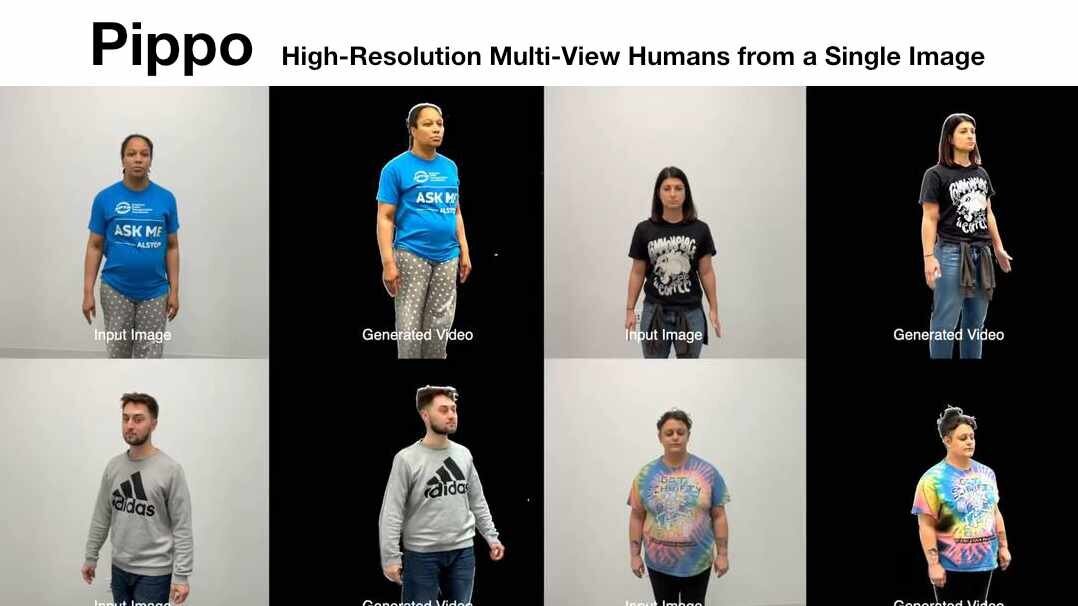

●Metaら、人物写真1枚からマルチアングル動画を生成できる画像生成AI技術「Pippo」を発表!

Meta Reality Labsやトロント大学の研究チームが画像生成AI技術「Pippo : High-Resolution Multi-View Humans from a Single Image」の論文を発表し、GitHubでトレーニングコードを公開。本技術は、トランスフォーマーをベースにした拡散モデル(DiT、Diffusion Transfomer)により、1枚の人物写真から複数アングルを推定し、1K解像度のマルチビュー画像を生成するもの。

https://cgworld.jp/flashnews/202502-Meta-AI-Pippo.html

●Meta、AIアバターの動作基盤モデル「Meta Motivo」公開! トレーニングや事前データセットなしでリアルなモーションを実現

Metaの基礎AI研究チーム(Meta FAIR)が動作基盤モデル「Meta Motivo」の研究結果を公開。Meta Motivoは同社の新アルゴリズムに基づく教師なし強化学習を基礎とするAIアバターの動作基盤モデル。バーチャル環境において、より人間らしい動きができるNPCキャラクターを生み出すためのエンボディドAI(Embodied AI、人型ロボットのような身体性のあるロボットのAIシステム)のひとつとなる。

https://cgworld.jp/flashnews/202412-Meta-Motivo.html

●Meta、動画生成AI「Meta Movie Gen」発表! Text to Video、Image to Videoだけでなくサウンドの生成や動画のアレンジにも対応

Metaが動画生成AI「Meta Movie Gen」を発表し、ブログ記事、論文、機能紹介ページを公開。Text to Video、サウンドの生成、動画のアレンジ(編集)、Image to Videoに対応するモデルとなり、生成される動画については、「業界初、異なるアスペクト比の長尺高精細ビデオを生成可能」だという。なおMeta Movie Genはまだ発表のみで、ユーザーが利用することはできない。

https://cgworld.jp/flashnews/202410-MetaMovieGen.html