3DCGアニメーションの制作現場では、膨大なレンダリングファームで高品質な映像を制作する一方、ゲームエンジンのレンダラを使うというながれができつつある。ここで紹介するツールPiStageはMaya上からアセットと完成したシーンを自動的に変換し、Unreal Engineでリアルタイム表示させる機能をもたらすPi Square社のプラグイン製品だ。このPiStageによって従来のアニメーション制作パイプラインに圧倒的な効率化がもたらされるという。

このPiStageの日本国内販売開始を記念して開催されたセミナーで、Pi Square社CEOのSpock ヤオ氏の話を聞くことができた。さらにEPIC Games Japan セールスマネージャーの杉山 明氏も登場し、Unreal Engineを活用したアニメーションの制作事例も紹介された。本稿ではその内容を、レポートしていく。

※本記事は2019年6月28日の取材内容に基づきます。

TEXT & PHOTO_安藤幸央(エクサ)/Yukio Ando(EXA CORPORATION)

EDIT_山田桃子 / Momoko Yamada

<1>次世代のプロダクションパイプライン「PiStage」

従来のCGアニメーション制作は、コストがかかり時間もかかる。高価なハードウェアが必要で、レンダリング時間も遅い。変更や修正があると数日かかることもあり、小さな変更だとしても修正にとても時間がかかる。「制作にかかる日数が膨大で、最終的な結果を見られるようになるまでに時間がかかりすぎるのが従来のアニメーション制作の問題だ」と、PiSquareの共同創業者&CEOである、Spock Yao/スポック・ヤオ氏(以下、ヤオ氏)は考えた。

そこでヤオ氏はゲームエンジンでのレンダリングを、アニメーション制作に取り込むことにした。MayaとUnreal Engineとの組み合わせで、ハイエンドPCやレンダリングファームを用意することなく、ゲームで遊ぶためのデスクトップPCでも3DCGを制作できるようにするのだ。そうすればハードウェアのコストも安く、リアルタイムレンダリングなので、従来型のレンダリングに比べれば約1000倍は制作スピードが速くなることが期待される。瞬時にレンダリングされることによって、制作や修正の即時性が上がり、スムーズなワークフローが得られる。

すでにいくつかのCGプロダクションではゲームエンジンをレンダリングに用いることで効率が上がることがわかってきており、ゲームエンジンの採用が進められている。

リアルタイムレンダリングは、すでにルーカスフィルムなどで利用されている

ただし、ゲームエンジンを映像制作に用いた場合ならではの課題もいくつか存在する。

ゲームエンジンを映像制作に用いた場合の課題

・アセットの仕様と作成ルールが従来とは異なる。一般的にはとても面倒

・ゲームエンジンにはアニメーションの編集機能がない。または十分ではない

・手動でモデルやアニメーションをゲームエンジン用に変換するのは面倒

・アーティストがゲームエンジンでの作業を学ぶ必要がある

PiStageではこれらの課題を解決し、Mayaで扱っているアセットとシーンを自動的にUnreal Engine用に変換し、それらのデータをリンクする機能を提供する。MayaとUnreal Engineで扱うデータがシンクロし、MayaでつくったものがそのままUnreal Engineで扱え、Unreal Engine上での修正や調整がMaya側にも反映される。

Next-Gen Pipeline for Previs and Animation (updated)

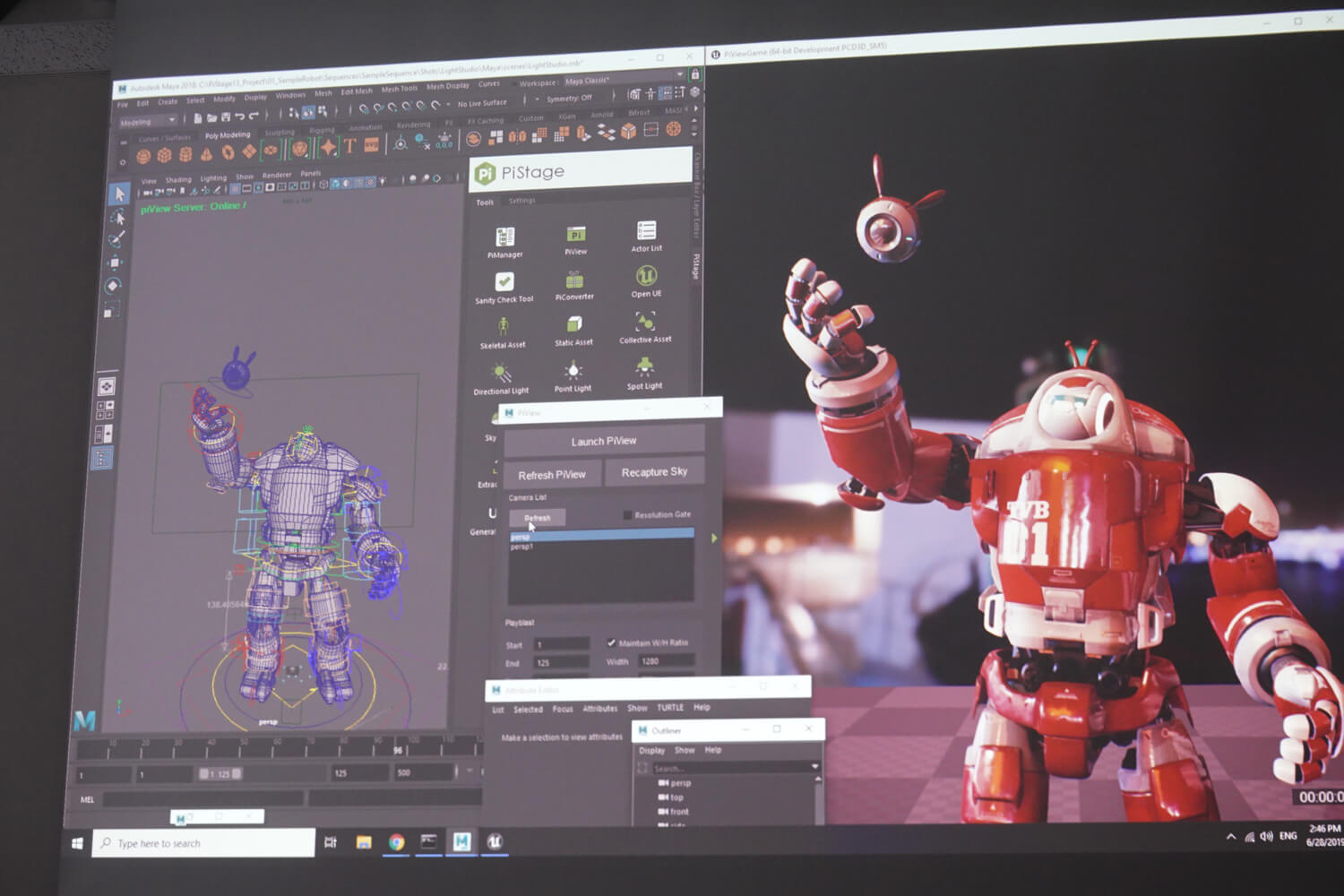

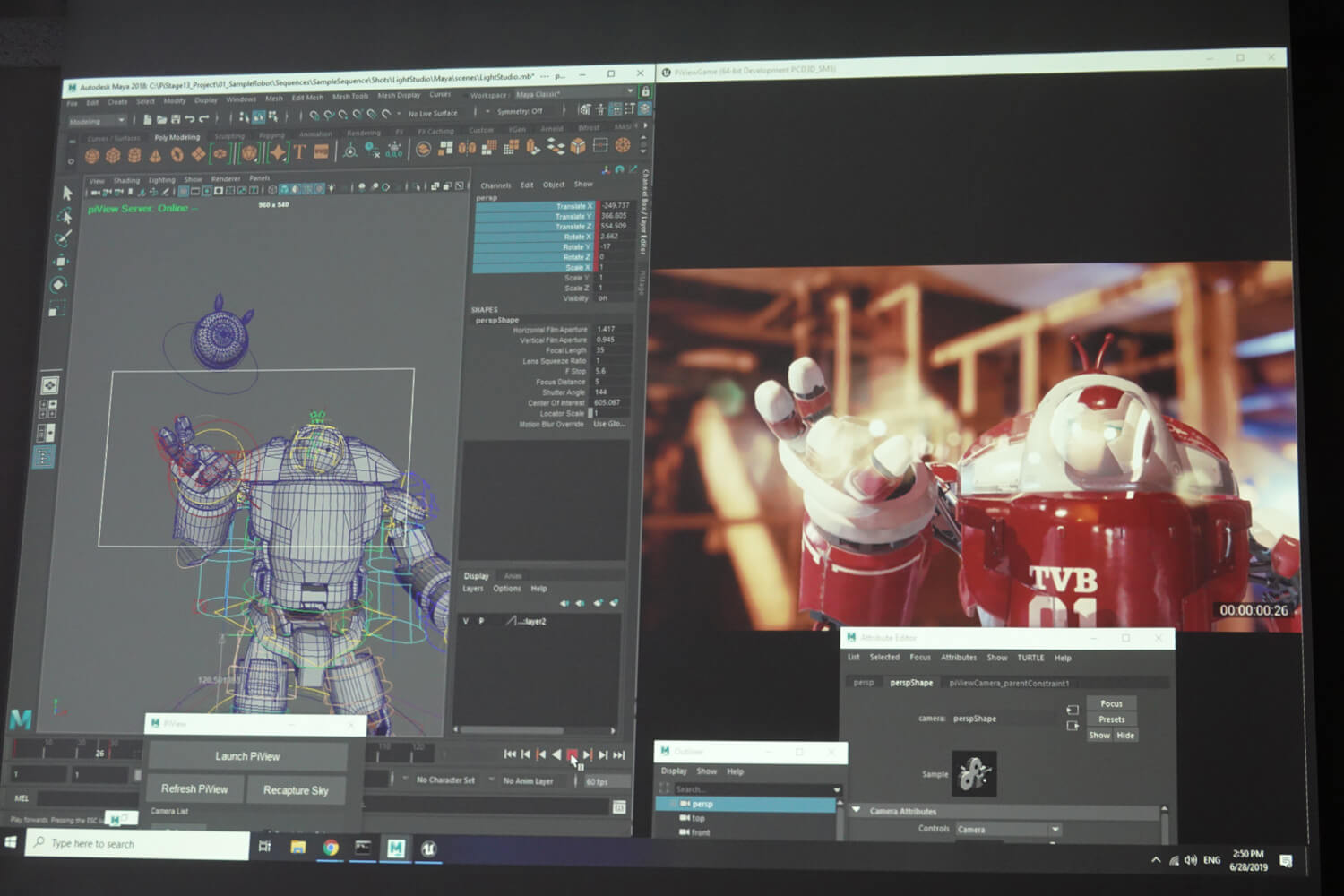

PiStageはMayaのプラグインとして動作し、PiStageをインストールするとMayaの操作パネルに様々なパラメータが表示される。これがコンテントクリエーションツールセットで、ゲームエンジンに準拠したモデルやスケルトン、シェーダなどを作成できるようになる。

MayaもUnreal Engineも3DCGを扱うが、厳密にはできることや表現方法などが異なる。そのため「サニティチェック(Sanity Check)」というツールが用意されており、このツールを使うとMayaのデータがそのまま変換できるのか、なにかそのままでは変換できない要素があって、修正が必要なのかがわかる。ツール上で黄色になるものは、多少問題があるがそのまま使えるデータ、赤色になるものは、ゲームエンジン上では使えないもの......といった具合に修正が必要なものが表示される。このツールによってどのメッシュやどのノードがゲームエンジンのデータに変換できるのか・変換できないのかがわかる。

コンテントクリエーションツール

PiStageを導入することでプロダクションワークフローがどうなるかというと、MayaからUnreal Engineにデータを自動変換し、表示内容を同期させながら制作を進めることができるようになる。またUnreal Engineのフォーマットに変換された後は3DCGアニメーション用途だけでなく、VRコンテンツとして活用することも可能だ。

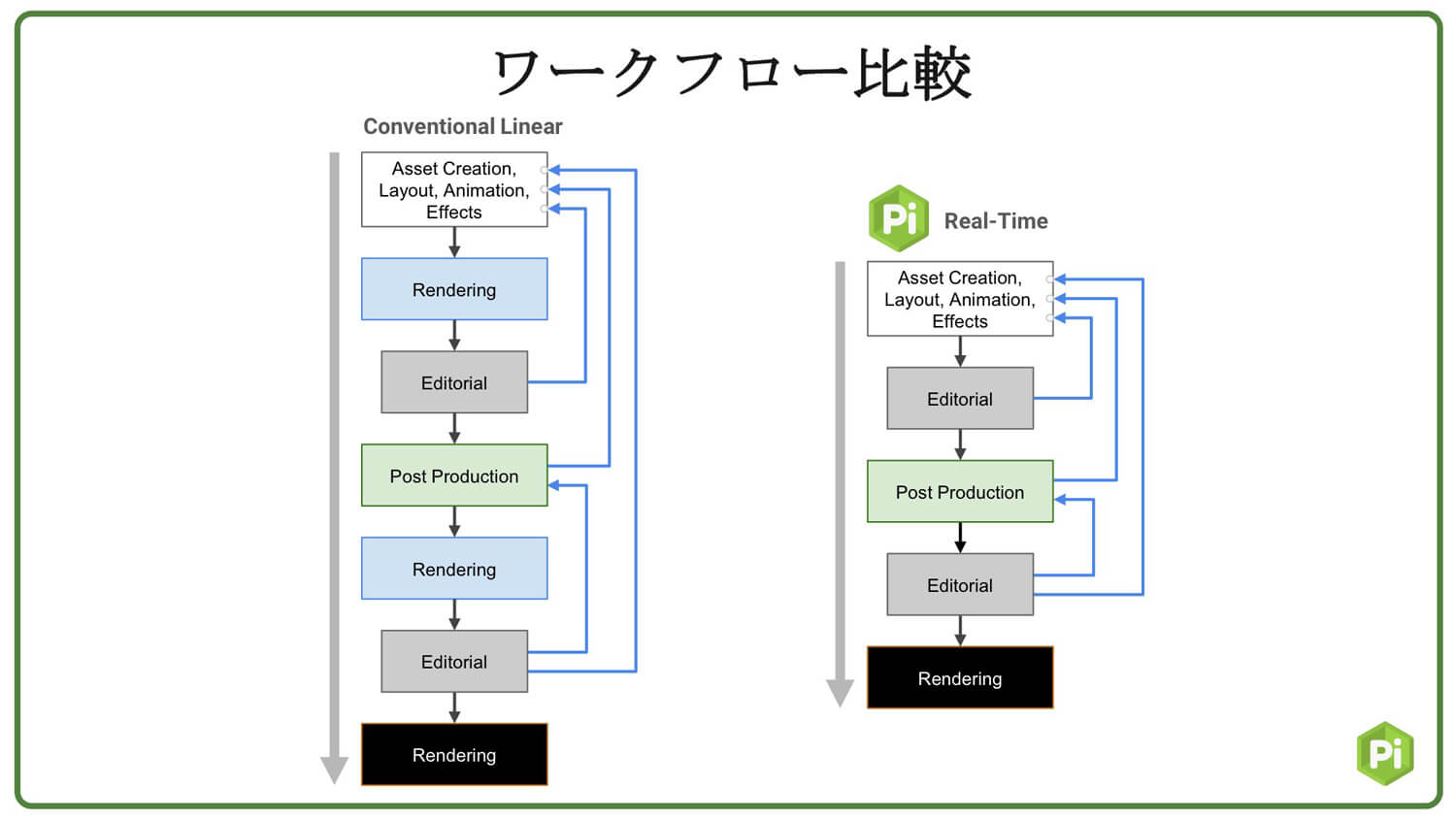

従来タイプのワークフローとPiStageを使ったMayaからUnreal Engineへのワーフローの比較(提供:マレーシアのCGアニメーションスタジオGiggle Garage Sdn Bhd)

従来型の3DCG映像制作の場合、アセット制作、レイアウト、アニメーションをつくったあとにレンダリングをして、レビューを実施。そこで変更の必要があれば、また制作工程の最初に戻るというのが一般的なながれだった。レビューでOKがでればその後のポストプロダクションに移り、それらの作業が終われば最終レンダリング。そしてまたレビューの繰り返し。とても時間と手間がかかる工程である。おまけにレビューの評価が悪いと最悪の場合、一番最初の工程に戻る場合もあるのだ。

一方、PiStageではリアルタイムでプレビューの結果を見ながら制作することができる。様々なプロセスをリアルタイムで確認しながら作業を進めることができ、満足する結果であればすぐに最終レンダリングを行える。全体的なプロセスを簡単にし、全てを速い時間、短い時間で処理することが可能だ。

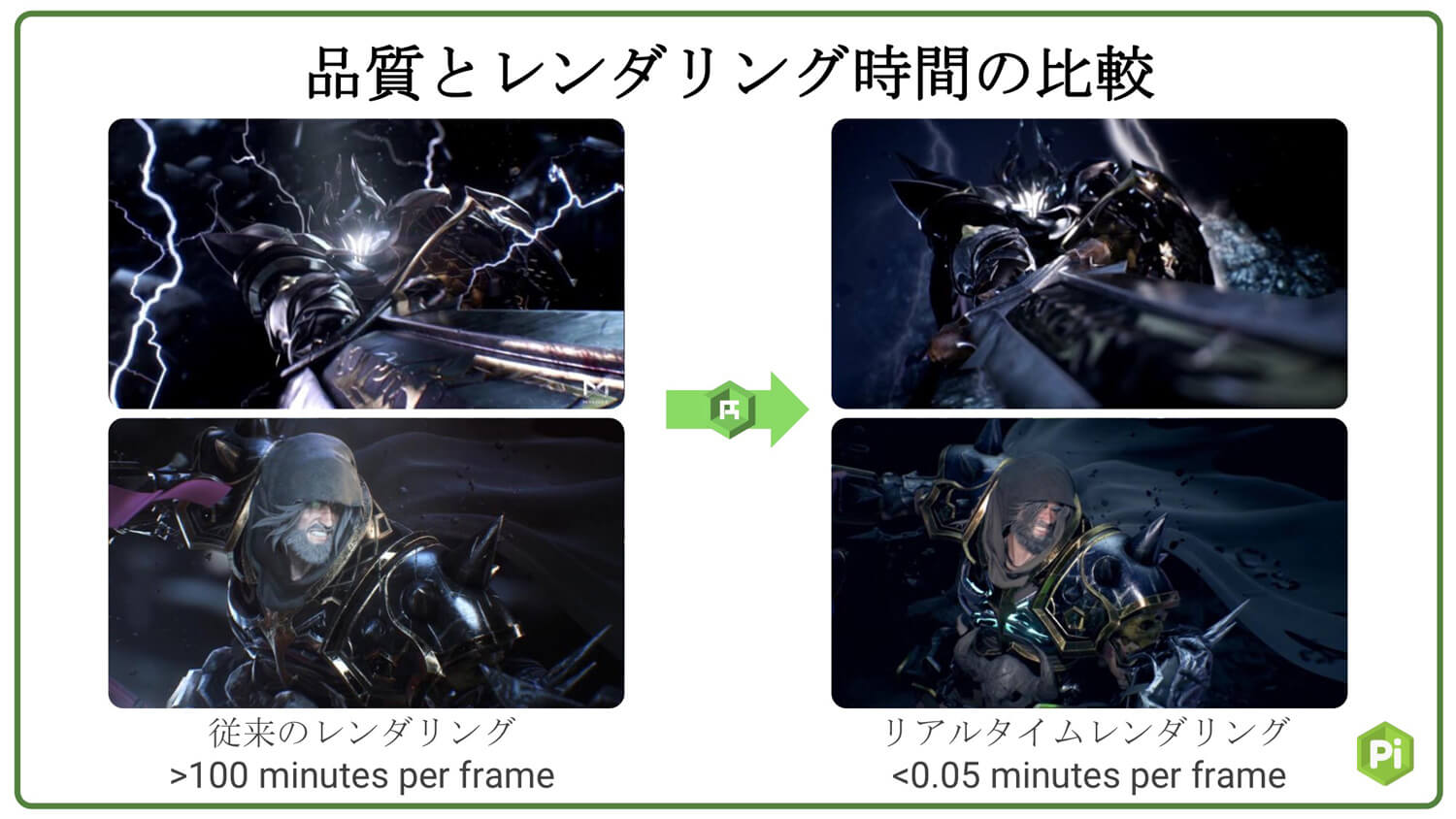

品質とレンダリング時間の比較

心配される品質も、ゲームエンジンでレンダリングすることを想定して制作していれば見た目はそれほど変わらない。通常のオフラインレンダリングであれば4Kサイズで100分かかったところが、Unreal Engineだと約4秒しかかからない。これらのレンダリングの高速化の恩恵は映像シーケンスが長いほど、より多くのメリットを得ることができる。

フルHD120秒のショットにかかる制作時間の比較(提供:マレーシアのCGアニメーションスタジオGiggle Garage Sdn Bhd)

では、それぞれの作業工程を比較してみよう。PiStageを使った場合、アセットの変換やチェックが必要なので、最初の作業時間が少し長くなる。アニメーション制作そのものにかかる時間はほぼ同じだ。その一方でPiStageを使った場合、ライティング作業はその場でインタラクティブに調整でき、すぐに結果を見ることができるので非常に制作時間が短くなる。

PC一台で制作した場合、レンダリングに90日ほどかかるレンダリング作業や、レンダーファームを使っても数日かかる作業でも、Unreal Engineでのリアルタイムレンダリングを活用するとコーヒーを一杯飲むほどの時間で終了する。

また、PiStageとUnreal Engineのリアルタイムレンダリングで、時間だけでなく、人的リソースも25%ほど削減することができる。

あるプリビズ映像制作会社の場合、通常14人が映像制作に関わっていた。ところがPiStageを使うと、10人ほどで同じ作業ができるようになり、残りの人は別の仕事ができるようになった。「PiStageはただのデータの架け橋ではありません。PiStageはプロダクションのハブになることができるのです」とヤオ氏は言う。

PiStage for Virtual Production : PiStageのバーチャルプロダクションでの利用事例

Create a Natural Scene with PiStage:自然環境シーンの制作事例

GETOP Virtual Production | Space station 技術展示:バーチャルスタジオ事例

このようにPiStageは3DCGアニメーション制作のほかにも、プリビズ制作やVR/ARコンテンツ制作、建築CG、バーチャルプロダクションで使われることが多くなってきている。

[[SplitPage]]<2>PiStageユーザーの事例紹介

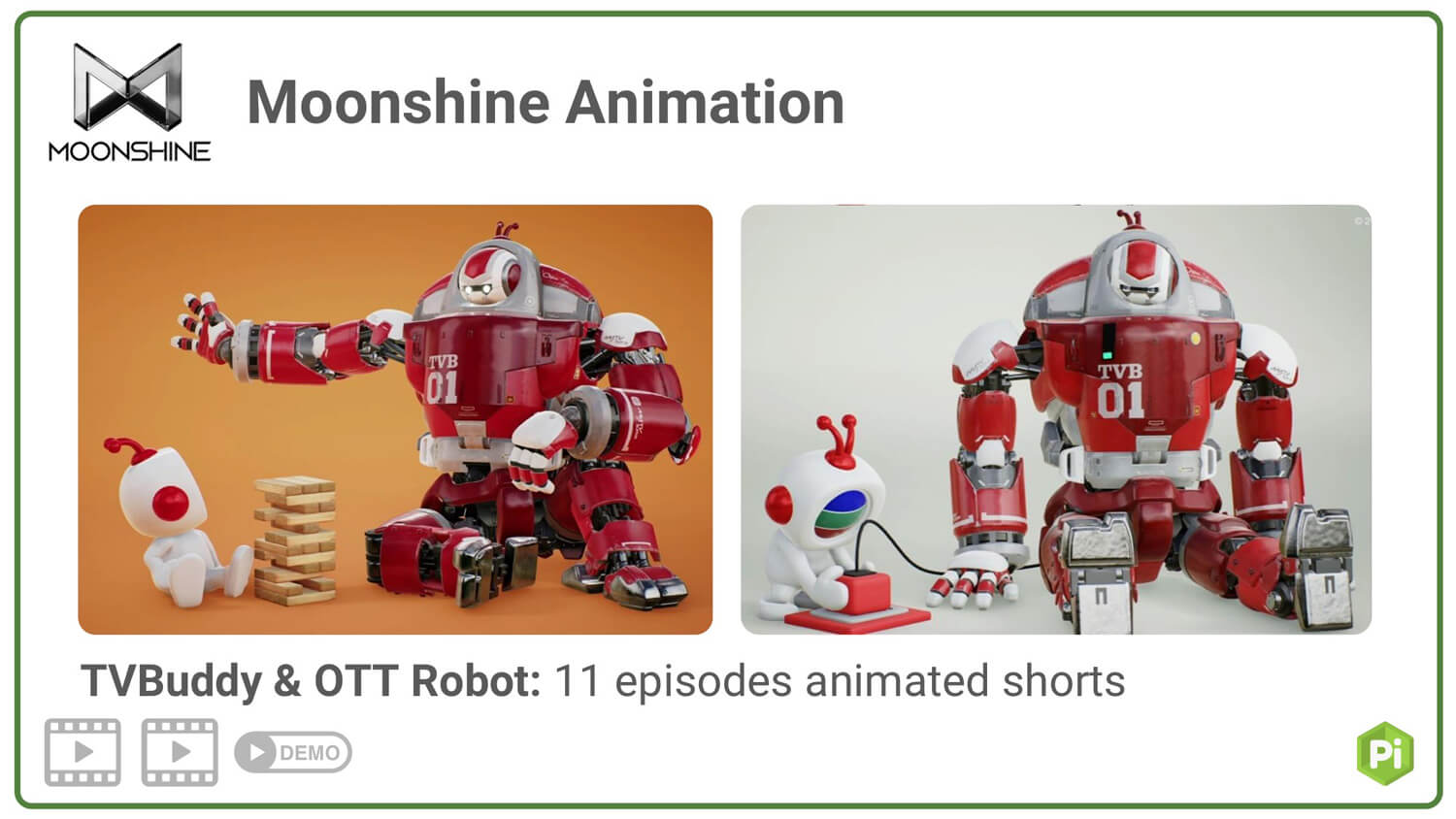

MoonShine Animation:PiStageをベータ版から使っている古参ユーザーの事例

TVBuddy Animations made with Pi Square Pipeline

台湾のMoonShine Animationではゲーム用の3Dデータの流用ではなくCGI用に別途用意したデータが使用されている。フル3DCGアニメーションの番組30エピソード、3つのVRプロジェクトがPiStageを活用して制作された。360度VR映像の場合、どこにカメラを設置するのかが重要な課題になるが、PiStageを活用すればリアルタイムにキャラクターを動かしながらカメラの位置を細かく検討し、調整することが可能となるという。

【上】MoonShine Animationから借りた実データで、MayaとUnreal Engineを繋いだPiStage表示例、【下】同上。レンズフレアあり

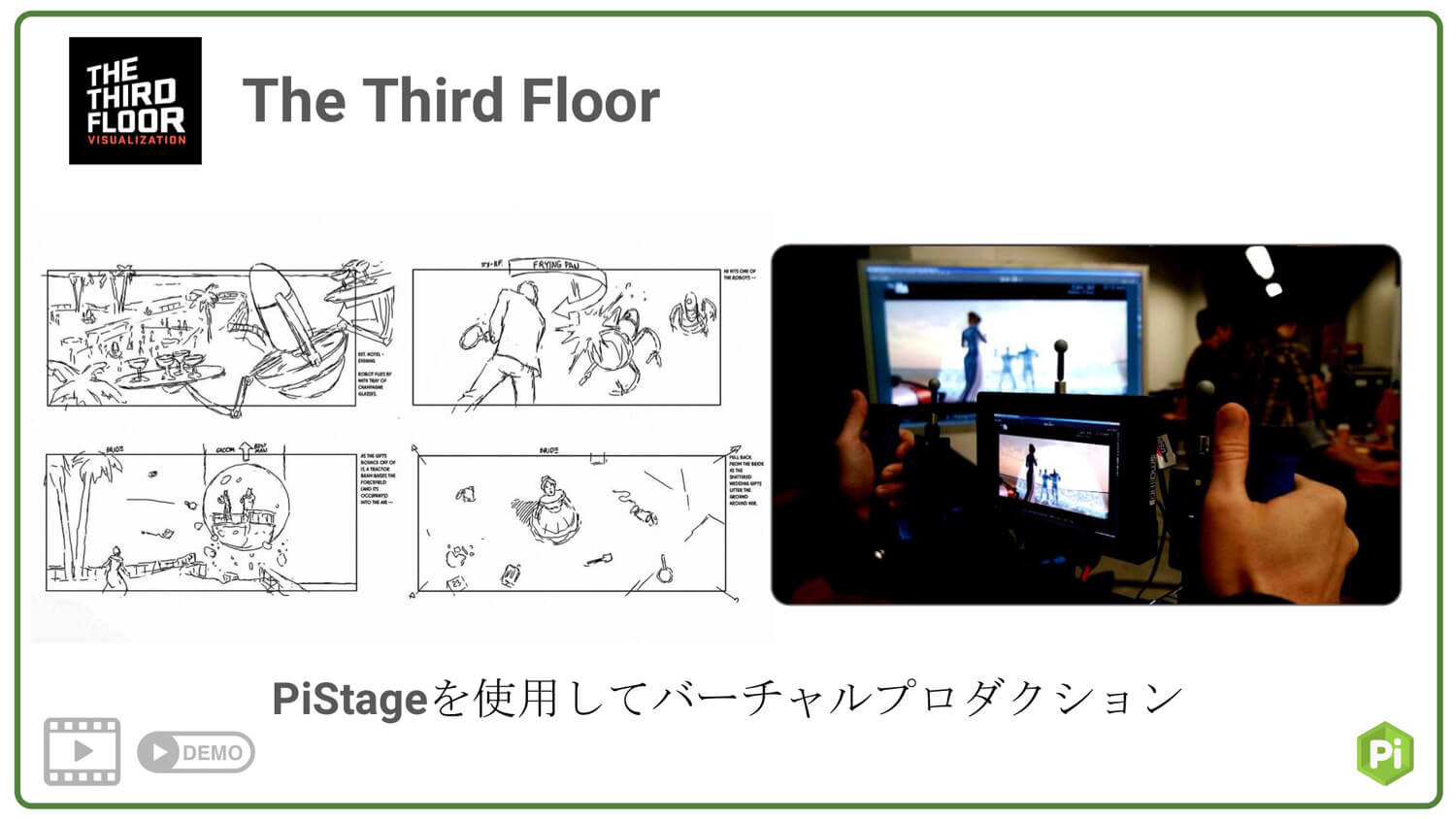

The Third Floor:ハリウッドのメジャーなプリビズ専門のスタジオ

プリビズのバーチャルプロダクション

The Third Floorはプリビズ専門のCGスタジオで、マーベルのスーパーヒーロー映画のプリビズはほとんどこの会社が手がけている。以前はMaya Viewport 2.0をプリビズ用に使っていたが、クオリティで気に入らないことが多々あり、ゲームエンジンを使うことを考え始めたそうだ。ところが何ヵ月もかかって試行錯誤したが、満足するプリビズが完成しなかった。そのためPiStageを見つけるまでは失敗の連続だったという。PiStageを使い、もともともっていたMayaのアセットをUnreal Engine用に変換することですぐに成果を得ることができた。ストーリーボード、ゲームエンジンとバーチャルカメラ、リアルタイムのクロースシミュレーションを利用することもでき、ライブでモーションキャプチャのデータを取り込むこともできる素晴らしいプリビズ環境が完成したという。

その他のPiStage活用作品

GO GO GIWAS_new_trailer(Engine Studio)

『ノーマン・ザ・スノーマン〜北の国のオーロラ』(太陽企画)。ストップモーションアニメ作品のVR用のリメイクでPiStageが活用された

<3>7月リリース予定、PiStage 1.3の新機能

2019年7月にリリース予定されているPiStage 1.3の新しい機能は、以下の通り。

・最新のUnreal 4.22のサポート

・リアルタイムレイトレーシング対応

・プロジェクトセッティング、メモリのコントロール、レンダリングセッティング可能に

・Rectangular Area Lightサポート

・アセットマネジメントとアクターマネジメント機能の向上

・Maya Camera シーケンスの設定をサポート。複数カメラのコントロールが可能に

・Mayaのタイムワープ機能もサポート、アニメーションがより細かく設定可能に

さらにmesh deformationという動きを誇張する機能も予定されているという。「これからもエンドユーザーの要望が多いものから実装していく予定」とヤオ氏はPiStageの今後について語った。

次ページ:

<4>Unreal Engineを活用したアニメーション制作事例の紹介

<4>Unreal Engineを活用したアニメーション制作事例の紹介

さて、ここからはEPIC Games Japanのセールスマネージャー杉山 明氏による、Unreal Engineを活用したアニメーションの制作事例を紹介していく。

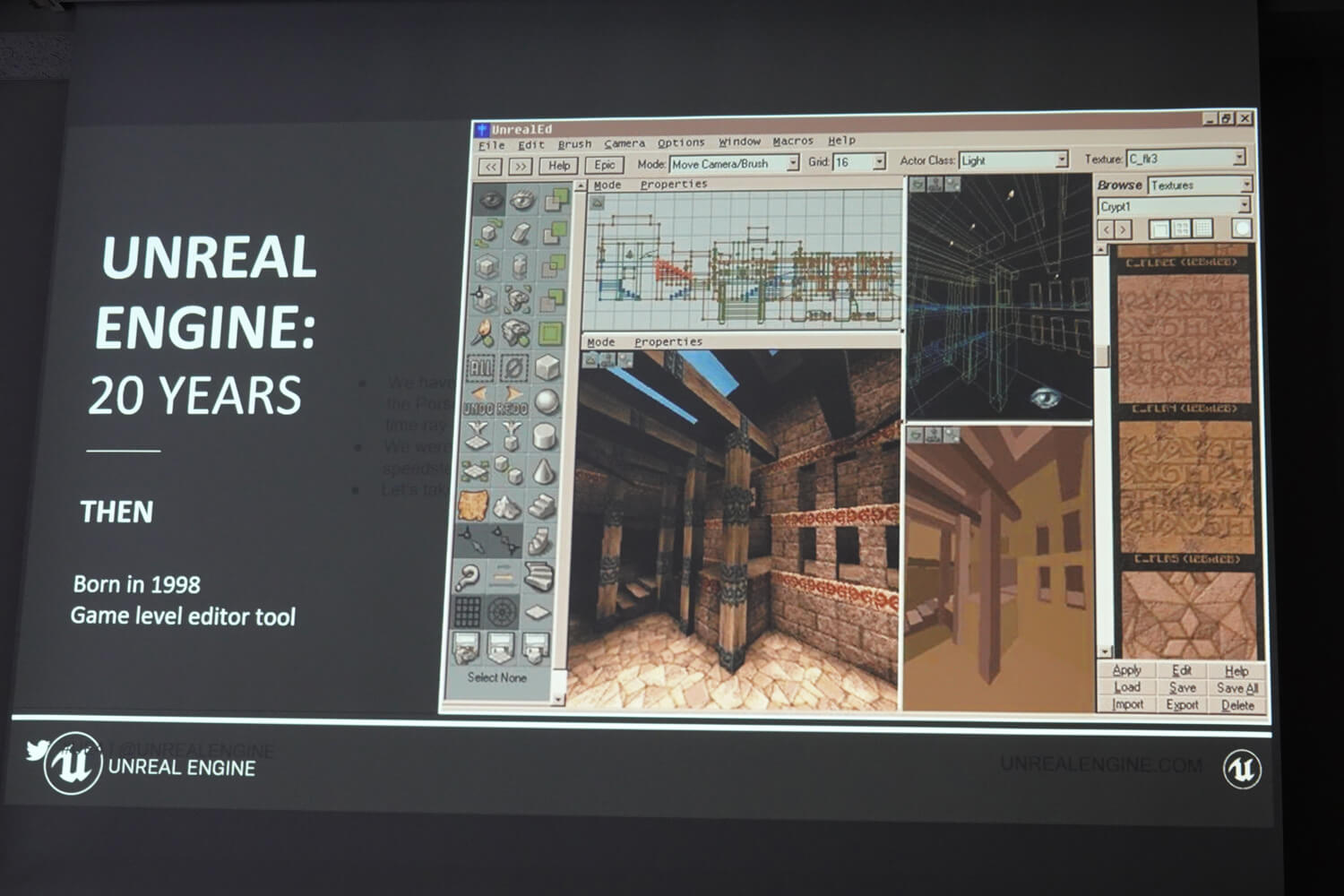

Unreal Engineは1998年に登場し、今年で21年目になる。最初はゲームのレベルエディタとして登場したが、現在ではゲーム機のみならず多種多様なプラットフォームに対応している。また最近ではゲーム用途以外にVRやARといったインタラクティブコンテンツ、バーチャルプロダクションでの活用が増えているという。

ゲームレベルエディタだった1998年当時のUnreal Engine

『Fortnite』トレイラー映像の制作事例

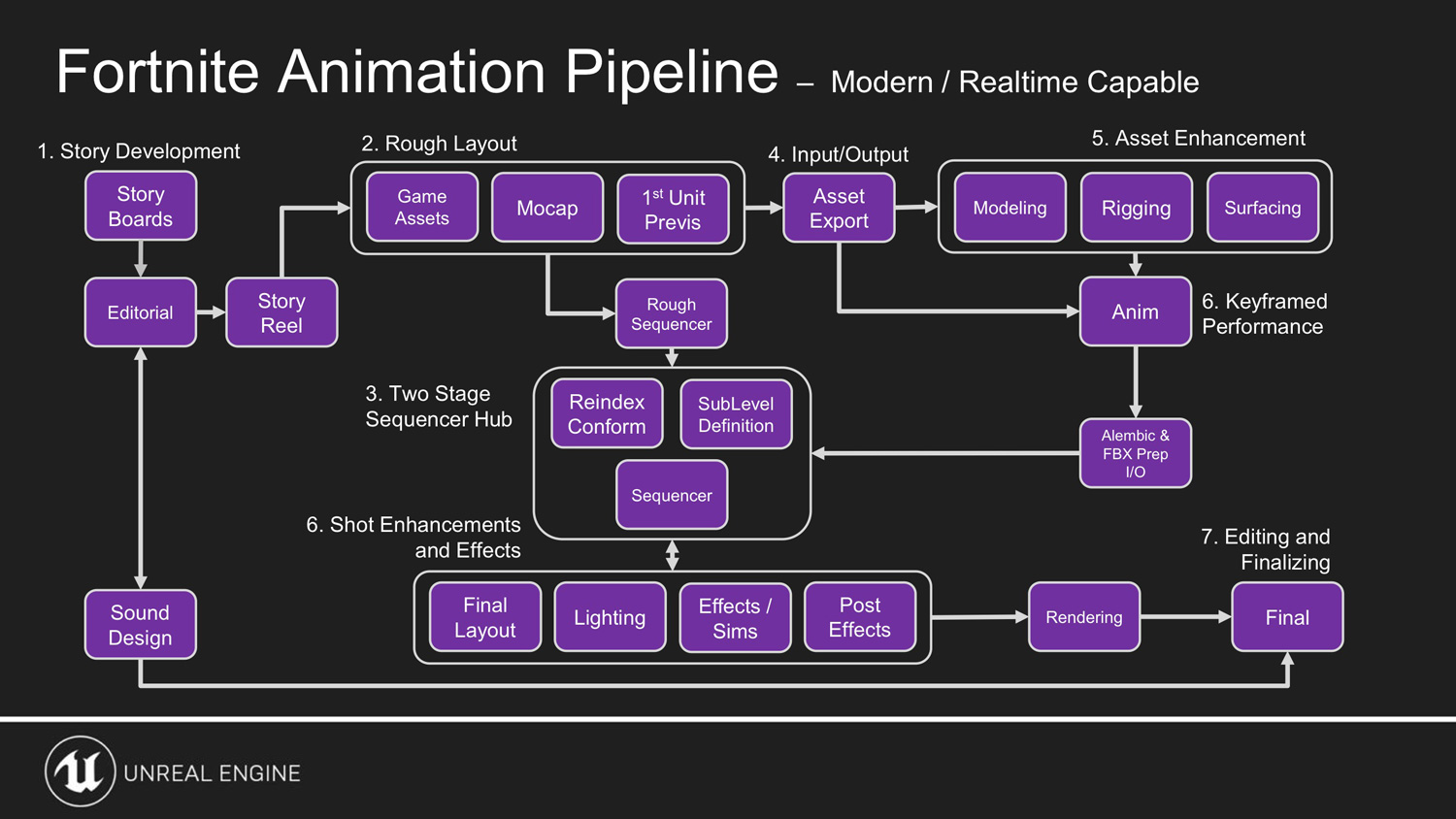

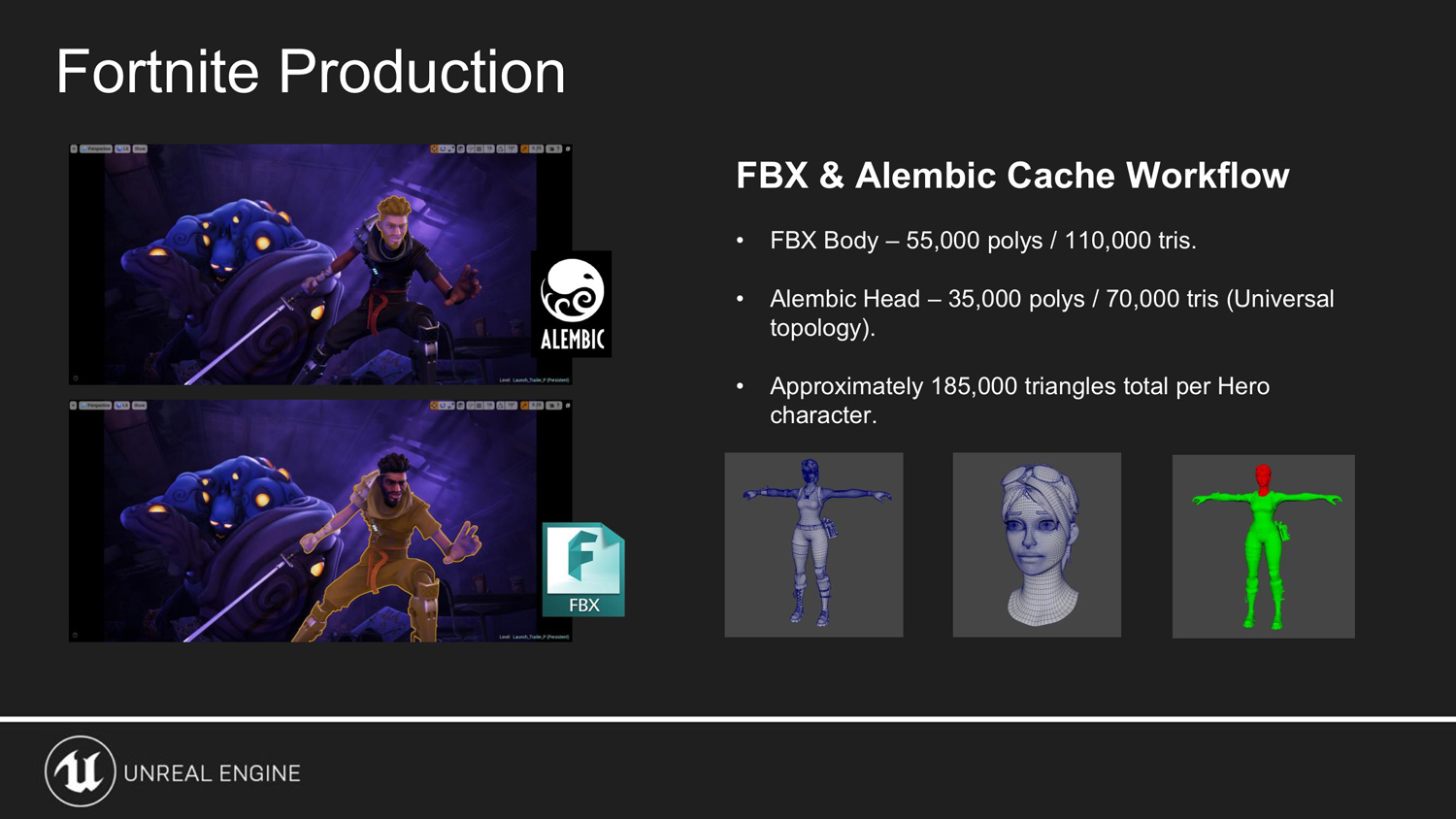

『Fortnite』のトレイラーは、ゲームのアセットを流用して制作された映像作品。モーションキャプチャを使ってプリビズをつくり、プリビズができた段階でラフなシーケンスを組んで、フェイシャルや指のアニメーションなどをMayaで制作していくながれをとっている。制作の早い段階からUnreal Engineが採用された。もともとゲームのトレイラー制作なのでゲームの3Dデータが流用できた点が最大の特徴だ。キャラクターに関しては首から下の部分はFBX、頭部は影響を受ける点が多いのでAlembicを使い、体と頭は別々のデータ形式で扱っている。トレイラーはゲームが動く実機上で再生できるコンテンツとしても使われた。

Fortnite Trailer

Fortnite Trailer Pipeline | Unreal Dev Day Montreal 2017 | Unreal Engine

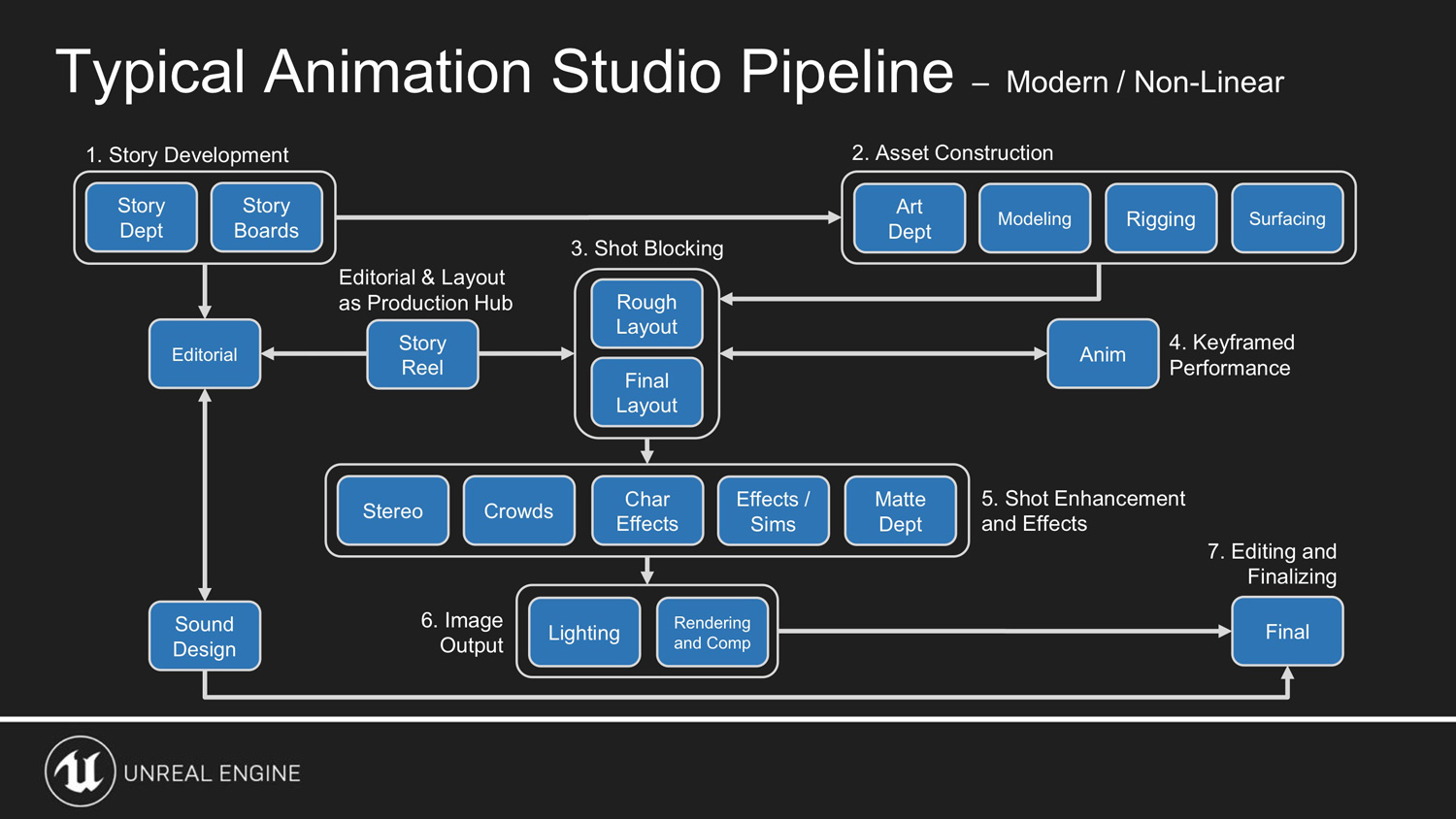

【上】従来型のアニメーション制作パイプライン、【下】Fortnite制作でのリアルタイムレンダリングを中心としたパイプライン

体はFBX、頭はAlembic形式が使われている

<関連記事>

「Fortnite トレイラー制作のリアルタイム パイプライン情報」

www.unrealengine.com/ja/tech-blog/explore-the-real-time-pipeline-behind-fortnite-s-trailer?lang=ja

ジェットスタジオの事例

MayaのデータをFBX経由でUnreal Engineに読み込み、Unreal Engineのシーケンサー上で編集、ライティング、ポストエフェクトを行い、映像制作を完了してしまうジェットスタジオの手法。こちらはUnreal Engine公式サイトに、詳細が紹介されている。

<関連記事>

【連載】第1回:映像制作におけるUE4のためのキャラクターデータ構成(モデリング編)

www.unrealengine.com/ja/blog/ue4-characterdesign-modeling

【連載】第2回:映像制作におけるUE4のためのキャラクターデータ構成(リギング編)

www.unrealengine.com/ja/blog/ue4-rigging

【連載】第3回:映像制作におけるUE4の活用〜マテリアル設計〜

www.unrealengine.com/ja/blog/ue4-material

【連載】第4回:UE4のシーケンサーを使用した映像制作〜ワークフロー編〜

www.unrealengine.com/ja/tech-blog/ue4--sequencer

Digital Dimension『ZAFARI』の事例

Digital DimensionによるフルCGアニメーション『ZAFARI』はもともとプリレンダリングで制作されていた作品だが、Unreal Engineのレンダリングに切り替えることで、1日にチェック用の映像を何回もつくることができるようになった。それまでは1日に2回のテストレンダリングが、Unreal Engineで30分以内に20回も可能になった。これにより修正、変更、試しに映像をつくるなどイテレーションの回数が増えたという。

ZAFARI: Tapping into Unreal Engine for Episodic Animation | Project Spotlight | Unreal Engine

The Mill『Mill Mascot』の事例

イギリスの広告を得意とするプロダクション The Millの、リアルタイム専門チームが制作した事例。

Mill Mascot | Virtual Production System

こちらは様々なキャラクターを動かすことができるシステム。ジェスチャーを感知するセンサーLeapMotionを使って、様々なキャラクターを動かすことができる。事例は、人材募集のCMのモンスターの映像。手づけだと時間がかかるものも多数の映像パターンを短時間で作成できる。髪の毛のシェーダもThe Millで開発されている。

Psyopの事例

広告を得意とするプロダクションPsyopの事例。リアルタイムでキャラクターアニメーションを制作する。Xsensでボディ、顔はFacewareを使ってキャプチャしている。フェイシャルはiPhoneのFaceARに対応しており、デジタルキャプチャのシステムと繋がるので、市販ツールや平易に手に入るものを使って手軽に動かすことができる。

Psyop takes Cricket Wireless's Dusty and Rose into real time | Project Spotlight | Unreal Engine

<関連記事>

「Psyop が UE4 のリアルタイム キャラクターでブランドの好感度を大幅に向上させる」

www.unrealengine.com/ja/spotlights/psyop-generates-huge-brand-love-with-real-time-characters-in-ue4

THE FUTURE GROUPの事例

THE FUTURE GROUPの事例では実写とCGの合成にUnreal Engineを活用している。天気予報の番組で、生放送の中で使われている。画像のキーイングも独自でつくられており、スタジオのカメラトラッキングなども独自に組んだシステムが用いられている。バーチャルスタジオの進化版だ。

The Weather Channel Immersive Mixed Reality Climate Change

<関連記事>

「The Future Group と The Weather Channel がアンリアル エンジンで雷とトルネードを作成」

www.unrealengine.com/ja/spotlights/the-future-group-and-the-weather-channel-create-lightning-and-tornadoes-with-unreal-engine

STARGATE STUDIOの事例

STARGATE STUDIOによるバーチャルプロダクションでの応用事例。ライブ映像のカメラ映像とCGI映像を連動させて合成している。

Virtual production: Stargate Studios creates final pixels on set | Project Spotlight | Unreal Engine

Goodbye KansasとDeep Forest Filmsによる『Troll』の事例

Goodbye KansasとDeep Forest Filmsによるデジタルヒューマン+リアルタイムレイトレーシングの『Troll(トロル)』という作品の事例。こちらはGDC 2019で発表された。リアルタイムレンダリングで映画を1本つくるという壮大なプロジェクトで、カスタムシェーダも特別なコードも使用せず、Unreal Engine 4.22の機能のみで制作されている。

『Troll』Unreal Engine 4.22 のレイトレーシングが実現したこれまでにない映画品質ライティング

<関連記事>

「『Troll』 Unreal Engine 4.22 のレイトレーシングが実現したこれまでにない映画品質ライティング」

www.unrealengine.com/ja/blog/troll-showcases-unreal-engine-4-22-ray-tracing-with-unprecedented-cinematic-quality-lighting

<5>PiStageの販売について

最後にPiStageに話を戻し、その販売方法について説明する。PiStagは以下の3つのエディションに分かれており、それぞれライセンス数などが異なるが、機能的には変わらない。

PiStage Standard:サブスクリプションで1年 238,000円 ライセンス数5つまで

PiStage Standard for Education:サブスクリプションで1年 54,000円

PiStage Premiaum:ライセンス数6つ以上の場合、個別見積もり

製品の導入や納期についての相談など、詳細については公式サイトで確認してほしい。また今後は東京のELSAオフィスと名古屋で、定期的にデモが開催されるとのことなので、気になる人は足を運んでみてはいかがだろうか。