「CGWORLD 2019 クリエイティブカンファレンス」のセッション「Unity上で劇場アニメ『HELLO WORLD』のシーンを再現」では、2019年9月から公開された劇場アニメ『HELLO WORLD』におけるUnityを使用した背景動画シーン・日常芝居シーン制作の解説、さらにUnityの「Cinemachine」を使った撮影編集の方法を解説した。

TEXT&PHOTO_日詰明嘉 / Akiyoshi Hizume

PHOTO(メインカット&登壇者)_弘田 充 / Mitsuru Hirota

EDIT_山田桃子 / Momoko Yamada

■関連記事はこちら

日本初のソーシャルVR『仮想世界ambr』はどのようにつくられたか ~CGWORLDクリエイティブカンファレンス レポート(1)

坂本隆輔(YAMATOWORKS)が指南! CGアニメーション基礎講座|CGWCCレポート(2)

NHK大河ドラマ『いだてん』で実践された、4K/HDRベースのVFXワーク|CGWCCレポート(3)

『ガールズ&パンツァー 最終章』第2話、安易にゲームエンジンを使うのは危険!|CGWCCレポート(4)

歴代ルパンへのリスペクトを込め、2Dから3Dへ『ルパン三世 THE FIRST』メイキング|CGWCCレポート(5)

映画『HELLO WORLD(ハロー・ワールド)』予告【2019年9月20日(金)公開】

<1>Unityを使用したサイケデリックな表現

まずはグラフィニカのディレクター・堀内 隆氏とプログラマー・鶴田 剛史氏が『HELLO WORLD』の解説を行なった。同作は伊藤智彦監督、脚本・野﨑まど氏による3DCGオリジナル劇場アニメ。人気アニメーター堀口悠紀子氏によるキャラクターデザインで、「従来の作画アニメに匹敵するようなアニメーションを3DCGで再現」することを目標とした。

右から、堀内 隆ディレクター、鶴田剛史プログラマー。以上、グラフィニカ

www.graphinica.com

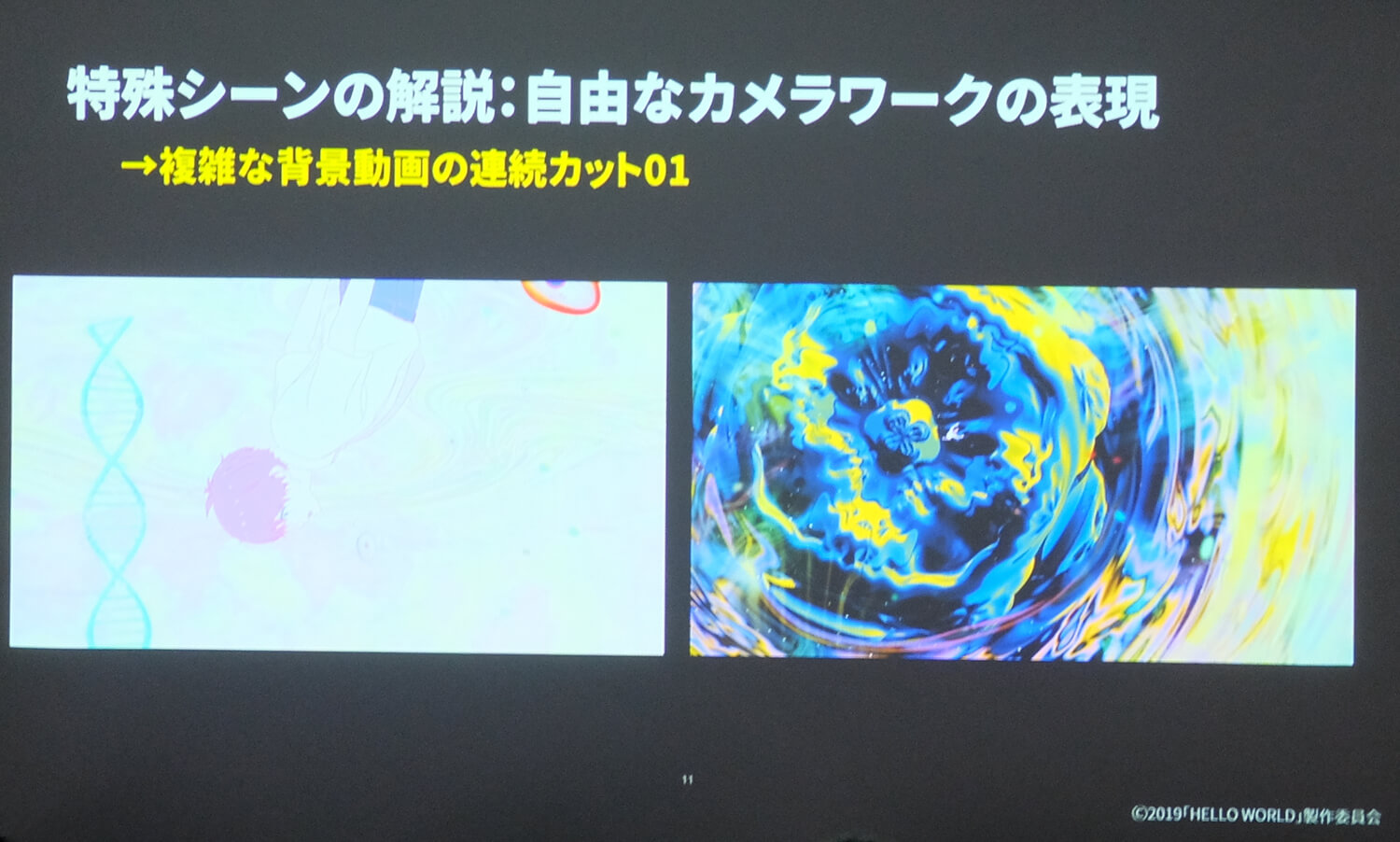

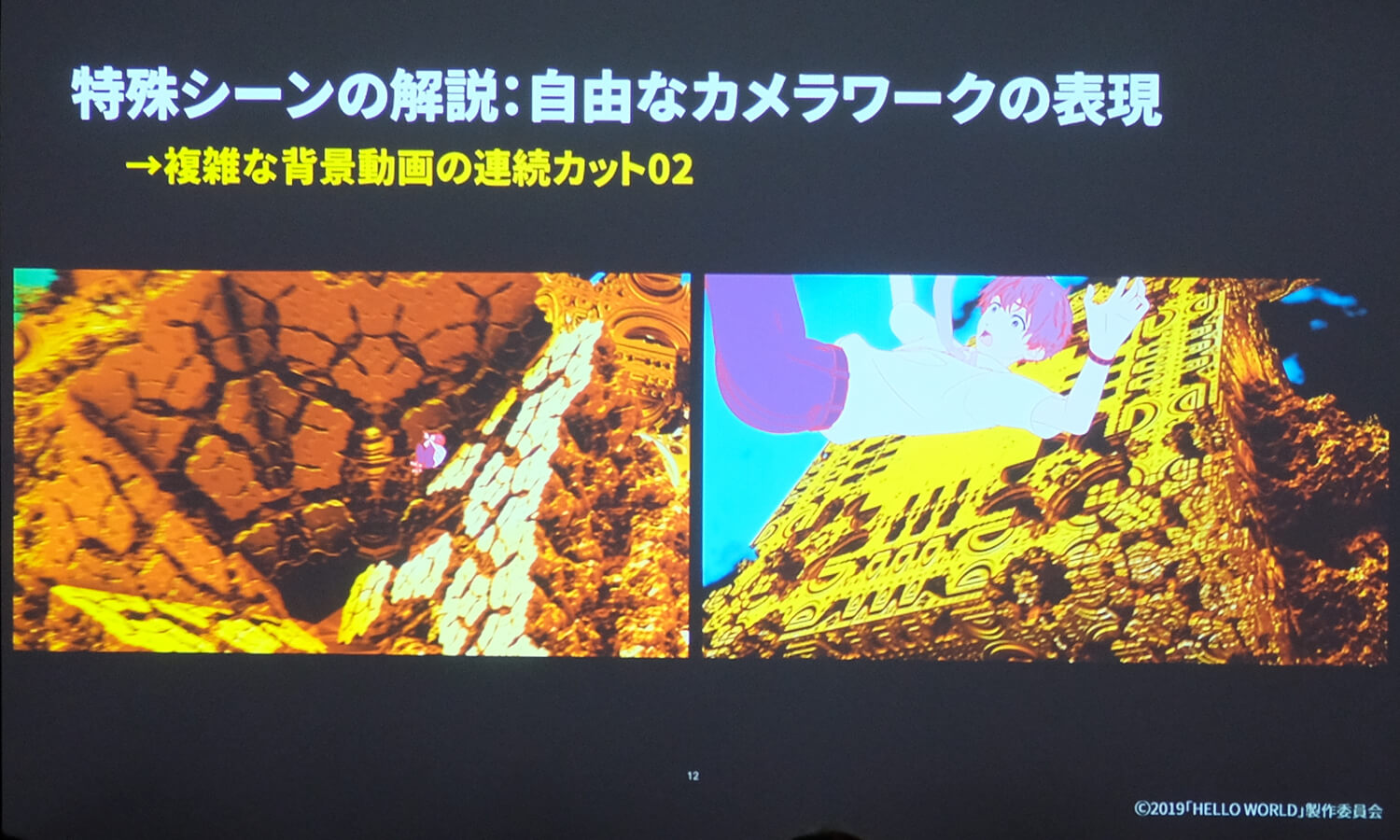

制作の基本は3ds MaxとAfter Effectsのコンポジットで、主人公が世界を移動する特殊シーンではUnityを素材作成のツールとして導入した。その理由として従来のDCCツールでは表現できないような表現の幅を広げるためだったという。

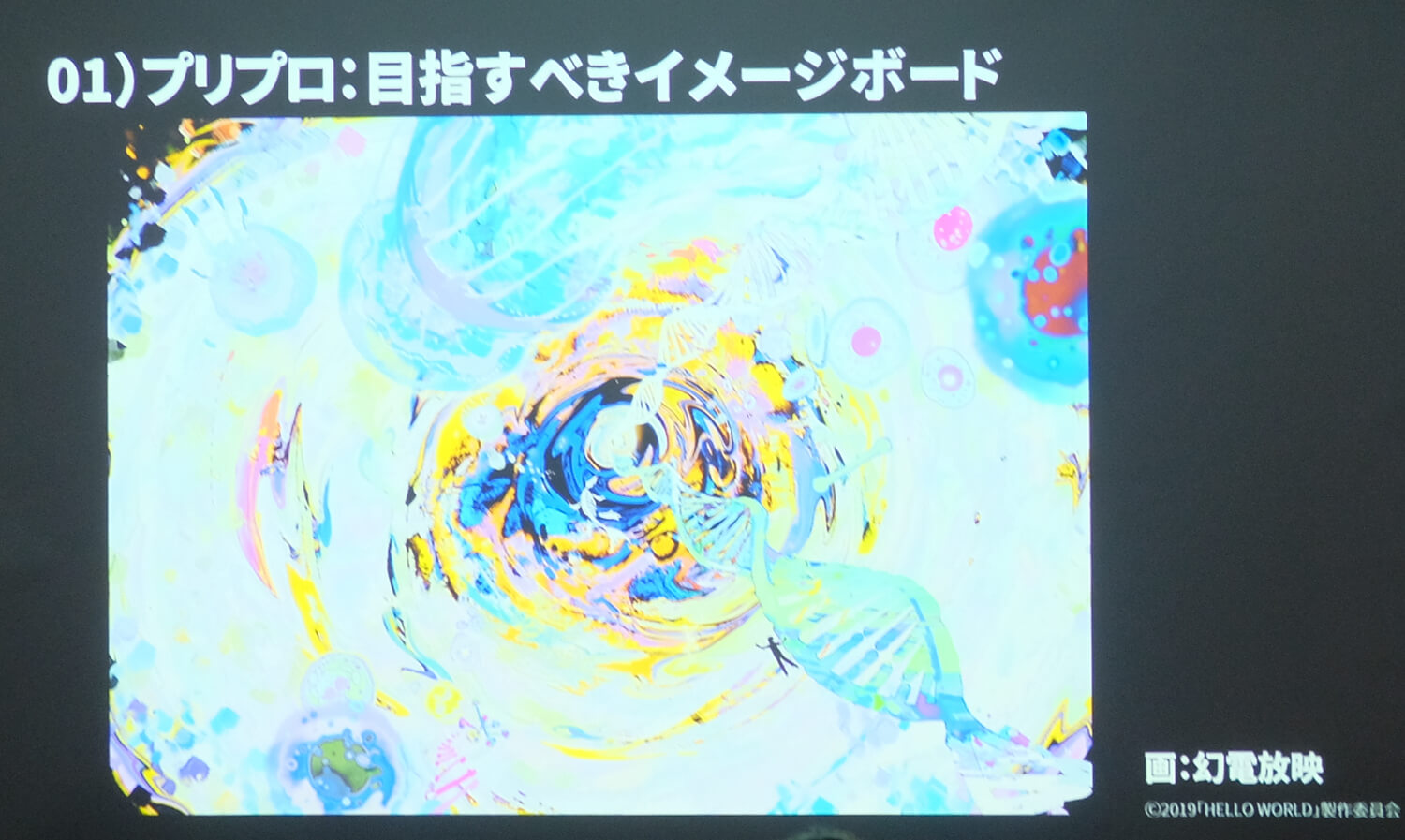

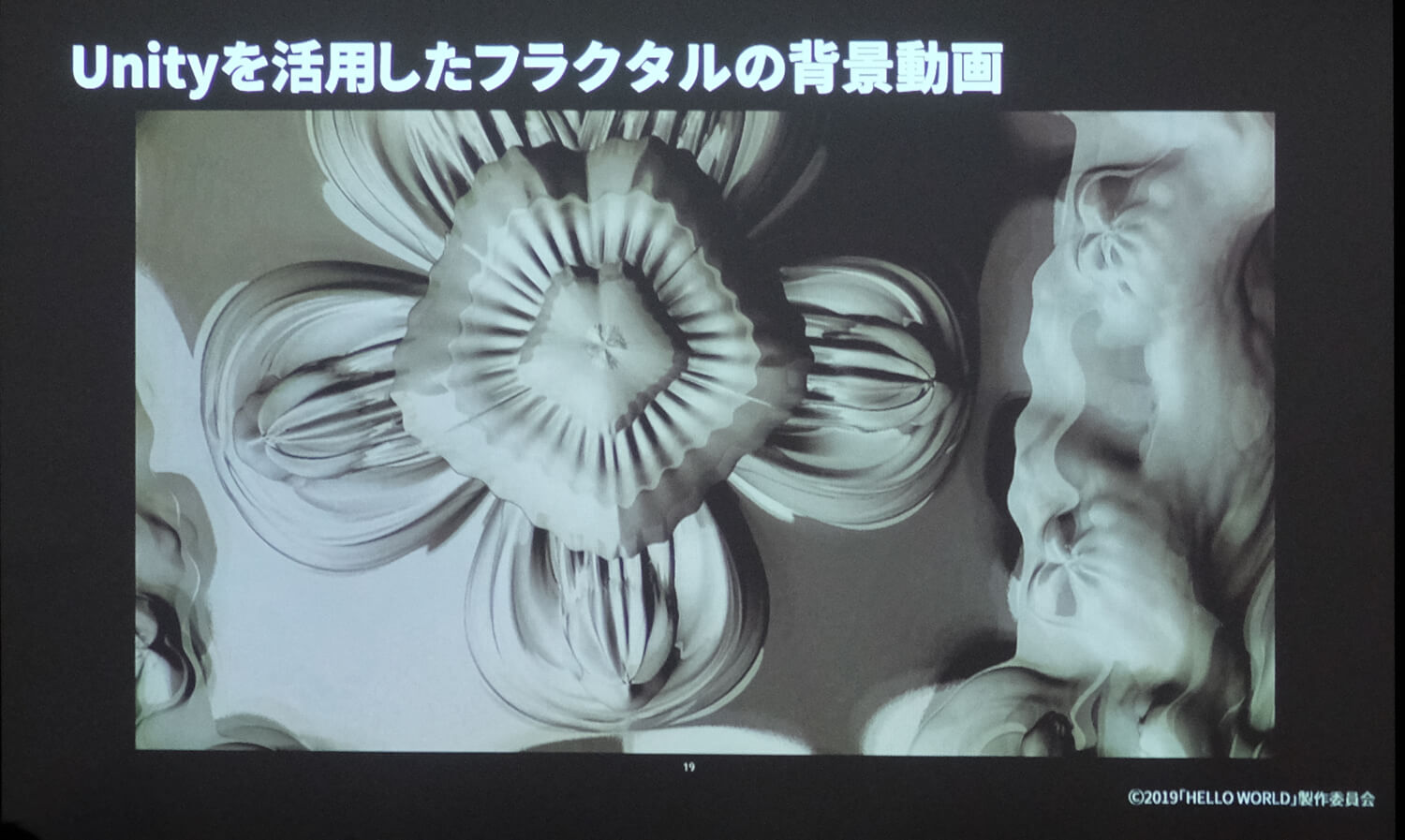

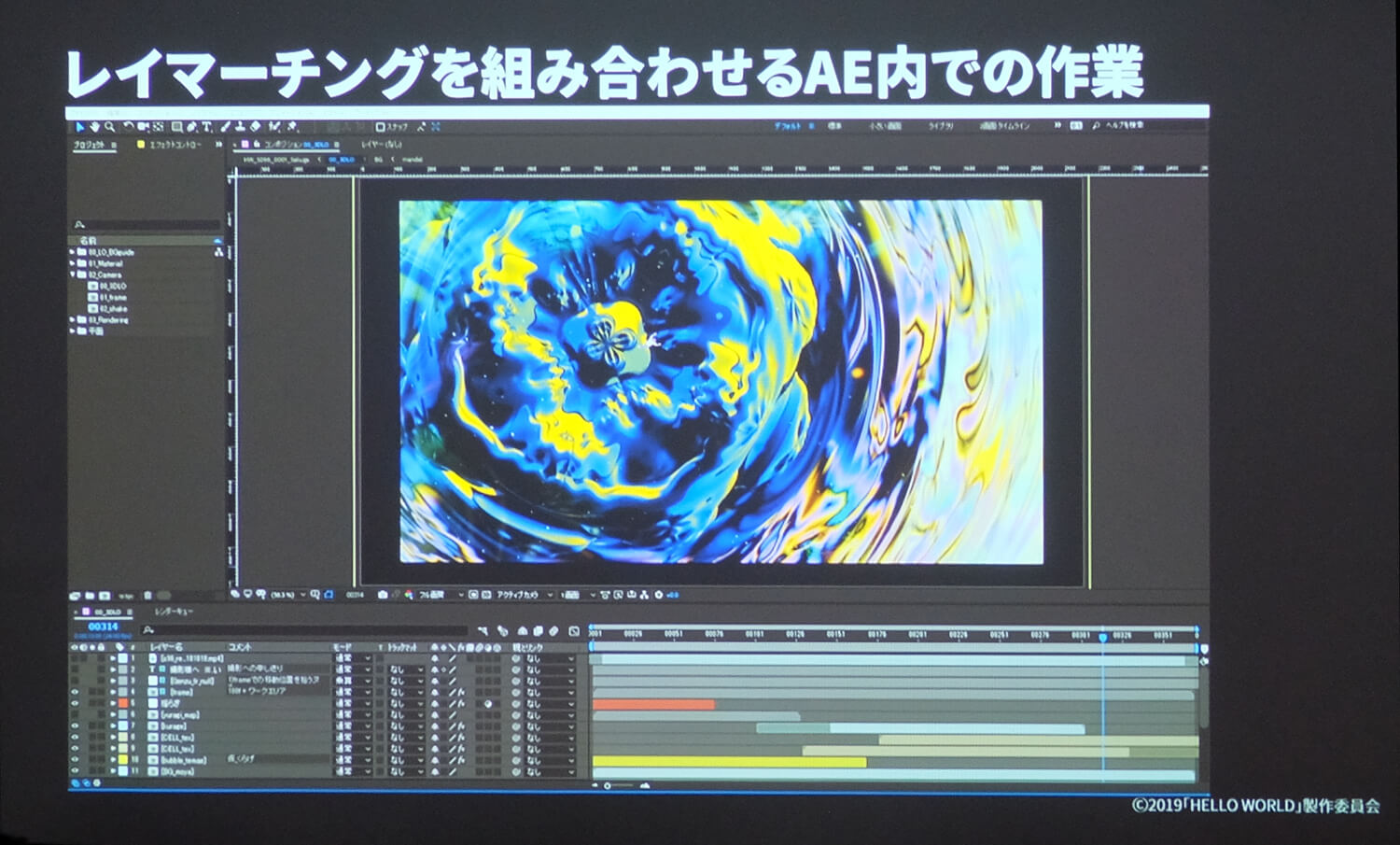

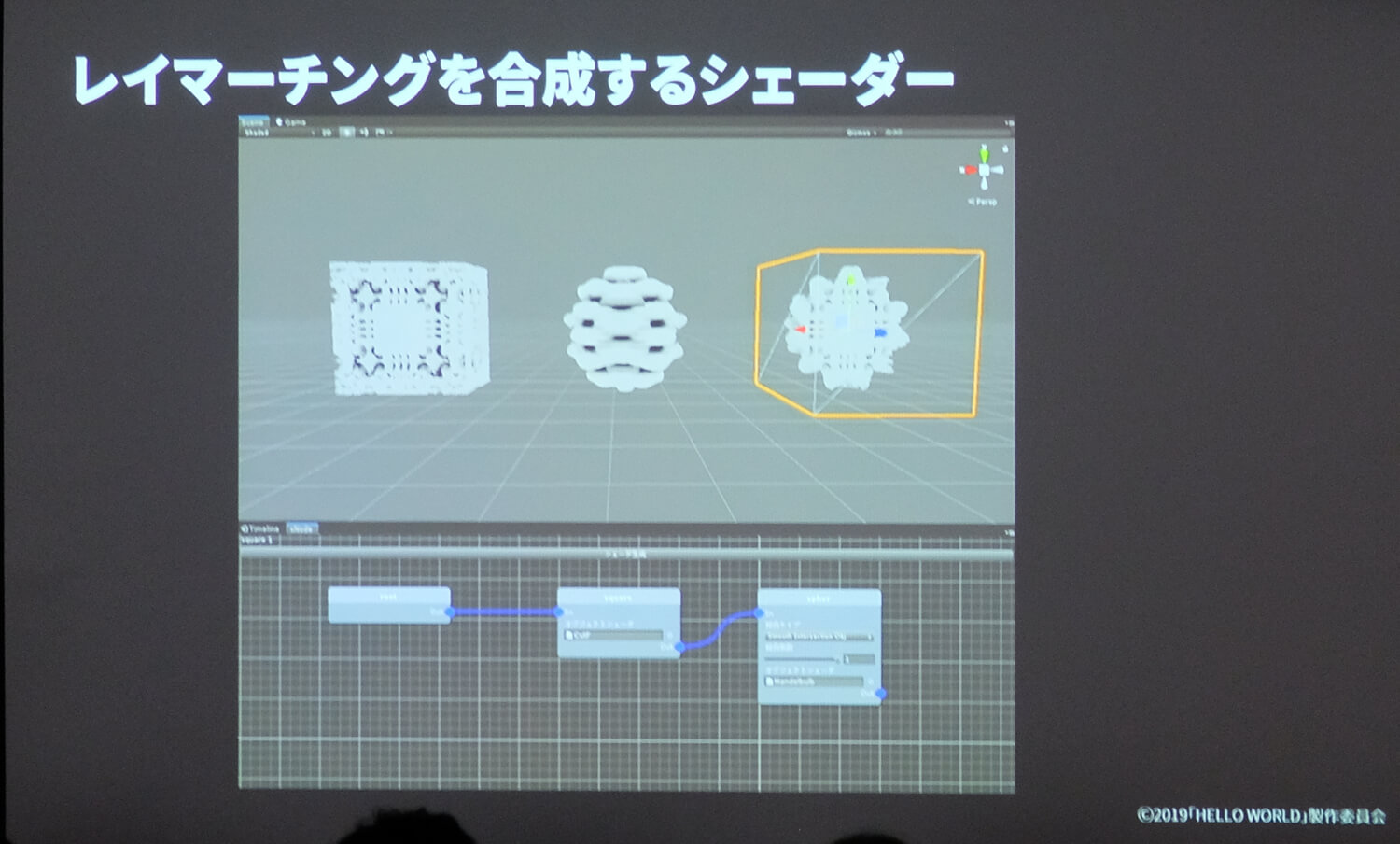

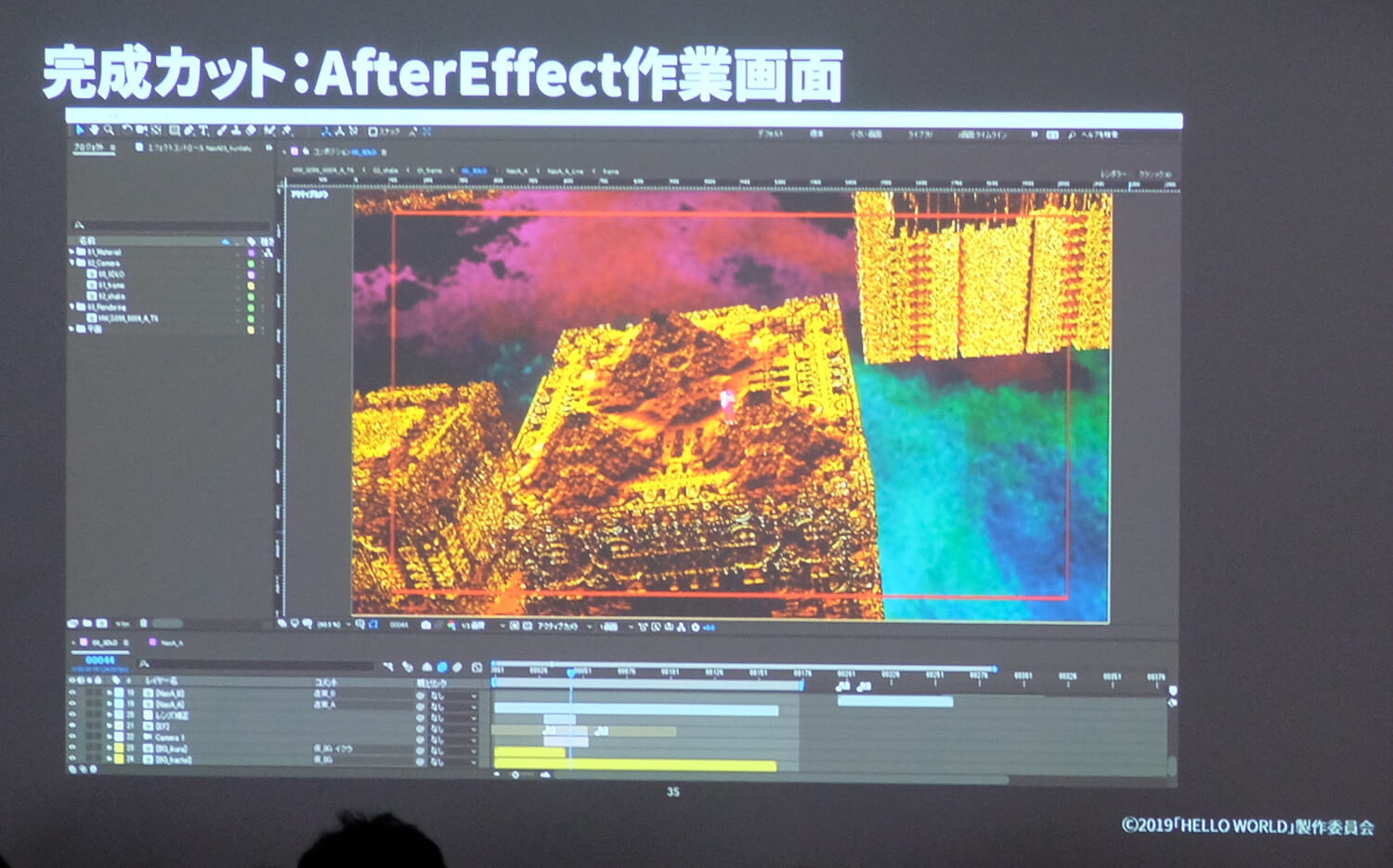

このシーンについて伊藤監督はサイケデリックな映像表現を求めていたという。プリプロダクションとして描かれた、幻電放映氏によるイメージボードを元に監督が描いた絵コンテから創造をふくらませていった。3ds Maxでモデリングするのは難しいフラクタル表現であったため、レイマーチングを実装したシェーダで描画した。Unityで描画したものを書き出し、他のDCCツールを使って素材作成しAE上で合成するというオーソドックスなつくりだ。

もう1カットは、本作と同じく野﨑まど氏が手がけたCGアニメ『正解するカド』へのリスペクトとして、マンデルボックスをレイマーチングで表現。キャラクターはUnityでモデルをつくるのが難しく、背景と同様の動画素材として用いた。

グラフィニカではレイマーチングのシェーダをつくりつつ、プログラムの方でマンデルブロー、マンデルボックスなどのシェーダをそれぞれ単体でつくった。それらを合成し、ひとつのシェーダとして吐き出す。レイマーチングのパラメーターはセンシティブで、少しの値のちがいで大きな変化が表れるが、リアルタイムであるため試行錯誤はしやすかったという。コンポジッターは感覚的に試行錯誤していくので、「今後はもっと絞ったパラメーターが必要なのでは」(鶴田氏)と語る。

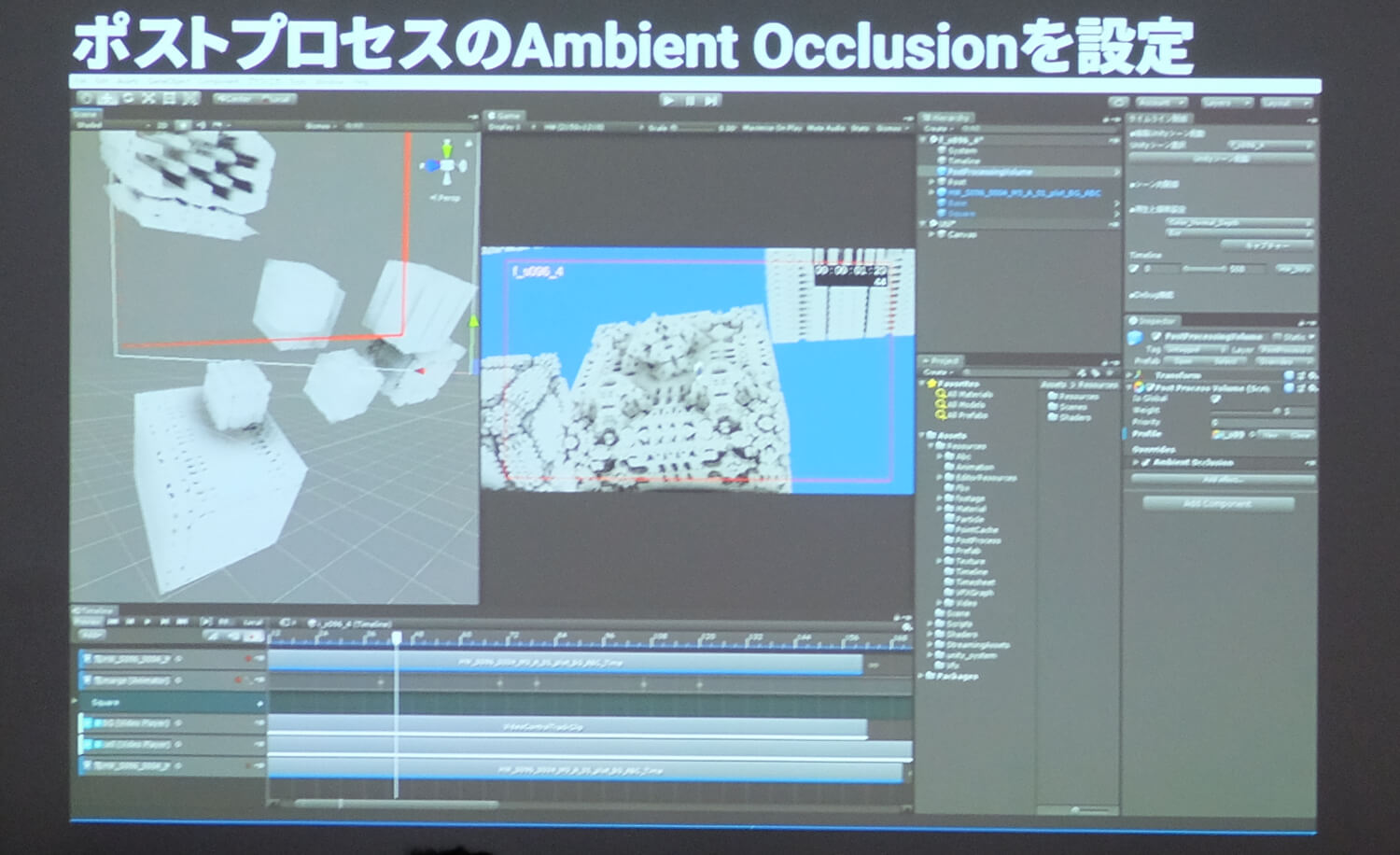

ポストプロセスは基本的にAfter Effectsで一部はUnityを使用。ポストプロセスとしてアンビエントオクルージョンをかけた

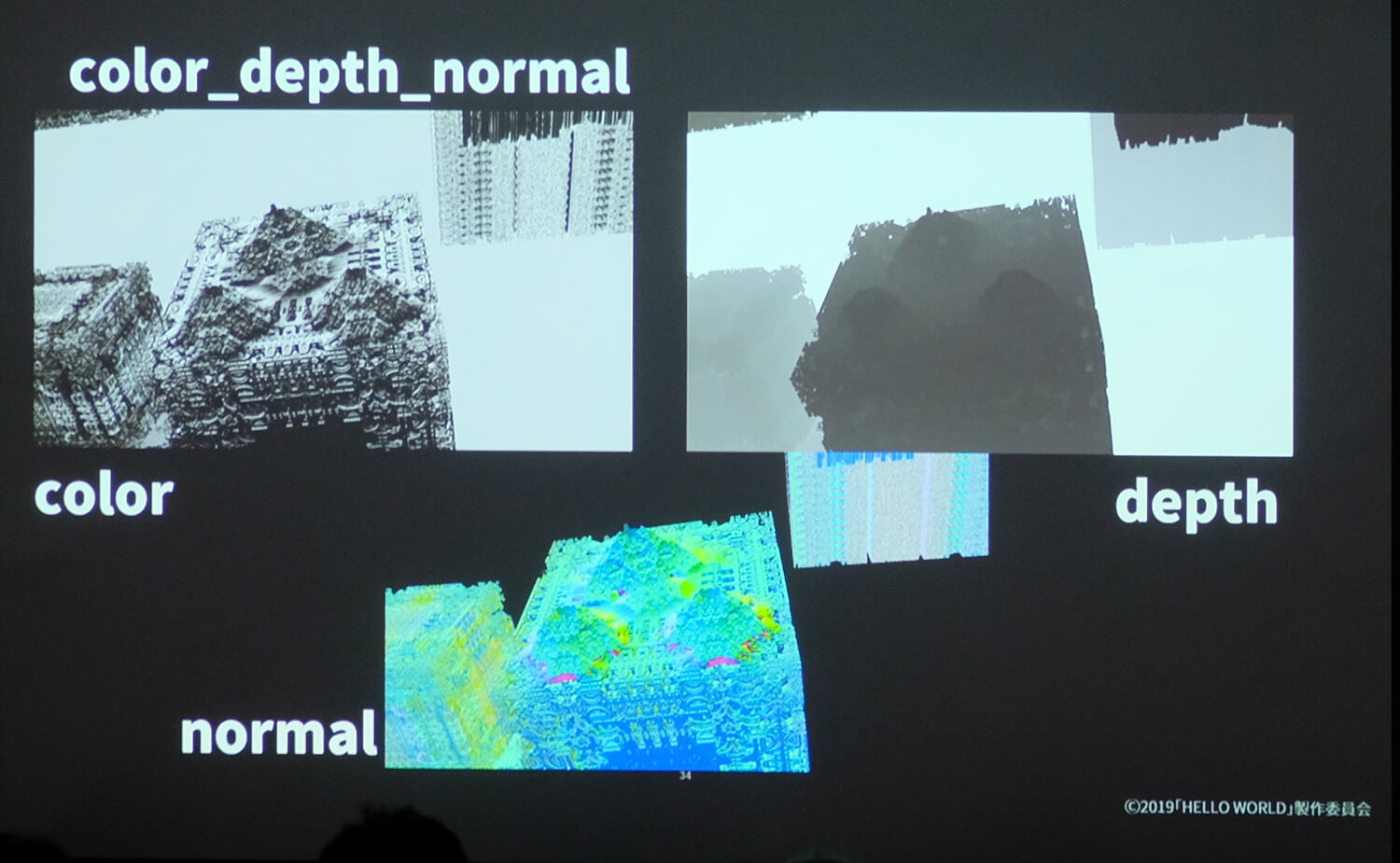

カラー、ノーマル、デプスの3つの連番画像として出力し、AEで最終的な仕上げを行なった。デプスはカラコレの要素として使っている

堀内氏は「はじめてVFXとしてUnityを触ったが、ゲームエンジンは概念がちがうツール」、「効果的に使うにはその概念がわからないと難しい」と使用した感想を述べた。また、「ゲームエンジンは1個1個シェーダを含めてつくっていかなくてはならない。サイエンスやテックは強いがアートの部分では今後どのくらいまで従来のツールに近づいていけるか」と、今後の課題を語った。

<2>コンポジットを効率的に行うUnityの使用法

つづいてキャラクター表現の解説が行なわれた。本作のキャラクターモデルは複雑なリグで、After Effects上での多重レイヤーを用いた丁寧なコンポジットが求められたため、深いコンポジット構成とファイルが巨大化する問題があったという。

Unityへのデータのやり取りは3dx Maxから複雑なリグを要するキャラクターをAlembicデータ、プロップをFBXデータ、物理カメラパラメータはJSONで、さらにマテリアルとメッシュの紐付けデータもJSONにて出力(マテリアルの設定自体はUnityで作成し,Maxから持ってこないで再現、また、カメラアニメは今回のカットではカメラの動きがないため、使用せず)。

そして、これらのパイプラインとは別に、頂点データの渡しとして、MeshSyncやSceneCacheを使用することで、ハイメッシュの重いアニメーションでもこれを使ってUnityに送ることでスクラブ再生が可能になった。また、2DアニメーションでのAfter Effects上での作業のようにコマ抜きの作業がUnity上でリアルタイムにできたという。この機能は3ds Max以外にもMayaやBlenderなどDCCを選ばないのがメリットと言える。

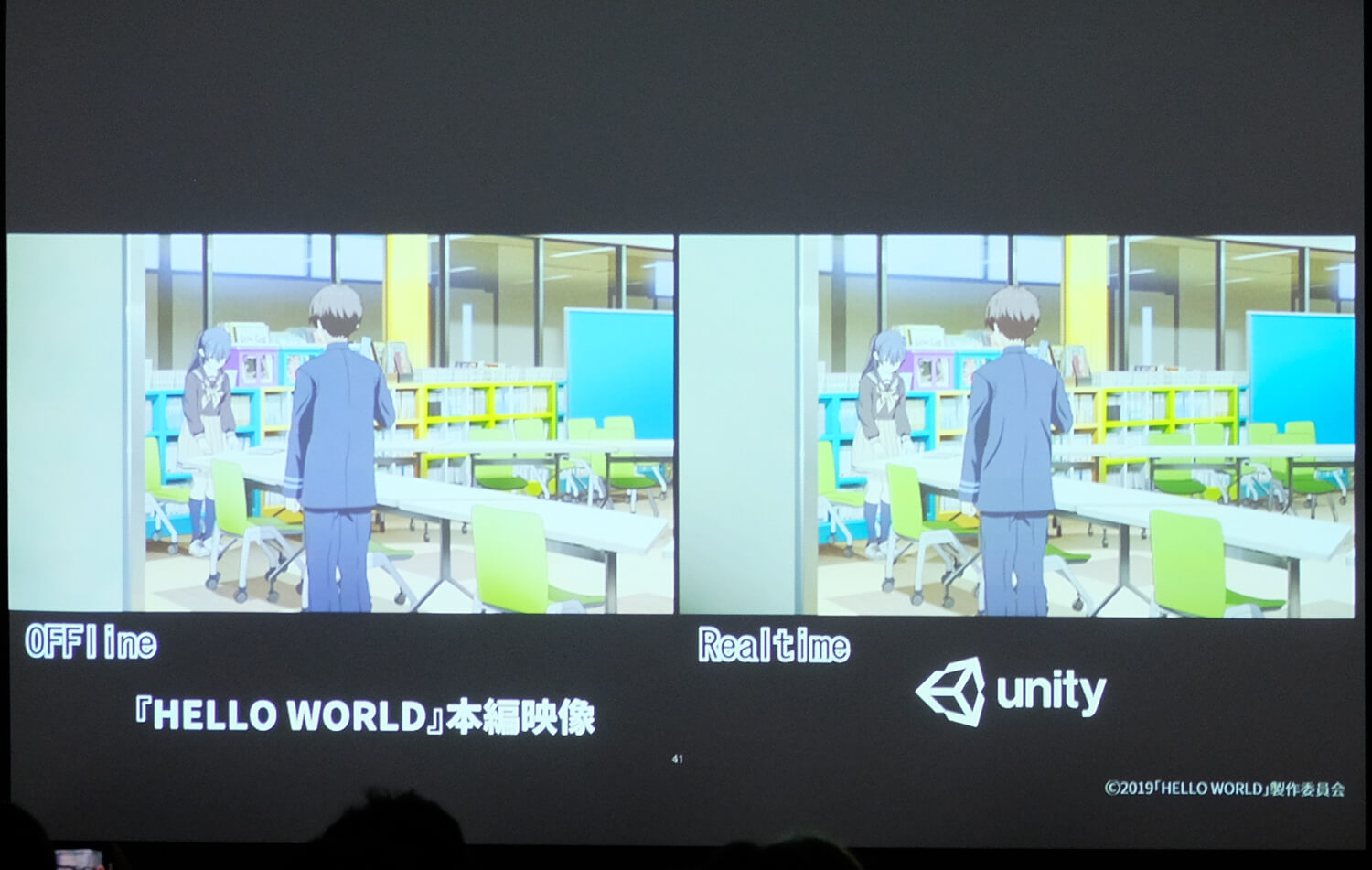

Unity上で質感再現(特に高品位の影の再現)を行う理由は3つあるという。1つはコンポジットをするための素材出しが増え、レイヤーが多重になる傾向にあるため、レイヤー管理を軽くする必要性。2つ目はコマ抜きなど作業は繰り返し試行錯誤するため、それを素早く行うニーズ。そして3つ目は、近年の作品は素材から完成映像で全く画面が変わるため、できるだけ完成段階に近い環境で最終的な結果を各工程が共有しながら速やかに作業を行うことが求められた。

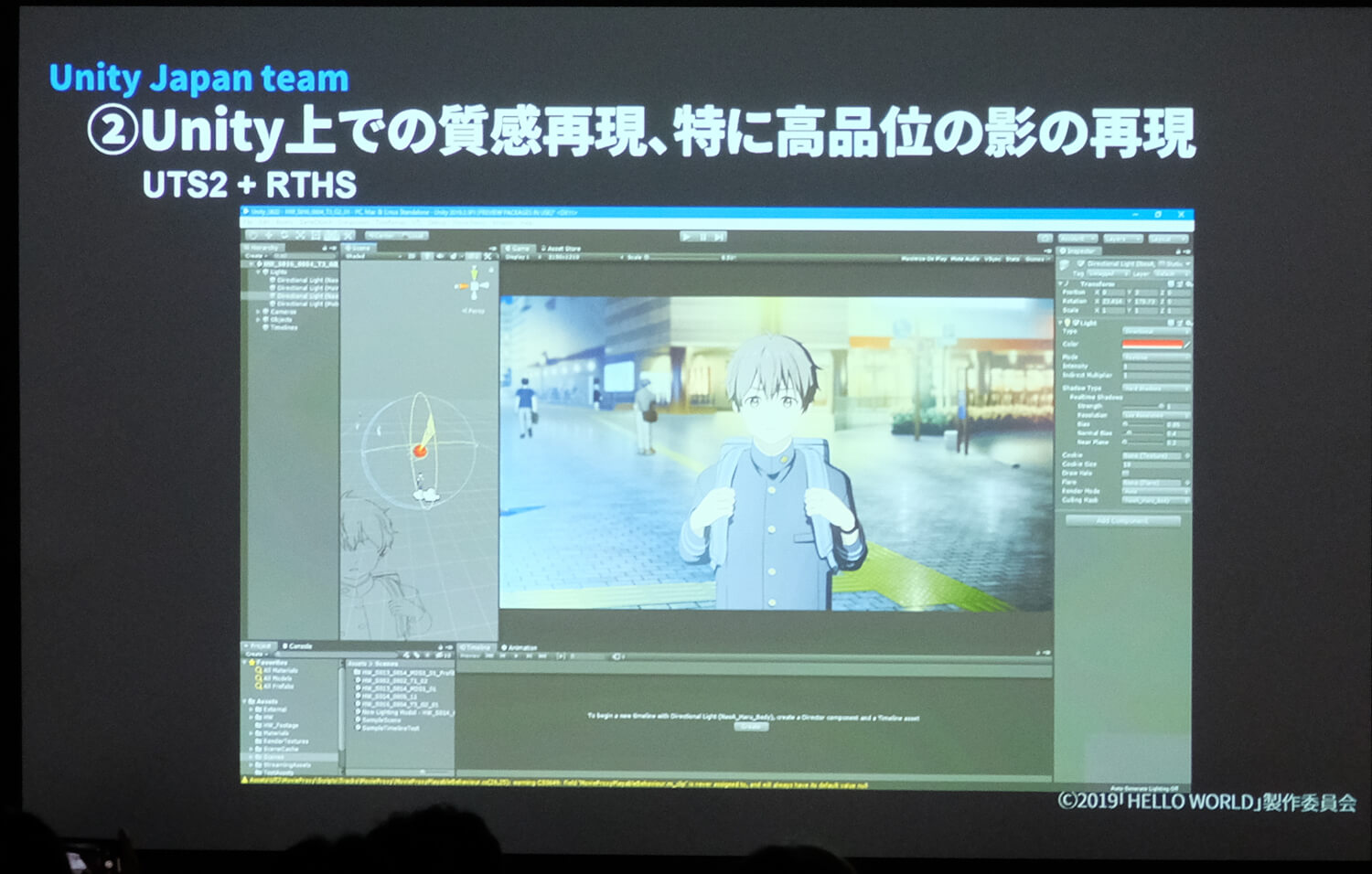

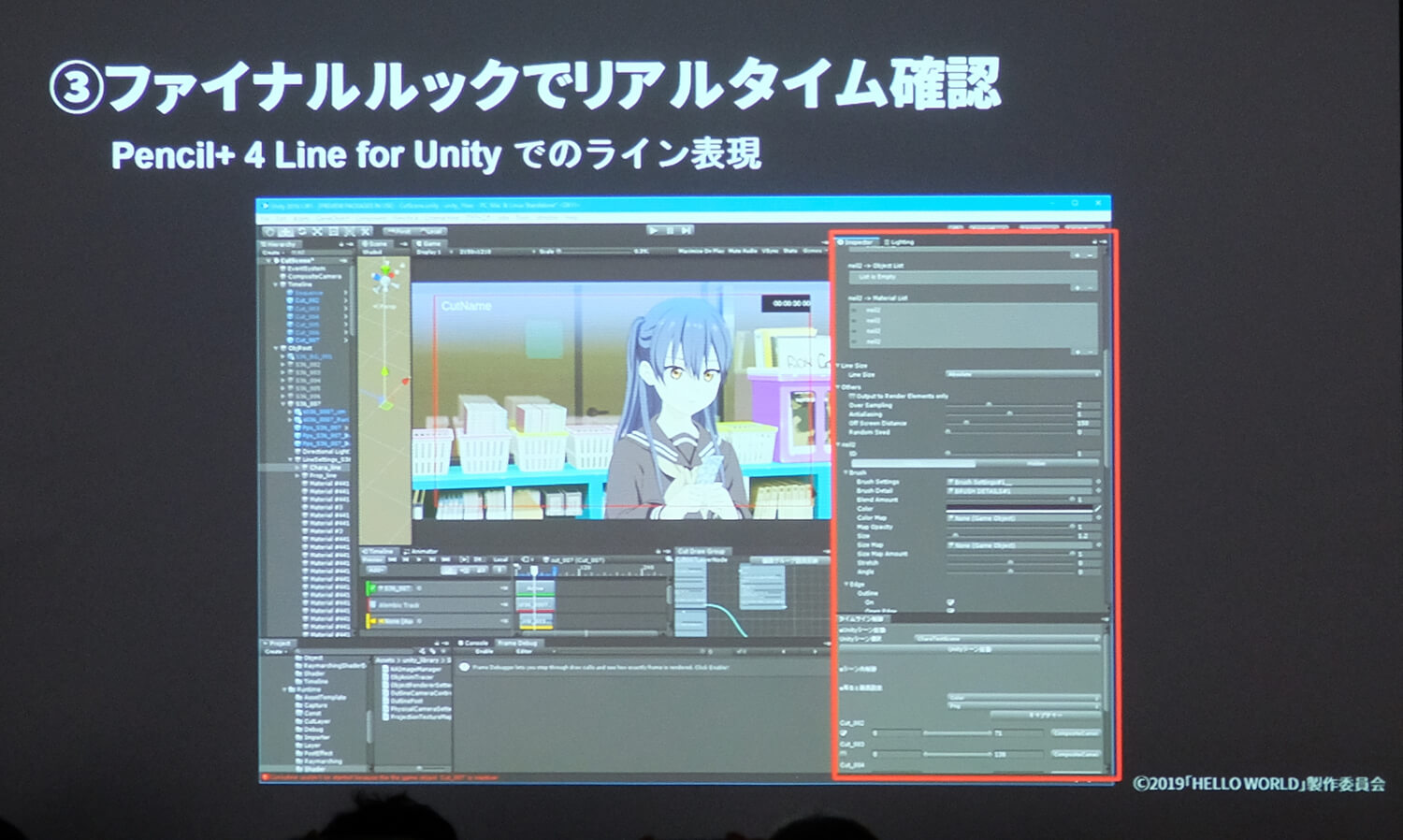

Unityでの質感再現はリアルタイムレイトレースを使用したユニティちゃんトゥーンシェーダー2とRaytraced Hard Shadowで描画。アニメ映像をUnityでつくるには従来のシャドウマップでは思った映像が出ないという不満があったためである。本検証では、3ds Max上でレイトレースを使用した影の出方を,Unity上でレイトレースを使用した影の出方として再現できたとのこと。メッシュの割り方については試行錯誤の上、TurboSmoothをかけたAlembicをUnity上で展開することに。アニメ表現においてラインは非常に大切だと強調。本編は3ds Max上でPencil+4を使用し、そのパラメーターのままUnityに出力している。

<3>「Cinemachine」の便利な使い方

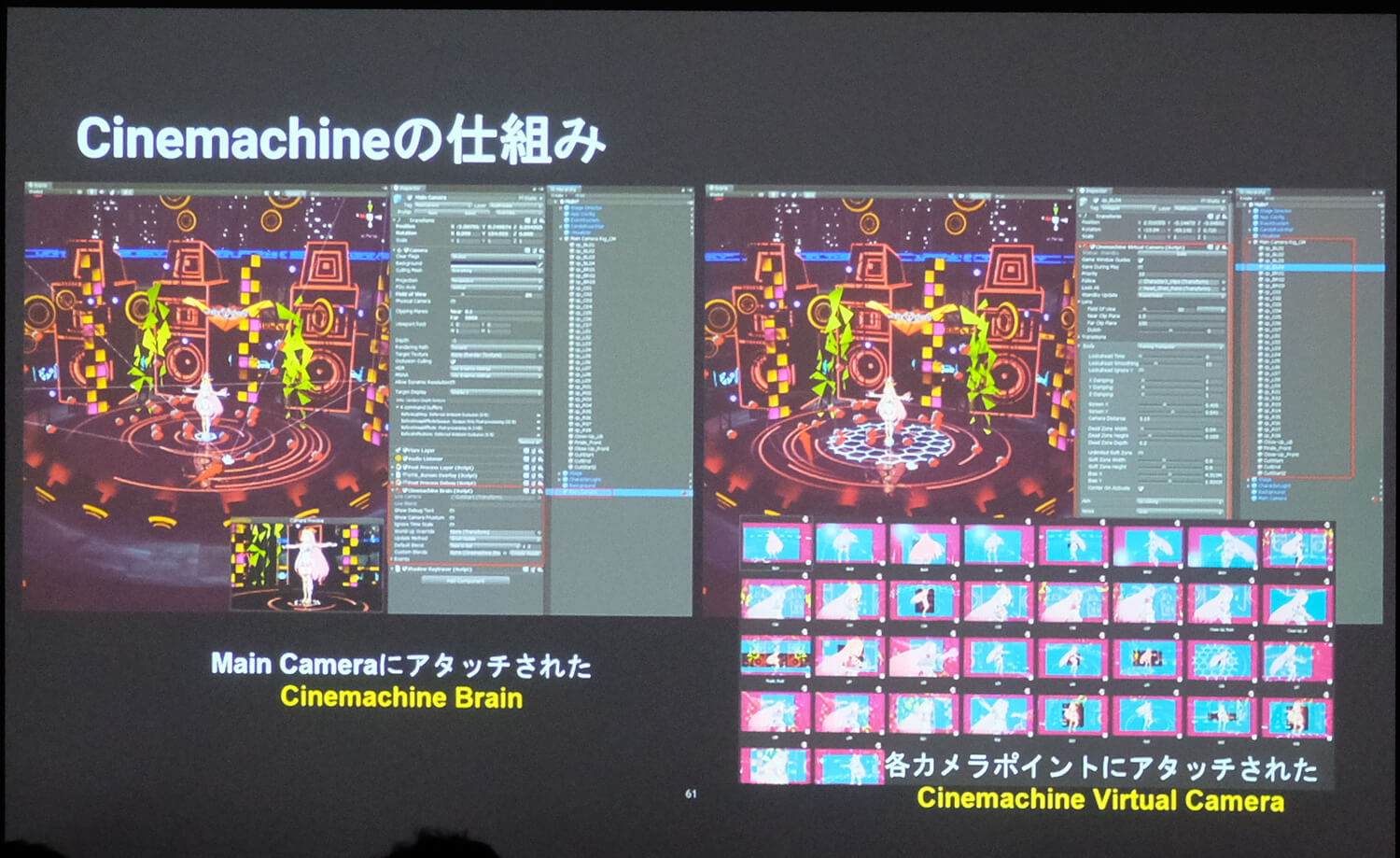

そして最後に、ユニティ・テクノロジーズ・ジャパン合同会社/コミュニティエバンジェリストの小林信行氏より「Cinemachine」についての説明が行われた。

これはUnityのアセットで、撮影と編集を同時に行うAIカメラシステム。アニメの撮影向けには「3D空間内に複数のアナログ撮影台的な動きを定義できるリグが設定できる」のが特徴だ。既存のカメラをバーチャルカメラとして設定し、各ポイントに設置したものを呼び出してコントロールしたり切り替えたりすることができる。また、CPUに負荷をかけずにカメラの切り替えを1フレームで行うことができるという、非常に便利なアセットにもかかわらず、Unityに詳しい人の間でも「半分くらいは知られていない」(小林氏)。一方で「15%位は、これがないと仕事にならない」(同)と言われる。

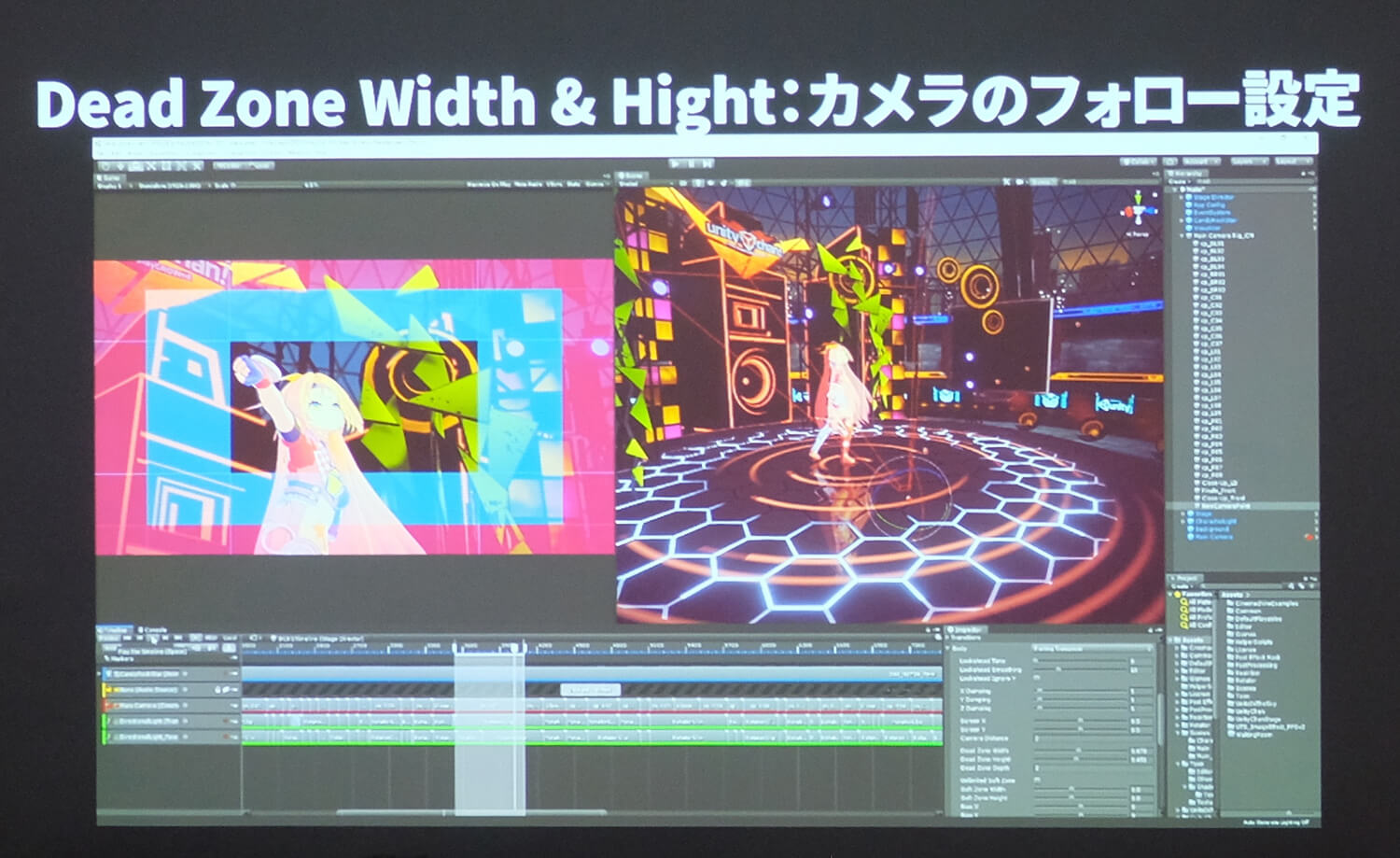

小林氏は映像を交えてその使い方を説明した。まず、座標をつくってバーチャルカメラを設置し、2Dアニメの「撮影台」的な動きを設定する。ここで重要な機能が「Framing Transposer」で、これは「2Dレイアウトを保ったままカメラを動かす」システムのこと。3Dのカメラは奥行方向に移動することができるため、背景も奥行きのパースが付いて映像になる。2Dの背景は通常、カキワリであるため、このちがいによって2Dらしい画面づくりを難しくしていた。この機能により3Dの背景を2Dのように扱って撮影することができる。

カメラのフォローは「Dead Zone Wideth & Hight」によって設定する。画像のクリアのエリアから対象物がズレるとカメラが追いかける。青のエリアに入ると対象物を真ん中に映すように動く。この範囲を設定することでカメラのフォローを調節できる。クリアのエリアを広げるほどカメラのフォローは止まって「安定」した映像になる。

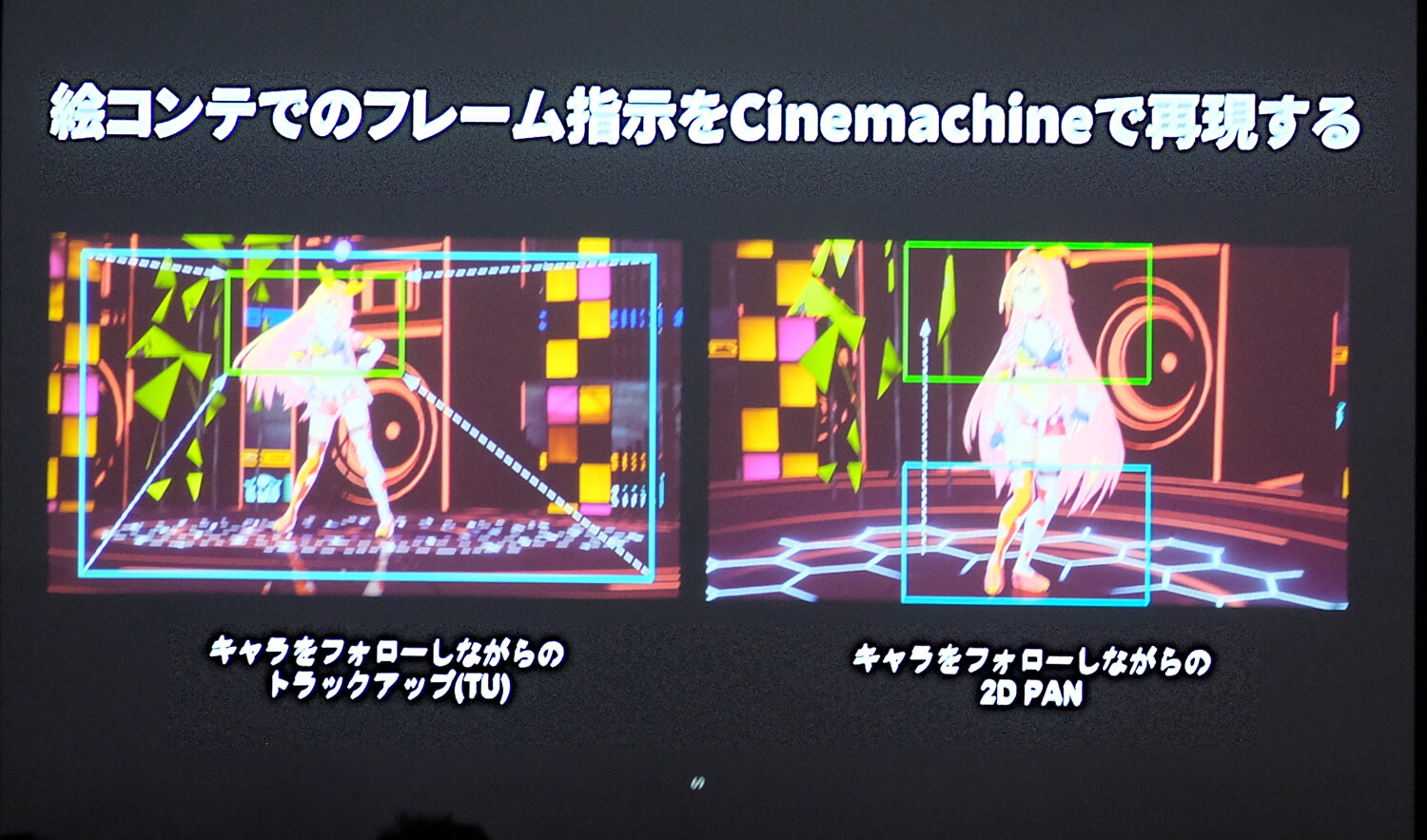

また「Screen X,Y」値で視界設定をすることで2D的なレイアウト設計を行うことができる。たとえば、キャラクターの右側に後々別のキャラクターが入ってくるという絵コンテの場合、その空間を開け続けながらフォローすることが可能だ。これによって絵コンテのフレーム指示をそのまま「Cinemachine」で再現することができる。従来のようにカメラパスを書く必要がないのがメリット。これをもとにプレビズの画面設計をしたりモーションキャプチャーの評価したり、2Dに落とすためのガイドをつくることができるという。さらなる研究に期待だ。

講演の最後に堀内氏は「Unityを使うことでフローの変換は可能か?」というパネルを出してまとめを行なった。ポイントのひとつは「DCCツールから大量の連番素材をレンダリングし、それらを2Dコンポジット上で大量のレイヤー構成で仕上げる従来のやり方から脱却」し、これらデータのやり取りを「視覚的に見られることで軽減」していきたいという。もうひとつは、「コンポジットとアニメーションがコンテ以降は同時並行作業」ができることで、演出や各セクションが一緒にスピーディーに作業をすすめることができるのではないかと展望を語った。