RESEARCH 1:全周ダイナミックプロジェクションマッピング

・私の研究の立ち位置

少しは私たちの研究についても書こうと思います。前述の通り、私自身の研究は友人のデザイナーのひと言から始まっており、東洋現像所での実務訓練での経験もあって、私の研究の立ち位置は「デザイナーの想像力を掻き立てるようなツールをつくりたい。エンジニア側からデザイナーに提案できるような表現をつくりたい」というところにあります。そのために最も重視していることは、デザイナーの試行錯誤を妨げないインタラクティブ性を維持することです。私の研究のきっかけがレイトレーシングではなくスキャンライン法だったのも、それが理由です。現在は、主にOpenGLを用いてグラフィックスハードウェアの機能や性能を活用するところに重点を置いています。

・「支援ツールの評価」の難しさ

一方で、学生の研究テーマは学生自身に決めてもらっているので、結構とりとめのないことになっています。それでも学生が私の考えを推察してくれるのか、「~の支援ツール」みたいなテーマが毎年提案されてきます。

ただ、そういうテーマはいつも「評価はどうするのか」という指摘を受けます。それは実際にデザイナーに使ってもらって評価してもらうしかありません。私たちの研究は、本当は産業との連携なしには成立しないのです。しかし、現実にはなかなかそういう機会がありません。内定が決まった学生に「内定先に頼んでみたら」と言ってみたこともあったのですが、「内定の段階でそんなこと頼めない」とスルーされました。

そういうこともあって、デザイナーの利用を想定した研究は、実は私自身ではあまり成果を得られていません。その代わり、グラフィックスハードウェアを活用することによって得られる高速性の研究では一定の成果を出せてきたように思います。この技術は、図形や画像の表示と処理に加え、後述するVRシステムや、ゲームなどのインタラクティブなコンテンツへの応用に対しても有効です。

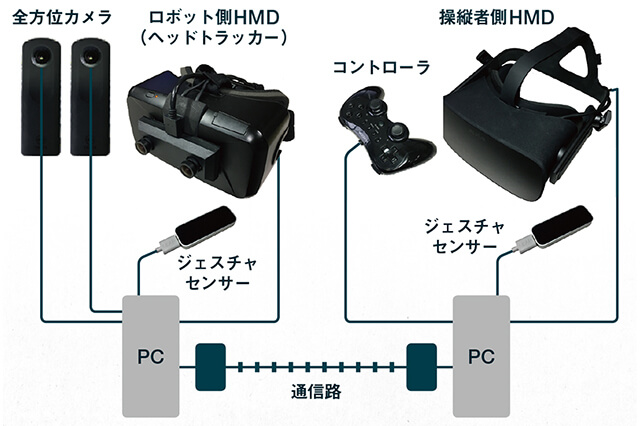

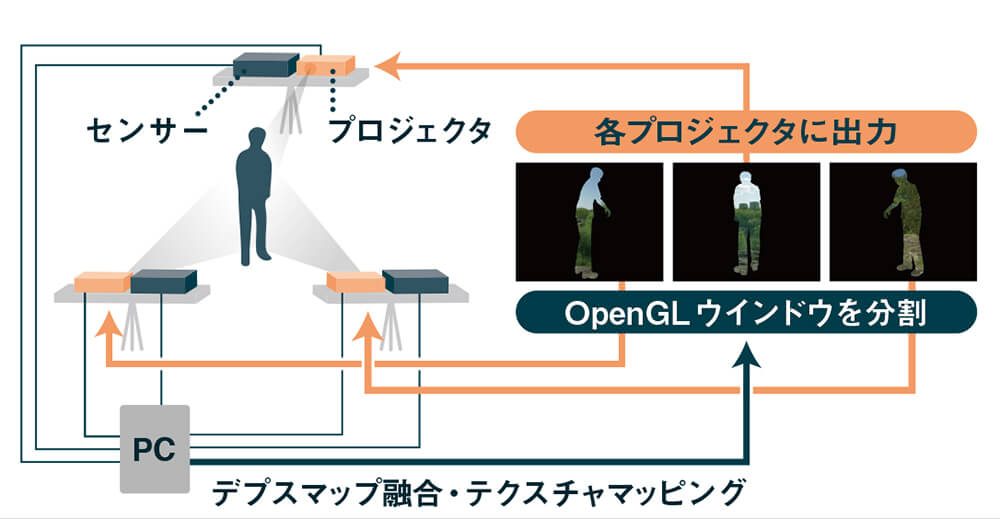

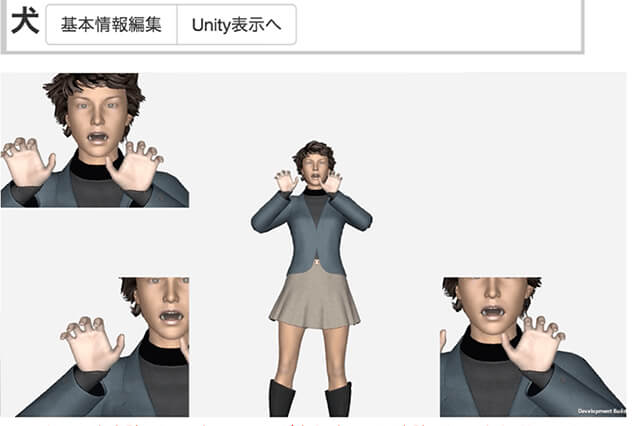

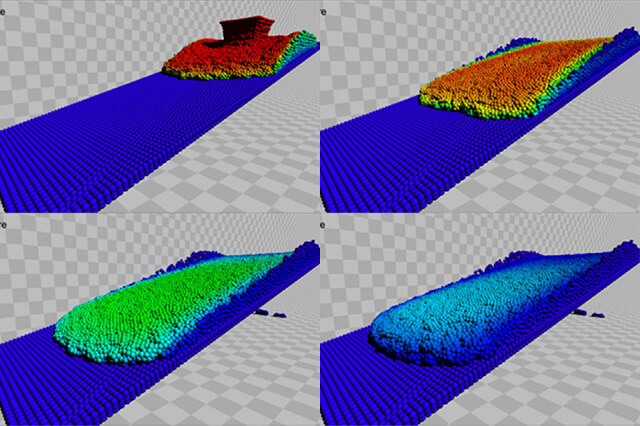

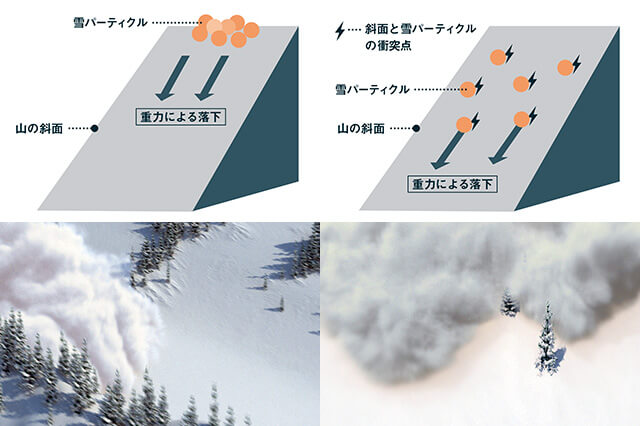

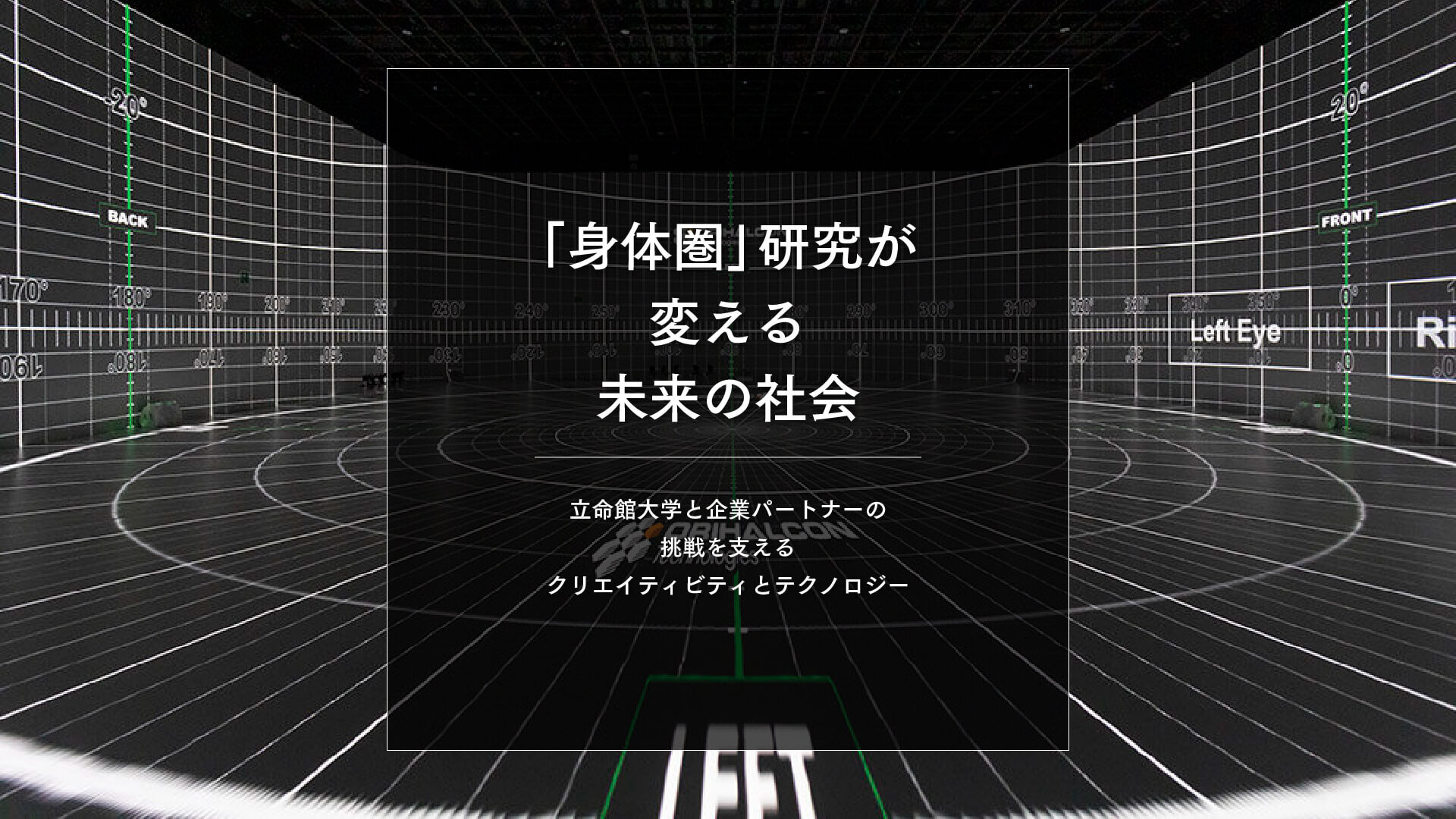

・姿勢が変化する人体への全周プロジェクションマッピング

2014年の修士研究では、人体のような変形する物体の周囲にカラー画像と一緒に深度画像(距離画像)も取得できるRGB-Dカメラを複数配置し、それらから得た深度画像をグラフィックスハードウェア(GPU)上で合成し、被写体の全周形状をダイナミックに再構成することを試みました。さらに、再構成された形状にテクスチャマッピング(リフレクションマッピング)を施した映像をプロジェクタで被写体に再投影しました。これにより被写体の姿勢の変化に応じて見かけが変化するダイナミックな全周プロジェクションマッピングを実現しました[1]。

しかし、本研究で用いたプロジェクタは一般的なものであり、RGB-Dカメラの遅延も大きいために、被写体は速く動くことができませんでした。なお、本研究の発表後に、超高速プロジェクタを用いた高品質な手法が開発されています[2]。

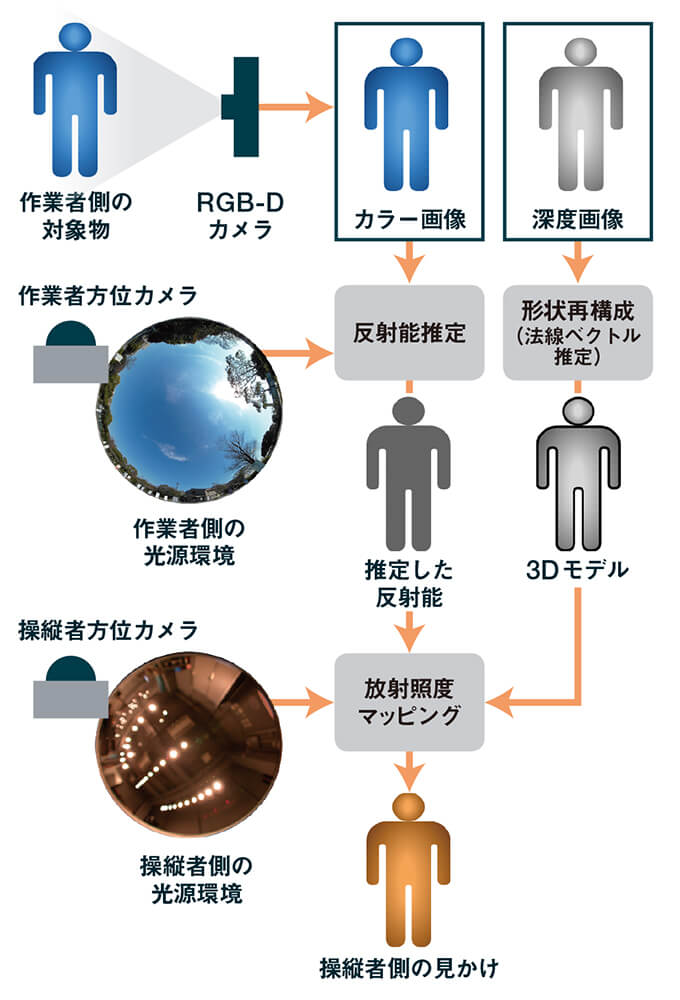

▲被写体の姿勢変化に追従する全周ダイナミックプロジェクションマッピングの構成。3台のRGB-Dカメラと3台のプロジェクタを用いています

▲全周ダイナミックプロジェクションマッピングを適用した被写体を、別のカメラで3方向から撮影したもの。再構成された被写体の形状に中央のキューブマップを用いたリフレクションマッピングを施したものを被写体に再投影しています

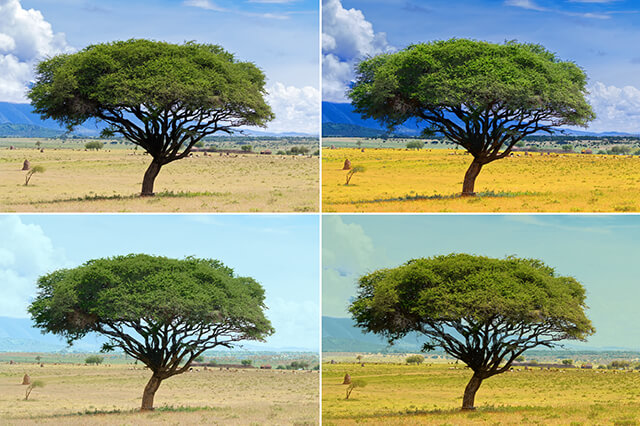

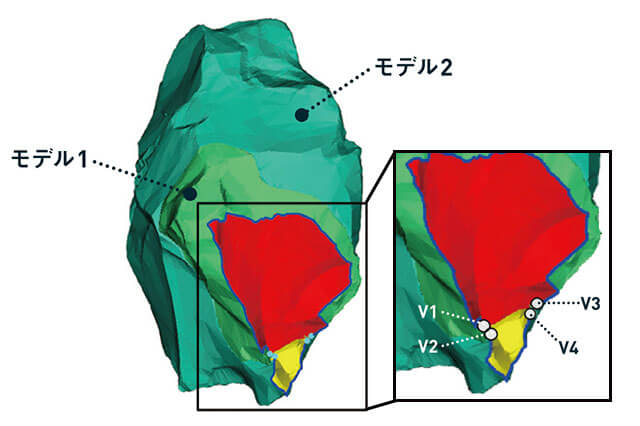

・別の光源環境に置き換えるリライティング処理

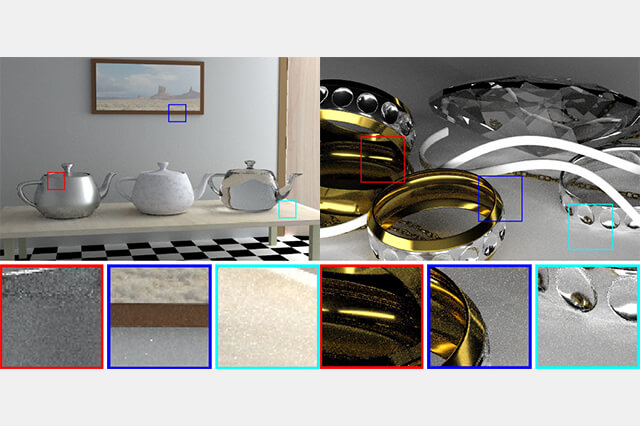

そこで2017年の修士研究では先の手法を応用して、RGB-Dカメラの深度画像から再構成された被写体の形状の法線情報と、全方位カメラにより取得した被写体の光源環境を基に、RGB-Dカメラのカラー画像から反射能(アルベド)を推定して光源環境の影響を削除し、別の全方位カメラにより取得した光源環境に置き換えるリライティング処理も試してみました[3]。

反射能の推定は、まずRGB-Dカメラのカラー画像上の1点における法線を推定し、その方向を中心に光源環境をサンプリングして、その点における放射照度を求めます。これにスクリーン空間アンビエントオクルージョンの手法により、表面の凹凸による遮蔽度を反映します。この放射照度とカラー画像との関係から、その点の反射能を推定します。

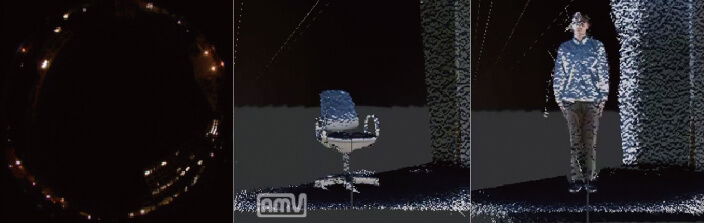

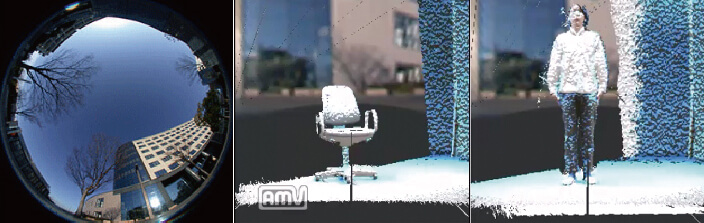

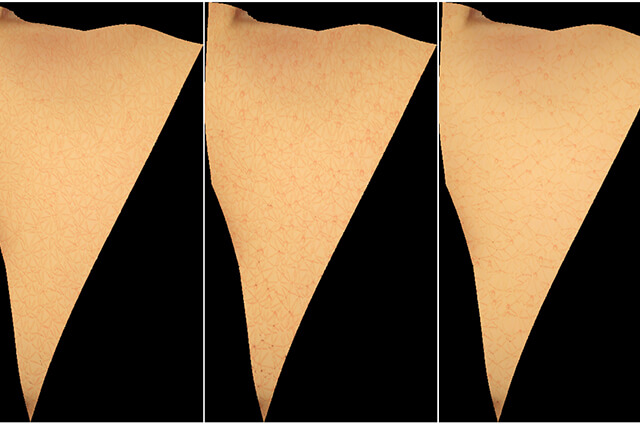

下図にて、被写体を屋内の光源環境(ダウンライト)で撮影し、その光源環境を夜間の屋外と昼間の屋外へと置き換えた結果を示しています。夜間の屋外へ置き換えたときに下から光が当たっているように見えるのは、光源環境の取得に単一の魚眼レンズを用いており、地面側からの光の放射を定数にしていたためです。

▲RGB-Dカメラと全方位カメラを用いた、光源環境の置き換え処理の手順

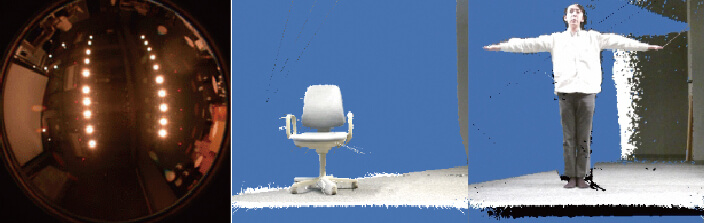

▲【左】元の光源環境/【中】被写体(椅子)/【右】被写体(人体)

▲【左】夜間の屋外の光源環境/【中】【右】元の光源環境から、夜間の屋外へと置き換えた結果

▲【左】昼間の屋外の光源環境/【中】【右】元の光源環境から、昼間の屋外へと置き換えた結果

・参考文献

[1]森正樹, 床井浩平: "運動する人体の全周に対するリアルタイムプロジェクションマッピング" インタラクション2015

[2]Narita Gaku, Yoshihiro Watanabe, Masatoshi Ishikawa: "Dynamic projection mapping onto deforming non-rigid surface using deformable dot cluster marker" IEEE transactions on visualization and computer graphics 23.3, pp. 1235-1248, 2017

[3]早川玲央, 床井浩平: "光源環境を反映したリアルタイム映像合成" NICOGRAPH 2017, 芸術科学会, 2017