RESEARCH 2:ロボットの視界再現などのVRシステムへの応用

・臨場感通信の研究

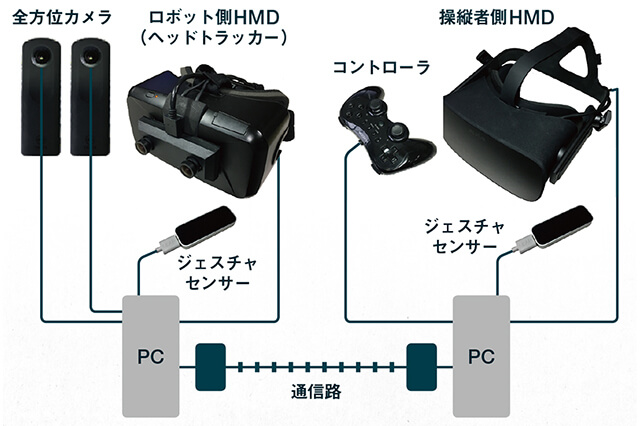

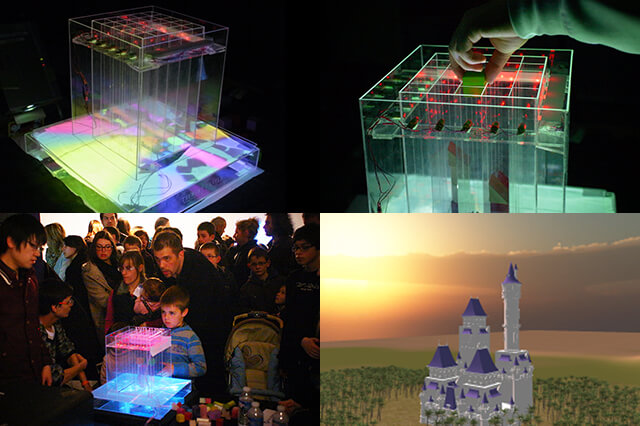

VRシステムは人間の行動に対してリアルタイムに反応を返す必要があり、グラフィックスハードウェアの支援なしに実現することは困難です。本研究では、最初にSilicon Graphics社のOnyx / Reality Engine 2に6台のBarco製プロジェクタを接続し、それぞれ3面の100インチスクリーンに時分割多重で立体映像を投影するシステムを導入しました。この3面のスクリーンは台形に折り曲げて配置し、利用者がその中心に立てば視野の140度が覆われる没入型のディスプレイになっています。

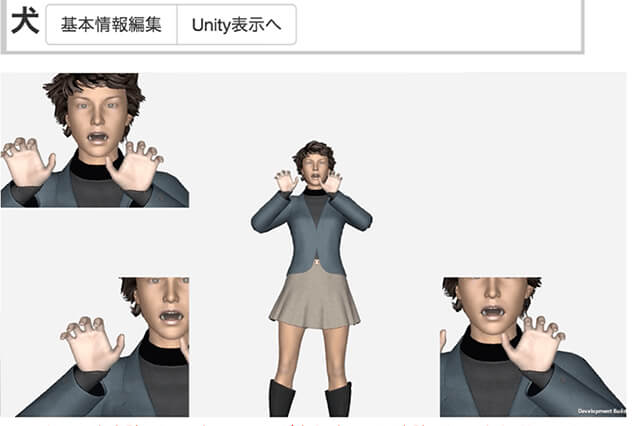

2001年の卒業研究では、これを用いて現実には目の前にいない人に殴られた感じを再現する研究などを行いました。また2003年の卒業研究では、手の平に取り付けたセンサーグローブ(SuperGlove-C)と位置センサー(Fastrak)を用いて、空間中に文字や図形を描いて相手に投げつけるチャットシステムの研究を行いました。

▲2組みの没入型ディスプレイを用いて、双方が痛くない殴り合いをする実験。目の前にいない相手に殴られた気がする表現の追及を行いました

▲同じく没入型ディスプレイを用いた実験。利用者は手の平にセンサーグローブと位置センサーを取り付け、ハンドジェスチャにより空間中に文字や図形を描いて相手に投げつけるチャットシステムを体験しています

・ロボットの視界再現の研究

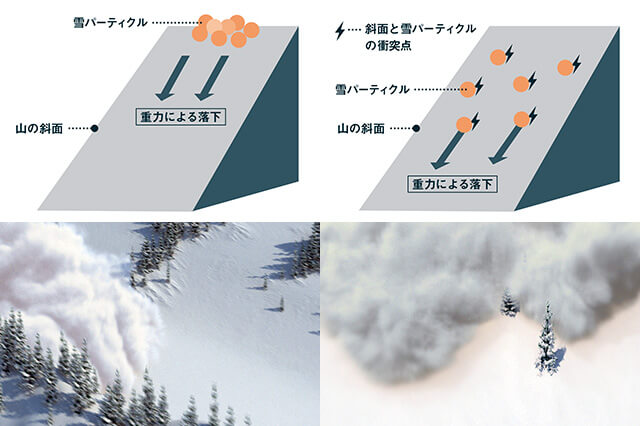

現在は低価格になったヘッドマウンテッドディスプレイ(HMD)を用いて、遠隔地のロボットの視界を再現するシステムの開発を行なっています。遠隔地で地質などの各種調査を行おうとする場合、人間が現地におもむけば詳細な調査を実施できます。しかし月面のような場所では、そもそもそこに行くことが困難であるか、行っても現地での移動や生命維持に莫大な費用がかかってしまいます。このため、一般には現地にロボットなどを設置し、遠隔操作により調査活動を行う方法が採られています。ただ、従来の遠隔操作方法では、人間が直接行うほどの柔軟かつ詳細な調査を行うことが難しいと考えられます。そこで遠隔地のロボットが置かれた環境自体を操縦者の下で再現するテレイグジスタンス[1][2]の技術を用いて、操縦者に遠隔地にいるのと同じ感覚を与える手法が試みられています[3]。

この手法の実現上の課題のひとつに、遠隔地のロボットと操縦者の通信の遅延があります。一般的なテレイグジスタンス技術はロボットと操縦者の間に高速・広帯域の通信路があることが前提になっています。ところが地上-月面間の通信では、帯域が非常に狭いだけでなく、大きな伝送遅延が存在します。このうち帯域の問題は将来改善される可能性がありますが、伝送遅延は物理的距離に起因するため、改善する手法が存在しません[4]。したがって、このような条件の下で遠隔地の環境をテレイグジスタンス技術により操縦者の周囲に再現しても、操縦者の動作に対する表示遅れのために操縦者はロボットを正しく操縦できないことが予想されます。

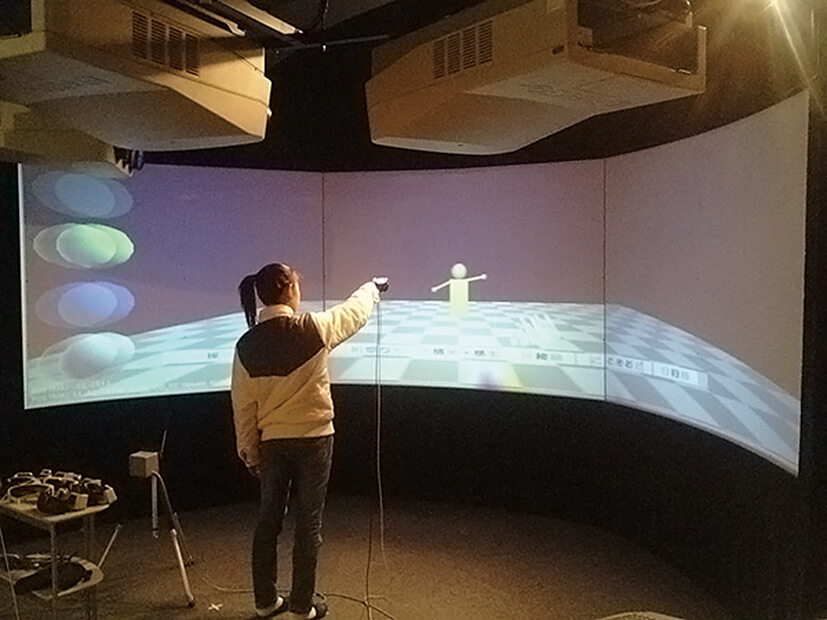

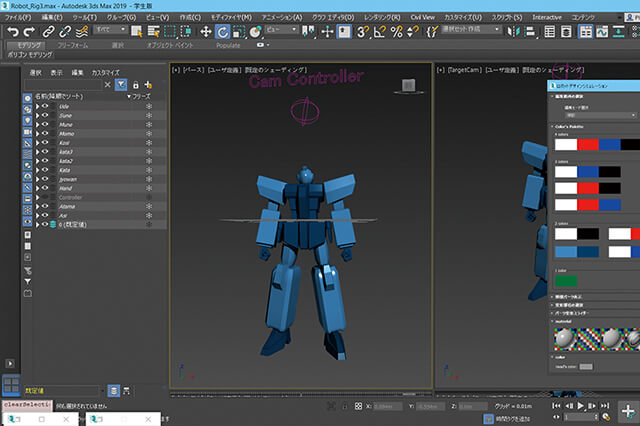

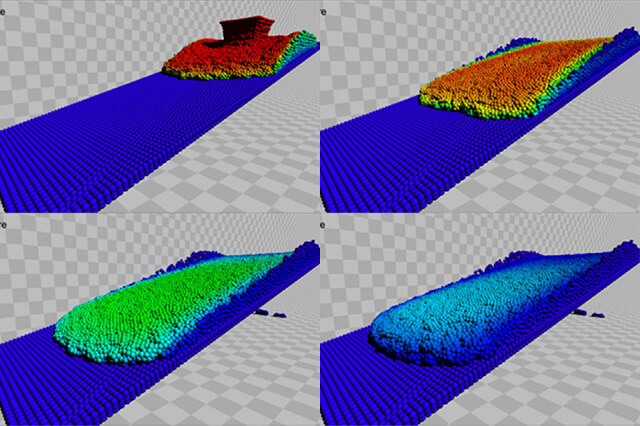

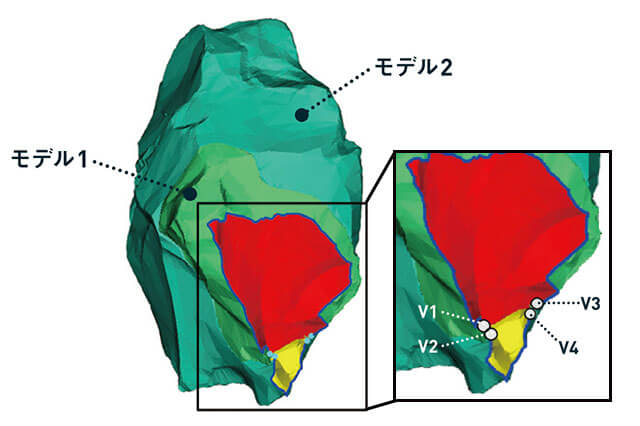

そこで本研究では、遠隔地のロボットの周囲の環境映像をあらかじめ操縦者の側に転送しておき、そこから操縦者の視野の映像を切り出して表示するシステムの開発を行なっています。これにより、操縦者の頭部の動き(視線の移動)に伴う表示の遅れを見かけ上は解消することができます。また、本システムは予測ディスプレイ技術[5][6]を用いた作業効率の改善手法[4]の評価のために、操縦するロボットをCG映像として環境映像に合成(重畳)表示する機能を有しています。

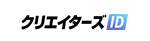

・試作システムの概要

本システムは、ロボット側に置いたカメラの映像を操縦者が装着したHMDで観測する、テレイグジスタンス視覚系において典型的な構成[7]になっています。操縦者側のHMDに映像を表示するソフトウェアは、ロボット側のカメラからネットワーク経由で取得した環境映像から操縦者の視野の映像を切り出す機能や、重畳表示している3次元形状データの位置や姿勢をマウスやゲームパッドで調整する機能、操縦者が装着したHMDのヘッドトラッキング情報をロボットに伝送する機能などをもっています。

▲2つのHMDを用いて、遠隔地の環境映像を、遠隔地の作業者(ロボット)と、作業者に指示を与える指示者との間で共有するシステムの構成。全方位カメラを用いて遠隔地の環境映像を取得し、HMDのヘッドトラッキング情報とジェスチャセンサーで取得した作業者の姿勢情報と共に指示者へ伝送します。一方で、指示者のヘッドトラッキング情報とジェスチャセンサーによる姿勢情報も、作業者に伝送します

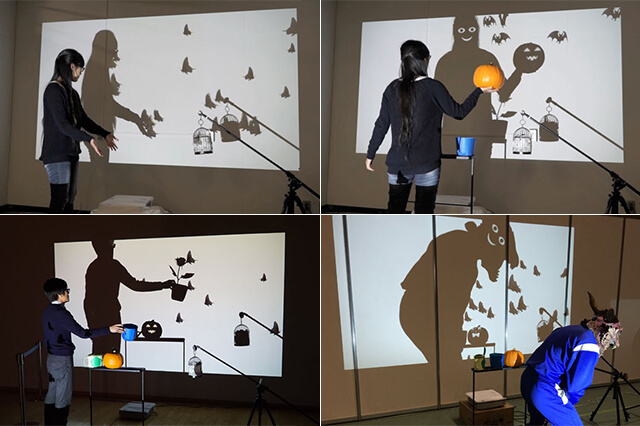

なお、この実験には玉川大学 工学部 岡田研究室が所有する川田工業NEXTAGEを用いました。しかし、ソフトウェア開発のため、ロボットを使用せず、人(作業者)がHMDを装着して代わりを務められるようにもしています。この場合、指示者(操縦者)は作業者と視野を共有し、指示者の注視方向を示すマーカーと手の動作を表すロボットハンドを作業者の視野に重畳します。また、もとより作業者(ロボット)の注視方向を示すマーカーと手の動作を表すロボットハンドを指示者の視界にフィードバックしているので、このシステムはロボットの視界の伝送だけでなく、テレイグジスタンスや遠隔行動誘導、体験共有の実験などにも使用できます[8]。

▲【左】実験に使用したロボット(川田工業NEXTAGE)/【右】ロボットの頭部に取り付けた全方位カメラ(RICOH THETA S)

▲遠隔地の作業者の視界を指示者と共有する実験。双方の注視方向や手の姿勢を視界に重畳して表示することができます

・参考文献

[1]Susumu Tachi: "Telexistence" 2nd edition, World Scientific, 2014

[2]舘暲: "テレイグジスタンス" 日本ロボット学会誌, vol. 33, no. 4, pp. 215-221, 2015

[3]河野功 他: "月の縦孔・地下空洞探査のためのスーパーテレイグジスタンスロボットの研究" 第33回日本ロボット学会学術講演会講演予稿集, 2015

[4]大山英明, 金奉根, 城間直司: "時間遅れの大きい通信下におけるテレイグジスタンス型ロボット操縦のための表示システム" 宇宙科学技術連合講演会講演集 59, 4p, 2015

[5]M. V. Noyes, T. B. Sheridan: "A Novel Predictor for Telemanipulation Through a Time Delay" Proc. Of 20th Annual Conf. on Manual Control, NASA Ames Research Center, 1984

[6]T. B. Sheridan: "Space Teleoperation through Time Delay: Review and Prognosis" IEEE Transactions on Robotics and Automation, vol. 9, no. 5, pp. 592-606, 1993

[7]柳田康幸: "テレイグジスタンス視覚系の最近の研究動向" システム/制御/情報, システム制御情報学会誌, 46. 12, pp. 745-750, 2002

[8]大山英明, 城間直司, 八木下明宏, 根本太晴, 岡田浩之, 鈴木夏夫, 床井浩平: "TelExistance Display System (TED): テレイグジスタンス/遠隔行動誘導/体験共有のためのAR表示オープンソースソフトウェア" 第18回計測自動制御学会システムインテグレーション部門講演会 SI2017, 2C2-06, 2017

info.

-

-

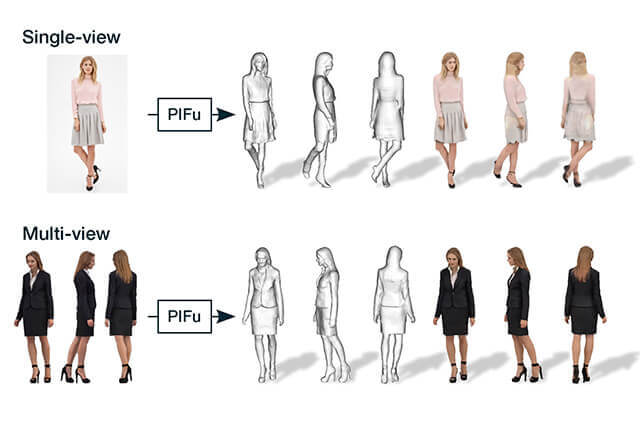

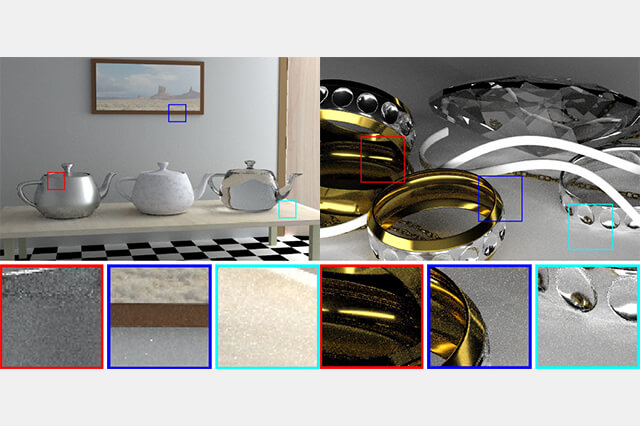

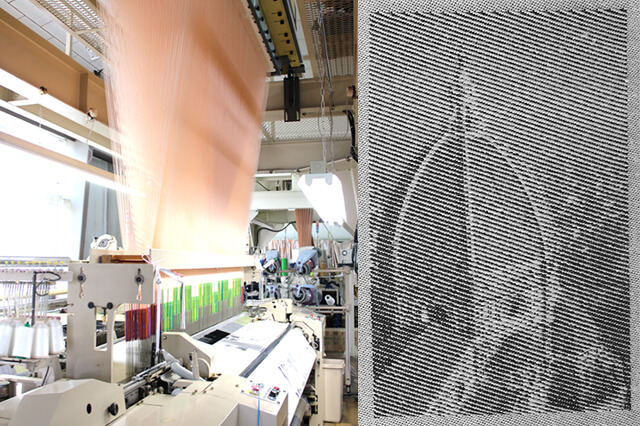

月刊CGWORLD + digital video vol.251(2019年7月号)

第1特集:デジタルヒューマン&バーチャルスタジオ

第2特集:世界観を表現するデジタルアート

定価:1,540円(税込)

判型:A4ワイド

総ページ数:128

発売日:2019年6月10日

cgworld.jp/magazine/cgw251.html