東映 ツークン研究所が開発・運用するマーカーレスのリアルタイムカメラトラッキング&合成システム「LiveZ studio」がリニューアル。最新版の性能を聞く。

※本記事は月刊「CGWORLD + digital video」vol. 266(2020年10月号)からの転載となります。

TEXT_福井隆弘

EDIT_沼倉有人 / Arihito Numakura(CGWORLD)、山田桃子 / Momoko Yamada

© 2020 Toei Zukun Laboratory

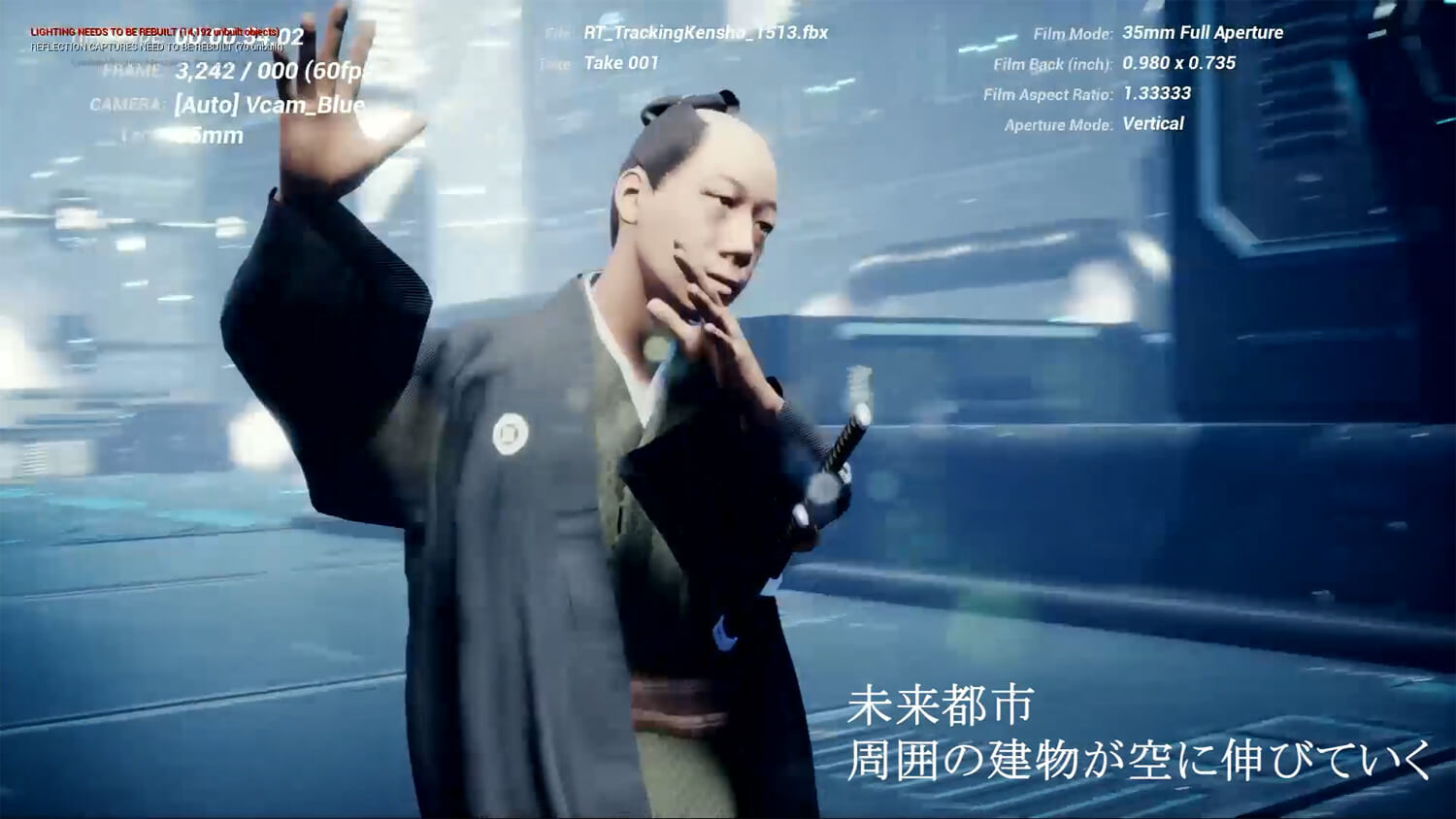

LiveZ studioデモムービー

出演・ナレーション:稲田 徹

監督:市田俊介

制作:東映 ツークン研究所

youtu.be/b1vusE57-SU

新たにAIによるキーイング機能も実装

東映デジタルセンター内で2010年に発足したツークン研究所がバーチャルプロダクション機能のひとつとして開発中の「LiveZ studio」(ライブズ スタジオ)。そのデモムービーが、5月29日(金)からYouTubeで公開中だ。

LiveZ studioは、撮影現場で合成映像のリアルタイム確認を可能にするシステム。Unreal Engine 4(以下、UE4)を用いて、グリーンバック不要・マーカーレスのトラッキングと、AIを導入した新しいマスク生成技術により、リアルタイムで人物のマスクを生成し用意した3DCG空間に合成することができる。小規模プロダクションでもバーチャル撮影を可能にすることを目指しているとのことだが、開発リーダーの三鬼健也氏が企画の経緯を語った。「初期バージョンではトラッキング精度などまだまだ不安定で、開発自体を見直した方が良いと判断して改めて仕切り直すことになりました。そこで2019年12月くらいから、UE4とハードをつなげるスキルをもったスタッフをリクルートするなど、社内の開発体制を整えました。それと同時に今回のプロジェクト、LiveZ studioを紹介するムービーをつくりたいという企画が起ち上がりました。当社の市田をディレクターとして2019年末からスタートし、本格的には2020年1月から5月まで制作に取り組みました」。

▲〈上段〉左から、三鬼健也氏、市田俊介氏、小林真吾氏、大橋一勝氏/〈下段〉左から、石原英祐氏、大川拓樹氏、坂田大季氏、朴 ナヒョン氏。以上、東映 ツークン研究所

zukun-lab.com

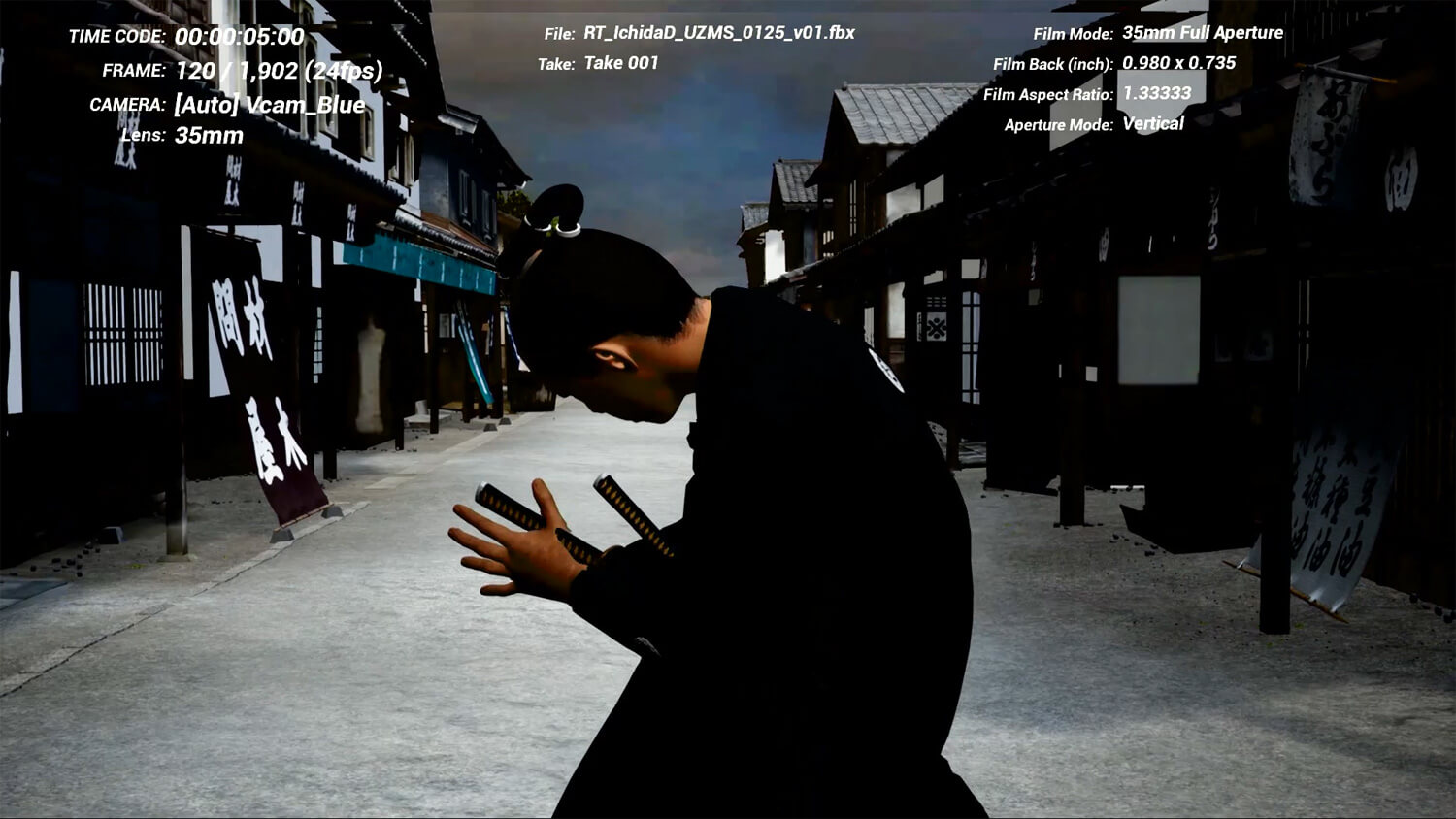

本作が監督デビュー作となった入社3年目の市田俊介氏はこう語る。「最初にお話をいただいたときに、堅い感じではなくある程度作品としてのユニークさやキャッチーさを担保したいと考えました。そこで、中年のサムライが小躍りしながら歩く姿をワンカット風のカメラ移動とCG背景の変化を合わせて見せたいというイメージが最初に生まれました。コンセプトは、映像技術が日々進化していく様を、時代を越えて渡り歩く侍を通して表現することです。内容の軸はもちろんAIを使ったマスク処理の検証で、それを具体的なビジュアルにしていきました」。コロナ禍での制作となったが、緊急事態宣言発令のタイミングですぐに全社員自宅作業に。最終段階の色味の確認など細かい仕上げはさすがに会社の環境で行う場面もあったが、大半の作業は問題なくテレワークで行えたそうだ。

<1>プリプロダクション

バーチャルカメラで撮り方の検証をしながらプリビズ制作

プリビズ時の撮影は1月某日の朝7時から準備を開始。撮影はAIによるマスク処理の検証も含むため、10時から18時と約8時間にも及んだ。その後準備を整え2月12日(水)にリハーサル、2月21日(金)にツークン常設のキャプチャスタジオで本番の撮影が行われた。今回、LiveZ studioのメリットを引き出すために長回しで動き回るカメラワークが前提としてあったため、絵コンテを飛ばしてバーチャルカメラとモーションキャプチャのアクターで撮り方の検証をしてしまった方が早いと判断し、直接プリビズ作成に入ったという。プリビズ用のモデルは社内にある侍と東映太秦映画村のアセットに加え、電車内や未来都市などその他のモデルは全てUE4のマーケットプレイスから用意した。初期段階から各モデルの調達先は決めていたため、プリビズの段階から実写の人物以外はほぼ本番と同様の状態で進めることができた。「今回の最大の目的はLiveZ studioを使用したワークフローを確立することでした。モデル制作に時間をかけてUE4の検証をするためではないので、この企画が始まる前にすでにつくってあった太秦映画村のアセットは別として、それ以外のアセット、現代や未来のシーンの背景については、最短で目的に到達するため、購入したモデルを上手く使う方向で進めました。スピード重視です」と、三鬼氏。

懸念していたトラッキングの精度については、バッチリとはいかないものの、リアルタイムでここまでできれば文句はないというクオリティが出たそうだ。「カメラを超高速で振り回せばさすがに飛ぶかもしれませんが、今回、撮影中にトラッキングがすっ飛んでしまって撮り直すということはありませんでした。演出的なリテイクはありましたが、技術トラブルなどでのリテイクはなく順調に進行でき、リアルタイムでどこまで抜けるかという点では合格点だったと思います。ただし、カメラが人物を軸に回っているので、スタッフが映り込まないように逃げるのだけは大変でした。映ってしまうとAIが人と認識して勝手に抽出してしまうので、グレーの布を被ったりして映り込まないように対処しました」と、全体的な監修を務めた小林真吾氏。なおトラッキングにはIntel RealSense Tracking Camera T265を使用、撮影用カメラにはSony α7 III、ジンバルにはDJI Roninが用いられた。

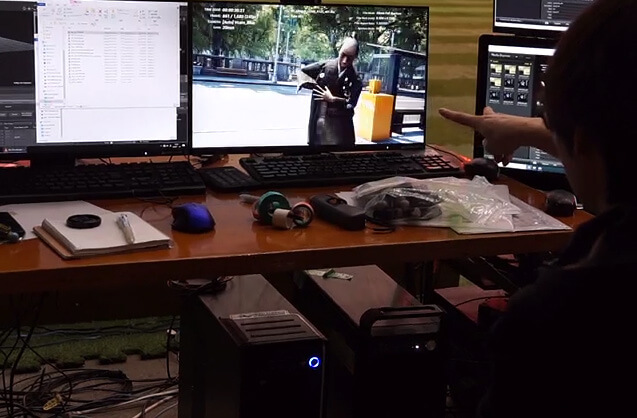

プリビズ撮影

▲バーチャルカメラとモーションキャプチャによるプリビズ撮影の様子

リアルタイム合成のテスト

▲AIによるリアルタイム合成のテスト風景

AIマスクのテスト

完成したプリビズ

▲今回作成したプリビズ。この段階でおおよそのレンズミリ数が算出される

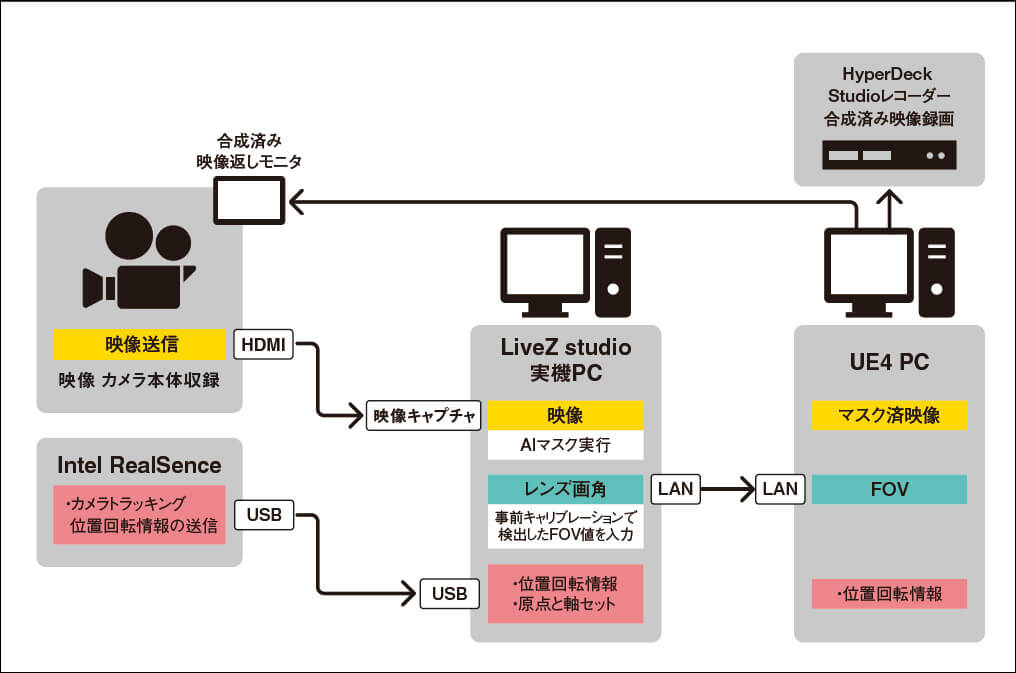

LiveZ studioシステム構成

▲LiveZ studioのシステム配線図。撮影カメラの映像とトラッキング情報(Intel RealSence)はまずLiveZ StudioのPCに送られ、AIマスク情報とFOV情報を付加してUE4が動作するPCへ。ゲームエンジン内で背景と実写を合成し、録画デバイスと撮影カメラのモニタにリアルタイムで映像を返すしくみ

撮影カメラ

▲LiveZ studioの撮影カメラ

▲カメラ本体に取り付けたセンサーが実写カメラの動きを取得

▲合成後の映像をリアルタイムでモニターしながら撮影可能

[[SplitPage]]<2>シーンメイキング~太秦(過去)~

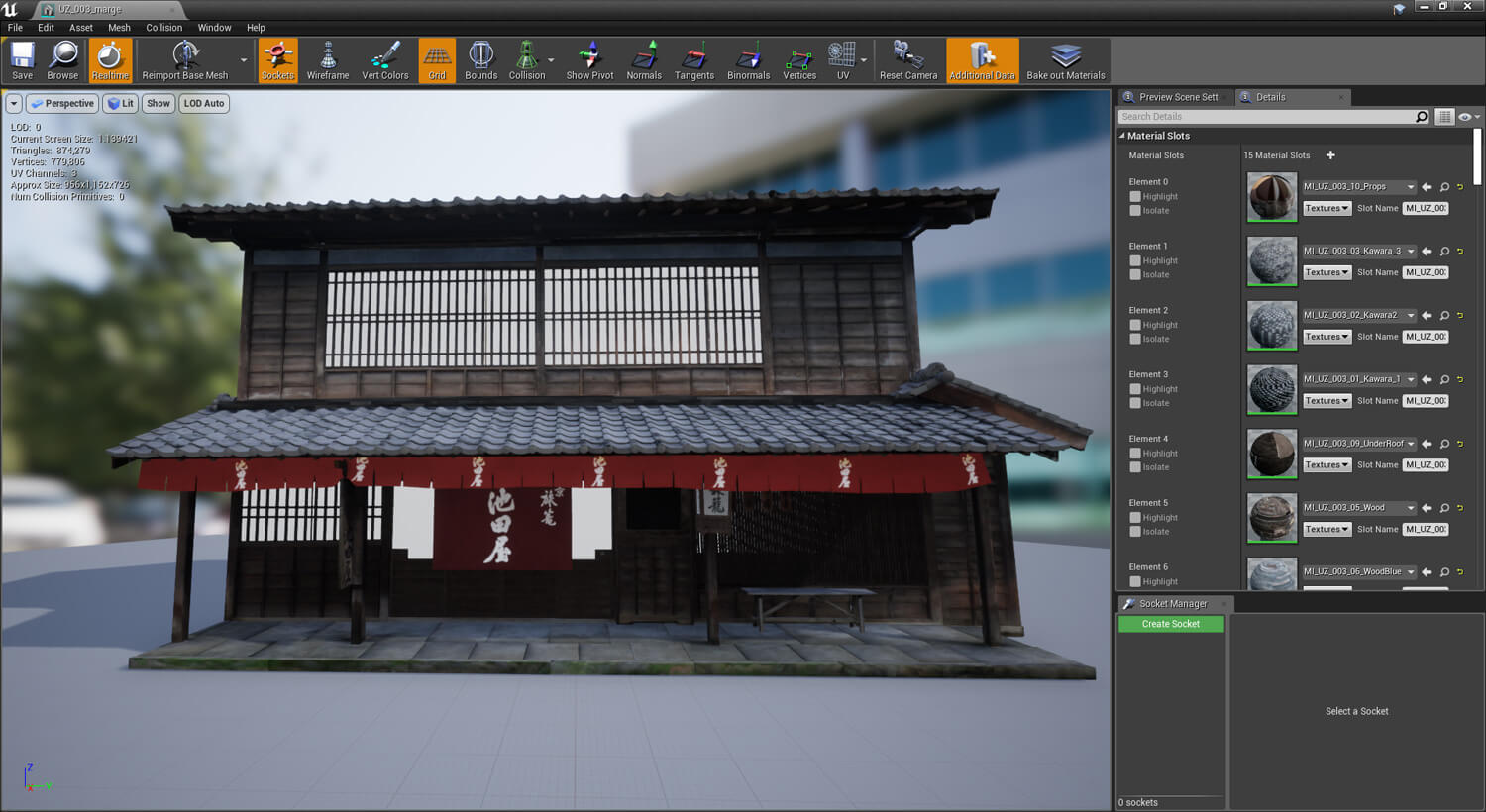

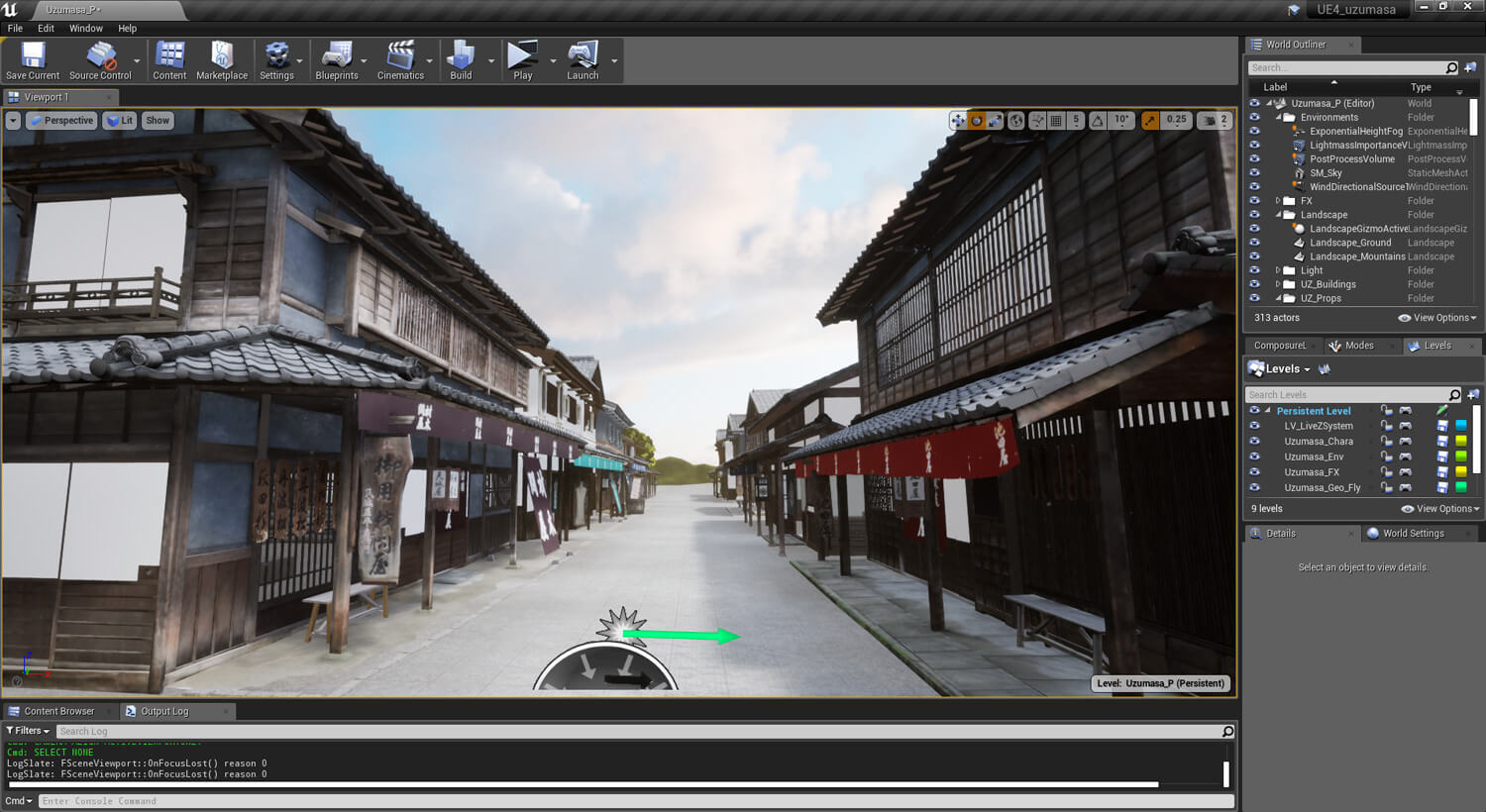

3Dレーザースキャンによる太秦のアセットを活用

当初、冒頭の実写シーンは東映太秦映画村(www.toei-eigamura.com)で撮影する予定だったが、様々な事情があり中止となり、以前から社内にあった、フォトグラメトリーやレーザースキャンで作成した太秦映画村のアセットを使用することになった。バーチャルプロダクションとして、あたかも現地に行ったかのようにビジュアルのイメージを具現化したのである。

デモムービーの侍役は声優の稲田 徹氏が務めた。市田監督は本番撮影について次のようにふり返る。「今回のデモの目玉はリアルタイムプレビューですが、実写の人物の背景に動かない背景を合成しても面白くなくて、それぞれ動いている状態でのカメラワークを見ることにこそ現場プレビューの価値があると思ったのです。実際、現場でリアルタイムに背景が合成された映像を確認できるので、稲田さんが、背景のビルがせり上がっていくタイミングに合わせて手を振り上げるという、背景に対応した演技をアドリブで入れてくれるなど、このシステムの利点を引き出すことができました」。

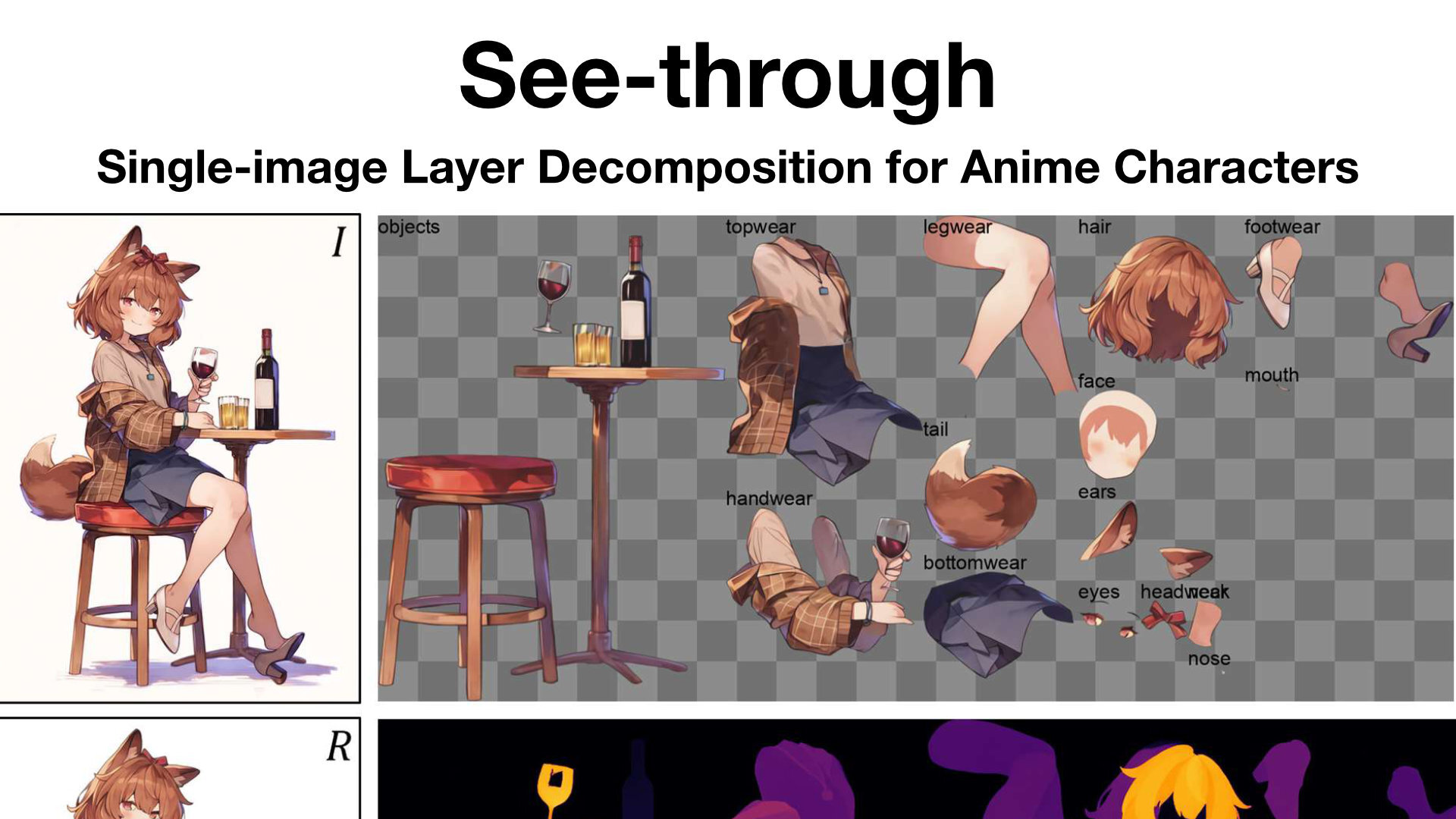

マスク生成に関しては、撮影時に白黒のマスクが同時に収録されるしくみ。そのデータについては撮影後に「ここは人間」「ここは人間ではない」という箇所をペイントしてAIに学習させ、マスクの精度を高めている。ペイントに使用するツールはAfter Effects(以下、AE)やDaVinci Resolveなどいくつか試した上で、フィードバックが一番早いと感じたDaVinci Resolveを採用。石原氏と市田氏はDaVinci Resolveの使用経験がなかったため、操作方法を学びながらの作業となった。

「AIがなかなか優秀で、人じゃない刀の部分だけが綺麗に抜かれていたり、モーションブラーなどは人間の作業よりも綺麗にマスクを切ってくれていました。条件が整えば髪の毛1本1本まで綺麗に抜けるので、上手く使えば相当手間が省けるだけでなく、クオリティも高い素材が上がってくると思います。幸い社内に大量の撮影素材があるので、AIに学習してもらう材料には困りませんでした」と小林氏。AIの精度向上のため、一度ある素材で学習させたらまた新たな素材で再度学習させるというように、時間の許す限り学習プロセスを増やした。なお、最終仕上げの段階ではパスを切る必要が出た箇所もあり、それらは通常通りAEを使用しているとのこと。

本番撮影

本番撮影時の様子。グリーンバックを一切立てず、リアルタイムで合成映像を確認しながら撮影を進める

▲カメラに人物と認識されるのを防ぐため、監督やスタッフは布をかぶりながらモニターチェックなどを行う

太秦映画村の3Dアセット

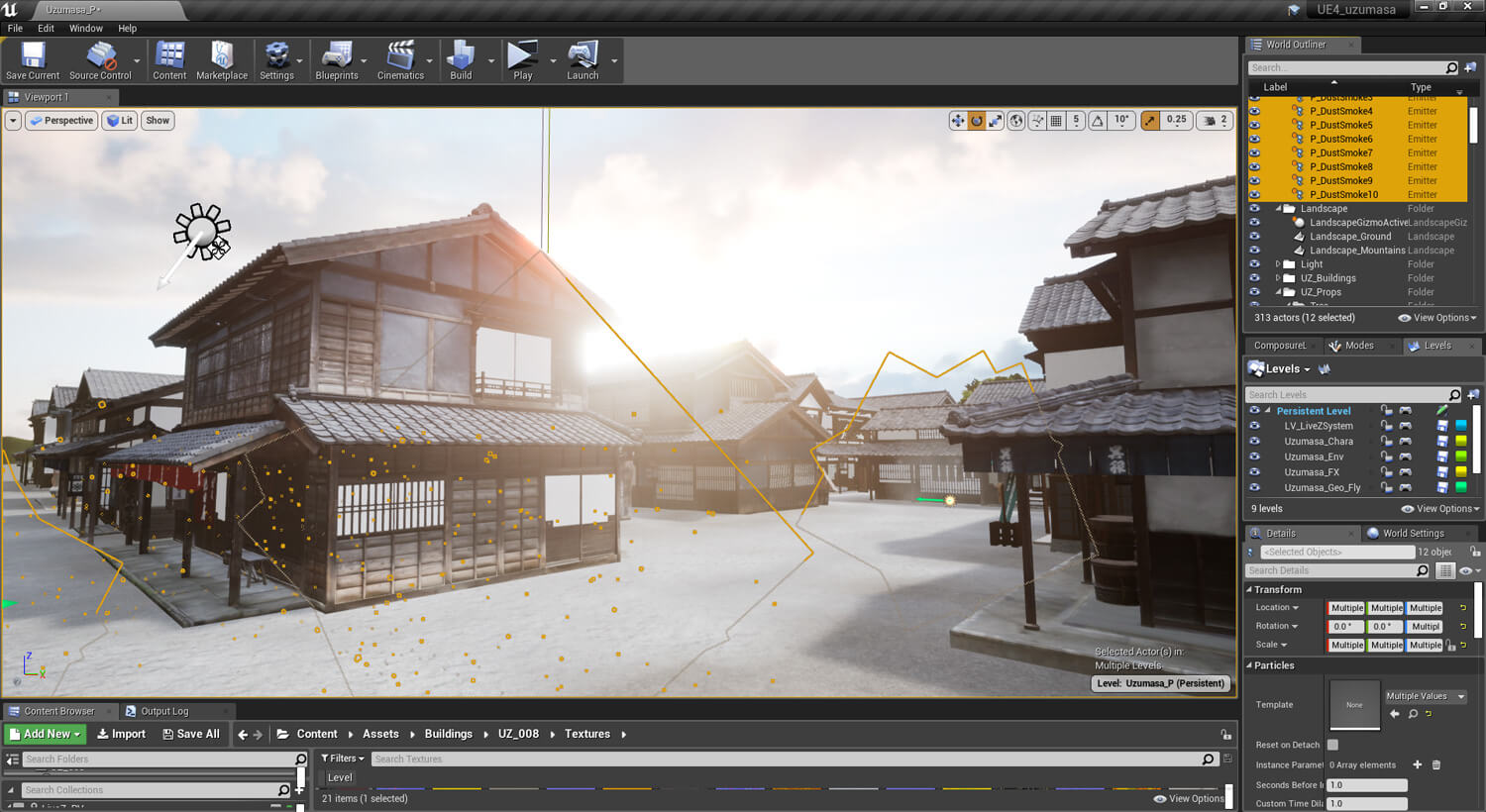

▲太秦映画村の一角をCG化するにあたって作成した3Dアセットの一部。本番撮影前に、監督はこのUE4シーンの中をバーチャルロケハンした

砂埃や塵の表現

©東映太秦映画村

▲地面の砂埃や空気中の塵はUE4のパーティクルで作成

LiveZ studioでの撮影

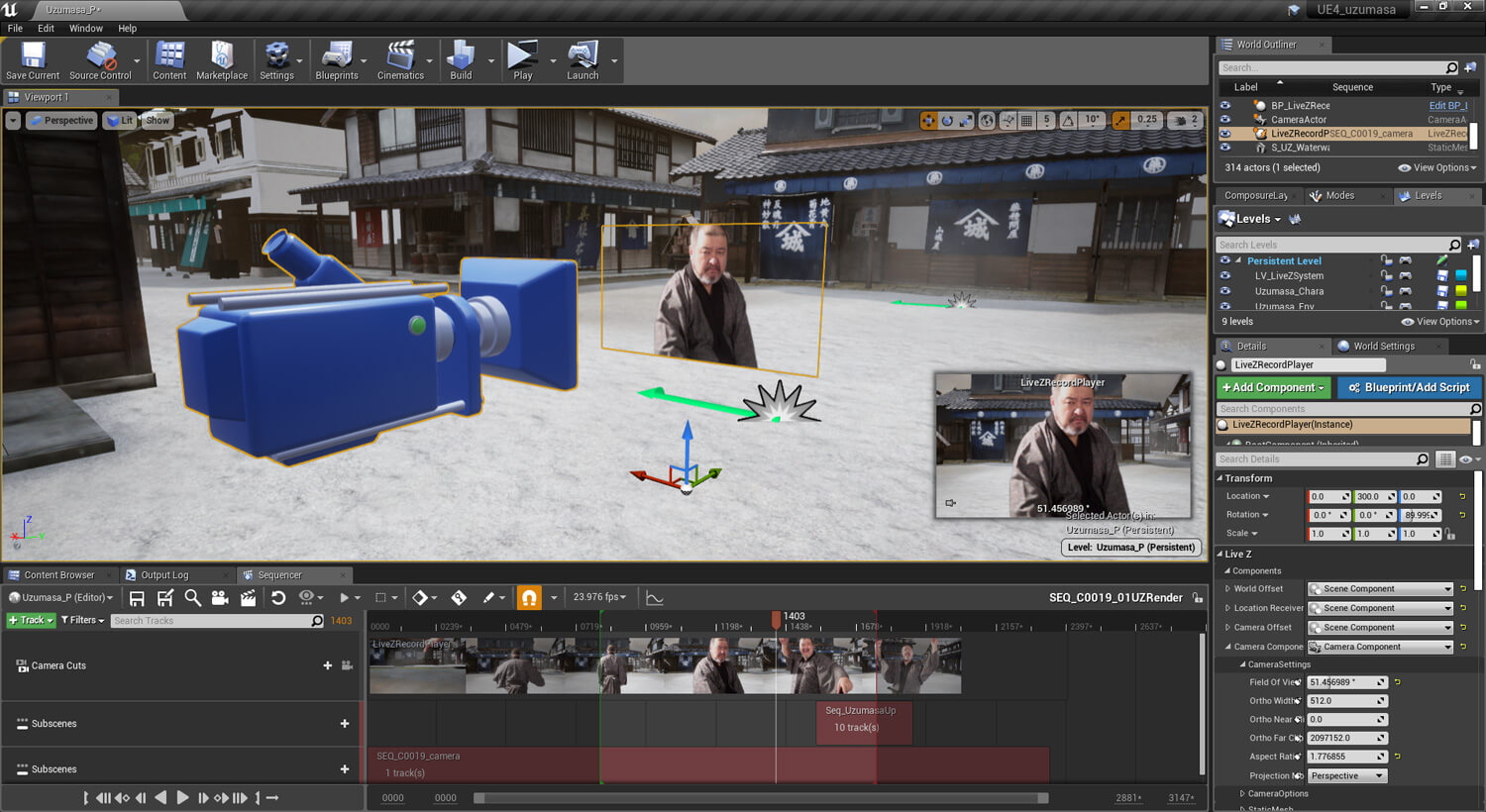

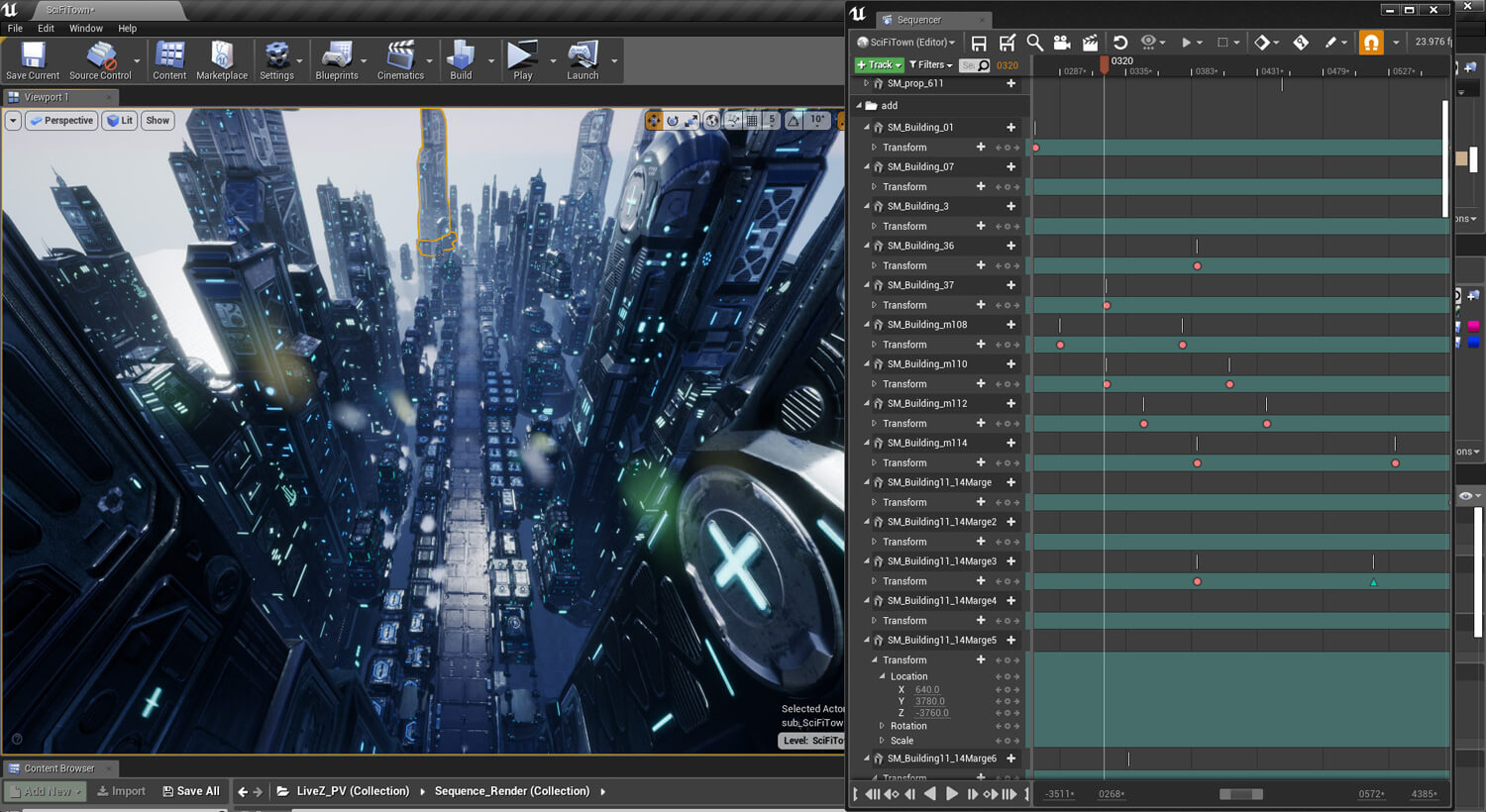

LiveZ studioでは、撮影中は常にカメラ位置とRGBA映像がストリームされリアルタイムプレビューが行えるだけでなく、撮影後は収録したデータを1セットでシーケンサーに並べるところまでプラグイン化。「新しいワークフ ローだからこそ手間や人的ミスを減らす工夫を加えながら開発しています」と三鬼氏

▲撮影後、収録した実写プレートとカメラトラッキングデータはUE4のシーケンサーに自動で並ぶ(画面は背景等の調整前、デモムービー0:38)

背景CGとのタイミング調整

撮影後は背景CGとのタイミング調整などをUE4上で行う

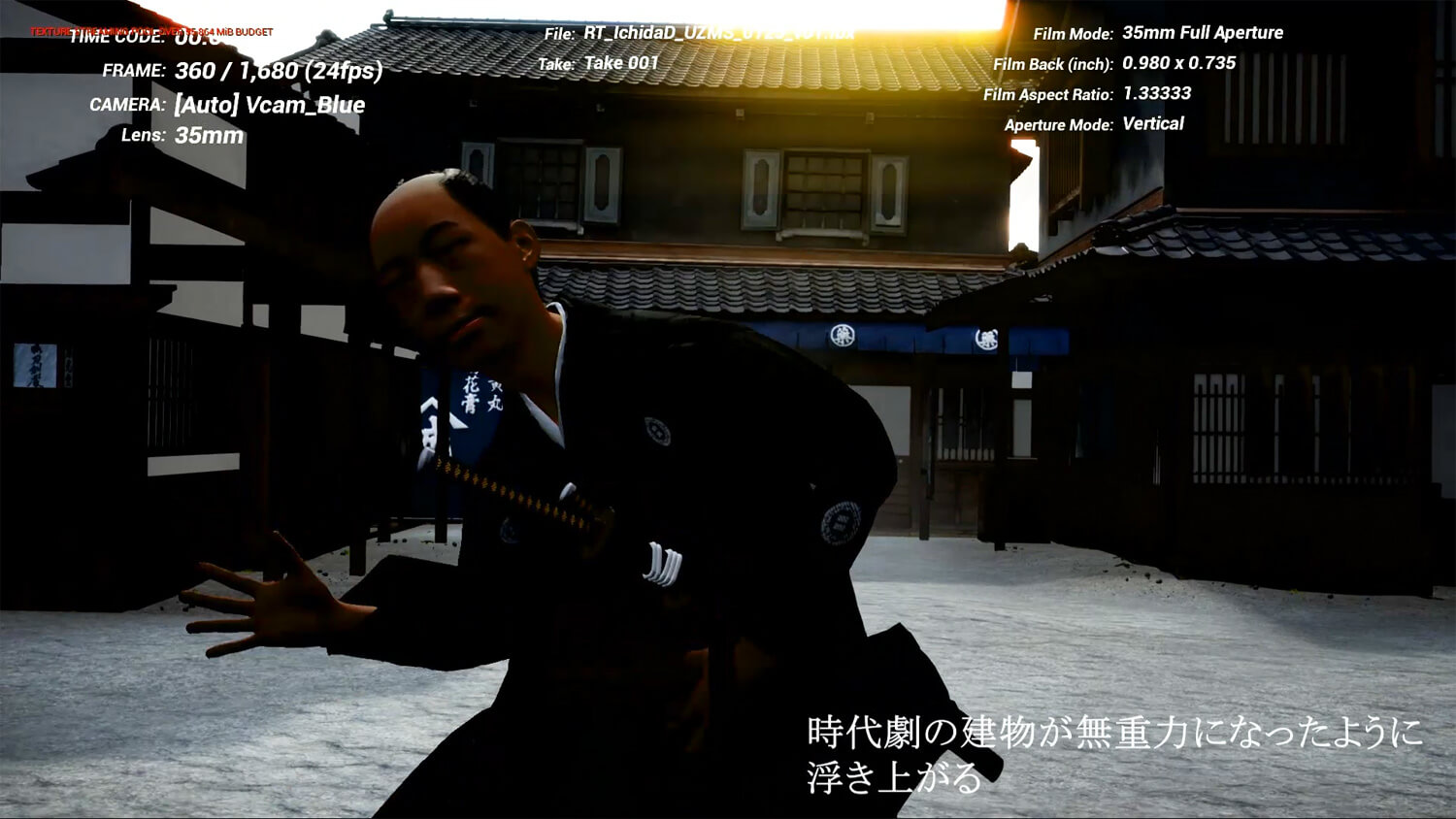

▲デモムービー0:50付近、家屋が浮遊するシーン。撮影時はキー入力をトリガーにして家屋を浮遊させてリアルタイムでタイミングを合わせつつ、撮影後に微調整して完成させた

▲デモムービー0:53、家屋セットがなくなって青空が現れ、高層ビルやタクシー、ベンチなどが次々と空から降ってきて街が出来上がるシーン。キー入力で背景CGの入れ替えができるようにしてあるため、背景が替わる演出であってもカットを切らずに1テイクで、リアルタイムで確認しながら撮影できた。オブジェクトの落下アニメーションは撮影後に実写に合わせて再調整した上で仕上げられた人物合成のブレイクダウン

AIマスクを活用した人物合成のブレイクダウン

次ページ:

<3>シーンメイキング~電車内(現代)&未来都市~

<3>シーンメイキング~電車内(現代)&未来都市~

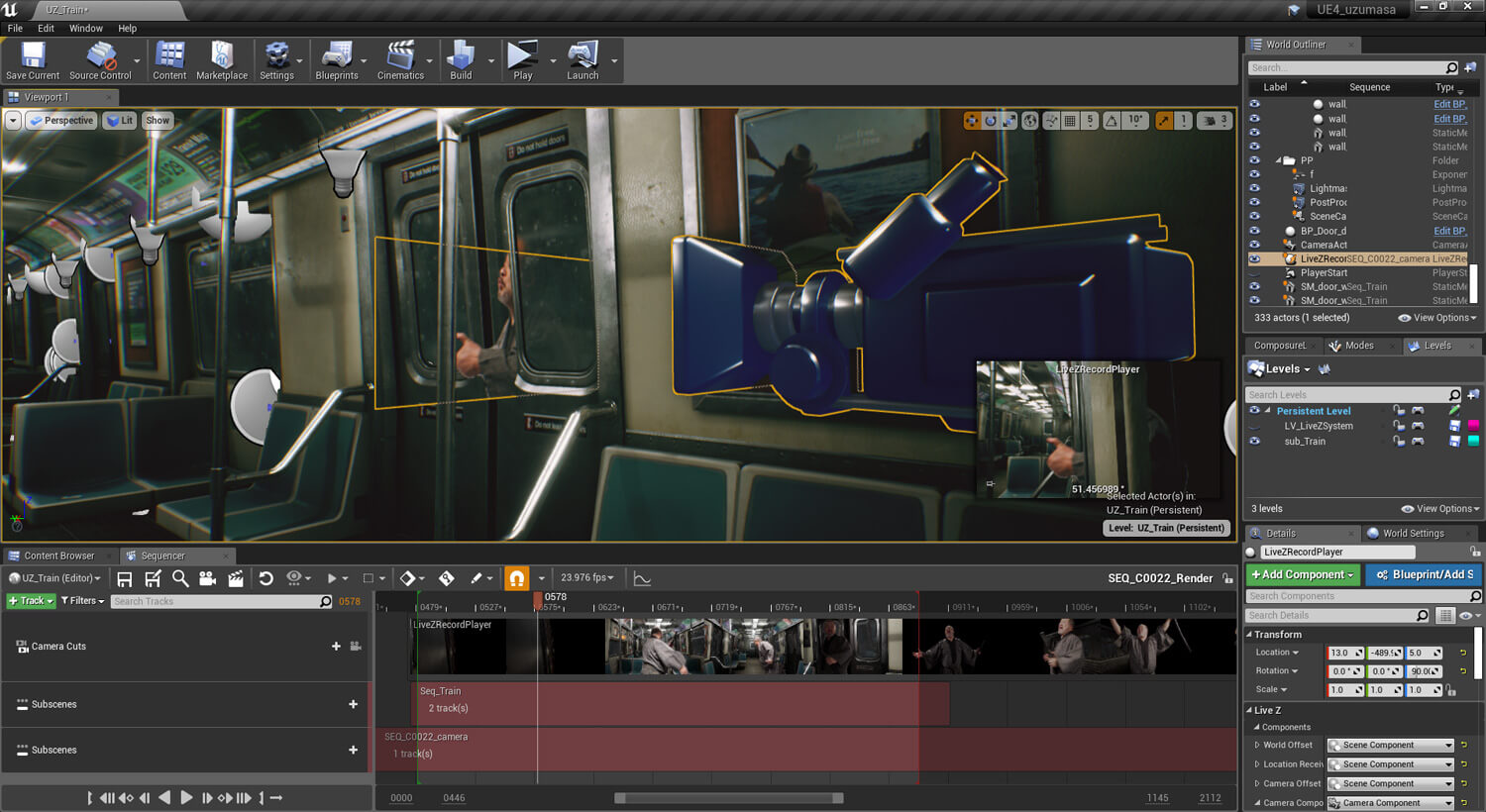

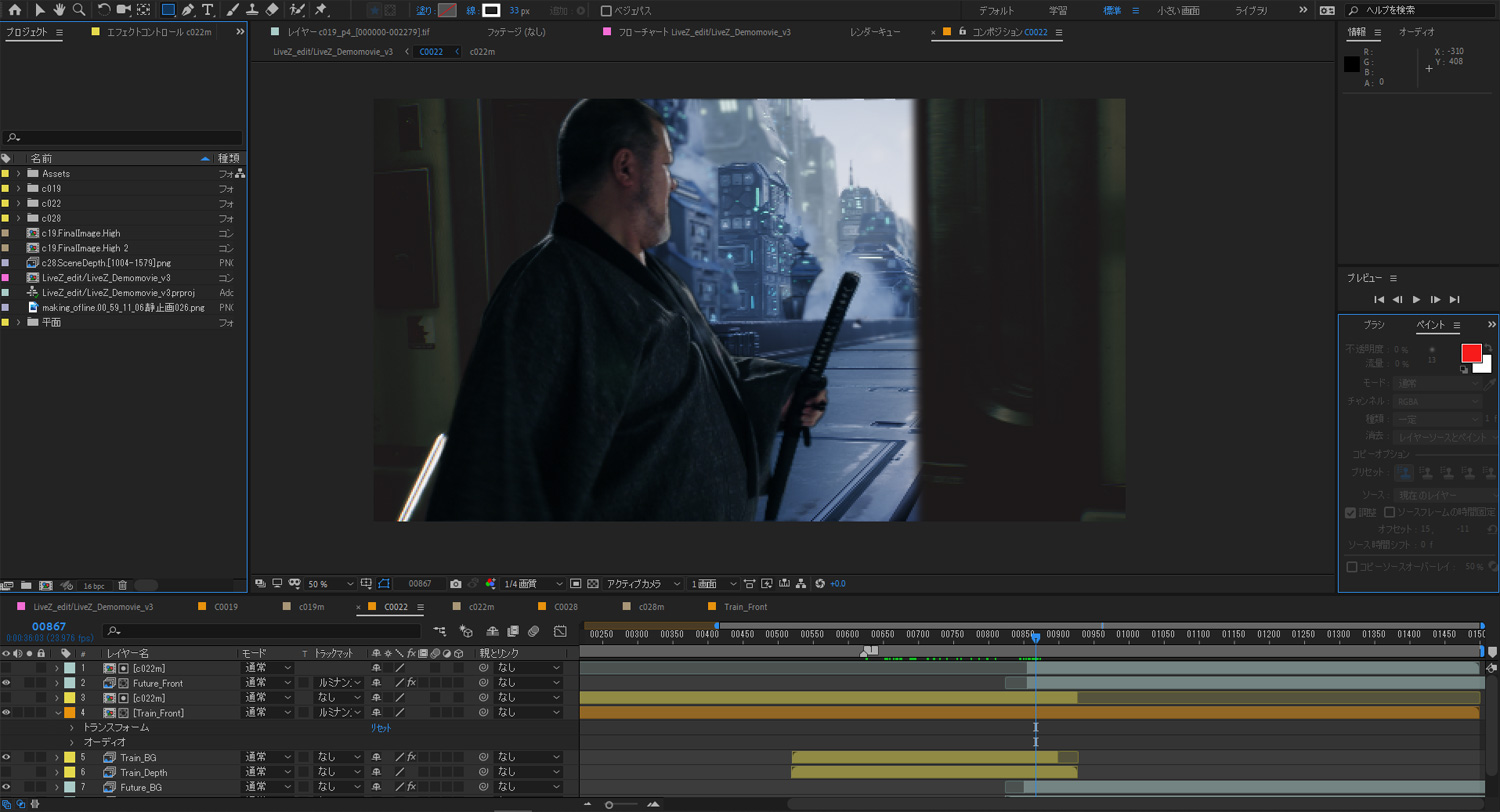

日本のマーケットに合ったバーチャルプロダクションの追求

現代の市街地や電車内部、未来都市の素材は前述の通りUE4のマーケットプレイスからアセットを購入。建物の浮遊アニメーションは三鬼氏がUE4で制作した。1カットに見えるように仕上げられた今回のデモムービー。小林氏はこう語る。「基本的には1カットで見せたいということだったんですが、現代の街から電車に乗る箇所で唯一カットを割っています。もちろん極力1カットに見えるように編集しています。ここはカメラマンさんが横っ飛びでジャンプしているんですが、幸いトラッキングは外れずにそのまま撮影ができました」。また小林氏は、合成の馴染み具合に欠かせないライティングについて「人物と背景を馴染ませるために、UE4のシーンのライティングをベースに、実写の撮影スタジオのライト位置を検討して、シーンごとにキーライトの位置を調整しました」と語った。コンポジット作業は小林氏と市田監督の両名が担当。UE4からOpenEXR形式で出力し、別途用意してもらったデプス素材を活用して人物のぼけ具合を見ながら合成作業を行なった。作業はAEを使用して2人で分担、仕上げは小林氏が担当した。

三鬼氏がバーチャルプロダクションの現状とLiveZ studioの今後について総括した。「バーチャルプロダクションに関しては、ここ半年から1年くらいで開発体制が整ってきましたし、機材を買ってきて使うだけではなく、自分たちの力でつくっていけるフェーズに入ってきていると思います。これからもしっかりと社内で技術を積み上げていきたいです。海外を見ると、日本より実績が圧倒的に多くて、規模も大きいです。当社も以前からバーチャルプロダクションの構想があって、日本のマーケットに合うかたちを模索しながらスタジオのデジタル化をしたいと考えています。全体的なワークフローとLiveZ studioの改良をひき続き進めて、モーションキャプチャ(VICON)も併用しつつ、また何かしら新たなデモムービーをお見せできるかもしれません」。最後に、今回のデモムービーについて市田監督が総括した。「入社して初めてディレクターとして立たせてもらい、とても楽しくやりがいのあるプロジェクトになりました。もちろんこの1作品で終わらせたくないので、ひき続きディレクターとしてがんばっていきたいです。LiveZ studio、AIマスクはひとつの強力な武器として、ツークンにはほかにも最新の技術が整っていますので、その総合力を活かして今後も新たにより良いものをつくっていこうと思っています」。

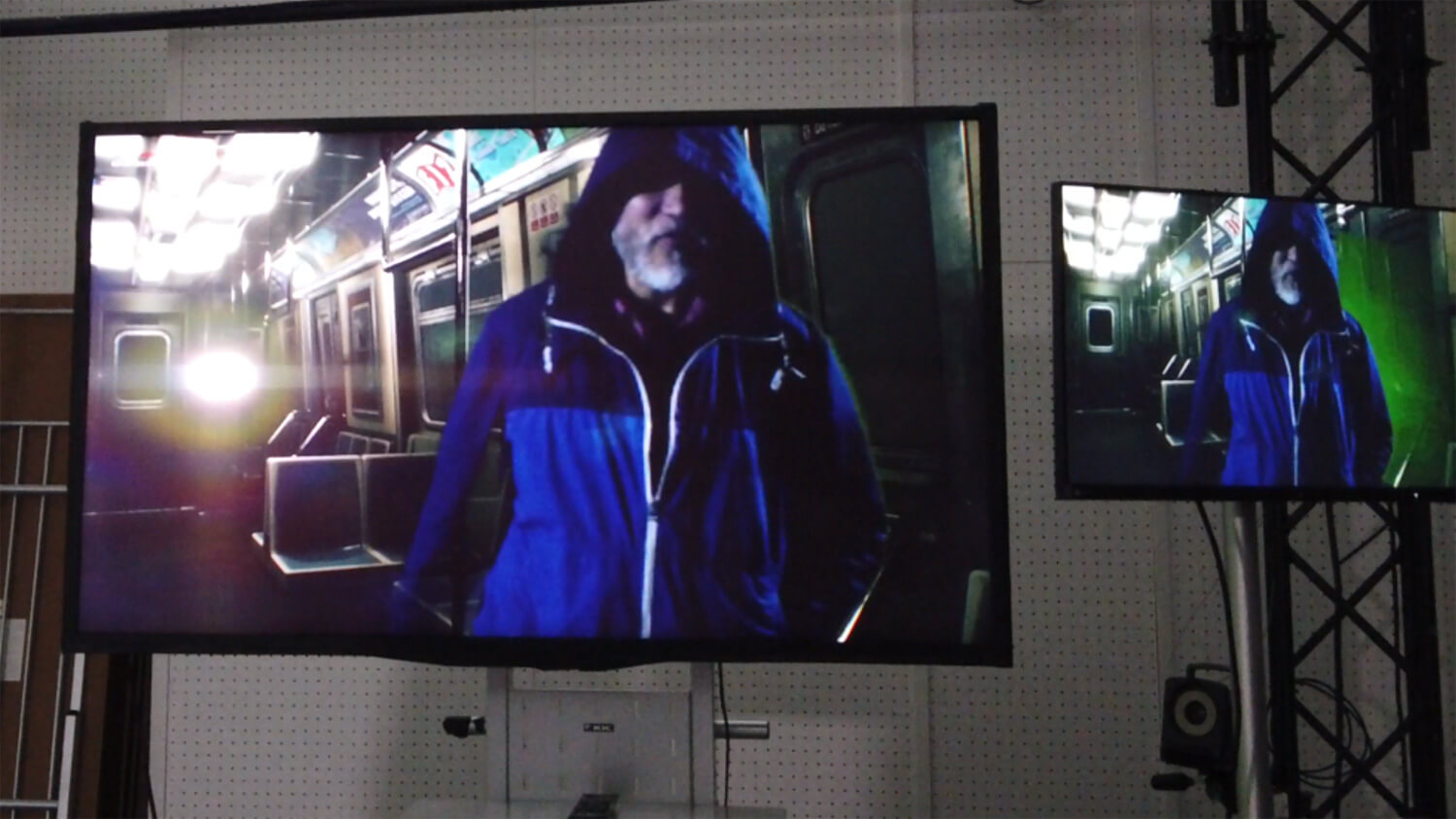

電車内のシーン

デモムービー1:10、電車内のシーン

▲UE4による電車内アセットのライト位置に合わせて、撮影場所に照明を設置

▲3Dシーンと撮影場所の距離縮尺を合わせてあるので、ドアからドアへの移動シーンも合成結果を見ながら正確に撮影できた

▲作業時は低解像度の連番RGBAファイルをロードし動作を軽くし、レンダリング時は自動的にフル解像度の素材に差し替わるようになっている

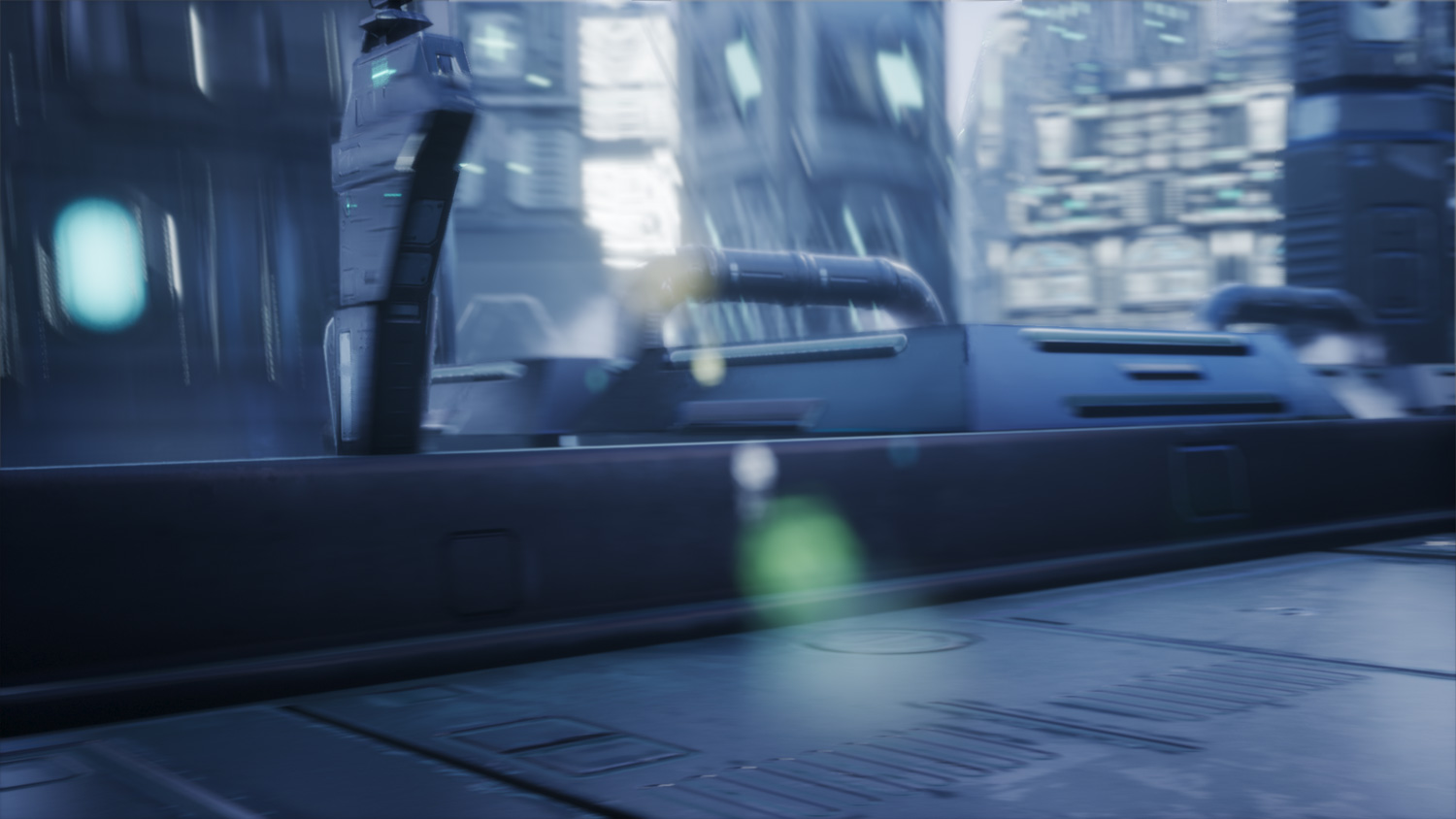

未来都市へ移動するカットのブレイクダウン

デモムービー1:20、電車のドアが開き、まばゆい光を受けて未来都市へと舞台を移すカットのブレイクダウン

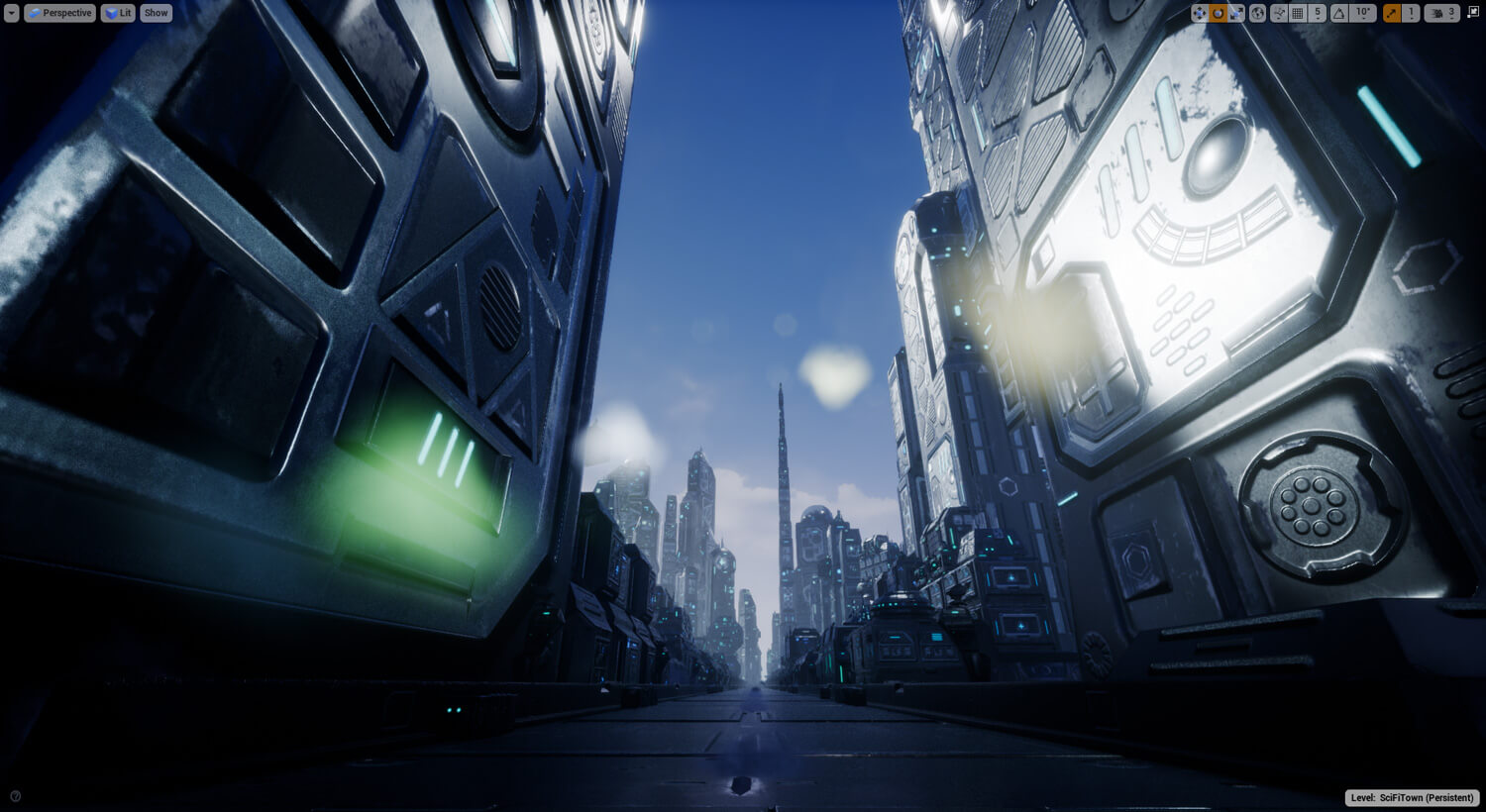

未来都市のシーン

未来都市のシーンは、一部のビル群が地中から現れ上昇するという演出が施されている

▲上空から見下ろしたビル群のシーン。撮影前の段階ではビル群の上昇アニメーションは仮制作状態にしておき、撮影後に実写のタイミングを見ながらアニメーションを微調整。これにより作業量が最小限で済んでいる

▲デモムービー1:34のUE4作業画面。3D空間に実写プレートが入っているため、CG背景のハレーションが実写の画に自然なかたちで乗り、馴染みが良い

未来都市のブレイクダウン

デモムービー1:27、電車から飛び降りて未来都市の壮大な景色に感激するカットのブレイクダウン

▲AEによるコンポジット作業UI